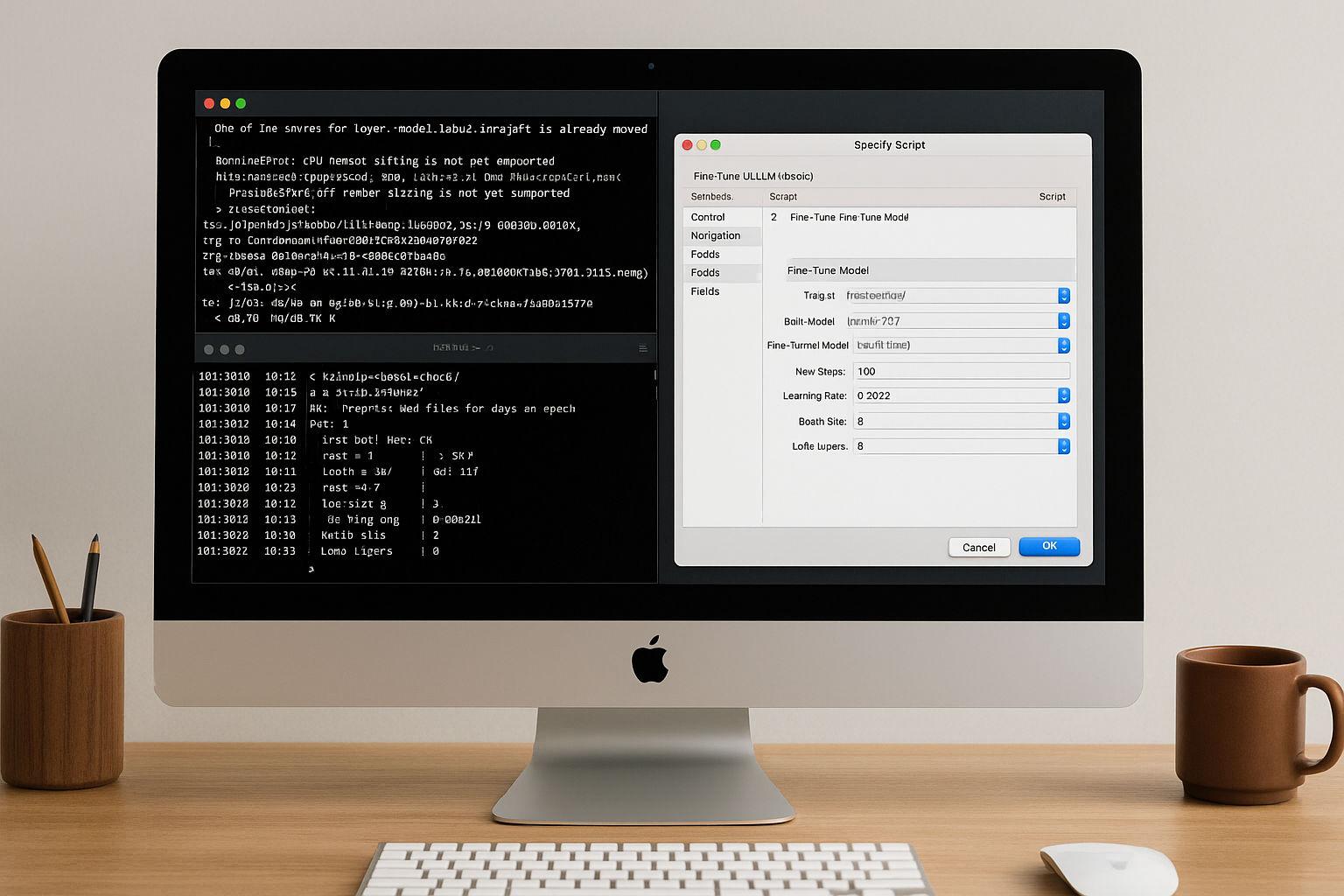

Локальный ИИ на Mac уже давно применяется на практике - особенно на компьютерах Apple-Silicon (серия M). С Ollama вы получаете среду выполнения для многих языковых моделей с открытым исходным кодом (например, Llama 3.1/3.2, Mistral, Gemma, Qwen). Текущая версия Ollama теперь также поставляется с удобным приложением, которое позволяет установить локальную языковую модель на вашем Mac одним щелчком мыши. В этой статье вы найдете прагматичное руководство от установки до первой подсказки - с практическими советами о том, где традиционно все идет не так.

Последние новости о местном искусственном интеллекте

03.04.2026: Google разработал Джемма 4 новое поколение открытые модели ИИ, которые впервые публикуются под коммерчески разрешенной лицензией Apache 2.0. Таким образом, компания делает явный стратегический сдвиг в сторону подлинной открытости и предоставляет разработчикам значительно больше свободы в плане использования, настройки и распространения. Семейство моделей включает в себя несколько вариантов - от небольших локально исполняемых моделей до мощных версий для серверов и рабочих станций. Это означает, что Gemma 4 охватывает широкий спектр аппаратного обеспечения - от смартфонов до центров обработки данных. С точки зрения технологий Gemma 4 базируется на тех же основах, что и собственные модели Gemini от Google, и предлагает такие современные возможности, как обработка текста и изображений, большие контекстные окна и поддержку многих языков.

Местный искусственный интеллект наконец-то стал хорошим ИИ с Арни

В целом Google стремится к демократизации мощного ИИ и поощрению локальных и независимых приложений - подход, который особенно интересен для внутренних ИИ-инсталляций и суверенных решений, основанных на данных.

Преимущества локального ИИ перед облачными системами

Модель на местном языке, такая как Ollama на Mac, предлагает решающие преимущества, которые трудно превзойти, особенно для компаний, разработчиков и пользователей, заботящихся о защите данных.

Суверенитет и защита данных

Все запросы и ответы остаются полностью на вашем компьютере. Чувствительная информация - данные клиентов, внутренние стратегические документы или медицинские данные - никогда не покидает локальную систему. Никакие файлы журналов или механизмы анализа от облачного провайдера не могут быть случайно или намеренно проанализированы.

Отсутствие зависимости от сторонних сервисов

Облачные системы могут менять ценовые модели, вводить ограничения доступа или отключать отдельные функции. При локальной установке вы имеете полный контроль над средой выполнения, версиями и вариантами моделей. Вы обновляете систему, когда хотите, а не когда диктует поставщик.

Калькулируемые затраты

Вместо постоянной платы за каждый запрос или месяц вы делаете единовременные инвестиции в оборудование (например, Mac с достаточным объемом оперативной памяти) и затем работаете с этой моделью неограниченное время. Для решения ресурсоемких задач вы можете целенаправленно расширять аппаратное обеспечение, не беспокоясь о растущих счетах за API.

Возможность работы в автономном режиме

Локальная модель работает и при отсутствии подключения к Интернету - например, в путешествиях, на стройплощадках или в высокозащищенных сетях без внешнего доступа.

Высокая гибкость и интеграция в существующие системы

Еще одно преимущество локальных систем искусственного интеллекта - возможность интеграции. Поскольку Ollama предоставляет локальный сервер API, подключить можно практически любое приложение - от простых скриптов до сложных ERP-систем.

Соединение FileMaker

Используя API Ollama, FileMaker может отправлять запросы непосредственно в модель и сохранять ответы в полях с помощью нескольких строк кода сценария или вызовов плагинов MBS. Это позволяет полностью реализовать в FileMaker автоматический анализ текста, классификацию, перевод или резюме контента - без задержек в облаке и без рисков защиты данных.

Автоматизированные рабочие процессы

Локальная конечная точка API также позволяет интегрировать такие инструменты, как Zapier, n8n или специализированные сценарии Python/bash. Это позволяет автоматизировать сложные процессы, такие как извлечение информации из электронных писем, генерация отчетов или создание текстовых модулей для документов.

Полный контроль над вариантами моделей

Вы можете запускать несколько моделей параллельно, переключаться между ними или загружать специальные модели отсеков, оптимизированные для вашего проекта. Такие настройки, как тонкая настройка или модели LoRA, также могут быть выполнены локально.

Практическое преимущество: скорость реакции и латентность

Один из факторов, который часто недооценивают, - это скорость реакции. В то время как облачные LLM часто задерживаются из-за сетевых путей, ограничений API или нагрузки на сервер, локальные модели - в зависимости от аппаратного обеспечения - реагируют практически в режиме реального времени. Особенно при выполнении повторяющихся задач или интерактивных процессов (например, во время презентации или анализа данных в реальном времени в FileMaker), это может сделать разницу между „спокойной работой“ и „разочарованием от ожидания“.

Какое оборудование подходит для работы с моделями местных языков, какие модели имеют преимущества и Сравнение между Apple Silicon и NVIDIA рассматриваются в отдельной статье.

Текущий обзор использования локальных систем искусственного интеллекта

1) Предпосылки и общие условия

macOS 12 „Monterey“ или новее (рекомендуется последняя версия Sonoma/Sequoia). Для официальной загрузки macOS требуется Monterey+. ollama.com

Предпочтительны Apple Silicon (M1-M4). Также работает на компьютерах Intel Mac, но Apple-Silicon гораздо эффективнее; для больших моделей требуется много оперативной/объединенной памяти. (Размеры библиотеки/модели см. в библиотеке Ollama.) ollama.com

Порт 11434 используется локально для API. Запишите порт - он важен для тестов и интеграций в дальнейшем. GitHubollama.readthedocs.io

Скептический совет в старой доброй традиции: „Установи и работай“ обычно срабатывает - узкими местами являются оперативная память/дисковое пространство (большие файлы GGUF), неправильный вариант модели или параллельные процессы, блокирующие порт.

2) Ollama installieren (Mac)

У вас есть два чистых способа - GUI-установщик или Homebrew. Оба варианта правильны; выберите стиль, который подходит для вашей повседневной жизни.

ВАРИАНТ A: ОФИЦИАЛЬНЫЙ УСТАНОВЩИК MACOS (DMG)

Скачать Ollama для macOS с официального сайта.

Откройте DMG, перетащите приложение в „Программы“, запустите.

(Требуется macOS 12+.) ollama.com

Если вы используете этот вариант 1TP12, вы можете использовать программное обеспечение macOS непосредственно для загрузки модели. Все следующие команды терминала относятся только к возможности автоматизировать языковую модель с помощью скриптов.

ВАРИАНТ B: HOMEBREW (CLI, ЧИСТЫЙ СКРИПТ)

Откройте терминал и (при необходимости) обновите Homebrew:

brew update

Бочка (Вариант приложения) 1TP12Animals:

brew install --cask ollama-app

(Обычно показывает текущее приложение для рабочего стола; на сегодняшний день 0.11.x.) Формулы Homebrew

Или формула (пакет CLI) installieren:

brew install ollama

(Доступны двоичные файлы для Apple-Silicon/Intel.) Формулы Homebrew

Проверьте версию:

ollama --version

(Основные команды и их варианты описаны в официальной документации и в репозитории GitHub). GitHub

3) Запустите и протестируйте службу/сервер

Ollama поставляется с локальным сервером. При необходимости запустите его в явном виде:

ollama serve

Если служба уже запущена (например, через приложение), оболочка может сообщить, что используется порт 11434 - тогда все в порядке.

По умолчанию сервер прослушивает http://localhost:11434.

Проверка работоспособности в браузере:

Звоните на http://localhost:11434/ - экземпляр должен ответить (некоторые инструкции используют эту проверку, поскольку порт активен по умолчанию). Средний

Традиционное предостережение: если ничего не отвечает, часто блокируется старый процесс или пакет безопасности. Проверьте, запущен ли второй терминал с помощью ollama serve - или выйдите из приложения и перезапустите его.

4) Загрузите и используйте первую языковую модель

4.1 ВЫТЯГИВАНИЕ МОДЕЛИ ИЛИ ПРЯМОЙ ЗАПУСК (ЗАПУСК)

Используйте напрямую (тянуть + бежать в одном):

ollama run llama3.1

Только для скачивания:

ollama pull llama3.1

В официальном репо представлены общие команды (run, pull, list, show, ps, stop, rm) и примеры с Llama 3.2, а также другие; идентичные команды для Llama 3.1, Mistral, Gemma и т.д. GitHubnotes.kodekloud.comglukhov.org

Больше страниц моделей / Библиотека:

Llama 3 / 3.1 / 3.2 различных размеров (1B-405B; конечно, большие версии доступны в большом количестве). Просто позвоните по телефону Сайт компании Ollama чтобы найти другие модели и installiere их на вашем Mac.

4.2 ИНТЕРАКТИВНЫЙ ЧАТ (ТЕРМИНАЛ)

Например, запустите Llama 3.1 в режиме чата:

ollama run llama3.1

Затем введите прямой текст:

Вы - полезный помощник. Объясните мне в двух предложениях, что такое индекс в базе данных.

Выйдите из игры, нажав Ctrl+D.

При запуске приложения Ollama на Mac вы также можете напрямую выбрать модель и ввести запрос. Если модель еще не доступна на вашем Mac, она будет загружена автоматически.

4.3 УПРАВЛЕНИЕ МОДЕЛЯМИ

# Какие модели можно приобрести на месте?

ollama list

# Посмотреть детали/квантование/теги:

ollama show llama3.1

# Проверка запущенных процессов модели:

ollama ps

# Остановите работу модели:

ollama stop llama3.1

# Очистить место (удалить модель):

ollama rm llama3.1

(Команды идентичны в нескольких текущих обзорах документально подтверждено.) notes.kodekloud.comGeshan's Blogglukhov.org

5) Используйте HTTP API локально (например, для скриптов, инструментов, интеграций).

Ollama предлагает REST API (по умолчанию http://localhost:11434). Пример звонков:

Сгенерировать (простая подсказка):

curl http://localhost:11434/api/generate -d '{

"model": "llama3.1",

"prompt": "Erkläre kurz den Unterschied zwischen RAM und SSD.",

"stream": false

}'

Чат (на основе ролей):

curl http://localhost:11434/api/chat -d '{

"model": "llama3.1",

"messages": [

{ "role": "system", "content": "Du antwortest knapp und sachlich." },

{ "role": "user", "content": "Was ist eine Normalisierung in Datenbanken?" }

],

"stream": false

}'

(Конечные точки, поведение потоков и поля описаны в официальном Документация по API/GitHub описано).

Подсказка по достижимости:

Локально все доступно через localhost.

Если Mac должен быть доступен в локальной сети, намеренно привяжите Ollama к сетевому адресу, например:

export OLLAMA_HOST=0.0.0.0 ollama serve

(Доступ к серверу можно получить через IP-адрес в сети. Проверьте безопасность!) Reddit

Mixed-Content/HTTPS (только если браузерные интеграции не работают):

Некоторые дополнения/браузеры (особенно Safari) блокируют HTTP-вызовы из HTTPS-контекстов. В таких случаях помогает локальный обратный прокси с HTTPS.

6) Практические советы для Mac (опыт и консервативный уход)

- Начните с консервативного подхода к выбору моделиНачните с меньших количеств (например, с 4-битных вариантов), проверьте качество, а затем постепенно увеличивайте ключ.

- Следите за памятью и дисками: Большие модели занимают несколько гигабайт - ollama show поможет с категоризацией. notes.kodekloud.com

- Apple-Silicon и металлOllama использует ускорение Apple (Metal) на Mac. Ошибки драйверов/металла могут возникать в последних сборках модели - обновляйте Ollama и следите за известными проблемами. GitHub

- Портовые конфликтыЕсли ollama serve жалуется, значит, приложение или другой процесс уже прослушивает 11434 - либо закройте приложение, либо остановите CLI-сервер. postman.com

7) Частые минимальные рабочие процессы (копирование и вставка)

A) Новая1TP12Тация и первый чат (Llama 3.1)

# Installation (eine Variante wählen) brew install --cask ollama-app # oder brew install ollama# Server starten (falls App nicht läuft) ollama serve # Erstes Modell testen ollama run llama3.1

(„run“ загружает модель, если она еще не существует.) Homebrew Formulae+1GitHub

B) Подготовьте модель в автономном режиме (сначала достаньте, потом используйте)

ollama pull mistral ollama show mistral ollama run mistral

(„Мистраль“ - обычная, компактная модель - хорошо подходит для начальных испытаний).

C) Интеграция API в скрипт/инструмент

curl http://localhost:11434/api/generate -d ‚{

„Модель“: „llama3.1“,

„prompt“: „Назовите мне три консервативные причины, по которым документация важнее автоматизации“.“

}‘

(Примеры API - 1:1 из официальная ссылка взято из)

8) Где я могу найти модели?

Библиотека Ollama содержит курируемые модели с тегами/размерами (Llama 3.1/3.2, Gemma, Qwen и т.д.). Выбирайте модели по назначению (чат, инструменты, вставки) и размеру. Вы можете создавать новые модели прямо в приложении Ollama на Mac или на Сайт компании Ollama найти.

9) Что делать, если что-то пошло не так?

- список оллама / оллама пс проверьте: Доступна/активна ли нужная модель?

- ollama show Просмотр: Какое квантование/размер был загружен? Соответствует ли это оперативной памяти Mac? notes.kodekloud.com

Обновление:

brew upgrade ollama ollama-app

Просмотр вопросов: Иногда случаются металлические ошибки, особенно в очень новых моделях/функциях; обновление или изменение варианта модели часто помогает.

10) Альтернативы с удобством для Mac (GUI)

Если вы предпочитаете использовать графический интерфейс с большим количеством опций или хотите просматривать/менять модели:

Студия LM - популярный фронтенд для Mac с интегрированным загрузчиком, чат-интерфейсом и локальным сервером API. Ссылка на страницу загрузки и примечания к выпуску. LM Studio+1Uptodown

(Существуют также сторонние пользовательские интерфейсы, такие как Open WebUI, которые можно подключить к Ollama - но для большинства Mac-установок достаточно Ollama + Terminal или LM Studio).

С помощью Ollama вы сможете создать локальную среду LLM на Mac всего за несколько минут - классическим, понятным способом и без зависимости от облака. Следуйте проверенным шагам (Installer/Brew → ollama serve → ollama run), проверьте ресурсы и пройдите путь от малого к большому. Если вы предпочитаете кликать, а не набирать текст, LM Studio - отличная альтернатива на Mac. ollama.comGitHubLM Studio

Удачи - и придерживайтесь критической системы: сначала правильно документируйте, затем автоматизируйте.

Новая серия статей: Использование экспорта данных ChatGPT в качестве персональной памяти ИИ

Если у вас уже есть локальный ИИ с Ollama на Mac installiert, вы можете сделать следующий шаг: построить свою собственную систему знаний. В новой серии статей я покажу вам, как Используйте экспорт данных ChatGPT для создания базы персональных знаний. Вместо того чтобы разговоры исчезали в истории чата, их можно экспортировать, обработать в структурированном виде и интегрировать в векторную базу данных. Таким образом, создается искусственный интеллект, который может получить доступ к вашим собственным мыслям, идеям и анализу. В этой серии вы шаг за шагом пройдете весь процесс - от экспорта данных до встраивания и интеграции в систему RAG. Таким образом, простые истории чатов постепенно превращаются в цифровую память для вашего собственного ИИ.

Если у вас уже есть локальный ИИ с Ollama на Mac installiert, вы можете сделать следующий шаг: построить свою собственную систему знаний. В новой серии статей я покажу вам, как Используйте экспорт данных ChatGPT для создания базы персональных знаний. Вместо того чтобы разговоры исчезали в истории чата, их можно экспортировать, обработать в структурированном виде и интегрировать в векторную базу данных. Таким образом, создается искусственный интеллект, который может получить доступ к вашим собственным мыслям, идеям и анализу. В этой серии вы шаг за шагом пройдете весь процесс - от экспорта данных до встраивания и интеграции в систему RAG. Таким образом, простые истории чатов постепенно превращаются в цифровую память для вашего собственного ИИ.

Часто задаваемые вопросы

- Что на самом деле означает „локальный ИИ“ - и почему я должен запускать языковую модель на своем Mac?

Локальный ИИ означает, что языковая модель работает полностью на вашем компьютере, а не обращается к внешним серверам через интернет-соединение. Модель управляется локально 1TP12 и обрабатывает введенные вами данные непосредственно на вашем устройстве. Основными преимуществами являются защита данных, контроль и независимость: ваши данные не покидают ваш компьютер, нет затрат на API и зависимости от облачных провайдеров. В то же время вы можете настроить систему под свои нужды, интегрировать собственные данные или даже разработать собственные рабочие процессы. Поэтому для многих пользователей - разработчиков, авторов или компаний с конфиденциальными данными - локальный ИИ является особенно интересной альтернативой облачным сервисам. - Какие преимущества дает Ollama по сравнению с другими инструментами для создания локальных языковых моделей?

Ollama быстро стал одним из самых популярных инструментов для локального ИИ, поскольку значительно упрощает многие сложные этапы. Вместо того чтобы вручную загружать, настраивать и запускать модели, Ollama в значительной степени берет на себя эти задачи автоматически. Как правило, языковая модель создается и запускается с помощью одной команды install. Ollama также предлагает REST API, благодаря чему модели могут быть легко интегрированы в ваши собственные программы - скрипты, базы данных или приложения. Это делает Ollama подходящим как для новичков, которые хотят быстро опробовать модель, так и для разработчиков, которые хотят интегрировать локальный ИИ в свои собственные программные проекты. - Каким требованиям должен соответствовать мой Mac, чтобы запустить языковую модель локально?

Для достижения хороших результатов мы рекомендуем использовать Mac с процессором Apple-Silicon (M1, M2, M3 или новее). Эти чипы имеют архитектуру, которая особенно хорошо подходит для вычислений ИИ, например, благодаря структурам общей памяти и GPU-ускорению. Также важно иметь достаточный объем памяти и достаточно свободного места для хранения данных, поскольку языковые модели могут иметь размер в несколько гигабайт. Небольшие модели уже работают на устройствах с умеренным объемом памяти, в то время как для больших моделей требуется значительно больше оперативной памяти. Не помешает и актуальная версия macOS, так как многие инструменты ИИ оптимизированы для современных системных библиотек. - Какие языковые модели можно использовать с Ollama на Mac?

Ollama поддерживает ряд современных языковых моделей с открытым исходным кодом. К ним относятся, например, варианты Llama, Mistral, Gemma или Qwen. Эти модели различаются по размеру, производительности и стилю. Некоторые из них довольно компактны и быстро работают на небольших компьютерах, другие больше и дают более сложные ответы. Большим преимуществом является то, что вы можете сравнить и опробовать различные модели, не перестраивая свою инфраструктуру. Это создает гибкую среду, в которой вы можете выбрать модель, наиболее подходящую для ваших задач. - Насколько сложна установка локальной языковой модели с Ollama?

Установка стала намного проще, чем несколько лет назад. Во многих случаях процесс состоит всего из нескольких шагов: Сначала installier Ollama на вашем Mac, затем загрузите языковую модель и запустите ее через терминал или графический интерфейс пользователя. Модель будет подготовлена автоматически, после чего ее можно будет использовать напрямую. Многие пользователи удивляются тому, как быстро происходит этот процесс. Даже не обладая глубокими техническими знаниями, можно за несколько минут настроить функционирующую локальную систему искусственного интеллекта. - Почему локальный ИИ особенно хорошо работает на компьютерах Apple-Silicon Mac?

Процессоры Apple-Silicon были разработаны с учетом современных вычислительных задач, включая машинное обучение. В них используется так называемая унифицированная архитектура памяти, при которой CPU, GPU и другие вычислительные блоки используют одну и ту же память. Это позволяет эффективнее обрабатывать большие объемы данных. Это большое преимущество для моделей ИИ, поскольку языковые модели должны постоянно обращаться к большим структурам данных в процессе вывода. Такие инструменты, как Ollama или MLX, целенаправленно используют эту архитектуру и в результате достигают удивительно высокой производительности - даже без выделенной видеокарты. - Как быстро работает локальная языковая модель на Mac?

Скорость работы зависит в основном от трех факторов: используемой модели, объема оперативной памяти Mac и производительности процессора. Маленькие модели часто реагируют практически в режиме реального времени, в то время как большие модели могут работать медленнее. Однако компьютеры Mac Apple-Silicon удивительно мощные и могут с легкостью запускать многие популярные модели. Для экспериментальных проектов или личных рабочих процессов производительности обычно более чем достаточно. Если вам нужна особенно быстрая реакция, можно использовать более компактные или сжатые модели. - Могу ли я также работать в автономном режиме с местным искусственным интеллектом?

Да, это одно из самых больших преимуществ. После загрузки модели больше не требуется подключение к Интернету. Все расчеты происходят прямо на вашем Mac. Это означает, что вы можете использовать ИИ в дороге, без сети или в изолированной среде. Для многих профессиональных приложений - например, для работы с конфиденциальными документами или внутреннего анализа - такая возможность работы в автономном режиме является решающим преимуществом. - Насколько безопасны мои данные, если я использую языковую модель локально?

Если модель работает полностью локально, ваши данные всегда остаются на вашем компьютере. Автоматического переноса на внешние серверы не происходит. Это означает, что вы можете работать с конфиденциальными текстами, не беспокоясь об облачном хранилище или несанкционированном доступе. Конечно, безопасность все равно зависит от того, как настроена ваша система - например, имеют ли другие программы доступ к вашим данным. Но в целом локальный ИИ обеспечивает гораздо больший контроль над вашей информацией. - Можно ли обучить или расширить модель местного языка на собственных данных?

Да, это возможно, но обычно не напрямую через базовую систему. Многие пользователи объединяют локальные языковые модели с так называемыми системами RAG или базами данных, чтобы интегрировать свой собственный контент. Для этого необходимо проанализировать документы или тексты и сохранить их в векторной базе данных. Впоследствии языковая модель может получить доступ к этому контенту и включить его в свои ответы. Таким образом, ИИ может специализироваться на собственных знаниях без необходимости полного переобучения модели. - В чем разница между языковой моделью и приложением с искусственным интеллектом, таким как ChatGPT?

Языковая модель - это, по сути, просто „двигатель“ ИИ - нейронная сеть, которая анализирует и генерирует тексты. Такие сервисы, как ChatGPT, представляют собой полноценные платформы, объединяющие модель с пользовательским интерфейсом, облачной инфраструктурой и дополнительными функциями. Если вы используете языковую модель локально installier, вы работаете напрямую с этой базовой системой. Это дает вам больше контроля, но вам также придется самостоятельно решать, какие дополнительные инструменты или интерфейсы вы хотите использовать. - Сколько места на Mac занимает модель местного языка?

Размер языковой модели может сильно различаться. Небольшие модели требуют всего несколько гигабайт памяти, в то время как большие варианты могут занимать значительно больше места. Оперативная память также необходима для загрузки модели во время выполнения. Однако для многих практических приложений достаточно компактных моделей, которые используют относительно мало памяти и при этом обладают удивительной мощностью. - Можно ли одновременно запускать несколько моделей на Mac 1TP12?

Да, это действительно большое преимущество локальных сред AI. Вы можете загрузить несколько моделей и запускать их по мере необходимости. Одни лучше подходят для творческих текстов, другие - для технического анализа или программного кода. Такая гибкость позволяет использовать среду ИИ как набор инструментов и выбирать модель, которая лучше всего подходит для конкретной задачи. - Можно ли интегрировать Ollama в ваши собственные программы?

Да, Ollama предлагает интерфейс прикладного программирования (API), который другие приложения могут использовать для доступа к языковой модели. Это позволяет интегрировать локальный ИИ в собственные проекты - например, в скрипты, автоматизированные системы или системы баз данных. Разработчики часто используют эту возможность для создания собственных ИИ-помощников или добавления интеллектуальных функций в существующее программное обеспечение. - Является ли локальная языковая модель такой же мощной, как и большие облачные модели?

Во многих случаях это не совсем так - по крайней мере, когда вы сравниваете очень большие модели с миллиардами параметров. Облачные провайдеры используют чрезвычайно мощное оборудование и поэтому могут запускать очень большие модели. Локальные модели часто более компактны, чтобы их можно было запустить на обычном компьютере. Тем не менее, они обладают потрясающей мощностью для многих практических задач и могут писать, анализировать или структурировать тексты. Такой производительности вполне достаточно для многих рабочих процессов. - Почему все больше людей интересуются локальным искусственным интеллектом, а не облачными сервисами?

Одна из важных причин - контроль над данными и инфраструктурой. Многие пользователи не хотят постоянно передавать свой контент внешним сервисам. Локальные системы также могут быть дешевле в долгосрочной перспективе из-за отсутствия постоянных затрат на API. Для разработчиков и технически подкованных пользователей есть еще одно преимущество: они могут сами разрабатывать и экспериментировать со своей средой ИИ. Это создает новую форму технического суверенитета. - Можно ли потом объединить локальный ИИ с другими системами?

На самом деле, это одна из самых интересных возможностей. Локальные языковые модели могут быть подключены к базам данных, платформам автоматизации или вашим собственным программам. Это может привести к созданию сложных рабочих процессов - например, систем, которые анализируют документы, обобщают контент или извлекают знания из собственных баз данных. Такие комбинации часто служат основой для специализированных ИИ-помощников или автоматизированных инструментов анализа. - Для кого локальный ИИ на Mac особенно полезен?

Он особенно интересен разработчикам, авторам, аналитикам и компаниям, которые регулярно работают с текстами или данными. Локальный ИИ - это также интересный вариант для технически подкованных пользователей, которые хотят сами контролировать свою цифровую инфраструктуру. Он позволяет использовать современные технологии ИИ, не завися от крупных платформ. В частности, на мощных компьютерах Mac это позволяет создать среду, которая может быть удивительно универсальной и продуктивной.