La IA local en Mac es práctica desde hace tiempo, especialmente en los ordenadores Apple-Silicon (serie M). Con Ollama se obtiene un entorno de ejecución sencillo para muchos modelos lingüísticos de código abierto (por ejemplo, Llama 3.1/3.2, Mistral, Gemma, Qwen). La versión actual de Ollama también incluye una aplicación fácil de usar que le permite configurar un modelo lingüístico local en su Mac con un simple clic del ratón. En este artículo encontrarás una guía pragmática desde la instalación hasta la primera consulta, con consejos prácticos sobre dónde suelen fallar las cosas.

Últimas noticias sobre la IA local

03.04.2026Google ha desarrollado Gemma 4 una nueva generación que se publican por primera vez bajo la licencia Apache 2.0, comercialmente permisiva. La empresa da así un claro giro estratégico hacia una auténtica apertura y ofrece a los desarrolladores mucha más libertad de uso, personalización y redistribución. La familia de modelos incluye diversas variantes, desde pequeños modelos ejecutables localmente hasta potentes versiones para servidores y estaciones de trabajo. Esto significa que Gemma 4 cubre una amplia gama de hardware, desde teléfonos inteligentes hasta centros de datos. Desde el punto de vista tecnológico, Gemma 4 se basa en fundamentos similares a los de los modelos Gemini, propiedad de Google, y ofrece funciones modernas como procesamiento de texto e imágenes, ventanas contextuales de gran tamaño y compatibilidad con numerosos idiomas.

La IA local por fin es buena AI con Arnie

En general, Google pretende democratizar en mayor medida la potente IA y fomentar las aplicaciones locales e independientes, un enfoque que resulta especialmente interesante para las instalaciones internas de IA y las soluciones soberanas de datos.

Ventajas de la IA local sobre los sistemas en la nube

Un modelo de idioma local como Ollama en Mac ofrece ventajas decisivas difíciles de superar, especialmente para empresas, desarrolladores y usuarios preocupados por la protección de datos.

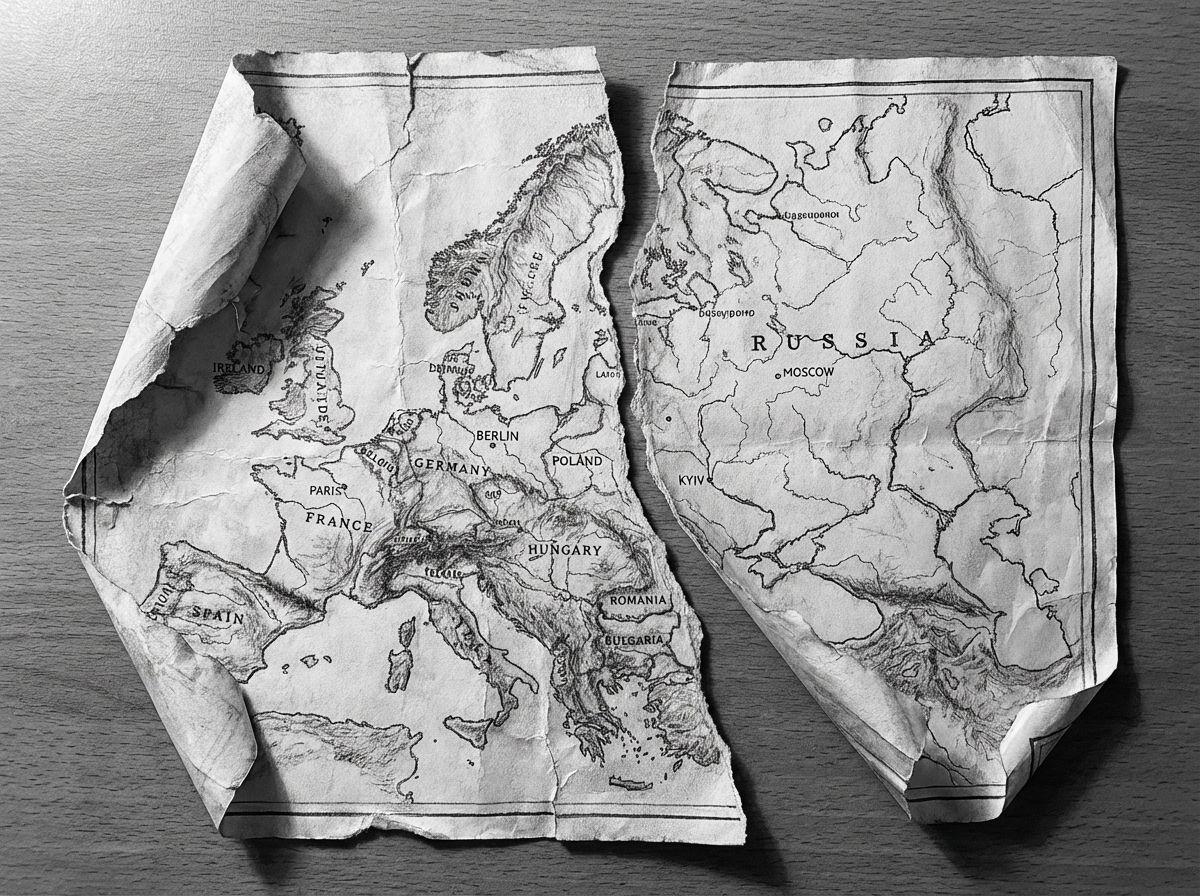

Soberanía y protección de datos

Todas las consultas y respuestas permanecen completamente en su propio ordenador. La información sensible -datos de clientes, documentos de estrategia interna o datos médicos- nunca sale del sistema local. No hay archivos de registro ni mecanismos de análisis de un proveedor en la nube que puedan ser analizados inadvertida o intencionadamente.

Sin dependencia de servicios de terceros

Los sistemas en la nube pueden cambiar los modelos de precios, introducir restricciones de acceso o desactivar funciones concretas. Con una instalación local, tienes pleno control sobre el entorno de ejecución, las versiones y las variantes del modelo. Usted realiza las actualizaciones cuando quiere, no cuando se lo dicta un proveedor.

Costes calculables

En lugar de cuotas continuas por solicitud o mes, usted hace una inversión única en hardware (por ejemplo, un Mac con suficiente RAM) y luego trabaja con el modelo indefinidamente. Para tareas informáticas intensivas, puede ampliar el hardware de forma puntual sin preocuparse por el aumento de las facturas de API.

Capacidad offline

Un modelo local también funciona cuando no hay conexión a Internet disponible, por ejemplo, cuando se viaja, en obras o en redes de alta seguridad sin acceso externo.

Gran flexibilidad e integración en los sistemas existentes

Otra ventaja de los sistemas locales de IA es su capacidad de integración. Como Ollama proporciona un servidor API local, se puede conectar casi cualquier aplicación, desde simples scripts hasta complejos sistemas ERP.

Conexión FileMaker

Gracias a la API Ollama, FileMaker puede enviar solicitudes directamente al modelo y almacenar las respuestas en campos con sólo unas líneas de código de script o mediante llamadas a complementos MBS. De este modo, los análisis de texto automatizados, las clasificaciones, las traducciones o los resúmenes de contenido pueden implementarse íntegramente en FileMaker, sin latencia en la nube y sin riesgos para la protección de datos.

Flujos de trabajo automatizados

El punto final de la API local también permite integrar herramientas como Zapier, n8n o scripts Python/bash personalizados. Esto permite automatizar procesos complejos, como extraer información de correos electrónicos, generar informes o crear módulos de texto para documentos.

Control total de las variantes del modelo

Puede ejecutar varios modelos en paralelo, alternar entre ellos o cargar modelos de compartimentos especiales optimizados para su proyecto. También se pueden realizar localmente personalizaciones como ajustes finos o modelos LoRA.

Ventaja práctica: velocidad de reacción y latencia

Un factor que a menudo se subestima es la velocidad de respuesta. Mientras que los LLM en la nube suelen sufrir retrasos por las rutas de red, los límites de la API o la carga del servidor, los modelos locales -dependiendo del hardware- responden casi en tiempo real. Especialmente con tareas repetitivas o procesos interactivos (por ejemplo, durante una presentación o un análisis de datos en directo en FileMaker), esto puede marcar la diferencia entre "trabajo fluido" y "frustración por la espera".

Qué hardware es adecuado para ejecutar modelos lingüísticos locales, qué modelos tienen qué ventajas y un Comparación entre Apple Silicon y NVIDIA se han tratado en otro artículo.

Encuesta actual sobre el uso de sistemas locales de IA

1) Requisitos previos y condiciones generales

macOS 12 "Monterey" o posterior (recomendado: última versión de Sonoma/Sequoia). La descarga oficial de macOS requiere Monterey+. ollama.com

Preferiblemente Apple Silicon (M1-M4). También funciona en Macs Intel, pero Apple-Silicon es mucho más eficiente; los modelos grandes necesitan mucha RAM/memoria unificada. (Para tamaños de bibliotecas/modelos, véase la biblioteca Ollama.) ollama.com

El puerto 11434 se utiliza localmente para la API. Anota el puerto, es importante para las pruebas e integraciones posteriores. GitHubollama.readthedocs.io

Consejo escéptico según la vieja tradición: "Instalar y listo" suele funcionar - los cuellos de botella son el espacio en RAM/disco (archivos GGUF grandes), la variante de modelo equivocada o los procesos paralelos que bloquean el puerto.

2) Ollama installieren (Mac)

Tienes dos formas limpias - instalador GUI o Homebrew. Ambos son correctos, elija el estilo que se adapte a su vida cotidiana.

OPCIÓN A: INSTALADOR OFICIAL DE MACOS (DMG)

Descargar Ollama para macOS del sitio oficial.

Abre el DMG, arrastra la aplicación a "Programas" e iníciala.

(Requiere macOS 12+.) ollama.com

Si utiliza esta variante 1TP12, puede utilizar directamente el software macOS para descargar el modelo. Todos los comandos de terminal siguientes solo se refieren a poder automatizar el modelo lingüístico mediante script.

VARIANTE B: HOMEBREW (CLI, CLEAN SCRIPTABLE)

Abra el terminal y (si es necesario) actualice Homebrew:

brew update

Barrica (Variante de aplicación) 1TP12Animales:

brew install --cask ollama-app

(Normalmente muestra la aplicación de escritorio actual; a partir de hoy 0.11.x.) Homebrew Fórmulas

O la fórmula (paquete CLI) installieren:

brew install ollama

(Binarios disponibles para Apple-Silicon/Intel.) Iniciobrew Fórmulas

Comprueba la versión:

ollama --version

(Los comandos básicos y las variantes están documentados en la documentación oficial y en el repositorio de GitHub). GitHub

3) Iniciar y probar el servicio/servidor

Ollama viene con un servidor local. Inícielo explícitamente si es necesario:

ollama serve

Si el servicio ya se está ejecutando (por ejemplo, a través de la aplicación), el intérprete de comandos puede informar de que el puerto 11434 está en uso - entonces todo está bien.

Por defecto, el servidor escucha en http://localhost:11434.

Prueba de funcionamiento en el navegador:

Llame a http://localhost:11434/ - la instancia debe responder (algunas instrucciones utilizan esta comprobación porque el puerto está activo por defecto). Medio

Precaución tradicional: Si nada responde, un proceso antiguo o una suite de seguridad suelen estar bloqueando. Comprueba si sigue funcionando un segundo terminal con ollama serve, o cierra/reinicia la aplicación.

4) Cargar y utilizar el primer modelo lingüístico

4.1 TIRAR DEL MODELO O ARRANCAR DIRECTAMENTE (RUN)

Utilizar directamente (tirar + correr en uno):

ollama run llama3.1

Sólo descarga:

ollama pull llama3.1

El repositorio oficial muestra los comandos comunes (run, pull, list, show, ps, stop, rm) y ejemplos con Llama 3.2, entre otros; idénticos para Llama 3.1, Mistral, Gemma, etc. GitHubnotes.kodekloud.comglukhov.org

Más páginas modelo / biblioteca:

Llama 3 / 3.1 / 3.2 en diferentes tamaños (1B-405B; por supuesto, las variantes grandes están disponibles en versiones muy cuantificadas). Basta con llamar al Página web de Ollama para encontrar otros modelos y installiere en tu Mac.

4.2 CHAT INTERACTIVO (TERMINAL)

Por ejemplo, inicia Llama 3.1 en modo chat:

ollama run llama3.1

A continuación, escriba directamente:

Eres un ayudante muy útil. Explícame en dos frases qué es un índice en una base de datos.

Salga con Ctrl+D.

Cuando inicie la aplicación Ollama en su Mac, también puede seleccionar un modelo directamente e introducir una consulta. Si el modelo aún no está disponible en tu Mac, se descargará automáticamente.

4.3 GESTIONAR MODELOS

# ¿Qué modelos están disponibles localmente?

ollama list

# Ver detalles/cuantificación/etiquetas:

ollama show llama3.1

# Comprobar los procesos del modelo en ejecución:

ollama ps

# Modelo de parada:

ollama stop llama3.1

# Despejar espacio (borrar modelo):

ollama rm llama3.1

(Los comandos son idénticos en varios resúmenes actuales documentado.) notes.kodekloud.comBlog de Geshanglukhov.org

5) Utilizar la API HTTP localmente (por ejemplo, para scripts, herramientas, integraciones)

Ollama ofrece una API REST (por defecto http://localhost:11434). Ejemplo de llamadas:

Generar (consulta simple):

curl http://localhost:11434/api/generate -d '{

"model": "llama3.1",

"prompt": "Erkläre kurz den Unterschied zwischen RAM und SSD.",

"stream": false

}'Chat (basado en roles):

curl http://localhost:11434/api/chat -d '{

"model": "llama3.1",

"messages": [

{ "role": "system", "content": "Du antwortest knapp und sachlich." },

{ "role": "user", "content": "Was ist eine Normalisierung in Datenbanken?" }

],

"stream": false

}'(Los puntos finales, el comportamiento de transmisión y los campos se describen en el documento oficial Documentación de la API/GitHub descrito).

Sugerencia de alcanzabilidad:

Localmente, todo es accesible a través de localhost.

Si el Mac debe ser accesible en la LAN, vincule deliberadamente Ollama a una dirección de red, por ejemplo

export OLLAMA_HOST=0.0.0.0 ollama serve

(A continuación, se puede acceder al servidor a través de la IP de la red. Compruebe el aspecto de seguridad) Reddit

Mixed-Content/HTTPS (sólo si las integraciones de navegador no funcionan):

Algunos complementos/navegadores (especialmente Safari) bloquean las llamadas HTTP desde contextos HTTPS. En tales casos, un proxy inverso local con HTTPS ayuda.

6) Consejos prácticos para el Mac (experiencia y cuidados conservadores)

- Empezar de forma conservadora con la selección de modelosComience con cuantificaciones más pequeñas (por ejemplo, variantes de 4 bits), compruebe la calidad y, a continuación, aumente lentamente la clave.

- Vigila la memoria y el disco: Los modelos grandes ocupan varios GB - ollama show ayuda con la categorización. notes.kodekloud.com

- Apple-Silicon y metalOllama utiliza la aceleración Apple (Metal) en el Mac. Es posible que se produzcan errores de controlador/Metal con modelos muy recientes. Mantén Ollama actualizado y estate atento a los problemas conocidos. GitHub

- Conflictos portuariosSi ollama serve se queja, la aplicación u otro proceso ya está escuchando por 11434 - cierre la aplicación o detenga el servidor CLI. postman.com

7) Frecuentes flujos de trabajo mínimos (copiar y pegar)

A) Nuevainstallación y primer chat (Llama 3.1)

# Installation (eine Variante wählen) brew install --cask ollama-app # oder brew install ollama# Server starten (falls App nicht läuft) ollama serve # Erstes Modell testen ollama run llama3.1

("ejecutar" carga el modelo si aún no existe.) Iniciobrew Formulae+1GitHub

B) Preparar el modelo fuera de línea (tirar primero, usar después)

ollama pull mistral ollama show mistral ollama run mistral

("mistral" es un modelo común y compacto, bueno para las pruebas iniciales).

C) Integración de la API en un script/herramienta

curl http://localhost:11434/api/generate -d '{

"modelo": "llama3.1",

"prompt": "Dame tres razones conservadoras para la documentación sobre la automatización".

}‘

(Los ejemplos de API son 1:1 del referencia oficial tomado de)

8) ¿Dónde puedo encontrar modelos?

La biblioteca Ollama contiene modelos curados con etiquetas/tamaños (Llama 3.1/3.2, Gemma, Qwen, etc.). Elige deliberadamente según el propósito (chat, herramientas, incrustaciones) y el tamaño. Puede crear nuevos modelos directamente en la aplicación Ollama en el Mac o en la aplicación Página web de Ollama encontrar.

9) ¿Qué hacer cuando las cosas van mal?

- lista ollama / ollama ps comprobar: ¿Está disponible/activo el modelo deseado?

- ollama show Ver: ¿Qué cuantificación/tamaño se ha cargado? ¿Coincide con la RAM del Mac? notes.kodekloud.com

Actualización:

brew upgrade ollama ollama-app

Ver temasError de metal: a veces se producen errores de metal, sobre todo con modelos/características muy nuevos; una actualización o un cambio de variante del modelo suelen ayudar.

10) Alternativas con comodidad Mac (GUI)

Si prefieres utilizar una interfaz gráfica con más opciones o navegar/cambiar de modelo:

Estudio LM - un popular frontend para Mac con descargador integrado, interfaz de chat y servidor API local. Página de descarga y notas de la versión. LM Studio+1Uptodown

(También hay interfaces de terceros como Open WebUI que se pueden conectar a Ollama - pero para la mayoría de las configuraciones de Mac, Ollama + Terminal o LM Studio es suficiente).

Con Ollama, puede configurar un entorno LLM local en el Mac en solo unos minutos, de forma clásica, comprensible y sin dependencia de la nube. Siga los pasos probados (Installer/Brew → ollama serve → ollama run), compruebe los recursos y vaya de lo pequeño a lo grande. Si prefieres hacer clic a escribir, LM Studio es una alternativa sólida en Mac. ollama.comGitHubLM Studio

Buena suerte, y manténgase crítico con un sistema: primero documente correctamente, luego automatice.

Nueva serie de artículos: Utilización de la exportación de datos ChatGPT como memoria personal de IA

Si ya tienes una IA local con Ollama en el Mac installiert, puedes dar el siguiente paso: construir tu propio sistema de conocimiento. En una nueva serie de artículos, te mostraré cómo la Utilizar la exportación de datos ChatGPT para crear una base de datos de conocimientos personales. En lugar de que las conversaciones desaparezcan en el historial de chat, pueden exportarse, procesarse de forma estructurada e integrarse en una base de datos vectorial. Así se crea una IA que puede acceder a tus propios pensamientos, ideas y análisis. La serie te lleva paso a paso por todo el proceso, desde la exportación de datos hasta su incorporación e integración en un sistema RAG. De este modo, simples historiales de chat se convierten gradualmente en una memoria digital para tu propia IA.

Si ya tienes una IA local con Ollama en el Mac installiert, puedes dar el siguiente paso: construir tu propio sistema de conocimiento. En una nueva serie de artículos, te mostraré cómo la Utilizar la exportación de datos ChatGPT para crear una base de datos de conocimientos personales. En lugar de que las conversaciones desaparezcan en el historial de chat, pueden exportarse, procesarse de forma estructurada e integrarse en una base de datos vectorial. Así se crea una IA que puede acceder a tus propios pensamientos, ideas y análisis. La serie te lleva paso a paso por todo el proceso, desde la exportación de datos hasta su incorporación e integración en un sistema RAG. De este modo, simples historiales de chat se convierten gradualmente en una memoria digital para tu propia IA.

Preguntas más frecuentes

- ¿Qué significa realmente „IA local“ y por qué debería ejecutar un modelo lingüístico en mi propio Mac?

IA local significa que un modelo lingüístico se ejecuta íntegramente en su propio ordenador en lugar de acceder a servidores externos a través de una conexión a Internet. El modelo funciona localmente 1TP12 y procesa sus entradas directamente en su dispositivo. Las principales ventajas son la protección de datos, el control y la independencia: tus datos no salen de tu ordenador, no hay costes de API ni dependencia de proveedores en la nube. Al mismo tiempo, puedes personalizar el sistema según tus necesidades, integrar tus propios datos o incluso desarrollar tus propios flujos de trabajo. Para muchos usuarios -como desarrolladores, autores o empresas con datos sensibles- la IA local es, por tanto, una alternativa especialmente interesante a los servicios en la nube. - ¿Qué ventajas ofrece Ollama frente a otras herramientas para modelos lingüísticos locales?

Ollama se ha convertido rápidamente en una de las herramientas más populares para la IA local porque simplifica enormemente muchos pasos complejos. En lugar de descargar, configurar e iniciar los modelos manualmente, Ollama se encarga en gran medida de estas tareas de forma automática. Por lo general, un modelo lingüístico puede crearse e iniciarse con un solo comando de install. Ollama también ofrece una API REST para que los modelos puedan integrarse fácilmente en sus propios programas, como scripts, bases de datos o aplicaciones. Esto hace que Ollama sea adecuado tanto para principiantes que quieran probar un modelo rápidamente como para desarrolladores que deseen integrar la IA local en sus propios proyectos de software. - ¿Qué requisitos debe cumplir mi Mac para ejecutar un modelo lingüístico localmente?

Para obtener buenos resultados, recomendamos un Mac con un procesador Apple-Silicon (M1, M2, M3 o posterior). Estos chips tienen una arquitectura especialmente adecuada para los cálculos de IA, por ejemplo mediante estructuras de memoria compartida y aceleración por GPU. También es importante disponer de suficiente memoria y espacio de almacenamiento libre, ya que los modelos lingüísticos pueden tener un tamaño de varios gigabytes. Los modelos más pequeños ya funcionan en dispositivos con una memoria moderada, mientras que los más grandes requieren bastante más RAM. También es útil disponer de una versión actualizada de macOS, ya que muchas herramientas de IA están optimizadas para las bibliotecas de sistemas modernos. - ¿Qué modelos lingüísticos puedo utilizar con Ollama en mi Mac?

Ollama es compatible con una serie de modelos lingüísticos modernos de código abierto. Entre ellos se incluyen, por ejemplo, variantes de Llama, Mistral, Gemma o Qwen. Estos modelos difieren en tamaño, rendimiento y estilo. Algunos son bastante compactos y se ejecutan rápidamente en ordenadores pequeños, otros son más grandes y ofrecen respuestas más complejas. La gran ventaja: puede probar y comparar distintos modelos con relativa facilidad sin tener que reconstruir su infraestructura. Esto crea un entorno flexible en el que puede elegir el modelo que mejor se adapte a sus tareas. - ¿Es realmente complicada la instalación de un modelo en lengua local con Ollama?

La instalación es ahora mucho más fácil que hace unos años. En muchos casos, el proceso consta de unos pocos pasos: Primero installier Ollama en su Mac, después descargue un modelo lingüístico e inícielo a través del terminal o de una interfaz gráfica de usuario. El modelo se prepara automáticamente y puede utilizarse directamente. Muchos usuarios se sorprenden de lo rápido que funciona este proceso. Incluso sin conocimientos técnicos profundos, es posible configurar un sistema local de IA que funcione en pocos minutos. - ¿Por qué la IA local funciona especialmente bien en los Mac Apple-Silicon?

Los procesadores Apple-Silicon se desarrollaron pensando en las tareas informáticas modernas, incluido el aprendizaje automático. Utilizan una arquitectura de memoria unificada en la que la CPU, la GPU y otras unidades de cálculo utilizan la misma memoria. Esto permite procesar grandes cantidades de datos de forma más eficiente. Esto supone una gran ventaja para los modelos de IA, ya que los modelos lingüísticos tienen que acceder constantemente a grandes estructuras de datos durante la inferencia. Herramientas como Ollama o MLX hacen un uso específico de esta arquitectura y logran un rendimiento sorprendentemente bueno, incluso sin una tarjeta gráfica dedicada. - ¿A qué velocidad funciona un modelo de idioma local en un Mac?

La velocidad depende principalmente de tres factores: el modelo utilizado, la memoria RAM del Mac y el rendimiento del procesador. Los modelos más pequeños suelen reaccionar casi en tiempo real, mientras que los más grandes pueden funcionar con más lentitud. Sin embargo, los Mac Apple-Silicon son sorprendentemente potentes y pueden ejecutar muchos modelos populares con facilidad. Para proyectos experimentales o procesos de trabajo personales, el rendimiento suele ser más que suficiente. Si necesita respuestas especialmente rápidas, puede utilizar modelos más pequeños o más comprimidos. - ¿Puedo trabajar también sin conexión con una IA local?

Sí, es una de las mayores ventajas. Una vez descargado el modelo, ya no necesita conexión a Internet. Todos los cálculos se realizan directamente en tu Mac. Esto significa que también puedes utilizar la IA sobre la marcha, sin red o en entornos aislados. Para muchas aplicaciones profesionales, como documentos sensibles o análisis internos, esta capacidad offline es una ventaja decisiva. - ¿Hasta qué punto están seguros mis datos si utilizo un modelo lingüístico a nivel local?

Si el modelo se ejecuta de forma completamente local, los datos permanecen siempre en tu ordenador. No hay transferencia automática a servidores externos. Esto significa que puedes trabajar con textos confidenciales sin tener que preocuparte por el almacenamiento en la nube o por accesos no autorizados. Por supuesto, la seguridad sigue dependiendo de cómo esté configurado tu sistema, por ejemplo, de si otros programas tienen acceso a tus datos. Pero básicamente, una IA local ofrece mucho más control sobre tu propia información. - ¿Puedo entrenar o ampliar un modelo lingüístico local con mis propios datos?

Sí, es posible, pero normalmente no directamente a través del sistema base. Muchos usuarios combinan modelos lingüísticos locales con los llamados sistemas RAG o bases de datos para integrar sus propios contenidos. Se trata de analizar documentos o textos y almacenarlos en una base de datos vectorial. Posteriormente, el modelo lingüístico puede acceder a estos contenidos e incorporarlos a sus respuestas. De este modo, una IA puede especializarse en sus propios conocimientos sin tener que volver a entrenar completamente el propio modelo. - ¿Cuál es la diferencia entre un modelo lingüístico y una aplicación de IA como ChatGPT?

Un modelo lingüístico es básicamente el „motor“ de la IA: la red neuronal que analiza y genera textos. Servicios como ChatGPT, en cambio, son plataformas completas que combinan un modelo con una interfaz de usuario, una infraestructura en la nube y funciones adicionales. Si utiliza un modelo lingüístico localmente installier, trabajará directamente con este sistema central. Esto te da más control, pero también tienes que decidir por ti mismo qué herramientas o interfaces adicionales quieres utilizar. - ¿Cuánto espacio de almacenamiento requiere un modelo de idioma local en el Mac?

El tamaño de un modelo lingüístico puede variar mucho. Los modelos pequeños sólo requieren unos pocos gigabytes de memoria, mientras que las variantes más grandes pueden ocupar bastante más espacio. También se necesita RAM para cargar el modelo durante la ejecución. Para muchas aplicaciones prácticas, sin embargo, basta con modelos compactos que utilicen relativamente poca memoria y sigan siendo sorprendentemente potentes. - ¿Puedo ejecutar varios modelos simultáneamente en mi Mac 1TP12?

Sí, ésta es en realidad una gran ventaja de los entornos locales de IA. Puede descargar varios modelos e iniciarlos según sus necesidades. Algunos son más adecuados para textos creativos, otros para análisis técnicos o código de programas. Esta flexibilidad te permite utilizar tu entorno de IA como una caja de herramientas y elegir el modelo que mejor se adapte a la tarea que tengas entre manos. - ¿Puede integrarse Ollama en sus propios programas?

Sí, Ollama ofrece una interfaz de programación de aplicaciones (API) que otras aplicaciones pueden utilizar para acceder al modelo lingüístico. Esto le permite integrar la IA local en sus propios proyectos, por ejemplo en scripts, automatizaciones o sistemas de bases de datos. Los desarrolladores suelen utilizar esta opción para crear asistentes de IA personalizados o para añadir funciones inteligentes al software existente. - ¿Es un modelo lingüístico local tan potente como los grandes modelos en la nube?

En muchos casos, no del todo, al menos cuando se comparan modelos muy grandes con miles de millones de parámetros. Los proveedores de servicios en la nube utilizan equipos muy potentes y, por tanto, pueden ejecutar modelos muy grandes. Los modelos locales suelen ser más compactos para que puedan ejecutarse en un ordenador normal. Sin embargo, son asombrosamente potentes para muchas tareas prácticas y pueden escribir, analizar o estructurar textos. Este rendimiento es totalmente suficiente para muchos procesos de trabajo. - ¿Por qué cada vez hay más gente interesada en la IA local en lugar de los servicios en la nube?

Una razón importante es el control sobre los datos y la infraestructura. Muchos usuarios no quieren transferir permanentemente sus contenidos a servicios externos. Los sistemas locales también pueden ser más baratos a largo plazo porque no hay costes continuos de API. Para los desarrolladores y usuarios expertos en tecnología hay otra ventaja: pueden diseñar y experimentar ellos mismos con su entorno de IA. Esto crea una nueva forma de soberanía técnica. - ¿Puedo combinar una IA local con otros sistemas más adelante?

De hecho, ésta es una de las posibilidades más apasionantes. Los modelos lingüísticos locales pueden conectarse a bases de datos, plataformas de automatización o programas propios. Esto puede dar lugar a flujos de trabajo complejos, como sistemas que analizan documentos, resumen contenidos o recuperan conocimientos de sus propias bases de datos. Estas combinaciones suelen ser la base de asistentes de IA personalizados o herramientas de análisis automatizadas. - ¿Para quién es especialmente útil una IA local en el Mac?

Es especialmente interesante para desarrolladores, autores, analistas y empresas que trabajan habitualmente con textos o datos. La IA local también es una opción interesante para los usuarios expertos en tecnología que quieren controlar ellos mismos su infraestructura digital. Permite utilizar la moderna tecnología de IA sin depender de grandes plataformas. Sobre todo en los potentes Mac, esto crea un entorno que puede ser sorprendentemente versátil y productivo.