Mac'te yerel yapay zeka uzun zamandır pratiktir - özellikle Apple-Silicon bilgisayarlarda (M serisi). Ollama ile birçok açık kaynak dil modeli (örneğin Llama 3.1/3.2, Mistral, Gemma, Qwen) için yalın bir çalışma zamanı ortamı elde edersiniz. Mevcut Ollama sürümü artık bir fare tıklamasıyla Mac'inizde yerel bir dil modeli kurmanıza olanak tanıyan kullanıcı dostu bir uygulama ile birlikte geliyor. Bu makalede kurulumdan ilk komut istemine kadar pragmatik bir rehber bulacaksınız - geleneksel olarak işlerin nerede yanlış gitme eğiliminde olduğuna dair pratik ipuçları ile birlikte.

Yerel Yapay Zeka ile ilgili son haberler

03.04.2026: Google geliştirdi Gemma 4 yeni nesil ilk kez ticari olarak izin verilen Apache 2.0 lisansı altında yayınlanan açık yapay zeka modelleri. Şirket böylece gerçek açıklığa doğru net bir stratejik geçiş yapıyor ve geliştiricilere kullanım, özelleştirme ve yeniden dağıtım açısından önemli ölçüde daha fazla özgürlük tanıyor. Model ailesi, küçük, yerel olarak çalıştırılabilir modellerden sunucular ve iş istasyonları için güçlü sürümlere kadar çeşitli varyantlar içeriyor. Bu da Gemma 4'ün akıllı telefonlardan veri merkezlerine kadar geniş bir donanım yelpazesini kapsadığı anlamına geliyor. Teknolojik olarak Gemma 4, Google'ın tescilli Gemini modelleriyle benzer temellere dayanıyor ve metin ve görüntü işleme, büyük bağlam pencereleri ve birçok dil desteği gibi modern özellikler sunuyor.

Yerel yapay zeka nihayet iyi Arnie ile Yapay Zeka

Genel olarak Google, güçlü yapay zekayı daha güçlü bir şekilde demokratikleştirmeyi ve yerel ve bağımsız uygulamaları teşvik etmeyi amaçlıyor - bu yaklaşım özellikle kurum içi yapay zeka kurulumları ve veri egemenliği çözümleri için ilgi çekici.

Yerel yapay zekanın bulut sistemlerine göre avantajları

Mac'te Ollama gibi yerel bir dil modeli, özellikle şirketler, geliştiriciler ve veri koruma bilincine sahip kullanıcılar için aşılması zor avantajlar sunuyor.

Veri egemenliği ve veri koruma

Tüm sorular ve yanıtlar tamamen kendi bilgisayarınızda kalır. Hassas bilgiler - müşteri verileri, dahili strateji belgeleri veya tıbbi veriler - asla yerel sistemden çıkmaz. Bir bulut sağlayıcısından yanlışlıkla veya kasıtlı olarak analiz edilebilecek hiçbir günlük dosyası veya analiz mekanizması yoktur.

Üçüncü taraf hizmetlerine bağımlılık yok

Bulut sistemleri fiyatlandırma modellerini değiştirebilir, erişim kısıtlamaları getirebilir veya bireysel özellikleri kapatabilir. Yerel bir kurulumla çalışma zamanı ortamı, sürümler ve model varyantları üzerinde tam kontrole sahip olursunuz. Güncellemeleri istediğiniz zaman yaparsınız - bir sağlayıcı dikte ettiğinde değil.

Hesaplanabilir maliyetler

İstek veya ay başına sürekli ücretler yerine, donanıma tek seferlik bir yatırım yaparsınız (örneğin yeterli RAM'e sahip bir Mac) ve ardından modelle süresiz olarak çalışırsınız. Yoğun bilgi işlem gerektiren görevler için, artan API faturaları konusunda endişelenmeden donanımı hedefli bir şekilde genişletebilirsiniz.

Çevrimdışı yetenek

Yerel bir model, internet bağlantısı olmadığında da çalışır - örneğin, seyahat ederken, şantiyelerde veya harici erişimi olmayan yüksek güvenlikli ağlarda.

Yüksek esneklik ve mevcut sistemlere entegrasyon

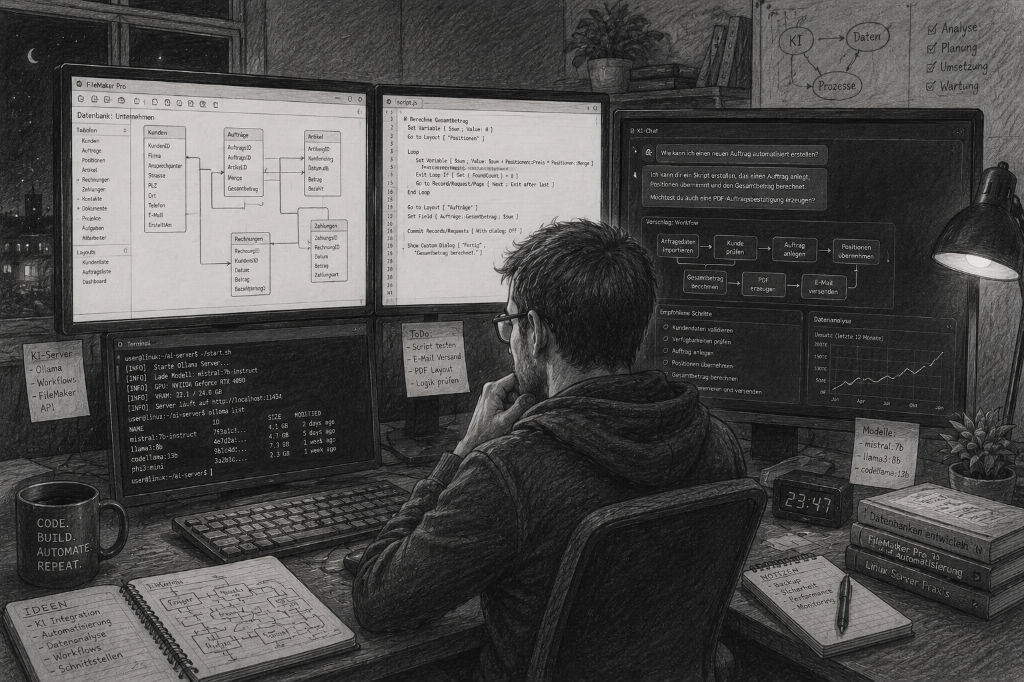

Yerel AI sistemlerinin bir diğer avantajı da entegrasyon kabiliyetidir. Ollama yerel bir API sunucusu sağladığından, basit komut dosyalarından karmaşık ERP sistemlerine kadar hemen hemen her uygulama bağlanabilir.

FileMaker bağlantı

Ollama API'sini kullanan FileMaker, istemleri doğrudan modele gönderebilir ve yanıtları yalnızca birkaç satırlık komut dosyası koduyla veya MBS eklenti çağrıları aracılığıyla alanlarda depolayabilir. Bu sayede otomatik metin analizleri, sınıflandırmalar, çeviriler veya içerik özetleri, bulut gecikmesi ve veri koruma riskleri olmadan tamamen FileMaker içinde uygulanabilir.

Otomatik iş akışları

Yerel API uç noktası ayrıca Zapier, n8n veya özelleştirilmiş Python/bash komut dosyaları gibi araçların entegre edilmesini sağlar. Bu, e-postalardan bilgi alma, rapor oluşturma veya belgeler için metin modülleri oluşturma gibi karmaşık süreçlerin otomatikleştirilmesine olanak tanır.

Model varyantları üzerinde tam kontrol

Birkaç modeli paralel olarak çalıştırabilir, bunlar arasında geçiş yapabilir veya projeniz için optimize edilmiş özel bölme modellerini yükleyebilirsiniz. İnce ayar veya LoRA modelleri gibi özelleştirmeler de yerel olarak gerçekleştirilebilir.

Pratik avantaj: tepki hızı ve gecikme süresi

Genellikle hafife alınan bir faktör de yanıt hızıdır. Bulut LLM'ler genellikle ağ yolları, API sınırları veya sunucu yükü nedeniyle gecikirken, yerel modeller - donanıma bağlı olarak - neredeyse gerçek zamanlı olarak yanıt verir. Özellikle tekrarlayan görevlerde veya etkileşimli süreçlerde (örneğin FileMaker'de bir sunum veya canlı veri analizi sırasında) bu, „sorunsuz çalışma“ ile „hayal kırıklığı içinde bekleme“ arasındaki farkı yaratabilir.

Yerel dil modellerini çalıştırmak için hangi donanımın uygun olduğu, hangi modellerin hangi avantajlara sahip olduğu ve Apple Silicon ve NVIDIA arasındaki karşılaştırma ayrı bir makalede ele alınmıştır.

Yerel yapay zeka sistemlerinin kullanımına ilişkin güncel anket

1) Önkoşullar ve genel koşullar

macOS 12 "Monterey" veya daha yenisi (önerilen: en son Sonoma/Sequoia). Resmi macOS indirmesi Monterey+ gerektirir. ollama.com

Apple Silicon (M1-M4) tercih edilir. Intel Mac'lerde de çalışır, ancak Apple-Silicon çok daha verimlidir; büyük modeller çok fazla RAM / birleşik bellek gerektirir. (Kütüphane/model boyutları için Ollama kütüphanesine bakın.) ollama.com

API için yerel olarak 11434 numaralı bağlantı noktası kullanılır. Bağlantı noktasını not edin - daha sonra testler ve entegrasyonlar için önemlidir. GitHubollama.readthedocs.io

Eski geleneğe göre şüpheci tavsiye: „Kur ve çalıştır“ genellikle işe yarar - darboğazlar RAM/disk alanı (büyük GGUF dosyaları), yanlış model varyantı veya bağlantı noktasını engelleyen paralel işlemlerdir.

2) Ollama installieren (Mac)

İki temiz yolunuz var - GUI yükleyici veya Homebrew. Her ikisi de doğrudur; günlük yaşamınıza uygun stili seçin.

SEÇENEK A: RESMI MACOS YÜKLEYICISI (DMG)

macOS için Ollama'yi indirin resmi siteden.

DMG'yi açın, uygulamayı "Programlar "a sürükleyin, başlatın.

(macOS 12+ gerektirir.) ollama.com

Bu 1TP12 varyantını kullanıyorsanız, modeli indirmek için doğrudan macOS yazılımını kullanabilirsiniz. Aşağıdaki terminal komutlarının tümü yalnızca dil modelini komut dosyası aracılığıyla otomatikleştirebilmekle ilgilidir.

VARYANT B: HOMEBREW (CLI, TEMIZ KODLANABILIR)

Terminali açın ve (gerekirse) Homebrew'yi güncelleyin:

brew update

Fıçı (Uygulama varyantı) 1TP12Hayvanlar:

brew install --cask ollama-app

(Genellikle geçerli masaüstü uygulamasını gösterir; bugün itibariyle 0.11.x.) Homebrew Formüller

Ya da formül (CLI paketi) installieren:

brew install ollama

(Apple-Silicon/Intel için ikili dosyalar mevcuttur.) Homebrew Formüller

Sürümü kontrol et:

ollama --version

(Temel komutlar ve varyantlar resmi belgelerde ve GitHub reposunda belgelenmiştir). GitHub

3) Hizmeti/sunucuyu başlatın ve test edin

Ollama yerel bir sunucu ile birlikte gelir. Gerekirse açıkça başlatın:

ollama serve

Hizmet zaten çalışıyorsa (örneğin uygulama aracılığıyla), kabuk 11434 numaralı bağlantı noktasının kullanımda olduğunu bildirebilir - o zaman her şey yolundadır.

Sunucu varsayılan olarak http://localhost:11434 adresini dinler.

Tarayıcıda fonksiyon testi:

Arayın http://localhost:11434/ - örnek yanıt vermelidir (bağlantı noktası varsayılan olarak etkin olduğu için bazı yönergeler bu kontrolü kullanır). Orta

Geleneksel uyarı: Hiçbir şey yanıt vermiyorsa, eski bir işlem veya bir güvenlik paketi genellikle engelliyordur. İkinci bir terminalin ollama serve ile hala çalışıp çalışmadığını kontrol edin - veya uygulamadan çıkın/yeniden başlatın.

4) Birinci dil modelini yükleyin ve kullanın

4.1 MODELI ÇEKIN VEYA DOĞRUDAN BAŞLATIN (ÇALIŞTIRIN)

Doğrudan kullanın (çekme + çalıştırma bir arada):

ollama run llama3.1

Sadece indirin:

ollama pull llama3.1

Resmi repo, diğerlerinin yanı sıra Llama 3.2 ile ortak komutları (çalıştır, çek, listele, göster, ps, durdur, rm) ve örnekleri gösterir; Llama 3.1, Mistral, Gemma vb. için aynıdır. GitHubnotes.kodekloud.comglukhov.org

Daha fazla model sayfası / kütüphane:

Llama 3 / 3.1 / 3.2 farklı boyutlarda (1B-405B; tabii ki, büyük varyantlar yüksek miktarlı versiyonlarda mevcuttur). Basitçe arayın Ollama web sitesi diğer modelleri bulmak ve bunları Mac'inizde installiere etmek için.

4.2 INTERAKTIF SOHBET (TERMINAL)

Örneğin, Llama 3.1'i sohbet modunda başlatın:

ollama run llama3.1

Ardından doğrudan yazın:

Sen yardımcı bir asistansın. Bana bir veritabanındaki indeksin ne olduğunu iki cümleyle açıklayın.

Ctrl+D ile çıkın.

Mac'inizde Ollama uygulamasını başlattığınızda, doğrudan bir model seçebilir ve bir istem girebilirsiniz. Model henüz Mac'inizde mevcut değilse, otomatik olarak indirilecektir.

4.3 MODELLERİ YÖNETMEK

# Yerel olarak hangi modeller mevcuttur?

ollama list

# Detayları/ölçümü/etiketleri görüntüleyin:

ollama show llama3.1

# Çalışan model süreçlerini kontrol edin:

ollama ps

# Çalışmayı durdurma modeli:

ollama stop llama3.1

# Alanı temizleyin (modeli silin):

ollama rm llama3.1

(Komutlar çeşitli güncel genel bakışlarda aynıdır belgelenmiş.) notes.kodekloud.comGeshan's Blogglukhov.org

5) HTTP API'sini yerel olarak kullanın (örn. komut dosyaları, araçlar, entegrasyonlar için)

Ollama bir REST API sunar (varsayılan olarak http://localhost:11434). Örnek çağrılar:

Oluştur (basit istem):

curl http://localhost:11434/api/generate -d '{

"model": "llama3.1",

"prompt": "Erkläre kurz den Unterschied zwischen RAM und SSD.",

"stream": false

}'Sohbet (rol tabanlı):

curl http://localhost:11434/api/chat -d '{

"model": "llama3.1",

"messages": [

{ "role": "system", "content": "Du antwortest knapp und sachlich." },

{ "role": "user", "content": "Was ist eine Normalisierung in Datenbanken?" }

],

"stream": false

}'(Uç noktalar, akış davranışı ve alanlar resmi API belgeleri/GitHub açıklanmıştır).

Ulaşılabilirlik ipucu:

Yerel olarak, her şeye localhost üzerinden erişilebilir.

Mac'in LAN'dan erişilebilir olması isteniyorsa, Ollama'yi kasıtlı olarak bir ağ adresine bağlayın, örn:

export OLLAMA_HOST=0.0.0.0 ollama serve

(Sunucuya daha sonra ağdaki IP üzerinden erişilebilir. Güvenlik yönünü kontrol edin!) Reddit

Mixed-Content/HTTPS (yalnızca tarayıcı entegrasyonları çalışmıyorsa):

Bazı eklentiler/tarayıcılar (özellikle Safari) HTTPS bağlamlarından HTTP çağrılarını engeller. Bu gibi durumlarda, HTTPS'li yerel bir ters proxy yardımcı olur.

6) Mac için pratik ipuçları (deneyim ve muhafazakar bakım)

- Model seçimine muhafazakar bir şekilde başlayınDaha küçük miktarlarla başlayın (örn. 4 bitlik varyantlar), kaliteyi kontrol edin, ardından yavaşça anahtarlayın.

- Bellek ve diske göz kulak olun: Büyük modeller birkaç GB yer kaplar - ollama gösterisi kategorizasyona yardımcı olur. notes.kodekloud.com

- Apple-Silicon & MetalOllama, Mac'te Apple hızlandırmasını (Metal) kullanır. Çok yeni model yapılarında Sürücü/Metal hataları oluşabilir - Ollama'yi güncel tutun ve bilinen sorunlara göz atın. GitHub

- Liman çatışmalarıollama serve şikayet ederse, uygulama veya başka bir işlem zaten 11434'ü dinliyordur - ya uygulamayı kapatın ya da CLI sunucusunu durdurun. postman.com

7) Sık sık minimal iş akışları (kopyala ve yapıştır)

A) Newinstallation & ilk sohbet (Llama 3.1)

# Installation (eine Variante wählen) brew install --cask ollama-app # oder brew install ollama# Server starten (falls App nicht läuft) ollama serve # Erstes Modell testen ollama run llama3.1

("run" zaten mevcut değilse modeli yükler.) Homebrew Formulae+1GitHub

B) Modeli çevrimdışı hazırlayın (önce çekin, sonra kullanın)

ollama pull mistral ollama show mistral ollama run mistral

(„mistral“ yaygın, kompakt bir modeldir - ilk testler için iyidir).

C) Bir komut dosyasında/araçta API entegrasyonu

curl http://localhost:11434/api/generate -d '{

"model": "llama3.1",

"prompt": "Otomasyon yerine dokümantasyon için bana üç muhafazakar neden söyleyin."

}‘

(API örnekleri 1:1 resmi̇ referans 'den alınmıştır)

8) Modelleri nerede bulabilirim?

Ollama kütüphanesi, etiketlere/boyutlara sahip seçilmiş modeller içerir (Llama 3.1/3.2, Gemma, Qwen, vb.). Amaca (sohbet, araçlar, yerleştirmeler) ve boyuta göre kasıtlı olarak seçin. Yeni modelleri doğrudan Mac'teki Ollama uygulamasında veya Ollama web sitesi Bul.

9) İşler ters gittiğinde ne yapmalı?

- ollama listesi / ollama ps kontrol edin: İstenen model mevcut mu/aktif mi?

- ollama show Görünüm: Hangi nicelik/boyut yüklendi? Bu Mac RAM ile eşleşiyor mu? notes.kodekloud.com

Güncelleme:

brew upgrade ollama ollama-app

Sorunları görüntüle: Özellikle çok yeni modellerde/özelliklerde zaman zaman metal hataları meydana gelir; bir güncelleme veya model varyantının değiştirilmesi genellikle yardımcı olur.

10) Mac konforuna sahip alternatifler (GUI)

Daha fazla seçeneğe sahip bir grafik arayüz kullanmayı tercih ediyorsanız veya modellere göz atmak/değiştirmek istiyorsanız:

LM Stüdyo - Entegre indirici, sohbet arayüzü ve yerel API sunucusu ile popüler bir Mac ön ucu. İndirme sayfası ve sürüm notları bağlantılı. LM Studio+1Uptodown

(Ollama'ye bağlanabilen Open WebUI gibi üçüncü taraf kullanıcı arayüzleri de vardır - ancak çoğu Mac kurulumu için Ollama + Terminal veya LM Studio yeterlidir).

Ollama ile Mac'te sadece birkaç dakika içinde yerel bir LLM ortamı kurabilirsiniz - klasik, anlaşılır bir şekilde ve bulut bağımlılığı olmadan. Denenmiş ve test edilmiş adımları izleyin (Installer/Brew → ollama serve → ollama run), kaynakları kontrol edin ve küçükten büyüğe doğru ilerleyin. Tıklamayı yazmaya tercih ediyorsanız, LM Studio Mac'te sağlam bir alternatiftir. ollama.comGitHubLM Studio

İyi şanslar - ve bir sistemle kritik kalın: önce düzgün bir şekilde belgeleyin, sonra otomatikleştirin.

Yeni makale serisi: ChatGPT veri aktarımını kişisel yapay zeka belleği olarak kullanma

Mac installiert üzerinde Ollama ile zaten yerel bir yapay zekanız varsa, bir sonraki adımı atabilirsiniz: kendi bilgi sisteminizi oluşturmak. Yeni bir makale dizisinde, size nasıl ChatGPT veri dışa aktarımını kullanma kişisel bir bilgi veritabanı oluşturmak için. Konuşmalar sohbet geçmişinde kaybolmak yerine dışa aktarılabilir, yapılandırılmış bir şekilde işlenebilir ve bir vektör veritabanına entegre edilebilir. Böylece kendi düşüncelerinize, fikirlerinize ve analizlerinize erişebilen bir yapay zeka yaratılıyor. Seri, veri aktarımından gömme ve bir RAG sistemine entegrasyona kadar tüm süreç boyunca sizi adım adım yönlendiriyor. Bu şekilde, basit sohbet geçmişleri yavaş yavaş kendi yapay zekanız için dijital bir bellek haline gelir.

Mac installiert üzerinde Ollama ile zaten yerel bir yapay zekanız varsa, bir sonraki adımı atabilirsiniz: kendi bilgi sisteminizi oluşturmak. Yeni bir makale dizisinde, size nasıl ChatGPT veri dışa aktarımını kullanma kişisel bir bilgi veritabanı oluşturmak için. Konuşmalar sohbet geçmişinde kaybolmak yerine dışa aktarılabilir, yapılandırılmış bir şekilde işlenebilir ve bir vektör veritabanına entegre edilebilir. Böylece kendi düşüncelerinize, fikirlerinize ve analizlerinize erişebilen bir yapay zeka yaratılıyor. Seri, veri aktarımından gömme ve bir RAG sistemine entegrasyona kadar tüm süreç boyunca sizi adım adım yönlendiriyor. Bu şekilde, basit sohbet geçmişleri yavaş yavaş kendi yapay zekanız için dijital bir bellek haline gelir.

Sıkça sorulan sorular

- „Yerel yapay zeka“ aslında ne anlama geliyor ve neden kendi Mac'imde bir dil modeli çalıştırmalıyım?

Yerel yapay zeka, bir dil modelinin internet bağlantısı üzerinden harici sunuculara erişmek yerine tamamen kendi bilgisayarınızda çalıştığı anlamına gelir. Model yerel olarak 1TP12 çalıştırılır ve girdilerinizi doğrudan cihazınızda işler. Başlıca avantajları veri koruma, kontrol ve bağımsızlıktır: verileriniz bilgisayarınızdan çıkmaz, API maliyeti yoktur ve bulut sağlayıcılara bağımlı değildir. Aynı zamanda sistemi kendi ihtiyaçlarınıza göre özelleştirebilir, kendi verilerinizi entegre edebilir ve hatta kendi iş akışlarınızı geliştirebilirsiniz. Bu nedenle, geliştiriciler, yazarlar veya hassas verilere sahip şirketler gibi birçok kullanıcı için yerel yapay zeka, bulut hizmetlerine özellikle ilginç bir alternatiftir. - Ollama, yerel dil modelleri için diğer araçlara kıyasla ne gibi avantajlar sunuyor?

Ollama, birçok karmaşık adımı büyük ölçüde basitleştirdiği için hızla yerel yapay zeka için en popüler araçlardan biri haline geldi. Modelleri manuel olarak indirmek, yapılandırmak ve başlatmak yerine, Ollama bu görevleri büyük ölçüde otomatik olarak üstlenir. Bir dil modeli genellikle tek bir install komutuyla oluşturulabilir ve başlatılabilir. Ollama ayrıca modellerin komut dosyaları, veritabanları veya uygulamalar gibi kendi programlarınıza kolayca entegre edilebilmesi için bir REST API sunar. Bu, Ollama'yi hem bir modeli hızlı bir şekilde denemek isteyen yeni başlayanlar hem de yerel yapay zekayı kendi yazılım projelerine entegre etmek isteyen geliştiriciler için uygun hale getirir. - Bir dil modelini yerel olarak çalıştırmak için Mac'imin hangi gereksinimleri karşılaması gerekir?

İyi sonuçlar için Apple-Silicon işlemcili (M1, M2, M3 veya daha yeni) bir Mac öneririz. Bu çipler, örneğin paylaşılan bellek yapıları ve GPU hızlandırması sayesinde yapay zeka hesaplamaları için özellikle uygun bir mimariye sahiptir. Dil modelleri birkaç gigabayt boyutunda olabileceğinden, yeterli belleğe ve yeterli boş depolama alanına sahip olmak da önemlidir. Daha küçük modeller zaten orta düzeyde belleğe sahip cihazlarda çalışırken, daha büyük modeller önemli ölçüde daha fazla RAM gerektirir. Birçok yapay zeka aracı modern sistem kütüphaneleri için optimize edildiğinden, güncel bir macOS sürümü de yararlıdır. - Mac'imde Ollama ile hangi dil modellerini kullanabilirim?

Ollama bir dizi modern açık kaynak dil modelini destekler. Bunlar arasında örneğin Llama, Mistral, Gemma veya Qwen varyantları bulunur. Bu modeller boyut, performans ve stil açısından farklılık gösterir. Bazıları oldukça kompakttır ve küçük bilgisayarlarda hızlı çalışır, diğerleri daha büyüktür ve daha karmaşık cevaplar sağlar. En büyük avantajı: altyapınızı yeniden inşa etmek zorunda kalmadan farklı modelleri nispeten kolay bir şekilde deneyebilir ve karşılaştırabilirsiniz. Bu, görevlerinize en uygun modeli seçebileceğiniz esnek bir ortam yaratır. - Ollama ile yerel bir dil modelinin kurulumu gerçekten ne kadar karmaşıktır?

Kurulum birkaç yıl öncesine göre çok daha kolay hale gelmiştir. Çoğu durumda, süreç sadece birkaç adımdan oluşur: Önce Mac'inizde installier Ollama, ardından bir dil modeli indirin ve terminal veya grafik kullanıcı arayüzü aracılığıyla başlatın. Model otomatik olarak hazırlanır ve daha sonra doğrudan kullanılabilir. Birçok kullanıcı bu sürecin ne kadar hızlı işlediğine şaşırmaktadır. Derinlemesine teknik bilgi olmadan bile, birkaç dakika içinde işleyen bir yerel AI sistemi kurmak mümkündür. - Yerel yapay zeka neden Apple-Silicon Mac'lerde özellikle iyi çalışıyor?

Apple-Silicon işlemciler, makine öğrenimi de dahil olmak üzere modern bilgi işlem görevleri göz önünde bulundurularak geliştirilmiştir. CPU, GPU ve diğer bilgi işlem birimlerinin aynı belleği kullandığı birleşik bellek mimarisi olarak adlandırılan bir mimariden yararlanırlar. Bu sayede büyük miktarda veri daha verimli bir şekilde işlenebiliyor. Bu, yapay zeka modelleri için büyük bir avantajdır çünkü dil modellerinin çıkarım sırasında sürekli olarak büyük veri yapılarına erişmesi gerekir. Ollama veya MLX gibi araçlar bu mimariyi hedefli bir şekilde kullanır ve sonuç olarak, özel bir grafik kartı olmadan bile şaşırtıcı derecede iyi performans elde eder. - Yerel dil modeli Mac'te ne kadar hızlı çalışır?

Hız temel olarak üç faktöre bağlıdır: kullanılan model, Mac'in RAM'i ve işlemci performansı. Daha küçük modeller genellikle neredeyse gerçek zamanlı tepki verirken, daha büyük modeller daha yavaş çalışabilir. Bununla birlikte, Apple-Silicon Mac'ler şaşırtıcı derecede güçlüdür ve birçok popüler modeli kolaylıkla çalıştırabilir. Deneysel projeler veya kişisel iş süreçleri için performans genellikle fazlasıyla yeterlidir. Özellikle hızlı yanıtlara ihtiyacınız varsa, daha küçük veya daha sıkıştırılmış modeller kullanabilirsiniz. - Yerel bir yapay zeka ile çevrimdışı da çalışabilir miyim?

Evet, en büyük avantajlarından biri de bu. Model indirildikten sonra artık internet bağlantısı gerektirmez. Tüm hesaplamalar doğrudan Mac'inizde gerçekleşir. Bu, yapay zekayı hareket halindeyken, ağ olmadan veya izole ortamlarda da kullanabileceğiniz anlamına gelir. Hassas belgeler veya dahili analizler gibi birçok profesyonel uygulama için bu çevrimdışı özellik belirleyici bir avantajdır. - Yerel olarak bir dil modeli çalıştırırsam verilerim ne kadar güvende olur?

Model tamamen yerel olarak çalışıyorsa, verileriniz her zaman bilgisayarınızda kalır. Harici sunuculara otomatik aktarım yoktur. Bu, bulut depolama veya yetkisiz erişim konusunda endişelenmenize gerek kalmadan gizli metinlerle çalışabileceğiniz anlamına gelir. Elbette güvenlik yine de sisteminizin nasıl yapılandırıldığına bağlıdır - örneğin, diğer programların verilerinize erişimi olup olmadığı gibi. Ancak temel olarak, yerel bir AI kendi bilgileriniz üzerinde önemli ölçüde daha fazla kontrol sunar. - Yerel bir dil modelini kendi verilerimle eğitebilir veya genişletebilir miyim?

Evet, bu mümkün - ancak genellikle doğrudan temel sistem üzerinden değil. Birçok kullanıcı kendi içeriklerini entegre etmek için yerel dil modellerini RAG sistemleri veya veritabanları ile birleştirir. Bu, belgelerin veya metinlerin analiz edilmesini ve bir vektör veritabanında saklanmasını içerir. Dil modeli daha sonra bu içeriğe erişebilir ve yanıtlarına dahil edebilir. Bu şekilde bir yapay zeka, modelin kendisini tamamen yeniden eğitmek zorunda kalmadan kendi bilgisinde uzmanlaşabilir. - Bir dil modeli ile ChatGPT gibi bir yapay zeka uygulaması arasındaki fark nedir?

Bir dil modeli temelde sadece yapay zekanın „motorudur“ - metinleri analiz eden ve üreten sinir ağı. ChatGPT gibi hizmetler ise bir modeli bir kullanıcı arayüzü, bulut altyapısı ve ek işlevlerle birleştiren eksiksiz platformlardır. Yerel olarak bir dil modeli kullanırsanız installier, doğrudan bu çekirdek sistemle çalışırsınız. Bu size daha fazla kontrol sağlar, ancak hangi ek araçları veya arayüzleri kullanmak istediğinize de kendiniz karar vermeniz gerekir. - Yerel bir dil modeli Mac'te ne kadar depolama alanı gerektirir?

Bir dil modelinin boyutu büyük ölçüde değişebilir. Küçük modeller yalnızca birkaç gigabayt bellek gerektirirken, daha büyük varyantlar önemli ölçüde daha fazla yer kaplayabilir. RAM ayrıca yürütme sırasında modeli yüklemek için de gereklidir. Bununla birlikte, birçok pratik uygulama için, nispeten az bellek kullanan ve yine de şaşırtıcı derecede güçlü olan kompakt modeller yeterlidir. - Mac 1TP12 cihazımda aynı anda birkaç model çalıştırabilir miyim?

Evet, bu aslında yerel yapay zeka ortamlarının büyük bir avantajıdır. Birkaç model indirebilir ve bunları gerektiği gibi başlatabilirsiniz. Bazıları yaratıcı metinler için daha uygunken, diğerleri teknik analizler veya program kodu için daha uygundur. Bu esneklik, yapay zeka ortamınızı bir araç kutusu gibi kullanmanıza ve elinizdeki göreve en uygun modeli seçmenize olanak tanır. - Ollama kendi programlarınıza da entegre edilebilir mi?

Evet, Ollama diğer uygulamaların dil modeline erişmek için kullanabileceği bir uygulama programlama arayüzü (API) sunar. Bu, yerel yapay zekayı kendi projelerinize entegre etmenize olanak tanır - örneğin komut dosyalarında, otomasyonlarda veya veritabanı sistemlerinde. Geliştiriciler bu seçeneği genellikle özelleştirilmiş yapay zeka asistanları oluşturmak veya mevcut yazılımlara akıllı işlevler eklemek için kullanır. - Yerel bir dil modeli büyük bulut modelleri kadar güçlü müdür?

Çoğu durumda, tam olarak değil - en azından milyarlarca parametre içeren çok büyük modelleri karşılaştırdığınızda. Bulut sağlayıcıları son derece güçlü donanımlar kullanır ve bu nedenle çok büyük modelleri çalıştırabilir. Yerel modeller genellikle daha kompakttır, böylece normal bir bilgisayarda çalışabilirler. Bununla birlikte, birçok pratik görev için inanılmaz derecede güçlüdürler ve metinleri yazabilir, analiz edebilir veya yapılandırabilirler. Bu performans birçok iş süreci için tamamen yeterlidir. - Neden giderek daha fazla insan bulut hizmetleri yerine yerel yapay zeka ile ilgileniyor?

Bunun önemli bir nedeni veri ve altyapı üzerindeki kontroldür. Birçok kullanıcı içeriklerini kalıcı olarak harici hizmetlere aktarmak istemez. Yerel sistemler de uzun vadede daha ucuz olabilir çünkü devam eden API maliyetleri yoktur. Geliştiriciler ve teknoloji meraklısı kullanıcılar için bir avantaj daha var: YZ ortamlarını kendileri tasarlayabilir ve deneyebilirler. Bu da yeni bir teknik egemenlik biçimi yaratır. - Yerel bir yapay zekayı daha sonra diğer sistemlerle birleştirebilir miyim?

Aslında bu, en heyecan verici olasılıklardan biridir. Yerel dil modelleri veritabanlarına, otomasyon platformlarına veya kendi programlarınıza bağlanabilir. Bu, belgeleri analiz eden, içeriği özetleyen veya kendi veritabanlarından bilgi alan sistemler gibi karmaşık iş akışlarıyla sonuçlanabilir. Bu tür kombinasyonlar genellikle özelleştirilmiş yapay zeka asistanları veya otomatik analiz araçları için temel oluşturur. - Mac'te yerel bir yapay zeka kimler için özellikle değerlidir?

Özellikle geliştiriciler, yazarlar, analistler ve düzenli olarak metinlerle veya verilerle çalışan şirketler için ilgi çekicidir. Yerel YZ, dijital altyapılarını kendileri kontrol etmek isteyen teknoloji meraklısı kullanıcılar için de heyecan verici bir seçenektir. Büyük platformlara bağımlı kalmadan modern yapay zeka teknolojisini kullanmayı mümkün kılıyor. Özellikle güçlü Mac'lerde bu, şaşırtıcı derecede çok yönlü ve üretken olabilen bir ortam yaratıyor.