Мир искусственного интеллекта находится в движении. Новые модели, новые методы и, главное, новые возможности появляются почти каждую неделю, но одно осознание остается неизменным: не каждая техническая инновация автоматически ведет к улучшению повседневной жизни. Многие вещи остаются экспериментальными, сложными или просто слишком дорогими для продуктивного использования. Это особенно очевидно в так называемой тонкой настройке больших языковых моделей - методе специализации генеративного ИИ под собственное содержание, термины и тональность.

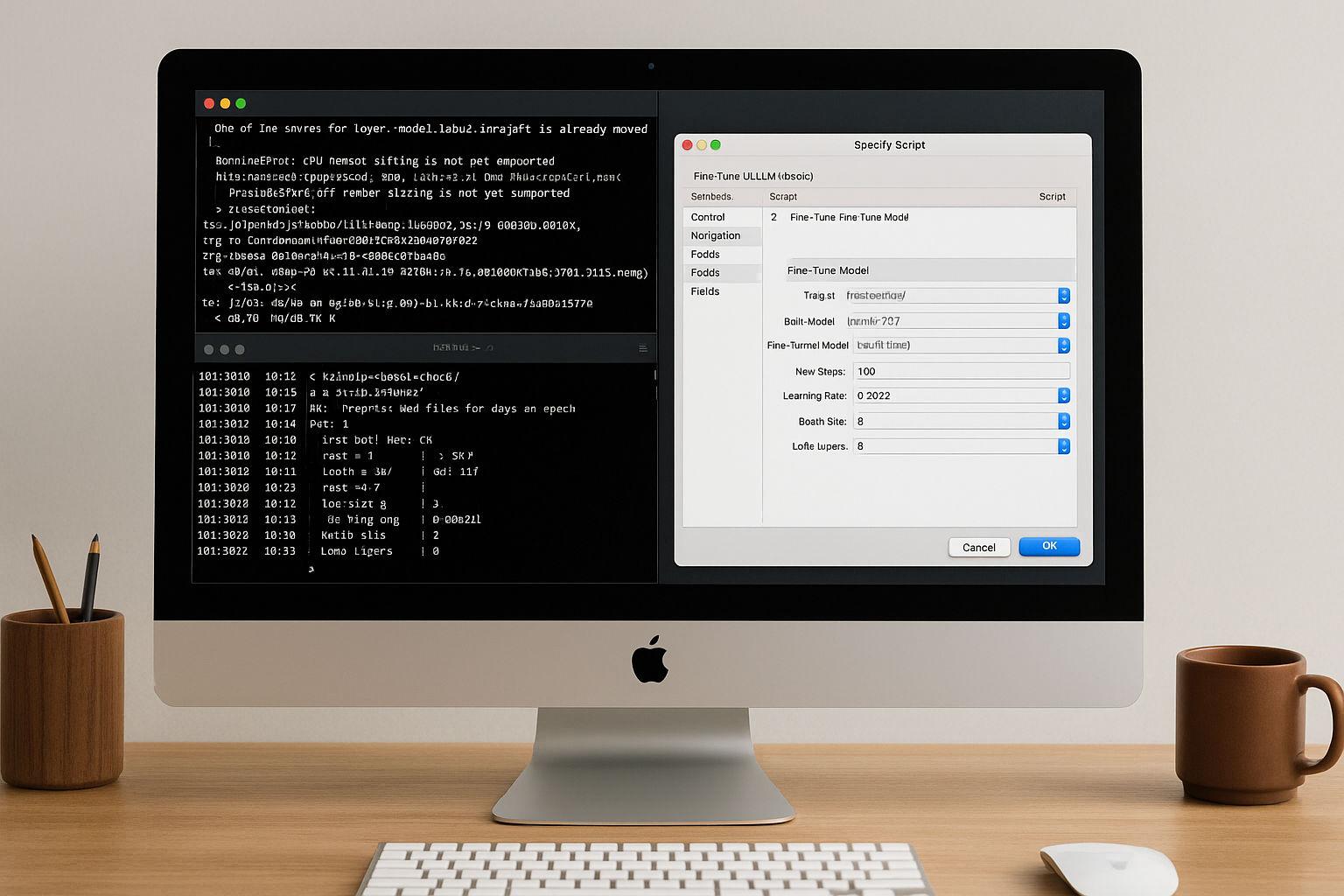

Я интенсивно сопровождал этот процесс в течение последних нескольких месяцев - сначала в классическом виде, с Python, терминалом, сообщениями об ошибках и нервными циклами настройки. А затем: с FileMaker 2025, шагом, который удивил меня - потому что он был не громким, но четким. И потому что он показал, что есть другой путь.

В подробном Специализированные статьи по gofilemaker.de Я документировал именно это изменение: переход от открытого, гибкого, но нестабильного обучения PEFT-LoRA (например, с помощью Axolotl, LLaMA-Factory или kohya_ss) к интегрированному решению от Claris - через скрипт, локально, с возможностью отслеживания.

Что такое LoRA и почему она так важна?

LoRA расшифровывается как Low-Rank Adaptation. За этим техническим термином скрывается простой, но мощный принцип: вместо того чтобы переобучать всю модель ИИ, адаптируются только очень специфические части - с помощью так называемых адаптивных весов, которые вставляются и обучаются целенаправленно. В последние годы этот метод зарекомендовал себя как золотой стандарт тонкой настройки для конкретной области - поскольку он не требует больших вычислительных мощностей и при этом дает отличные результаты.

Классический подход требует целого арсенала инструментов:

- функционирующая среда Python,

- подходящие версии CUDA и PyTorch,

- обучающий движок, например Axolotl или kohya_ss,

- Ресурсы графического процессора позволяют справиться со всем этим,

- И последнее, но не менее важное: Терпение. Много терпения.

Поскольку между файлами YAML, конфликтами токенайзеров и преобразованиями форматов (от safetensors до GGUF, MLX и обратно) часто проходит несколько дней, прежде чем удается получить пригодный для использования результат. Это работает - но это не то, чем можно заниматься на стороне.

А потом появился FileMaker 2025.

С появлением AI Model Server и нового шага сценария под названием Fine-Tune Model компания Claris переносит этот метод в среду, в которой его не ожидали увидеть: в реляционную базу данных.

То, что сначала кажется необычным, при ближайшем рассмотрении оказывается вполне логичным. Ведь что нужно для хорошей тонкой настройки?

- Структурированные данные,

- стабильная обстановка,

- очистить параметры,

- и определенный контекст приложения.

FileMaker предлагает все это - вот почему интеграция LoRA в эту среду выглядит не как инородное тело, а скорее как логическое продолжение.

Обучение без терминала - но не без контроля

В своей статье я подробно описываю, на что похож процесс обучения в FileMaker:

- Ввод данных непосредственно из существующих таблиц или файлов JSONL,

- Гиперпараметрами, такими как скорость обучения или глубина слоя, можно управлять непосредственно в сценарии,

- Полная локальная работа на Apple-Silicon - без облака, без выгрузки,

- и самое главное: воспроизводимые результаты, пригодные для ежедневного использования.

Конечно, есть ограничения. FileMaker (пока) не позволяет обслуживать несколько моделей, применять стратегии замораживания слоев или экспортировать в другие форматы, такие как GGUF или ONNX. Это не исследовательский инструмент, а инструмент для четких сценариев использования - например, для адаптации языковых моделей к специфическим для компании терминам, ответам, описаниям продуктов или внутренним диалоговым структурам.

И в этом заключается вся прелесть: она работает. Стабильно. Повторяемо. И быстрее, чем я мог себе представить.

Текущий опрос о будущем FileMaker и искусственного интеллекта

Кому и почему стоит присмотреться?

Эта статья адресована всем, кто не только понимает, что такое искусственный интеллект, но и хочет его использовать:

- Управляющий директор, которые хотят гармонизировать защиту данных и повысить эффективность.

- Разработчик, которые не хотят каждый раз начинать с нуля.

- Стратеги, которые понимают, что ИИ можно не только „купить“ извне, но и обучить внутри компании.

В FileMaker 2025 года тонкая настройка языковых моделей станет частью рабочего процесса - не как инородное тело, а как реальный инструмент. Это тихое, но устойчивое изменение, которое показывает, как далеко мы продвинулись в пригодности ИИ для повседневного использования.

В следующей статье я расскажу о том, как можно обучить языковую модель на практике с помощью FileMaker, а также приведу соответствующий пример скрипта.