Świat sztucznej inteligencji jest w ciągłym ruchu. Nowe modele, nowe metody, a przede wszystkim nowe możliwości pojawiają się niemal co tydzień - a jednak jedno pozostaje niezmienne: nie każda innowacja techniczna automatycznie prowadzi do lepszego życia codziennego. Wiele rzeczy pozostaje eksperymentalnych, złożonych lub po prostu zbyt kosztownych do produktywnego wykorzystania. Jest to szczególnie widoczne w tak zwanym dostrajaniu dużych modeli językowych - metodzie specjalizacji generatywnej sztucznej inteligencji do własnych treści, terminów i tonacji.

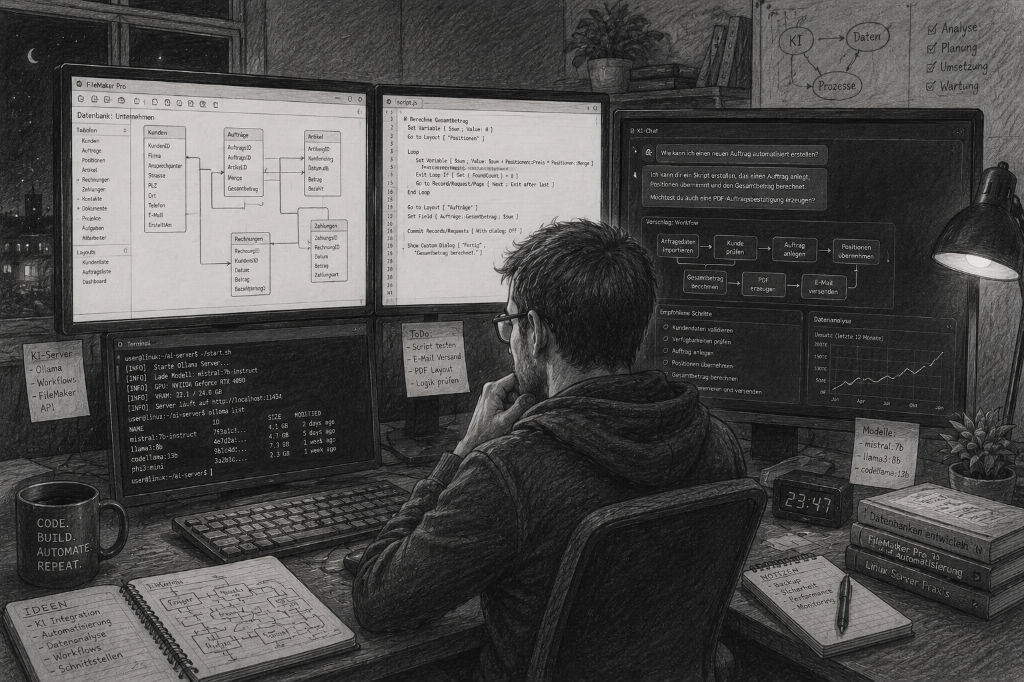

Towarzyszyłem temu procesowi intensywnie przez ostatnie kilka miesięcy - najpierw w klasycznej formie, z Pythonem, terminalem, komunikatami o błędach i nerwowymi pętlami konfiguracji. A potem: z FileMaker 2025, krokiem, który mnie zaskoczył - bo nie był głośny, ale wyraźny. I dlatego, że pokazał, że jest inny sposób.

W szczegółowym Artykuły specjalistyczne na temat gofilemaker.de Udokumentowałem dokładnie tę zmianę: przejście z otwartego, elastycznego, ale niestabilnego szkolenia PEFT-LoRA (np. z Axolotl, LLaMA-Factory lub kohya_ss) do zintegrowanego rozwiązania Claris - za pomocą skryptu, lokalnie, identyfikowalnie.

Czym w ogóle jest LoRA i dlaczego jest tak ważna?

LoRA to skrót od Low-Rank Adaptation. Za tym technicznie brzmiącym terminem kryje się prosta, ale potężna zasada: zamiast przekwalifikowywać cały model sztucznej inteligencji, dostosowywane są tylko bardzo specyficzne części - przy użyciu tak zwanych adapterów, które są wstawiane i trenowane w ukierunkowany sposób. W ostatnich latach metoda ta stała się złotym standardem dla dostrajania specyficznego dla domeny - ponieważ wymaga niewielkiej mocy obliczeniowej i nadal zapewnia doskonałe wyniki.

Klasyczne podejście wymaga arsenału narzędzi:

- działające środowisko Python,

- odpowiednie wersje CUDA i PyTorch,

- silnik treningowy, taki jak Axolotl lub kohya_ss,

- Zasoby GPU do obsługi całości,

- i ostatnie, ale nie mniej ważne: Cierpliwość. Dużo cierpliwości.

Pomiędzy plikami YAML, konfliktami tokenizerów i konwersjami formatów (z safetensors do GGUF do MLX i z powrotem), często mijają dni, zanim osiągnięty zostanie użyteczny wynik. To działa - ale nie jest to coś, co można robić na boku.

A potem nadszedł FileMaker 2025.

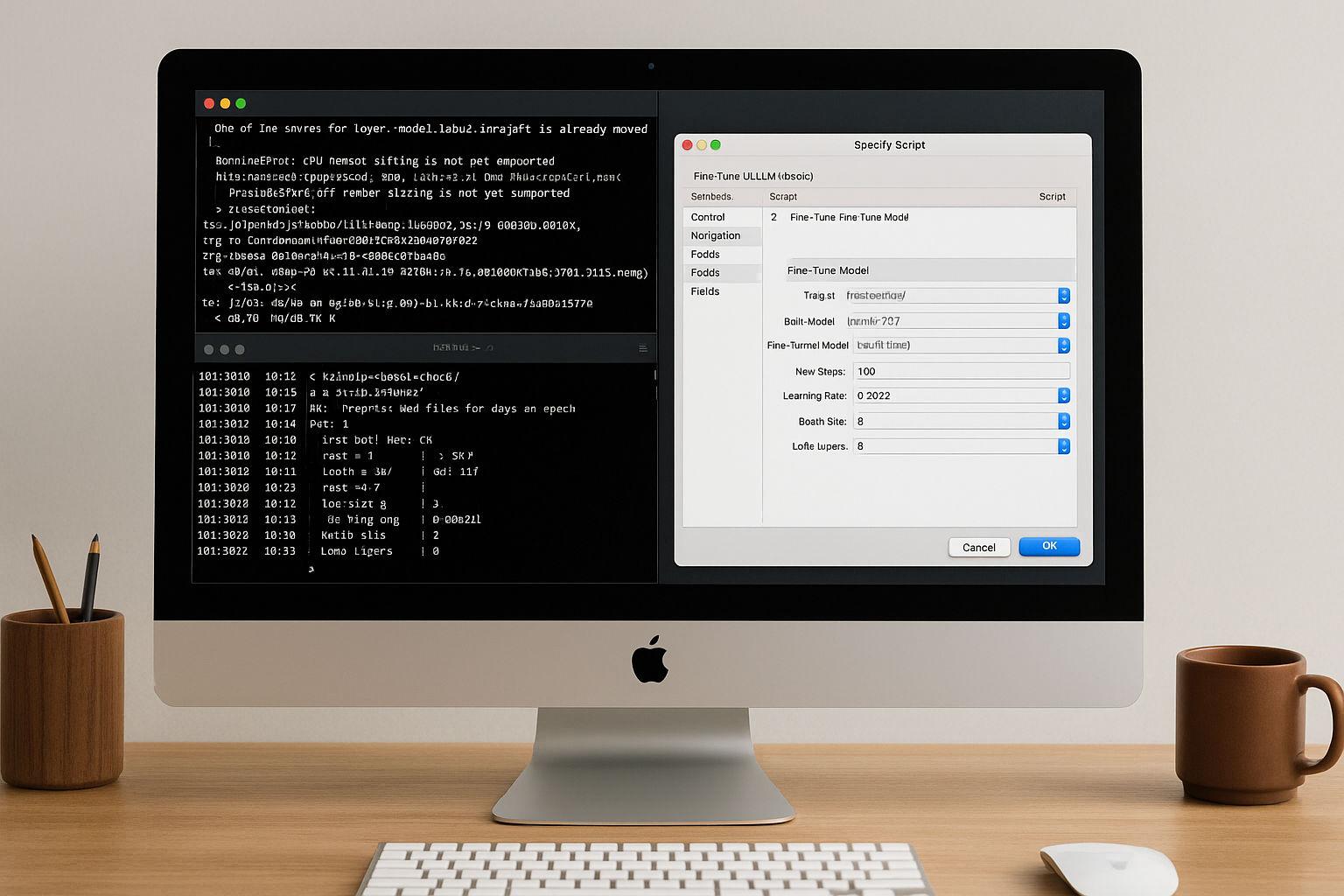

Wraz z wprowadzeniem AI Model Server i nowego kroku skryptu o nazwie Fine-Tune Model, Claris wprowadza tę metodę do środowiska, w którym nie byłaby oczekiwana: relacyjnej bazy danych.

To, co na początku brzmi nietypowo, po bliższym przyjrzeniu się nabiera sensu. Bo czego potrzebuje dobre dostrojenie?

- Dane strukturalne,

- stabilne środowisko,

- wyczyść parametry,

- i zdefiniowany kontekst aplikacji.

FileMaker oferuje to wszystko - dlatego integracja LoRA w tym środowisku nie wygląda jak ciało obce, ale raczej jak logiczne rozszerzenie.

Trening bez terminala - ale nie bez kontroli

W moim artykule opisuję szczegółowo, jak wygląda proces treningowy w FileMaker:

- Wprowadzanie danych bezpośrednio z istniejących tabel lub plików JSONL,

- Hiperparametry takie jak szybkość uczenia lub głębokość warstwy mogą być kontrolowane bezpośrednio w skrypcie,

- Pełna obsługa lokalna na Apple-Silicon - bez chmury, bez przesyłania,

- a przede wszystkim: wyniki, które są powtarzalne i odpowiednie do codziennego użytku.

Oczywiście są pewne ograniczenia. FileMaker nie pozwala (jeszcze) na obsługę wielu modeli, strategie zamrażania warstw lub eksport do innych formatów, takich jak GGUF lub ONNX. Nie jest to narzędzie badawcze, ale narzędzie do jasnych przypadków użycia - takich jak dostosowywanie modeli językowych do specyficznych dla firmy terminów, odpowiedzi, opisów produktów lub wewnętrznych struktur dialogowych.

I w tym tkwi urok: to działa. Stabilne. Powtarzalne. I szybciej niż kiedykolwiek myślałem, że to możliwe.

Aktualna ankieta na temat przyszłości FileMaker i sztucznej inteligencji

Kto powinien przyjrzeć się bliżej - i dlaczego?

Ten artykuł jest skierowany do każdego, kto nie tylko rozumie sztuczną inteligencję, ale także chce z niej korzystać:

- Dyrektor zarządzający, którzy chcą zharmonizować ochronę danych i wydajność.

- Deweloper, którzy nie chcą za każdym razem zaczynać od zera.

- Strategowie, którzy zdają sobie sprawę, że sztuczną inteligencję można nie tylko „kupić“ z zewnątrz, ale także wyszkolić wewnętrznie.

W FileMaker 2025 dostrajanie modeli językowych stanie się częścią przepływu pracy - nie jako ciało obce, ale jako prawdziwe narzędzie. Jest to cicha, ale trwała zmiana, która pokazuje, jak daleko zaszliśmy w zakresie przydatności sztucznej inteligencji do codziennego użytku.

Do artykułu:

Od terminala do skryptu: FileMaker 2025 sprawia, że dostrajanie LoRA nadaje się do codziennego użytku

W następnym artykule opiszę, w jaki sposób można trenować model językowy w praktyce za pomocą FileMaker, a także przedstawię odpowiedni przykładowy skrypt.