Все, кто сегодня работает с ИИ, почти автоматически попадают в облако: OpenAI, Microsoft, Google, любые веб-интерфейсы, токены, лимиты, условия и положения. Это кажется современным, но по сути является возвратом к зависимости: другие определяют, какие модели вам разрешено использовать, как часто, с какими фильтрами и по какой цене. Я сознательно иду другим путем: сейчас я строю свою собственную маленькую AI-студию у себя дома. Со своим собственным оборудованием, своими собственными моделями и своими собственными рабочими процессами.

Моя цель ясна: локальный текстовый ИИ, локальный ИИ изображений, обучение собственных моделей (LoRA, тонкая настройка) и все это таким образом, чтобы я, фрилансер, а впоследствии и клиент малого и среднего бизнеса, не зависел от ежедневных капризов какого-нибудь облачного провайдера. Можно сказать, что это возврат к старому отношению, которое раньше было вполне нормальным: „Важные вещи делайте сами“. Только на этот раз речь идет не о собственном верстаке, а о вычислительной мощности и суверенитете данных.

Последние новости о местном искусственном интеллекте и оборудовании

06.05.2026Apple, очевидно, еще больше сокращает выбор своих более мощных настольных компьютеров Mac. Как сообщает Хейзе, несколько ранее доступных конфигураций оперативной памяти для Apple Mac mini и Apple Mac Studio исчезают из ассортимента или становятся труднодоступными. Особенно пострадали модели с большим объемом памяти, которые в последнее время стали особенно интересны для локальных приложений искусственного интеллекта. По имеющимся данным, будут сняты с производства варианты Mac mini с 32 и 64 ГБ оперативной памяти, а также конфигурации Mac Studio с 128 и 256 ГБ ОЗУ. Ранее компания Apple уже отменила вариант Mac Studio с 512 ГБ оперативной памяти. В то же время сроки поставки других вариантов значительно увеличиваются. Наблюдатели подозревают, что это связано с высоким спросом со стороны рабочих нагрузок ИИ, возможной нехваткой памяти и подготовкой новых моделей M5. Особенно в области локальных моделей ИИ становится все более очевидным, насколько сильно аппаратные стратегии ориентированы на растущие требования современного программного обеспечения ИИ.

04.05.2026Компания Apple отменила самый дешевый на сегодняшний день выход в мир настольных Mac: . Модель Mac mini с 256 ГБ SSD больше не продается. В будущем конфигурация будет начинаться только с 512 ГБ памяти, что увеличит цену начального уровня примерно до 949 евро. На первый взгляд, это решение кажется незначительной корректировкой продукта, но оно показывает четкую стратегическую линию: Apple смещает базу вверх и фокусируется на более мощных минимальных конфигурациях.

Для пользователей в контексте ИИ - например, при локальной работе с моделями, вкраплениями или такими инструментами, как MLX, - это вполне объяснимо, поскольку 16 ГБ объединенной памяти и 256 ГБ хранилища быстро достигают своего предела. Однако в то же время это устраняет ранее низкий порог входа в экосистему Mac. Этот шаг вписывается в общую картину: растущие требования к аппаратному обеспечению из-за нагрузок, связанных с искусственным интеллектом, и растущая ориентация на более мощные системы вместо минимальных цен начального уровня. Для пользователей это означает больший запас производительности в долгосрочной перспективе - но более высокие инвестиционные затраты в краткосрочной.

11.04.2026В недавнем выпуске программы „Inside AI“ от Fraunhofer IEM представлен компактный обзор ключевых событий в области ИИ. Эксперт по ИИ Томми Фальковски рассматривает новые подходы к большим языковым моделям, такие как так называемые рекурсивные языковые модели, а также достижения в области генерации видео с помощью ИИ. Также в центре внимания окажутся системы на основе агентов и более эффективные методы обработки больших объемов данных. Особое практическое значение имеет растущая важность локальных инфраструктур ИИ, которые становятся все более мощными и открывают новые возможности применения - аспект, который также играет решающую роль при выборе подходящего оборудования.

Заправка ИИ: самые важные тенденции, инструменты и модели ИИ на 2026 год | INSIDE AI #33 | Fraunhofer IEM

Кроме того, представлены современные инструменты, модели и технологии, которые в долгосрочной перспективе меняют как инженерное дело, так и применение ИИ. В то же время показано, насколько динамично развивается эта область: Новые модели с открытым исходным кодом и недавние анонсы подчеркивают, что ключевые тенденции продолжают меняться за короткий промежуток времени.

Скорость остается непревзойденной на местном уровне

Облачные модели впечатляют - до тех пор, пока линия работает, серверы не перегружены, а API не подвергается очередному дросселированию. Но каждый, кто серьезно работает с ИИ, быстро понимает, что самая честная форма скорости - локальная. Если модель работает на вашем собственном Mac Studio или на вашем собственном GPU, значит, это правда:

- Отсутствие сетевых задержек

- Не нужно ждать, пока „другие“ будут готовы

- Никаких почасовых отмен

- Никаких „Rate limit reached“ в середине рабочего процесса

Я испытываю это каждый день: на своих Mac Studio параллельно работает модель 120B (GPT-OSS) и модель Gemma 27B - плюс сервер FileMaker и все мои базы данных. Тем не менее, система остается настолько отзывчивой, что я могу работать со скоростью, практически недостижимой для облачных систем. Особенно когда вы выполняете множество мелких операций подряд - переводы, переформулировки, анализы, подсказки в виде изображений - задержки быстро увеличиваются. Локальный ИИ ощущается не как „работа на сервере“, а как прямой инструмент: нажал - и все получилось.

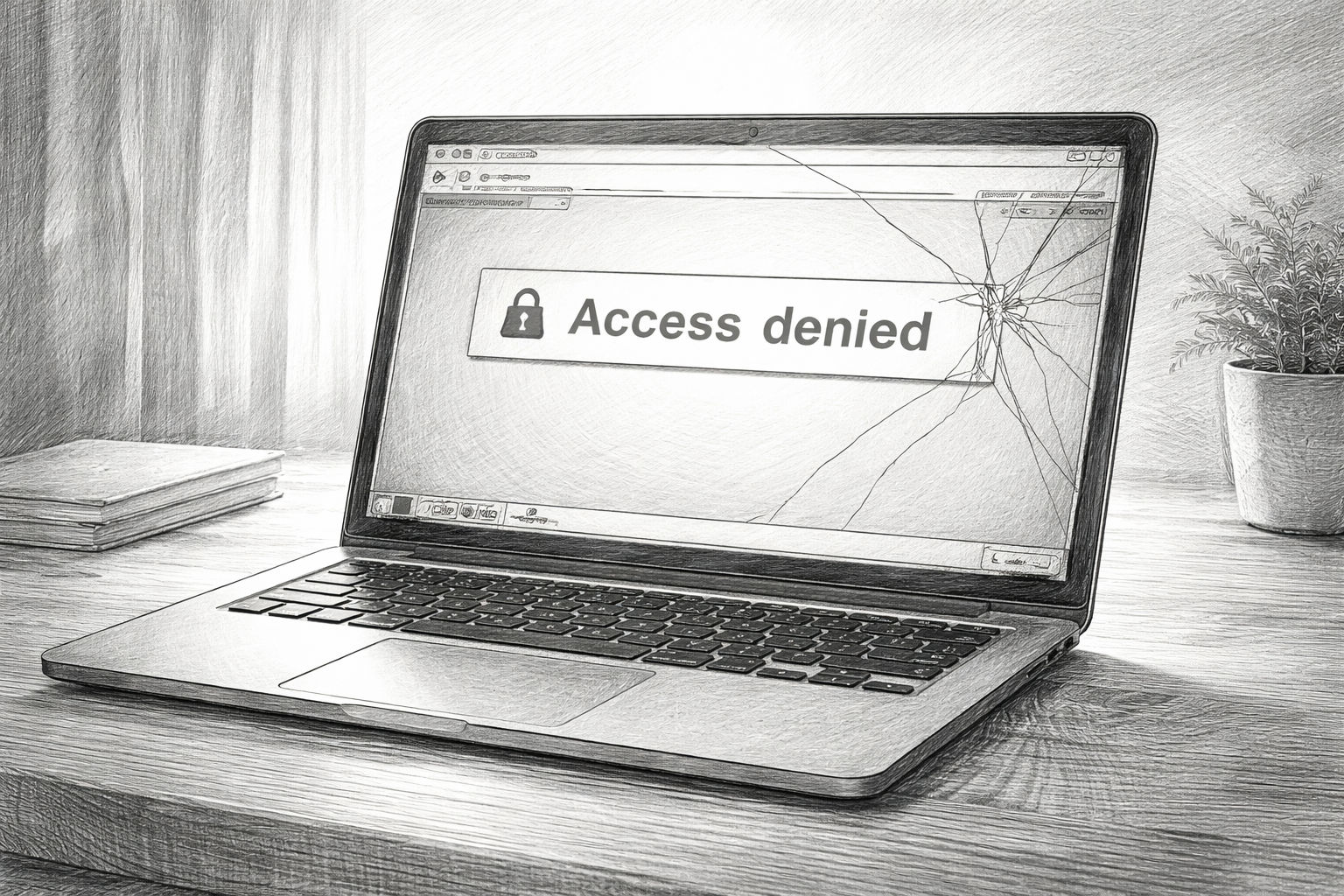

Суверенитет данных: когда конфиденциальной информации не место в сети

Один момент, о котором часто забывают, но который крайне важен для предпринимателей: данные. Как только вы используете облачный ИИ, вы неизбежно задаете себе вопросы:

- Можно ли вводить туда данные о клиентах?

- Что происходит с внутренними документами?

- Как долго хранятся журналы?

- Кто теоретически имеет доступ - сегодня и через два года?

- Какие юридические последствия может иметь утечка информации?

Конечно, крупные провайдеры обещают защиту данных. Но в конце концов вы передаете свой контент. И это именно то, чего вы хотели избежать в своей собственной компании в прошлом: Внутренние дела оставались внутренними. В местной AI-студии ситуация иная:

- Данные остаются в вашей собственной сети.

- Ни одна просьба не выходит из дома.

- Модели работают без доступа в Интернет.

- Журналы, данные тренировок и промежуточные результаты хранятся на ваших собственных дисках.

Когда в будущем я буду прогонять свои книги, статьи, заметки, PR-тексты, внутренние стратегические документы или данные о клиентах через свой ИИ, я хочу быть уверен, что ничего из этого не попадет в чужой обучающий набор. Такое доверие возможно только в том случае, если инфраструктура принадлежит мне.

Контроль над расходами вместо ползучей подписки

Облачные ИИ на первый взгляд кажутся дешевыми: несколько центов за 1 000 токенов, месячная подписка здесь, небольшой тариф там. Проблема в том, что затраты растут вместе с вашим успехом. Чем продуктивнее вы становитесь, тем дороже становится инфраструктура - каждый месяц. Местный ИИ работает иначе:

- Вы инвестируете в оборудование один раз.

- Затем запускайте модели столько и так часто, как вам захочется.

- Никакого „дрожания пальцев при заказе“, потому что каждый звонок стоит денег.

- Вы можете свободно экспериментировать, не просчитывая каждый входной сигнал.

Я купил свою RTX 3090 подержанной примерно за 750 евро - практически как новая. Mac Studio с 128 ГБ оперативной памяти достался мне примерно за 2 750 евро, в оригинальной упаковке и ни разу не вскрытый. Это деньги, да - но:

- Эти машины останутся со мной на долгие годы.

- Вы создаете непосредственно используемые активы: книги, статьи, изображения, LoRA, рабочие процессы.

- Они не требуют никаких дополнительных ежемесячных расходов, кроме электроэнергии.

Для издателя, консультанта, разработчика или небольшой компании это может быть разницей между „Мы должны просчитать, можем ли мы себе это позволить“ и „Мы просто будем использовать ИИ, когда он нам понадобится“.

Старые достоинства, новые преимущества: Почему владение собственными машинами снова имеет смысл

Раньше считалось само собой разумеющимся, что в мастерской у мастера должны быть хорошие инструменты. Столярная мастерская без соответствующего верстака и пил была бы немыслима. Сегодня мы привыкли к обратному: вместо того чтобы иметь собственное оборудование, мы нанимаем услуги. Собственная AI-студия - это, по сути, не что иное, как современная версия классической мастерской:

- Сайт Mac Studio является центральным движком для языковых моделей.

- Сайт Видеокарта RTX это фрезерный станок для изображений и обучения.

- A Дополнительный компьютер (например, Mac mini) берется за выполнение специальных задач, например, озвучивание или создание небольших моделей.

- Программное обеспечение, такое как FileMaker, служит панелью управления: оно организует, сохраняет и документирует.

Я создаю такую установку, потому что хочу иметь возможность делать все самостоятельно в долгосрочной перспективе:

- Написание и перевод книг,

- Создайте серию изображений,

- обучайте свои собственные модели LoRA,

- Автоматизируйте рабочие процессы,

- а позже также предложили клиентам решения, которые могут работать полностью локально.

Это не ностальгия, а трезвое решение: чем глубже ИИ вмешивается в повседневную жизнь, тем разумнее сохранять контроль над технологией. Локальный ИИ - это не „хоббистская альтернатива“ модным облакам, а осознанный возврат к независимости:

- Вы набираете скорость.

- Вы сохраняете свои данные.

- Вы контролируете свои расходы.

- Вы создаете инфраструктуру, которая принадлежит вам.

Если продумать все до конца, то домашняя AI-студия становится все больше похожа на классическую, хорошо оборудованную мастерскую: Вы не полагаетесь на то, что делают другие где-то на заднем плане, а создаете свою собственную стабильную базу.

Текущий обзор локальных систем искусственного интеллекта

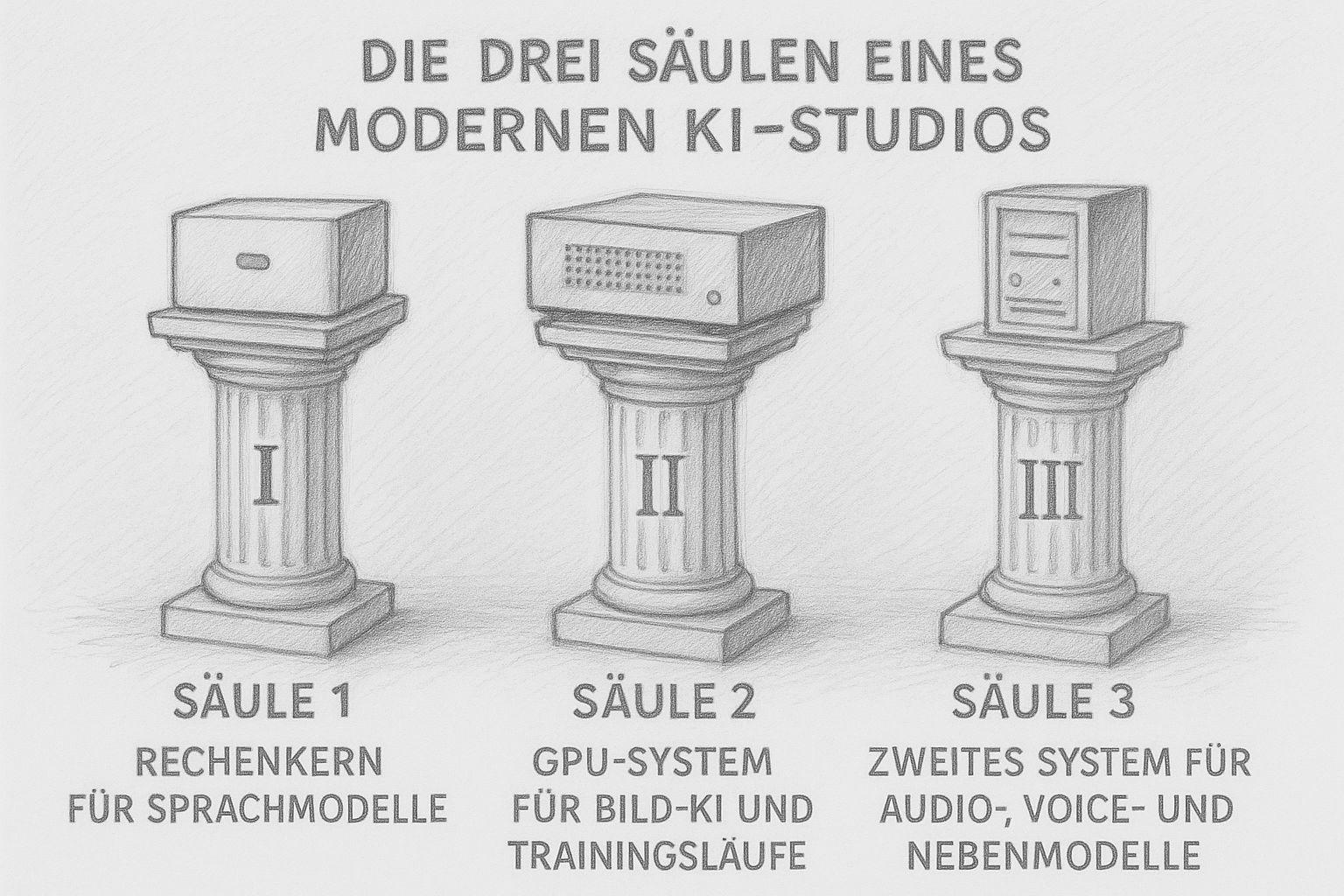

Три столпа современной AI-студии

Сегодня студия искусственного интеллекта уже не состоит из „одного большого компьютера“, который делает все. Современным рабочим процессам нужны разные мощности: вычислительные мощности для текстов, много VRAM для изображений и обучающих прогонов, а также более мелкие системы, выполняющие побочную работу. В результате получается не хаотичное множество устройств, а продуманная небольшая инфраструктура - как хорошо оборудованная мастерская в прошлом, где каждая машина выполняет свою задачу.

Я сам строю свою студию именно по этому принципу. И чем глубже я погружаюсь в этот вопрос, тем яснее он становится: трех столпов достаточно, чтобы запустить полноценное AI-производство на месте.

Компонент 1: вычислительное ядро для языковых моделей (LLM)

Сегодня для создания больших языковых моделей больше не требуется сервер в дата-центре, а прежде всего - много очень быстрой оперативной памяти. Именно на это способны современные системы Apple-Silicon или аналогично оснащенные Linux-машины с большим объемом оперативной памяти. Вычислительное ядро - это центральная часть студии. Именно здесь оно работает:

- Крупные магистратуры (20B, 30B, 70B, 120B MoE ...)

- Аналитические модели

- Модели перевода

- Внутренний Системы знаний (neo4j, RAG)

- также долгосрочный Память с поддержкой искусственного интеллекта

- Системы управления например, n8n

- FileMaker-Автоматизация и серверные процессы

В моей системе эту роль выполняет Mac Studio M1 Ultra с 128 ГБ оперативной памяти. И делает это удивительно хорошо. Я работаю на нем:

- GPT-OSS 120B MoE (для глубокого мышления, длинных текстов и анализов)

- Гемма-3 27B (для технической работы, такой как FileMaker, код, точное структурирование)

- Сервер FileMaker + базы данных

- плюс вся инфраструктура оболочки и веб-сервера

Невероятно, но даже при одновременной работе двух больших моделей 10-15 ГБ оперативной памяти остаются свободными. Это преимущество архитектуры, полностью рассчитанной на унифицированную память. В двух словах: вычислительное ядро - это мозг студии искусственного интеллекта. Здесь происходит все, что связано с пониманием, генерацией или преобразованием текста.

Опора 2: система GPU для искусственного интеллекта изображений и тренировочных прогонов

Вторая составляющая - рабочая станция на GPU, оптимизированная для обучения Stable Diffusion, ComfyUI, ControlNet и LoRA. В то время как текстовые модели требуют в основном оперативной памяти, ИИ изображений нуждается в VRAM. И очень много. Почему? Потому что модели изображений прогоняют через память гигантские объемы данных за кадр. И именно для этого созданы видеокарты. В моей студии этим занимается NVIDIA RTX 3090 с 24 ГБ VRAM - и эти 24 ГБ на вес золота. Они позволяют:

- SDXL с разумным размером партии

- Рабочие процессы ComfyUI

- Синтез видео

- Серия картинок

- Обучение материалу и стилю

- Обучение LoRA с разрешением 896×896 или даже 1024×1024

Для искусственного интеллекта VRAM важнее, чем самый современный чип. Солидный 3090 сегодня может сделать больше, чем дорогие карты среднего класса 2025 г. Поэтому колонна GPU - это „тяжелое оборудование“ в студии - фрезерный станок, который отпиливает все, что означает вычислительную нагрузку. Без нее серьезное производство изображений вряд ли возможно.

Опора 3: Вторая система для аудио, голосовых и вторичных моделей

Третья составляющая может показаться незаметной, но она имеет решающее значение: более компактная, энергоэффективная система, которая берет на себя второстепенные задачи. К ним относятся:

- TTS (преобразование текста в речь)

- STT (транскрипция)

- более компактные модели (4B, 7B, 8B, 14B)

- статический Фоновые процессы

- маленький Агентские системы

- Инструменты, которые вы хотите использовать отдельно от основной системы

Я использую маленький Mac mini M4 с 32 ГБ оперативной памяти. Идеально подходит для:

- Шепот-Транскрипция

- Голос-модели

- свет Оптимизационные модели

- быстрое реагирование Ассистенты

- Эксперименты и Тестовые испытания

- параллельно Модель контейнера

Это значительно разгружает основную систему. В конце концов, имеет смысл не загружать большие модели для каждой мелкой работы. Точно так же, как раньше вы не запускали большую циркулярную пилу для каждого реза в мастерской, а использовали маленький станок. Третья опора обеспечивает организацию и стабильность.

Он отделяет крупные модели от мелких задач - и это делает всю студию долговечной, гибкой и безотказной.

Интеллектуальное распределение рабочих нагрузок

Студия искусственного интеллекта процветает благодаря тому, что каждая машина делает то, для чего она была создана. Это приводит к логическому порядку:

- Расчетное ядро → Мышление, письмо, перевод, анализ

- Система GPU → Изображения, учебные модели, ComfyUI, видео

- Подсистема → Аудио, голос, маленькие модели, агенты

Когда добавляется дополнительное программное обеспечение - например, FileMaker в качестве центральной системы управления - создается настоящий производственный конвейер. Больше никакого хаоса, никаких „посмотрим, где еще есть место“, только организованная система, которая стабильно работает каждый день.

Три столпа - это фундамент, а не вольный стиль

Многие считают, что студия искусственного интеллекта нужна только после того, как вы станете „компанией искусственного интеллекта“. На самом деле все наоборот: надежная AI-студия - это фундамент для того, чтобы стать таковой. Благодаря этим трем составляющим у вас есть все необходимое:

- Создание контента (текст и изображения)

- Обучайте собственных моделей

- Автоматизируйте рабочие процессы

- Работайте независимо от облака

- разрабатывать собственные решения для клиентов

- использовать цифровые „верстаки“ в долгосрочной перспективе

Для предпринимателей, творческих личностей, издателей и разработчиков это стратегическое решение, обеспечивающее свободу, скорость и контроль в долгосрочной перспективе.

Разумное оборудование начального уровня для небольшой студии искусственного интеллекта

Если вы смотрите рекламу в наши дни, то можете подумать, что для локальной работы с искусственным интеллектом необходимо постоянно покупать самое современное оборудование. Однако часто бывает наоборот: решающее значение имеют не новейшие модели, а правильное сочетание оперативной памяти, VRAM и стабильности. Многие старые устройства - особенно в секторе GPU - сегодня являются настоящими монстрами по соотношению цена/производительность. И если вы готовы мыслить нестандартно, вы можете создать студию искусственного интеллекта, которая будет отвечать требованиям небольшой компании, не перенапрягаясь при этом финансово. Именно этим я сейчас и занимаюсь, и это работает на удивление хорошо. В этой главе мы рассмотрим три класса оборудования: Новичок, Стандарт и Профессионал. И, конечно, я объясняю, почему некоторые старые системы сегодня ценнее, чем вы думаете.

1-й класс начального уровня (1500-2500 €)

Для тех, кто хочет начать свое дело на местном уровне - без больших инвестиций. На этом занятии вы сможете сделать первые уверенные шаги:

- Mac mini M2 или M4 с 16-32 ГБ оперативной памяти

- или ПК с RTX 3060/3070 (12-16 ГБ ПАМЯТИ)

- плюс, по желанию, небольшой NAS или внешний SSD

Это хороший способ:

- Эксплуатация моделей от 7B до 14B

- Выполняйте местные переводы

- Беги шепотом

- Используйте меньшие модели изображений, например SD 1.5/2.1.

- Попробуйте ComfyUI в уменьшенном виде

- Тестируйте собственных агентов или рабочие процессы

Для многих творческих людей или самозанятых этого более чем достаточно, чтобы стать продуктивными. Главное - не усложнять начало работы. Самая большая опасность заключается не в том, что у вас слишком мало мощности, а в том, что вы увязнете в большом количестве технических деталей. Например, с помощью Mac mini M4 можно сделать невероятно много: Переводы, исследования, структурирование, даже небольшие письменные модели - и всё это при минимальном энергопотреблении.

2-й стандартный класс (2500-4000 €)

Сладкая точка для серьезной работы с текстами и изображениями. Именно здесь начинается то, что я бы назвал “настоящей AI-студией“: установка, которая может работать как с большими текстовыми моделями, так и с цельными моделями изображений. Типичная комбинация:

- Mac Studio M1 Ultra или M2 Max с 64 ГБ оперативной памяти

- Рабочая станция ПК/ГПУ с RTX 3080, 3090 или 3090 Ti

- по желанию небольшой Дополнительный компьютер для аудио или голоса

С помощью этого урока вы сможете:

- Надежное управление моделями 20-40B

- Используйте Stable Diffusion XL в хорошем качестве

- Выполните обучение LoRA в диапазоне средних наборов данных

- Распределение параллельных рабочих нагрузок на нескольких устройствах

- Настройка автоматики (например, через FileMaker)

И тут выясняется интересная истина: старые GPU, такие как RTX 3090, по-прежнему разбивают на куски многие новые карты среднего уровня. Почему? У них больше VRAM (24 ГБ), в то время как новые карты зачастую кастрированы. У них широкий интерфейс памяти, идеальный для широко распространенных моделей. У них зрелые и стабильные драйверы CUDA. Они часто продаются подержанными по удивительным ценам. 3090 может сделать больше за 700-900 евро, чем современные 4070 или 4070 Ti за 1100 евро - просто потому, что VRAM и возможности подключения памяти важнее, чем несколько процентов сырой производительности.

3-й профессиональный класс (4000-8000 €)

Для всех, кто серьезно относится к производству - и стремится к полной независимости. В этом классе доступна настоящая производственная мощь. Типичная установка:

- Mac Studio M1 / M2 / M3 Ultra с 128 ГБ оперативной памяти или более

- Система ПК-ГПУ с RTX 3090 или 4090

- a второй компьютер для аудио/агентов

- Дополнительный сервер FileMaker в качестве центра автоматизации

Это позволит вам:

- Используйте модели 70B плавно

- Стабильная работа моделей MoE, таких как GPT-OSS 120B

- Координация параллельных агентов ИИ

- SDXL, видео ИИ, ComfyUI работают на полную мощность

- Запускайте тренировки LoRA с разрешением 896×896 или 1024×1024

- Подготовьте собственные базы данных для обучения

- Составьте карту полных трубопроводов (подсказки → изображения → PDF → книги)

И вот тут вы увидите самое интересное: лучшее оборудование для ИИ в 2025 году зачастую использует оборудование премиум-класса 2020-2022 годов. Почему? Тогда оно было разработано для высокопроизводительных рабочих нагрузок. Сегодня оно стоит в разы дешевле. Технология отработана. Нет проблем с бета-драйверами. Оно обладает именно теми характеристиками, которые нужны ИИ: много VRAM, широкие шины памяти, стабильные тензорные ядра.

Почему вы потерпите неудачу при слишком малом количестве VRAM - и не потерпите неудачу при слишком малой мощности GPU

Этот момент многие недооценивают: VRAM является решающим фактором для AI изображения, а не для чистой производительности. Примеры:

- Один RTX 4060 (8 ГБ VRAM) практически непригоден для SDXL.

- Один RTX 4070 Ti (12 ГБ VRAM) лишь ненадежно хватает для обучения.

- Один RTX 3090 (24 ГБ VRAM), напротив, работает без сбоев в течение многих лет.

Короче говоря, большим моделям нужна память, а не маркетинг. А память - это то, что есть у старых карт высокого класса и нет у новых карт среднего класса.

Как модульно расширить студию искусственного интеллекта

Самое большое преимущество трехкомпонентной студии - ее модульность:

- Рабочая станция с GPU может быть модернизирована независимо.

- Вы можете хранить Mac Studio в течение многих лет.

- Вы можете заменить ведомый компьютер, не нарушая работу системы.

- Жесткие диски или SSD можно расширять отдельно.

- В качестве оркестровки можно использовать FileMaker, Python или Bash.

Это как мастерская: Вы не перестраиваете все сразу, а только то, что необходимо в данный момент.

Местный ИИ теперь действительно пригоден для использования (и он работает на этом оборудовании) |. c't 3003

Рекомендации на 2025 год - Это оборудование действительно стоящее

В джунглях рекламы и спецификаций легко заблудиться. Но для использования ИИ дома или в небольшой студии есть классы оборудования, которые будут особенно полезны в 2025 году - потому что они предлагают хорошее соотношение цены и качества, надежны и достаточны для текущих моделей. Что важно сегодня:

- Достаточное количество VRAM (для задач GPU): Для искусственного интеллекта, тренировок, стабильной диффузии и т. д. видеокарта должна иметь не менее 16, а лучше 24 ГБ VRAM. При превышении этого порога искусственный интеллект становится комфортным и стабильным.

- Хорошая рабочая память и объем оперативной памяти (для LLM): Для больших LLM, работающих в многозадачном режиме с серверными службами и параллельными процессами, имеет смысл использовать как можно больше оперативной памяти - в идеале 64-128 ГБ для Apple-Silicon.

- Стабильное, проверенное оборудование вместо новейших маркетинговых продуктовСтарые карты высокого класса, в частности, часто имеют отличные характеристики (VRAM, шина памяти, зрелость драйверов) при умеренной цене.

- Модульность и микширование вместо моноблокаСочетание компьютера LLM, рабочей станции с GPU и вторичной/агентской системы более гибкое и долговечное, чем одна машина „все в одном“.

| Класс | Типичные компоненты | Для кого подходит | Сильные стороны / Компромиссы |

|---|---|---|---|

| Начальный уровень (около 1 500-2 500 €) | Mac mini (16-32 ГБ ОЗУ) или ПК с GPU (например, RTX 3060 / 3060 Ti / 4060 Ti с ≥ 12-16 ГБ VRAM) | Хобби, первые опыты, небольшие модели, управляемый AI | Выгодный начальный уровень, достаточный для небольших LLM, легких стабильных диффузионных рабочих процессов и аудио/текстового AI. Ограничения при работе с большими моделями, сложными конвейерами ComfyUI и обучением LoRA. |

| Стандарт (ок. € 2 500-4 000) | Рабочая станция с GPU среднего уровня (например, с RTX 3080 или RTX 3090), компьютер с 64 ГБ оперативной памяти | Творческие люди, самоиздатели, амбициозные пользователи ИИ, небольшие команды | Высокая производительность при работе с текстом и изображениями, хорошее соотношение цены и качества. Достаточно VRAM и RAM для разностороннего использования ИИ, включая SDXL и начальное обучение LoRA. При работе с экстремальными проектами или множеством параллельных рабочих процессов система в какой-то момент достигает своего предела. |

| Профессиональный / студийный (около 4 000-8 000 €) | Система с высоким объемом оперативной памяти (например, Mac Studio с 128 ГБ ОЗУ или мощная рабочая станция Linux) + GPU с ≥ 24 ГБ VRAM (например, RTX 3090, 4090) + отдельная вторичная/агентная система | Фрилансеры, издатели, медиапроизводители, разработчики с несколькими проектами, небольшие AI-студии | Максимальная гибкость, большие модели (70B, MoE), параллельная обработка изображений и текста, автоматизация и длительные рабочие процессы. Очень перспективен, но требует больших первоначальных инвестиций и немного больше усилий по планированию при настройке. |

Почему подержанные и старые графические процессоры высокого класса сегодня зачастую лучше новых карт среднего класса

Многие новые карты предлагаются с ограниченным объемом VRAM, но это очень важно для ИИ. Старые модели высокого класса, такие как RTX 3090, часто предлагают 24 ГБ VRAM, что очень ценно сегодня для SDXL, обучения LoRA или видео ИИ. Аппаратное обеспечение изначально разрабатывалось для обеспечения производительности и стабильности - с высококачественными компонентами, шиной памяти, охлаждением и хорошей поддержкой драйверов.

Это означает: долговечность и надежная работа. Подержанные карты часто стоят значительно дешевле и поэтому очень доступны - идеальный вариант для фрилансеров или небольших студий с ограниченным бюджетом.

Моя текущая рекомендация на 2025 год (и почему)

Если бы я создавал студию сегодня и не стремился к максимальной мощности суперкомпьютера, я бы принял решение:

- Для искусственного интеллектаКак минимум один графический процессор с 24 ГБ VRAM - например, RTX 3090 или 4090.

- Для текста/LLM128 ГБ оперативной памяти в мощной системе Apple-Silicon.

- Для работы с частичной занятостью (аудио, голос, небольшие модели, автоматизация): небольшой отдельный компьютер (например, мини-ПК или недорогой сервер).

- Для координации: программный слой - для меня это FileMaker, для других это может быть простая оболочка или конвейер Python.

Эта система не является чрезмерной, не зависит от дорогостоящих облачных лицензий - и достаточна практически для всего, что может быть сделано с помощью ИИ в творческом, издательском или девелоперском секторе в 2025 году.

ERP intelligent: Выполнение локальных языковых моделей с помощью сервера FileMaker

Вопрос о правильном аппаратном обеспечении для ИИ вполне оправдан, но если рассматривать его в отрыве от реальности, то он не оправдывает себя. Такие мощные системы, как Mac Studio или рабочая станция на базе RTX, по-настоящему раскрывают свои возможности только тогда, когда они интегрированы в продуманную структуру программного обеспечения. Благодаря предстоящим разработкам Claris FileMaker Server именно этот шаг станет более ощутимым: впервые локальные языковые модели могут работать непосредственно на сервере и интегрироваться в существующие приложения. Это означает, что даже прямые Обучение LoRA в рамках FileMaker возможно. Однако это также означает, что требования к оперативной памяти, графическому процессору и системе в целом значительно возрастают - простой работы сервера без соответствующего резерва в долгосрочной перспективе будет уже недостаточно. В сочетании с локальным ERP-решение на базе FileMaker таких как gFM Business, это приводит к созданию мощной общей системы, в которой искусственный интеллект работает не изолированно, а напрямую обращается к процессам компании. Таким образом, чистая вычислительная мощность превращается в реальный производственный фактор - структурированный, контролируемый и непосредственно привязанный к вашей собственной системе.

Вопрос о правильном аппаратном обеспечении для ИИ вполне оправдан, но если рассматривать его в отрыве от реальности, то он не оправдывает себя. Такие мощные системы, как Mac Studio или рабочая станция на базе RTX, по-настоящему раскрывают свои возможности только тогда, когда они интегрированы в продуманную структуру программного обеспечения. Благодаря предстоящим разработкам Claris FileMaker Server именно этот шаг станет более ощутимым: впервые локальные языковые модели могут работать непосредственно на сервере и интегрироваться в существующие приложения. Это означает, что даже прямые Обучение LoRA в рамках FileMaker возможно. Однако это также означает, что требования к оперативной памяти, графическому процессору и системе в целом значительно возрастают - простой работы сервера без соответствующего резерва в долгосрочной перспективе будет уже недостаточно. В сочетании с локальным ERP-решение на базе FileMaker таких как gFM Business, это приводит к созданию мощной общей системы, в которой искусственный интеллект работает не изолированно, а напрямую обращается к процессам компании. Таким образом, чистая вычислительная мощность превращается в реальный производственный фактор - структурированный, контролируемый и непосредственно привязанный к вашей собственной системе.

Оборудование для ИИ не обязательно должно быть новым, но подходящим

Сегодня заканчивается время, когда „ИИ“ был уделом только крупных корпораций или облачных лабораторий. К 2025 году практически любой человек - с приемлемым бюджетом и небольшими техническими знаниями - сможет создать собственную небольшую студию ИИ. Это сделает вас независимым от дорогостоящих ежемесячных подписок, условий защиты данных от сторонних разработчиков, очередей, узких мест на серверах и неопределенности в отношении того, как долго будут существовать облачные сервисы. Вместо этого вы получаете:

- Полный контроль о ваших данных и рабочих процессах,

- стабильный, быстрый и Масштабируемая производительность,

- один Устойчивые инвестиции, который прослужит долгие годы,

- и Свобода, заниматься творчеством, когда и как вам хочется - без внешних ограничений.

Поэтому, если вы думаете об использовании искусственного интеллекта в своих книгах, текстах, изображениях или проектах, сейчас как никогда целесообразно создать собственную студию. Вам не нужно быть инженером-технологом. Вам не нужен огромный бюджет. Вам не нужно новейшее оборудование.

Прежде всего, вам необходимо четко представлять себе цель, к которой вы стремитесь, и сохранять контроль над своими процессами.

Я покажу вам, как настроить локальный LLM с Ollama на Mac installier в эта статья.

Здесь вы найдете сравнение Apple MLX на Silicon против NVIDIA.

Как работать с Qdrant локальная память для вашего местного ИИ можно найти здесь.

Часто задаваемые вопросы

- Зачем вообще нужна собственная студия искусственного интеллекта, если есть столько облачных провайдеров?

Собственная AI-студия делает вас более независимыми, стабильными и дешевыми в долгосрочной перспективе. Облачные сервисы удобны, но они стоят денег каждый месяц, создают зависимость и часто ограничены в использовании. Локальный ИИ работает быстро, постоянно доступен и может использоваться без переменных затрат. Кроме того, все данные остаются внутри компании - огромное преимущество для самозанятых, компаний, издателей или представителей творческих профессий. - Какое минимальное оборудование необходимо для начала работы с локальным искусственным интеллектом?

Для начала работы достаточно Mac mini с 16-32 ГБ ОЗУ или ПК с GPU с не менее чем 12 ГБ VRAM. Это позволит вам запускать небольшие языковые модели, легкие модели изображений и начальные автоматизации. Если вы хотите просто попробовать, вам не придется выкладывать несколько тысяч евро. - Действительно ли мне нужна Mac Studio или она дешевле?

Он определенно дешевле. Mac Studio стоит приобрести, если вы хотите запускать большие языковые модели (20-120B), много работать параллельно или иметь долгосрочные производственные процессы. Для первых шагов вполне достаточно Mac mini или надежного ПК с Windows. Студия - это инвестиция в удобство и будущее, но не обязательное условие. - Почему для искусственного интеллекта изображений VRAM важнее, чем современное поколение видеокарты?

Потому что такие модели изображений, как Stable Diffusion, прогоняют через память огромные объемы данных. Если VRAM недостаточно, процесс останавливается или становится крайне медленным. Старые карты, такие как RTX 3090 с 24 ГБ VRAM, часто выигрывают у новых моделей среднего класса с 8-12 ГБ VRAM - просто потому, что они предлагают больше места для больших моделей и тренировочных прогонов. - Могу ли я запустить студию искусственного интеллекта полностью на оборудовании Apple без NVIDIA?

Для языковых моделей - да. Для ИИ изображений - нет. Apple-Silicon чрезвычайно эффективен для LLM, но для стабильной диффузии, обучения LoRA и многих моделей изображений карты NVIDIA (благодаря ядрам CUDA/Tensor) по-прежнему являются эталоном. Поэтому многие студии используют гибрид Apple/LLM и Linux+NVIDIA для работы с изображениями. - Достаточно ли RTX 4080 или 4070 Ti для искусственного интеллекта?

Теоретически да, но на практике все зависит от цели использования. Для простых изображений или небольших рабочих процессов этого достаточно. Но для SDXL, сложных конвейеров ComfyUI или обучения LoRA ограничение в 12-16 ГБ VRAM быстро достигает своего предела. Поэтому в долгосрочной перспективе более целесообразно использовать RTX 3090 или 4090. - Почему языковые модели работают не на GPU, а в оперативной памяти?

Языковые модели ориентированы на память. Они должны хранить в оперативной памяти большие объемы текста и контекста, а не выполнять графические операции. Графические процессоры созданы для обработки изображений, а не для анализа текста. Именно поэтому системы LLM получают огромную пользу от большого объема оперативной памяти, но меньшую - от VRAM. - Какой объем оперативной памяти должен быть у компьютера LLM?

Для небольших моделей достаточно 32-64 ГБ. Для моделей среднего размера (20-30B) идеально подходит 64-128 ГБ. Для больших моделей, таких как 70B, или моделей MoE, таких как GPT-OSS 120B, идеально подходит 128-192 ГБ оперативной памяти. Чем больше оперативной памяти, тем стабильнее и быстрее все работает. - Можно ли запустить студию искусственного интеллекта полностью без Linux?

Да, но с ограничениями. macOS идеально подходит для LLM, но для искусственного интеллекта в ней не хватает некоторых инструментов, которые есть только в Linux/NVIDIA. Windows хорошо работает для ИИ изображений, но менее стабильна и сложнее поддается автоматизации. Поэтому прагматичное сочетание часто выглядит так: macOS → LLM, Linux → image AI, маленький компьютер → аудио/скрипты. - Насколько громко работает такая студия искусственного интеллекта?

Меньше, чем вы думаете. Mac Studio практически бесшумен. Linux PC зависит от охлаждения - высококачественные GPU не шумят при низкой нагрузке, но могут стать слышны во время тренировок. Если вы предпочитаете бесшумные сборки, можно использовать рабочие станции с водяным охлаждением GPU. - Какую роль играет Mac mini в качестве третьего компонента?

Он служит в качестве вспомогательной станции для транскрипции, TTS, небольших AI-моделей, фоновых процессов, автоматизации и вторичных заданий для переводов. Это позволяет освободить две большие машины и обеспечить стабильность рабочих процессов. Третий компьютер не является абсолютно необходимым, но он создает порядок и надежность. - Могу ли я постепенно расширять свою студию искусственного интеллекта?

Безусловно. На самом деле, это идеальный вариант. Покупка системы LLM, затем добавление рабочей станции с GPU, а затем небольшого дополнительного компьютера - это очень естественная установка, которую можно растянуть на месяцы или годы. ИИ-студии растут так же, как и традиционные мастерские. - Какие операционные системы лучше всего подходят для студии искусственного интеллекта?

- macOS → оптимально для моделей LLM и Apple-Silicon

- Linux (Ubuntu, Debian) → лучший выбор для AI изображений, ComfyUI, Stable Diffusion

- Windows → хорошо работает для SD/ComfyUI, но менее идеально подходит для процессов автоматизации

Многие студии сегодня используют комбинированные установки - каждая система делает то, для чего она лучше всего подходит. - Сколько энергии потребляет студия искусственного интеллекта?

Mac Studio обладает потрясающей эффективностью и обычно потребляет 50-100 Вт. Рабочая станция на GPU с RTX 3090 может потреблять 250-350 Вт в зависимости от нагрузки. Mac mini - около 10-30 Вт. В общем, гораздо меньше, чем вы ожидаете, и зачастую дешевле, чем облачные подписки. - Сложно ли самостоятельно создать студию искусственного интеллекта?

Не совсем. Вам необходимо некоторое техническое понимание, но не степень в области компьютерных наук. Многие инструменты сегодня имеют веб-интерфейсы, сценарии установки и автоматические конфигурации. И если четко разделить системы (LLM / GPU / побочная работа), все останется понятным. - Можно ли с его помощью охватить весь процесс публикации?

Да, и именно для этого идеально подходит AI-студия. От идеи книги до текста, дизайна обложки, серии изображений, исправлений, переводов и конечного файла для печати или электронной книги - многое можно автоматизировать и производить своими силами. Это огромная свобода для самоиздателей. - Насколько перспективна сегодня студия искусственного интеллекта?

Очень. LLM становятся более эффективными, имиджевые модели - более модульными, аппаратные средства - более долговечными, а локальный ИИ снова приобретает все большее значение на рынке, поскольку облачные законы, защита данных и стоимость делают облака менее привлекательными. Тот, кто инвестирует в небольшую студию ИИ сегодня, создает инфраструктуру, которая станет более важной, а не устаревшей в 2026-2030 годах. - Можно ли в дальнейшем обучать или расширять модели ИИ?

Да, система GPU (например, RTX 3090 или 4090) может быть использована для обучения LoRA, обучения стилю, обучению материалам и процессам. Это означает, что со временем вы сможете обучить свой собственный „визуальный язык ИИ“ или „текстовое направление ИИ“. Это самое большое стратегическое преимущество ИИ-студии: вы становитесь независимыми от типовых моделей и создаете свой собственный стиль.