Atualmente, quem trabalha com IA é quase automaticamente empurrado para a nuvem: OpenAI, Microsoft, Google, quaisquer interfaces Web, tokens, limites, termos e condições. Isto parece moderno - mas é essencialmente um regresso à dependência: outros determinam quais os modelos que podemos utilizar, com que frequência, com que filtros e a que custo. Eu estou deliberadamente a seguir o caminho inverso: estou atualmente a construir o meu próprio estúdio de IA em casa. Com o meu próprio hardware, os meus próprios modelos e os meus próprios fluxos de trabalho.

O meu objetivo é claro: IA local de texto, IA local de imagem, aprender os meus próprios modelos (LoRA, afinação) e tudo isto de forma a que eu, como freelancer e, mais tarde, também como cliente de uma PME, não esteja dependente dos caprichos diários de um qualquer fornecedor de serviços em nuvem. Pode dizer-se que é um regresso a uma velha atitude que costumava ser bastante normal: „As coisas importantes fazem-se sozinhas“. Só que, desta vez, não se trata da sua própria bancada de trabalho, mas do poder de computação e da soberania dos dados.

A velocidade continua a ser imbatível a nível local

Os modelos de nuvem são impressionantes - desde que a linha esteja disponível, os servidores não estejam sobrecarregados e a API não esteja a ser novamente estrangulada. Mas qualquer pessoa que trabalhe seriamente com IA apercebe-se rapidamente de que a forma mais honesta de velocidade é a local. Se um modelo funciona no seu próprio Mac Studio ou na sua própria GPU, então é verdade:

- Sem latência de rede

- Sem tempo de espera até que „os outros“ estejam prontos

- Não há cancelamentos por hora

- Sem „Limite de taxa atingido“ no meio do fluxo de trabalho

É o que acontece todos os dias: na minha Estúdio Mac funciona com um modelo de 120B (GPT-OSS) e um modelo Gemma de 27B em paralelo - mais um servidor FileMaker e todas as minhas bases de dados. No entanto, o sistema continua a ser tão reativo que consigo trabalhar a uma velocidade que é quase impossível de alcançar com os sistemas de nuvem. Especialmente quando se fazem muitas pequenas operações seguidas - traduções, reformulações, análises, pedidos de imagens - os atrasos acumulam-se rapidamente. A IA local não parece uma „operação de servidor“, mas sim uma ferramenta direta: carrega-se e acontece.

Soberania dos dados: quando as informações sensíveis não pertencem à Internet

Um ponto que é frequentemente ignorado, mas que é crucial para os empresários: os dados. Assim que se utiliza a IA na nuvem, é inevitável que se coloquem questões:

- Posso introduzir aí os dados dos clientes?

- O que acontece aos documentos internos?

- Durante quanto tempo são conservados os registos?

- Quem é que, teoricamente, tem acesso - hoje e daqui a dois anos?

- Que consequências jurídicas teria uma fuga de informação?

É claro que os grandes fornecedores têm promessas de proteção de dados. Mas, no final do dia, está a entregar o seu conteúdo. E era exatamente isso que queria evitar na sua própria empresa no passado: As coisas internas permanecem internas. Num estúdio local de IA, a situação é diferente:

- Os dados permanecem na sua própria rede.

- Nenhum pedido sai de casa.

- Os modelos funcionam sem acesso à Internet.

- Os registos, os dados de treino e os resultados intermédios são armazenados nos seus próprios discos.

Quando, no futuro, passar os meus livros, artigos, notas, textos de relações públicas, documentos de estratégia interna ou dados de clientes pela minha IA, quero ter a certeza de que nada disso acaba no conjunto de treino de outra pessoa. Só posso ter esta confiança se a infraestrutura me pertencer.

Controlo dos custos em vez de assinaturas em alta

As IAs na nuvem parecem baratas à primeira vista: alguns cêntimos por 1.000 tokens, uma assinatura mensal aqui, uma pequena tarifa ali. O problema é que os custos aumentam com o seu sucesso. Quanto mais produtivo se torna, mais cara se torna a infraestrutura - todos os meses. A IA local funciona de forma diferente:

- Investe-se uma vez em hardware.

- Em seguida, execute os modelos tantas vezes quanto desejar.

- Não há „dedos a tremer“ porque cada chamada custa dinheiro.

- Pode experimentar mais livremente sem ter de calcular cada entrada.

Comprei a minha RTX 3090 em segunda mão por cerca de 750 euros - praticamente como nova. Comprei o meu Mac Studio com 128 GB de RAM por cerca de 2750 euros, na sua embalagem original e nunca aberto. É dinheiro, sim - mas:

- Estas máquinas vão acompanhar-me durante muitos anos.

- Cria activos diretamente utilizáveis: livros, artigos, imagens, LoRAs, fluxos de trabalho.

- Não implicam quaisquer custos mensais adicionais para além da eletricidade.

Para um editor, um consultor, um programador ou uma pequena empresa, esta pode ser a diferença entre „Temos de calcular se podemos pagar“ e „Só utilizaremos a IA quando precisarmos“.

Velhas virtudes, novos benefícios: Porque é que vale a pena voltar a ter as suas próprias máquinas

Antigamente, era um dado adquirido que um artesão tinha boas ferramentas na sua própria oficina. Uma oficina de carpintaria sem uma bancada de trabalho e serras adequadas seria impensável. Atualmente, habituámo-nos ao contrário: em vez de possuirmos as nossas próprias máquinas, contratamos serviços. Um estúdio de IA interno não é, basicamente, mais do que uma versão moderna da oficina clássica:

- O Estúdio Mac é o motor central dos modelos linguísticos.

- O Placa gráfica RTX é a máquina de fresagem para imagens e formação.

- A Computador adicional (por exemplo, Mac mini) assume tarefas especiais, como voz ou modelos pequenos.

- Um software como o FileMaker funciona como um painel de controlo: orquestra, guarda e documenta.

Estou a construir uma instalação deste tipo porque quero ser capaz de fazer tudo sozinho a longo prazo:

- Escrever e traduzir livros,

- Gerar séries de imagens,

- treinar os seus próprios modelos LoRA,

- Automatizar fluxos de trabalho,

- e, mais tarde, oferecer também soluções ao cliente que podem ser executadas totalmente a nível local.

Não se trata de nostalgia, mas de uma decisão sóbria: quanto mais a IA intervém na vida quotidiana, mais sensato é manter o controlo sobre a tecnologia. A IA local não é a „alternativa hobbyista“ à nuvem sofisticada, mas sim um regresso consciente à independência:

- Ganha-se velocidade.

- Mantém os seus dados.

- O utilizador controla os seus custos.

- Constrói-se uma infraestrutura que lhe pertence.

Se pensarmos nisto até ao fim, um estúdio de IA em casa está a tornar-se cada vez mais parecido com uma oficina clássica e bem equipada: Não se depende do que os outros estão a fazer em segundo plano, mas constrói-se a própria base estável.

Inquérito atual sobre sistemas locais de IA

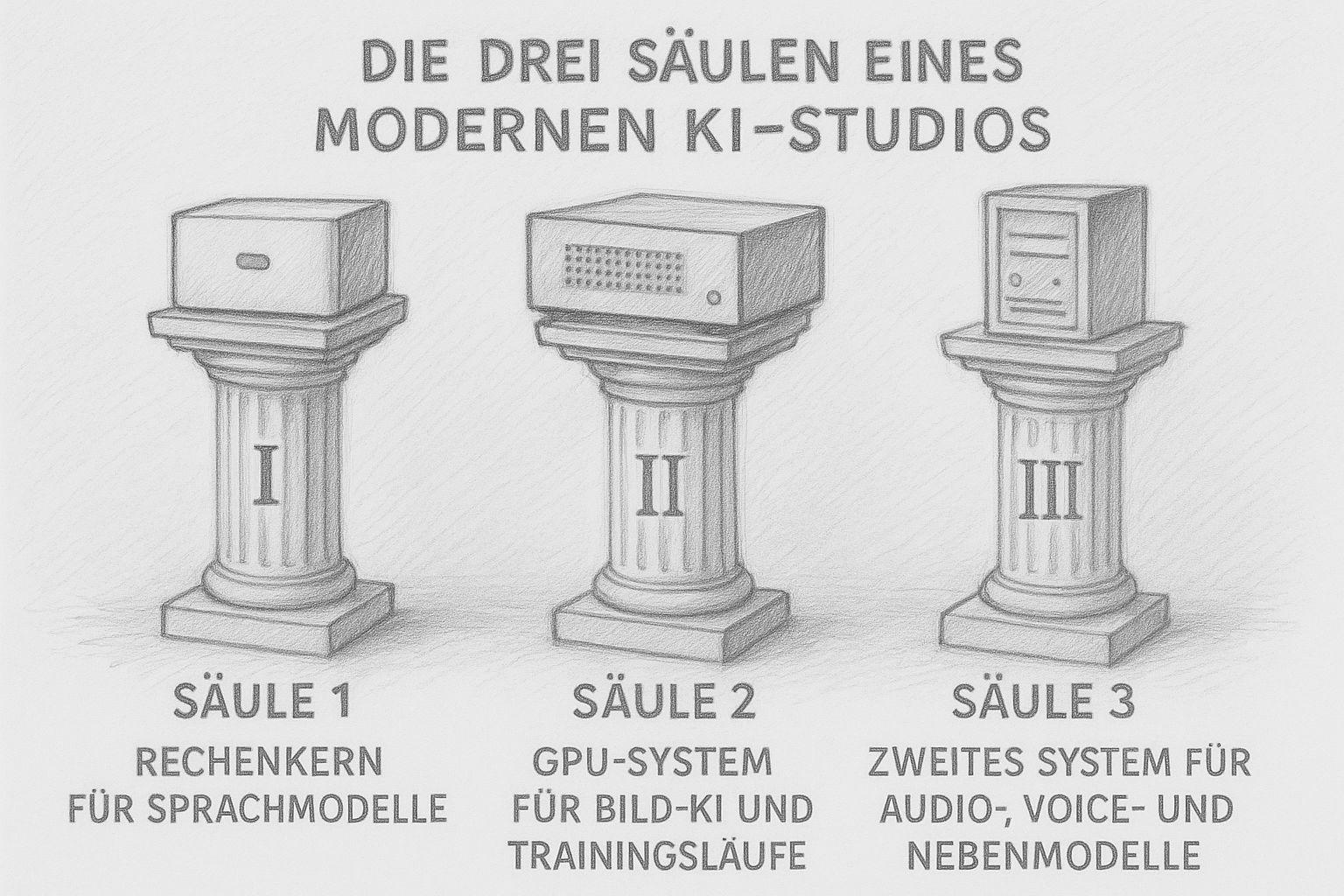

Os três pilares de um estúdio de IA moderno

Atualmente, um estúdio de IA já não é composto por „um grande computador“ que faz tudo. Os fluxos de trabalho modernos precisam de diferentes pontos fortes: capacidade de computação para textos, muita VRAM para imagens e execuções de treino e sistemas mais pequenos que assumem os trabalhos secundários. O resultado não é uma frota caótica de dispositivos, mas uma pequena infraestrutura bem pensada - como uma oficina bem equipada no passado, onde cada máquina cumpre o seu objetivo.

Eu próprio construo o meu estúdio exatamente de acordo com este princípio. E quanto mais me aprofundo neste assunto, mais claro se torna: Três pilares são suficientes para gerir localmente uma produção completa de IA.

Pilar 1: O núcleo de cálculo dos modelos de linguagem (LLM)

Atualmente, os modelos linguísticos de grande dimensão já não necessitam de um servidor de centro de dados, mas sim de uma coisa acima de tudo: uma grande quantidade de RAM muito rápida. É exatamente isso que os modernos sistemas Apple-Silicon ou máquinas Linux equipadas de forma semelhante com muita RAM podem fazer. O núcleo de computação é a peça central do estúdio. É aqui que ele funciona:

- Grandes LLMs (20B, 30B, 70B, 120B MoE ...)

- Modelos de análise

- Modelos de tradução

- Interno Sistemas de conhecimento (neo4j, RAG)

- também a longo prazo Memória com suporte de IA

- Sistemas de controlo como o n8n

- FileMaker-Automatização e processos de servidor

Na minha configuração, o Mac Studio M1 Ultra com 128 GB de RAM assume esse papel. E fá-lo incrivelmente bem. Eu corro nele:

- GPT-OSS 120B MoE (para reflexão profunda, textos longos e análises)

- Gemma-3 27B (para trabalhos técnicos como FileMaker, código, estruturação precisa)

- Servidor FileMaker + bases de dados

- além de toda a infraestrutura de servidores web e shell

O mais incrível é que, mesmo com dois modelos grandes em simultâneo, 10-15 GB de RAM permanecem livres. Esta é a vantagem de uma arquitetura totalmente concebida para a memória unificada. Em poucas palavras: o núcleo de computação é o cérebro do estúdio de IA. Tudo o que compreende, gera ou transforma texto acontece aqui.

Pilar 2: O sistema GPU para IA de imagens e execuções de treino

O segundo pilar é uma estação de trabalho GPU, optimizada para a formação Stable Diffusion, ComfyUI, ControlNet e LoRA. Enquanto os modelos de texto requerem principalmente RAM, a IA de imagem precisa de VRAM. E muito. Porquê? Porque os modelos de imagem carregam quantidades gigantescas de dados na memória por fotograma. E é para isso que as placas gráficas foram concebidas. No meu estúdio, isto é feito por uma NVIDIA RTX 3090 com 24 GB de VRAM - e estes 24 GB valem o seu peso em ouro. Eles permitem:

- SDXL com tamanho de lote razoável

- Fluxos de trabalho ComfyUI

- Síntese de vídeo

- Série de imagens

- Formação em materiais e estilos

- Formação LoRA com 896×896 ou mesmo 1024×1024

Para a IA de imagem, a VRAM é mais importante do que o chip mais recente. Um sólido 3090 pode fazer mais hoje do que as caras placas de gama média de 2025. A coluna GPU é, portanto, o „equipamento pesado“ no estúdio - a fresadora que corta tudo o que significa carga de computação. Sem ela, a produção séria de imagens dificilmente é possível.

Pilar 3: Um segundo sistema para áudio, voz e modelos secundários

O terceiro pilar pode parecer discreto, mas é crucial: um sistema mais pequeno e eficiente em termos energéticos que assume tarefas secundárias. Estes incluem:

- TTS (Texto para voz)

- STT (transcrição)

- modelos mais pequenos (4B, 7B, 8B, 14B)

- estático Processos de fundo

- pequeno Sistemas de agentes

- Ferramentas, que se pretende utilizar separadamente do sistema principal

Utilizo um pequeno Mac mini M4 com 32 GB de RAM. Perfeitamente adequado para:

- Sussurro-Transcrição

- Voz-modelos

- luz Modelos de otimização

- reação rápida Assistentes

- Experiências e Testes de funcionamento

- paralelo Modelo de contentor

Isto alivia enormemente o sistema principal. Afinal de contas, faz sentido não carregar modelos grandes para cada trabalho pequeno. Tal como antigamente não se usava a serra circular grande para cada corte na oficina, mas sim uma máquina pequena. O terceiro pilar assegura a organização e a estabilidade.

Separa os grandes modelos das pequenas tarefas - o que torna todo o estúdio durável, flexível e à prova de falhas.

Distribuição inteligente de cargas de trabalho

Um estúdio de IA prospera com o facto de cada máquina fazer aquilo para que foi construída. Isto resulta numa ordem lógica:

- Núcleo de cálculo → Pensar, escrever, traduzir, analisar

- Sistema GPU → Imagens, modelos de treino, ComfyUI, vídeo

- Subsistema → Áudio, voz, pequenos modelos, agentes

Quando se adiciona software adicional - como o FileMaker como o meu sistema de controlo central - é criado um verdadeiro canal de produção. Não há mais caos, não há mais „vamos ver onde ainda há espaço“, mas um sistema organizado que funciona de forma estável todos os dias.

Os três pilares são a base - não o estilo livre

Muitas pessoas pensam que só é necessário um estúdio de IA quando se é uma „empresa de IA“. Na realidade, o oposto é verdadeiro: um estúdio de IA sólido É a base para se tornar uma empresa. Com estes três pilares, tem tudo o que precisa para:

- Produzir conteúdos (texto e imagem)

- Ensinar os seus próprios modelos

- Automatizar fluxos de trabalho

- Trabalhar de forma independente da nuvem

- desenvolver soluções próprias para os clientes

- operar „bancadas de trabalho“ digitais a longo prazo

Para empresários, criadores, editores independentes e programadores, esta é agora uma decisão estratégica que garante liberdade, rapidez e controlo a longo prazo.

Hardware de nível de entrada sensato para um pequeno estúdio de IA

Quem vê os anúncios hoje em dia, pode pensar que tem de estar sempre a comprar o hardware mais recente para poder trabalhar com IA localmente. Mas o que acontece frequentemente é o contrário: não são os modelos mais recentes que são decisivos, mas sim a combinação correta de RAM, VRAM e estabilidade. Muitos dispositivos mais antigos - especialmente no sector das GPU - são agora verdadeiros monstros em termos de preço e desempenho. E se estivermos preparados para pensar fora da caixa, podemos construir um estúdio de IA que faça justiça a uma pequena empresa sem nos excedermos financeiramente. É exatamente isso que estou a fazer neste momento, e está a funcionar surpreendentemente bem. Este capítulo mostra-lhe três classes de hardware: Principiante, Standard e Profissional. E, claro, também explico porque é que certos sistemas mais antigos são mais valiosos hoje em dia do que possa pensar.

1ª classe de entrada (1500-2500 €)

Para quem quer começar a trabalhar localmente - sem grandes investimentos. Esta aula é sobre como dar os primeiros passos sólidos:

- Mac mini M2 ou M4 com 16-32 GB de RAM

- ou um PC com RTX 3060/3070 (12-16 GB VRAM)

- e, opcionalmente, um pequeno NAS ou externo SSD

Esta é uma boa maneira de o fazer:

- Funcionamento dos modelos 7B a 14B

- Efetuar traduções locais

- Correr Sussurro

- Utilizar modelos de imagem mais pequenos, como SD 1.5/2.1

- Experimente a ComfyUI em formato reduzido

- Teste os seus próprios agentes ou fluxos de trabalho

Para muitas pessoas criativas ou que trabalham por conta própria, isto é mais do que suficiente para se tornarem produtivas. O importante é não complicar demasiado o início da atividade. O maior perigo não é ter pouca potência, mas sim ficar atolado em demasiados pormenores técnicos. Com um Mac mini M4, por exemplo, é possível fazer muitas coisas: Traduções, pesquisa, estrutura, até modelos de escrita mais pequenos - e com um consumo de energia mínimo.

2ª classe standard (2500-4000 €)

O ponto ideal para um trabalho sério com textos e imagens. É aqui que começa o que eu chamaria um “verdadeiro estúdio de IA“: uma configuração que pode lidar com modelos de texto grandes e modelos de imagens sólidas. Uma combinação típica:

- Estúdio Mac M1 Ultra ou M2 Max com 64 GB de RAM

- Estação de trabalho PC/GPU com RTX 3080, 3090 ou 3090 Ti

- opcionalmente, um pequeno Computador adicional para áudio ou voz

Com esta aula, pode:

- Conduzir modelos 20-40B de forma fiável

- Utilizar Stable Diffusion XL de boa qualidade

- Efetuar a formação LoRA na gama média de conjuntos de dados

- Distribuir cargas de trabalho paralelas em vários dispositivos

- Configurar automatismos (por exemplo, através do FileMaker)

E isto revela uma verdade interessante: GPUs mais antigas, como a RTX 3090, continuam a esmagar muitas das novas placas de gama média. Porquê? Porque têm mais VRAM (24 GB), ao passo que as novas placas foram muitas vezes neutralizadas. Têm uma interface de memória alargada, ideal para modelos de grande difusão. Têm controladores CUDA maduros e estáveis. São frequentemente vendidas usadas a preços incríveis. Uma 3090 pode fazer mais por 700-900 euros usada do que uma 4070 ou 4070 Ti atual por 1100 euros - simplesmente porque a VRAM e a conetividade da memória são mais importantes do que alguns por cento do desempenho bruto.

3ª classe profissional (4000-8000 €)

Para todos aqueles que levam a produção a sério - e procuram uma independência total. O verdadeiro poder de produção está disponível nesta classe. Configuração típica:

- Estúdio Mac M1 / M2 / M3 Ultra com 128 GB de RAM ou mais

- Sistema PC-GPU com RTX 3090 ou 4090

- a segundo computador para áudio/agentes

- Servidor FileMaker opcional como centro de automação

Isto permite-lhe:

- Utilizar os modelos 70B com fluidez

- Funcionamento estável de modelos MoE como o GPT-OSS 120B

- Coordenar agentes de IA paralelos

- SDXL, vídeo AI, ComfyUI a funcionar em pleno

- Executar formações LoRA com 896×896 ou 1024×1024

- Preparar as suas próprias bases de dados para a formação

- Mapear condutas completas (prompts → imagens → PDFs → livros)

E é aqui que se pode ver o mais interessante: o melhor hardware de IA em 2025 é frequentemente utilizado hardware de topo de 2020-2022. Porquê? Porque foi desenvolvido para cargas de trabalho topo de gama na altura. É uma fração do preço atual. A tecnologia está madura. Não há problemas de driver beta. Tem exatamente as caraterísticas de que a IA necessita: muita VRAM, barramentos de memória largos, núcleos tensoriais estáveis.

Porque é que falha com pouca VRAM - e não com pouca potência de GPU

Este é um aspeto que muitas pessoas subestimam: A VRAM é o fator decisivo para a IA da imagem, não o desempenho puro. Exemplos:

- Um RTX 4060 (8 GB VRAM) é praticamente inutilizável para SDXL.

- Um RTX 4070 Ti (12 GB VRAM) só é suficiente para o treino de forma pouco fiável.

- Um RTX 3090 (24 GB VRAM), por outro lado, funciona sem problemas durante anos.

Resumindo: os modelos grandes precisam de memória - não de marketing. E a memória é o que os cartões topo de gama mais antigos têm e os novos cartões de gama média não têm.

Como expandir modularmente um estúdio de IA

A maior vantagem de um estúdio de três pilares é a sua modularidade:

- A estação de trabalho GPU pode ser actualizada de forma independente.

- Pode manter o Mac Studio durante anos.

- Pode trocar o computador escravo sem perturbar o sistema.

- Pode expandir os discos rígidos ou SSDs separadamente.

- Pode utilizar FileMaker, Python ou Bash como orquestração.

É como uma oficina: Não se reconstrói tudo ao mesmo tempo, mas apenas o que é necessário na altura.

A IA local é agora REALMENTE utilizável (e funciona neste hardware) c't 3003

Recomendações para 2025 - Este hardware vale realmente a pena

É fácil perder o rasto na selva de anúncios e especificações. Mas para a utilização de IA em casa ou num pequeno estúdio, existem classes de hardware que serão particularmente úteis em 2025 - porque oferecem uma boa relação preço-desempenho, são robustas e são suficientes para os modelos actuais. O que importa atualmente:

- VRAM suficiente (para tarefas de GPU)Para a IA de imagens, treinos, difusão estável, etc., uma placa gráfica deve ter pelo menos 16 GB, de preferência 24 GB de VRAM. Acima deste limite, a IA de imagens torna-se confortável e estável.

- Boa memória de trabalho e capacidade de RAM (para LLMs): Para grandes LLMs, multitarefas com serviços de servidor e processos paralelos, faz sentido ter o máximo de RAM possível - idealmente 64-128 GB para Apple-Silicon.

- Hardware estável e comprovado em vez dos mais recentes produtos de marketingAs placas topo de gama mais antigas, em particular, têm frequentemente excelentes especificações (VRAM, barramento de memória, maturidade dos controladores) a um preço moderado.

- Modularidade e mistura em vez de monoblocoA combinação de computador LLM, estação de trabalho GPU e sistema secundário/agente é mais flexível e duradoura do que uma única máquina „tudo em um“.

| Classe | Componentes típicos | Adequado para quem | Pontos fortes / Compromissos |

|---|---|---|---|

| Nível de entrada (aprox. 1.500-2.500 euros) | Mac mini (16-32 GB de RAM) ou PC com GPU (por exemplo, RTX 3060 / 3060 Ti / 4060 Ti com ≥ 12-16 GB de VRAM) | Passatempo, primeiras experiências, modelos pequenos, imagem AI manejável | Nível de entrada favorável, suficiente para LLMs mais pequenos, fluxos de trabalho de difusão estáveis e ligeiros e IA de áudio/texto. Limitações com modelos grandes, pipelines ComfyUI complexos e formação LoRA. |

| Normal (aprox. 2 500-4 000 euros) | Estação de trabalho com GPU de gama média (por exemplo, com RTX 3080 ou RTX 3090), computador com 64 GB de RAM | Criativos, auto-editores, utilizadores ambiciosos de IA, pequenas equipas | Desempenho sólido para texto e imagens, boa relação preço-desempenho. VRAM e RAM suficientes para uma utilização versátil da IA, incluindo SDXL e formação inicial LoRA. Com projectos extremos ou muitos fluxos de trabalho paralelos, o sistema atinge os seus limites a dada altura. |

| Profissional / Estúdio (aprox. 4.000-8.000 €) | Sistema de RAM elevada (por exemplo, Mac Studio com 128 GB de RAM ou estação de trabalho Linux potente) + GPU com ≥ 24 GB de VRAM (por exemplo, RTX 3090, 4090) + sistema secundário/agente separado | Freelancers, editores, produções multimédia, programadores com vários projectos, pequenos estúdios de IA | Máxima flexibilidade, modelos de grandes dimensões (70B, MoE), IA de imagem e texto em paralelo, automatização e fluxos de trabalho de longa duração. Muito preparado para o futuro, mas com um investimento inicial mais elevado e um pouco mais de esforço de planeamento durante a instalação. |

Porque é que as GPUs topo de gama usadas e mais antigas são frequentemente melhores do que as novas placas de gama média actuais

Muitas placas mais recentes são oferecidas com VRAM limitada - mas isso é crucial para a IA. Os modelos topo de gama mais antigos, como a RTX 3090, oferecem frequentemente 24 GB de VRAM, o que é muito valioso atualmente para SDXL, formação LoRA ou IA de vídeo. O hardware foi originalmente concebido para desempenho e estabilidade - com componentes de alta qualidade, barramento de memória, arrefecimento e bom suporte de controladores.

Isto significa: durabilidade e desempenho robusto estão frequentemente disponíveis. Os cartões usados são muitas vezes significativamente mais baratos e, por conseguinte, muito acessíveis - ideais para freelancers ou pequenos estúdios com um orçamento limitado.

A minha recomendação atual para 2025 (e porquê)

Se eu estivesse a construir um estúdio hoje e não tivesse como objetivo a potência máxima de um supercomputador, decidiria:

- Para IA de imagemPelo menos uma GPU com 24 GB de VRAM - por exemplo, RTX 3090 ou 4090.

- Para texto/LLM128 GB de RAM num potente sistema Apple-Silicon.

- Para empregos a tempo parcial (áudio, voz, modelos pequenos, automatização): um computador pequeno e separado (por exemplo, um mini PC ou um servidor barato).

- Para a coordenaçãouma camada de software - para mim é o FileMaker, para outros pode ser uma simples shell ou um pipeline Python.

Esta configuração não é excessiva, não depende de licenças de nuvem dispendiosas - e é suficiente para quase tudo o que pode ser feito com IA no sector criativo, editorial ou de desenvolvimento em 2025.

O hardware para a IA não tem de ser novo, mas sim adequado

Atualmente, o tempo em que a „IA“ era apenas algo para as grandes empresas ou para os laboratórios de computação em nuvem está a chegar ao fim. Em 2025, quase qualquer pessoa - com um orçamento razoável e alguns conhecimentos técnicos - pode criar o seu próprio pequeno estúdio de IA. Isto torna-o independente das dispendiosas subscrições mensais, das condições de proteção de dados de terceiros, das filas de espera, dos estrangulamentos dos servidores e da incerteza de quanto tempo os serviços de nuvem continuarão a existir. Em vez disso, obtém:

- Controlo total sobre os seus dados e os seus fluxos de trabalho,

- estável, rápido e Desempenho escalável,

- um Investimento sustentável, que dura anos,

- e o Liberdade, para ser criativo quando e como quiser - sem limitações externas.

Por isso, se está a pensar utilizar a IA nos seus livros, textos, imagens ou projectos, vale mais do que nunca a pena montar o seu próprio estúdio. Não precisa de ser um engenheiro de hardware. Não precisa de um grande orçamento. Não precisa de ter o hardware mais recente.

Acima de tudo, é preciso ter uma ideia clara do objetivo para o qual se está a trabalhar - e a vontade de manter o controlo sobre os seus próprios processos.

Vou mostrar-lhe como configurar um LLM local com Ollama num Mac installier em este artigo.

Aqui encontrará uma comparação de Apple MLX em Silicon vs. NVIDIA.

Como trabalhar com Qdrant uma memória local para a sua IA local pode ser encontrado aqui.

Perguntas mais frequentes

- Porque é que vale a pena ter o seu próprio estúdio de IA quando existem tantos fornecedores de serviços na nuvem?

Ter o seu próprio estúdio de IA torna-o mais independente, mais estável e mais barato a longo prazo. Os serviços na nuvem são cómodos, mas custam dinheiro todos os meses, criam dependência e são frequentemente limitados por restrições de utilização. A IA local é rápida, está permanentemente disponível e pode ser utilizada sem custos variáveis. Além disso, todos os dados permanecem na empresa - uma enorme vantagem para os trabalhadores independentes, empresas, editoras ou profissões criativas. - De que hardware mínimo necessito para começar a utilizar a IA localmente?

Para começar, é suficiente um Mac mini com 16-32 GB de RAM ou um PC com uma GPU com pelo menos 12 GB de VRAM. Isto permite-lhe executar pequenos modelos de linguagem, modelos de imagem ligeiros e automatizações iniciais. Se quiser apenas experimentar, não precisa de investir vários milhares de euros. - Preciso mesmo de um Mac Studio ou é mais barato?

É definitivamente mais barato. Um Mac Studio vale a pena se pretender executar modelos de linguagem grandes (20-120B), trabalhar muito em paralelo ou ter processos de produção a longo prazo. Para os primeiros passos, um Mac mini ou um PC Windows sólido é perfeitamente adequado. Um estúdio é um investimento na conveniência e no futuro - mas não é obrigatório. - Porque é que a VRAM é mais importante para a IA de imagem do que uma geração de placas gráficas modernas?

Porque os modelos de imagem, como a Difusão Estável, enviam enormes quantidades de dados para a memória. Se a VRAM não for suficiente, o processo pára ou torna-se extremamente lento. Uma placa mais antiga, como a RTX 3090, com 24 GB de VRAM, supera muitas vezes os novos modelos de gama média com apenas 8-12 GB de VRAM - simplesmente porque oferece mais espaço para modelos grandes e execuções de treino. - Posso executar um estúdio de IA completamente com hardware Apple sem NVIDIA?

Para modelos de linguagem, sim. Para IA de imagem, não. Apple-Silicon é extremamente eficiente para LLMs, mas para difusão estável, treinamento LoRA e muitos modelos de imagem, as placas NVIDIA (devido aos núcleos CUDA/Tensor) ainda são a referência. Por conseguinte, muitos estúdios utilizam uma mistura de Apple/LLM e Linux+NVIDIA para imagens. - Uma RTX 4080 ou 4070 Ti também é suficiente para IA de imagem?

Teoricamente sim - na prática, depende da utilização pretendida. Para imagens simples ou pequenos fluxos de trabalho, isso é suficiente. Mas para SDXL, pipelines ComfyUI complexos ou formação LoRA, o limite de 12-16 GB de VRAM atinge rapidamente os seus limites. Uma RTX 3090 ou 4090, portanto, faz mais sentido a longo prazo. - Porque é que os modelos de linguagem não são executados na GPU, mas sim na RAM?

Os modelos linguísticos são orientados para a memória. Precisam de guardar grandes quantidades de texto e contexto na RAM e não necessariamente de efetuar operações gráficas. As GPUs foram criadas para o processamento de imagens, não para a análise de texto. É por isso que os sistemas LLM beneficiam enormemente de uma grande quantidade de RAM, mas menos de VRAM. - Que quantidade de RAM deve ter um computador LLM?

Para modelos mais pequenos, 32-64 GB é suficiente. Para modelos médios (20-30B), 64-128 GB é o ideal. Para modelos grandes, como 70B ou modelos MoE, como GPT-OSS 120B, 128-192 GB de RAM é o ideal. Quanto mais memória RAM, mais estável e rápido é o funcionamento. - É possível gerir um estúdio de IA completamente sem Linux?

Sim - mas com limitações. O macOS é perfeito para LLMs, mas para IA de imagens faltam-lhe algumas ferramentas que só existem no Linux/NVIDIA. O Windows funciona bem para a IA de imagens, mas é menos estável e mais difícil de automatizar. A combinação pragmática é, portanto, frequentemente: macOS → LLM, Linux → IA de imagem, computador pequeno → áudio/scripts - Qual é o ruído de um estúdio de IA como este em funcionamento?

Menos do que se possa pensar. Um Mac Studio é praticamente silencioso. Um PC Linux depende do arrefecimento - as GPUs de alta qualidade são silenciosas com pouca carga, mas podem tornar-se audíveis durante os treinos. Se preferir construções silenciosas, pode utilizar estações de trabalho com GPUs arrefecidas a água. - Que papel desempenha o Mac mini como terceiro componente?

Serve como estação secundária para transcrição, TTS, pequenos modelos de IA, processos de fundo, automatização e trabalhos secundários para traduções. Isto mantém as duas máquinas grandes livres e garante fluxos de trabalho estáveis. Um terceiro computador não é absolutamente necessário, mas cria ordem e fiabilidade. - Posso expandir gradualmente o meu estúdio de IA?

Sem dúvida. De facto, esse é o caso ideal. Comprar um sistema LLM, depois adicionar uma estação de trabalho GPU e, mais tarde, um pequeno computador secundário - esta é uma configuração muito natural que pode ser alargada ao longo de meses ou anos. Os estúdios de IA crescem tal como as oficinas tradicionais. - Que sistemas operativos são mais adequados para um estúdio de IA?

- macOS → ótimo para os modelos LLM e Apple-Silicon

- Linux (Ubuntu, Debian) → melhor escolha para IA de imagem, ComfyUI, Stable Diffusion

- Windows → funciona bem para SD/ComfyUI, mas é menos ideal para processos de automatização

Atualmente, muitos estúdios utilizam configurações combinadas - cada sistema faz aquilo para que é mais adequado. - Quanta energia consome um estúdio de IA?

Um Mac Studio é incrivelmente eficiente e tem normalmente entre 50-100 W. Uma estação de trabalho com GPU RTX 3090 pode consumir 250-350 W, dependendo da carga. Um Mac mini tem cerca de 10-30 W. Em suma, muito menos do que seria de esperar - e muitas vezes mais barato do que as subscrições na nuvem. - É difícil criar um estúdio de IA sozinho?

Não é bem assim. É necessário algum conhecimento técnico, mas não uma licenciatura em informática. Atualmente, muitas ferramentas têm interfaces Web, scripts de instalação e configurações automáticas. E se separar claramente os sistemas (LLM / GPU / trabalhos paralelos), tudo fica claro. - Posso realmente cobrir processos de publicação completos com ele?

Sim - e é exatamente para isso que um estúdio de IA é ideal. Desde ideias para livros a textos, desenhos de capas, séries de imagens, correcções, traduções e o ficheiro final para impressão ou e-book, muitas coisas podem ser automatizadas e produzidas internamente. Esta é uma enorme liberdade para os auto-editores. - Até que ponto um estúdio de IA está preparado para o futuro?

Muito. Os LLM estão a tornar-se mais eficientes, os modelos de imagem mais modulares, o hardware mais duradouro - e a IA local está a tornar-se novamente mais importante no mercado, porque as leis da nuvem, a proteção de dados e os custos estão a tornar a nuvem menos atractiva. Quem investir hoje num pequeno estúdio de IA está a construir uma infraestrutura que se tornará mais importante do que obsoleta em 2026-2030. - Os modelos de IA podem ser treinados ou expandidos posteriormente?

Sim, um sistema GPU (por exemplo, RTX 3090 ou 4090) pode ser utilizado para treino de LoRA, treino de estilo, treino de material e treino de processo. Isto significa que pode treinar a sua própria „linguagem visual de IA“ ou „direção de texto de IA“ ao longo do tempo. Esta é a maior vantagem estratégica de um estúdio de IA: torna-se independente de modelos genéricos e cria o seu próprio estilo.