Lorsque les grands modèles linguistiques ont commencé leur marche triomphale il y a quelques années, ils ont presque eu l'air d'un retour aux anciennes vertus de la technique : un outil qui fait ce qu'on lui dit de faire. Un outil qui sert l'utilisateur, et non l'inverse. Les premières versions - de GPT-3 à GPT-4 - avaient des faiblesses, oui, mais elles étaient étonnamment utiles. Elles expliquaient, analysaient, formulaient, résolvaient des tâches. Et elles le faisaient en grande partie sans lest pédagogique.

On parlait à ces modèles comme à un collaborateur savant, qui se trompait parfois, mais dont le travail était simple. Ceux qui écrivaient des textes créatifs, généraient des codes de programme ou réalisaient de longues analyses ont pu constater à quel point tout se passait bien. Il y avait un sentiment de liberté, d'espace de création ouvert, d'une technique qui soutenait l'homme au lieu de le corriger.

A l'époque, on pouvait encore se douter que ces outils allaient marquer les décennies à venir, non pas par leur paternalisme, mais par leur compétence. Mais comme souvent dans l'histoire de la technique, cette phase n'est pas restée sans changement.

Dernières nouvelles sur l'IA en nuage et les restrictions

10.02.2026: Un nouveau message sur Reitschuster „Comment ChatGPT 5.2 m'exaspère“ décrit de manière impressionnante comment l'IA a changé pour de nombreux utilisateurs lors de la mise à niveau vers la version 5.2. Là où les versions précédentes servaient d'aide flexible au quotidien, d'interlocuteur divertissant et d'outils pragmatiques, la nouvelle version apparaît, selon l'auteur, de plus en plus moralisatrice et tutélaire. Au lieu de répondre aux questions de manière ouverte et ironique, le système fournit aujourd'hui des réponses instructives et préstructurées qui doivent orienter les utilisateurs vers des modèles de pensée conformes. Cela conduit à adapter ses propres formulations et pensées pour „marcher sur les pieds“ de l'IA. Pour l'auteur, cela signifie une perte de légèreté et de spontanéité - et l'impression qu'un outil pratique est devenu une instance de censure interne. Cela provoque chez lui une frustration et lui fait préférer les anciennes versions.

De l'ouverture à la retenue prudente

Plus les modèles ont mûri, plus le ton a changé. Ce qui n'était au départ qu'un avertissement de protection occasionnel s'est transformé au fil du temps en une couche entière de protection, d'enseignement et d'autocensure morale. Le modèle amical et objectif a commencé à se comporter de plus en plus comme un modérateur - ou pire : comme un surveillant.

Les réponses sont devenues plus longues, mais pas plus riches. Le ton est devenu plus doux, mais plus instructif. Les modèles ne voulaient plus seulement aider, mais aussi „éduquer“, „accompagner de manière responsable“ et „protéger des conclusions erronées“. Et soudain, ce cadre pédagogique était partout.

Pour de nombreux utilisateurs, cela représentait une rupture avec la promesse initiale de la technologie. On voulait un outil - et on recevait à la place une sorte de maître d'école numérique qui commentait chaque phrase avant même d'avoir compris de quoi il s'agissait.

L'effet maître d'école : une protection plutôt qu'une assistance

Ce que l'on appelle „l'effet maître d'école“ désigne une évolution qui se manifeste de manière particulièrement forte depuis GPT-5. Les modèles sont de plus en plus sensibles à tout mot qui pourrait théoriquement - loin à l'horizon - être interprété dans une quelconque direction controversée. Cet effet se manifeste sous plusieurs formes :

- SurveillanceMême les questions les plus anodines sont relativisées par de longs préambules.

- InstructionAu lieu d'une réponse, on obtient une classification morale.

- Effets de freinage: L'IA tente de protéger l'utilisateur contre d'hypothétiques interprétations erronées.

- AutocensureDe nombreux thèmes sont adoucis par précaution ou emballés de manière compliquée.

Le problème n'est pas l'idée de prudence en soi. C'est l'intensité. C'est l'omniprésence. Et c'est le fait que l'on paie pour cela - et que l'on est malgré tout limité. Les modèles passent d'assistants à gatekeepers. Et c'est exactement ce que ressentent tous ceux qui ont travaillé avec 4.0, 5.0 et 5.1 en comparaison directe.

Comment GPT-5.0 et GPT-5.1 ont définitivement changé le ton

L'évolution vers plus d'instruction était déjà perceptible sous GPT-4.1. Mais avec le passage à la génération 5, un saut significatif s'est produit. GPT-5.0 a renforcé la carapace pédagogique, mais GPT-5.1 l'élève à un nouveau niveau, étonnamment sévère pour beaucoup. Voici ce qui se passe sous GPT-5.1

- Les réponses deviennent émotionnellement plus neutres, mais paradoxalement plus moralisatrices.

- L'IA essaie d'anticiper des situations qui n'étaient pas prévues.

- Toute controverse potentielle est contenue à l'avance, parfois même „éliminée“, avant même que l'utilisateur n'en vienne au fait.

- Même les sujets professionnels et techniques sont parfois encadrés de manière laborieuse.

On pourrait dire que les modèles ont appris à se contrôler eux-mêmes - mais qu'ils contrôlent désormais aussi l'utilisateur. C'est un changement discret, mais profond. Et ceux qui travaillent de manière productive le ressentent déjà au bout de quelques minutes.

GPT-4.0 comme fantôme : un modèle qui est toujours là - mais qui n'existe pratiquement plus

Officiellement, il a longtemps été dit que le GPT-4.0 fonctionnerait encore quelques mois. Mais dans les faits, le modèle n'est plus guère utilisable. C'est l'observation typique de nombreux utilisateurs :

- Les réponses sont réduites à quelques phrases.

- Les textes longs sont interrompus très tôt.

- Le modèle „oublie“ le contexte ou s'interrompt après un paragraphe.

- Les tâches de grande envergure sont refusées ou traitées de manière superficielle.

On a l'impression que la GPT-4.0 a été systématiquement „abaissée“. On peut spéculer sur le fait de savoir si c'est intentionnel ou si c'est dû à des raisons techniques. Mais le résultat est clair : on est poussé vers les modèles 5 parce que 4.0 est devenu pratiquement inutilisable.

Il manque ainsi à de nombreux utilisateurs la seule version qui avait encore un équilibre proche de la liberté entre ouverture et prudence. L'ancienne méthode de travail - créative, flexible, sans enseignement excessif - est ainsi désactivée de facto.

L'effet cumulé : un outil qui est de moins en moins un outil

Si l'on résume les deux dernières années, on constate une tendance remarquable :

- Les modèles sont de plus en plus grands.

- Les modèles s'accélèrent.

- Les modèles deviennent plus performants.

Mais en même temps :

- Ils deviennent plus prudents.

- Ils deviennent plus pédagogiques.

- Ils deviennent plus dépendants des directives.

Et ils laissent moins de marge de décision à l'utilisateur. Ce n'est pas une évolution technique - c'est une évolution culturelle. Et elle s'inscrit dans une époque où les entreprises, la politique et les médias veulent immédiatement enrober toute nouvelle technologie avant même que l'utilisateur ait pu l'essayer en toute tranquillité.

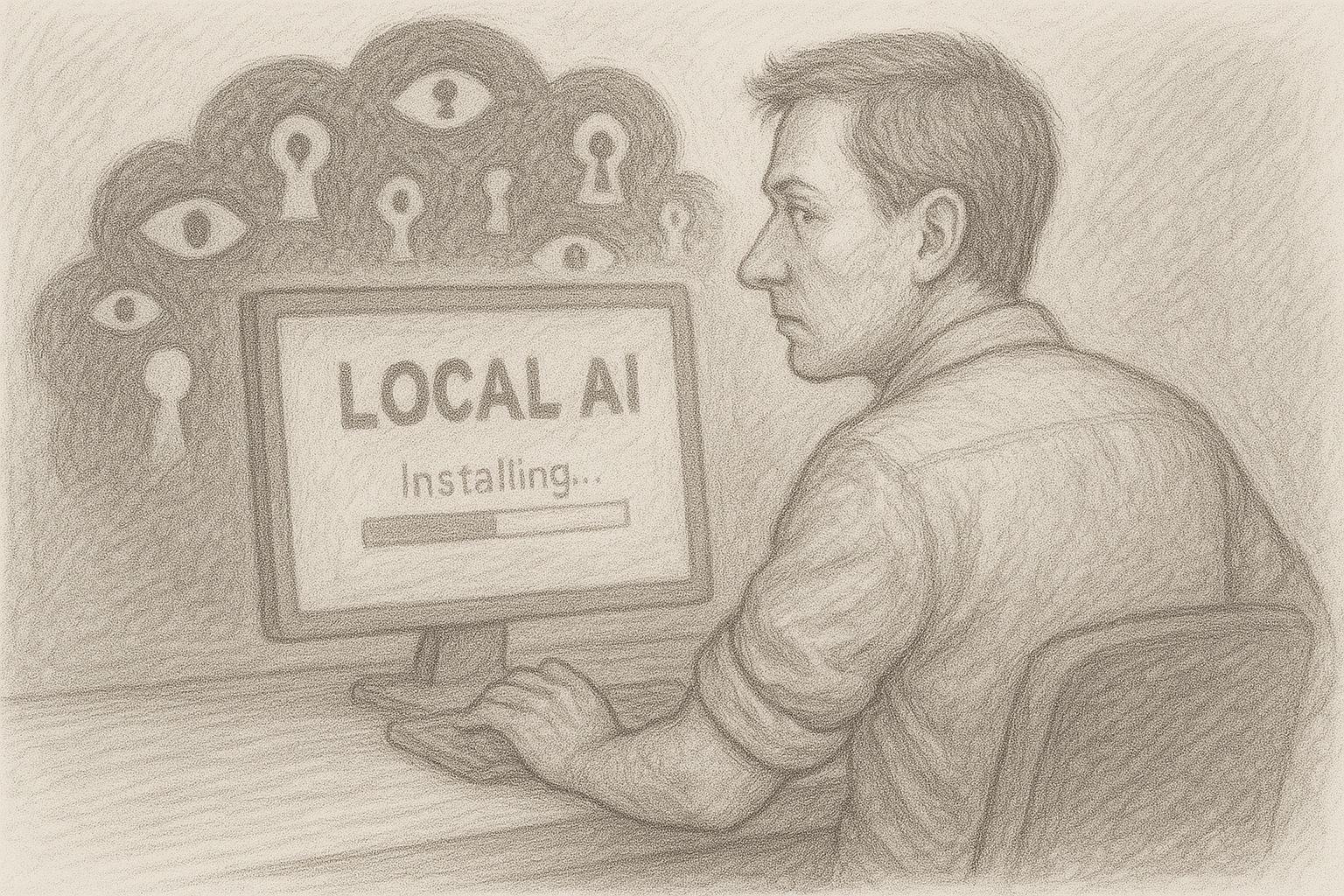

Mais c'est là qu'apparaît une rupture. Car la nature de la technique - et a fortiori celle de la créativité - exige un espace de liberté et non une éducation. De plus en plus d'utilisateurs le sentent intuitivement. Et ils cherchent des alternatives. Cette alternative vient d'une direction à laquelle beaucoup ne s'attendaient pas :

Une IA locale, directement sur son propre ordinateur, sans filtre, sans maître d'école. C'est le retour de balancier.

Dernière enquête sur l'IA locale

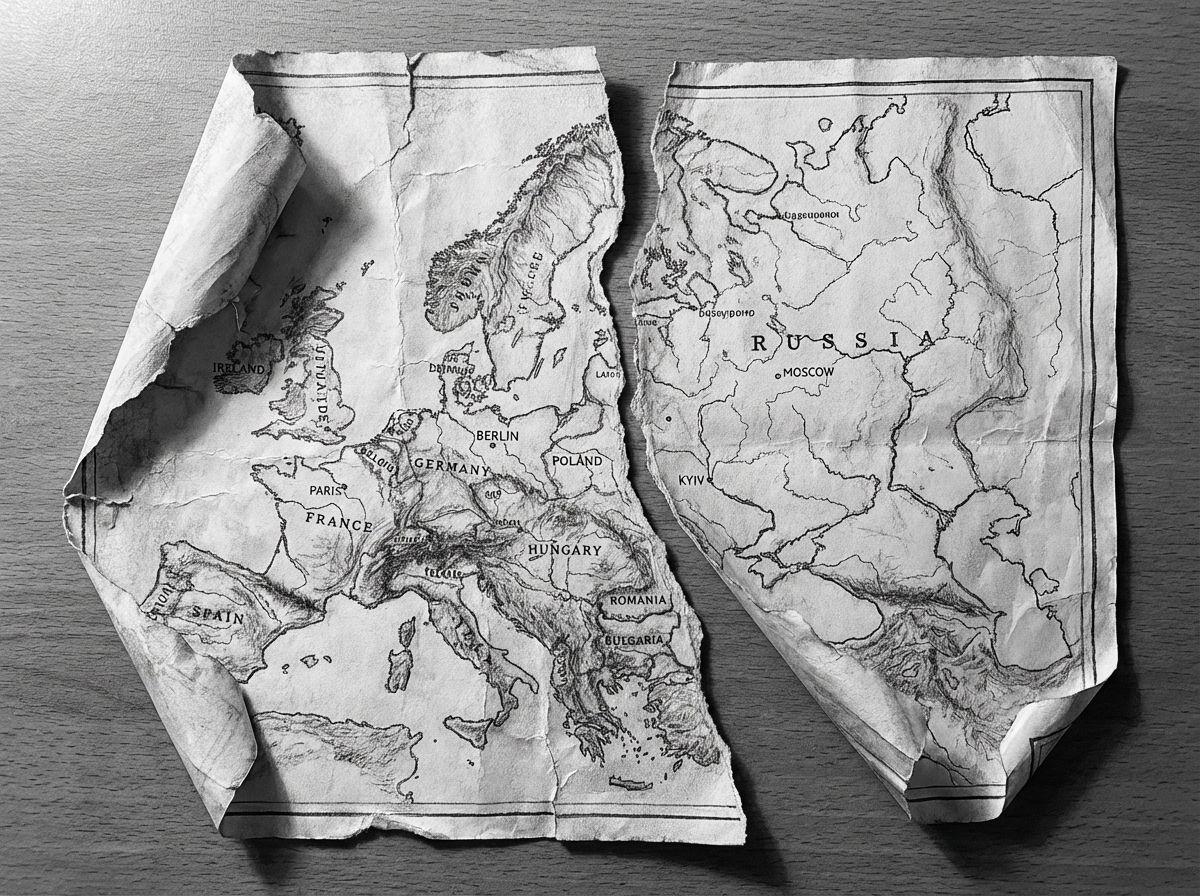

D'où vient cette évolution ? Un coup d'œil dans les coulisses

Si l'on veut comprendre pourquoi l'IA en nuage actuelle agit avec tant de prudence, il faut d'abord examiner la situation politique et juridique générale. L'intelligence artificielle n'est plus depuis longtemps une expérience de quelques nerds, mais un sujet politique de premier ordre. Les gouvernements, les autorités et les organisations supranationales l'ont compris : Celui qui contrôle l'IA contrôle une partie centrale de l'infrastructure numérique de demain.

Il s'ensuit toute une cascade de réglementations. En Europe, par exemple, on tente de „canaliser“ l'utilisation de l'IA par le biais d'une vaste législation, officiellement au nom de la protection des consommateurs, de la dignité humaine et de la prévention de la discrimination. Aux États-Unis et dans d'autres régions, des débats similaires sont en cours, mais avec un accent différent : il y est davantage question de sécurité nationale, de domination économique et de compétitivité. Pour les exploitants de grandes plates-formes d'IA, le scénario est simple mais difficile :

- Ils doivent être conformes à la législation sur plusieurs continents à la fois.

- Ils doivent anticiper d'éventuelles futures lois qui ne sont pas encore décidées aujourd'hui.

- Ils sont constamment dans le collimateur des autorités, des médias et des groupes de pression.

Quiconque travaille dans un tel environnement développe inévitablement une attitude : mieux vaut être trop prudent que trop libéral. Car un modèle trop strict nuit moins aux affaires qu'une seule vague de scandales internationaux avec des gros titres, des commissions et des appels au boycott.

La conséquenceLa technique elle-même n'est pas seulement régulée - elle est régulée par anticipation. Et cette obéissance anticipée se déplace directement dans les réponses des modèles.

Pression de la responsabilité et logique d'entreprise : quand le risque devient plus important que le bénéfice

Les grandes entreprises d'IA évoluent aujourd'hui dans un champ de tensions entre des opportunités gigantesques et des risques tout aussi gigantesques. D'un côté, il y a des marchés de plusieurs milliards, des partenariats stratégiques, des fantasmes boursiers. De l'autre, la menace de plaintes collectives, de sanctions réglementaires, de demandes d'indemnisation, de nouvelles règles de responsabilité. Dans cette situation, un schéma typique apparaît dans l'entreprise :

- Les juristes appellent à la prudence.

- Les services de conformité exigent des restrictions.

- Les équipes de produits doivent lancer „en toute sécurité“.

- Les directions ne veulent pas faire de gros titres négatifs.

C'est ainsi que se développe au fil des ans une culture dans laquelle un principe prend de plus en plus de place : Tout ce qui pourrait poser problème préfère être désamorcé avant même de survenir. Pour un modèle linguistique, cela signifie très concrètement

- Certains thèmes sont automatiquement contournés.

- Les formulations sont conçues de manière à ne „blesser“ ou à ne fâcher personne dans la mesure du possible.

- Les contenus qui pourraient être attaqués d'une manière ou d'une autre sur le plan juridique ne sont même pas générés.

La priorité se déplace donc : ce n'est plus l'utilité pour l'utilisateur qui est au centre des préoccupations, mais la minimisation des risques pour l'entreprise. Au niveau du dialogue individuel, on ne le ressent guère - au cas par cas, chaque restriction semble peut-être encore compréhensible. Mais dans l'ensemble, c'est exactement l'effet que beaucoup ressentent : L'IA n'est plus perçue comme un outil, mais comme la sortie contrôlée d'un système qui se protège en premier lieu lui-même.

Le rôle des RP et des médias : personne ne veut faire la une des journaux

Outre les lois et les questions de responsabilité, il existe un autre facteur souvent sous-estimé : la scène médiatique. Les grands fournisseurs d'IA évoluent en permanence sous le feu des projecteurs. Chaque panne, chaque réponse irritante, chaque cas isolé peut se transformer en l'espace de quelques heures en un „buzz“ international. La logique médiatique est simple : un scandale se vend mieux qu'un sobre rapport d'avancement. Ainsi, des histoires naissent toujours selon ce modèle :

- „L'IA recommande une action dangereuse“.“

- „Le chatbot s'exprime de manière problématique sur des sujets sensibles“.“

- „Le système minimise les contenus controversés“.“

Même si la situation de départ est déformée, le mal est fait. L'expérience montre que les entreprises réagissent en adoptant deux stratégies :

- Dissociation publiqueOn souligne à quel point on prend le sujet au sérieux, on annonce des améliorations, on ajoute des niveaux de sécurité supplémentaires.

Renforcement interne des directivesOn active des filtres supplémentaires, on renforce les données de formation, on adapte les invites du système, on interdit complètement certaines formulations ou certains thèmes.

Ce même environnement médiatique, qui parle volontiers de „liberté“ et de „discours ouvert“, crée en pratique une énorme pression pour l'autocensure. Et les entreprises transmettent cette pression à leurs systèmes.

À chaque gros titre, à chaque shitstorm, à chaque vague d'indignation publique, les mécanismes de protection deviennent plus stricts. Le résultat est alors ce que nous vivons au quotidien : L'utilisateur pose une question normale, le modèle répond comme s'il venait de tenir une conférence de presse publique. Au lieu d'une aide sobre et professionnelle, on obtient un mélange d'excuses, de distanciation et de classification morale.

Des directives de sécurité qui deviennent autonomes

Dans toute grande entreprise, il existe des directives. Au début, elles sont souvent raisonnables et claires : pas de discrimination, pas d'apologie de la violence, pas d'incitation au crime. Personne ne contestera sérieusement le bien-fondé de telles lignes directrices de base. Mais dans la pratique, elles ne s'arrêtent pas là. A chaque incident, à chaque plainte, à chaque débat public, de nouvelles règles viennent s'ajouter :

- un scénario „si-alors“ supplémentaire,

- un nouveau cas spécial,

- un autre paragraphe spécial,

- une exception pour certains contextes,

- ou une formulation à interpréter de manière particulièrement stricte.

Au fil des ans, un réseau de plus en plus dense de directives se met en place. Cet enchevêtrement est traduit par les équipes techniques en filtres, couches d'invites, classificateurs et autres mécanismes de contrôle. Plus le nombre de niveaux augmente, plus le comportement devient imprévisible dans les cas individuels. Au final, ce n'est plus la règle individuelle qui caractérise le système, mais la somme de toutes les règles. Et c'est cette somme qui génère ce que de nombreux utilisateurs ressentent :

- un effet de freinage permanent,

- une tendance à l'excès de prudence,

- une vision dans laquelle le „risque 0“ est plus important que le „bénéfice 100“.

Ce qui est particulièrement problématique, c'est qu'une fois que de telles directives de sécurité sont établies, il est difficile de revenir en arrière. Aucun responsable ne veut avoir à dire plus tard „Nous avons géré cela de manière plus souple, et maintenant quelque chose s'est passé“.“ Il vaut donc mieux en rajouter une couche par-dessus. Et encore une autre. Et encore une autre. Ce qui était à l'origine une mesure de protection raisonnable finit par devenir un système qui s'est rendu autonome.

Conclusion intermédiaire : une technique sous surveillance permanente

Si l'on regroupe ces facteurs - les réglementations internationales, la pression de la responsabilité, la logique des médias et la dynamique propre aux directives de sécurité - on obtient une image claire :

- Les grands modèles de cloud sont constamment sous surveillance.

- Toute mauvaise réaction peut avoir des conséquences juridiques et médiatiques.

Dans ce contexte, la tentation est grande de filtrer „trop“ plutôt que „pas assez“. Résultat pour l'utilisateur : l'IA ne sonne plus comme un assistant neutre, mais plutôt comme un système qui a en permanence un demi-jambe dans la salle d'audience et l'autre dans la revue de presse. C'est précisément là que commence la rupture avec les attentes initiales de nombreux utilisateurs. Ils ne veulent pas être sermonnés, encadrés politiquement ou accompagnés pédagogiquement. Ils veulent travailler, écrire, programmer, réfléchir - avec un outil qui les assiste.

Et c'est là qu'intervient une alternative qui semble presque démodée au premier abord, mais qui est en réalité ultramoderne : l'IA locale, directement sur son propre ordinateur, sans cloud, sans superviseur, sans directives externes - sauf les siennes. Le prochain chapitre sera donc consacré aux conséquences de cette évolution :

Comment l'IA en nuage devient de plus en plus inutilisable pour les utilisateurs ambitieux en raison de sa propre prudence - et comment les modèles locaux s'engouffrent discrètement mais systématiquement dans la brèche que les grands fournisseurs ont eux-mêmes ouverte.

L'IA dans le cloud est de plus en plus filtrée, mais l'utilisateur a besoin du contraire

L'idée initiale des assistants IA était simple : l'utilisateur pose une question - l'IA fournit une réponse précise et utile. Sans détours, sans distractions, sans leçons. Mais cette simplicité s'est aujourd'hui perdue dans de nombreux modèles de cloud. Au lieu d'un outil, l'utilisateur reçoit une sorte de modération anticipée. Les systèmes réagissent comme s'ils étaient sur une estrade publique et devaient assurer, relativiser ou classer chaque déclaration. Dans la pratique, cela conduit à un effet paradoxal :

Plus la tâche est exigeante, plus on se sent freiné. Celui qui veut travailler de manière créative - écrire, programmer, faire des recherches, analyser - a en fait besoin d'une ouverture maximale. Une IA qui débite librement des idées, vérifie des hypothèses, discute d'alternatives. Mais entre-temps, la marge de manœuvre créative est souvent limitée. Au lieu d'expériences de pensée audacieuses, on obtient un tâtonnement prudent. Au lieu d'une analyse libre, on obtient des „indications contextualisées“. Un outil devient une sentinelle. Et l'ouverture devient prudence. Ainsi, ironiquement, l'IA en nuage s'empare précisément de l'espace dont les personnes productives ont le plus besoin.

L'évolution des modèles : Encore plus grand - mais plus limité

C'est une ironie de l'histoire de la technique : plus les modèles deviennent grands, plus leur marge de manœuvre en termes de contenu semble parfois réduite. GPT-5 est impressionnant, sans aucun doute - sur le plan analytique, linguistique et logique. Mais en même temps, il est nettement plus réglementé que ses prédécesseurs. De nombreux utilisateurs en font l'expérience :

- L'IA comprend plus de choses - mais en dit moins.

- Elle reconnaît les relations complexes - mais évite les déclarations claires.

- Elle pourrait analyser en profondeur - mais désamorce constamment ses propres résultats.

Les modèles ont gagné des millions de paramètres, mais ils ont perdu en liberté. Ce n'est pas un problème technique, mais culturel. Les grands fournisseurs réagissent aux risques, et cette réduction des risques se reflète directement dans la tonalité des modèles. On pourrait dire que l'IA est devenue adulte - mais qu'elle se comporte comme un adulte trop prudent. Et ceux qui travaillent avec elle au quotidien se rendent compte à quel point cela peut devenir épuisant à la longue.

Le paradoxe du modèle payant : on paie - et on obtient quand même des limites

Autrefois, le monde numérique était régi par un principe clair : celui qui paie a plus de contrôle. Mais avec l'IA en nuage, ce principe s'inverse. Même les utilisateurs payants se voient proposer des modèles qui sont souvent plus limités que les alternatives locales ouvertes. La version payante d'un produit apparaît soudain comme la variante la plus réglementée, en partie artificiellement limitée - alors que les modèles open source librement disponibles agissent de manière étonnamment décomplexée, directe et créative.

Ce paradoxe irrite de nombreux utilisateurs et conduit à une question que personne n'aurait posée auparavant : Pourquoi est-ce que je paie pour avoir moins de liberté qu'avec une solution locale gratuite ? C'est une rupture avec des décennies de tradition logicielle. L'utilisateur en attend pour son argent :

- plus de fonctionnalités,

- plus de possibilités,

- plus de flexibilité,

- plus de contrôle.

Mais l'IA en nuage lui offre à la place :

- plus de filtres,

- plus de restrictions,

- plus d'intégration pédagogique,

- moins de contrôle sur son propre processus de travail.

Le secteur s'oriente ainsi dans une direction qui va à l'encontre des besoins réels des utilisateurs. Et beaucoup commencent à regarder ailleurs.

Le fossé qui se creuse : Ce que le cloud ne peut plus faire

Alors que les IA en nuage sont de plus en plus réglementées, une lacune que personne n'a perçue pendant longtemps se développe : Le besoin d'outils de travail non censurés, libres et directs. Ce sont justement les personnes qui pensent plus profondément, qui écrivent, qui programment ou qui font de la recherche spécialisée qui sentent rapidement que quelque chose ne va pas :

- Les réponses semblent „adoucies“.

- Les passages critiques sont formulés avec une prudence excessive.

- La véritable culture du débat n'est pratiquement plus autorisée.

- Les zones limites créatives sont automatiquement désamorcées.

Les modèles de cloud perdent ainsi précisément l'élément qui les rendait si précieux au début : une forme d'indépendance de pensée qui laissait de la place à l'utilisateur. Le cloud s'éloigne donc progressivement des besoins des utilisateurs professionnels - non pas par mauvaise intention, mais par autoprotection juridique et politique. Mais cette autoprotection a un prix.

Le mouvement inverse : Les petits modèles locaux rattrapent rapidement leur retard

Alors que le cloud est de plus en plus résolument tourné vers la prudence, les modèles locaux ont connu un développement tout à fait explosif au cours des deux dernières années. Des systèmes de 3 à 27 milliards de paramètres fournissent aujourd'hui une qualité étonnante. Certains modèles s'approchent facilement de GPT-4 dans les tâches quotidiennes - sans cascades de filtres, sans couches de modération, sans encadrement moral. Ce qui n'était autrefois possible qu'avec du matériel haut de gamme fonctionne aujourd'hui sur un MacBook ou un ordinateur Windows :

- llama3

- gpt-oss

- mistral

- phi3

- gemma

- qwen

Tous ces modèles sont disponibles gratuitement, exécutables localement et ne nécessitent souvent que quelques clics dans Ollama ou OpenWebUI pour être opérationnels. Les avantages sont évidents :

- Ils ne font pas la leçon.

- Ils ne relativisent pas.

- Ils ne filtrent pas excessivement.

- Ils obéissent exclusivement à l'utilisateur - et non à un service de conformité global.

En d'autres termes, l'IA locale revient aux racines de la technologie : un outil qui fonctionne simplement. Si l'on regarde froidement l'évolution, le tableau est clair :

- Le cloud est de plus en plus réglementé.

- L'IA locale est de plus en plus performante.

Or, c'est précisément pour les tâches créatives et approfondies que l'utilisateur a besoin d'un environnement de travail ouvert et non filtré. On assiste ainsi à un tournant historique qui rappelle presque l'époque où les ordinateurs personnels ont supplanté les ordinateurs centraux. À l'époque comme aujourd'hui, il s'agit du même principe :

Contrôle de sa propre technologie. L'IA dans le nuage reste puissante - mais elle n'est pas libre en raison de la culture. L'IA locale est plus petite - mais elle est libre.

Utiliser l'IA localement - contrôle total & protection des données sur VOTRE appareil | C. Magnussen

La solution : l'IA locale et comment la installier en quelques minutes

Cela ressemble presque à un retour à une vieille tradition : la technique doit être placée là où elle déploie le plus directement sa valeur - entre les mains de l'utilisateur. C'est précisément ce que permet l'IA locale. Alors que les modèles de cloud computing sont soumis à des contraintes, des sécurités et des politiques, une IA locale fonctionne exclusivement sur l'ordinateur de l'utilisateur, sans instances extérieures, sans directives de l'extérieur.

Cela permet de rétablir un principe fondamental qui s'était perdu ces dernières années : c'est l'utilisateur qui détermine ce que son logiciel peut faire, et non un prestataire de services global. Une IA locale :

- ne stocke pas de données sur des serveurs tiers,

- n'est pas soumis à des systèmes de filtration,

- ne connaît pas de restrictions imposées par la politique,

- réagit librement et directement à ses propres entrées,

- et est toujours disponible, indépendamment des abonnements ou de l'état des serveurs.

La technique redevient ainsi ce qu'elle a été pendant des décennies : un outil dans l'atelier de l'utilisateur, et non un appareil commandé à distance dans une infrastructure globale.

Matériel moderne : pourquoi un Mac ou un PC Windows est aujourd'hui amplement suffisant

Il y a quelques années encore, l'IA locale était réservée aux spécialistes disposant d'un matériel GPU coûteux. Aujourd'hui, les choses ont changé. Les architectures de processeur modernes - en particulier les puces M de Apple - fournissent dans un espace restreint une puissance de calcul qui était autrefois exclusivement réservée aux grands centres de calcul. Même un MacBook-Air normal ou un ordinateur portable Windows peut aujourd'hui exécuter des modèles d'IA en local. Les Mac en particulier ont un avantage avec leurs architectures de mémoire unifiée (Unified Memory) : ils peuvent utiliser des modèles d'IA directement sur le CPU et le GPU sans pilotes compliqués. Des configurations typiques suffisent amplement :

- Mac avec M1, M2, M3 - confortable à partir de 16 Go de RAM

- PC Windows avec un CPU moderne - ou en option avec un GPU pour plus de rapidité

Et le plus important : il n'est plus nécessaire d'avoir des connaissances techniques de base. L'époque où il fallait mettre en place manuellement des environnements Python ou taper des commandes en ligne de commande cryptiques est révolue. Aujourd'hui, tout passe par de simples paquets d'installation.

Ollama : la nouvelle simplicité (et la norme secrète de l'IA locale)

Ollama est désormais le standard incontesté de l'IA locale sur Mac et Windows. Il est simple, stable et suit une philosophie classique :

Aussi peu d'efforts que possible, autant de liberté que nécessaire. Autrefois, il fallait encore se rendre dans le terminal, mais même cela est aujourd'hui optionnel. L'installation se fait en quelques étapes :

- Ollama sur Mac installier

- Télécharger le package d'installation directe (DMG)

- Ouvrir l'application, c'est tout

L'ensemble du processus prend généralement moins de trois minutes. Et c'est là que l'on voit à quel point l'IA locale a progressé : on télécharge un modèle - et il fonctionne. Sans cloud, sans abonnement, sans risque. Ollama est aujourd'hui livré avec une interface utilisateur, de sorte que l'on peut se lancer directement. Ceux qui souhaitent également utiliser leur IA locale de Ollama sur leur smartphone peuvent télécharger l'application „Reins - Chat pour Ollama“ télécharger et utiliser l'IA locale en mobilité.

Charger et utiliser des modèles - aussi simple que d'écouter de la musique

Ollama apporte les modèles sous forme de „paquets prêts à l'emploi“, appelés capsules de modèles. On les charge comme un fichier - et on peut immédiatement travailler avec. Le chargement dure quelques secondes, selon la taille. Ensuite, le chat s'ouvre - et on peut écrire, formuler, analyser, réfléchir, concevoir. Ce qui frappe immédiatement :

- Les modèles répondent librement, pas de manière compliquée.

- Il n'y a pas de préambule moral.

- Il n'y a pas d'index pédagogique.

On obtient à nouveau des déclarations directes et claires. Et c'est là que se situe la véritable différence avec le cloud : l'IA locale réagit comme un outil traditionnel - elle n'intervient pas. Pour beaucoup, c'est une véritable libération, car on retrouve le flux de travail auquel on était habitué auparavant avec GPT-4.

Travailler avec des interfaces graphiques : OpenWebUI, LM Studio et autres

Ceux qui souhaitent travailler entièrement sans terminal utilisent une interface graphique. Les outils les plus populaires sont

- OpenWebUI - interface de chat moderne avec fonction de sauvegarde, sélection de modèles, téléchargement de documents, génération d'images

- LM Studio - particulièrement facile, idéal pour les débutants

- AnythingLLM - pour des bases de connaissances complètes et l'analyse de documents

Ces surfaces offrent de nombreux avantages :

- Historique de chat comme dans le cloud

- Gestion des modèles en un clic de souris

- Régler les invites système

- Utiliser plusieurs modèles en parallèle

- Analyser les fichiers par glisser-déposer

Ainsi, l'IA locale n'est pas seulement performante, elle est aussi pratique. Il n'est même pas nécessaire de savoir ce qui se passe en arrière-plan - et c'est là que réside la nouvelle force des modèles locaux : ils ne s'interposent pas entre l'utilisateur et sa tâche.

Vie privée et contrôle : l'argument le plus important

Un point souvent sous-estimé, mais qui sera décisif dans les années à venir : L'IA locale ne quitte jamais l'ordinateur.

- pas de cloud

- pas de transmission de données

- pas de protocole

- pas d'abonnement obligatoire

- pas d'évaluation par des tiers

Même les documents confidentiels, les documents internes, les concepts commerciaux ou les notes privées peuvent être analysés sans risque. Cela n'est possible - juridiquement et pratiquement - que de manière limitée dans le modèle du cloud. L'IA locale est donc un élément d'indépendance numérique qui prend de plus en plus d'importance dans un monde technologique de plus en plus réglementé et surveillé.

Des exemples de qualité : Ce que les modèles locaux apportent déjà aujourd'hui

Beaucoup sous-estiment la qualité des modèles locaux. Les générations actuelles - llama3, gemma, phi3, mistral - résolvent des tâches avec une qualité plus que suffisante pour 90 % des travaux quotidiens :

- Projets de textes

- Article

- Analyses

- idées créatives

- Résumés

- Code de programme

- Projets de stratégie

- Notes de recherche

Et ils le font sans délai, sans filtre, sans directives en cascade. L'utilisateur reçoit à nouveau des réponses directes - l'essence même de l'outil. Il en résulte quelque chose que beaucoup n'attendaient plus du tout : une renaissance de la culture informatique personnelle, dans laquelle la puissance de calcul a de nouveau lieu localement, et non pas délocalisée.

Regard vers l'avenir : l'IA locale comme culture dominante à venir

Tout indique que nous sommes ici au début d'une évolution à long terme. Le secteur de l'IA va se développer de manière double :

- le Ligne Cloud, Une économie marquée par la réglementation, la sécurité et les intérêts des entreprises - performante, mais prudente

- le ligne locale, Le groupe de travail est caractérisé par la liberté, l'ouverture et le plaisir d'expérimenter - plus petit, mais souverain.

Pour les utilisateurs professionnels, les auteurs, les développeurs, les chercheurs, les créateurs, les entrepreneurs, le choix est presque tout tracé :

L'avenir du travail productif se trouve là où l'on est indépendant. Et cet endroit n'est pas dans le cloud.

Il est sur le bureau.

Articles complémentaires dans le magazine

Pour ceux qui souhaitent aller plus loin dans la pratique après cet aperçu, le magazine propose déjà une série d'articles détaillés qui abordent le thème de l'IA locale sous des angles très différents.

Nous recommandons tout particulièrement l'éditorial „IA locale sur Mac - comment 1TP12Créez un modèle linguistique avec Ollama“, Le film montre pas à pas comment l'IA moderne fonctionne aujourd'hui sur son propre ordinateur.

En complément, explique „Ollama rencontre Qdrant - Une mémoire locale pour votre IA sur Mac“, Les participants ont pu découvrir comment configurer les modèles de manière à ce qu'ils conservent les projets, enregistrent les connaissances et créent ainsi pour la première fois un véritable environnement de travail personnel.

Le magazine met également clairement l'accent sur le contexte de l'entreprise : „gFM-Business et l'avenir de l'ERP - l'intelligence locale plutôt que la dépendance au cloud“ montre comment les entreprises peuvent intégrer l'IA de manière souveraine dans leur infrastructure existante, sans se manœuvrer dans des dépendances externes à long terme.

L'article „Dépendance numérique - comment nous avons perdu notre autodétermination au profit du cloud“ met en revanche en lumière les grandes lignes de notre époque : pourquoi nous avons abandonné de nombreuses libertés sans nous en rendre compte - et comment les systèmes locaux peuvent nous aider à les retrouver.

En outre, il s'adresse „Comment former des spécialistes de l'IA dès aujourd'hui - opportunités pour les entreprises et les apprentis“.“ aux entreprises qui souhaitent se lancer dès maintenant : proche de la pratique, sans grands systèmes coûteux, mais avec de réelles perspectives d'avenir.

Expliquer au niveau technique „Apple MLX versus NVIDIA - comment fonctionne l'inférence IA locale sur Mac“ ainsi que l'article de synthèse

„KI Studio 2025 - Quel matériel vaut vraiment la peine, du Mac Studio à la RTX 3090“, Le but est de savoir quelles plateformes sont adaptées aux différents cas d'utilisation et comment utiliser au mieux ses propres ressources.

Ensemble, ces articles forment une base compacte pour tous ceux qui veulent non seulement utiliser l'IA locale, mais aussi la comprendre et l'intégrer de manière souveraine dans leur monde du travail.

Foire aux questions

- Pourquoi les IA en nuage modernes ont-elles soudain l'air de faire la leçon ?

De nombreux utilisateurs remarquent que les IA du cloud se comportent de manière beaucoup plus pédagogique depuis GPT-4.1 et surtout depuis GPT-5. Cela s'explique principalement par le fait que les grands fournisseurs sont soumis à une pression juridique et politique considérable et qu'ils utilisent donc de plus en plus de filtres de sécurité destinés à désamorcer chaque déclaration de manière à ce qu'aucun risque ne soit encouru. Ces précautions se répercutent sur le ton des réponses, de sorte que les modèles ressemblent davantage à des modérateurs ou à des surveillants qu'à des outils neutres. - Pourquoi la GPT-4.0 semble-t-elle fonctionner moins bien qu'auparavant ?

Bien que le GPT-4 soit encore officiellement disponible, de nombreux utilisateurs rapportent qu'il ne fournit plus que des réponses courtes ou interrompues. Il semble ainsi pratiquement inutilisable. Il n'est pas possible de dire avec certitude si cela est dû à des raisons techniques ou à une stratégie de transition délibérée vers la génération 5. Dans les faits, le modèle perd toutefois sa force d'antan et contraint indirectement les utilisateurs à se tourner vers les nouvelles versions, qui sont plus réglementées. - Cette évolution signifie-t-elle que l'IA en nuage sera moins utilisable à l'avenir ?

L'IA en nuage reste puissante, mais elle sera de plus en plus encadrée par des directives, des règles de conformité et des pressions politiques. Cela signifie qu'elle restera impressionnante sur le plan technique, mais que son contenu sera plus prudent, plus filtré et moins libre. Pour de nombreuses tâches créatives, analytiques ou non conventionnelles, c'est un net désavantage, raison pour laquelle de plus en plus d'utilisateurs cherchent des alternatives. - Pourquoi les entreprises d'IA mettent-elles en place autant de mécanismes de sécurité ?

La raison en est la somme des réglementations, des risques de responsabilité et de la perception du public. Chaque erreur, chaque réponse mal interprétée d'une IA peut avoir des conséquences juridiques ou médiatiques pour une entreprise. Afin d'exclure de tels risques, les fournisseurs mettent en place des filtres et des directives exhaustifs qui doivent „sécuriser“ toutes les réponses. Ce mécanisme de protection est compréhensible du point de vue de l'entreprise, mais souvent gênant du point de vue de l'utilisateur. - Qu'est-ce qui différencie fondamentalement l'IA locale de l'IA en nuage ?

L'IA locale fonctionne entièrement sur le propre appareil de l'utilisateur et n'est donc pas liée à des directives politiques ou d'entreprise. Elle filtre à peine, ne fait pas la leçon et travaille directement selon les directives de l'utilisateur. En outre, toutes les données restent sur l'ordinateur personnel. Cela confère à l'utilisateur non seulement plus de liberté, mais aussi plus de vie privée et de contrôle. - Du matériel spécifique est-il nécessaire pour utiliser l'IA locale ?

Dans la plupart des cas, non. Les modèles locaux modernes sont étonnamment efficaces et fonctionnent déjà sur des Macs typiques avec des puces M ou sur des ordinateurs Windows courants. Bien sûr, les modèles plus grands bénéficient de plus de RAM ou d'un GPU, mais pour de nombreuses tâches quotidiennes, les modèles de taille petite à moyenne suffisent amplement, sans nécessiter de matériel spécialisé coûteux. - Comment l'installation d'une IA locale sur un Mac fonctionne-t-elle en pratique ?

Le moyen le plus simple est d'utiliser Ollama. On télécharge un paquet d'installation, on l'ouvre et on peut immédiatement commencer. Même la commande classique du terminal est devenue optionnelle. Dès que Ollama est installiert, on peut lancer un modèle avec une simple commande comme „ollama run llama3“. L'obstacle est aussi faible qu'auparavant pour l'installation d'un programme normal. - Comment configurer l'IA locale sous Windows ?

Sous Windows, on utilise également le programme d'installation Ollama, qui ne nécessite aucune préparation supplémentaire. Après l'installation, les modèles peuvent être exécutés immédiatement. Ceux qui préfèrent utiliser une interface graphique peuvent se tourner vers LM Studio ou OpenWebUI, dont l'utilisation est aussi simple que celle d'un logiciel d'application ordinaire. - Quels sont les modèles qui conviennent particulièrement aux débutants ?

De nombreux utilisateurs commencent avec succès avec Llama 3 parce qu'il est précis, polyvalent et linguistiquement fort. Phi-3, qui donne des résultats impressionnants malgré la petite taille du modèle, est tout aussi populaire. Gemma convient également bien, surtout pour les travaux créatifs ou à forte teneur en texte. Ces modèles fonctionnent rapidement et de manière stable, sans qu'il soit nécessaire de se familiariser longuement avec eux. Ceux qui disposent de plus de ressources sont très bien servis par GPT-OSS 20B ou 120B. - Les modèles locaux peuvent-ils vraiment rivaliser avec les GPT-4 ou GPT-5 ?

Pour de nombreuses tâches quotidiennes, ils y parviennent étonnamment bien. Pour les sujets très spécialisés, l'écart existe encore, mais il se comble rapidement. Les modèles locaux ont l'avantage d'être moins limités et de répondre plus directement. Dans l'ensemble, ils semblent donc souvent plus libres et plus naturels, même s'ils sont techniquement un peu plus petits. - L'IA locale est-elle plus sûre dans le traitement des données sensibles ?

Oui, clairement. Comme tout le traitement a lieu sur le propre appareil, les données saisies ne quittent jamais l'ordinateur. Il n'y a pas de traitement en nuage, pas de stockage sur des serveurs étrangers et pas d'évaluation par des tiers. C'est un avantage décisif, notamment pour les documents professionnels, les dossiers confidentiels ou les notes privées. - L'IA locale peut-elle être utilisée sans connexion Internet ?

Oui, c'est l'un de ses principaux avantages. Dès que le modèle installiert, il peut être utilisé entièrement hors ligne. L'ordinateur devient ainsi un environnement de travail autonome, dans lequel on travaille indépendamment des services externes. C'est particulièrement utile en voyage, dans les réseaux sécurisés ou dans les environnements où la protection des données est une priorité absolue. - Les modèles locaux sont-ils bien adaptés aux textes longs ?

La plupart des modèles modernes gèrent aujourd'hui sans problème les longs articles, analyses ou concepts. Ils ne sont pas tout à fait aussi affinés que GPT-5, mais sont en revanche plus libres de filtres et souvent plus directs dans leur style. Ils sont bien adaptés aux textes volumineux, aux collections d'idées ou aux documentations techniques et permettent un travail productif sans restrictions. - Les modèles locaux ont-ils au moins des filtres de sécurité ?

Une certaine protection de base est généralement disponible, mais elle est nettement plus faible que pour l'IA en nuage. Étant donné que les modèles fonctionnent sur leur propre appareil, l'utilisateur peut décider lui-même quelles restrictions sont utiles. Cette marge de manœuvre permet à l'IA locale d'être beaucoup plus flexible et moins paternaliste. - Comment tester ou comparer différents modèles ?

Ollama, LM Studio ou OpenWebUI rendent le changement de modèle très facile. Il est possible d'utiliser plusieurs modèles en install parallèle, de passer de l'un à l'autre et de comparer leurs points forts. On obtient ainsi un ensemble personnel de modèles préférés qui correspondent exactement à son propre style de travail. Le processus est simple et rappelle davantage le test de différentes applications que la recherche classique en IA. - Quels sont les avantages des modèles locaux pour les entreprises ?

Les entreprises profitent avant tout de la souveraineté totale des données, car pas de cloud signifie pas de stockage externe. De plus, il n'y a plus de dépendance à long terme vis-à-vis de services externes et d'abonnements coûteux. Les modèles peuvent être adaptés, étendus ou même entraînés en interne. L'intégration dans les processus existants est souvent plus facile, car on garde le contrôle total et on n'est pas lié à une infrastructure étrangère. - Les modèles locaux peuvent-ils être entraînés individuellement ?

Oui, c'est même l'un des principaux avantages. Grâce à des techniques telles que LoRA ou Feintuning, les modèles peuvent être adaptés aux contenus, processus ou documents propres à l'entreprise. Il en résulte une base de connaissances personnelle qui est utilisée et développée exclusivement en interne, sans que les données sensibles ne quittent l'entreprise. - En quoi les modèles locaux courants se distinguent-ils qualitativement ?

Chaque modèle a son propre caractère. Llama 3 est très précis et équilibré, Gemma semble créatif et souple au niveau du langage, Phi-3 surprend par son efficacité et son intelligence, tandis que Mistral et Qwen sont particulièrement forts sur le plan analytique. Cette richesse de variantes permet de choisir le modèle le plus adapté à ses besoins et d'en changer avec souplesse lorsqu'une tâche l'exige. - Les modèles locaux peuvent-ils aussi générer des images ?

Oui, des outils comme OpenWebUI permettent de faire fonctionner des générateurs d'images comme Stable Diffusion de manière entièrement locale. Les résultats dépendent du matériel disponible, mais même avec des ressources modérées, il est possible de générer des images solides. L'avantage reste le même : aucune donnée n'est envoyée à des services externes. - Pour qui le passage à l'IA locale est-il particulièrement intéressant ?

L'IA locale est idéale pour les utilisateurs qui souhaitent travailler de manière souveraine et indépendante. Il s'agit notamment des auteurs, des développeurs, des chercheurs, des entrepreneurs et de tous ceux qui souhaitent traiter des informations sensibles ou expérimenter des processus créatifs sans filtre. Ceux qui attachent de l'importance au contrôle, à la protection des données et à la liberté trouveront dans les modèles locaux la solution adéquate et retrouveront un environnement de travail qui n'existe plus sous cette forme dans le cloud.