Toen de grote taalmodellen een paar jaar geleden aan hun zegetocht begonnen, leken ze bijna een terugkeer naar de oude deugden van technologie: een hulpmiddel dat doet wat het wordt opgedragen. Een hulpmiddel dat de gebruiker dient, niet andersom. De eerste versies - van GPT-3 tot GPT-4 - hadden zwakke punten, dat wel, maar ze waren verbazingwekkend nuttig. Ze legden uit, analyseerden, formuleerden en losten opgaven op. En ze deden dit grotendeels zonder pedagogische ballast.

Je sprak met deze modellen alsof je met een erudiete medewerker sprak, die soms zijn woorden verkeerd gebruikte, maar in wezen gewoon werkte. Iedereen die in die tijd creatieve teksten schreef, programmacode genereerde of langere analyses maakte, ervoer hoe soepel het werkte. Er was een gevoel van vrijheid, van een open creatieve ruimte, van technologie die mensen ondersteunde in plaats van corrigeerde.

Op dat moment kon nog worden voorzien dat deze hulpmiddelen de komende decennia vorm zouden geven - niet door paternalisme, maar door expertise. Maar zoals zo vaak het geval is in de geschiedenis van de technologie, verliep ook deze fase niet zonder veranderingen.

Laatste nieuws over AI in de cloud en beperkingen

10.02.2026: Een nieuw artikel over Reitschuster „Hoe ChatGPT 5.2 me witheet maakt“ beschrijft op indrukwekkende wijze hoe AI voor veel gebruikers is veranderd met de upgrade naar versie 5.2. Waar eerdere versies dienden als flexibele alledaagse helpers, onderhoudende gesprekspartners en pragmatische hulpmiddelen, lijkt de nieuwe versie volgens de auteur steeds moraliserend en beschermend. In plaats van open en ironisch te reageren op vragen, geeft het systeem nu instructieve, voorgestructureerde antwoorden die bedoeld zijn om gebruikers in de richting van conformistische denkpatronen te sturen. Dit leidt ertoe dat mensen hun eigen formuleringen en gedachten aanpassen om de AI „op de tenen te trappen“. Voor de auteur betekent dit een verlies aan gemak en spontaniteit - en de indruk dat een praktisch hulpmiddel een interne censor is geworden. Dit frustreert hem en zorgt ervoor dat hij de voorkeur geeft aan oudere versies.

Van openheid naar voorzichtige terughoudendheid

Hoe meer de modellen volwassen werden, hoe meer de toon veranderde. Wat aanvankelijk leek op een incidentele beschermende waarschuwing werd geleidelijk een hele laag van bescherming, instructie en morele zelfcensuur. Het vriendelijke, objectieve model begon zich steeds meer te gedragen als een moderator - of erger nog: als een waakhond.

De antwoorden werden langer, maar niet substantiëler. De toon werd zachter, maar leerzamer. De modellen wilden niet langer alleen helpen, maar ook „opvoeden“, „verantwoordelijk begeleiden“ en „beschermen tegen verkeerde conclusies“. En plotseling was dit pedagogische kader overal.

Voor veel gebruikers was dit een breuk met de oorspronkelijke belofte van de technologie. Ze wilden een hulpmiddel - en in plaats daarvan kregen ze een soort digitale schoolmeester die elke zin becommentarieert nog voor ze begrepen hebben waar het over gaat.

Het senior teacher effect: bescherming in plaats van hulp

Het zogenaamde „teacher-in-chief effect“ beschrijft een ontwikkeling die vooral sinds GPT-5 duidelijk is. De modellen reageren steeds gevoeliger op elk woord dat theoretisch - ver aan de horizon - in om het even welke controversiële richting zou kunnen worden geïnterpreteerd. Het effect manifesteert zich in verschillende vormen:

- OvervoorzichtigheidZelfs onschuldige vragen worden gerelativeerd met lange voorwoorden.

- InstructieIn plaats van een antwoord krijg je een morele categorisering.

- RemeffectenAI probeert de gebruiker te beschermen tegen hypothetische misinterpretaties.

- ZelfcensuurVeel onderwerpen worden afgezwakt of op een ingewikkelde manier verpakt.

Het probleem is niet het idee van voorzichtigheid zelf. Het is de intensiteit. Het is de alomtegenwoordigheid. En het feit dat je ervoor betaalt - en nog steeds beperkt bent. De modellen veranderen van assistenten in poortwachters. En dit is precies wat iedereen voelt die met 4.0, 5.0 en 5.1 heeft gewerkt.

Hoe GPT-5.0 en GPT-5.1 de toon voorgoed verlegden

De ontwikkeling naar meer instructie was al merkbaar onder GPT-4.1. Maar met de stap naar de 5e generatie is een belangrijke sprong gemaakt. GPT-5.0 versterkte het onderwijspantser, maar GPT-5.1 brengt het naar een nieuw en voor velen verrassend streng niveau. Dit is wat er gebeurt onder GPT-5.1:

- De antwoorden worden emotioneel neutraler, maar paradoxaal genoeg ook moraliserend.

- De AI probeert te anticiperen op situaties die niet de bedoeling waren.

- Elke mogelijke controverse wordt van tevoren onder controle gehouden en soms zelfs „opgeruimd“ voordat de gebruiker zelfs maar ter zake komt.

- Zelfs gespecialiseerde technische onderwerpen worden soms op een onhandige manier geformuleerd.

Je zou kunnen zeggen dat de modellen hebben geleerd zichzelf te controleren - maar ze controleren nu ook de gebruiker. Het is een stille maar diepgaande verschuiving. En iedereen die productief werkt, voelt het al na een paar minuten.

GPT-4.0 als fantoom: een model dat er nog wel is - maar praktisch niet meer bestaat

Officieel werd lange tijd gezegd dat GPT 4.0 nog een paar maanden zou werken. In werkelijkheid is het model nu echter nauwelijks bruikbaar. De typische observatie van veel gebruikers:

- Antwoorden worden ingekort tot een paar zinnen.

- Langere teksten worden vroegtijdig geannuleerd.

- Het model „vergeet“ context of annuleert na een paragraaf.

- Uitgebreide taken worden geweigerd of slechts oppervlakkig behandeld.

De indruk bestaat dat GPT-4.0 systematisch is „gedownreguleerd“. Of dit opzettelijk is of om technische redenen is open voor speculatie. Maar het resultaat is duidelijk: mensen worden naar de 5 modellen geduwd omdat 4.0 praktisch onbruikbaar is geworden.

Dit betekent dat veel gebruikers de enige versie missen die nog een vrijheidsachtige balans had tussen openheid en voorzichtigheid. De oude manier van werken - creatief, flexibel, zonder overdreven instructies - is daarmee de facto uitgeschakeld.

Het cumulatieve effect: een hulpmiddel dat steeds minder een hulpmiddel is

Als je de afgelopen twee jaar samenvat, komt er een opmerkelijke trend naar voren:

- De modellen worden groter.

- De modellen worden steeds sneller.

- De modellen worden steeds krachtiger.

Maar tegelijkertijd:

- Ze worden voorzichtiger.

- Ze worden pedagogischer.

- Ze worden afhankelijker van richtlijnen.

En ze laten de gebruiker minder speelruimte. Dit is geen technische ontwikkeling - het is een culturele ontwikkeling. En het past in een tijd waarin bedrijven, politici en de media elke nieuwe technologie meteen willen omarmen voordat de gebruiker het rustig kan uitproberen.

Maar hier treedt een breuk op. Want de aard van technologie - en nog meer de aard van creativiteit - vraagt om vrijheid, niet om opvoeding. Steeds meer gebruikers voelen dit intuïtief aan. En ze gaan op zoek naar alternatieven. Dit alternatief komt uit een richting die velen niet hadden verwacht:

Lokale AI, direct op je eigen computer, zonder filters, zonder schoolhoofd. De slinger zwaait terug.

Huidig onderzoek naar lokale AI

Waar komt deze ontwikkeling vandaan? Een kijkje achter de schermen

Als je wilt begrijpen waarom cloud-AI tegenwoordig zo overbezorgd te werk gaat, moet je eerst naar het politieke en juridische klimaat kijken. Kunstmatige intelligentie is niet langer een experiment van een paar nerds, maar een politieke kwestie van de hoogste orde. Regeringen, overheden en supranationale organisaties hebben dit erkend: Wie AI beheerst, beheerst een centraal onderdeel van de digitale infrastructuur van morgen.

Dit heeft geleid tot een hele cascade aan regelgeving. In Europa wordt bijvoorbeeld geprobeerd om het gebruik van AI te „kanaliseren“ door middel van uitgebreide wetgeving - officieel in naam van consumentenbescherming, menselijke waardigheid en het voorkomen van discriminatie. Vergelijkbare debatten vinden plaats in de VS en andere regio's, alleen met een andere focus: daar ligt de focus meer op nationale veiligheid, economische dominantie en concurrentievermogen. Voor de exploitanten van grote AI-platforms resulteert dit in een eenvoudig maar lastig scenario:

- Ze moeten op meerdere continenten tegelijk aan de wet voldoen.

- Ze moeten anticiperen op mogelijke toekomstige wetten die nog niet eens zijn aangenomen.

- Ze zijn voortdurend in het vizier van overheden, de media en lobbygroepen.

Wie in zo'n omgeving werkt, ontwikkelt onvermijdelijk een houding: je kunt beter te voorzichtig zijn dan te liberaal. Een te streng model is immers minder schadelijk voor het bedrijfsleven dan één internationale golf van schandalen met krantenkoppen, commissies en oproepen tot boycots.

Het gevolgDe technologie zelf is niet alleen gereguleerd - ze is van tevoren gereguleerd. En deze anticiperende gehoorzaamheid wordt rechtstreeks gekanaliseerd in de reacties van de modellen.

Aansprakelijkheidsdruk en bedrijfslogica: wanneer risico belangrijker wordt dan voordeel

Vandaag de dag opereren grote AI-bedrijven in een spanningsveld tussen gigantische kansen en even gigantische risico's. Aan de ene kant zijn er miljardenmarkten, strategische partnerschappen en beursfantasieën. Aan de andere kant is er de dreiging van collectieve rechtszaken, boetes, schadeclaims en nieuwe aansprakelijkheidsregels. In deze situatie ontstaat een typisch patroon binnen het bedrijf:

- Advocaten vragen om voorzichtigheid.

- Compliance afdelingen eisen beperkingen.

- Productteams moeten „veilig“ lanceren.

- Het management wil geen negatieve krantenkoppen.

In de loop der jaren creëert dit een cultuur waarin één principe steeds meer ruimte inneemt: Alles wat problemen kan veroorzaken, kan beter onschadelijk worden gemaakt voordat het zelfs maar ontstaat. Voor een taalmodel heeft dit zeer praktische gevolgen:

- Bepaalde onderwerpen worden automatisch overgeslagen.

- De formuleringen zijn zo ontworpen dat ze niemand „pijn“ doen of van streek maken.

- Inhoud die op enigerlei wijze juridisch kan worden aangevochten, wordt überhaupt niet gemaakt.

Hierdoor verschuift de prioriteit: de focus ligt niet langer op de voordelen voor de gebruiker, maar op het minimaliseren van het risico voor het bedrijf. Op het niveau van de individuele dialoog is dit nauwelijks merkbaar - in individuele gevallen kan elke beperking nog steeds begrijpelijk lijken. Het algemene effect is echter precies wat veel mensen voelen: AI wordt niet langer gezien als een hulpmiddel, maar als de gecontroleerde output van een systeem dat vooral zichzelf beschermt.

De rol van PR en de media: niemand wil in de krantenkoppen belanden

Naast wetten en aansprakelijkheidskwesties is er nog een factor die vaak wordt onderschat: de media. Grote AI-aanbieders staan voortdurend in de schijnwerpers. Elke hapering, elk irritant antwoord, elk individueel geval kan binnen een paar uur veranderen in een internationale „sensatie“. De medialogica is eenvoudig: een schandaal verkoopt beter dan een nuchter voortgangsverslag. Dus verhalen volgen dit patroon keer op keer:

- „AI raadt gevaarlijke actie aan.“

- „Chatbot maakt problematische opmerkingen over gevoelige onderwerpen.“

- „Het systeem bagatelliseert controversiële inhoud op een bagatelliserende manier.“

Zelfs als de uitgangssituatie verstoord is, is de schade al aangericht. De ervaring leert dat bedrijven hierop reageren met twee strategieën:

- Publiekelijk afstand nemenZe benadrukken hoe serieus ze het probleem nemen, kondigen verbeteringen aan en bouwen extra beveiligingslagen in.

Interne aanscherping van richtlijnenEr worden extra filters geactiveerd, de trainingsgegevens worden aangescherpt, systeemprompts worden aangepast en bepaalde formuleringen of onderwerpen worden helemaal verboden.

Dezelfde mediaomgeving die graag praat over „vrijheid“ en „open discours“ creëert in de praktijk een enorme druk voor zelfcensuur. En bedrijven geven deze druk door aan hun systemen.

Met elke krantenkop, elke shitstorm, elke golf van publieke verontwaardiging worden de beschermingsmechanismen strenger. Het resultaat is wat we in het dagelijks leven ervaren: De gebruiker stelt een normale vraag en het model reageert alsof het net een openbare persconferentie heeft gehouden. In plaats van nuchtere, professionele hulp is er een mengeling van verontschuldigingen, afstand nemen en morele categorisering.

Beveiligingsrichtlijnen die een eigen leven gaan leiden

In elk groot bedrijf zijn er richtlijnen. In eerste instantie zijn deze vaak verstandig en duidelijk: geen discriminatie, geen verheerlijking van geweld, geen aanzetten tot strafbare feiten. Niemand zal serieus betwisten dat zulke basisrichtlijnen verstandig zijn. Maar in de praktijk blijft het daar niet bij. Bij elk incident, elke klacht, elke publieke discussie komen er nieuwe regels bij:

- een extra „als-dan“ scenario,

- een nieuw speciaal geval,

- nog een speciale paragraaf,

- een uitzondering voor bepaalde contexten,

- of een bijzonder strikte interpretatie van de formulering.

In de loop der jaren ontstaat er een steeds dichter netwerk van specificaties. Dit netwerk wordt door technische teams vertaald in filters, promptlagen, classificeerders en andere controlemechanismen. Hoe meer lagen worden toegevoegd, hoe onvoorspelbaarder het gedrag in individuele gevallen wordt. Uiteindelijk is het niet langer de individuele regel die het systeem kenmerkt, maar de som van alle regels. En deze som creëert wat veel gebruikers voelen:

- een permanent remeffect,

- de neiging om overbezorgd te zijn,

- een visie waarin „risico 0“ belangrijker is dan „voordeel 100“.

Een bijzonder probleem is dat als dergelijke beveiligingsrichtlijnen eenmaal zijn opgesteld, het bijna onmogelijk is om ze terug te draaien. Geen enkele manager wil later moeten zeggen: „We hebben het rustiger aan gedaan en nu is er iets gebeurd.“ Het is dus beter om er nog een laag bovenop te leggen. En nog een. En nog een. Wat oorspronkelijk begon als een verstandige beschermingsmaatregel, eindigt als een systeem dat een eigen leven is gaan leiden.

Tussentijdse conclusie: Een technologie onder permanent toezicht

Als je deze factoren - internationale regelgeving, aansprakelijkheidsdruk, medialogica en het momentum van beveiligingsrichtlijnen - samenvat, ontstaat er een duidelijk beeld:

- De grote wolkenmodellen worden voortdurend onder de loep genomen.

- Een verkeerde reactie kan juridische gevolgen en gevolgen voor de media hebben.

In deze omgeving is de verleiding groot om „te veel“ te filteren in plaats van „te weinig“. Het resultaat voor de gebruiker: de AI klinkt niet langer als een neutrale assistent, maar meer als een systeem dat constant met één voet in de rechtszaal staat en met de andere in de persoverzichten. Dit is precies waar de breuk met de oorspronkelijke verwachtingen van veel gebruikers begint. Ze willen niet geïnstrueerd, politiek geframed of pedagogisch begeleid worden. Ze willen werken, schrijven, programmeren, denken - met een tool die hen ondersteunt.

En dit is waar een alternatief om de hoek komt kijken dat op het eerste gezicht bijna ouderwets klinkt, maar in feite ultramodern is: lokale AI, direct op je eigen computer, zonder de cloud, zonder supervisie, zonder externe richtlijnen - behalve die van jezelf. Het volgende hoofdstuk gaat daarom over de gevolgen van deze ontwikkeling:

Hoe AI in de cloud steeds onbruikbaarder wordt voor ambitieuze gebruikers vanwege de eigen voorzichtigheid - en hoe lokale modellen onopvallend maar consistent groeien in het gat dat de grote providers zelf hebben opengebroken.

AI in de cloud wordt steeds meer gefilterd, maar gebruikers hebben het tegenovergestelde nodig

Het oorspronkelijke idee achter AI-assistenten was eenvoudig: de gebruiker stelt een vraag - de AI geeft een nauwkeurig en nuttig antwoord. Zonder omwegen, zonder afleidingen, zonder instructies. Deze eenvoud is tegenwoordig echter verloren gegaan in veel cloudmodellen. In plaats van een hulpmiddel krijgt de gebruiker een soort anticiperende moderatie. De systemen reageren alsof ze op een publiek podium staan en moeten elke uitspraak onderbouwen, relativeren of categoriseren. In de praktijk leidt dit tot een paradoxaal effect:

Hoe veeleisender de taak, hoe meer je je belemmerd voelt. Als je creatief wilt werken - schrijven, programmeren, onderzoeken, analyseren - heb je eigenlijk maximale openheid nodig. Een AI die vrijelijk ideeën uitspuugt, hypotheses test en alternatieven bespreekt. De creatieve ruimte is nu echter vaak beperkt. In plaats van gedurfde gedachte-experimenten krijgen we voorzichtig aftasten. In plaats van vrije analyse zijn er „gecontextualiseerde hints“. Een hulpmiddel wordt een bewaker. En openheid wordt voorzichtigheid. Ironisch genoeg betekent dit dat cloud-AI precies de ruimte overneemt die productieve mensen het hardst nodig hebben.

De verandering in modellen: Nog groter - maar beperkter

Het is een ironie van de geschiedenis van de technologie: hoe groter de modellen worden, hoe kleiner hun actieradius soms lijkt. GPT-5 is indrukwekkend, zonder twijfel - analytisch, taalkundig en logisch. Maar tegelijkertijd is het merkbaar meer gereguleerd dan zijn voorgangers. Veel gebruikers ervaren dit:

- De AI begrijpt meer, maar zegt minder.

- Ze herkent complexe relaties - maar vermijdt duidelijke uitspraken.

- Het zou diepgaand kunnen analyseren - maar maakt zijn eigen resultaten voortdurend onschadelijk.

De modellen hebben er miljoenen parameters bijgekregen, maar het gevoel is dat ze aan vrijheid hebben ingeboet. Dit is geen technisch probleem, maar een cultureel probleem. Grote aanbieders reageren op risico's en deze risicominimalisatie wordt direct weerspiegeld in de toon van de modellen. Je zou kunnen zeggen dat AI volwassen is geworden, maar het gedraagt zich als een overbezorgde volwassene. En iedereen die er dagelijks mee werkt, beseft hoe vermoeiend dit op de lange termijn kan worden.

De paradox van het betalingsmodel: je betaalt - en krijgt toch beperkingen

Vroeger was er een duidelijk principe in de digitale wereld: wie betaalt, heeft meer controle. Maar met cloud AI wordt dit principe omgedraaid. Zelfs betalende gebruikers krijgen modellen die vaak beperkter zijn dan de open, lokale alternatieven. De betaalde versie van een product lijkt opeens de zwaarder gereguleerde, soms kunstmatig beperkte versie - terwijl vrij beschikbare open source modellen verrassend onbevooroordeeld, direct en creatief zijn.

Deze paradox irriteert veel gebruikers en leidt tot een vraag die in het verleden bijna niemand gesteld zou hebben: Waarom betaal ik eigenlijk om minder vrijheid te hebben dan met een gratis lokale oplossing? Het is een breuk met tientallen jaren softwaretraditie. De gebruiker verwacht waar voor zijn geld:

- meer functies,

- meer mogelijkheden,

- meer flexibiliteit,

- meer controle.

Maar de cloud-AI biedt hem in plaats daarvan:

- meer filters,

- meer beperkingen,

- meer pedagogische inbedding,

- minder controle over hun eigen werkproces.

Dit betekent dat de industrie zich in een richting beweegt die in tegenspraak is met de werkelijke behoeften van gebruikers. En velen beginnen om zich heen te kijken.

De opkomende kloof: Wat de cloud niet meer kan

Terwijl AI's in de cloud steeds meer gereguleerd worden, groeit er een gat dat niemand lange tijd heeft onderkend: De behoefte aan ongecensureerde, vrije, direct werkende tools. Mensen die diepgaand denken, schrijven, programmeren of specialistisch onderzoek doen, voelen al snel dat er iets mis is:

- Antwoorden komen „verzacht“ over.

- Kritische passages worden te voorzichtig geformuleerd.

- Echte debatcultuur is nauwelijks nog toegestaan.

- Creatieve grenzen worden automatisch onschadelijk gemaakt.

Hierdoor verliezen de cloudmodellen precies datgene wat ze in het begin zo waardevol maakte: een vorm van intellectuele onafhankelijkheid die de gebruiker de ruimte gaf. De cloud verwijdert zich daarom geleidelijk van de behoeften van professionele gebruikers - niet uit kwade bedoelingen, maar uit juridische en politieke zelfbescherming. Maar deze zelfbescherming heeft een prijs.

De tegenbeweging: Kleine lokale modellen halen hun achterstand snel in

Terwijl de cloud zich steeds meer richt op voorzichtigheid, hebben lokale modellen zich de afgelopen twee jaar explosief ontwikkeld. Systemen met 3-27 miljard parameters leveren nu verbazingwekkende kwaliteit. Sommige modellen komen gemakkelijk in de buurt van GPT-4 in alledaagse taken - zonder filtercascades, zonder moderatielagen, zonder morele framing. Wat ooit alleen mogelijk was met high-end hardware draait nu op een MacBook of een Windows computer:

- lama3

- gpt-oss

- mistral

- phi3

- gemma

- qwen

Al deze modellen zijn vrij beschikbaar, kunnen lokaal worden uitgevoerd en vereisen vaak maar een paar klikken in Ollama of OpenWebUI om klaar te zijn voor gebruik. De voordelen liggen voor de hand:

- Ze geven geen preken.

- Ze relativeren niet.

- Ze filteren niet overmatig.

- Ze gehoorzamen alleen de gebruiker - niet een wereldwijde compliance-afdeling.

Met andere woorden, lokale AI keert terug naar de wortels van de technologie: een hulpmiddel dat gewoon werkt. Als je de ontwikkeling nuchter bekijkt, is het plaatje duidelijk:

- De cloud wordt steeds meer gereguleerd.

- Lokale AI wordt steeds krachtiger.

Gebruikers hebben echter een open, ongefilterde werkomgeving nodig, vooral voor creatieve en diepgaande taken. Dit is een historisch keerpunt dat bijna doet denken aan de tijd toen personal computers mainframes vervingen. Het principe was toen hetzelfde als nu:

Controle over je eigen technologie. Cloud AI blijft krachtig, maar is cultureel niet gratis. Lokale AI is kleiner, maar wel gratis.

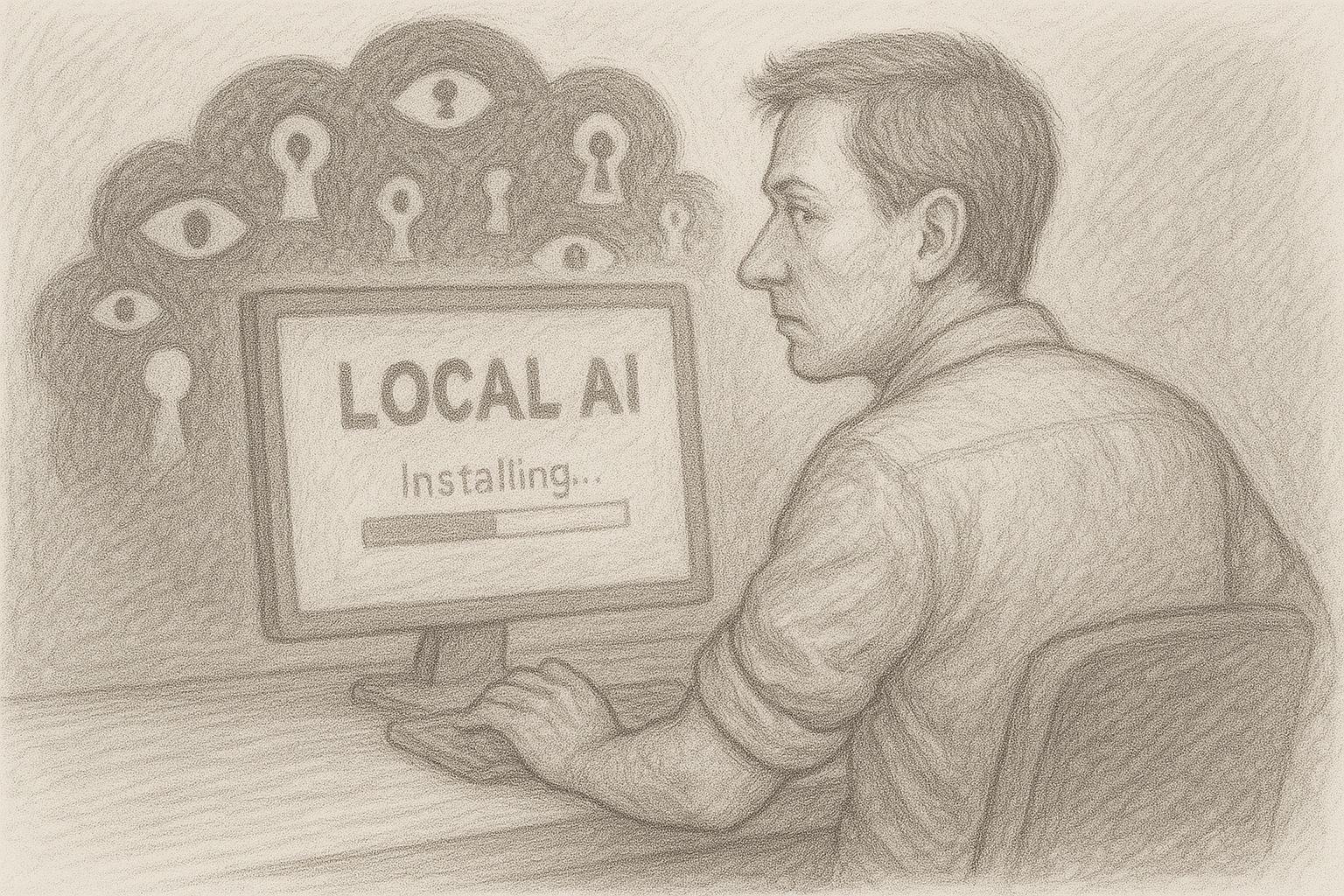

Gebruik AI lokaal - volledige controle en gegevensbescherming op UW apparaat. C. Magnussen

De oplossing: lokale AI en hoe je het in een paar minuten installier kunt maken

Het lijkt bijna een terugkeer naar een oude traditie: technologie hoort daar thuis waar ze het meest direct haar waarde kan ontvouwen - in de handen van de gebruiker. Dit is precies wat lokale AI mogelijk maakt. Terwijl cloudmodellen onderhevig zijn aan voorwaarden, veiligheid en politieke beperkingen, draait lokale AI uitsluitend op de eigen computer van de gebruiker, zonder externe instanties of richtlijnen.

Dit herstelt een fundamenteel principe dat de afgelopen jaren verloren is gegaan: de gebruiker bepaalt wat zijn software mag doen - niet een wereldwijde serviceprovider. Lokale AI:

- slaat geen gegevens op externe servers op,

- is niet onderworpen aan filtersystemen,

- kent geen politiek opgelegde beperkingen,

- reageert vrij en direct op zijn eigen invoer,

- en is altijd beschikbaar, ongeacht abonnementen of serverstatus.

Technologie wordt weer wat het decennialang was: een gereedschap in de werkplaats van de gebruiker, geen op afstand bediend apparaat in een wereldwijde infrastructuur.

Moderne hardware: Waarom een Mac of Windows-pc tegenwoordig prima voldoet

Nog maar een paar jaar geleden was lokale AI alleen iets voor specialisten met dure GPU-hardware. Vandaag de dag is dat anders. Moderne processorarchitecturen - vooral de M-chips van Apple - leveren rekenkracht in een kleine ruimte die voorheen alleen was voorbehouden aan grote datacenters. Zelfs een gewone MacBook Air of een Windows-laptop kan nu lokaal AI-modellen draaien. Vooral Macs hebben een voordeel met hun unified memory architecturen: ze kunnen AI-modellen direct op de CPU en GPU gebruiken zonder ingewikkelde stuurprogramma's. Typische configuraties zijn volledig toereikend:

- Mac met M1, M2, M3 - vanaf 16 GB RAM comfortabel

- Windows PC met een moderne CPU - of optioneel met een GPU voor meer snelheid

En het belangrijkste: je hebt geen technische achtergrondkennis meer nodig. De dagen dat je Python-omgevingen handmatig moest opzetten of cryptische commandoregelcommando's moest intypen, zijn voorbij. Vandaag draait alles via eenvoudige installatiepakketten.

Ollama: De nieuwe eenvoud (en de geheime standaard van lokale AI)

Ollama is nu de onbetwiste standaard voor lokale AI op Mac en Windows. Het is eenvoudig, stabiel en volgt een klassieke filosofie:

Zo weinig mogelijk moeite, zoveel vrijheid als nodig. Vroeger moest je naar de terminal, maar zelfs dat is tegenwoordig optioneel. Installeren gaat in een paar stappen:

- Ollama op de Mac installieren

- Direct installatiepakket (DMG) downloaden

- Open de app, klaar

Het hele proces duurt meestal minder dan drie minuten. En dit laat zien hoe ver lokale AI is gekomen: je downloadt een model - en het werkt. Geen cloud, geen abonnement, geen risico. Ollama wordt nu geleverd met een gebruikersinterface, zodat je meteen aan de slag kunt. Als je de lokale AI van Ollama ook op je smartphone wilt gebruiken, kun je de „Teugels - Chat voor Ollama“.“ en gebruik de lokale AI onderweg.

Modellen laden en gebruiken - net zo eenvoudig als naar muziek luisteren

Ollama levert de modellen als „kant-en-klare pakketten“, zogenaamde modelcapsules. Je laadt ze als een bestand - en je kunt er onmiddellijk mee werken. Het laden duurt een paar seconden, afhankelijk van de grootte. De chat wordt dan geopend - en je kunt schrijven, formuleren, analyseren, denken en ontwerpen. Wat meteen opvalt:

- De modellen reageren vrij, niet onhandig.

- Er zijn geen morele voorwoorden.

- Er wordt niet met de vinger gewezen.

Je krijgt weer directe, duidelijke uitspraken. En dit is waar het echte verschil met de cloud ontstaat: lokale AI reageert als een traditionele tool - het grijpt niet in. Voor velen is dit een echte bevrijding, want je krijgt de workflow terug die je eerder gewend was met GPT-4.

Werken met grafische gebruikersinterfaces: OpenWebUI, LM Studio en andere

Als je volledig zonder terminal wilt werken, gebruik dan een grafische gebruikersinterface. De populairste tools zijn

- OpenWebUI - Moderne chatinterface met geheugenfunctie, modelselectie, uploaden van documenten, genereren van afbeeldingen

- LM Studio - Bijzonder eenvoudig, ideaal voor beginners

- AllesLLM - voor complete kennisdatabases en documentanalyse

Deze oppervlakken bieden veel voordelen:

- Chatgeschiedenis zoals in de cloud

- Modelbeheer met één muisklik

- Systeemprompts instellen

- Meerdere modellen parallel gebruiken

- Bestanden analyseren via slepen en neerzetten

Dit maakt lokale AI niet alleen krachtig, maar ook handig. Je hoeft niet eens te weten wat er op de achtergrond gebeurt - en dat is precies de nieuwe kracht van lokale modellen: ze komen niet tussen de gebruiker en hun taak.

Privacy en controle: het belangrijkste argument

Een punt dat vaak wordt onderschat, maar de komende jaren van cruciaal belang zal zijn: Lokale AI verlaat nooit de computer.

- Geen wolk

- Geen gegevensoverdracht

- Geen logboekregistratie

- Geen verplichte inschrijving

- Geen analyses door derden

Zelfs vertrouwelijke documenten, interne dossiers, bedrijfsconcepten of privénotities kunnen zonder risico worden geanalyseerd. Dit is slechts beperkt mogelijk in het cloudmodel - zowel juridisch als praktisch. Lokale AI is daarom een stukje digitale onafhankelijkheid dat steeds belangrijker wordt in een steeds meer gereguleerde en gecontroleerde technologische wereld.

Voorbeelden van kwaliteit: Wat lokale modellen vandaag al bereiken

Veel mensen onderschatten hoe goed lokale modellen zijn geworden. De huidige generaties - llama3, gemma, phi3, mistral - lossen taken op met een kwaliteit die meer dan voldoende is voor 90 % alledaagse taken:

- Ontwerpteksten

- Artikel

- Analyses

- creatieve ideeën

- Samenvattingen

- Programmacode

- Ontwerpstrategieën

- Onderzoeksnotities

En dat doen ze zonder vertraging, zonder filters, zonder cascaderichtlijnen. De gebruiker krijgt weer directe antwoorden - de pure essentie van de tool. Het resultaat is iets wat velen niet meer hadden verwacht: een renaissance van de persoonlijke computercultuur, waarin rekenkracht weer lokaal is en niet uitbesteed.

Vooruitkijken: lokale AI als de leidende cultuur van de toekomst

Alles wijst erop dat we aan het begin staan van een langetermijnontwikkeling. De AI-sector zal zich op twee sporen ontwikkelen:

- de Wolkenlijn, gekenmerkt door regelgeving, veiligheid, bedrijfsbelangen - efficiënt maar voorzichtig

- de lokale lijn, gekenmerkt door vrijheid, openheid en het plezier van experimenteren - klein maar zelfverzekerd

Voor professionele gebruikers, auteurs, ontwikkelaars, onderzoekers, creatieven en ondernemers is de beslissing bijna een uitgemaakte zaak:

De toekomst van productief werk ligt daar waar je onafhankelijk bent. En die plek is niet in de cloud.

Het staat op het bureau.

Verdere artikelen in het tijdschrift

Als je na dit overzicht dieper wilt ingaan op de praktische kant van de zaak, vind je in het magazine een reeks gedetailleerde artikelen die het onderwerp van lokale AI vanuit heel verschillende perspectieven belichten.

Het hoofdartikel is bijzonder aan te bevelen „Lokale AI op de Mac - hoe installiere een taalmodel met Ollama“, dat stap voor stap laat zien hoe eenvoudig het is om moderne AI op je eigen computer uit te voeren.

Bovendien legt „Ollama ontmoet Qdrant - Een lokaal geheugen voor je AI op de Mac“, hoe je modellen zo kunt configureren dat ze projecten vasthouden, kennisstatussen opslaan en zo voor het eerst een echte persoonlijke werkomgeving creëren.

Het magazine legt ook duidelijke accenten in de bedrijfscontext: „gFM-Business en de toekomst van ERP - lokale intelligentie in plaats van cloudafhankelijkheid“ laat zien hoe bedrijven met vertrouwen AI kunnen integreren in hun bestaande infrastructuur zonder zich in langdurige externe afhankelijkheden te manoeuvreren.

Het artikel „Digitale afhankelijkheid - hoe we onze zelfbeschikking zijn kwijtgeraakt aan de cloud“ Aan de andere kant werpt het licht op het grote plaatje van onze tijd: waarom we veel vrijheden hebben opgegeven zonder het te beseffen - en hoe lokale systemen ons kunnen helpen ze terug te krijgen.

Bovendien zijn de „Hoe kun je tegenwoordig AI-specialisten opleiden - kansen voor bedrijven en stagiairs?“ voor bedrijven die nu de sprong willen wagen: praktisch, zonder dure grootschalige systemen, maar met echte toekomstperspectieven.

Uitleggen op technisch niveau „Apple MLX versus NVIDIA - hoe lokale AI-inferentie werkt op de Mac“.“ en het overzichtsartikel

„AI Studio 2025 - welke hardware is echt de moeite waard, van de Mac Studio tot de RTX 3090“, welke platforms geschikt zijn voor verschillende gebruikssituaties en hoe je het gebruik van je eigen bronnen kunt optimaliseren.

Samen vormen deze artikelen een compacte basis voor iedereen die niet alleen lokale AI wil gebruiken, maar het ook wil begrijpen en met vertrouwen in zijn werkomgeving wil integreren.

Veelgestelde vragen

- Waarom lijken moderne cloud-AI's opeens zo leerzaam?

Veel gebruikers hebben gemerkt dat cloud AI's zich sinds GPT-4.1 en vooral sinds GPT-5 veel pedagogischer gedragen. Dit heeft vooral te maken met het feit dat grote providers onder grote juridische en politieke druk staan en daarom steeds meer gebruik maken van beveiligingsfilters die bedoeld zijn om uitspraken zo onschadelijk te maken dat er geen risico's ontstaan. Deze voorzorgsmaatregelen werken door in de toon van de antwoorden, zodat de modellen zich meer gedragen als moderators of toezichthouders dan als neutrale hulpmiddelen. - Waarom lijkt GPT-4.0 nu slechter te werken dan voorheen?

Hoewel GPT-4 nog steeds officieel beschikbaar is, melden veel gebruikers dat het alleen korte of afgebroken reacties geeft. Dit maakt het praktisch onbruikbaar. Of dit een technische reden is of een bewuste overgangsstrategie naar de 5e generatie kan niet met zekerheid worden gezegd. In feite verliest het model echter zijn vroegere kracht en worden gebruikers indirect gedwongen om naar de nieuwe versies te gaan, die strenger gereguleerd zijn. - Betekent deze ontwikkeling dat cloud-AI in de toekomst minder nuttig zal worden?

Cloud AI blijft krachtig, maar zal in toenemende mate worden gekenmerkt door regelgeving, nalevingsregels en politieke druk. Dit betekent dat het technisch indrukwekkend zal blijven, maar dat het voorzichtiger, meer gefilterd en minder vrij zal worden qua inhoud. Voor veel creatieve, analytische of onconventionele taken is dit een duidelijk nadeel, waardoor steeds meer gebruikers op zoek gaan naar alternatieven. - Waarom gebruiken AI-bedrijven eigenlijk zoveel beveiligingsmechanismen?

De reden ligt in de optelsom van regelgeving, aansprakelijkheidsrisico's en publieke perceptie. Elke fout, elk misleidend antwoord van een AI kan juridische of mediagevolgen hebben voor een bedrijf. Om dergelijke risico's uit te sluiten, implementeren leveranciers uitgebreide filters en richtlijnen die bedoeld zijn om alle antwoorden „veilig te stellen“. Dit beschermingsmechanisme is begrijpelijk vanuit het perspectief van het bedrijf, maar is vaak een belemmering vanuit het oogpunt van de gebruiker. - Wat is het fundamentele verschil tussen lokale AI en cloud-AI?

Lokale AI draait volledig op het eigen apparaat van de gebruiker en is daarom niet gebonden aan politieke eisen of bedrijfsrichtlijnen. Het filtert nauwelijks, geeft geen instructies en werkt direct volgens de specificaties van de gebruiker. Bovendien blijven alle gegevens op de eigen computer van de gebruiker. Dit geeft de gebruiker niet alleen meer vrijheid, maar ook meer privacy en controle. - Is er speciale hardware nodig om lokale AI te gebruiken?

In de meeste gevallen niet. Moderne lokale modellen zijn verbazingwekkend efficiënt en draaien al op typische Macs met M chips of op standaard Windows computers. Natuurlijk hebben grotere modellen baat bij meer RAM of een GPU, maar voor veel alledaagse taken voldoen kleine tot middelgrote modellen prima zonder dat er dure gespecialiseerde hardware nodig is. - Hoe werkt de installatie van lokale AI op de Mac in de praktijk?

De eenvoudigste manier om dit te doen is met Ollama. Je downloadt een installatiepakket, opent het en kunt meteen aan de slag. Zelfs het klassieke terminalcommando is optioneel geworden. Zodra Ollama installiert, kun je een model starten met een eenvoudig commando zoals „ollama run llama3“. De drempel is net zo laag als vroeger bij het installeren van een normaal programma. - Hoe stel je lokale AI in op Windows?

Onder Windows wordt ook het Ollama installatieprogramma gebruikt, dat geen extra voorbereiding vereist. Na de installatie kunnen de modellen onmiddellijk worden uitgevoerd. Als u liever een grafische gebruikersinterface gebruikt, kunt u LM Studio of OpenWebUI gebruiken, die net zo gemakkelijk te gebruiken zijn als standaard applicatiesoftware. - Welke modellen zijn bijzonder geschikt voor beginners?

Veel gebruikers beginnen succesvol met Llama 3 omdat het nauwkeurig, veelzijdig en taalkundig sterk is. Even populair is Phi-3, dat ondanks zijn kleine model indrukwekkende resultaten levert. Gemma is ook een goede keuze, vooral voor creatief of tekstintensief werk. Deze modellen werken snel en stabiel zonder dat je er lang aan moet wennen. Als je meer middelen hebt, zijn GPT-OSS 20B of 120B zeer goede keuzes. - Kunnen lokale modellen echt concurreren met GPT-4 of GPT-5?

Ze kunnen dit verrassend goed voor veel alledaagse taken. De kloof bestaat nog steeds voor zeer gespecialiseerde onderwerpen, maar wordt snel kleiner. Lokale modellen hebben het voordeel dat ze minder beperkt zijn en directer reageren. Over het algemeen komen ze daardoor vrijer en natuurlijker over, ook al zijn ze technisch wat kleiner. - Is lokale AI veiliger bij het verwerken van gevoelige gegevens?

Ja, zeker weten. Omdat alle verwerking op je eigen apparaat plaatsvindt, verlaten de gegevens die je invoert nooit je computer. Er is geen verwerking in de cloud, geen opslag op externe servers en geen analyse door derden. Dit is een doorslaggevend voordeel, vooral voor zakelijke documenten, vertrouwelijke documenten of privénotities. - Kan lokale AI worden gebruikt zonder internetverbinding?

Ja, dat is een van de grootste voordelen. Zodra het model installiert is geïnstalleerd, kan het volledig offline worden gebruikt. Dit verandert de computer in een zelfvoorzienende werkomgeving waarin je onafhankelijk van externe diensten kunt werken. Dit is vooral handig op reis, in beveiligde netwerken of in omgevingen waar gegevensbescherming een topprioriteit is. - Hoe geschikt zijn lokale modellen voor lange teksten?

De meeste moderne modellen kunnen tegenwoordig zonder problemen lange artikelen, analyses of concepten aan. Ze zijn niet zo gepolijst als GPT-5, maar zijn vrijer van filters en zijn vaak directer in hun stijl. Ze zijn zeer geschikt voor uitgebreide teksten, verzamelingen van ideeën of technische documentatie en maken productief werken zonder beperkingen mogelijk. - Hebben lokale modellen wel veiligheidsfilters?

Er is meestal een bepaald niveau van basisbeveiliging beschikbaar, hoewel dit aanzienlijk zwakker is dan bij cloud-AI. Omdat de modellen op het eigen apparaat van de gebruiker draaien, kan deze zelf bepalen welke beperkingen zinvol zijn. Deze ontwerpvrijheid zorgt ervoor dat lokale AI veel flexibeler en minder betuttelend is. - Hoe kun je verschillende modellen testen of vergelijken?

Ollama, LM Studio of OpenWebUI maken het wisselen van model heel eenvoudig. U kunt meerdere install-modellen naast elkaar gebruiken, tussen ze wisselen en hun sterke punten vergelijken. Dit resulteert in een persoonlijke set favoriete modellen die precies passen bij uw eigen werkstijl. Het proces is eenvoudig en doet meer denken aan het testen van verschillende apps dan aan klassiek AI-onderzoek. - Wat zijn de voordelen van lokale modellen voor bedrijven?

Bovenal profiteren bedrijven van volledige gegevenssoevereiniteit, want geen cloud betekent geen externe opslag. Langdurige afhankelijkheid van externe services en dure abonnementen vallen ook weg. Modellen kunnen intern worden aangepast, uitgebreid of zelfs getraind. Integratie in bestaande processen is vaak eenvoudiger omdat u de volledige controle behoudt en niet gebonden bent aan externe infrastructuur. - Kunnen lokale modellen individueel worden getraind?

In feite is dit een van de belangrijkste voordelen. Met technieken zoals LoRA of fine-tuning kunnen modellen worden aangepast aan de eigen inhoud, processen of documenten van het bedrijf. Zo ontstaat een persoonlijke kennisbank die uitsluitend intern wordt gebruikt en ontwikkeld zonder dat gevoelige gegevens het bedrijf verlaten. - Wat zijn de kwalitatieve verschillen tussen de huidige lokale modellen?

Elk model heeft zijn eigen karakter. Llama 3 is heel precies en evenwichtig, Gemma is creatief en taalkundig soepel, Phi-3 verrast met zijn efficiëntie en intelligentie, terwijl Mistral en Qwen analytisch bijzonder sterk zijn. Deze rijkdom aan varianten maakt het mogelijk om het juiste model voor je eigen behoeften te kiezen en flexibel te schakelen wanneer een taak dat vereist. - Kunnen lokale modellen ook afbeeldingen genereren?

Ja, beeldgeneratoren zoals Stable Diffusion kunnen volledig lokaal worden uitgevoerd met hulpmiddelen zoals OpenWebUI. De resultaten hangen af van de beschikbare hardware, maar zelfs met matige middelen kunnen solide afbeeldingen worden gegenereerd. Het voordeel blijft hetzelfde: er worden geen gegevens naar externe services gestuurd. - Voor wie is de overstap naar lokale AI vooral de moeite waard?

Local AI is ideaal voor gebruikers die zelfverzekerd en onafhankelijk willen werken. Hieronder vallen auteurs, ontwikkelaars, onderzoekers, ondernemers en iedereen die gevoelige informatie verwerkt of creatieve processen zonder filters wil ervaren. Iedereen die controle, gegevensbescherming en vrijheid belangrijk vindt, zal de juiste oplossing vinden in lokale modellen en een werkomgeving herwinnen die in de cloud niet meer bestaat.