Každý, kdo dnes pracuje s umělou inteligencí, je téměř automaticky odsunut do cloudu: OpenAI, Microsoft, Google, jakákoli webová uživatelská rozhraní, tokeny, limity, podmínky. Zdá se to být moderní - ale v podstatě jde o návrat k závislosti: jiní určují, které modely smíte používat, jak často, s jakými filtry a za jakou cenu. Záměrně jdu opačnou cestou: v současné době si doma buduji vlastní malé studio umělé inteligence. S vlastním hardwarem, vlastními modely a vlastními pracovními postupy.

Můj cíl je jasný: lokální textová AI, lokální obrazová AI, učení vlastních modelů (LoRA, dolaďování) a to vše tak, abych jako freelancer a později i zákazník SME nebyl závislý na každodenních rozmarech nějakého poskytovatele cloudu. Dalo by se říci, že je to návrat ke starému přístupu, který býval zcela běžný: „Důležité věci si děláš sám“. Jenže tentokrát nejde o vlastní pracovní stůl, ale o výpočetní výkon a suverenitu dat.

Rychlost zůstává na místní úrovni bezkonkurenční

Cloudové modely jsou působivé - pokud je linka v provozu, servery nejsou přetížené a rozhraní API není opět přiškrceno. Ale každý, kdo vážně pracuje s umělou inteligencí, si rychle uvědomí, že nejpoctivější forma rychlosti je lokální. Pokud model běží na vašem vlastním Mac Studiu nebo na vašem vlastním GPU, pak je to pravda:

- Žádné zpoždění sítě

- Žádné čekání na to, až budou připraveni „ostatní“.

- Žádné rušení hodin

- Žádné „Rate limit reached“ uprostřed pracovního postupu

Zažívám to každý den: na svém Mac Studio paralelně provozuje 120B model (GPT-OSS) a 27B model Gemma - plus FileMaker server a všechny mé databáze. Přesto systém zůstává tak svižný, že mohu pracovat rychlostí, které je u cloudových systémů téměř nemožné dosáhnout. Zvláště když provádíte mnoho drobných operací za sebou - překlady, reformulace, analýzy, obrazové podněty - zpoždění se rychle sčítají. Místní UI nepůsobí jako „serverový provoz“, ale jako přímý nástroj: stisknete, stane se.

Suverenita dat: když citlivé informace nepatří na internet

Jeden bod, který se často opomíjí, ale pro podnikatele je zásadní: data. Jakmile začnete používat cloudovou umělou inteligenci, nevyhnutelně si budete klást otázky:

- Mohu tam zadávat údaje o zákaznících?

- Co se stane s interními dokumenty?

- Jak dlouho se protokoly uchovávají?

- Kdo má teoreticky přístup - dnes a za dva roky?

- Jaké právní důsledky by měl únik informací?

Velcí poskytovatelé samozřejmě slibují ochranu dat. Nakonec však předáváte svůj obsah. A to je přesně to, čemu jste se v minulosti chtěli ve své vlastní firmě vyhnout: Interní věci zůstaly interní. V místním studiu umělé inteligence je situace jiná:

- Data zůstávají ve vaší síti.

- Žádná žádost neopustí dům.

- Modely běží bez přístupu k internetu.

- Protokoly, tréninková data a průběžné výsledky jsou uloženy na vlastních discích.

Až budu v budoucnu procházet své knihy, články, poznámky, PR texty, interní strategické dokumenty nebo data o zákaznících přes svou umělou inteligenci, chci mít jistotu, že nic z toho neskončí v tréninkové sadě někoho jiného. Tuto důvěru mohu mít pouze tehdy, pokud infrastruktura patří mně.

Kontrola nákladů namísto plíživého předplatného

Cloudové umělé inteligence se na první pohled zdají být levné: pár centů za 1 000 tokenů, měsíční předplatné tady, malý tarif tam. Problém je v tom, že náklady rostou s vaší úspěšností. Čím jste produktivnější, tím je infrastruktura dražší - každý měsíc. Místní umělá inteligence funguje jinak:

- Do hardwaru investujete jednou.

- Pak modely spouštějte tak často a tak často, jak chcete.

- Žádné „třesoucí se prsty při objednávání“, protože každý hovor stojí peníze.

- Můžete volněji experimentovat, aniž byste museli počítat každý vstup.

Svou RTX 3090 jsem koupil z druhé ruky za přibližně 750 eur - prakticky jako novou. Mac Studio se 128 GB RAM jsem pořídil za zhruba 2 750 eur, v originálním balení a nikdy neotevřené. To jsou peníze, to ano - ale:

- Tyto stroje mě budou provázet mnoho let.

- Vytváříte přímo použitelné zdroje: knihy, články, obrázky, LoRA, pracovní postupy.

- Kromě elektřiny jim nevznikají žádné další měsíční náklady.

Pro vydavatele, konzultanta, vývojáře nebo malou společnost to může znamenat rozdíl mezi „Musíme si spočítat, zda si to můžeme dovolit“ a „Použijeme AI, až ji budeme potřebovat“.

Staré ctnosti, nové výhody: Proč se opět vyplatí vlastnit vlastní stroje?

V minulosti se považovalo za samozřejmé, že řemeslník má ve své dílně dobré nářadí. Truhlářská dílna bez pořádného pracovního stolu a pil by byla nemyslitelná. Dnes jsme si zvykli na opak: místo vlastních strojů si najímáme služby. Vlastní truhlářská dílna není v podstatě nic jiného než moderní verze klasické dílny:

- Na stránkách Mac Studio je ústředním nástrojem pro jazykové modely.

- Na stránkách Grafická karta RTX je frézka pro snímky a školení.

- A Další počítač (např. Mac mini) přebírá speciální úlohy, jako je hlasová komunikace nebo malé modely.

- Software jako FileMaker slouží jako řídicí panel: organizuje, ukládá a dokumentuje.

Stavím si takovou sestavu, protože chci být schopen dlouhodobě dělat všechno sám:

- Psaní a překládání knih,

- Generování série obrázků,

- trénovat vlastní modely LoRA,

- Automatizujte pracovní postupy,

- a později také nabízet zákaznická řešení, která mohou běžet zcela lokálně.

Nejde o nostalgii, ale o střízlivé rozhodnutí: čím hlouběji zasahuje umělá inteligence do každodenního života, tím rozumnější je udržet si nad touto technologií kontrolu. Místní AI není „hobbystickou alternativou“ k módnímu cloudu, ale vědomým návratem k nezávislosti:

- Získáte rychlost.

- Svá data si ponecháte.

- Své náklady máte pod kontrolou.

- Vybudujete infrastrukturu, která vám patří.

Když to domyslíte do konce, domácí studio umělé inteligence se stále více podobá klasické, dobře vybavené dílně: Nespoléháte se na to, co dělají ostatní někde v pozadí, ale budujete si vlastní stabilní základnu.

Aktuální průzkum místních systémů umělé inteligence

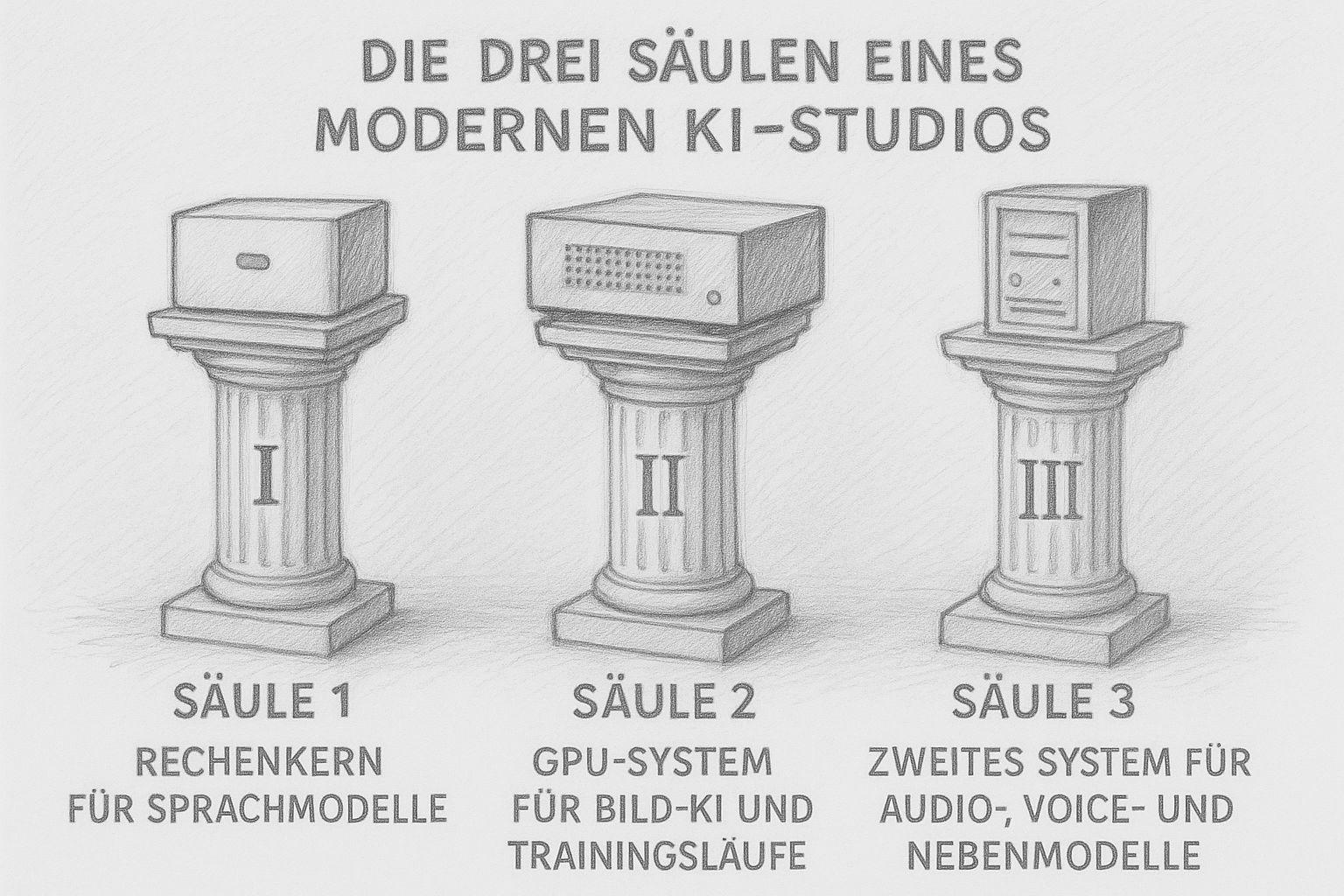

Tři pilíře moderního studia umělé inteligence

Dnes už studio umělé inteligence netvoří „jeden velký počítač“, který dělá všechno. Moderní pracovní postupy potřebují různé síly: výpočetní výkon pro texty, spoustu VRAM pro obrázky a tréninkové běhy a menší systémy, které se postarají o vedlejší úkoly. Výsledkem není chaotická flotila zařízení, ale promyšlená malá infrastruktura - jako v minulosti dobře vybavená dílna, kde každý stroj plní svůj účel.

Sám buduji svůj ateliér přesně podle tohoto principu. A čím hlouběji se do této problematiky nořím, tím je to jasnější: Tři pilíře stačí k provozování kompletní lokální výroby umělé inteligence.

Pilíř 1: Výpočetní jádro pro jazykové modely (LLM)

Velké jazykové modely dnes již nevyžadují server datového centra, ale především jednu věc: hodně rychlou paměť RAM. Přesně to dokáží moderní systémy Apple-Silicon nebo podobně vybavené linuxové stroje s velkým množstvím paměti RAM. Výpočetní jádro je středobodem studia. Právě zde běží:

- Velké LLM (20B, 30B, 70B, 120B MoE...)

- Analytické modely

- Modely překladu

- Interní Znalostní systémy (neo4j, RAG)

- také dlouhodobý Paměť s podporou umělé inteligence

- Řídicí systémy jako je n8n

- FileMaker-Automatizační a serverové procesy

V mé sestavě tuto roli zastává Mac Studio M1 Ultra se 128 GB RAM. A dělá to úžasně dobře. Spouštím na něm:

- GPT-OSS 120B MoE (pro hluboké myšlení, dlouhé texty a analýzy)

- Gemma-3 27B (pro technickou práci, jako je FileMaker, kód, přesné strukturování)

- FileMaker Server + databáze

- a celou infrastrukturu shellu a webového serveru

Neuvěřitelné je, že i při dvou velkých modelech současně zůstává volných 10-15 GB paměti RAM. To je výhoda architektury, která je kompletně navržena pro sjednocenou paměť. Zjednodušeně řečeno: výpočetní jádro je mozkem studia AI. Zde se odehrává vše, co chápe, generuje nebo transformuje text.

Pilíř 2: Systém GPU pro obrazovou umělou inteligenci a tréninkové běhy

Druhým pilířem je pracovní stanice s GPU, optimalizovaná pro trénink stabilní difúze, ComfyUI, ControlNet a LoRA. Zatímco textové modely vyžadují především paměť RAM, obrazová umělá inteligence potřebuje paměť VRAM. A to hodně. Proč? Protože obrazové modely přehazují přes paměť gigantické množství dat na jeden snímek. A na to jsou grafické karty stavěné. V mém studiu se o to stará NVIDIA RTX 3090 s 24 GB VRAM - a těchto 24 GB má cenu zlata. Umožňují totiž:

- SDXL s přiměřenou velikostí dávky

- Pracovní postupy ComfyUI

- Syntéza videa

- Série obrázků

- Školení o materiálu a stylu

- Trénink LoRA s rozlišením 896×896 nebo dokonce 1024×1024

Pro obrazovou umělou inteligenci je paměť VRAM důležitější než nejnovější čip. Solidní 3090 toho dnes zvládne více než drahé karty střední třídy z roku 2025. Kolona GPU je tedy „těžkým vybavením“ ve studiu - frézou, která odpiluje vše, co znamená výpočetní zátěž. Bez ní je seriózní tvorba snímků jen stěží možná.

Pilíř 3: Druhý systém pro audio, hlas a sekundární modely

Třetí pilíř se může zdát nenápadný, ale je klíčový: menší, energeticky účinný systém, který přebírá sekundární úkoly. Mezi ně patří:

- TTS (převod textu na řeč)

- STT (přepis)

- menší modely (4B, 7B, 8B, 14B)

- statické Základní procesy

- malé Agentské systémy

- Nástroje, které chcete provozovat odděleně od hlavního systému.

Používám malý Mac mini M4 s 32 GB RAM. Perfektně se hodí pro:

- Whisper-Přepis

- Hlas-modely

- světlo Optimalizační modely

- rychlá reakce Asistenti

- Experimenty a Zkušební jízdy

- paralelní Modelový kontejner

Tím se hlavnímu systému velmi uleví. Koneckonců nemá smysl načítat velké modely pro každou malou úlohu. Stejně jako jste dříve v dílně na každý řez nezapínali velkou kotoučovou pilu, ale používali místo ní malý stroj. Třetí pilíř zajišťuje organizaci a stabilitu.

Odděluje velké modely od malých úkolů - a díky tomu je celé studio odolné, flexibilní a bezpečné.

Inteligentní rozdělení pracovních zátěží

Studio AI prosperuje díky tomu, že každý stroj dělá to, k čemu byl zkonstruován. Výsledkem je logický řád:

- Výpočetní jádro → Přemýšlení, psaní, překládání, analyzování

- Systém GPU → Obrázky, výukové modely, ComfyUI, video

- Subsystém → Zvuk, hlas, malé modely, agenti

Po přidání dalšího softwaru - například FileMaker jako mého centrálního řídicího systému - se vytvoří skutečný výrobní okruh. Už žádný chaos, žádné „podíváme se, kde je ještě místo“, ale organizovaný systém, který běží stabilně každý den.

Tři pilíře jsou základem - ne volným stylem.

Mnoho lidí se domnívá, že studio umělé inteligence potřebujete až ve chvíli, kdy se stanete „společností s umělou inteligencí“. Ve skutečnosti je opak pravdou: solidní AI studio JE základem pro to, abyste se jím stali. Díky těmto třem pilířům máte vše, co potřebujete:

- Vytváření obsahu (text a obrázek)

- Výuka vlastních modelů

- Automatizace pracovních postupů

- Práce nezávisle na cloudu

- vyvíjet vlastní řešení pro zákazníky

- dlouhodobě provozovat digitální „pracovní stoly“.

Pro podnikatele, tvůrce, samovydavatele a vývojáře je to nyní strategické rozhodnutí, které jim zajistí svobodu, rychlost a dlouhodobou kontrolu.

Rozumný základní hardware pro malé AI studio

Pokud dnes sledujete reklamy, můžete si myslet, že musíte neustále kupovat nejnovější hardware, abyste mohli pracovat s umělou inteligencí na místě. Často je to však naopak: rozhodující nejsou nejnovější modely, ale správná kombinace paměti RAM, VRAM a stability. Mnohá starší zařízení - zejména v oblasti GPU - jsou dnes skutečnými monstry v poměru cena/výkon. A pokud jste ochotni přemýšlet jinak, můžete vybudovat studio s UI, které bude dělat čest malé firmě, aniž byste se finančně přehnali. Přesně to teď dělám já sám a funguje to překvapivě dobře. Tato kapitola vám ukáže tři třídy hardwaru: Začátečník, Standard a Profesionál. A samozřejmě také vysvětluji, proč jsou dnes některé starší systémy cennější, než si možná myslíte.

1. základní třída (1500-2500 €)

Pro všechny, kteří chtějí začít na místě - bez velkých investic. V této třídě se dozvíte, jak udělat první solidní kroky:

- Mac mini M2 nebo M4 s 16-32 GB RAM

- nebo PC s RTX 3060/3070 (12-16 GB VRAM)

- a volitelně malý NAS nebo externí SSD

To je dobrý způsob, jak:

- Provoz modelů 7B až 14B

- Provádět místní překlady

- Běh Whisper

- Použijte menší obrazové modely, například SD 1,5/2,1

- Vyzkoušejte ComfyUI ve zmenšené podobě

- Testování vlastních agentů nebo pracovních postupů

Pro mnoho kreativních lidí nebo osob samostatně výdělečně činných je to více než dost, aby se stali produktivními. Důležité je, abyste si začátky příliš nekomplikovali. Největším nebezpečím není mít příliš málo výkonu - ale zabřednout do příliš mnoha technických detailů. Například s počítačem Mac mini M4 toho zvládnete neuvěřitelně mnoho: Překlady, výzkum, strukturu, dokonce i menší modely psaní - a to s minimální spotřebou energie.

2. standardní třída (2500-4000 €)

Sladké místo pro seriózní práci s texty a obrázky. Zde začíná to, co bych nazval “skutečným AI studiem“: nastavení, které zvládne jak velké textové modely, tak pevné obrazové modely. Typická kombinace:

- Mac Studio M1 Ultra nebo M2 Max s 64 GB RAM

- Pracovní stanice PC/GPU s RTX 3080, 3090 nebo 3090 Ti

- volitelně malý Další počítač pro zvuk nebo hlas

V této třídě můžete:

- Spolehlivý pohon modelů 20-40B

- Použijte Stable Diffusion XL v dobré kvalitě

- Proveďte trénink LoRA ve středním rozsahu datových sad

- Distribuce paralelních pracovních zátěží na více zařízení

- Nastavení automatizace (např. prostřednictvím FileMaker)

A to odhaluje zajímavou pravdu: starší GPU, jako je RTX 3090, stále rozbíjejí mnoho nových karet střední třídy. Proč? Mají více VRAM (24 GB), zatímco nové karty byly často vykastrovány. Mají široké paměťové rozhraní, ideální pro modely s velkým rozšířením. Mají vyspělé a stabilní ovladače CUDA. Často se prodávají jako použité za úžasné ceny. Karta 3090 dokáže za 700-900 EUR použitá více než současná 4070 nebo 4070 Ti za 1100 EUR - jednoduše proto, že VRAM a paměťová konektivita jsou důležitější než pár procent hrubého výkonu.

3. profesionální třída (4000-8000 €)

Pro všechny, kteří to s výrobou myslí vážně - a usilují o naprostou nezávislost. V této třídě je k dispozici skutečný výrobní výkon. Typické nastavení:

- Mac Studio M1 / M2 / M3 Ultra se 128 GB RAM nebo více

- Systém PC-GPU s RTX 3090 nebo 4090

- jeden druhý počítač pro audio/agenty

- Volitelný server FileMaker jako automatizační centrum

To vám umožní:

- Plynulé používání modelů 70B

- Stabilní provoz modelů MoE, jako je GPT-OSS 120B

- Koordinace paralelních agentů AI

- SDXL, video AI, ComfyUI pracující na plný výkon

- Spouštění školení LoRA s rozlišením 896×896 nebo 1024×1024

- Připravte si vlastní databáze pro školení

- Mapujte kompletní potrubí (nápovědy → obrázky → PDF → knihy)

A tady je vidět to nejzajímavější: nejlepší hardware s umělou inteligencí v roce 2025 často používá prémiový hardware z let 2020-2022. Proč? Protože byl tehdy vyvinut pro špičkové pracovní zátěže. Dnes je za zlomek ceny. Technologie je vyspělá. Žádné problémy s beta ovladači. Má přesně ty vlastnosti, které AI potřebuje: spoustu VRAM, široké paměťové sběrnice, stabilní tenzorová jádra.

Proč selháváte s příliš malou pamětí VRAM - a ne s příliš malým výkonem GPU

Tento bod mnozí podceňují: VRAM je rozhodujícím faktorem pro umělou inteligenci obrazu, nikoliv čistý výkon. Příklady:

- Jeden RTX 4060 (8 GB VRAM) je pro SDXL prakticky nepoužitelný.

- Jeden RTX 4070 Ti (12 GB VRAM) je pro trénink jen nespolehlivě dostačující.

- Jeden RTX 3090 (24 GB VRAM) naopak běží plynule po celé roky.

Stručně řečeno: velké modely potřebují paměť - ne marketing. A paměť je to, co starší karty vyšší třídy mají a nové karty střední třídy ne.

Jak modulárně rozšířit studio umělé inteligence

Největší výhodou třísloupového studia je jeho modularita:

- Pracovní stanici s GPU lze upgradovat nezávisle.

- Mac Studio si můžete ponechat několik let.

- Podřízený počítač můžete vyměnit bez narušení systému.

- Pevné disky nebo disky SSD můžete rozšířit samostatně.

- Jako orchestraci můžete použít FileMaker, Python nebo Bash.

Je to jako dílna: Nebudujete všechno najednou, ale jen to, co je v danou chvíli potřeba.

Místní umělá inteligence je nyní skutečně použitelná (a běží na tomto hardwaru) | c't 3003

Doporučení pro rok 2025 - Tento hardware se opravdu vyplatí

V džungli reklam a specifikací je snadné ztratit přehled. Pro použití UI v domácnosti nebo malém studiu však existují třídy hardwaru, které budou v roce 2025 obzvláště užitečné - nabízejí totiž dobrý poměr ceny a výkonu, jsou robustní a postačují současným modelům. Na čem dnes záleží:

- Dostatečná paměť VRAM (pro úlohy GPU): Pro umělou inteligenci obrazu, tréninkové běhy, stabilní difúzi atd. by grafická karta měla mít alespoň 16 GB, nejlépe 24 GB VRAM. Nad touto hranicí se obrazová AI stává pohodlnou a stabilní.

- Dobrá pracovní paměť a kapacita RAM (pro studenty LLM): Pro velké LLM, multitasking se serverovými službami a paralelní procesy má smysl mít co nejvíce RAM - ideálně 64-128 GB pro Apple-Silicon.

- Stabilní, osvědčený hardware namísto nejnovějšího marketingového zbožíZejména starší high-endové karty mají často vynikající specifikace (VRAM, paměťová sběrnice, vyspělost ovladačů) za mírnou cenu.

- Modularita a míchání místo monoblokuKombinace počítače LLM, pracovní stanice s GPU a sekundárního/agentního systému je flexibilnější a odolnější než jediný stroj „vše v jednom“.

| Třída | Typické součásti | Vhodné pro koho | Silné stránky / kompromisy |

|---|---|---|---|

| Vstupní úroveň (cca 1 500-2 500 €) | Mac mini (16-32 GB RAM) nebo PC s GPU (např. RTX 3060 / 3060 Ti / 4060 Ti s ≥ 12-16 GB VRAM) | Hobby, první pokusy, malé modely, zvládnutelný obraz AI | Příznivá vstupní úroveň, dostatečná pro menší LLM, lehké stabilní difúzní pracovní postupy a audio/textovou AI. Omezení u velkých modelů, složitých pipeline ComfyUI a tréninku LoRA. |

| Standardní (cca 2 500-4 000 €) | Pracovní stanice s GPU střední třídy (např. s RTX 3080 nebo RTX 3090), počítač s 64 GB RAM | Kreativci, samovydavatelé, ambiciózní uživatelé AI, malé týmy | Solidní výkon pro text a obrázky, dobrý poměr cena/výkon. Dostatečná paměť VRAM a RAM pro všestranné využití AI, včetně SDXL a počátečního tréninku LoRA. Při extrémních projektech nebo mnoha paralelních pracovních postupech systém v určitém okamžiku dosáhne svých limitů. |

| Profesionální / studiové (cca 4 000-8 000 €) | Systém s velkým množstvím paměti (např. Mac Studio se 128 GB RAM nebo výkonná pracovní stanice s Linuxem) + GPU s ≥ 24 GB VRAM (např. RTX 3090, 4090) + samostatný sekundární/agentní systém. | Svobodní povolání, vydavatelé, mediální produkce, vývojáři s více projekty, malá studia umělé inteligence. | Maximální flexibilita, velké modely (70B, MoE), paralelní obrazová a textová AI, automatizace a dlouhodobé pracovní postupy. Velmi perspektivní, ale vyšší počáteční investice a o něco větší nároky na plánování při nastavování. |

Proč jsou dnes použité a starší grafické procesory vyšší třídy často lepší než nové karty střední třídy?

Mnoho novějších karet je nabízeno s omezenou pamětí VRAM - ta je však pro umělou inteligenci klíčová. Starší špičkové modely, jako je RTX 3090, často nabízejí 24 GB VRAM, což je dnes velmi cenné pro SDXL, trénink LoRA nebo video AI. Hardware byl původně navržen pro výkon a stabilitu - s kvalitními komponenty, paměťovou sběrnicí, chlazením a dobrou podporou ovladačů.

To znamená: často je k dispozici dlouhá životnost a robustní výkon. Použité karty jsou často výrazně levnější, a proto cenově velmi dostupné - ideální pro nezávislé pracovníky nebo malá studia s omezeným rozpočtem.

Moje aktuální doporučení pro rok 2025 (a proč)

Kdybych dnes stavěl studio a neusiloval o maximální výkon superpočítače, rozhodl bych se:

- Pro obrazovou umělou inteligenciAlespoň jeden grafický procesor s 24 GB VRAM - např. RTX 3090 nebo 4090.

- Pro text/LLM128 GB RAM ve výkonném systému Apple-Silicon.

- Pro práci na částečný úvazek (zvuk, hlas, malé modely, automatizace): malý samostatný počítač (např. mini PC nebo levný server).

- Pro koordinaci: softwarová vrstva - pro mě je to FileMaker, pro ostatní to může být jednoduchý shell nebo pipeline v Pythonu.

Toto nastavení není přehnané, není závislé na drahých cloudových licencích - a postačí téměř na vše, co lze v roce 2025 s umělou inteligencí v kreativním, publikačním nebo vývojovém odvětví dělat.

Hardware pro umělou inteligenci nemusí být nový, ale vhodný.

Dnes končí doba, kdy byla „umělá inteligence“ pouze záležitostí velkých korporací nebo cloudových laboratoří. Do roku 2025 si může téměř každý - s přijatelným rozpočtem a trochou technických znalostí - založit vlastní malé studio AI. Stane se tak nezávislým na drahých měsíčních předplatných, podmínkách ochrany dat třetích stran, frontách, úzkých hrdlech serverů a nejistotě, jak dlouho budou cloudové služby ještě existovat. Místo toho získáte:

- Plná kontrola o vašich datech a pracovních postupech,

- stabilní, rychlé a Škálovatelný výkon,

- jeden Udržitelné investice, která vydrží roky,

- a Freedom, být kreativní, kdy chcete a jak chcete - bez vnějších omezení.

Pokud tedy uvažujete o použití umělé inteligence pro své knihy, texty, obrázky nebo projekty, je výhodnější než kdy jindy založit si vlastní studio. Nemusíte být hardwarovým inženýrem. Nepotřebujete obrovský rozpočet. Nepotřebujete nejnovější hardware.

Především potřebujete mít jasnou představu o cíli, ke kterému směřujete, a vůli udržet si kontrolu nad vlastními procesy.

Ukážu vám, jak nastavit místní LLM s Ollama na Macu installier v. tento článek.

Zde najdete srovnání Apple MLX na Silicon vs. NVIDIA.

Jak pracovat s Qdrant místní paměť pro místní AI naleznete zde.

Často kladené otázky

- Proč vůbec stojí za to mít vlastní studio AI, když existuje tolik poskytovatelů cloudových služeb?

Vlastní studio umělé inteligence je nezávislejší, stabilnější a dlouhodobě levnější. Cloudové služby jsou pohodlné, ale stojí každý měsíc peníze, vytvářejí závislost a často jsou omezeny omezeními používání. Místní AI je rychlá, trvale dostupná a lze ji používat bez variabilních nákladů. Všechna data navíc zůstávají ve firmě, což je obrovská výhoda pro živnostníky, firmy, vydavatele nebo tvůrčí profese. - Jaký minimální hardware potřebuji, abych mohl začít pracovat s AI na místní úrovni?

Pro začátek vám postačí Mac mini s 16-32 GB RAM nebo PC s GPU s alespoň 12 GB VRAM. To vám umožní spouštět malé jazykové modely, lehké obrazové modely a počáteční automatizace. Pokud si to chcete jen vyzkoušet, nemusíte investovat několik tisíc eur. - Opravdu potřebuji Mac Studio, nebo je levnější?

Rozhodně je to levnější. Mac Studio se vyplatí, pokud chcete provozovat velké jazykové modely (20-120B), pracovat hodně paralelně nebo máte dlouhodobé výrobní procesy. Pro vaše první kroky je Mac mini nebo solidní počítač s Windows naprosto dostačující. Studio je investicí do pohodlí a budoucnosti - ale ne nutností. - Proč je paměť VRAM pro umělou inteligenci obrazu důležitější než moderní generace grafických karet?

Protože obrazové modely, jako je stabilní difúze, přenášejí do paměti obrovské množství dat. Pokud paměť VRAM nestačí, proces se zastaví nebo je extrémně pomalý. Starší karta, jako je RTX 3090 s 24 GB VRAM, často překonává nové modely střední třídy s pouhými 8-12 GB VRAM - jednoduše proto, že nabízí více prostoru pro velké modely a tréninkové běhy. - Mohu spustit studio AI kompletně s hardwarem Apple bez NVIDIA?

Pro jazykové modely ano. Pro obrazovou umělou inteligenci ne. Apple-Silicon je extrémně efektivní pro LLM, ale pro stabilní difúzi, trénování LoRA a mnoho obrazových modelů jsou karty NVIDIA (díky CUDA/Tensor jádrům) stále referenční. Mnoho studií proto pro snímky používá kombinaci Apple/LLM a Linux+NVIDIA. - Je RTX 4080 nebo 4070 Ti dostatečná i pro obrazovou AI?

Teoreticky ano - v praxi záleží na zamýšleném použití. Pro jednoduché snímky nebo malé pracovní postupy to stačí. Ale pro SDXL, složité pipeline ComfyUI nebo školení LoRA dosáhne limit 12-16 GB VRAM rychle svých hranic. RTX 3090 nebo 4090 proto dává z dlouhodobého hlediska větší smysl. - Proč se jazykové modely nespouštějí na GPU, ale v paměti RAM?

Jazykové modely jsou orientovány na paměť. Potřebují uchovávat velké množství textu a kontextu v paměti RAM, nikoli nutně provádět grafické operace. Grafické procesory jsou konstruovány pro zpracování obrazu, ne pro analýzu textu. Proto mají systémy LLM obrovský prospěch z velkého množství paměti RAM, ale menší z paměti VRAM. - Kolik paměti RAM by měl mít počítač LLM?

U menších modelů postačí 32-64 GB. Pro středně velké modely (20-30B) je ideální 64-128 GB. Pro velké modely, jako je 70B, nebo modely MoE, jako je GPT-OSS 120B, je ideální 128-192 GB RAM. Čím více paměti RAM, tím stabilněji a rychleji vše běží. - Je možné provozovat studio umělé inteligence zcela bez Linuxu?

Ano - ale s omezeními. macOS je ideální pro LLM, ale pro obrazovou AI mu chybí některé nástroje, které existují pouze v Linuxu/NVIDIA. Windows funguje dobře pro obrazovou AI, ale je méně stabilní a obtížněji se automatizuje. Pragmatický mix je tedy často následující: MacOS → LLM, Linux → obrazová AI, malý počítač → audio/skripty. - Jak hlasité je takové studio AI v provozu?

Méně, než si myslíte. Mac Studio je prakticky bezhlučné. U linuxového počítače záleží na chlazení - kvalitní GPU jsou při nízké zátěži tiché, ale při tréninkovém běhu mohou být slyšet. Pokud dáváte přednost tichým sestavám, můžete použít pracovní stanice s vodním chlazením GPU. - Jakou roli hraje Mac mini jako třetí součást?

Slouží jako sekundární stanice pro přepis, TTS, malé modely AI, procesy na pozadí, automatizaci a sekundární úlohy pro překlady. Díky tomu jsou dva velké stroje volné a je zajištěn stabilní pracovní postup. Třetí počítač není nezbytně nutný, ale vytváří řád a spolehlivost. - Mohu své studio AI postupně rozšiřovat?

Rozhodně. To je vlastně ideální případ. Koupě systému LLM, následné přidání pracovní stanice s GPU a později malého sekundárního počítače - to je velmi přirozená sestava, kterou lze rozložit na měsíce nebo roky. Studia umělé inteligence rostou stejně jako tradiční dílny. - Které operační systémy jsou nejvhodnější pro studio umělé inteligence?

- macOS → optimální pro modely LLM a Apple-Silicon

- Linux (Ubuntu, Debian) → nejlepší volba pro AI obrázků, ComfyUI, Stable Diffusion

- Windows → funguje dobře pro SD/ComfyUI, ale méně ideálně pro automatizační procesy.

Mnoho studií dnes používá kombinované sestavy - každý systém dělá to, k čemu se nejlépe hodí. - Kolik energie spotřebuje studio umělé inteligence?

Mac Studio je úžasně úsporné a jeho spotřeba se obvykle pohybuje mezi 50 a 100 W. Pracovní stanice s GPU RTX 3090 může odebírat 250-350 W v závislosti na zátěži. Mac mini má spotřebu kolem 10-30 W. Celkově mnohem méně, než byste čekali - a často levněji než předplatné cloudu. - Je obtížné založit si studio umělé inteligence?

Ne tak docela. Potřebujete určité technické znalosti, ale ne titul z informatiky. Mnoho dnešních nástrojů má webové rozhraní, instalační skripty a automatickou konfiguraci. A pokud jasně oddělíte systémy (LLM / GPU / vedlejší úlohy), zůstane vše jasné. - Mohu s ním skutečně pokrýt kompletní publikační procesy?

Ano - a právě k tomu je studio umělé inteligence ideální. Od nápadů na knihu přes texty, návrhy obálek, série obrázků, korektury, překlady až po finální soubor pro tisk nebo e-knihu - mnoho věcí lze automatizovat a vyrobit přímo ve firmě. To je pro samonakladatele obrovská svoboda. - Jak je dnes studio AI odolné vůči budoucnosti?

Velmi. LLM se stávají efektivnějšími, image modely modulárnějšími, hardware odolnějším - a lokální AI se na trhu opět stává důležitější, protože zákony, ochrana dat a náklady na cloud snižují jeho atraktivitu. Každý, kdo dnes investuje do malého studia AI, buduje infrastrukturu, která bude v letech 2026-2030 spíše důležitá než zastaralá. - Lze modely umělé inteligence později trénovat nebo rozšiřovat?

Ano, systém GPU (např. RTX 3090 nebo 4090) lze použít pro školení LoRA, školení stylu, školení materiálu a procesů. To znamená, že můžete časem trénovat vlastní „vizuální jazyk AI“ nebo „textový směr AI“. To je největší strategická výhoda studia AI: stanete se nezávislými na obecných modelech a vytvoříte si vlastní styl.