Si tu travailles régulièrement avec une IA, tu connais probablement cette situation : une pensée en entraîne une autre. Tu poses une question, tu obtiens une réponse, tu reformules, tu développes une idée. Une question courte devient soudain un dialogue plus long. Parfois, cela donne même naissance à des projets entiers.

Mais la plupart de ces conversations disparaissent à nouveau. Elles se retrouvent quelque part dans la liste des discussions, glissent vers le bas et tombent dans l'oubli avec le temps. C'est précisément là que réside l'une des grandes particularités des systèmes d'IA modernes : Alors que les conversations antérieures avec des collègues, des amis ou des conseillers n'existaient que dans notre mémoire, les dialogues d'IA sont entièrement conservés.

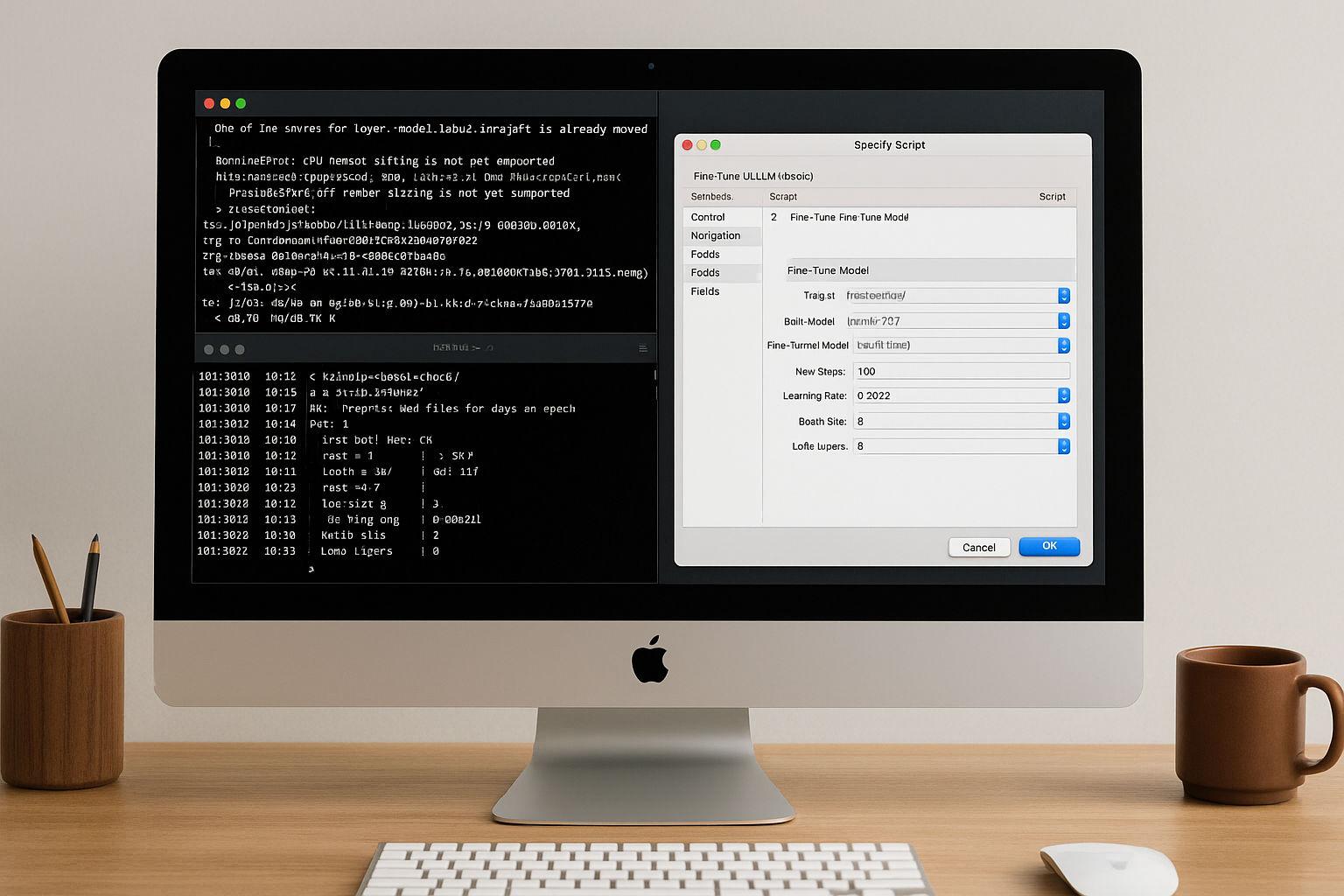

Cela signifie quelque chose de crucial : Avec chaque conversation, une archive numérique de ta pensée est créée. Ceci est la première partie d'une petite série d'articles qui te permet d'exporter l'historique de tes discussions depuis ChatGPT et de l'utiliser efficacement comme un trésor de connaissances personnelles avec ton système d'IA local.