À une époque où les services d'IA centralisés tels que ChatGPT, Claude ou Gemini font la une des journaux, le besoin d'une contrepartie - une infrastructure d'IA locale et contrôlable par l'utilisateur - se fait de plus en plus sentir chez de nombreux utilisateurs professionnels. Une solution locale est souvent l'option la plus durable et la plus sûre, en particulier pour les processus créatifs, les données sensibles ou les flux de travail répétitifs.

Quiconque travaille avec un Mac - en particulier avec Apple Silicon (M1, M2, M3 ou M4) - trouve aujourd'hui des outils étonnamment performants pour exploiter ses propres modèles de voix directement sur l'appareil. Au centre de ces outils se trouve un nouveau composant largement inconnu : MLX, un framework d'apprentissage automatique développé par Apple, qui devrait jouer un rôle de plus en plus central dans l'écosystème d'IA de l'entreprise au cours des prochaines années.

Dernières nouvelles sur MLX et Ollama

02.05.2026Une vidéo actuelle approfondit le sujet et classe en détail les principaux moteurs d'inférence. Il en ressort que ce n'est pas seulement le modèle lui-même qui est décisif, mais surtout le „moteur“ qui se trouve derrière, c'est-à-dire le moteur qui gère le calcul, l'accès à la mémoire et la communication. La comparaison entre Ollama, MLX, llama.cpp et vLLM montre à quel point les performances et les domaines d'application peuvent varier en fonction du matériel et des objectifs. Le rôle de MLX sur les appareils Apple-Silicon est particulièrement passionnant, car de nouveaux gains d'efficacité sont possibles grâce à cette architecture. En même temps, il est clair qu'il n'existe pas de solution universelle : Selon le scénario - local, basé sur un serveur ou évolutif - différents moteurs sont utiles. La vidéo ajoute ainsi une perspective stratégique importante au développement actuel de MLX.

Ollama, MLX, llama.cpp ou vLLM ? Voici comment choisir le moteur de VOTRE IA ! | Giorgi Lomidze

30.03.2026: Avec la version actuelle de l'aperçu intègre pour la première fois le framework MLX de Ollama comme backend pour les Macs Apple-Silicon. L'objectif est d'accélérer considérablement l'IA locale et de mieux exploiter le matériel. MLX utilise l'architecture de mémoire unifiée des Mac modernes, ce qui permet de partager efficacement les données entre le CPU et le GPU, sans avoir à recopier constamment les données. Il en résulte une amélioration sensible du „time to first token“ et de la vitesse de génération.

Les premiers benchmarks et rapports font état de gains de performance significatifs, voire d'une forte augmentation des taux de jetons et d'une utilisation plus efficace de la mémoire. La vidéo liée à l'article montre clairement pourquoi ce changement est si important : l'ancienne pile llama.cpp est remplacée par MLX, ce qui rend pour la première fois l'IA locale sur Mac vraiment fluide et utilisable au quotidien. En même temps, la fonction reste encore un aperçu, de sorte que des restrictions et d'autres optimisations sont à prévoir. Dans l'ensemble, cette étape marque une transition importante vers une IA locale rapide sur du matériel grand public.

Qu'est-ce que MLX - et que représente ce nouveau format ?

MLX est un framework open source de Apple pour l'apprentissage automatique, spécialement conçu pour l'architecture matérielle de Apple Silicon. Contrairement à d'autres backends d'IA comme PyTorch ou TensorFlow, MLX utilise directement les avantages de la "mémoire unifiée" de Apple - c'est-à-dire l'accès commun du CPU et du GPU à la même zone de RAM. Cela assure un traitement nettement plus efficace des données et des modèles - en particulier pour les grands modèles de langage qui peuvent contenir plusieurs gigaoctets.

Le format MLX correspondant décrit typiquement des modèles dont les pondérations sont stockées dans un format de fichier compressé .npz (NumPy Zip). Des modèles tels que Mistral, Phi-2 ou LLaMA 3 peuvent être convertis dans ce format à l'aide d'outils appropriés et exécutés directement sur un Mac - sans cloud, sans API, sans restrictions.

Dans un autre article, je présente un Comparaison entre Apple Silicon et NVIDIA et explique quel matériel est adapté à l'exécution de modèles linguistiques locaux sur un Mac.

La situation actuelle : ce qu'offre déjà Apple

Avec l'annonce de Apple Intelligence en 2024, Apple a commencé à intégrer des fonctions d'IA à l'échelle du système directement dans le système d'exploitation. Assistants d'écriture, traitement d'images, recherche sémantique, fonctions de messagerie intelligentes - beaucoup de ces fonctions fonctionnent entièrement en local, notamment sur les appareils équipés d'une puce M1 ou plus récente. En revanche, aucune des nouvelles fonctions n'est disponible sur les anciens Macs Intel.

Parallèlement, Apple a continué à développer le framework MLX et l'a publié sous une licence ouverte. En combinaison avec des outils tels que mlx-lm ou la nouvelle API MLX Swift, il est déjà possible aujourd'hui d'exploiter des modèles de texte en local, de mettre en place ses propres workflows ou d'entraîner des modèles - directement sur son propre Mac, sans que les données ne quittent l'appareil.

Les utilisateurs professionnels, notamment dans les domaines du développement de logiciels, de l'édition, du marketing ou de la recherche, peuvent en tirer un grand profit, car MLX leur offre de toutes nouvelles possibilités d'intégrer des modèles d'IA dans leurs flux de travail sans dépendre de fournisseurs externes.

Comment fonctionne MLX dans la pratique

Pour utiliser MLX aujourd'hui, il suffit d'un terminal, de Python (idéalement dans son propre environnement virtuel) et du paquet mlx-lm, qui regroupe toutes les fonctions nécessaires : Téléchargement de modèles, quantification, inférence et chat. Après l'installation, il est possible de lancer des modèles déjà prêts de la communauté Hugging-Face - par exemple :

mlx_lm.chat --model mlx-community/Mistral-7B-Instruct-v0.3-4bit

Il est également possible d'accéder à l'API via un script Python. Les modèles sont alors automatiquement chargés, mis en cache et exécutés localement - sans connexion Internet après le premier téléchargement.

Il est également facile de convertir ses propres modèles. Une seule commande permet de télécharger des modèles depuis le Hugging Face Hub, de les quantifier et de les mettre à disposition pour MLX :

python -m mlx_lm.convert --hf-path meta-llama/Llama-3-8B-Instruct -q

Les fichiers .npz qui en résultent peuvent alors être stockés localement de manière permanente et réutilisés.

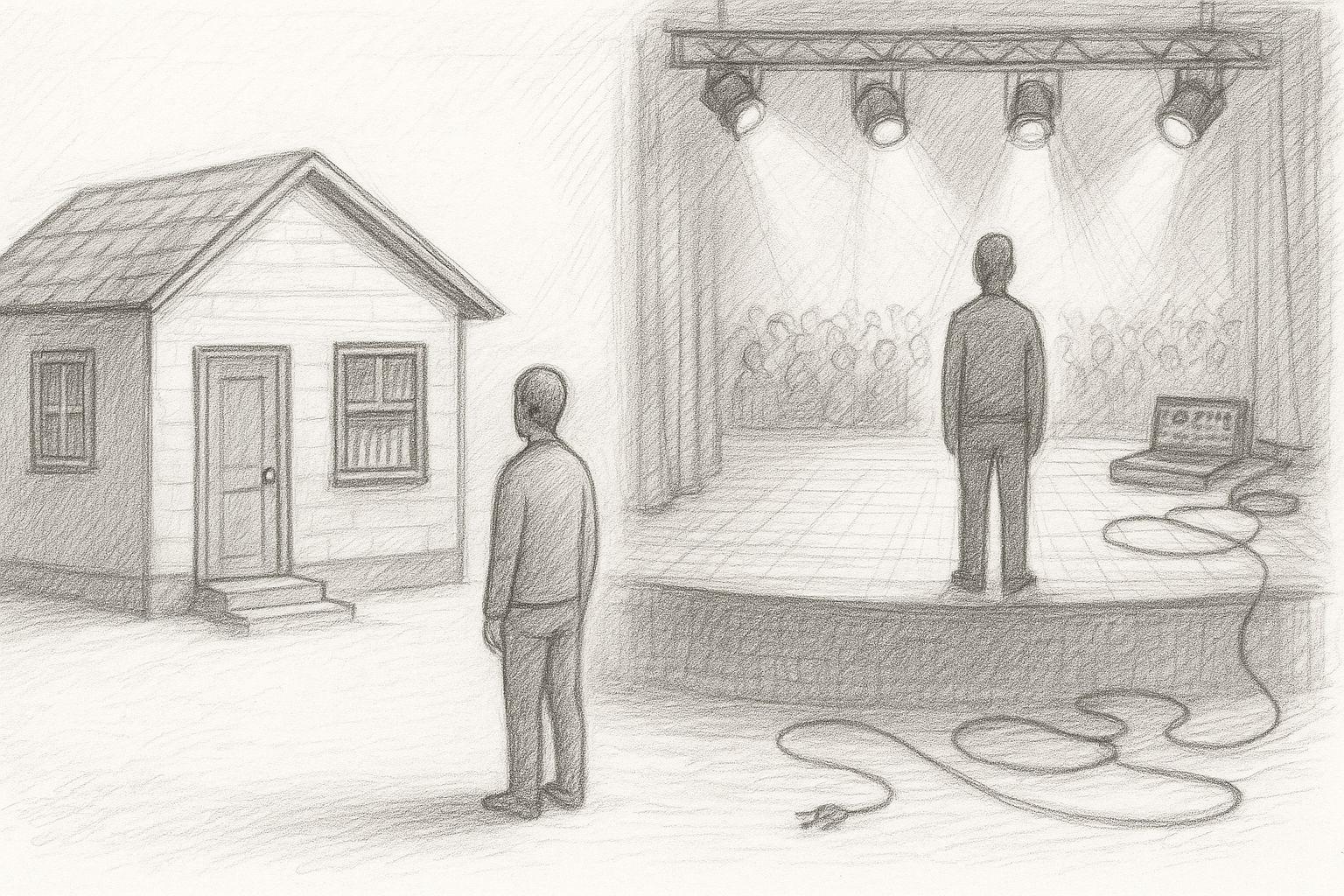

La comparaison : MLX vs. Ollama, Llama.cpp et LM Studio

Outre MLX, il existe sur Mac plusieurs alternatives bien établies pour l'utilisation locale de l'IA - en particulier Ollama, Llama.cpp et LM Studio. Chacun de ces outils a ses points forts, mais aussi ses limites spécifiques.

Ollama

Ollama est particulièrement apprécié des développeurs parce qu'il offre une ligne de commande simple et une API REST. Les modèles sont ici disponibles au format dit GGUF, un format de fichier optimisé pour une exécution rapide sur des machines locales. Ollama est rapide à mettre en place, flexible et prend en charge un grand nombre de modèles. Actuellement, Ollama ne fonctionne toutefois pas encore avec le moteur MLX sur Mac, mais utilise principalement le backend basé sur Metal via llama.cpp.

Pour les flux de travail qui nécessitent une automatisation ou un fonctionnement "headless" (par exemple des processus s'exécutant en arrière-plan), Ollama est actuellement le premier choix. Mais ceux qui souhaitent utiliser les optimisations propres à la Apple devront attendre les futures intégrations MLX.

Llama.cpp

Ce projet constitue la base de nombreux autres outils (dont Ollama) et offre un moteur d'inférence très performant pour les modèles GGUF. Il est extrêmement flexible, mais n'est pas toujours facile à installier ou à utiliser - surtout pour les débutants. Son grand avantage : il existe une énorme communauté, de nombreuses extensions et un développement stable.

LM Studio

Celui qui cherche une interface utilisateur graphique tombe généralement sur LM Studio. Cet outil réunit le téléchargement, la gestion et l'exécution de modèles linguistiques dans une application légère et native pour Mac - y compris l'interface de chat, la configuration et la gestion des modèles. Le clou : depuis quelques mois, LM Studio supporte également le moteur MLX, ce qui permet de profiter pleinement des optimisations de Apple sur un Mac M1 ou M2 - et ce avec une consommation de RAM nettement inférieure à celle d'outils comparables.

LM Studio est le point d'entrée idéal dans le monde de l'IA locale, en particulier pour les utilisateurs qui ne souhaitent pas s'attarder sur les commandes de terminal - et, en combinaison avec MLX, un véritable vecteur de performance.

Le réglage fin en toute simplicité : comment FileMaker 2025 intègre l'entraînement LoRA dans la vie quotidienne

Alors que MLX et Ollama montrent comment exploiter localement des modèles linguistiques et les intégrer dans des processus existants, l'étape suivante va nettement plus loin : l'adaptation ciblée de ces modèles à des données propres. C'est précisément là que l'approche avec FileMaker 2025 de Claris, filiale de Apple de l'entreprise. Au lieu d'environnements de formation isolés, on obtient une interface structurée dans laquelle les ensembles de données, les paramètres de formation et les versions de modèles peuvent être gérés de manière centralisée. Grâce à des processus clairement définis, les formations LoRA peuvent être préparées, lancées et reproduites - sans que chaque étape doive être contrôlée manuellement par des scripts ou des lignes de commande. Ainsi, le réglage fin expérimental devient un flux de travail reproductible qui s'intègre dans les processus commerciaux existants. Les entreprises qui travaillent avec leurs propres données bénéficient ainsi d'un avantage décisif : l'IA ne reste pas générale, mais est entraînée de manière ciblée en fonction de leur propre contexte.

Alors que MLX et Ollama montrent comment exploiter localement des modèles linguistiques et les intégrer dans des processus existants, l'étape suivante va nettement plus loin : l'adaptation ciblée de ces modèles à des données propres. C'est précisément là que l'approche avec FileMaker 2025 de Claris, filiale de Apple de l'entreprise. Au lieu d'environnements de formation isolés, on obtient une interface structurée dans laquelle les ensembles de données, les paramètres de formation et les versions de modèles peuvent être gérés de manière centralisée. Grâce à des processus clairement définis, les formations LoRA peuvent être préparées, lancées et reproduites - sans que chaque étape doive être contrôlée manuellement par des scripts ou des lignes de commande. Ainsi, le réglage fin expérimental devient un flux de travail reproductible qui s'intègre dans les processus commerciaux existants. Les entreprises qui travaillent avec leurs propres données bénéficient ainsi d'un avantage décisif : l'IA ne reste pas générale, mais est entraînée de manière ciblée en fonction de leur propre contexte.

Quand MLX sur Silicon est un meilleur choix

Alors que les solutions basées sur GGUF (Ollama, Llama.cpp) sont très flexibles et fonctionnent sur de nombreuses plates-formes, MLX marque des points grâce à son intégration profonde dans le monde Apple. Il convient de souligner en particulier

- Utilisation efficace de la mémoire grâce à la mémoire unifiée

- Optimisation pour Metal/GPU sans configuration complexe

- Intégration transparente dans les projets Swift et les frameworks Apple

- Pérennité, car Apple continue à développer activement le framework

- Extensibilité, par exemple par des modèles propres, un réglage fin et une intégration du système

Pour les utilisateurs de Mac qui souhaitent planifier à long terme et garder le contrôle total de leurs données, MLX est dès aujourd'hui une entrée prometteuse dans le monde de l'IA locale - avec le potentiel de devenir un standard à l'avenir.

De l'IA locale aux véritables processus d'entreprise : Où les systèmes ERP entrent en jeu

Ce qui est souvent sous-estimé dans ce contexte : La véritable force des systèmes d'IA locaux comme MLX ou Ollama ne réside pas seulement dans le modèle lui-même, mais aussi dans leur intégration dans les processus de travail existants. C'est justement par le biais d'interfaces et d'API qu'il est possible de ne pas utiliser l'IA de manière isolée, mais de l'intégrer directement dans des processus opérationnels - par exemple pour l'analyse de données, l'automatisation de textes ou l'aide à la décision.

Ce qui est souvent sous-estimé dans ce contexte : La véritable force des systèmes d'IA locaux comme MLX ou Ollama ne réside pas seulement dans le modèle lui-même, mais aussi dans leur intégration dans les processus de travail existants. C'est justement par le biais d'interfaces et d'API qu'il est possible de ne pas utiliser l'IA de manière isolée, mais de l'intégrer directement dans des processus opérationnels - par exemple pour l'analyse de données, l'automatisation de textes ou l'aide à la décision.

C'est précisément à ce stade qu'un système ERP performant devient le maillon central : il met les données à disposition, structure les processus et veille à ce que les résultats de l'IA ne soient pas seulement générés, mais aussi traités de manière judicieuse. Celui qui souhaite utiliser l'IA locale de manière productive ne peut donc pas se passer à long terme d'un environnement système bien pensé. Plus d'informations à ce sujet sur la page Logiciel ERP, Le système ERP basé sur FileMaker y sera présenté. FileMaker Server supporte l'hébergement de modèles de langage MLX à partir de la version 2025 directement sur le serveur de la base de données et met à disposition les commandes de script correspondantes. Le logiciel de Claris, une filiale de Apple, peut être exécuté sur Apple Mac, Windows et sur les appareils mobiles iOS.

Un aperçu de la situation : Où veut aller Apple avec MLX et Apple Intelligence

Avec la WWDC 2025, Apple a clairement signalé que MLX n'est pas un gadget, mais un composant stratégique dans l'écosystème croissant de Apple autour de l'IA. L'intégration des nouveaux „Foundation Models“ directement dans macOS et iOS, le support natif de Swift et le développement de MLX vers l'entraînement, la quantification et l'inférence le montrent clairement : Apple veut être de la partie - mais à sa manière. Dans un autre article, je montre où Apple avec Siri et Gemini dans le cadre du partenariat avec Google.

Avec la WWDC 2025, Apple a clairement signalé que MLX n'est pas un gadget, mais un composant stratégique dans l'écosystème croissant de Apple autour de l'IA. L'intégration des nouveaux „Foundation Models“ directement dans macOS et iOS, le support natif de Swift et le développement de MLX vers l'entraînement, la quantification et l'inférence le montrent clairement : Apple veut être de la partie - mais à sa manière. Dans un autre article, je montre où Apple avec Siri et Gemini dans le cadre du partenariat avec Google.

Ce faisant, Apple reste fidèle à sa ligne de conduite : pas de promesses spectaculaires, mais une technique solide, qui fonctionne localement et qui fait ses preuves à long terme. Pour les utilisateurs professionnels, c'est non seulement sympathique, mais aussi très intéressant d'un point de vue stratégique.

MLX est en passe de devenir la solution standard pour l'IA locale sur Mac. Ceux qui l'utilisent dès aujourd'hui prennent une avance précieuse, que ce soit pour des applications créatives, techniques ou analytiques. En combinaison avec des outils tels que mlx-lm, LM Studio ou la nouvelle API Swift, il est possible de construire un environnement d'IA robuste, fiable et à l'épreuve du temps - tout à fait dans l'esprit d'une méthode de travail contrôlée et souveraine en matière de données, comme cela sera de plus en plus important à l'avenir.

Dernière enquête sur l'intelligence artificielle

Utiliser MLX sur Mac - guide simple pour débutants

Apple a créé MLX, un nouveau système qui permet d'utiliser l'intelligence artificielle (IA) directement sur son propre Mac - sans connexion Internet, sans cloud, sans dépendance de Google ou d'OpenAI. La beauté de la chose : si tu possèdes un Mac avec un processeur M1, M2, M3 ou M4 (donc Apple Silicon), tu peux essayer MLX en quelques étapes. Tout fonctionne en local - tes textes, questions et données ne quittent jamais ton ordinateur.

J'explique ici étape par étape comment télécharger et utiliser ce que l'on appelle un modèle linguistique avec MLX. Cela semble technique - mais tu verras que c'est tout à fait réalisable.

Étape 1 : Vérifier les conditions préalables

D'abord, il te faut

- Un Mac Apple Silicon (M1 ou plus récent). Tu le trouveras dans les Préférences Système sous "À propos de ce Mac".

- macOS 13 (Ventura) ou plus récent.

- Une connexion Internet qui fonctionne - uniquement pour télécharger le modèle, ensuite tout fonctionne hors ligne.

- Un peu de mémoire, au moins environ 8-10 Go pour un petit modèle.

Tu as également besoin du programme appelé "Terminal", qui est déjà présent sur tous les Macinstall. Nous l'utilisons pour entrer quelques commandes. Tu le trouves sur ton Mac sous "Applications/Utilitaires" ou simplement puis tu tapes "Terminal" et tu confirmes avec "Entrée". Ne t'inquiète pas - il te suffit de copier et de coller.

Étape 2 : Python installier (seulement si nécessaire)

MLX fonctionne avec le langage de programmation Python. De nombreux Macs disposent déjà de Python installiert. Tu peux vérifier s'il est présent en tapant ce qui suit dans le terminal :

python3 --version

Si tu obtiens un numéro de version (par exemple Python 3.10.6), tu peux directement continuer.

Si ce n'est pas le cas, je te conseille d'utiliser Homebrew pour installieren (un outil populaire pour les programmes sur Mac). Pour cela, il suffit de taper dans le terminal

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"

Ensuite, installous les pythons avec :

brew install python

Étape 3 : Outil MLX installieren

Nous allons maintenant télécharger l'outil MLX qui te permettra d'utiliser plus tard le modèle linguistique. Pour ce faire, tu installierst un petit programme appelé mlx-lm. Saisis-le dans le terminal :

pip3 install mlx-lm

Cela prend quelques secondes. Quand c'est fait, tu es prêt à charger un modèle.

Etape 4 : Télécharger un modèle et le lancer

Maintenant, la partie excitante : tu récupères un vrai modèle de langage sur ton Mac - par exemple une version de Mistral, un modèle d'IA très puissant et disponible gratuitement. Il suffit de le saisir dans le terminal :

mlx_lm.chat --model mlx-community/Mistral-7B-Instruct-v0.3-4bit

Cette commande a trois effets :

- Le modèle est téléchargé automatiquement (une seule fois).

- Il est préparé et lancé.

- Tu arrives dans une fenêtre de chat dans le terminal, dans laquelle tu peux poser des questions - un peu comme dans ChatGPT.

Lorsque le téléchargement est terminé (cela peut prendre quelques minutes selon la vitesse d'Internet), tu vois un curseur qui clignote. Tu peux maintenant écrire, par exemple

Parle-moi de l'histoire de Venise.

...et le modèle répond directement - complètement hors ligne.

Etape 5 : Continuer à travailler avec le modèle

Lorsque tu as terminé, tu peux quitter le chat en tapant exit ou en fermant la fenêtre. Plus tard, tu pourras réutiliser le même modèle sans le télécharger à nouveau, en tapant simplement la même commande. Le modèle se trouve maintenant en local sur ton Mac et y reste.

Si tu souhaites essayer différents modèles, tu peux le faire via Hugging Face ou changer le nom du modèle directement dans la ligne du terminal - par exemple :

mlx_lm.chat --model mlx-community/Phi-2-4bit

Chaque modèle a un style différent - certains sont objectifs, d'autres plus créatifs ou orientés vers le dialogue.

Encore plus simple ? Utiliser LM Studio comme interface

Si tu préfères travailler avec une souris et une fenêtre, tu peux aussi essayer le programme LM Studio. Il a une belle interface, supporte MLX (sur Apple Silicon) et te permet de télécharger et d'utiliser des modèles en un clic.

Tu peux obtenir LM Studio ici :

Après l'installation, tu peux choisir "MLX" comme moteur dans les paramètres - le programme utilise alors la même technique que ci-dessus, mais dans une jolie fenêtre avec un champ de chat.

Tu l'as fait - tu utilises maintenant une IA moderne entièrement localement sur ton Mac, sans cloud ni abonnement. Apple MLX permet d'exploiter des modèles linguistiques de manière efficace, sûre et respectueuse de la vie privée.

Si tu veux aller plus loin par la suite - par exemple entraîner tes propres modèles, les améliorer avec tes textes ou les intégrer dans tes propres logiciels (comme FileMaker) - tu es sur la bonne voie avec MLX. Mais le premier pas est fait : tu as repris le contrôle - et une IA performante directement sur ton ordinateur.

Du modèle local à la véritable mémoire de l'IA

L'article sur MLX montre clairement à quel point l'IA locale est devenue puissante directement sur le matériel Apple, notamment grâce à l'étroite imbrication avec l'architecture Apple Silicon et des frameworks optimisés. Ollama mise davantage sur la simplicité d'intégration, les API et la flexibilité des flux de travail, tandis que MLX est profondément intégré dans l'écosystème Apple et offre un énorme potentiel à long terme. C'est là qu'intervient la nouvelle série d'articles : Elle va plus loin et montre comment ces modèles d'IA locaux peuvent être complétés par une véritable „mémoire“. Au lieu de se contenter d'exécuter des modèles, on construit une base de connaissances qui l'exportation des données de ses propres historiques de chat à partir de ChatGPT et les rend sémantiquement consultables. Ainsi, l'IA locale ne devient pas seulement un outil, mais un système personnel qui grandit avec ses propres connaissances.

L'article sur MLX montre clairement à quel point l'IA locale est devenue puissante directement sur le matériel Apple, notamment grâce à l'étroite imbrication avec l'architecture Apple Silicon et des frameworks optimisés. Ollama mise davantage sur la simplicité d'intégration, les API et la flexibilité des flux de travail, tandis que MLX est profondément intégré dans l'écosystème Apple et offre un énorme potentiel à long terme. C'est là qu'intervient la nouvelle série d'articles : Elle va plus loin et montre comment ces modèles d'IA locaux peuvent être complétés par une véritable „mémoire“. Au lieu de se contenter d'exécuter des modèles, on construit une base de connaissances qui l'exportation des données de ses propres historiques de chat à partir de ChatGPT et les rend sémantiquement consultables. Ainsi, l'IA locale ne devient pas seulement un outil, mais un système personnel qui grandit avec ses propres connaissances.

Foire aux questions

- Qu'est-ce que MLX exactement - et en quoi est-il différent de PyTorch ou TensorFlow ?

MLX est un framework d'apprentissage automatique développé par Apple et optimisé spécifiquement pour Apple Silicon (M1-M4). Contrairement à PyTorch ou TensorFlow, qui visent de nombreuses plateformes, MLX utilise spécifiquement l'architecture des puces Apple - par exemple la structure de mémoire unifiée (Unified Memory) et l'accélération Metal-GPU. Il fonctionne ainsi plus efficacement en termes de mémoire et plus rapidement sur les Mac - mais uniquement sur le matériel Apple. - Pourquoi préférer MLX à un outil comme Ollama ou Llama.cpp ?

MLX est avantageux si l'on travaille de manière ciblée sur Apple Silicon et que l'on veut tirer le maximum de performances de l'appareil. Ollama et Llama.cpp sont très flexibles, mais fonctionnent souvent moins efficacement sur Mac. MLX peut en outre être intégré directement dans des projets Swift - idéal pour les développeurs qui construisent des applications proches de Apple. Ce n'est pas un concurrent de Ollama - mais un outil spécialisé pour les professionnels. - Quels sont les modèles compatibles avec MLX ?

De nombreux modèles de langues ouverts sont compatibles - par exemple Mistral, LLaMA 2 et 3, Phi-2 ou TinyLLaMA - qui sont déjà convertis ou peuvent être convertis à l'aide de l'outil mlx-lm.convert. Il est important qu'ils soient au format NumPy-ZIP (.npz) et qu'ils soient préparés pour MLX. Il existe entre-temps sur Hugging Face une section spéciale pour les modèles compatibles avec MLX. - Est-il facile de commencer ? Dois-je être développeur ?

Un peu de compréhension technique est utile - par exemple pour le terminal, les environnements Python ou les noms de modèles. Mais l'initiation est relativement simple grâce à mlx-lm : une commande d'installation, une commande pour démarrer, et c'est tout. Ceux qui préfèrent travailler avec une interface peuvent utiliser LM Studio - il prend désormais également en charge MLX sur Mac. - Puis-je également m'entraîner à utiliser MLX pour mes propres projets - par exemple avec mes propres textes ?

Oui, c'est possible - mais la formation est actuellement plutôt destinée aux utilisateurs avancés. La plupart des utilisateurs se servent des modèles MLX pour l'inférence (c'est-à-dire pour répondre, générer du texte, etc.). Pour l'entraînement ou le réglage fin, il faut connaître LoRA, les formats de données (JSONL) et les besoins en mémoire - ou recourir à des outils comme FileMaker 2025, qui simplifient ce processus. - Qu'en est-il de la sécurité et de la protection des données chez MLX ?

Très bien - car MLX fonctionne entièrement en local. Toutes les données, les entrées et les réponses aux modèles restent sur ton propre ordinateur. Il n'y a pas de transfert dans le nuage, pas d'API étrangère - idéal pour les projets sensibles aux données, les documents internes, les données protégées des clients ou les notes confidentielles. - Quel est le rôle de Apple lui-même dans ce contexte ? Le développement de MLX se poursuit-il ?

Apple a publié MLX sous une licence ouverte et continue de le développer activement - notamment en relation avec Apple Intelligence, le système d'IA pour macOS, iOS et iPadOS. Lors de la WWDC 2025, MLX a été présenté comme cadre officiel pour l'intégration de modèles linguistiques propres dans le logiciel Apple. On peut s'attendre à ce que MLX gagne encore en importance dans le monde Apple. - Puis-je combiner MLX avec d'autres outils, par exemple Neo4j, n8n ou FileMaker ?

Oui - MLX est certes un framework ML pur, mais il peut être relié à d'autres outils via des API REST, des services Python propres ou des wrappers locaux. On peut par exemple l'intégrer dans une automatisation propre (n8n), une base de données sémantique (Neo4j) ou dans des solutions FileMaker - cette dernière étant même devenue native avec FileMaker 2025.

Image (c) Monoar_CGI_Artist @ pixabay