Ce livre ne fournit pas de visions spéculatives de l'avenir, mais une réponse fondée et pratique issue du quotidien d'un auteur qui écrit lui-même avec l'IA - et qui mise délibérément non pas sur l'automatisation, mais sur l'autonomie. "Écrire des livres 2.0" s'adresse à tous ceux qui envisagent d'écrire leur propre livre - ou qui sont déjà en train de le faire - et qui se demandent comment des outils modernes comme ChatGPT, les générateurs d'images d'IA ou les aides à la traduction peuvent être utilisés de manière judicieuse. L'accent n'est pas mis sur les "produits IA prêts à l'emploi", mais sur une approche globale : l'IA comme outil, l'homme comme auteur.

Articles récents

Rendez-vous à la conférence FileMaker FMK 2025 à Hambourg ?

Du 15 au 17 septembre 2025, la communauté germanophone FileMaker se réunira à l'hôtel JUFA de Hambourg HafenCity pour échanger sur les développements actuels, les tendances et les meilleures pratiques lors de la conférence FileMaker (FMK 2025). Depuis plus de dix ans, cette conférence est considérée comme l'événement le plus important pour les développeurs, les utilisateurs et les décideurs dans le domaine de Claris FileMaker - et je suis heureux d'y participer personnellement cette année encore.

Le livre sur les hémorroïdes un peu différent - ouvert, honnête et holistique

Les hémorroïdes sont un sujet tabou. Bien que des millions de personnes soient concernées, on en parle rarement ouvertement. Beaucoup souffrent en silence, repoussent les consultations médicales et essaient de s'en sortir avec des crèmes et des remèdes maison. Mais c'est justement ce silence qui peut prolonger involontairement la souffrance.

Avec "Le livre sur les hémorroïdes d'un autre genre - Mon chemin à travers l'enfer des hémorroïdes - et retour" Markus Schall envoie un signal clair contre ce mutisme - et montre de nouvelles voies pour mieux comprendre les troubles, les classer et les soulager de manière globale.

Thérapie par gouttières en cas de DTM - Mon parcours personnel à travers la dernière phase

Il y a maintenant trois ans et demi, j'ai commencé un voyage que je n'aurais pas imaginé d'une telle ampleur - un voyage à travers mon propre corps, guidé par une seule attelle régulièrement ajustée. Au début de l'année 2022, je n'aurais certainement pas imaginé que les conséquences seraient aussi énormes.

Ollama rencontre Qdrant : une mémoire locale pour ton IA sur Mac

IA locale avec mémoire - sans cloud, sans abonnement, sans détour

Dans un article précédent j'ai expliqué comment utiliser Ollama sur Mac install. Ceux qui ont déjà franchi cette étape disposent maintenant d'un modèle de langage local performant - par exemple Mistral, LLaMA3 ou un autre modèle compatible auquel il est possible de s'adresser via l'API REST.

Mais de lui-même, le modèle ne "sait" que ce qui est écrit dans le prompt actuel. Il ne se souvient pas des conversations précédentes. Ce qui manque, c'est la mémoire.

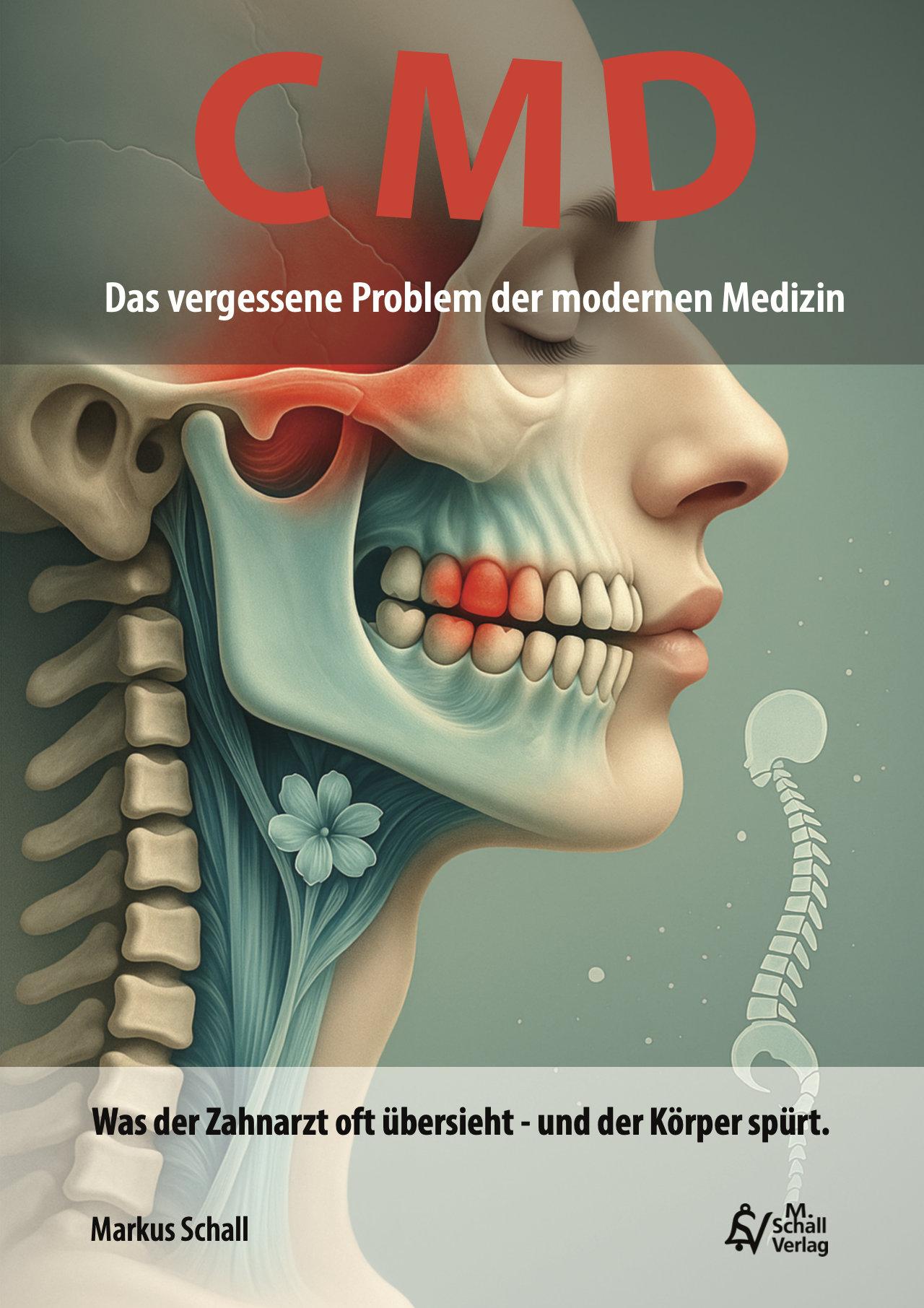

CMD - Le problème oublié de la médecine moderne

Des millions de personnes en Allemagne souffrent de troubles tels que les acouphènes, les vertiges, les douleurs dorsales ou les tensions - et ne trouvent pourtant pas de diagnostic clair. Ce que beaucoup ne savent pas : Derrière tous ces symptômes peut se cacher une cause unique, souvent ignorée : un Dysfonction temporo-mandibulaire, ou DTM.

Avec mon livre "CMD - Le problème oublié de la médecine moderne" c'est ici que je souhaite intervenir : J'explique ce qu'est la DTM, comment elle se manifeste, pourquoi elle est si difficile à reconnaître - et comment les personnes concernées peuvent enfin y voir plus clair et retrouver une meilleure qualité de vie.

"Le livre des bases de données un peu différent" introduit la réflexion sur les processus.

Quel est le point commun entre les contacts d'un téléphone portable, les listes de tâches, les calendriers et même la garde-robe d'un individu ? Exact : ils peuvent être représentés sous forme de tableaux - et ce n'est pas un hasard. Les données sont depuis longtemps devenues un élément de base de notre quotidien. Les comprendre, c'est comprendre le monde un peu mieux. C'est précisément là qu'intervient "Le livre des bases de données pas comme les autres".

Car celui qui peut comprendre les processus et les tenants et aboutissants au quotidien est automatiquement en mesure de concevoir et de mettre en pratique des processus logiciels de manière rapide et intuitive.

IA locale sur Mac : comment 1TP12Créer un modèle linguistique avec Ollama

L'IA locale sur Mac est depuis longtemps une réalité, en particulier sur les ordinateurs Apple-Silicon (série M). Avec Ollama, vous obtenez un environnement d'exécution léger pour de nombreux modèles de langage open source (par ex. Llama 3.1/3.2, Mistral, Gemma, Qwen). La version actuelle de Ollama est désormais accompagnée d'une application conviviale qui vous permet de configurer un modèle de langage local sur votre Mac d'un simple clic de souris. Dans cet article, vous trouverez un guide pragmatique de l'installation jusqu'à la première invite - avec des conseils tirés de la pratique, où les choses ont traditionnellement tendance à mal tourner.