Questo libro non fornisce visioni speculative del futuro, ma una risposta pratica e fondata, tratta dalla vita quotidiana di un autore che scrive con l'IA in prima persona e che volutamente non si concentra sull'automazione, ma sull'autonomia. "Scrivere libri 2.0" si rivolge a tutti coloro che stanno pensando di scrivere il proprio libro - o sono già in procinto di farlo - e si chiedono come strumenti moderni come ChatGPT, generatori di immagini AI o ausili per la traduzione possano essere utilizzati al meglio. L'attenzione non è rivolta a "prodotti AI finiti", ma a un approccio olistico: l'AI come strumento, gli esseri umani come autori.

Contributi attuali

Ci vediamo alla conferenza FileMaker FMK 2025 ad Amburgo?

Dal 15 al 17 settembre 2025, la comunità FileMaker di lingua tedesca si riunirà al JUFA Hotel Hamburg HafenCity per discutere gli ultimi sviluppi, le tendenze e le migliori pratiche in occasione della Conferenza FileMaker (FMK 2025). Da oltre dieci anni, questa conferenza è considerata l'evento più importante per gli sviluppatori, gli utenti e i decisori del settore FileMaker di Claris e sono lieto di essere presente di persona anche quest'anno.

Il libro sulle emorroidi un po' diverso - aperto, onesto e olistico

Le emorroidi sono un argomento tabù. Anche se milioni di persone ne sono affette, raramente se ne parla apertamente. Molti soffrono in silenzio, rimandando le visite dal medico e cercando di cavarsela con creme e rimedi casalinghi. Ma è proprio questo silenzio che può inavvertitamente prolungare la sofferenza.

Con "Il libro delle emorroidi, un po' diverso dal precedente - Il mio cammino attraverso l'inferno delle emorroidi e ritorno" Markus Schall lancia un chiaro segnale contro questa mancanza di parole e mostra nuovi modi per comprendere meglio, classificare e risolvere in modo olistico i reclami.

Terapia con stecche per la CMD - Il mio personale percorso attraverso la fase finale

Tre anni e mezzo fa è iniziato per me un viaggio che non mi sarei mai aspettato fino a questo punto: un viaggio attraverso il mio stesso corpo, guidato da un'unica stecca regolata regolarmente. All'inizio del 2022, sicuramente non avrei pensato che gli effetti sarebbero stati così enormi.

Ollama incontra Qdrant: una memoria locale per la vostra AI su Mac

IA locale con memoria - senza cloud, senza abbonamento, senza distrazioni

In un articoli precedenti Ho spiegato come configurare l'Ollama sul Mac install. Se avete già completato questo passaggio, ora disponete di un potente modello di lingua locale, come Mistral, LLaMA3 o un altro modello compatibile che può essere indirizzato tramite API REST.

Tuttavia, il modello "sa" solo cosa c'è nel prompt corrente. Non ricorda le conversazioni precedenti. Ciò che manca è la memoria.

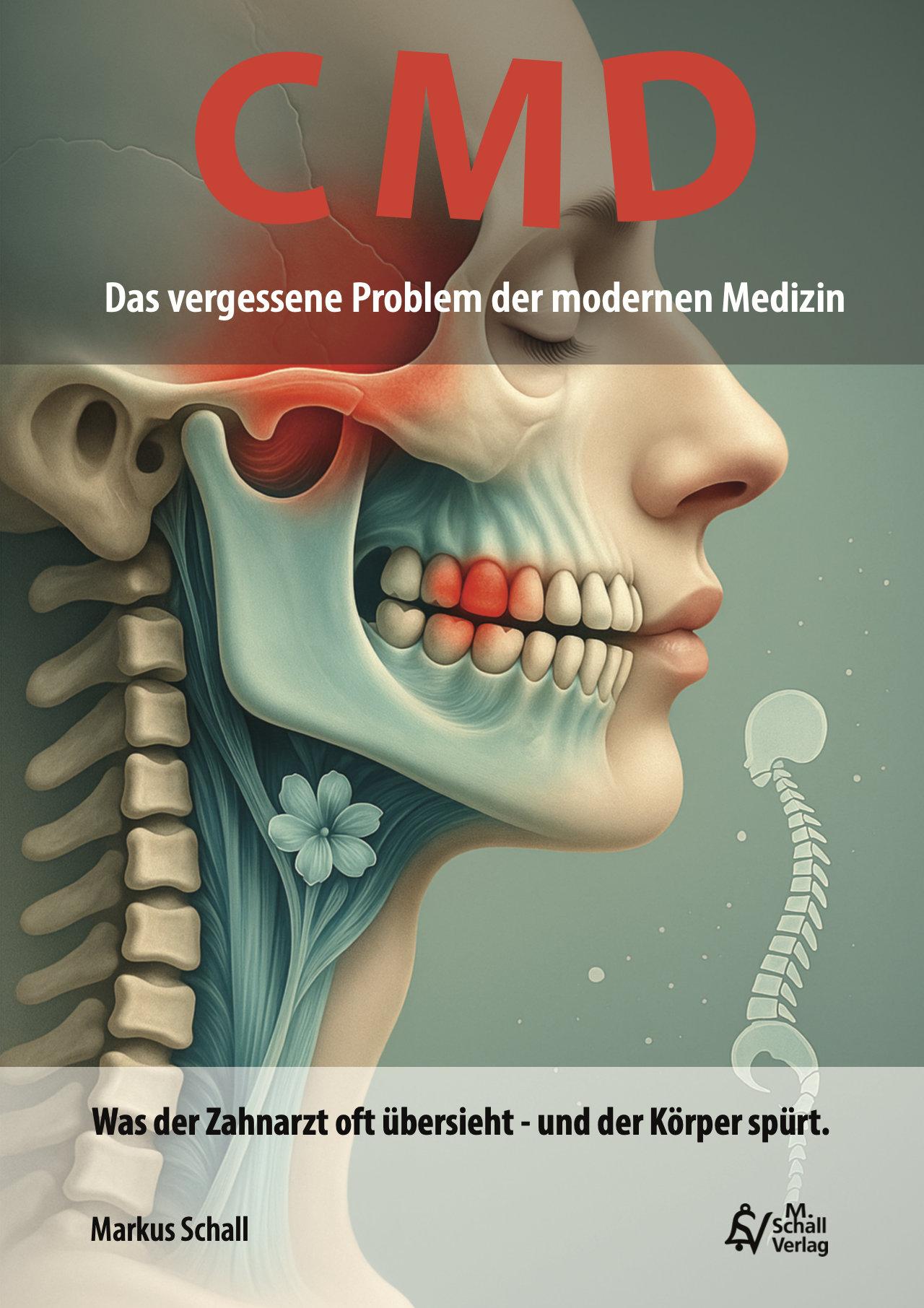

CMD - Il problema dimenticato della medicina moderna

Milioni di persone in Germania soffrono di disturbi come acufeni, vertigini, mal di schiena o tensione, senza riuscire a trovare una diagnosi chiara. Quello che molti non sanno è che Alla base di tutti questi sintomi potrebbe esserci un'unica causa, spesso trascurata: la disfunzione cranio-mandibolare, in breve CMD.

Con il mio libro "CMD - Il problema dimenticato della medicina moderna". Vorrei iniziare proprio da qui: Spiego cos'è la CMD, come si manifesta, perché è così difficile da riconoscere e come chi ne è affetto può finalmente raggiungere una maggiore chiarezza e qualità di vita.

Il libro "Il database un po' diverso" introduce il modo di pensare per processi.

Che cosa hanno in comune i contatti del cellulare, gli elenchi di cose da fare, i calendari e persino il vostro guardaroba? Esatto: possono essere visualizzati come tabelle, e non è una coincidenza. I dati sono diventati da tempo un elemento base della nostra vita quotidiana. Se li si comprende, si capisce un po' meglio il mondo. È proprio qui che entra in gioco "Il libro dei database con una differenza".

Dopotutto, chi è in grado di comprendere i processi e i contesti della vita quotidiana è automaticamente in grado di concettualizzare i processi software in modo rapido e intuitivo e di implementarli nella pratica.

IA locale su Mac: come installiere un modello linguistico con Ollama

L'intelligenza artificiale locale su Mac è da tempo pratica, soprattutto sui computer Apple-Silicon (serie M). Con Ollama si ottiene un ambiente di runtime snello per molti modelli linguistici open source (ad esempio Llama 3.1/3.2, Mistral, Gemma, Qwen). L'attuale versione Ollama è dotata di un'applicazione di facile utilizzo che consente di configurare un modello linguistico locale sul Mac con un semplice clic del mouse. In questo articolo troverete una guida pragmatica dall'installazione al primo prompt, con consigli pratici su dove tradizionalmente le cose tendono ad andare storte.