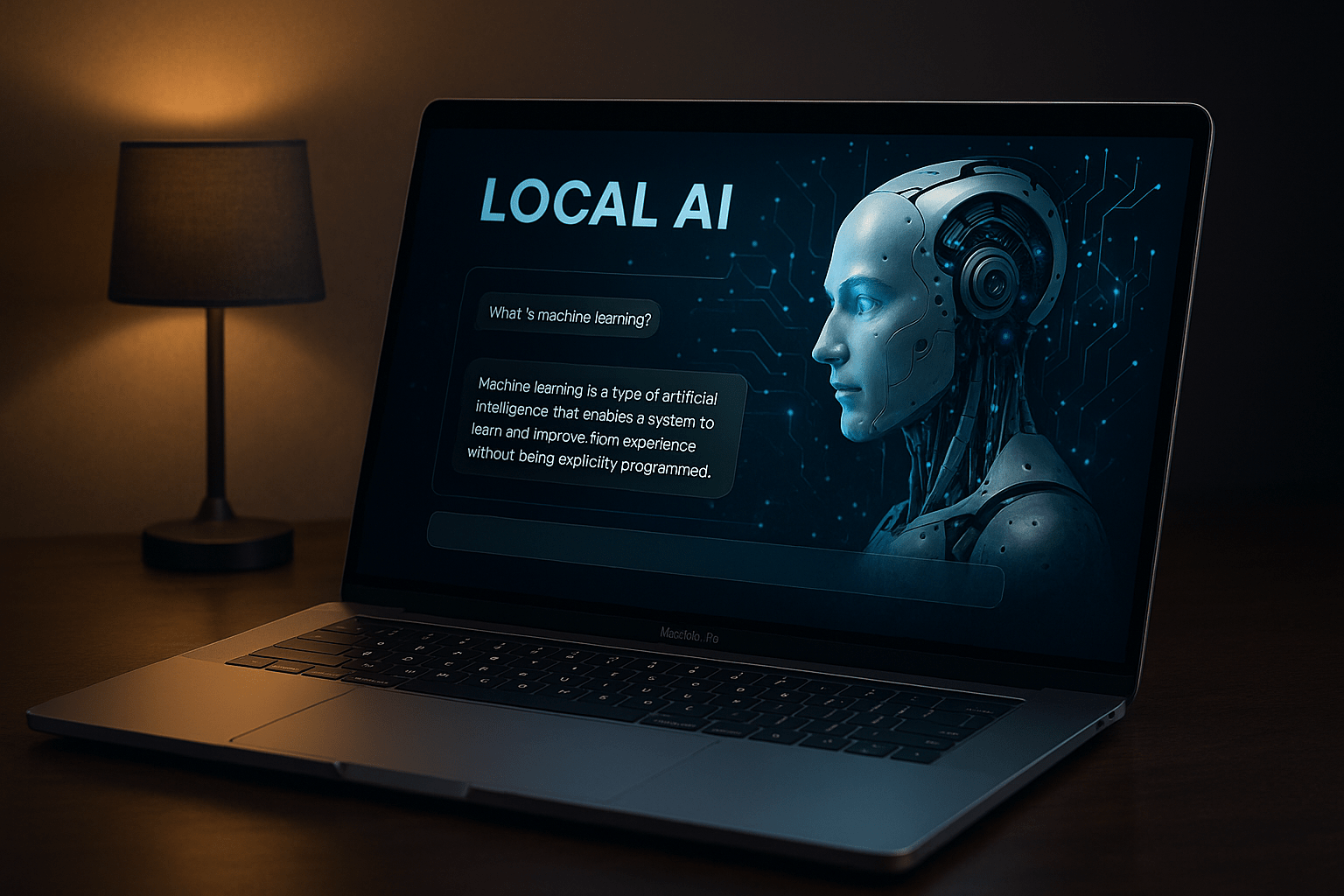

Lokale KI auf dem Mac ist längst praxistauglich – vor allem auf Apple-Silicon-Rechnern (M-Serie). Mit Ollama holen Sie sich eine schlanke Laufzeitumgebung für viele Open-Source-Sprachmodelle (z. B. Llama 3.1/3.2, Mistral, Gemma, Qwen). Mit der aktuellen Ollama-Version wird nun auch eine benutzerfreundliche App geliefert, mit der Sie per Mausklick ein lokales Sprachmodell auf Ihrem Mac einrichten können. In diesem Artikel finden Sie eine pragmatische Anleitung von der Installation bis zum ersten Prompt – mit Hinweisen aus der Praxis, wo Dinge traditionell gern schiefgehen.

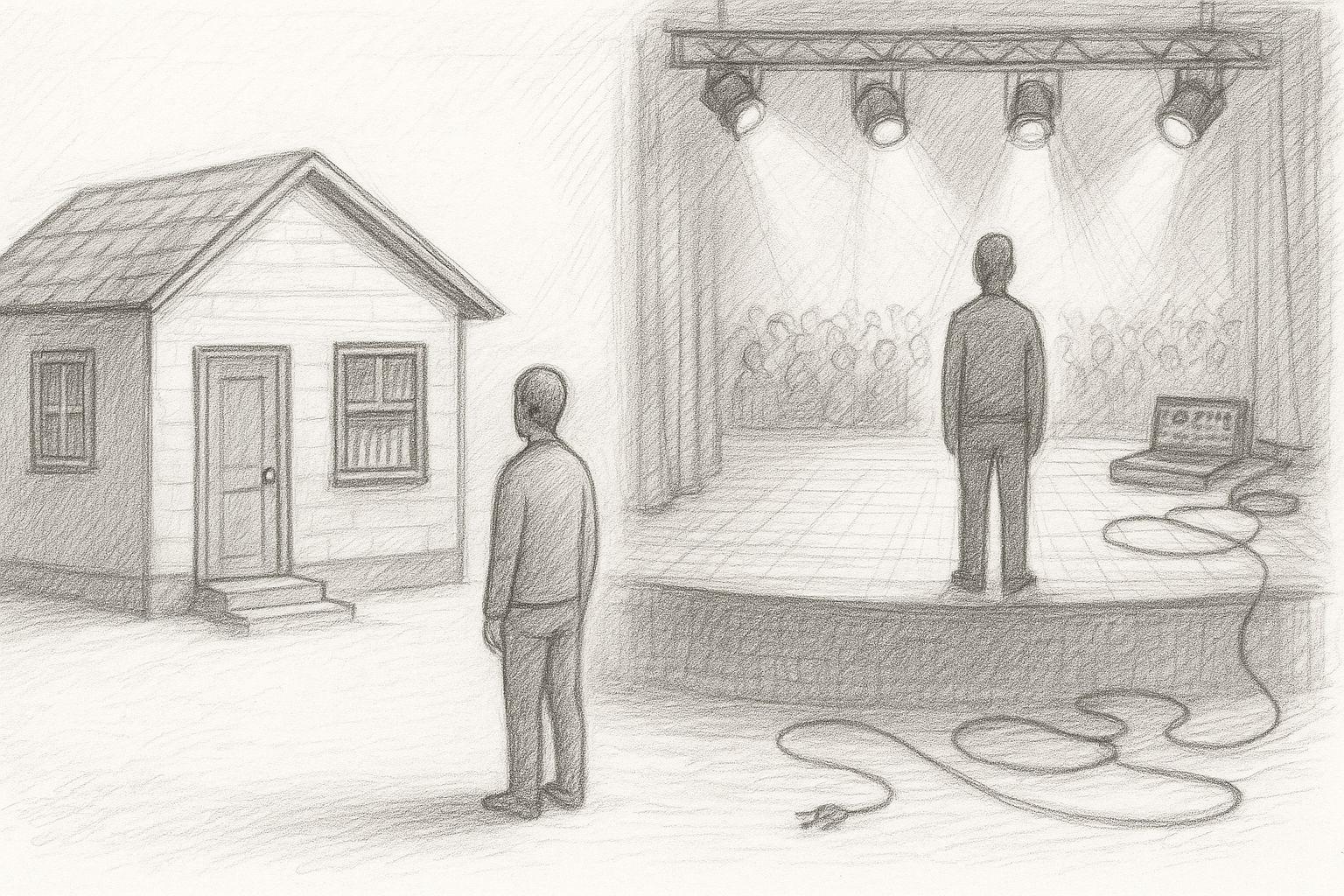

Vorteile lokaler KI gegenüber Cloudsystemen

Ein lokales Sprachmodell wie mit Ollama auf dem Mac bringt entscheidende Vorzüge mit sich, die vor allem für Unternehmen, Entwickler und Datenschutzbewusste schwer zu überbieten sind.

Datensouveränität & Datenschutz

Alle Anfragen und Antworten bleiben vollständig auf dem eigenen Rechner. Sensible Informationen – Kundendaten, interne Strategiepapiere oder medizinische Daten – verlassen niemals das lokale System. Es gibt keine Logfiles oder Analyse-Mechanismen eines Cloud-Anbieters, die versehentlich oder absichtlich ausgewertet werden könnten.

Keine Abhängigkeit von Drittdiensten

Cloudsysteme können Preismodelle ändern, Zugriffsbeschränkungen einführen oder einzelne Features abschalten. Mit einer lokalen Installation haben Sie die volle Kontrolle über Laufzeitumgebung, Versionen und Modellvarianten. Updates führen Sie durch, wenn Sie es wollen – nicht, wenn ein Anbieter es diktiert.

Kalkulierbare Kosten

Statt kontinuierlicher Gebühren pro Anfrage oder Monat investieren Sie einmalig in Hardware (z. B. einen Mac mit ausreichend RAM) und arbeiten dann unbegrenzt mit dem Modell. Für rechenintensive Aufgaben können Sie die Hardware gezielt ausbauen, ohne sich um steigende API-Rechnungen zu sorgen.

Offline-Fähigkeit

Ein lokales Modell funktioniert auch dann, wenn keine Internetverbindung verfügbar ist – etwa unterwegs, auf Baustellen oder in hochgesicherten Netzwerken ohne externen Zugang.

Hohe Flexibilität und Integration in bestehende Systeme

Ein weiterer Pluspunkt lokaler KI-Systeme ist die Integrationsfähigkeit. Da Ollama einen lokalen API-Serverbereitstellt, lassen sich nahezu beliebige Anwendungen anbinden – von einfachen Skripten bis zu komplexen ERP-Systemen.

FileMaker-Anbindung

Über die Ollama-API kann FileMaker mit wenigen Zeilen Scriptcode oder über MBS-Plugin-Aufrufe direkt Prompts an das Modell senden und Antworten in Feldern ablegen. Damit lassen sich automatisierte Textanalysen, Klassifikationen, Übersetzungen oder Inhaltszusammenfassungen vollständig innerhalb von FileMakerumsetzen – ohne Cloud-Latenz und ohne Datenschutzrisiken.

Automatisierte Workflows

Durch den lokalen API-Endpunkt können auch Tools wie Zapier, n8n oder individuelle Python-/Bash-Skripte eingebunden werden. So lassen sich komplexe Abläufe automatisieren, etwa das Extrahieren von Informationen aus E-Mails, das Generieren von Berichten oder das Erstellen von Textbausteinen für Dokumente.

Volle Kontrolle über Modellvarianten

Sie können mehrere Modelle parallel betreiben, zwischen ihnen wechseln oder spezielle Fach-Modelle laden, die optimal zu Ihrem Projekt passen. Anpassungen wie Fine-Tuning oder LoRA-Modelle lassen sich ebenfalls lokal ausführen.

Praxisvorteil: Reaktionsgeschwindigkeit und Latenz

Ein oft unterschätzter Faktor ist die Antwortgeschwindigkeit. Während Cloud-LLMs oft durch Netzwerkwege, API-Limits oder Serverlast verzögert werden, antworten lokale Modelle – je nach Hardware – nahezu in Echtzeit. Besonders bei wiederholten Aufgaben oder interaktiven Prozessen (z. B. während einer Präsentation oder einer Live-Datenanalyse in FileMaker) kann das den Unterschied zwischen „flüssiger Arbeit“ und „Wartefrust“ ausmachen.

Welche Hardware zur Ausführung lokaler Sprachmodelle geeignet ist, welche Modelle welche Vorzüge haben und einen Vergleich zwischen Apple Silicon und NVIDIA habe ich in einem separaten Artikel behandelt.

Aktuelle Umfrage zur Nutzung lokaler KI-Systeme

1) Voraussetzungen & Rahmenbedingungen

macOS 12 „Monterey“ oder neuer (empfohlen: aktuelles Sonoma/Sequoia). Offizieller macOS-Download setzt Monterey+ voraus. ollama.com

Apple Silicon (M1–M4) bevorzugt. Läuft auch auf Intel-Macs, aber Apple-Silicon ist deutlich effizienter; große Modelle brauchen viel RAM/Unified Memory. (Zur Bibliothek/Modellgrößen siehe die Ollama-Library.) ollama.com

Port 11434 wird lokal für die API genutzt. Merken Sie sich den Port – er ist später wichtig für Tests und Integrationen. GitHubollama.readthedocs.io

Skeptischer Hinweis in guter alter Tradition: „Installieren und los“ klappt meist – Engstellen sind RAM/Plattenplatz(große GGUF-Dateien), falsche Modellvariante oder Parallelprozesse, die den Port blockieren.

2) Ollama installieren (Mac)

Sie haben zwei saubere Wege – GUI-Installer oder Homebrew. Beides ist korrekt; wählen Sie den für Ihren Alltag passenden Stil.

VARIANTE A: OFFIZIELLER MACOS-INSTALLER (DMG)

Laden Sie Ollama für macOS von der offiziellen Seite.

DMG öffnen, App in „Programme“ ziehen, starten.

(Erfordert macOS 12+.) ollama.com

Wenn Sie diese Variante installieren, können Sie für das Herunterladen des Modells direkt die macOS Software nutzen. Alle folgenden Terminal-Befehle beziehen sich nur darauf, das Sprachmodell per Script automatisieren zu können.

VARIANTE B: HOMEBREW (CLI, SAUBER SKRIPTBAR)

Terminal öffnen und (falls nötig) Homebrew aktualisieren:

brew update

Cask (App-Variante) installieren:

brew install --cask ollama-app

(Zeigt i. d. R. die aktuelle Desktop-App; Stand heute 0.11.x.) Homebrew Formulae

Oder die Formula (CLI-Paket) installieren:

brew install ollama

(Binaries für Apple-Silicon/Intel verfügbar.) Homebrew Formulae

Version prüfen:

ollama --version

(Basiskommandos und Varianten sind in der offiziellen Doku & im GitHub-Repo dokumentiert.) GitHub

3) Dienst/Server starten und testen

Ollama bringt einen lokalen Server mit. Starten Sie ihn bei Bedarf explizit:

ollama serve

Läuft der Dienst bereits (z. B. durch die App), meldet die Shell ggf., dass Port 11434 in Benutzung ist – dann ist alles gut.

Der Server lauscht standardmäßig auf http://localhost:11434.

Funktionstest im Browser:

Rufen Sie http://localhost:11434/ auf – die Instanz sollte reagieren (einige Anleitungen nutzen diesen Check, weil der Port standardmäßig aktiv ist). Medium

Traditionelle Vorsicht: Wenn nichts antwortet, blockiert oft ein alter Prozess oder eine Security-Suite. Prüfen Sie, ob noch ein zweites Terminal mit ollama serve läuft – oder beenden/neu starten Sie die App.

4) Erstes Sprachmodell laden und nutzen

4.1 MODELL ZIEHEN (PULL) ODER DIREKT STARTEN (RUN)

Direkt nutzen (pull + run in einem):

ollama run llama3.1

Nur herunterladen:

ollama pull llama3.1

Das offizielle Repo zeigt die gängigen Befehle (run, pull, list, show, ps, stop, rm) und Beispiele u. a. mit Llama 3.2; sinngemäß identisch für Llama 3.1, Mistral, Gemma etc. GitHubnotes.kodekloud.comglukhov.org

Weitere Modellseiten / Bibliothek:

Llama 3 / 3.1 / 3.2 in verschiedenen Größen (1B–405B; natürlich sind die großen Varianten stark quantisiert erhältlich). Rufen Sie einfach die Website von Ollama auf, um weitere Modell zu finden und auf Ihrem Mac zu installieren.

4.2 INTERAKTIV CHATTEN (TERMINAL)

Starten Sie z. B. Llama 3.1 im Chatmodus:

ollama run llama3.1

Dann direkt tippen:

Du bist ein hilfsbereiter Assistent. Erkläre mir in zwei Sätzen, was ein Index in einer Datenbank ist.

Beenden mit Ctrl+D.

Wenn Sie die Ollama-App auf Ihrem Mac starten, können Sie auch direkt ein Modell auswählen und einen Prompt eingeben. Sollte das Modell noch nicht auf Ihrem Mac vorhanden sein, wird es automatisch heruntergeladen.

4.3 MODELLE VERWALTEN

# Welche Modelle sind lokal vorhanden?

ollama list

# Details/Quantisierung/Tags ansehen:

ollama show llama3.1

# Laufende Model-Prozesse prüfen:

ollama ps

# Laufendes Modell stoppen:

ollama stop llama3.1

# Platz freiräumen (Modell löschen):

ollama rm llama3.1

(Die Kommandos sind in mehreren aktuellen Übersichten gleichlautend dokumentiert.) notes.kodekloud.comGeshan’s Blogglukhov.org

5) HTTP-API lokal nutzen (z. B. für Skripte, Tools, Integrationen)

Ollama bietet eine REST-API (standardmäßig http://localhost:11434). Beispielaufrufe:

Generate (einfacher Prompt):

curl http://localhost:11434/api/generate -d '{

"model": "llama3.1",

"prompt": "Erkläre kurz den Unterschied zwischen RAM und SSD.",

"stream": false

}'

Chat (rollenbasiert):

curl http://localhost:11434/api/chat -d '{

"model": "llama3.1",

"messages": [

{ "role": "system", "content": "Du antwortest knapp und sachlich." },

{ "role": "user", "content": "Was ist eine Normalisierung in Datenbanken?" }

],

"stream": false

}'

(Endpoints, Streamingverhalten und Felder sind in der offiziellen API-Doku/GitHub beschrieben.)

Reachability-Hinweis:

Lokal ist alles per localhost erreichbar.

Soll der Mac im LAN erreichbar sein, binden Sie Ollama bewusst an eine Netzadresse, z. B.:

export OLLAMA_HOST=0.0.0.0 ollama serve

(Dann ist der Server über die IP im Netzwerk ansprechbar. Sicherheitsaspekt prüfen!) Reddit

Mixed-Content/HTTPS (nur, wenn Browser-Integrationen zicken):

Manche Add-ins/Browser (insb. Safari) blocken HTTP-Aufrufe aus HTTPS-Kontexten. In solchen Fällen hilft ein lokaler Reverse-Proxy mit HTTPS.

6) Praxis-Tipps für den Mac (Erfahrung & konservative Sorgfalt)

- Modellwahl konservativ beginnen: Starten Sie mit kleineren Quantisierungen (z. B. 4-bit-Varianten), prüfen Sie Qualität, dann langsam hochtasten.

- Speicher & Disk im Blick behalten: Große Modelle belegen mehrere GB – ollama show hilft bei der Einordnung. notes.kodekloud.com

- Apple-Silicon & Metal: Ollama nutzt auf dem Mac Apple-Beschleunigung (Metal). Bei sehr neuen Modell-Builds können Treiber/Metal-Fehler auftreten – halten Sie Ollama aktuell und behalten Sie bekannte Issues im Blick. GitHub

- Port-Konflikte: Wenn ollama serve meckert, lauscht die App oder ein anderer Prozess schon auf 11434 – entweder App schließen oder CLI-Server stoppen. postman.com

7) Häufige Minimal-Workflows (Copy & Paste)

A) Neuinstallation & erster Chat (Llama 3.1)

# Installation (eine Variante wählen) brew install --cask ollama-app # oder brew install ollama# Server starten (falls App nicht läuft) ollama serve # Erstes Modell testen ollama run llama3.1

(„run“ lädt das Modell, falls noch nicht vorhanden.) Homebrew Formulae+1GitHub

B) Modell offline vorbereiten (zuerst pull, später nutzen)

ollama pull mistral ollama show mistral ollama run mistral

(„mistral“ ist ein verbreitetes, kompaktes Modell – gut für erste Tests.)

C) API-Integration in ein Script/Tool

curl http://localhost:11434/api/generate -d ‚{

„model“: „llama3.1“,

„prompt“: „Gib mir drei konservative Gründe für Dokumentation vor Automatisierung.“

}‘

(API-Beispiele sind 1:1 der offiziellen Referenz entnommen.)

8) Wo finde ich Modelle?

Die Ollama-Library führt kuratierte Modelle mit Tags/Größen (Llama 3.1/3.2, Gemma, Qwen, u. a.). Wählen Sie bewusst nach Einsatzzweck (Chat, Tools, Embeddings) und Größe. Sie können neue Modelle direkt in der Ollama-App auf dem Mac oder auf der Website von Ollama finden.

9) Was tun, wenn’s hakt?

- ollama list / ollama ps prüfen: Ist das Wunschmodell vorhanden/aktiv?

- ollama show <modell> ansehen: Welche Quantisierung/Größe wurde geladen? Passt das zum Mac-RAM? notes.kodekloud.com

Updaten:

brew upgrade ollama ollama-app

Issues sichten: Gerade bei sehr neuen Modellen/Features tauchen vereinzelt Metal-Fehler auf; ein Update oder Wechsel der Modell-Variante hilft oft.

10) Alternativen mit Mac-Komfort (GUI)

Wenn Sie lieber eine grafische Oberfläche mit weiteren Optionen nutzen oder Modelle gern stöbern/wechseln:

LM Studio – ein beliebtes Mac-Frontend mit integriertem Downloader, Chat-UI und lokalem API-Server. Download-Seite & Release-Hinweise verlinkt. LM Studio+1Uptodown

(Es gibt außerdem Dritt-UIs wie Open WebUI, die sich an Ollama anbinden lassen – für die meisten Mac-Setups genügt aber Ollama + Terminal bzw. LM Studio.)

Mit Ollama richten Sie auf dem Mac in wenigen Minuten eine lokale LLM-Umgebung ein – klassisch, nachvollziehbar und ohne Cloud-Abhängigkeit. Halten Sie sich an die bewährten Schritte (Installer/Brew → ollama serve → ollama run), prüfen Sie Ressourcen, und arbeiten Sie sich vom Kleinen ins Große vor. Wenn Sie lieber klicken statt tippen, ist LM Studio eine solide Alternative auf dem Mac. ollama.comGitHubLM Studio

Viel Erfolg – und bleiben Sie kritisch mit System: Erst sauber dokumentieren, dann automatisieren.

Neue Artikelserie: ChatGPT-Datenexport als persönliches KI-Gedächtnis nutzen

Wer bereits eine lokale KI mit Ollama auf dem Mac installiert hat, kann den nächsten Schritt gehen: ein eigenes Wissenssystem aufbauen. In einer neuen Artikelserie zeige ich, wie sich der ChatGPT-Datenexport nutzen lässt, um eine persönliche Wissensdatenbank aufzubauen. Statt dass Gespräche im Chatverlauf verschwinden, können sie exportiert, strukturiert verarbeitet und in eine Vektordatenbank integriert werden. Dadurch entsteht eine KI, die auf die eigenen Gedanken, Ideen und Analysen zugreifen kann. Die Serie führt Schritt für Schritt durch den gesamten Prozess – vom Datenexport über Embeddings bis zur Integration in ein RAG-System. So wird aus einfachen Chatverläufen nach und nach ein digitales Gedächtnis für die eigene KI.

Wer bereits eine lokale KI mit Ollama auf dem Mac installiert hat, kann den nächsten Schritt gehen: ein eigenes Wissenssystem aufbauen. In einer neuen Artikelserie zeige ich, wie sich der ChatGPT-Datenexport nutzen lässt, um eine persönliche Wissensdatenbank aufzubauen. Statt dass Gespräche im Chatverlauf verschwinden, können sie exportiert, strukturiert verarbeitet und in eine Vektordatenbank integriert werden. Dadurch entsteht eine KI, die auf die eigenen Gedanken, Ideen und Analysen zugreifen kann. Die Serie führt Schritt für Schritt durch den gesamten Prozess – vom Datenexport über Embeddings bis zur Integration in ein RAG-System. So wird aus einfachen Chatverläufen nach und nach ein digitales Gedächtnis für die eigene KI.

Häufig gestellte Fragen

- Was bedeutet eigentlich „lokale KI“ – und warum sollte ich ein Sprachmodell auf meinem eigenen Mac betreiben?

Lokale KI bedeutet, dass ein Sprachmodell vollständig auf Deinem eigenen Computer läuft, statt über eine Internetverbindung auf fremde Server zuzugreifen. Das Modell wird lokal installiert und verarbeitet Deine Eingaben direkt auf Deinem Gerät. Der Vorteil liegt vor allem in Datenschutz, Kontrolle und Unabhängigkeit: Deine Daten verlassen den Rechner nicht, es gibt keine API-Kosten und keine Abhängigkeit von Cloud-Anbietern. Gleichzeitig kannst Du das System an eigene Bedürfnisse anpassen, eigene Daten integrieren oder sogar eigene Workflows entwickeln. Für viele Anwender – etwa Entwickler, Autoren oder Unternehmen mit sensiblen Daten – ist eine lokale KI deshalb eine besonders interessante Alternative zu Cloud-Diensten. - Welche Vorteile bietet Ollama im Vergleich zu anderen Tools für lokale Sprachmodelle?

Ollama hat sich in kurzer Zeit zu einem der beliebtesten Werkzeuge für lokale KI entwickelt, weil es viele komplexe Schritte stark vereinfacht. Statt Modelle manuell herunterzuladen, zu konfigurieren und zu starten, übernimmt Ollama diese Aufgaben weitgehend automatisch. Ein Sprachmodell lässt sich meist mit einem einzigen Befehl installieren und starten. Außerdem bietet Ollama eine REST-API, sodass sich Modelle problemlos in eigene Programme integrieren lassen – etwa in Skripte, Datenbanken oder Anwendungen. Dadurch eignet sich Ollama sowohl für Einsteiger, die schnell ein Modell ausprobieren möchten, als auch für Entwickler, die lokale KI in eigene Softwareprojekte einbauen wollen. - Welche Voraussetzungen muss mein Mac erfüllen, um ein Sprachmodell lokal auszuführen?

Für ein gutes Ergebnis empfiehlt sich ein Mac mit Apple-Silicon-Prozessor (M1, M2, M3 oder neuer). Diese Chips verfügen über eine Architektur, die besonders gut für KI-Berechnungen geeignet ist, etwa durch gemeinsame Speicherstrukturen und GPU-Beschleunigung. Wichtig sind außerdem ausreichend Arbeitsspeicher und genügend freier Speicherplatz, da Sprachmodelle mehrere Gigabyte groß sein können. Kleinere Modelle funktionieren bereits auf Geräten mit moderatem Speicher, während größere Modelle deutlich mehr RAM benötigen. Auch eine aktuelle macOS-Version ist sinnvoll, da viele KI-Tools für moderne Systembibliotheken optimiert sind. - Welche Sprachmodelle kann ich mit Ollama auf meinem Mac nutzen?

Ollama unterstützt eine Reihe moderner Open-Source-Sprachmodelle. Dazu gehören beispielsweise Varianten von Llama, Mistral, Gemma oder Qwen. Diese Modelle unterscheiden sich in Größe, Leistungsfähigkeit und Stil. Manche sind eher kompakt und laufen schnell auf kleineren Rechnern, andere sind größer und liefern komplexere Antworten. Der große Vorteil: Du kannst relativ einfach verschiedene Modelle ausprobieren und vergleichen, ohne Deine Infrastruktur neu aufbauen zu müssen. Dadurch entsteht eine flexible Umgebung, in der Du das Modell auswählen kannst, das am besten zu Deinen Aufgaben passt. - Wie kompliziert ist die Installation eines lokalen Sprachmodells mit Ollama wirklich?

Die Installation ist deutlich einfacher geworden als noch vor wenigen Jahren. In vielen Fällen besteht der Prozess aus wenigen Schritten: Zunächst installierst Du Ollama auf Deinem Mac, danach lädst Du ein Sprachmodell herunter und startest es über das Terminal oder eine grafische Oberfläche. Das Modell wird automatisch vorbereitet und kann anschließend direkt verwendet werden. Viele Nutzer sind überrascht, wie schnell dieser Prozess funktioniert. Selbst ohne tiefes technisches Wissen ist es möglich, innerhalb weniger Minuten ein funktionierendes lokales KI-System aufzusetzen. - Warum läuft lokale KI besonders gut auf Apple-Silicon-Macs?

Apple-Silicon-Prozessoren wurden mit Blick auf moderne Rechenaufgaben entwickelt, darunter auch maschinelles Lernen. Sie nutzen eine sogenannte Unified-Memory-Architektur, bei der CPU, GPU und andere Recheneinheiten denselben Speicher verwenden. Dadurch lassen sich große Datenmengen effizienter verarbeiten. Für KI-Modelle ist das ein großer Vorteil, weil Sprachmodelle während der Inferenz ständig auf große Datenstrukturen zugreifen müssen. Tools wie Ollama oder MLX nutzen diese Architektur gezielt aus und erreichen dadurch eine überraschend gute Leistung – selbst ohne dedizierte Grafikkarte. - Wie schnell arbeitet ein lokales Sprachmodell auf einem Mac?

Die Geschwindigkeit hängt vor allem von drei Faktoren ab: dem verwendeten Modell, dem Arbeitsspeicher des Macs und der Prozessorleistung. Kleine Modelle reagieren oft nahezu in Echtzeit, während größere Modelle langsamer arbeiten können. Apple-Silicon-Macs sind jedoch erstaunlich leistungsfähig und können viele gängige Modelle problemlos ausführen. Für experimentelle Projekte oder persönliche Arbeitsprozesse ist die Leistung in der Regel mehr als ausreichend. Wer besonders schnelle Antworten benötigt, kann kleinere oder stärker komprimierte Modelle verwenden. - Kann ich mit einer lokalen KI auch offline arbeiten?

Ja, genau das ist einer der größten Vorteile. Sobald das Modell einmal heruntergeladen wurde, benötigt es keine Internetverbindung mehr. Alle Berechnungen finden direkt auf Deinem Mac statt. Dadurch kannst Du die KI auch unterwegs, ohne Netzwerk oder in abgeschotteten Umgebungen verwenden. Für viele professionelle Anwendungen – etwa bei sensiblen Dokumenten oder internen Analysen – ist diese Offline-Fähigkeit ein entscheidender Vorteil. - Wie sicher sind meine Daten, wenn ich ein Sprachmodell lokal betreibe?

Wenn das Modell vollständig lokal läuft, bleiben Deine Daten grundsätzlich auf Deinem Rechner. Es findet keine automatische Übertragung an externe Server statt. Dadurch kannst Du mit vertraulichen Texten arbeiten, ohne Dir Sorgen über Cloud-Speicherung oder fremde Zugriffe machen zu müssen. Natürlich hängt die Sicherheit weiterhin davon ab, wie Dein System konfiguriert ist – etwa ob andere Programme Zugriff auf Deine Daten haben. Aber grundsätzlich bietet eine lokale KI deutlich mehr Kontrolle über die eigenen Informationen. - Kann ich ein lokales Sprachmodell mit eigenen Daten trainieren oder erweitern?

Ja, das ist möglich – allerdings meist nicht direkt über das Basissystem. Viele Anwender kombinieren lokale Sprachmodelle mit sogenannten RAG-Systemen oder Datenbanken, um eigene Inhalte einzubinden. Dabei werden Dokumente oder Texte analysiert und in einer Vektordatenbank gespeichert. Das Sprachmodell kann später auf diese Inhalte zugreifen und sie in seine Antworten einbeziehen. Auf diese Weise lässt sich eine KI auf eigene Wissensbestände spezialisieren, ohne das Modell selbst vollständig neu zu trainieren. - Was ist der Unterschied zwischen einem Sprachmodell und einer KI-App wie ChatGPT?

Ein Sprachmodell ist im Grunde nur der „Motor“ der KI – also das neuronale Netz, das Texte analysiert und generiert. Dienste wie ChatGPT sind hingegen komplette Plattformen, die ein Modell mit Benutzeroberfläche, Cloud-Infrastruktur und zusätzlichen Funktionen kombinieren. Wenn Du ein Sprachmodell lokal installierst, arbeitest Du direkt mit diesem Kernsystem. Dadurch hast Du mehr Kontrolle, musst aber auch selbst entscheiden, welche Tools oder Schnittstellen Du zusätzlich einsetzen möchtest. - Wie viel Speicherplatz benötigt ein lokales Sprachmodell auf dem Mac?

Die Größe eines Sprachmodells kann stark variieren. Kleine Modelle benötigen nur wenige Gigabyte Speicher, während größere Varianten deutlich mehr Platz beanspruchen können. Zusätzlich wird Arbeitsspeicher benötigt, um das Modell während der Ausführung zu laden. Für viele praktische Anwendungen reichen jedoch bereits kompakte Modelle, die relativ wenig Speicher verbrauchen und dennoch erstaunlich leistungsfähig sind. - Kann ich mehrere Modelle gleichzeitig auf meinem Mac installieren?

Ja, das ist sogar ein großer Vorteil lokaler KI-Umgebungen. Du kannst mehrere Modelle herunterladen und je nach Bedarf starten. Manche eignen sich besser für kreative Texte, andere für technische Analysen oder Programmcode. Durch diese Flexibilität kannst Du Deine KI-Umgebung wie einen Werkzeugkasten nutzen und jeweils das Modell wählen, das am besten zur Aufgabe passt. - Lässt sich Ollama auch in eigene Programme integrieren?

Ja, Ollama bietet eine Programmierschnittstelle (API), über die andere Anwendungen auf das Sprachmodell zugreifen können. Dadurch kannst Du lokale KI in eigene Projekte einbauen – etwa in Skripte, Automationen oder Datenbanksysteme. Entwickler nutzen diese Möglichkeit häufig, um individuelle KI-Assistenten zu erstellen oder bestehende Software um intelligente Funktionen zu erweitern. - Ist ein lokales Sprachmodell genauso leistungsfähig wie große Cloud-Modelle?

In vielen Fällen nicht ganz – zumindest wenn man sehr große Modelle mit Milliarden Parametern vergleicht. Cloud-Anbieter betreiben extrem leistungsfähige Hardware und können dadurch sehr große Modelle ausführen. Lokale Modelle sind oft kompakter, damit sie auf einem normalen Rechner laufen. Trotzdem sind sie für viele praktische Aufgaben erstaunlich leistungsfähig und können Texte schreiben, analysieren oder strukturieren. Für viele Arbeitsprozesse ist diese Leistung völlig ausreichend. - Warum interessieren sich immer mehr Menschen für lokale KI statt Cloud-Dienste?

Ein wichtiger Grund ist die Kontrolle über Daten und Infrastruktur. Viele Nutzer möchten ihre Inhalte nicht dauerhaft an externe Dienste übertragen. Außerdem können lokale Systeme langfristig günstiger sein, weil keine laufenden API-Kosten entstehen. Für Entwickler und technikaffine Anwender kommt ein weiterer Vorteil hinzu: Sie können ihre KI-Umgebung vollständig selbst gestalten und experimentieren. Dadurch entsteht eine neue Form von technischer Souveränität. - Kann ich eine lokale KI später mit anderen Systemen kombinieren?

Ja, das ist sogar eine der spannendsten Möglichkeiten. Lokale Sprachmodelle lassen sich mit Datenbanken, Automationsplattformen oder eigenen Programmen verbinden. Dadurch können komplexe Workflows entstehen – etwa Systeme, die Dokumente analysieren, Inhalte zusammenfassen oder Wissen aus eigenen Datenbeständen abrufen. Solche Kombinationen bilden oft die Grundlage für individuelle KI-Assistenten oder automatisierte Analysewerkzeuge. - Für wen lohnt sich eine lokale KI auf dem Mac besonders?

Besonders interessant ist sie für Entwickler, Autoren, Analysten und Unternehmen, die regelmäßig mit Texten oder Daten arbeiten. Auch für technikaffine Nutzer, die ihre digitale Infrastruktur selbst kontrollieren möchten, ist eine lokale KI eine spannende Option. Sie ermöglicht es, moderne KI-Technologie ohne Abhängigkeit von großen Plattformen zu nutzen. Gerade auf leistungsfähigen Macs entsteht dadurch eine Umgebung, die überraschend vielseitig und produktiv sein kann.