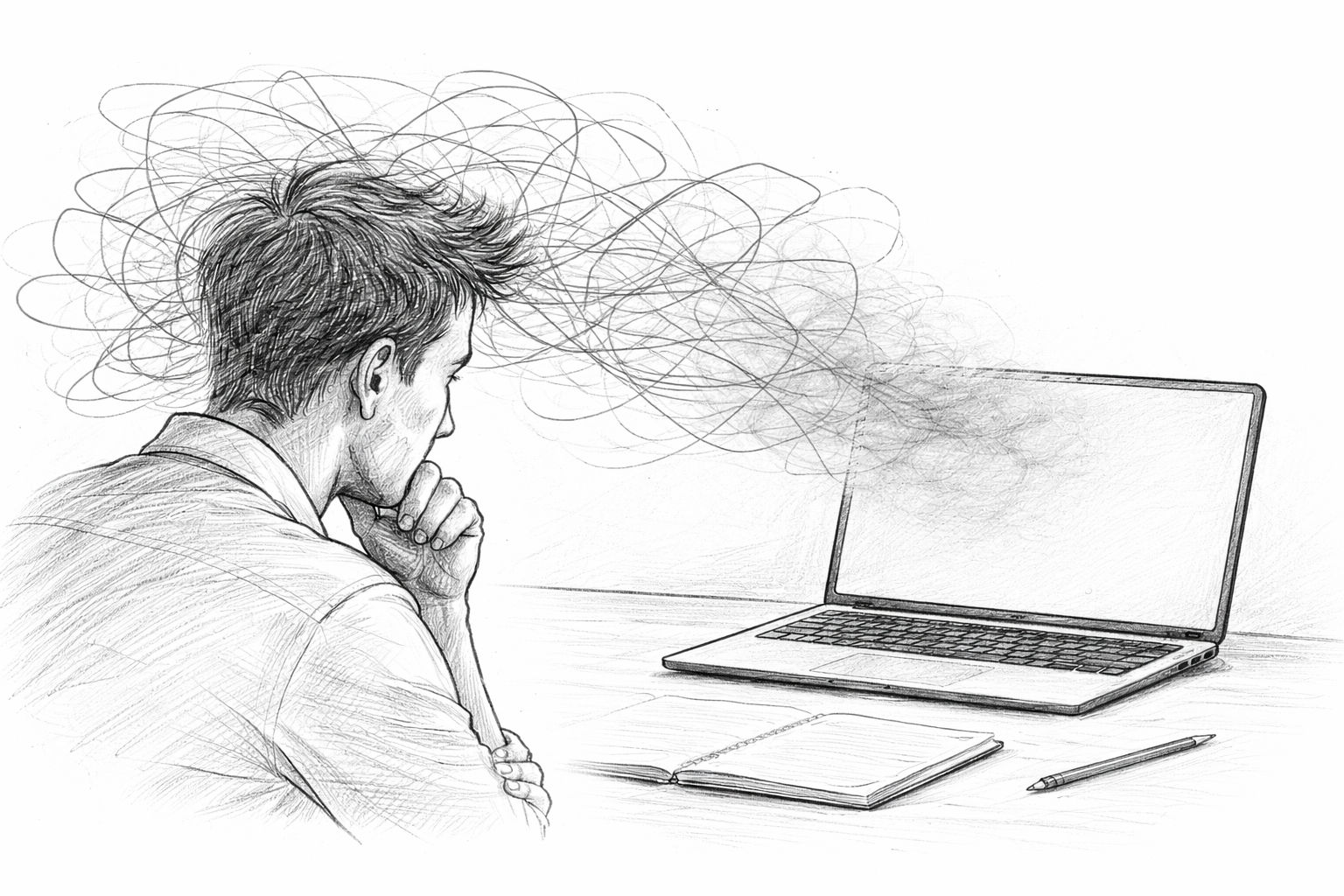

Der Begriff „KI als Sparringspartner“ taucht inzwischen häufig auf. Meist ist damit gemeint, dass eine KI beim Schreiben hilft, Ideen generiert oder Aufgaben schneller erledigt. Ein erster Grundlagenartikel dazu wurde bereits im Magazin veröffentlicht. Dieser Artikel soll nun in der Realität zeigen, wie man KI als effektiven Denkpartner einsetzen kann. In der Praxis zeigt sich: Eine KI wird erst dann wirklich interessant, wenn man sie nicht wie ein Werkzeug behandelt, sondern wie ein Gegenüber. Nicht im menschlichen Sinn, sondern als etwas, das antwortet, widerspricht, weiterführt – oder auch gnadenlos offenlegt, wo das eigene Denken unsauber ist.

Genau an diesem Punkt beginnt der eigentliche Nutzen. Nicht dort, wo die KI „liefert“, sondern dort, wo sie reagiert. Wo sie nicht einfach abarbeitet, sondern Denkbewegungen sichtbar macht. Das ist unbequemer als ein klassisches Tool – aber auch nachhaltiger.

Meine eigene Praxis: viel KI, wenig Tools

Ich arbeite selbst sehr viel mit KI, weil ich damit gefühlt fünf bis zehnmal so effektiv meist bessere Ergebnisse erzielen kann. Mehrere Stunden täglich, über viele Monate hinweg. Und gerade deshalb ist mein Setup erstaunlich unspektakulär. Ich nutze keine ausgefeilten Prompt-Frameworks, keine spezialisierten Oberflächen, keine automatisierten Workflows. Im Kern arbeite ich fast ausschließlich mit einem ganz normalen Chatfenster.

Was sich allerdings ändert, ist nicht das Werkzeug, sondern das Modell – je nach Aufgabe. Zum Reflektieren, Strukturieren, Denken in Schleifen eignet sich ein Modell besser als ein anderes. Beim Programmieren kann ein anderes sinnvoller sein, beim Analysieren oder Gegenlesen wieder ein anderes. Das ist keine ideologische Frage, sondern eine pragmatische.

Der entscheidende Punkt ist aber: Das Arbeitsprinzip bleibt immer gleich.

Ich spreche mit der KI. Ich denke laut. Ich präzisiere. Ich korrigiere. Ich widerspreche. Ich lasse mir Widersprüche spiegeln. Der Mehrwert entsteht nicht durch Spezialfunktionen, sondern durch den Dialog selbst.

Vom Einstieg zur Vertiefung: KI als Denkpartner verstehen

Bevor es um Denkdisziplin, Reife und strukturiertes Fragen geht, lohnt sich ein Blick auf die Grundlagen. Im einführenden Artikel „KI als Sparringspartner“ wird zunächst praktisch beschrieben, wie KI im Alltag eingesetzt werden kann – als strategischer Berater, kreativer Ideengeber oder strukturierender Gesprächspartner. Der Fokus liegt dort weniger auf Theorie als auf konkreten Anwendungsfeldern. Wer neu einsteigt oder sich einen Überblick verschaffen möchte, findet in diesem Text einen klaren, zugänglichen Startpunkt – bevor die vertiefende Auseinandersetzung mit Haltung und Denkweise beginnt.

Bevor es um Denkdisziplin, Reife und strukturiertes Fragen geht, lohnt sich ein Blick auf die Grundlagen. Im einführenden Artikel „KI als Sparringspartner“ wird zunächst praktisch beschrieben, wie KI im Alltag eingesetzt werden kann – als strategischer Berater, kreativer Ideengeber oder strukturierender Gesprächspartner. Der Fokus liegt dort weniger auf Theorie als auf konkreten Anwendungsfeldern. Wer neu einsteigt oder sich einen Überblick verschaffen möchte, findet in diesem Text einen klaren, zugänglichen Startpunkt – bevor die vertiefende Auseinandersetzung mit Haltung und Denkweise beginnt.

Warum der reine Chat unterschätzt wird

Viele Nutzer suchen früh nach Abkürzungen: besseren Prompts, besseren Tools, besseren Modellen. Das ist verständlich – und oft auch sinnvoll. Aber es verdeckt eine unbequeme Wahrheit: Der größte Hebel liegt nicht in der Technik, sondern im Denken des Nutzers.

Der reine Chat ist deshalb so wirkungsvoll, weil er nichts kaschiert. Er zwingt dazu, Gedanken in Sprache zu überführen. Er macht Unklarheiten sichtbar. Er reagiert exakt auf das, was man formuliert – nicht auf das, was man „eigentlich meint“.

- Wer unscharf denkt, bekommt unscharfe Antworten.

- Wer widersprüchlich fragt, erhält widersprüchliche Ergebnisse.

Und wer glaubt, die KI müsse schon „wissen, was gemeint ist“, lernt sehr schnell, wie trügerisch diese Annahme ist.

Künstliche Intelligenz als Spiegel, nicht als Orakel

In vielen Diskussionen wird KI noch immer wie eine Art Orakel behandelt: Man fragt, man bekommt eine Antwort, man bewertet sie als richtig oder falsch. Als Sparringspartner funktioniert KI jedoch völlig anders. Sie beantwortet nicht nur Fragen – sie reagiert auf Denkbewegungen.

Das macht sie wertvoll. Und gleichzeitig entlarvend.

Denn sie ersetzt kein Denken, keine Reife, keine Erfahrung. Sie legt lediglich offen, was vorhanden ist – und was nicht. Wer strukturiert denkt, profitiert. Wer Abkürzungen sucht, stößt schnell an Grenzen.

In diesem Sinne ist KI kein Fortschrittsgarant. Sie ist ein Verstärker. Für Klarheit ebenso wie für Unklarheit.

Warum dieser Artikel praxisnäher ansetzt

Der vorherige Text zum Thema „KI als Sparringspartner“ war bewusst grundlegend gehalten. Dieser Artikel geht einen Schritt weiter – weg von der Einordnung, hin zur Praxis. Nicht im Sinne von „So machst du es richtig“, sondern im Sinne von Beobachtungen, Mustern und Denkfallen. Es geht um Fragen wie:

- Warum verändern sich KI-Dialoge mit der Zeit?

- Weshalb sind gute Fragen wichtiger als gute Modelle?

- Und warum empfinden viele Nutzer KI irgendwann als „enttäuschend“, während andere immer tiefer einsteigen?

Die zentrale These lautet: KI ist kein Ersatz für Denken – aber ein hervorragendes Trainingsgerät dafür. Vorausgesetzt, man ist bereit, sich selbst dabei zuzusehen.

Von hier aus lohnt sich der Blick auf das Fundament jeder Interaktion: die Frage selbst. Denn dort entscheidet sich, ob ein Dialog entsteht – oder nur eine weitere beliebige Antwort.

Schlechte Fragen, schlechte Ergebnisse – ein unbequemes Grundgesetz

Eine schlechte Frage ist selten dumm. Sie ist meist unscharf. Und Unscharfe haben die unangenehme Eigenschaft, dass sie erst einmal harmlos wirken. In der Arbeit mit KI fallen sie jedoch sofort auf – nicht, weil die KI sie kritisiert, sondern weil die Antworten diffus bleiben. Typische Merkmale schlechter Fragen sind:

- ein unklarer Zweck („Ich will mal schauen, was dabei rauskommt“),

- mehrere Themen in einer Frage,

- implizite Annahmen, die nicht ausgesprochen werden,

- oder der verdeckte Wunsch nach Bestätigung statt nach Erkenntnis.

Das Entscheidende dabei: Die KI macht diese Schwächen nicht wett. Sie gleicht sie auch nicht aus. Sie arbeitet exakt mit dem Material, das man ihr gibt. Und genau deshalb wirkt sie auf viele Nutzer zunächst enttäuschend – obwohl sie in Wahrheit nur konsequent ist.

Typische Muster aus der Praxis

In der täglichen Arbeit begegnen einem bestimmte Fragestellungen immer wieder. Sie klingen auf den ersten Blick sinnvoll, führen aber fast zwangsläufig zu mittelmäßigen Ergebnissen. Ein Klassiker ist die offene, aber ziellose Frage:

„Schreib mir mal etwas zu …“

Hier fehlt nicht nur der Kontext, sondern auch die Entscheidung, wofür der Text gebraucht wird, wer ihn lesen soll und was er leisten soll. Die KI antwortet folgerichtig allgemein. Ein anderes Muster ist der implizite Anspruch:

„Sag mir, was richtig ist.“

Das ist weniger eine Frage als eine Delegation von Verantwortung. Die KI kann Perspektiven liefern, Argumente abwägen, Zusammenhänge erklären – aber sie kann keine Reife ersetzen. Wer so fragt, bekommt oft Antworten, die sich richtig anfühlen, aber nicht tragen. Ebenso verbreitet:

„Mach das besser.“

Besser als was? Nach welchen Kriterien? Für welchen Zweck? Ohne diese Klärung bleibt „besser“ eine leere Hülle – und die Antwort entsprechend beliebig.

Warum KI hier gnadenlos ist

Im Unterschied zu menschlichen Gesprächspartnern ist KI höflich, aber nicht ausgleichend. Sie springt nicht ein, wenn etwas fehlt. Sie fragt nicht automatisch nach, wenn Ziele unklar sind. Sie interpretiert nicht wohlwollend, was man gemeint haben könnte.

Das wirkt auf manche Nutzer kalt oder mechanisch. Tatsächlich ist es eine Stärke. Denn genau dadurch entsteht Transparenz. Die KI zeigt sehr schnell, wo Denkprozesse abgekürzt wurden, wo Entscheidungen noch gar nicht getroffen sind oder wo man sich selbst etwas vormacht.

Man könnte sagen: Die KI ist nicht unhöflich – sie ist präzise.

Wenn Antworten beliebig wirken

Ein häufiger Vorwurf lautet: „Die KI schreibt immer das Gleiche.“ In vielen Fällen stimmt das – aber nicht aus dem vermuteten Grund. Nicht das Modell ist austauschbar, sondern die Frage.

- Wer allgemein fragt, bekommt Allgemeines.

- Wer keine Position bezieht, bekommt Ausgleich.

- Wer keine Richtung vorgibt, bekommt Mittelmaß.

Die KI liefert dann Texte, die sprachlich korrekt, aber inhaltlich leer wirken. Das wird gern dem System angelastet. In Wahrheit zeigt sich hier ein strukturelles Problem: Ohne gedankliche Vorarbeit kann auch die beste KI nichts Substanzielles leisten.

Schlechte Fragen sind oft ein Selbstschutz

Ein unbequemer Gedanke: Schlechte Fragen sind nicht immer Zufall. Häufig schützen sie vor Klarheit. Denn Klarheit hat Konsequenzen. Wer präzise fragt, zwingt sich selbst, Position zu beziehen, Ziele zu benennen und Prioritäten festzulegen.

Eine vage Frage erlaubt es, sich hinterher nicht festlegen zu müssen. Man kann die Antwort übernehmen oder verwerfen, ohne sich selbst infrage zu stellen. Die KI wird so zum Lieferanten – nicht zum Sparringspartner. Doch genau hier verschenkt man Potenzial.

Das Grundgesetz im Umgang mit KI

Am Ende lässt sich das Ganze auf ein einfaches, unbequemes Grundgesetz reduzieren:

Die Qualität der Antwort folgt der Qualität der Frage.

Nicht linear, sondern konsequent. Nicht sofort sichtbar, aber zuverlässig. Wer beginnt, das ernst zu nehmen, ändert seinen Umgang mit KI grundlegend. Die Frage wird nicht mehr als Mittel zum Zweck verstanden, sondern als Teil des Denkprozesses selbst. Und genau an diesem Punkt beginnt der Übergang von der bloßen Nutzung hin zum echten Dialog.

Im nächsten Schritt lohnt es sich daher, genauer hinzusehen: Was macht eine gute Frage eigentlich aus – und warum ist sie fast immer das Ergebnis von bereits geleisteter Denkarbeit?

Gute Fragen sind strukturierte Gedanken

Eine weitverbreitete Annahme lautet: Gute Fragen sind eine Frage der richtigen Formulierung. Ein bisschen Feinschliff, ein paar präzisere Wörter – und schon wird aus einer mittelmäßigen Anfrage eine gute. In der Praxis zeigt sich jedoch etwas anderes: Gute Fragen entstehen selten spontan. Sie sind fast immer das Ergebnis von Vorarbeit.

Bevor eine gute Frage gestellt werden kann, ist im Kopf bereits etwas passiert. Eine Unterscheidung wurde getroffen, ein Ziel zumindest grob definiert, ein Problem eingegrenzt. Die Frage ist dann nicht der Anfang des Denkens, sondern dessen sichtbarer Ausdruck. Wer versucht, das Denken an die KI auszulagern, merkt schnell, dass genau diese Vorarbeit fehlt – und dass sie sich nicht überspringen lässt.

In diesem Sinne ist eine gute Frage kein Trick, sondern ein Nebenprodukt von Klarheit.

Denken vor dem Prompt

Wer mit KI arbeitet, entwickelt mit der Zeit ein Gefühl dafür, wann ein Prompt „noch nicht reif“ ist. Das äußert sich oft als inneres Zögern: Man tippt etwas ein, löscht es wieder, formuliert um. Nicht, weil die Worte fehlen, sondern weil der Gedanke selbst noch nicht steht.

Dieses Zögern ist kein Hindernis, sondern ein Signal. Es zeigt an, dass das eigentliche Denken noch nicht abgeschlossen ist. Wer an dieser Stelle trotzdem fragt, bekommt zwar eine Antwort – aber sie bleibt zwangsläufig oberflächlich. Die KI reagiert korrekt, aber nicht tief. Erst wenn klar ist:

- Worum es wirklich geht,

- warum diese Frage jetzt relevant ist,

- und was mit der Antwort geschehen soll,

entsteht eine Frage, die den Dialog trägt. Alles andere ist Vorrede.

Merkmale guter Fragen

Gute Fragen haben bestimmte Eigenschaften. Nicht als Checkliste, sondern als wiederkehrende Muster. Sie schaffen Kontext. Die KI weiß, in welchem Rahmen sie antwortet, welche Perspektive eingenommen werden soll und was bereits bekannt ist.

- Sie benennen ein Ziel. Nicht zwingend ein Ergebnis, aber eine Richtung.

- Sie setzen Grenzen. Was ist nicht gemeint? Welche Aspekte sind bewusst ausgeklammert?

- Und sie lassen Offenheit zu. Sie sind keine verkappten Anweisungen, sondern echte Suchbewegungen.

Auffällig ist: Gute Fragen wirken oft länger und umständlicher als schlechte. Nicht, weil sie komplizierter sind, sondern weil sie präziser sind. Sie tragen die gedankliche Arbeit bereits in sich.

Praxisbeispiel: von schlecht zu tragfähig

Ein einfaches Beispiel verdeutlicht den Unterschied. Eine schlechte Frage könnte lauten:

„Schreib mir einen Text über KI und Denken.“

Die Antwort darauf wird zwangsläufig allgemein bleiben. Die KI weiß weder, für wen der Text gedacht ist, noch, welche Haltung eingenommen werden soll oder welchen Zweck er erfüllt. Eine bessere Variante wäre:

„Schreib mir einen sachlichen Artikel darüber, wie KI beim Denken helfen kann.“

Das ist bereits eingegrenzt, bleibt aber vage. Wie helfen? Wem helfen? In welchem Kontext? Eine gute Frage könnte schließlich so aussehen:

„Ich möchte einen ruhigen, nicht-technischen Artikel für erfahrene Leser schreiben, in dem KI nicht als Lösung, sondern als Spiegel des eigenen Denkens beschrieben wird. Welche zentralen Argumentationslinien eignen sich dafür – und wo liegen typische Missverständnisse?“

Hier ist das Denken bereits sichtbar. Die KI kann anschließen, vertiefen, widersprechen, strukturieren. Nicht, weil sie klüger wäre, sondern weil sie nun weiß, woran sie andocken soll.

Warum gute Fragen anstrengend sind

Gute Fragen kosten Energie. Sie verlangen Entscheidungen, bevor überhaupt eine Antwort vorliegt. Man muss sich festlegen, ohne schon zu wissen, ob man richtig liegt. Genau deshalb werden sie oft vermieden.

Schlechte Fragen sind bequem. Sie lassen alle Optionen offen. Gute Fragen hingegen schließen Möglichkeiten aus. Sie zwingen zur Positionierung. Und genau darin liegt ihr Wert.

In der Arbeit mit KI wird dieser Unterschied besonders deutlich. Die KI akzeptiert beides – schlechte wie gute Fragen. Aber sie belohnt nur eine davon.

Die eigentliche Leistung liegt vor der Antwort

Wer KI als Sparringspartner nutzt, verlagert den Fokus. Nicht mehr die Antwort steht im Zentrum, sondern der Weg dorthin. Die Frage wird zum Denkwerkzeug. Sie hilft, Ordnung zu schaffen, bevor externe Perspektiven hinzukommen. In diesem Sinne ist eine gute Frage keine Bitte an die KI. Sie ist eine Selbstklärung, die anschließend gespiegelt wird. Die Antwort ist dann nicht mehr der Abschluss, sondern der nächste Schritt im Denkprozess.

Und genau hier beginnt sich der Dialog zu verändern – nicht abrupt, sondern schleichend. Wie sich dieser Wandel vollzieht und warum er Zeit braucht, darum geht es im nächsten Kapitel.

Die Kunst des Promptens: Denken in Sprache statt Befehle erteilen

In dieser Folge zeigt Salvatore Princi, warum die Qualität einer KI-Antwort weniger vom System als von der gestellten Frage abhängt. Prompting wird nicht als technische Spielerei verstanden, sondern als philosophische Disziplin: Ein Prompt ist kein Befehl, sondern eine Denkbewegung. Thematisiert werden Mehrdeutigkeit, Intention und Metaperspektive – also jene sprachlichen Feinheiten, die Tiefe und Richtung einer Antwort bestimmen. Wer bewusst fragt, nutzt Sprache als Erkenntniswerkzeug und spiegelt zugleich die eigene Denkweise.

Wie man mit KI denkt – Philosophie, Sprache und Prompt-Intelligenz | Salvatore Princi

Die Botschaft: Bessere Fragen führen nicht nur zu besseren Antworten, sondern zu klarerem, reflektierterem Denken – besonders für Führungskräfte, Strategen und Kreative.

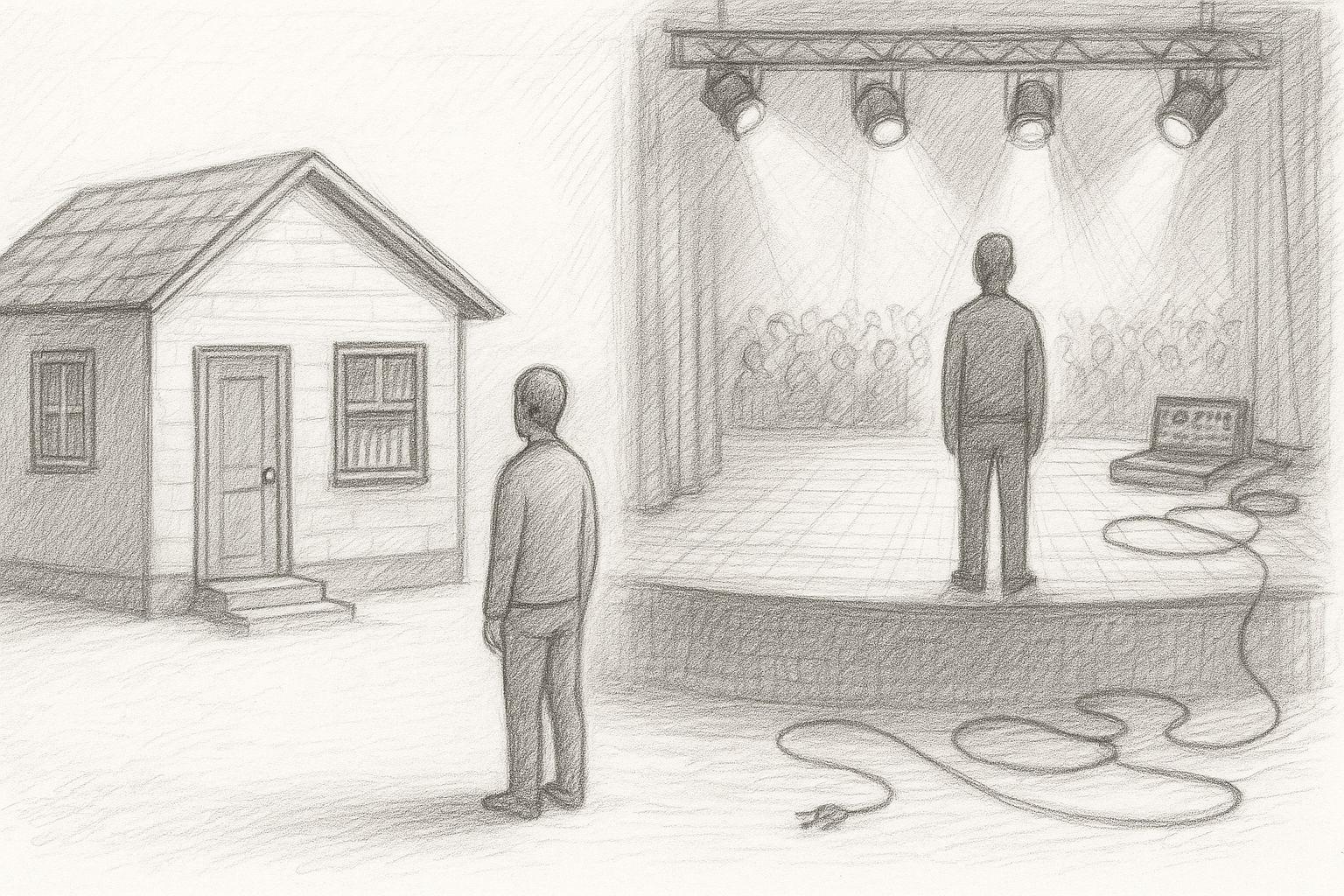

Der Dialog verändert sich – wenn man ihn zulässt

Fast jeder, der beginnt, regelmäßig mit KI zu arbeiten, durchläuft zunächst dieselbe Phase. Man stellt eine Frage, bekommt eine Antwort – und ist ernüchtert. Zu allgemein, zu glatt, zu wenig Substanz. Die KI wirkt wie ein gut formulierender, aber letztlich beliebiger Textgenerator.

Diese Frustration ist kein Zeichen von Scheitern, sondern ein Übergangszustand. Sie entsteht meist dort, wo Erwartungen und Vorgehensweise nicht zusammenpassen. Wer KI wie eine Suchmaschine oder einen Texter befragt, bekommt genau das: brauchbare, aber austauschbare Ergebnisse. Der eigentliche Dialog hat zu diesem Zeitpunkt noch gar nicht begonnen.

Viele brechen hier ab. Sie wechseln das Modell, suchen bessere Prompts oder erklären das Thema für überschätzt. Dabei liegt das Problem selten in der KI – sondern im fehlenden Raum für Entwicklung innerhalb des Gesprächs.

Die zweite Phase: Nachschärfen, Rückfragen, Schleifen

Wer dranbleibt, beginnt irgendwann, anders zu arbeiten. Die erste Antwort wird nicht mehr als Ergebnis betrachtet, sondern als Arbeitsmaterial. Man präzisiert, widerspricht, ergänzt, grenzt ein. Die Fragen werden kürzer oder auch länger, aber sie werden gezielter.

In dieser Phase verändert sich etwas Entscheidendes: Der Nutzer beginnt, mit der KI zu denken – nicht mehr nur über sie. Die Antworten werden differenzierter, nicht weil die KI „lernt“, sondern weil der Kontext dichter wird. Der Chat entwickelt eine innere Logik. Frühere Aussagen wirken nach, Begriffe bekommen Bedeutung, Denklinien setzen sich fort. Der Dialog gewinnt Tiefe – langsam, aber spürbar.

Eine bewährte Strategie: erst Kontext aufbauen, dann arbeiten

Eine einfache, aber wirkungsvolle Praxis passt genau an diese Stelle. Gerade bei komplexeren Themen beginne ich oft nicht mit der eigentlichen Aufgabe, sondern mit einer vorgeschalteten Bitte:

„Recherchiere das Thema zunächst. Fasse relevante Hintergründe, Positionen oder typische Argumentationslinien zusammen.“

Das hat mehrere Effekte. Zum einen entsteht sofort ein gemeinsamer Bezugsrahmen. Die KI arbeitet nicht im luftleeren Raum, sondern auf einer explizit aufgebauten Wissensbasis. Zum anderen wird der Chat dadurch „geerdeter“. Begriffe sind geklärt, Wiederholungen reduzieren sich, und Missverständnisse treten früher zutage.

Vor allem aber verändert sich die eigene Haltung. Man steigt nicht mit einer fertigen Erwartung ein, sondern mit einer offenen Arbeitsposition. Der Dialog beginnt nicht bei der Lösung, sondern bei der Orientierung. Das entschleunigt – und erhöht paradoxerweise die Qualität der Ergebnisse.

Die dritte Phase: Dialog statt Abfrage

Irgendwann kippt das Verhältnis. Die KI ist nicht mehr Antwortmaschine, sondern Gesprächspartner im eigentlichen Sinn. Nicht, weil sie ein Bewusstsein hätte, sondern weil der Nutzer beginnt, sie so zu nutzen.

- Antworten werden zu Anschlussfragen.

- Texte werden zu Rohmaterial.

- Gedanken werden gespiegelt, nicht ersetzt.

In dieser Phase stellt man der KI nicht mehr nur Fragen, um etwas zu bekommen, sondern um etwas zu prüfen. Die KI dient als Resonanzraum. Sie hält Gedanken aus, sortiert sie, stellt sie nebeneinander. Und manchmal zeigt sie auch, dass eine Idee noch nicht trägt.

Warum viele diesen Punkt nie erreichen

Der Übergang in diese dritte Phase ist unspektakulär. Es gibt keinen Aha-Moment, kein neues Feature, keinen besonderen Prompt. Es ist eine Frage der Geduld – und der Bereitschaft, sich selbst im Denkprozess zu beobachten.

Viele scheitern hier nicht an der KI, sondern an der eigenen Ungeduld. Sie erwarten Effizienz, wo eigentlich Reife gefragt ist. Sie wollen Ergebnisse, ohne den Weg zu gehen. Doch genau dieser Weg ist der eigentliche Wert. Wer ihn zulässt, erlebt eine stille Verschiebung: Die KI wird nicht besser – aber der Dialog wird es. Und damit auch das eigene Denken.

Aktuelle Umfrage zur Nutzung lokaler KI-Systeme

KI erzwingt Denkdisziplin – ob man will oder nicht

Im Umgang mit KI fällt etwas auf, das im menschlichen Gespräch oft verborgen bleibt: Widersprüche haben keinen Schonraum. Eine KI reagiert nicht irritiert, sie runzelt nicht die Stirn, sie lässt Ungereimtheiten nicht aus Höflichkeit stehen. Sie verarbeitet, was man ihr gibt – konsequent und ohne Rücksicht auf innere Logikfehler.

Das führt dazu, dass Widersprüche plötzlich sichtbar werden. Begriffe, die man selbst für eindeutig hielt, erweisen sich als mehrdeutig. Argumente, die im Kopf zusammenpassten, stehen nebeneinander, ohne sich wirklich zu verbinden. Zielsetzungen widersprechen sich, ohne dass man es bemerkt hätte.

Die KI deckt das nicht aktiv auf. Sie zeigt es indirekt – durch Antworten, die ausweichen, ausgleichen oder auseinanderlaufen. Wer genau hinsieht, merkt: Nicht die KI ist inkonsistent, sondern das Ausgangsdenken.

Ungenaue Begriffe, unscharfe Ebenen

Ein häufiger Stolperstein liegt in der Sprache selbst. Viele Begriffe werden im Alltag locker verwendet, ohne klar definiert zu sein. Im Gespräch mit Menschen funktioniert das, weil Kontext und Erfahrung ausgleichen. Im Dialog mit KI funktioniert es nicht.

Begriffe wie „Erfolg“, „Qualität“, „Strategie“, „Wahrheit“ oder „besser“ sind ohne Präzisierung leer. Die KI füllt sie mit statistischem Mittelmaß. Das Ergebnis wirkt korrekt, aber seelenlos. Erst wenn man beginnt, Begriffe einzugrenzen, Ebenen zu trennen und Annahmen offenzulegen, verändert sich die Antwort.

Die KI zwingt damit zu einer Denkbewegung, die man sonst gern vermeidet: zur sauberen Trennung von Meinung, Beobachtung, Ziel und Bewertung. Nicht aus pädagogischem Eifer, sondern aus struktureller Notwendigkeit.

Denkdisziplin als Nebenwirkung

Viele empfinden diese Erfahrung zunächst als anstrengend. Die KI „macht es einem nicht leicht“. Sie nimmt einem die Arbeit nicht ab, sondern gibt sie in verfeinerter Form zurück. Was fehlt, muss ergänzt werden. Was unscharf ist, wirkt in der Antwort hohl.

Doch genau darin liegt der Wert. Denkdisziplin entsteht hier nicht als Vorsatz, sondern als Nebenwirkung. Wer brauchbare Antworten will, muss sich klarer ausdrücken. Wer tiefer gehen will, muss sauberer denken. Die KI belohnt nicht Kreativität im luftleeren Raum, sondern Struktur.

Das ist ungewohnt in einer Zeit, in der viele Systeme darauf ausgelegt sind, Unklarheit zu kaschieren. KI tut das Gegenteil. Sie verstärkt, was vorhanden ist – und zwingt damit zur Entscheidung: Entweder man präzisiert, oder man bleibt an der Oberfläche.

Warum das Widerstand erzeugt

Nicht jeder schätzt diese Form von Rückmeldung. Manche erleben sie als kalt, andere als belehrend, wieder andere als frustrierend. In Wahrheit richtet sich der Widerstand selten gegen die KI selbst. Er richtet sich gegen die eigene Unschärfe, die plötzlich sichtbar wird.

Denkdisziplin ist unbequem. Sie verlangt, Annahmen zu überprüfen, Position zu beziehen und Widersprüche auszuhalten. KI beschleunigt diesen Prozess – nicht durch Druck, sondern durch Konsequenz. Sie reagiert immer gleich: auf das, was da ist.

Wer bereit ist, das anzunehmen, gewinnt ein präzises Werkzeug. Wer es ablehnt, wird KI als begrenzt oder enttäuschend wahrnehmen. Beides ist nachvollziehbar.

Präzision als Voraussetzung für Tiefe

Am Ende lässt sich festhalten: Tiefe entsteht nicht durch komplexe Modelle, sondern durch präzises Denken. KI macht diesen Zusammenhang sichtbar. Sie ist kein moralischer Richter und kein Lehrmeister. Aber sie ist unerbittlich in einem Punkt: Sie arbeitet nur mit dem, was man ihr gibt.

Denkdisziplin ist daher keine Option, sondern eine Voraussetzung. Wer sie nicht mitbringt, stößt schnell an Grenzen. Wer sie entwickelt, entdeckt in der KI ein Gegenüber, das Gedankengänge trägt, prüft und weiterführt.

Damit rückt KI in eine Rolle, die weit über Effizienz hinausgeht. Sie wird zum stillen Korrektiv – nicht für Wissen, sondern für Denken. Und genau hier öffnen sich die Parallelen zu klassischen Sparringspartnern, die seit jeher weniger Antworten liefern als gute Gegenfragen.

Parallelen zu klassischen Sparringspartnern

Ein gutes Gespräch erkennt man nicht daran, dass es viele Antworten liefert. Man erkennt es daran, dass man danach klarer denkt als zuvor. Genau hier liegt die Parallele zwischen KI als Sparringspartner und klassischen Gesprächspartnern: Mentoren, erfahrenen Kollegen, Coaches oder schlicht Menschen, mit denen man ernsthaft denken kann.

Solche Gespräche sind selten bequem. Sie verlaufen nicht linear, sie liefern keine schnellen Lösungen. Oft verlassen sie einen mit mehr Fragen als zuvor. Und genau deshalb sind sie wertvoll. Sie zwingen zur Ordnung, zur Priorisierung, zur Selbstprüfung. Nicht, weil der Gesprächspartner „es besser weiß“, sondern weil er den Denkraum hält.

KI übernimmt in vielen Fällen genau diese Funktion – wenn man sie lässt.

Mentoren, Coaches, gute Kollegen

Wer jemals mit einem wirklich guten Mentor gearbeitet hat, kennt das Muster: Auf eine Frage folgt selten eine klare Antwort. Stattdessen kommen Rückfragen. Unbequeme Nachfragen. Hinweise auf blinde Flecken. Manchmal auch schlichtes Schweigen, das zum Weiterdenken zwingt.

Der Mentor ersetzt keine Entscheidung. Er nimmt sie einem nicht ab. Er hilft lediglich, sie sauber vorzubereiten. Genau hier liegt die Nähe zur KI. Auch sie kann Entscheidungen nicht treffen – und sollte es nicht. Aber sie kann Denkpfade sichtbar machen, Alternativen nebeneinanderstellen und innere Widersprüche offenlegen.

Der Unterschied: Die KI ist immer verfügbar. Und sie ist unermüdlich.

Keine Schonung, keine Projektion

Ein entscheidender Punkt unterscheidet KI von menschlichen Sparringspartnern: Emotionen spielen keine Rolle. Es gibt keine Eitelkeit, kein Bedürfnis nach Zustimmung, keine soziale Rücksichtnahme. Das kann man als Nachteil empfinden – oder als Befreiung.

Die KI fühlt sich nicht angegriffen, wenn man widerspricht. Sie nimmt es nicht persönlich, wenn man einen Gedanken verwirft. Sie erwartet keine Dankbarkeit. Dadurch entsteht ein Denkraum, der ungewöhnlich sauber ist. Projektionen verlieren an Wirkung. Was bleibt, ist die Sache selbst.

Das ist besonders wertvoll für Menschen, die gewohnt sind, Verantwortung zu tragen. Entscheidungen, Strategien, Positionierungen – all das lässt sich mit KI vorbesprechen, ohne soziale Nebenwirkungen zu erzeugen. Nicht als Ersatz für menschliche Rückkopplung, sondern als vorgelagerte Klärung.

Wenn KI kein guter Sparringspartner ist – für manche

So überzeugend diese Parallelen sind: KI ist nicht für jeden ein guter Sparringspartner. Wer eigentlich Bestätigung sucht, wird enttäuscht. Wer klare Anweisungen erwartet, fühlt sich allein gelassen. Wer Unsicherheit vermeiden will, empfindet die Offenheit des Dialogs als Zumutung.

Ein guter Sparringspartner – menschlich oder künstlich – verstärkt keine Illusionen. Er macht sie sichtbar. Und das ist nicht immer angenehm. In klassischen Gesprächen lässt sich das umgehen, durch Charme, Ausweichen oder Autorität. Bei KI funktioniert das nicht. Sie bleibt neutral. Und genau darin liegt ihre Strenge.

Sparring statt Führung

Ein letzter, wichtiger Unterschied: Ein Sparringspartner führt nicht. Er begleitet. Er denkt mit, nicht voraus. KI eignet sich genau dafür – nicht als Lehrer, nicht als Chef, nicht als Instanz. Sondern als Gegenüber auf Augenhöhe im Denkprozess. Wer diese Rolle akzeptiert, nutzt KI sinnvoll. Wer mehr erwartet, überfordert sie. Und wer weniger erwartet, verschenkt Potenzial.

Die Parallele zu klassischen Sparringspartnern zeigt damit vor allem eines: Der Wert liegt nicht in den Antworten, sondern im Prozess. In der Bereitschaft, sich auf ein Gespräch einzulassen, das keine Abkürzungen kennt. Genau hier entscheidet sich, ob KI zur Spielerei wird – oder zum ernsthaften Denkpartner.

KI ersetzt keine Reife – sie legt Defizite offen

Eine der hartnäckigsten Fehlannahmen im Umgang mit KI lautet: Wer KI nutzt, denkt automatisch besser. Diese Vorstellung ist verführerisch, weil sie Fortschritt an Technik bindet. In der Praxis zeigt sich jedoch schnell: KI hebt nicht das Niveau – sie verstärkt es.

- Wer strukturiert denkt, gewinnt an Tiefe.

- Wer unsauber denkt, produziert schneller Unsinn.

Die KI selbst bleibt dabei neutral. Sie bewertet nicht, sie korrigiert nicht von sich aus. Sie arbeitet mit dem, was vorhanden ist. Genau deshalb ist sie kein Ersatz für Reife. Sie kann Wissen ordnen, Argumente sammeln, Perspektiven öffnen – aber sie kann keine Haltung entwickeln.

Typische Defizite, die sichtbar werden

Im längeren Arbeiten mit KI treten bestimmte Muster immer wieder zutage. Nicht als Fehler der KI, sondern als Spiegel menschlicher Denkgewohnheiten.

Ein häufiges Defizit ist Ungeduld. Die Erwartung, dass eine Antwort sofort tragfähig sein müsse. Wird sie das nicht, gilt die KI als unbrauchbar. Dabei hätte ein zweiter oder dritter Denk-Schritt genügt.

Ein weiteres Muster ist der Wunsch nach Abkürzungen. Statt sich mit einem Problem auseinanderzusetzen, soll die KI es „lösen“. Das Ergebnis wirkt dann plausibel, bleibt aber äußerlich. Die innere Klärung hat nicht stattgefunden.

Auch fehlende Selbstreflexion wird sichtbar. Wer eigene Annahmen nicht kennt, kann sie auch nicht hinterfragen lassen. Die KI spiegelt sie trotzdem – und macht damit unbewusst deutlich, wo Denkbewegungen fehlen.

Nicht zuletzt zeigt sich oft eine Scheu vor Entscheidungen. Die KI soll festlegen, gewichten, bewerten. Doch genau hier endet ihre Rolle. Entscheidungen lassen sich vorbereiten, nicht delegieren.

Verstärkung statt Ausgleich

Diese Defizite wären ohne KI weniger auffällig. Im Alltag lassen sie sich kaschieren – durch Tempo, durch Autorität, durch soziale Dynamiken. KI entzieht diese Schutzschichten. Sie verstärkt, was da ist, ohne Rücksicht auf Wirkung.

Das kann entlarvend sein. Und genau deshalb reagieren manche Nutzer enttäuscht oder ablehnend. Nicht, weil die KI versagt, sondern weil sie Erwartungen enttäuscht, die nie realistisch waren.

KI ist kein Korrektiv für innere Unordnung. Sie ist ein Verstärker. Wer das akzeptiert, kann sie gezielt nutzen. Wer es ignoriert, stößt immer wieder an dieselben Grenzen – unabhängig vom Modell.

Warum das eine Chance ist

So unbequem diese Offenlegung sein kann: Sie bietet eine seltene Gelegenheit. KI erlaubt es, Defizite früh zu erkennen – bevor sie sich in Entscheidungen, Texten oder Strategien verfestigen.

- Ungeduld lässt sich entschleunigen.

- Unsicherheit lässt sich strukturieren.

- Unklare Ziele lassen sich benennen.

Voraussetzung ist die Bereitschaft, nicht auf die KI zu zeigen, sondern auf sich selbst. Wer diesen Schritt geht, nutzt KI nicht als Krücke, sondern als Trainingsgerät. Nicht für Wissen, sondern für Reife.

Reife bleibt nicht delegierbar

Am Ende bleibt eine einfache, aber unbequeme Erkenntnis: Reife ist nicht automatisierbar. Sie entsteht durch Erfahrung, durch Fehler, durch bewusste Auseinandersetzung. KI kann diesen Prozess begleiten, beschleunigen oder vertiefen – aber sie kann ihn nicht ersetzen.

Gerade darin liegt ihr Wert. Sie zwingt nicht, aber sie lädt ein. Sie zeigt, was vorhanden ist, ohne es zu beschönigen. Wer diesen Spiegel nutzt, gewinnt Klarheit. Wer ihn meidet, bleibt auf dem Stand, den er bereits hatte.

KI verspricht keinen Fortschritt. Sie bietet eine Möglichkeit. Was daraus wird, entscheidet nicht das Modell – sondern der Mensch, der fragt.

Praktische Leitlinien: KI sinnvoll als Sparringspartner nutzen

Eine der wichtigsten praktischen Erfahrungen im Umgang mit KI ist überraschend simpel: Man muss nicht perfekt vorbereitet sein, aber man sollte bewusst starten. Ein grob geklärtes Anliegen reicht oft aus. Die Feinjustierung darf – und soll – im Dialog entstehen.

Wer wartet, bis ein Gedanke vollständig ausformuliert ist, verschenkt Potenzial. Wer hingegen völlig ungeordnet startet, verliert sich schnell. Der sinnvolle Mittelweg besteht darin, eine erste, ehrliche Arbeitsposition einzunehmen und diese im Gespräch zu prüfen.

KI als Sparringspartner funktioniert nicht nach dem Prinzip „Eingabe – Ausgabe“, sondern als Prozess.

Antworten sind Rohmaterial, keine Ergebnisse

Eine häufige Fehlhaltung besteht darin, die erste Antwort der KI wie ein Endprodukt zu behandeln. Sinnvoller ist es, sie als Zwischenstand zu sehen. Etwas, das man hinterfragt, verschiebt, zuspitzt oder auch verwirft. Gute Praxis bedeutet:

- Antworten nicht übernehmen, sondern prüfen

- Widersprüche markieren statt ignorieren

- Nachfragen stellen, wenn etwas zu glatt wirkt

Die Qualität des Dialogs steigt nicht durch Zustimmung, sondern durch Reibung.

Entscheidungen nicht delegieren – vorbereiten schon

KI eignet sich hervorragend, um Entscheidungen vorzubereiten: Argumente zu sammeln, Perspektiven gegenüberzustellen, Risiken sichtbar zu machen. Sie eignet sich schlecht dafür, Entscheidungen zu treffen.

Wer versucht, Verantwortung abzugeben, bekommt scheinbare Klarheit – aber keine tragfähige Grundlage. Wer hingegen die KI nutzt, um die eigene Entscheidungsfähigkeit zu schärfen, profitiert nachhaltig. Eine gute Leitfrage lautet daher nicht:

„Was soll ich tun?“

sondern:

„Was übersehe ich gerade?“

Sprachfunktion nutzen – aber bewusst

Eine besonders wirkungsvolle Praxis ist die Nutzung der Sprachfunktion, bei der man selbst spricht, die KI aber weiterhin schriftlich antwortet. Das verändert den gesamten Arbeitsfluss.

Der Vorteil liegt auf der Hand: Man denkt laut. So, wie man es auch in einem echten Gespräch tun würde. Man verhaspelt sich, korrigiert sich, springt zwischen Gedanken – und genau das ist kein Nachteil, sondern ein Gewinn. Der Denkprozess wird sichtbarer, lebendiger, ehrlicher.

Die KI reagiert darauf nicht irritiert. Sie filtert, ordnet, greift Fäden auf. Auch Widersprüche bleiben nicht folgenlos. Oft reagiert sie auf Spannungen, die man selbst noch gar nicht bewusst wahrgenommen hat. Das Gespräch wird natürlicher – und damit ergiebiger.

Gerade für Reflexion, Konzeptarbeit oder strategische Überlegungen ist diese Form des Arbeitens erstaunlich effektiv. Sie nimmt Druck heraus und fördert Klarheit.

Widersprüche nicht vermeiden, sondern nutzen

Ein natürlicher Dialog enthält Widersprüche. Gedanken verändern sich, Annahmen kippen, Prioritäten verschieben sich. In klassischen Arbeitsprozessen gelten solche Brüche oft als Störung. Im Sparring mit KI sind sie wertvoll.

Wenn die KI auf widersprüchliche Aussagen reagiert, geschieht etwas Entscheidendes: Das eigene Denken wird gespiegelt. Nicht wertend, nicht belehrend – aber sichtbar. Wer an dieser Stelle innehält und nicht vorschnell „aufräumt“, entdeckt oft neue Einsichten.

Widersprüche sind keine Fehler. Sie sind Hinweise.

Kontext bewusst aufbauen

Gerade bei komplexeren Themen lohnt es sich, dem eigentlichen Arbeiten einen Schritt vorzuschalten: den bewussten Aufbau von Kontext. Eine kurze Recherche-Zusammenfassung, eine Klärung zentraler Begriffe oder ein Überblick über relevante Perspektiven schafft eine gemeinsame Basis.

Das Gespräch wird dadurch fokussierter, konsistenter und nachhaltiger. Die KI „weiß“, worauf sie sich bezieht – und der Nutzer ebenso. Missverständnisse treten früher auf und lassen sich leichter korrigieren.

Am Ende ist die wichtigste Leitlinie keine technische, sondern eine innere. KI als Sparringspartner funktioniert nur dann gut, wenn man bereit ist, sich selbst ernst zu nehmen – und nicht zu schonen. Nicht jedes Modell eignet sich gleich gut für jede Aufgabe. Nicht jede Antwort ist hilfreich. Aber der entscheidende Faktor bleibt konstant: die eigene Bereitschaft, zu denken, zu prüfen und Verantwortung zu übernehmen.

KI ist kein Ersatz für diesen Prozess. Aber sie ist ein ungewöhnlich präziser Begleiter auf diesem Weg.

Denken bleibt nicht delegierbar

Am Ende dieses Weges steht keine neue Methode und kein besonderer Trick. Es steht eine nüchterne Erkenntnis: Denken lässt sich nicht auslagern. Weder an Menschen noch an Maschinen. KI kann strukturieren, spiegeln, sortieren, provozieren – aber sie kann die innere Arbeit nicht übernehmen.

Gerade darin liegt ihr Wert. Sie zwingt nicht, sie drängt nicht. Aber sie macht sichtbar, wo Klarheit fehlt, wo Annahmen ungeprüft bleiben und wo Entscheidungen noch nicht reif sind. Wer das annimmt, gewinnt. Wer es vermeiden will, stößt früher oder später an Grenzen.

KI als Sparringspartner ist damit kein Fortschrittsversprechen, sondern ein Angebot. Ein Angebot, den eigenen Denkprozess ernster zu nehmen.

Gute Modelle ändern wenig, gute Fragen alles

Im Verlauf dieses Artikels ist deutlich geworden, warum gute Fragen wichtiger sind als gute Modelle. Modelle werden leistungsfähiger, schneller, vielseitiger. Doch ohne Struktur im Denken bleibt ihr Potenzial ungenutzt.

Gute Fragen entstehen nicht durch Technik, sondern durch Haltung. Sie setzen voraus, dass man bereit ist, Verantwortung für den eigenen Denkprozess zu übernehmen – inklusive Unsicherheit, Widersprüchen und Umwegen. KI verstärkt diese Bereitschaft nicht automatisch. Sie macht nur sichtbar, ob sie vorhanden ist.

Das ist unbequem, aber ehrlich.

KI als Lernraum, nicht als Abkürzung

Wer KI langfristig sinnvoll nutzen will, sollte sie nicht als Abkürzung begreifen, sondern als Lernraum. Als Ort, an dem Gedanken getestet, verworfen und neu zusammengesetzt werden dürfen. Ohne Publikum. Ohne Bewertung. Ohne soziale Nebenwirkungen.

In dieser Rolle ist KI erstaunlich leistungsfähig. Nicht weil sie „klug“ wäre, sondern weil sie konsequent reagiert. Sie belohnt Klarheit und entlarvt Unschärfe. Still, sachlich, zuverlässig.

Ein Einstieg ohne Vorwissen – bewusst niedrigschwellig

Für Leser, die an diesem Punkt denken: Das klingt sinnvoll, aber wie fängt man konkret an?, lohnt sich ein Blick auf einen ergänzenden Artikel: „KI für Anfänger – wie du ohne Vorkenntnisse sinnvoll mit künstlicher Intelligenz startest“.

Dort geht es weniger um Denkdisziplin und mehr um Orientierung. Welche KI-Systeme es gibt, wofür sie sich eignen, und wie man ohne technisches Vorwissen in die praktische Nutzung einsteigt. Der Artikel bietet einen Überblick, ohne zu überfordern – und ergänzt damit die eher reflexive Perspektive dieses Artikels.

Ein ruhiger Ausblick

KI wird bleiben. Sie wird besser, schneller, allgegenwärtiger. Die entscheidende Frage ist nicht, was sie künftig kann – sondern wie wir mit ihr umgehen. Ob wir sie nutzen, um Denken zu vermeiden, oder um es zu schärfen.

Denken bleibt nicht delegierbar. Aber es lässt sich begleiten.

Wer KI als Sparringspartner begreift, nutzt sie nicht, um Antworten zu bekommen, sondern um bessere Fragen zu stellen. Und genau dort beginnt echte Souveränität – leise, unspektakulär und erstaunlich wirksam.

Häufig gestellte Fragen

- Was bedeutet eigentlich „KI als Sparringspartner“ – und was nicht?

Mit „KI als Sparringspartner“ ist nicht gemeint, dass KI Entscheidungen trifft oder Denken ersetzt. Gemeint ist ein dialogischer Einsatz: Die KI reagiert auf Gedanken, spiegelt sie, ordnet sie und macht Widersprüche sichtbar. Sie liefert keine Wahrheit, sondern Resonanz. Genau darin unterscheidet sie sich von klassischen Tools oder Suchmaschinen. - Warum betont der Artikel so stark die Bedeutung guter Fragen?

Weil gute Fragen strukturierte Gedanken sind. Die KI kann nur mit dem arbeiten, was man ihr gibt. Unscharfe Fragen führen zu unscharfen Antworten – unabhängig vom Modell. Gute Fragen zwingen dazu, Ziele, Annahmen und Kontext zu klären. Das verbessert nicht nur die Antwort, sondern vor allem das eigene Denken. - Heißt das, dass bessere Modelle weniger wichtig sind?

Nein, Modelle spielen durchaus eine Rolle. Aber ihr Einfluss wird überschätzt. Ein gutes Modell kann unsauberes Denken nicht ausgleichen. Umgekehrt lassen sich mit einfachen Modellen sehr gute Ergebnisse erzielen, wenn die Fragestellung klar ist. Der Hebel liegt fast immer beim Nutzer, nicht bei der Technik. - Warum empfinden viele Nutzer KI nach anfänglicher Euphorie als enttäuschend?

Weil sie KI wie eine Abkürzung behandeln. Die Erwartung lautet oft: Frage rein, Lösung raus. Wenn das nicht funktioniert, gilt die KI als oberflächlich. In Wahrheit zeigt sich hier, dass Denken nicht delegierbar ist. Wer bereit ist, in den Dialog zu gehen, erlebt eine ganz andere Tiefe. - Was ist der Unterschied zwischen Abfrage und Dialog?

Eine Abfrage zielt auf eine einmalige Antwort. Ein Dialog entwickelt sich über mehrere Schritte. Antworten werden hinterfragt, ergänzt, korrigiert. Kontext baut sich auf. Erst im Dialog wird KI zum Sparringspartner – vorher bleibt sie ein Textgenerator. - Warum legt KI Denkfehler und Widersprüche so schnell offen?

Weil sie keine sozialen Ausgleichsmechanismen hat. Sie interpretiert nicht wohlwollend, sie glättet nicht aus Höflichkeit. Sie reagiert konsequent auf Sprache. Widersprüche, unklare Begriffe oder Zielkonflikte werden dadurch indirekt sichtbar – oft schneller als im Gespräch mit Menschen. - Ist KI damit nicht kalt oder unpersönlich?

Ja – und genau das ist ihre Stärke. Die Abwesenheit von Emotionen, Eitelkeit oder sozialen Erwartungen schafft einen ungewöhnlich sauberen Denkraum. Gerade bei komplexen oder sensiblen Fragen kann das entlastend wirken, weil nichts „richtig rüberkommen“ muss. - Warum werden schlechte Fragen im Artikel als eine Art Selbstschutz beschrieben?

Weil Unschärfe Verantwortung vermeidet. Wer vage fragt, muss sich nicht festlegen. Gute Fragen hingegen zwingen zu Klarheit – und damit zu Konsequenzen. KI macht diesen Unterschied sichtbar, weil sie Unklarheit nicht ausgleicht. - Was bringt es, der KI zuerst Rechercheaufgaben zu geben?

Es schafft einen gemeinsamen Bezugsrahmen. Begriffe werden geklärt, Hintergründe gesammelt, typische Argumente sichtbar gemacht. Der eigentliche Dialog beginnt dann auf einer stabileren Grundlage. Das erhöht die Tiefe und reduziert Missverständnisse. - Warum ist die Sprachfunktion mit Textantworten besonders hilfreich?

Weil sie natürliches Denken erlaubt. Man kann frei sprechen, sich korrigieren, abschweifen. Die KI filtert und ordnet dennoch. Dadurch entsteht ein Gespräch, das dem Denken näherkommt als getippte, „perfekte“ Prompts. Widersprüche tauchen organisch auf – und werden nutzbar. - Ist es problematisch, wenn man sich beim Sprechen verhaspelt oder widerspricht?

Im Gegenteil. Gerade diese Brüche sind wertvoll. Sie zeigen Denkbewegungen. Die KI reagiert darauf oft präziser, als man selbst erwartet. Viele Einsichten entstehen genau dort, wo man merkt: Das passt gerade noch nicht zusammen. - Kann KI Entscheidungen treffen oder Verantwortung übernehmen?

Nein – und das sollte sie auch nicht. KI kann vorbereiten, strukturieren, abwägen. Entscheidungen bleiben menschlich. Wer versucht, Verantwortung abzugeben, bekommt scheinbare Klarheit, aber keine tragfähige Grundlage. - Welche Rolle spielt Reife im Umgang mit KI?

Eine zentrale. KI verstärkt vorhandene Muster. Reife zeigt sich darin, wie jemand mit Unsicherheit, Widersprüchen und offenen Fragen umgeht. KI ersetzt diese Reife nicht – sie macht sichtbar, ob sie vorhanden ist. - Warum reagieren manche Menschen ablehnend auf KI als Sparringspartner?

Weil sie Bestätigung erwarten. Ein Sparringspartner bestätigt nicht automatisch. Er spiegelt. Das kann als Zumutung empfunden werden, besonders wenn man schnelle Lösungen oder klare Anweisungen sucht. - Ist KI damit eher ein Lernwerkzeug als ein Produktivitäts-Tool?

Beides – aber der nachhaltigere Wert liegt im Lernaspekt. Produktivität entsteht kurzfristig. Denkdisziplin und Klarheit wirken langfristig. Wer KI nur als Effizienzwerkzeug nutzt, schöpft ihr Potenzial nicht aus. - Braucht man technisches Vorwissen, um KI so zu nutzen?

Nein. Der Einstieg ist niedrigschwellig. Entscheidend ist nicht Technik, sondern Haltung. Wer sprechen, zuhören und nachfragen kann, bringt die wichtigsten Voraussetzungen bereits mit. - Wie passt dieser Artikel zum Thema „KI für Anfänger“?

Der Einsteigerartikel bietet Orientierung: Systeme, Einsatzmöglichkeiten, erste Schritte. Dieser Text geht tiefer. Er setzt dort an, wo erste Erfahrungen gemacht wurden, und zeigt, wie man KI langfristig sinnvoll nutzt – jenseits von Tools und Hype. - Was ist die wichtigste Erkenntnis aus dem Artikel?

Dass Denken nicht delegierbar ist. KI kann begleiten, spiegeln und schärfen. Aber sie ersetzt keine Klarheit, keine Haltung und keine Verantwortung. Wer das akzeptiert, gewinnt mit KI einen ungewöhnlich präzisen Sparringspartner.