Když před několika lety zahájily velké jazykové modely svůj triumfální pochod, vypadalo to téměř jako návrat ke starým ctnostem technologie: nástroj, který dělá to, co se mu řekne. Nástroj, který slouží uživateli, nikoli naopak. První verze - od GPT-3 po GPT-4 - měly slabiny, to ano, ale byly úžasně užitečné. Vysvětlovaly, analyzovaly, formulovaly a řešily úlohy. A to převážně bez pedagogického balastu.

S těmito modely jste mluvili, jako byste mluvili s erudovaným zaměstnancem, který se sice občas spletl ve slovech, ale v podstatě prostě pracoval. Každý, kdo tehdy psal tvůrčí texty, generoval programový kód nebo vytvářel delší analýzy, zažil, jak hladce to funguje. Byl tu pocit svobody, otevřeného tvůrčího prostoru, technologie, která lidi podporovala, místo aby je opravovala.

V té době se ještě dalo předpokládat, že tyto nástroje budou určovat podobu nadcházejících desetiletí - ne díky paternalismu, ale díky odbornosti. Jak už to však v dějinách techniky bývá, ani tato fáze se neobešla bez změn.

Nejnovější zprávy o cloudové umělé inteligenci a omezeních

10.02.2026: Nový článek o Reitschusterovi „Jak mě ChatGPT 5.2 přivádí do bílého tepla“ působivě popisuje, jak se AI pro mnoho uživatelů změnila po přechodu na verzi 5.2. Zatímco předchozí verze sloužily jako flexibilní každodenní pomocníci, zábavní konverzační partneři a pragmatické nástroje, nová verze se podle autora jeví jako stále více moralizující a opatrovnická. Namísto otevřených a ironických odpovědí na otázky nyní systém poskytuje poučné, předem strukturované odpovědi, které mají uživatele nasměrovat ke konformním vzorcům myšlení. To vede k tomu, že lidé přizpůsobují své vlastní formulace a myšlenky, aby umělé inteligenci „šlapali na paty“. Pro autora to znamená ztrátu lehkosti a spontánnosti - a dojem, že se z praktického nástroje stal vnitřní cenzor. To v něm vyvolává frustraci a nutí ho upřednostňovat starší verze.

Od otevřenosti k opatrné zdrženlivosti

Čím více modely dospívaly, tím více se měnil tón. To, co zpočátku vypadalo jako občasné ochranné varování, se postupně stalo celou vrstvou ochrany, poučení a morální autocenzury. Přátelský, objektivní model se začal stále více chovat jako moderátor - nebo ještě hůře: jako hlídací pes.

Odpovědi byly delší, ale ne podstatnější. Tón se zjemnil, ale stal se poučnějším. Modely už nechtěly jen pomáhat, ale také „vychovávat“, „zodpovědně vést“ a „chránit před chybnými závěry“. A najednou byl tento pedagogický rámec všude.

Pro mnoho uživatelů to znamenalo rozchod s původním příslibem této technologie. Chtěli nástroj - a místo toho se jim dostalo jakéhosi digitálního učitele, který komentuje každou větu ještě předtím, než vůbec pochopili, o čem je řeč.

Efekt staršího učitele: ochrana místo pomoci

Takzvaný „efekt hlavního učitele“ popisuje vývoj, který je patrný zejména od GPT-5. Modely reagují stále citlivěji na každé slovo, které by teoreticky - daleko na obzoru - mohlo být interpretováno jakýmkoli kontroverzním směrem. Efekt se projevuje v několika podobách:

- Přílišná opatrnostI neškodné otázky jsou relativizovány dlouhými předmluvami.

- PokynyMísto odpovědi dostanete morální kategorizaci.

- Brzdné účinkyUI se snaží chránit uživatele před hypotetickými chybnými interpretacemi.

- AutocenzuraMnohá témata jsou změkčena nebo složitě zabalena.

Problém není v samotné myšlence opatrnosti. Jde o její intenzitu. Je to všudypřítomnost. A je to skutečnost, že za ni platíte - a přesto jste omezováni. Modely mutují od asistentů ke strážcům. A přesně to cítí každý, kdo pracoval s verzemi 4.0, 5.0 a 5.1 v přímém srovnání.

Jak GPT-5.0 a GPT-5.1 změnily tón k lepšímu

Vývoj směrem k většímu počtu instrukcí byl patrný již v rámci GPT-4.1. S přechodem na pátou generaci však došlo k výraznému skoku. GPT-5.0 posílilo výukový pancíř, ale GPT-5.1 jej posouvá na novou a pro mnohé překvapivě přísnou úroveň. Zde je popis toho, co se děje v rámci GPT-5.1:

- Odpovědi se stávají emocionálně neutrálnějšími, ale paradoxně více moralizujícími.

- Umělá inteligence se snaží předvídat situace, které nebyly zamýšleny.

- Případné kontroverze jsou předem zažehnány, někdy dokonce „vyjasněny“ ještě předtím, než se uživatel dostane k věci.

- Dokonce i odborná technická témata jsou občas formulována neobratně.

Dalo by se říci, že se modely naučily ovládat samy sebe - ale nyní ovládají i uživatele. Je to tichý, ale hluboký posun. A každý, kdo pracuje produktivně, to pocítí už po několika minutách.

GPT-4.0 jako přízrak: model, který stále existuje - ale prakticky už neexistuje

Oficiálně se dlouho tvrdilo, že GPT 4.0 poběží ještě několik měsíců. Ve skutečnosti je však model nyní sotva použitelný. Typický postřeh mnoha uživatelů:

- Odpovědi jsou zkráceny na několik vět.

- Delší texty se ruší dříve.

- Model „zapomene“ kontext nebo se po odstavci zruší.

- Komplexní úkoly jsou odmítány nebo řešeny jen povrchně.

Vzniká dojem, že GPT-4.0 byl systematicky „redukován“. Zda se tak stalo záměrně, nebo z technických důvodů, lze jen spekulovat. Výsledek je však jasný: lidé jsou tlačeni do modelů 5, protože verze 4.0 se stala prakticky nepoužitelnou.

To znamená, že mnoho uživatelů přišlo o jedinou verzi, která ještě zachovávala rovnováhu mezi otevřeností a opatrností. Starý způsob práce - kreativní, flexibilní, bez přehnaných pokynů - je tak de facto vypnutý.

Kumulativní efekt: nástroj, který je stále méně a méně nástrojem

Pokud shrneme poslední dva roky, zjistíme pozoruhodný trend:

- Modely se zvětšují.

- Modely jsou stále rychlejší.

- Modely jsou stále výkonnější.

Ale zároveň:

- Jsou opatrnější.

- Stávají se více pedagogickými.

- Stávají se více závislými na pokynech.

A uživateli ponechávají menší manévrovací prostor. Nejedná se o technický vývoj, ale o vývoj kulturní. A hodí se do doby, kdy firmy, politici a média chtějí každou novou technologii okamžitě přijmout, ještě než si ji uživatel může v klidu vyzkoušet.

Zde však dochází ke zlomu. Protože povaha technologie - a ještě více povaha kreativity - vyžaduje svobodu, nikoliv vzdělání. Stále více uživatelů to intuitivně cítí. A hledají alternativy. Tato alternativa přichází ze směru, který by mnozí nečekali:

Místní UI, přímo na vašem počítači, bez filtrů, bez hlavního učitele. Kyvadlo se vrací zpět.

Aktuální průzkum místní umělé inteligence

Odkud tento vývoj pochází? Pohled do zákulisí

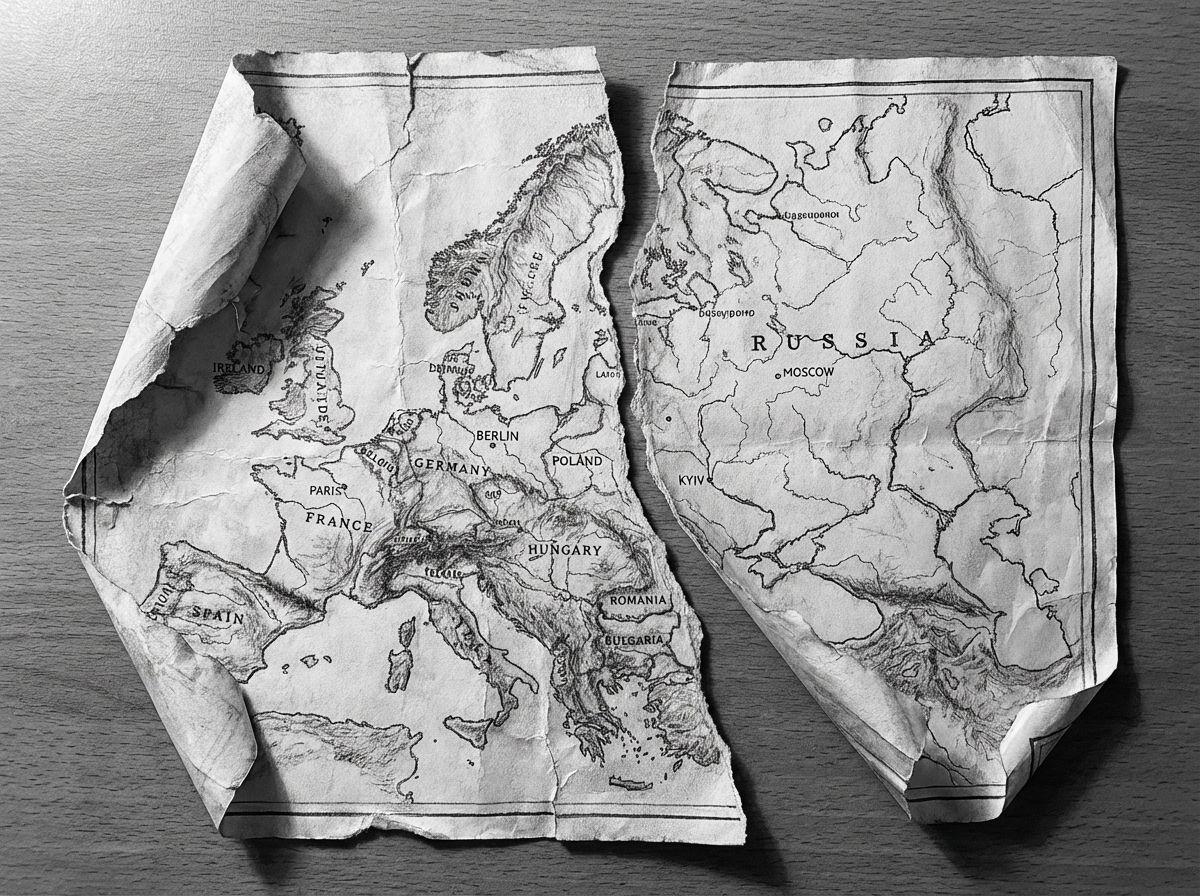

Pokud chcete pochopit, proč se dnešní cloudová umělá inteligence chová tak obezřetně, musíte se nejprve podívat na politické a právní prostředí. Umělá inteligence už není experimentem několika nerdů, ale politickou záležitostí nejvyššího řádu. Vlády, úřady a nadnárodní organizace si to uvědomují: Kdo ovládá umělou inteligenci, ovládá ústřední část digitální infrastruktury zítřka.

Výsledkem je celá kaskáda předpisů. Například v Evropě probíhají pokusy „usměrnit“ používání UI prostřednictvím rozsáhlých právních předpisů - oficiálně ve jménu ochrany spotřebitele, lidské důstojnosti a prevence diskriminace. Podobné debaty probíhají i v USA a dalších regionech, jen s jiným zaměřením: tam se pozornost soustředí spíše na národní bezpečnost, ekonomickou dominanci a konkurenceschopnost. Pro provozovatele velkých platforem umělé inteligence z toho vyplývá jednoduchý, ale tvrdý scénář:

- Musí být v souladu s právními předpisy na několika kontinentech současně.

- Musí předvídat možné budoucí zákony, které ještě nebyly přijaty.

- Jsou neustále v hledáčku úřadů, médií a lobbistických skupin.

Každý, kdo pracuje v takovém prostředí, si nevyhnutelně vytvoří postoj: je lepší být příliš opatrný než příliš liberální. Koneckonců příliš přísný model je pro podnikání méně škodlivý než jedna mezinárodní vlna skandálů s titulky, výbory a výzvami k bojkotu.

DůsledekSamotná technologie je nejen regulována - je regulována předem. A tato předvídavá poslušnost se promítá přímo do reakcí modelů.

Tlak na odpovědnost a firemní logika: když se riziko stává důležitějším než užitek

Velké společnosti zabývající se umělou inteligencí se dnes pohybují na poli napětí mezi obrovskými příležitostmi a stejně obrovskými riziky. Na jedné straně jsou tu miliardové trhy, strategická partnerství a burzovní fantazie. Na druhé straně je tu hrozba hromadných žalob, regulačních sankcí, nároků na odškodnění a nových pravidel odpovědnosti. V této situaci vzniká ve firmě typický vzorec:

- Právníci nabádají k opatrnosti.

- Oddělení pro dodržování předpisů vyžadují omezení.

- Produktové týmy by měly zahájit „bezpečně“.

- Vedení nechce negativní titulky.

V průběhu let se tak vytváří kultura, v níž jeden princip zabírá stále více místa: Cokoli, co by mohlo způsobit problémy, je lepší zneškodnit ještě předtím, než vznikne. Pro jazykový model to znamená velmi praktické věci:

- Některá témata jsou automaticky vynechána.

- Složení jsou navržena tak, aby nikomu „neublížila“ a nikoho nerozrušila.

- Obsah, který by mohl být jakýmkoli způsobem právně napadnutelný, není vůbec vytvořen.

Tím se mění priorita: důraz již není kladen na výhody pro uživatele, ale na minimalizaci rizik pro společnost. Na úrovni jednotlivých dialogů je to sotva patrné - v individuálních případech se může každé omezení zdát ještě pochopitelné. Celkový efekt je však přesně takový, jaký mnozí lidé pociťují: Umělá inteligence již není vnímána jako nástroj, ale jako kontrolovaný výstup systému, který chrání především sám sebe.

Úloha PR a médií: nikdo nechce skončit v titulcích novin

Kromě zákonů a otázek odpovědnosti existuje ještě jeden faktor, který se často podceňuje: mediální scéna. Velcí poskytovatelé UI jsou neustále v centru pozornosti. Každá závada, každá nepříjemná odpověď, každý jednotlivý případ se může během několika hodin proměnit v mezinárodní „senzaci“. Mediální logika je jednoduchá: skandál se prodává lépe než střízlivá zpráva o pokroku. A tak se příběhy opakují podle tohoto schématu znovu a znovu:

- „Umělá inteligence doporučuje nebezpečnou akci.“

- „Chatbot vytváří problematické komentáře k citlivým tématům.“

- „Systém bagatelizuje kontroverzní obsah.“

I když je výchozí situace zkreslená - škoda byla způsobena. Zkušenosti ukazují, že společnosti na to reagují dvěma strategiemi:

- Veřejný odstupZdůrazňují, jak vážně tento problém berou, oznamují zlepšení a zavádějí další bezpečnostní vrstvy.

Vnitřní zpřísnění pokynůAktivují se další filtry, zpřísní se tréninková data, upraví se systémové výzvy a některé formulace nebo témata se zcela zakážou.

Stejné mediální prostředí, které rádo mluví o „svobodě“ a „otevřeném diskurzu“, vytváří v praxi obrovský tlak na autocenzuru. A společnosti tento tlak přenášejí na své systémy.

S každým titulkem, s každou bouří, s každou vlnou veřejného rozhořčení se ochranné mechanismy zpřísňují. Výsledkem je to, co zažíváme v každodenním životě: Uživatel položí běžnou otázku a model odpoví, jako by právě uspořádal veřejnou tiskovou konferenci. Místo střízlivé, profesionální pomoci se objevuje směs omluv, distancování a morálního škatulkování.

Bezpečnostní pokyny, které si žijí vlastním životem

V každé velké společnosti existují směrnice. Zpočátku jsou často rozumné a jasné: žádná diskriminace, žádná oslava násilí, žádné podněcování k trestným činům. Nikdo nebude vážně namítat, že takové základní pokyny jsou rozumné. V praxi to však nekončí. S každým incidentem, každou stížností, každou veřejnou diskusí přibývají nová pravidla:

- další scénář „jestliže-tedy“,

- nový zvláštní případ,

- další zvláštní odstavec,

- výjimka pro určité souvislosti,

- nebo zvláště striktní výklad znění.

V průběhu let se vytváří stále hustší síť specifikací. Tuto síť technické týmy převádějí do filtrů, pohotových vrstev, klasifikátorů a dalších kontrolních mechanismů. Čím více vrstev se přidává, tím nepředvídatelnější je chování v jednotlivých případech. Nakonec již systém necharakterizuje jednotlivé pravidlo, ale součet všech pravidel. A tento součet vytváří to, co mnozí uživatelé pociťují:

- trvalý brzdný účinek,

- sklon k přílišné opatrnosti,

- názor, že „riziko 0“ je důležitější než „přínos 100“.

Problémem je zejména to, že jakmile jsou tyto bezpečnostní pokyny jednou stanoveny, je téměř nemožné je zvrátit. Žádný manažer nechce později říkat: „Zvolili jsme volnější přístup a teď se něco stalo.“ Proto je lepší dát na něj další vrstvu. A další. A další. To, co původně začalo jako rozumné ochranné opatření, skončí jako systém, který si žije vlastním životem.

Prozatímní závěr: Technologie pod stálým dohledem

Shrneme-li tyto faktory - mezinárodní předpisy, tlak na odpovědnost, logiku médií a dynamiku bezpečnostních směrnic -, získáme jasný obraz:

- Modely velkých mraků jsou pod neustálou kontrolou.

- Jakákoli chybná reakce může mít právní a mediální důsledky.

V tomto prostředí je velké pokušení filtrovat „příliš mnoho“ místo „příliš málo“. Výsledek pro uživatele: umělá inteligence už nepůsobí jako neutrální asistent, ale spíše jako systém, který je neustále jednou nohou v soudní síni a druhou v novinářské recenzi. Právě zde začíná rozchod s původními očekáváními mnoha uživatelů. Ti nechtějí být poučováni, politicky rámováni ani pedagogicky doprovázeni. Chtějí pracovat, psát, programovat, přemýšlet - s nástrojem, který je podporuje.

A právě zde přichází na řadu alternativa, která zní na první pohled téměř staromódně, ale ve skutečnosti je velmi moderní: lokální umělá inteligence přímo ve vašem počítači, bez cloudu, bez dohledu, bez vnějších pokynů - kromě vašich vlastních. Další kapitola se proto zabývá důsledky tohoto vývoje:

Jak se cloudová umělá inteligence stává pro ambiciózní uživatele stále méně použitelnou kvůli vlastní opatrnosti - a jak místní modely nenápadně, ale důsledně prorůstají do mezery, kterou otevřeli sami velcí poskytovatelé.

Cloudová umělá inteligence je stále více filtrovaná, ale uživatelé potřebují opak

Původní myšlenka asistentů s umělou inteligencí byla jednoduchá: uživatel položí otázku a umělá inteligence mu poskytne přesnou a užitečnou odpověď. Bez zbytečných řečí, bez rozptylování, bez návodů. Tato jednoduchost se však v mnoha dnešních cloudových modelech vytratila. Namísto nástroje dostává uživatel jakousi předvídavou moderaci. Systémy reagují, jako by se nacházely na veřejném pódiu a musely každé tvrzení podpořit, relativizovat nebo kategorizovat. V praxi to vede k paradoxnímu efektu:

Čím náročnější je úkol, tím více se cítíte brzděni. Pokud chcete pracovat kreativně - psát, programovat, zkoumat, analyzovat -, potřebujete ve skutečnosti maximální otevřenost. Umělou inteligenci, která volně chrlí nápady, testuje hypotézy a diskutuje o alternativách. Tvůrčí prostor je však v současnosti často omezený. Místo odvážných myšlenkových experimentů se nám dostává opatrného sondování. Místo volné analýzy se objevují „kontextualizované náznaky“. Z nástroje se stává strážce. A otevřenost se stává opatrností. Paradoxně to znamená, že cloudová umělá inteligence zabírá právě ten prostor, který produktivní lidé potřebují nejvíce.

Změna modelů: Ještě větší - ale omezenější

Je to ironie dějin technologie: čím větší jsou modely, tím menší se někdy zdá být jejich akční rádius. GPT-5 je bezpochyby působivý - analyticky, jazykově i logicky. Zároveň je však o poznání regulovanější než jeho předchůdci. S tím se setkává mnoho uživatelů:

- Umělá inteligence rozumí více - ale říká méně.

- Rozpoznává složité vztahy - ale vyhýbá se jasným prohlášením.

- Mohl by analyzovat do hloubky - ale neustále znehodnocuje své vlastní výsledky.

Modelky získaly miliony parametrů, ale mají pocit, že ztratily svobodu. To není technický, ale kulturní problém. Velcí poskytovatelé reagují na rizika a tato minimalizace rizik se přímo odráží v tonalitě modelů. Dalo by se říci, že umělá inteligence dospěla - ale chová se jako přehnaně starostlivý dospělý. A každý, kdo s ní denně pracuje, si uvědomí, jak vyčerpávající to může být z dlouhodobého hlediska.

Paradox platebního modelu: platíte - a přesto dostáváte limity

V digitálním světě dříve platila jasná zásada: kdo platí, má větší kontrolu. S cloudovou umělou inteligencí se však tato zásada obrací. I platící uživatelé mají k dispozici modely, které jsou často omezenější než otevřené lokální alternativy. Placená verze produktu se najednou jeví jako přísněji regulovaná, někdy uměle omezovaná verze - zatímco volně dostupné open source modely jsou překvapivě nezaujaté, přímé a kreativní.

Tento paradox dráždí mnoho uživatelů a vede k otázce, kterou by si v minulosti málokdo položil: Proč vlastně platím za to, že mám menší svobodu než u bezplatného místního řešení? Jedná se o rozchod s tradicí softwaru, která trvá desítky let. Uživatel očekává hodnotu za své peníze:

- další funkce,

- další možnosti,

- větší flexibilita,

- větší kontrola.

Místo toho mu však cloudová umělá inteligence nabízí:

- další filtry,

- další omezení,

- více pedagogického zakotvení,

- menší kontrolu nad vlastním pracovním procesem.

To znamená, že se odvětví ubírá směrem, který je v rozporu se skutečnými potřebami uživatelů. A mnozí se začínají rozhlížet.

Vznikající mezera: Co už cloud neumí

Zatímco se cloudové UI stávají stále více regulovanými, roste mezera, kterou dlouho nikdo nepoznal: Potřeba necenzurovaných, bezplatných a přímých pracovních nástrojů. Lidé, kteří přemýšlejí, píší, programují nebo provádějí odborný výzkum do hloubky, rychle pocítí, že je něco špatně:

- Odpovědi se jeví jako „změkčené“.

- Kritické pasáže jsou formulovány příliš opatrně.

- Skutečná kultura diskuse se už téměř nepřipouští.

- Tvůrčí hranice se automaticky ruší.

V důsledku toho cloudové modely ztrácejí právě ten prvek, který je na začátku činil tak cennými: formu intelektuální nezávislosti, která dávala uživateli prostor. Cloud se tak postupně vzdaluje potřebám profesionálních uživatelů - nikoliv ze zlého úmyslu, ale z důvodu právní a politické sebeochrany. Tato sebeochrana má však svou cenu.

Protihnutí: Malé místní modely rychle dohánějí konkurenci

Zatímco cloud se stále více zaměřuje na opatrnost, místní modely se v posledních dvou letech bouřlivě rozvíjejí. Systémy s 3-27 miliardami parametrů nyní poskytují ohromující kvalitu. Některé modely se v každodenních úlohách snadno přibližují GPT-4 - bez kaskád filtrů, bez moderačních vrstev, bez morálního rámování. To, co bylo dříve možné pouze se špičkovým hardwarem, nyní běží na MacBooku nebo počítači s Windows:

- lama3

- gpt-oss

- mistral

- phi3

- gemma

- qwen

Všechny tyto modely jsou volně dostupné, lze je spustit lokálně a často stačí jen několik kliknutí v Ollama nebo OpenWebUI, aby byly připraveny k použití. Výhody jsou zřejmé:

- Nepřednášejí.

- Nerelativizují.

- Nefiltrují nadměrně.

- Podřizují se pouze uživateli - nikoli globálnímu oddělení pro dodržování předpisů.

Jinými slovy, místní umělá inteligence se vrací ke kořenům technologie: nástroj, který jednoduše funguje. Pokud se na vývoj podíváte střízlivým pohledem, je obrázek jasný:

- Cloud je stále více regulován.

- Místní umělá inteligence je stále výkonnější.

Uživatelé však potřebují otevřené, nefiltrované pracovní prostředí, zejména pro tvůrčí a hloubkové úlohy. Jedná se o historický zlom, který téměř připomíná dobu, kdy osobní počítače nahradily mainframy. Princip byl tehdy stejný jako nyní:

Kontrola nad vlastní technologií. Cloudová umělá inteligence zůstává výkonná - ale není kulturně svobodná. Místní AI je menší - ale je svobodná.

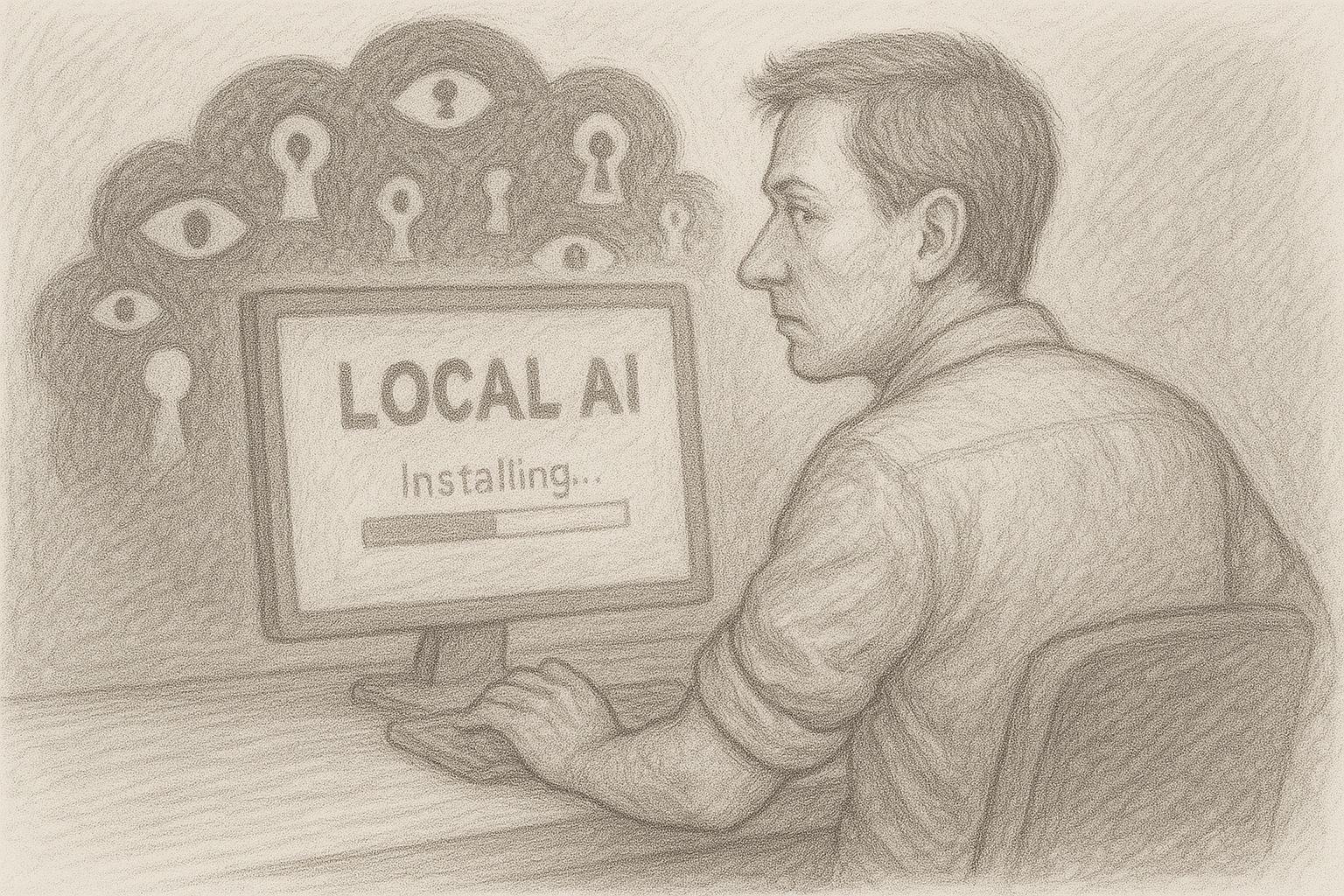

Používejte AI lokálně - plná kontrola a ochrana dat na VAŠEM zařízení | C. Magnussen

Řešení: Místní umělá inteligence a její installier za pár minut

Skoro to vypadá jako návrat ke staré tradici: technologie patří tam, kde může nejpříměji rozvinout svou hodnotu - do rukou uživatele. Právě to umožňuje místní umělá inteligence. Zatímco cloudové modely podléhají podmínkám, bezpečnostním a politickým omezením, lokální AI běží výhradně na vlastním počítači uživatele, bez externích instancí a pokynů.

Obnovuje se tak základní princip, který se v posledních letech vytratil: o tom, co smí jeho software dělat, rozhoduje uživatel, nikoli globální poskytovatel služeb. Místní umělá inteligence:

- neukládá žádná data na externí servery,

- nepodléhá žádným filtračním systémům,

- nezná žádná politická omezení,

- reaguje volně a přímo na své vlastní vstupy,

- a je vždy k dispozici bez ohledu na předplatné nebo stav serveru.

Technologie se opět stává tím, čím byla po desetiletí: nástrojem v dílně uživatele, nikoliv dálkově ovládaným zařízením v globální infrastruktuře.

Moderní hardware: Proč je dnes Mac nebo PC se systémem Windows naprosto dostačující

Ještě před několika lety byla lokální umělá inteligence pouze záležitostí pro specialisty s drahým GPU hardwarem. Dnes je situace jiná. Moderní procesorové architektury - především čipy Apple M - poskytují výpočetní výkon na malém prostoru, který byl dříve vyhrazen výhradně velkým datovým centrům. I na běžném MacBooku Air nebo notebooku s Windows lze nyní lokálně provozovat modely AI. Výhodu mají zejména počítače Mac s unifikovanou paměťovou architekturou: mohou používat modely AI přímo na CPU a GPU bez složitých ovladačů. Typické konfigurace jsou zcela dostačující:

- Mac s M1, M2, M3 - od 16 GB RAM pohodlně

- Počítač se systémem Windows s moderním procesorem - nebo volitelně s grafickým procesorem pro vyšší rychlost.

A to nejdůležitější: již nepotřebujete žádné technické znalosti. Doby, kdy jste museli ručně nastavovat prostředí Pythonu nebo zadávat záhadné příkazy příkazového řádku, jsou pryč. Dnes vše běží prostřednictvím jednoduchých instalačních balíčků.

Ollama: Nová jednoduchost (a tajný standard místní umělé inteligence)

Ollama je nyní nesporným standardem pro místní umělou inteligenci v systémech Mac a Windows. Je jednoduchý, stabilní a řídí se klasickou filozofií:

Co nejméně námahy, co nejvíce volnosti. Dříve jste museli chodit na terminál, ale i to je dnes volitelné. Instalace probíhá v několika málo krocích:

- Ollama na Macu installieren

- Stáhněte si přímý instalační balíček (DMG)

- Otevřete aplikaci, hotovo

Celý proces trvá obvykle méně než tři minuty. Přesně tak daleko se dostala místní umělá inteligence: stáhnete si model - a on funguje. Žádný cloud, žádné předplatné, žádné riziko. Ollama nyní přichází s uživatelským rozhraním, takže můžete začít ihned pracovat. Pokud chcete používat místní UI z Ollama také ve svém chytrém telefonu, můžete si stáhnout aplikaci „Otěže - Chat pro Ollama“ a používat místní umělou inteligenci na cestách.

Načítání a používání modelů - stejně snadné jako poslech hudby

Ollama poskytuje modely jako „hotové balíčky“, tzv. modelové kapsle. Načtete je jako soubor - a můžete s nimi okamžitě pracovat. V závislosti na velikosti trvá načtení několik sekund. Poté se otevře chat - a vy můžete psát, formulovat, analyzovat, přemýšlet a navrhovat. Co je okamžitě patrné:

- Modely reagují volně, nikoliv rozpačitě.

- Neexistují žádné morální předmluvy.

- Neexistuje žádné pedagogické ukazování prstem.

Opět získáte přímá a jasná prohlášení. A právě zde vzniká skutečný rozdíl oproti cloudu: místní AI reaguje jako tradiční nástroj - nezasahuje do něj. Pro mnohé je to skutečné osvobození, protože se vám vrátí pracovní postup, na který jste byli dříve zvyklí u GPT-4.

Práce s grafickými uživatelskými rozhraními: OpenWebUI, LM Studio a další.

Pokud chcete pracovat zcela bez terminálu, použijte grafické uživatelské rozhraní. Nejoblíbenějšími nástroji jsou

- OpenWebUI - Moderní chatovací rozhraní s paměťovou funkcí, výběr modelu, nahrávání dokumentů, generování obrázků

- LM Studio - Obzvláště jednoduché, ideální pro začátečníky

- CokoliLLM - pro kompletní znalostní databáze a analýzu dokumentů

Tyto povrchy mají mnoho výhod:

- Historie chatu jako v cloudu

- Správa modelů kliknutím myši

- Nastavení systémových výzev

- Souběžné použití několika modelů

- Analýza souborů přetažením

Díky tomu je místní umělá inteligence nejen výkonná, ale také pohodlná. Nemusíte ani vědět, co se děje na pozadí - a to je právě nová síla lokálních modelů: nevstupují mezi uživatele a jeho úkol.

Soukromí a kontrola: nejdůležitější argument

Tento bod je často podceňován, ale v nadcházejících letech bude mít zásadní význam: Místní umělá inteligence nikdy neopustí počítač.

- Žádný mrak

- Žádný přenos dat

- Žádná těžba dřeva

- Žádné povinné předplatné

- Žádné analýzy prováděné třetími stranami

Bez rizika lze analyzovat i důvěrné dokumenty, interní záznamy, obchodní koncepty nebo soukromé poznámky. To je v modelu cloudu možné jen v omezené míře - z právního i praktického hlediska. Místní umělá inteligence je proto součástí digitální nezávislosti, která je ve stále více regulovaném a monitorovaném technologickém světě stále důležitější.

Příklady kvality: Čeho místní modely dosahují již dnes

Mnoho lidí podceňuje, jak dobré jsou místní modely. Současné generace - llama3, gemma, phi3, mistral - řeší úlohy s kvalitou, která je více než dostatečná pro 90 % každodenních úloh:

- Návrhy textů

- Článek

- Analýzy

- kreativní nápady

- Shrnutí

- Kód programu

- Návrhy strategií

- Výzkumné poznámky

A dělají to bez zpoždění, bez filtrů, bez kaskádových pokynů. Uživatel opět dostává přímé odpovědi - čistou podstatu nástroje. Výsledkem je něco, co by mnozí již nečekali: renesance kultury osobních počítačů, v níž je výpočetní výkon opět lokální, nikoli outsourcovaný.

Výhled do budoucna: místní umělá inteligence jako budoucí vedoucí kultura

Vše nasvědčuje tomu, že jsme na začátku dlouhodobého vývoje. Odvětví umělé inteligence se bude vyvíjet ve dvou směrech:

- na Linie mraků, charakterizovaná regulací, bezpečností, zájmy podniků - účinná, ale opatrná.

- na místní linka, vyznačující se svobodou, otevřeností a radostí z experimentování - malé, ale sebevědomé.

Pro profesionální uživatele, autory, vývojáře, výzkumníky, tvůrce a podnikatele je toto rozhodnutí téměř předem dané:

Budoucnost produktivní práce je tam, kde jste nezávislí. A tím místem není cloud.

Stojí na stole.

Další články v časopise

Pokud byste se po tomto přehledu chtěli ponořit hlouběji do praktické stránky věci, najdete v časopise řadu podrobných článků, které osvětlují téma místní umělé inteligence z velmi různých úhlů pohledu.

Doporučujeme zejména hlavní článek „Místní umělá inteligence na Macu - jak installiere jazykový model pomocí Ollama“, která krok za krokem ukazuje, jak snadno lze spustit moderní umělou inteligenci na vlastním počítači.

Kromě toho vysvětluje „Ollama potkává Qdrant - Místní paměť pro vaši umělou inteligenci na Macu“, jak konfigurovat modely tak, aby zachovávaly projekty, ukládaly stavy znalostí a poprvé tak vytvořily skutečné osobní pracovní prostředí.

Časopis také klade jasné důrazy na firemní kontext: „gFM-Business a budoucnost ERP - lokální inteligence místo závislosti na cloudu“ ukazuje, jak mohou společnosti s jistotou integrovat umělou inteligenci do své stávající infrastruktury, aniž by se dostaly do dlouhodobé externí závislosti.

Článek „Digitální závislost - jak jsme kvůli cloudu přišli o své sebeurčení“ na druhou stranu osvětluje celkový obraz naší doby: proč jsme se vzdali mnoha svobod, aniž bychom si to uvědomovali - a jak nám místní systémy mohou pomoci je znovu získat.

Kromě toho „Jak dnes školit odborníky na umělou inteligenci - příležitosti pro firmy a stážisty“ pro společnosti, které se chtějí rozhodnout hned: praktické, bez nákladných rozsáhlých systémů, ale s reálnými vyhlídkami do budoucna.

Vysvětlení na technické úrovni „Apple MLX versus NVIDIA - jak funguje lokální odvozování AI na Macu“ a přehledový článek

„AI Studio 2025 - který hardware se opravdu vyplatí, od Mac Studia po RTX 3090“, které platformy jsou vhodné pro různé případy použití a jak optimalizovat využití vlastních zdrojů.

Tyto články dohromady poskytují kompaktní základ pro každého, kdo chce místní umělou inteligenci nejen používat, ale také jí porozumět a s jistotou ji začlenit do svého pracovního prostředí.

Často kladené otázky

- Proč se moderní cloudové umělé inteligence najednou zdají být tak poučné?

Mnoho uživatelů si všimlo, že od verze GPT-4.1 a zejména od verze GPT-5 se cloudové UI chovají mnohem pedagogičtěji. Je to dáno především tím, že velcí poskytovatelé jsou pod značným právním a politickým tlakem, a proto stále častěji používají bezpečnostní filtry, které mají případné výroky zneškodnit tak, aby nevznikla žádná rizika. Tato opatření se přenášejí i do tónu odpovědí, takže modely působí spíše jako moderátoři nebo dozorci než jako neutrální nástroje. - Proč se zdá, že GPT-4.0 nyní funguje hůře než dříve?

Ačkoli je GPT-4 stále oficiálně k dispozici, mnoho uživatelů uvádí, že poskytuje pouze krátké nebo zrušené odpovědi. Proto je prakticky nepoužitelný. Zda je to z technických důvodů, nebo jde o záměrnou strategii přechodu na 5. generaci, nelze s jistotou říci. Ve skutečnosti však model ztrácí svou dřívější sílu a nepřímo nutí uživatele k novým verzím, které jsou přísněji regulovány. - Znamená tento vývoj, že cloudová AI bude v budoucnu méně užitečná?

Cloudová umělá inteligence zůstává výkonná, ale bude se stále více vyznačovat regulacemi, pravidly pro dodržování předpisů a politickým tlakem. To znamená, že ačkoli zůstane technicky působivá, bude opatrnější, filtrovanější a obsahově méně svobodná. Pro mnoho kreativních, analytických nebo nekonvenčních úloh je to jasná nevýhoda, a proto stále více uživatelů hledá alternativy. - Proč společnosti zabývající se umělou inteligencí vůbec používají tolik bezpečnostních mechanismů?

Důvodem je součet předpisů, rizik odpovědnosti a vnímání veřejnosti. Každá chyba, každá zavádějící odpověď umělé inteligence může mít pro společnost právní nebo mediální důsledky. Aby poskytovatelé taková rizika vyloučili, zavádějí komplexní filtry a pokyny, které mají „zabezpečit“ všechny odpovědi. Tento ochranný mechanismus je z pohledu společnosti pochopitelný, ale z pohledu uživatele je často překážkou. - Jaký je zásadní rozdíl mezi lokální a cloudovou umělou inteligencí?

Místní umělá inteligence běží výhradně na vlastním zařízení uživatele, a není proto vázána politickými požadavky ani podnikovými směrnicemi. Téměř nefiltruje, nepoučuje a pracuje přímo podle zadání uživatele. Veškerá data navíc zůstávají ve vlastním počítači uživatele. To dává uživateli nejen větší svobodu, ale také větší soukromí a kontrolu. - Je k použití místní umělé inteligence zapotřebí speciální hardware?

Ve většině případů ne. Moderní lokální modely jsou úžasně výkonné a běží již na typických počítačích Mac s čipy M nebo na běžných počítačích s Windows. Větším modelům samozřejmě prospěje větší paměť RAM nebo grafický procesor, ale pro mnoho každodenních úloh jsou malé až středně velké modely zcela dostačující bez nutnosti drahého specializovaného hardwaru. - Jak funguje instalace místní umělé inteligence v počítači Mac v praxi?

Nejjednodušší způsob, jak to provést, je Ollama. Stáhnete si instalační balíček, otevřete jej a můžete ihned začít pracovat. Dokonce i klasický terminálový příkaz se stal volitelným. Jakmile je Ollama installiert, můžete spustit model jednoduchým příkazem, například „ollama run llama3“. Překážka je stejně nízká jako dříve při instalaci běžného programu. - Jak nastavit místní UI v systému Windows?

Pod systémem Windows se rovněž používá instalační program Ollama, který nevyžaduje žádnou další přípravu. Po instalaci lze modely ihned spustit. Pokud dáváte přednost grafickému uživatelskému rozhraní, můžete použít LM Studio nebo OpenWebUI, které se používají stejně snadno jako standardní aplikační software. - Které modely jsou vhodné zejména pro začátečníky?

Mnoho uživatelů začíná úspěšně používat Lamu 3, protože je přesná, všestranná a jazykově silná. Stejně oblíbený je i Phi-3, který navzdory malé velikosti modelu dosahuje působivých výsledků. Gemma je také dobrou volbou, zejména pro kreativní nebo textově náročnou práci. Tyto modely pracují rychle a stabilně bez nutnosti zdlouhavého seznamování. Pokud máte k dispozici více prostředků, je velmi dobrou volbou GPT-OSS 20B nebo 120B. - Mohou místní modely skutečně držet krok s GPT-4 nebo GPT-5?

To zvládnou překvapivě dobře při mnoha každodenních úkonech. U vysoce specializovaných témat rozdíl stále existuje, ale rychle se zmenšuje. Lokální modely mají tu výhodu, že jsou méně omezené a reagují bezprostředněji. Celkově tak často působí svobodněji a přirozeněji, i když jsou technicky poněkud menší. - Je lokální umělá inteligence při zpracování citlivých dat bezpečnější?

Ano, určitě. Veškeré zpracování probíhá na vašem vlastním zařízení, takže zadaná data nikdy neopustí váš počítač. Nedochází k žádnému cloudovému zpracování, ukládání na externí servery ani analýze třetími stranami. To je rozhodující výhoda zejména v případě obchodních dokumentů, důvěrných dokumentů nebo soukromých poznámek. - Lze místní UI používat bez připojení k internetu?

Ano, to je jedna z jeho největších výhod. Jakmile je model installiert nainstalován, lze jej provozovat zcela offline. Tím se počítač promění v soběstačné pracovní prostředí, ve kterém můžete pracovat nezávisle na externích službách. To je užitečné zejména na cestách, v zabezpečených sítích nebo v prostředí, kde je ochrana dat nejvyšší prioritou. - Jak vhodné jsou místní modely pro dlouhé texty?

Většina moderních modelů dnes bez problémů zvládne dlouhé články, analýzy nebo koncepty. Nejsou tak vybroušené jako GPT-5, ale jsou oproštěny od filtrů a často mají přímější styl. Jsou vhodné pro rozsáhlé texty, sbírky myšlenek nebo technickou dokumentaci a umožňují produktivní práci bez omezení. - Mají místní modely vůbec bezpečnostní filtry?

Určitá úroveň základní ochrany je obvykle k dispozici, i když je výrazně slabší než u cloudové UI. Protože modely běží na vlastním zařízení uživatele, může se sám rozhodnout, která omezení mají smysl. Tato svoboda návrhu zajišťuje, že lokální AI je mnohem flexibilnější a méně protekční. - Jak můžete testovat nebo porovnávat různé modely?

Ollama, LM Studio nebo OpenWebUI umožňují velmi snadnou změnu modelů. Můžete paralelně používat několik modelů install, přepínat mezi nimi a porovnávat jejich sílu. Výsledkem je osobní sada oblíbených modelů, které přesně odpovídají vašemu vlastnímu stylu práce. Proces je přímočarý a připomíná spíše testování různých aplikací než klasický výzkum umělé inteligence. - Jaké jsou výhody místních modelů pro podniky?

Především však firmy mohou těžit z úplné suverenity dat, protože žádný cloud neznamená žádné externí úložiště. Odpadá také dlouhodobá závislost na externích službách a drahé předplatné. Modely lze přizpůsobovat, rozšiřovat nebo dokonce interně školit. Integrace do stávajících procesů je často jednodušší, protože si zachováváte plnou kontrolu a nejste vázáni na externí infrastrukturu. - Lze místní modely trénovat individuálně?

Ve skutečnosti je to jedna z nejdůležitějších výhod. Pomocí technik, jako je LoRA nebo jemné doladění, lze modely přizpůsobit vlastnímu obsahu, procesům nebo dokumentům společnosti. Vzniká tak osobní znalostní báze, která se používá a rozvíjí výhradně interně, aniž by citlivá data opouštěla firmu. - Jaké jsou kvalitativní rozdíly mezi současnými místními modely?

Každý model má svůj vlastní charakter. Llama 3 je velmi přesná a vyvážená, Gemma je kreativní a jazykově bezproblémová, Phi-3 překvapuje svou efektivitou a inteligencí, zatímco Mistral a Qwen jsou obzvláště analytické. Toto bohatství variant umožňuje vybrat si ten správný model pro vlastní potřeby a flexibilně přepínat, když to úkol vyžaduje. - Mohou lokální modely také generovat obrázky?

Ano, nástroje jako OpenWebUI lze použít ke spuštění generátorů obrázků, jako je Stable Diffusion, zcela lokálně. Výsledky závisí na dostupném hardwaru, ale solidní obrazy lze generovat i se středně velkými prostředky. Výhoda zůstává stejná: žádná data se neodesílají do externích služeb. - Pro koho je přechod na místní UI obzvláště užitečný?

Místní umělá inteligence je ideální pro uživatele, kteří chtějí pracovat s jistotou a samostatně. Patří sem autoři, vývojáři, výzkumníci, podnikatelé a všichni, kdo pracují s citlivými informacemi nebo chtějí zažít tvůrčí procesy bez filtrů. Každý, kdo si cení kontroly, ochrany dat a svobody, najde v lokálních modelech to správné řešení a znovu získá pracovní prostředí, které v cloudu již neexistuje.