Numa altura em que os serviços centralizados de IA, como o ChatGPT, o Claude ou o Gemini, estão a dominar as manchetes, muitos utilizadores profissionais têm uma necessidade crescente de uma alternativa - uma infraestrutura de IA local e auto-controlável. Especialmente para processos criativos, dados sensíveis ou fluxos de trabalho recorrentes, uma solução local é frequentemente a opção mais sustentável e segura.

Qualquer pessoa que trabalhe com um Mac - especialmente com o Apple Silicon (M1, M2, M3 ou M4) - pode agora encontrar ferramentas incrivelmente poderosas para executar os seus próprios modelos linguísticos diretamente no dispositivo. No centro de tudo isto está um novo componente, em grande parte desconhecido: MLX, uma estrutura de aprendizagem automática desenvolvida pelo Apple que irá provavelmente desempenhar um papel cada vez mais central no ecossistema de IA da empresa nos próximos anos.

Últimas notícias sobre o MLX e o Ollama

02.05.2026Um vídeo atual aprofunda o tema e classifica em pormenor os motores de inferência mais importantes. Torna-se claro que não é apenas o modelo em si que é decisivo, mas sobretudo o „motor“ que lhe está subjacente, ou seja, o motor que controla o cálculo, os acessos à memória e a comunicação. A comparação entre o Ollama, o MLX, o llama.cpp e o vLLM mostra como o desempenho e as áreas de aplicação podem ser muito diferentes, dependendo do hardware e dos objectivos. O papel do MLX nos dispositivos Apple-Silicon é particularmente interessante, uma vez que são possíveis novos ganhos de eficiência graças a esta arquitetura. Ao mesmo tempo, é evidente que não existe uma solução universal: Dependendo do cenário - local, baseado em servidor ou em escala - diferentes motores fazem sentido. O vídeo acrescenta, assim, uma importante perspetiva estratégica ao atual desenvolvimento do MLX.

Ollama, MLX, llama.cpp ou vLLM? Como escolher o motor para a SUA IA! | Giorgi Lomidze

30.03.2026: Com o versão de pré-visualização atual O Ollama integra pela primeira vez a estrutura MLX do Apple como backend para Macs Apple-Silicon. O objetivo é acelerar significativamente a IA local e utilizar melhor o hardware. O MLX utiliza a arquitetura de memória unificada dos Macs modernos, permitindo que os dados sejam partilhados de forma eficiente entre a CPU e a GPU sem cópias constantes. O resultado são melhorias notáveis no „tempo para o primeiro token“ e na velocidade de geração.

Os benchmarks e relatórios iniciais falam de ganhos significativos de desempenho através de taxas de token muito maiores e de uma utilização mais eficiente da memória. O vídeo apresentado no artigo mostra claramente porque é que esta mudança é tão importante: a pilha llama.cpp anterior está a ser substituída pelo MLX, tornando a IA local no Mac verdadeiramente fluida e adequada para utilização diária pela primeira vez. Ao mesmo tempo, a função continua a ser uma pré-visualização, pelo que são de esperar limitações e optimizações adicionais. De um modo geral, a mudança marca uma transição importante para uma IA rápida e de execução local no hardware do consumidor.

O que é o MLX - e o que significa o novo formato?

O MLX é uma estrutura de código aberto do Apple para aprendizagem automática, especialmente adaptada à arquitetura de hardware do Apple Silicon. Ao contrário de outros backends de IA, como o PyTorch ou o TensorFlow, o MLX utiliza diretamente as vantagens da chamada "memória unificada" do Apple, ou seja, o acesso partilhado do CPU e do GPU à mesma área de RAM. Isto garante um processamento significativamente mais eficiente de dados e modelos - especialmente para grandes modelos de linguagem, que podem conter vários gigabytes.

O formato MLX associado descreve normalmente modelos cujos pesos são armazenados num formato de ficheiro comprimido .npz (NumPy Zip). Modelos como o Mistral, Phi-2 ou LLaMA 3 podem ser convertidos para este formato utilizando ferramentas adequadas e executados diretamente num Mac - sem uma nuvem, sem uma API, sem restrições.

Noutro artigo apresento uma Comparação entre Apple Silicon e NVIDIA e explicar que hardware é adequado para executar modelos de língua local num Mac.

A situação atual: O que o Apple já oferece

Com o anúncio de Apple Intelligence Em 2024, o Apple começou a integrar funções de IA de todo o sistema diretamente no sistema operativo. Assistentes de escrita, processamento de imagem, pesquisa semântica, funções de correio inteligente - muito disto é executado completamente localmente, especialmente em dispositivos com um chip M1 ou mais recente. No entanto, nenhuma das novas funções está disponível em Macs Intel mais antigos.

Ao mesmo tempo, o Apple desenvolveu ainda mais a estrutura MLX e publicou-a sob uma licença aberta. Em combinação com ferramentas como o mlx-lm ou a nova API Swift do MLX, já é possível executar modelos de texto localmente, configurar os seus próprios fluxos de trabalho ou treinar modelos - diretamente no seu próprio Mac, sem que os dados saiam do dispositivo.

Os utilizadores profissionais em particular - das áreas de desenvolvimento de software, publicação, marketing ou investigação, por exemplo - podem beneficiar muito com isto, uma vez que o MLX lhes dá oportunidades completamente novas de integrar modelos de IA nos seus fluxos de trabalho sem terem de depender de fornecedores externos.

Como funciona o MLX na prática

Se quiser utilizar o MLX hoje, só precisa de um terminal, Python (idealmente num ambiente virtual separado) e o pacote mlx-lm, que reúne todas as funções necessárias: Descarga de modelos, quantificação, inferência e conversação. Após a instalação, os modelos prontos da comunidade Hugging Face podem ser iniciados - por exemplo:

mlx_lm.chat --model mlx-community/Mistral-7B-Instruct-v0.3-4bit

Em alternativa, também é possível aceder à API utilizando um script Python. Os modelos são automaticamente carregados, armazenados em cache e executados localmente - sem uma ligação à Internet após o descarregamento inicial.

Também é fácil converter os seus próprios modelos. Com um único comando, pode descarregar modelos do Hugging Face Hub, quantificá-los e disponibilizá-los para o MLX:

python -m mlx_lm.convert --hf-path meta-llama/Llama-3-8B-Instruct -q

Os ficheiros .npz resultantes podem então ser permanentemente guardados localmente e reutilizados.

A comparação: MLX vs. Ollama, Llama.cpp e LM Studio

Para além do MLX, existem várias alternativas estabelecidas para a utilização local da IA no Mac - sobretudo o Ollama, o Llama.cpp e o LM Studio. Cada uma destas ferramentas tem os seus pontos fortes, mas também limitações específicas.

Ollama

Ollama é particularmente popular entre os programadores porque oferece uma linha de comandos simples e uma API REST. Os modelos estão disponíveis aqui no formato GGUF, um formato de ficheiro optimizado para uma execução rápida em máquinas locais. O Ollama é rápido de configurar, flexível e suporta uma vasta gama de modelos. No entanto, o Ollama não funciona atualmente no Mac com o motor MLX, mas utiliza principalmente um backend baseado em metal através do llama.cpp.

Para fluxos de trabalho que requerem automação ou operação sem cabeça (por exemplo, processos executados em segundo plano), o Ollama é atualmente a primeira escolha. No entanto, se pretender utilizar as optimizações próprias do Apple, terá de esperar por futuras integrações MLX.

Lhama.cpp

Este projeto constitui a base de muitas outras ferramentas (incluindo o Ollama) e oferece um motor de inferência de elevado desempenho para modelos GGUF. É extremamente flexível, mas nem sempre é fácil de utilizar ou operar - especialmente para principiantes. A grande vantagem: existe uma enorme comunidade, muitas extensões e um desenvolvimento estável.

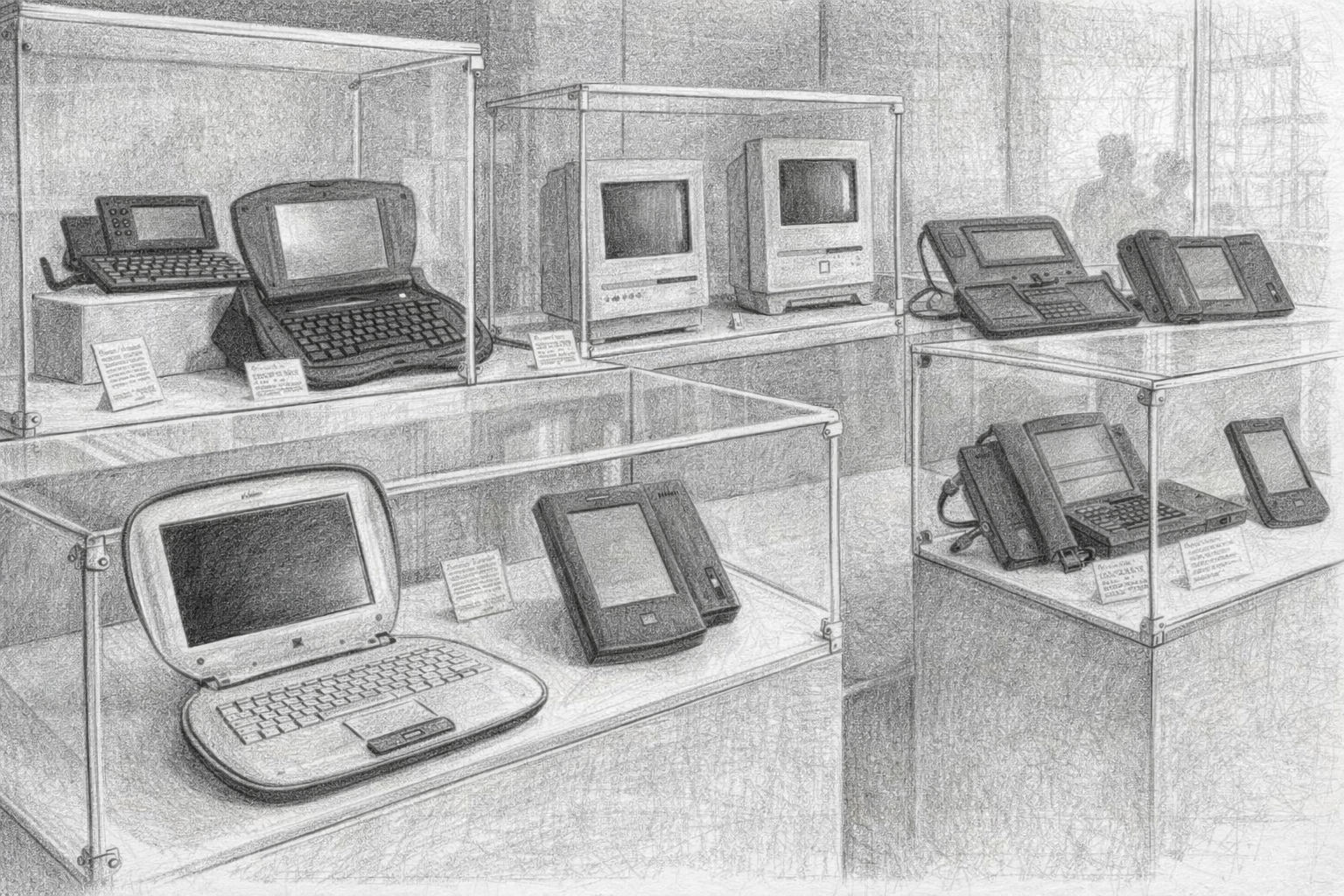

Estúdio LM

Quem procura uma interface gráfica do utilizador acaba normalmente por utilizar o LM Studio. A ferramenta combina o download, a administração e a execução de modelos de linguagem numa aplicação simples, nativa do Mac - incluindo uma interface de chat, configuração e gestão de modelos. O destaque: o LM Studio também suporta o motor MLX há alguns meses, permitindo-lhe tirar o máximo partido das optimizações do Apple num Mac M1 ou M2 - e com um consumo de RAM significativamente inferior ao de ferramentas comparáveis.

O LM Studio é o ponto de entrada ideal para o mundo da IA local, especialmente para os utilizadores que não se querem preocupar com os comandos do terminal - e em combinação com o MLX, é um verdadeiro sucesso.

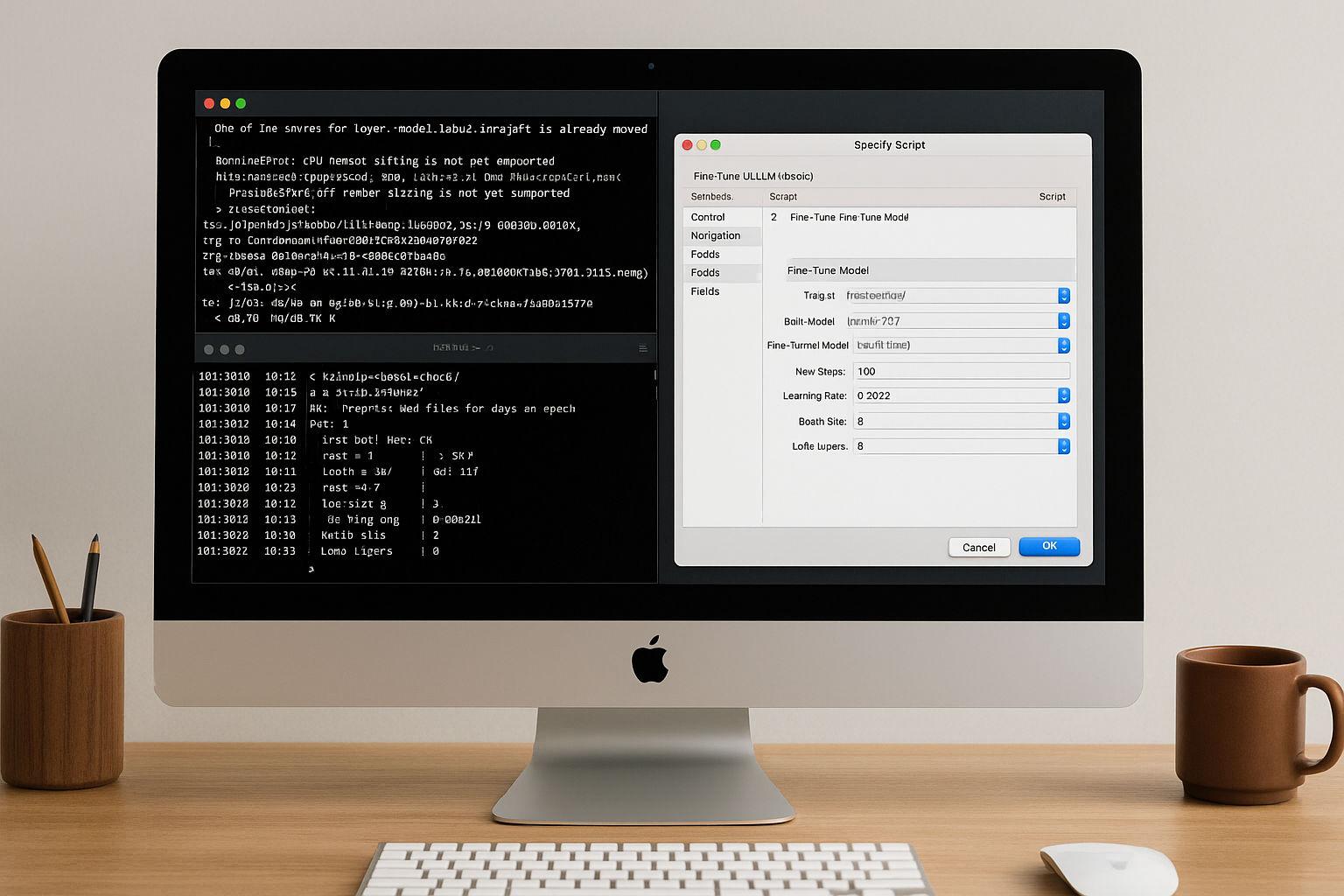

Afinação facilitada: como o FileMaker 2025 transporta o treino LoRA para a vida quotidiana

Enquanto o MLX e o Ollama mostram como os modelos linguísticos podem ser operados localmente e integrados nos processos existentes, o passo seguinte vai muito mais longe: a personalização direcionada destes modelos para os seus próprios dados. É precisamente aqui que a abordagem com o FileMaker 2025 da Claris, filial do Apple sobre. Em vez de ambientes de formação isolados, é criada uma interface estruturada na qual os registos de dados, os parâmetros de formação e as versões dos modelos podem ser geridos de forma centralizada. A formação LoRA pode ser preparada, iniciada e reproduzida utilizando processos claramente definidos - sem ter de controlar cada passo manualmente através de scripts ou linhas de comando. Isto transforma a afinação experimental num fluxo de trabalho reproduzível que pode ser integrado nos processos empresariais existentes. Esta é uma vantagem decisiva, especialmente para as empresas que trabalham com os seus próprios dados: a IA não permanece geral, mas é treinada especificamente para o seu próprio contexto.

Enquanto o MLX e o Ollama mostram como os modelos linguísticos podem ser operados localmente e integrados nos processos existentes, o passo seguinte vai muito mais longe: a personalização direcionada destes modelos para os seus próprios dados. É precisamente aqui que a abordagem com o FileMaker 2025 da Claris, filial do Apple sobre. Em vez de ambientes de formação isolados, é criada uma interface estruturada na qual os registos de dados, os parâmetros de formação e as versões dos modelos podem ser geridos de forma centralizada. A formação LoRA pode ser preparada, iniciada e reproduzida utilizando processos claramente definidos - sem ter de controlar cada passo manualmente através de scripts ou linhas de comando. Isto transforma a afinação experimental num fluxo de trabalho reproduzível que pode ser integrado nos processos empresariais existentes. Esta é uma vantagem decisiva, especialmente para as empresas que trabalham com os seus próprios dados: a IA não permanece geral, mas é treinada especificamente para o seu próprio contexto.

Quando o MLX em Silicon é a melhor escolha

Embora as soluções baseadas em GGUF (Ollama, Llama.cpp) sejam muito flexíveis e funcionem em muitas plataformas, o MLX destaca-se pela sua profunda integração no mundo do Apple. Particularmente dignos de nota são:

- Utilização eficiente da memória através da memória unificada

- Otimização para Metal/GPU sem configuração complexa

- Integração perfeita em projectos Swift e estruturas Apple

- Preparado para o futuro, uma vez que o Apple está a desenvolver ativamente a estrutura

- Expansibilidade, por exemplo, através de modelos personalizados, afinação e integração de sistemas

Para os utilizadores de Mac que pretendem planear a longo prazo e manter o controlo total sobre os seus dados, o MLX é já uma entrada promissora no mundo da IA local - com potencial para se tornar o padrão no futuro.

Da IA local aos processos empresariais reais: Onde os sistemas ERP entram em ação

O que é frequentemente subestimado neste contexto: A verdadeira força dos sistemas locais de IA, como o MLX ou o Ollama, não reside apenas no modelo em si, mas também na sua integração nos fluxos de trabalho existentes. As interfaces e APIs, em particular, permitem não utilizar a IA isoladamente, mas integrá-la diretamente nos processos operacionais - por exemplo, ao analisar dados, automatizar textos ou apoiar decisões.

O que é frequentemente subestimado neste contexto: A verdadeira força dos sistemas locais de IA, como o MLX ou o Ollama, não reside apenas no modelo em si, mas também na sua integração nos fluxos de trabalho existentes. As interfaces e APIs, em particular, permitem não utilizar a IA isoladamente, mas integrá-la diretamente nos processos operacionais - por exemplo, ao analisar dados, automatizar textos ou apoiar decisões.

É precisamente aqui que um sistema ERP potente se torna o elo central: fornece os dados, estrutura os processos e assegura que os resultados da IA não são apenas gerados, mas também processados de forma significativa. Quem quiser seriamente utilizar a IA local de forma produtiva, precisará, portanto, de um cenário de sistema bem pensado a longo prazo. Mais informações na página Software ERP, onde será apresentado um sistema ERP baseado no FileMaker. O servidor FileMaker suporta a hospedagem de modelos de linguagem MLX a partir da versão 2025 diretamente no servidor da base de dados e fornece os comandos de script correspondentes. O software da Claris, subsidiária da Apple, funciona em dispositivos Apple Mac, Windows e dispositivos móveis iOS.

Uma perspetiva: Onde o Apple quer chegar com o MLX e o Apple Intelligence

Com a WWDC 2025, o Apple sinalizou claramente que o MLX não é um truque, mas um componente estratégico no crescente ecossistema do Apple em torno da IA. A integração dos novos „Foundation Models“ diretamente no macOS e no iOS, o suporte nativo do Swift e o desenvolvimento do MLX na direção da formação, quantificação e inferência mostram claramente que o Apple quer envolver-se - mas à sua maneira. Noutro artigo, mostro onde Apple com Siri e Gemini no âmbito da parceria com a Google.

Com a WWDC 2025, o Apple sinalizou claramente que o MLX não é um truque, mas um componente estratégico no crescente ecossistema do Apple em torno da IA. A integração dos novos „Foundation Models“ diretamente no macOS e no iOS, o suporte nativo do Swift e o desenvolvimento do MLX na direção da formação, quantificação e inferência mostram claramente que o Apple quer envolver-se - mas à sua maneira. Noutro artigo, mostro onde Apple com Siri e Gemini no âmbito da parceria com a Google.

O Apple mantém-se fiel à sua linha: sem promessas espectaculares, mas com uma tecnologia sólida, que funciona localmente e que se comprova a longo prazo. Para os utilizadores profissionais, isto não é apenas atrativo, mas também estrategicamente muito interessante.

O MLX está no bom caminho para se tornar a solução padrão para a IA local no Mac. Aqueles que já estão a trabalhar com ele hoje em dia estão a ganhar uma vantagem valiosa - seja para aplicações criativas, técnicas ou analíticas. Em combinação com ferramentas como o mlx-lm, o LM Studio ou a nova API Swift, pode ser criado um ambiente de IA robusto, fiável e preparado para o futuro - em linha com a forma de trabalhar controlada e soberana em termos de dados que se tornará cada vez mais importante no futuro.

Estudo atual sobre a inteligência artificial

Utilizar o MLX no Mac - instruções simples para principiantes

Com o MLX, o Apple criou um novo sistema que lhe permite utilizar a inteligência artificial (IA) diretamente no seu próprio Mac - sem ligação à Internet, sem a nuvem, sem depender do Google ou do OpenAI. O melhor de tudo: se tiver um Mac com um processador M1, M2, M3 ou M4 (ou seja, Apple Silicon), pode experimentar o MLX em apenas alguns passos. Tudo é executado localmente - os seus textos, perguntas e dados nunca saem do seu computador.

Aqui explico passo a passo como descarregar e utilizar um modelo de linguagem com o MLX. Parece técnico - mas verá que é fácil de fazer.

Etapa 1: Verificar os requisitos

Primeiro, é necessário:

- Um Mac Apple Silicon (M1 ou mais recente). Pode encontrar esta informação nas definições do sistema em "Acerca deste Mac".

- macOS 13 (Ventura) ou mais recente.

- Uma ligação à Internet que funcione - apenas para descarregar o modelo, depois disso tudo funciona offline.

- Algum espaço de armazenamento, pelo menos cerca de 8-10 GB para um modelo pequeno.

Também precisa de um programa chamado "Terminal", que já vem instalado em todos os Mac. Utilizamo-lo para introduzir alguns comandos. Pode encontrá-lo no seu Mac em "Aplicações/Utilidades" ou simplesmente digitar e depois "Terminal" e confirmar com "Enter". Não se preocupe - só precisa de copiar e colar.

Etapa 2: Animais Python 1TP12 (apenas se necessário)

O MLX funciona com a linguagem de programação Python. Muitos Macs já têm Python installiert. Pode verificar se está disponível introduzindo o seguinte no terminal:

python3 --version

Se obtiver um número de versão (por exemplo, Python 3.10.6), pode continuar diretamente.

Caso contrário, recomendo a utilização de Homebrew para installieren (uma ferramenta popular para programas no Mac). Para o fazer, introduza no terminal:

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"

Em seguida, installier com o qual o Python:

brew install python

Etapa 3: MLX-Tool 1TP12Animal

Agora, descarregamos a ferramenta MLX com a qual pode utilizar posteriormente o modelo de linguagem. Para o fazer, installier um pequeno programa chamado mlx-lm. Introduza-o no terminal:

pip3 install mlx-lm

Isto demora alguns segundos. Quando terminar, está pronto para carregar um modelo.

Passo 4: Descarregar e iniciar um modelo

Agora vem a parte excitante: tem um modelo de linguagem real no seu Mac - por exemplo, uma versão do Mistral, um modelo de IA muito poderoso e disponível gratuitamente. Basta introduzi-lo no terminal:

mlx_lm.chat --model mlx-community/Mistral-7B-Instruct-v0.3-4bit

Este comando faz três coisas:

- O modelo é descarregado automaticamente (uma única vez).

- É preparada e iniciada.

- Acaba numa janela de chat no terminal onde pode fazer perguntas - semelhante ao ChatGPT.

Quando a transferência estiver concluída (pode demorar alguns minutos, dependendo da velocidade da sua Internet), verá um cursor a piscar. Pode agora escrever, por exemplo:

Fale-me um pouco sobre a história de Veneza.

...e o modelo responde diretamente - completamente offline.

Etapa 5: Continuar a trabalhar com o modelo

Quando tiver terminado, pode terminar a conversação digitando exit ou fechando a janela. Mais tarde, pode reutilizar o mesmo modelo sem ter de o descarregar novamente, bastando introduzir novamente o mesmo comando. O modelo é agora armazenado localmente no Mac e aí permanece.

Se quiser experimentar modelos diferentes, pode fazê-lo através de Cara de abraço ou alterar o nome do modelo diretamente na linha do terminal - por exemplo

mlx_lm.chat --model mlx-community/Phi-2-4bit

Cada modelo tem um estilo diferente - alguns são factuais, outros são mais criativos ou orientados para o diálogo.

Ainda mais fácil? Use o LM Studio como uma interface

Se preferir trabalhar com um rato e uma janela, pode também experimentar o programa LM Studio. Tem uma interface agradável, suporta MLX (em Apple Silicon) e permite descarregar e utilizar modelos com um clique.

Pode obter o LM Studio aqui:

Após a instalação, pode selecionar "MLX" como motor nas definições - o programa utiliza então a mesma tecnologia acima referida, mas numa bonita janela com um campo de conversação.

Conseguiu - está agora a utilizar uma IA moderna completamente local no seu Mac, sem qualquer nuvem ou subscrição. O Apple MLX permite utilizar modelos linguísticos de forma eficiente, segura e com proteção de dados.

Se mais tarde quiser ir mais longe - por exemplo, treinar os seus próprios modelos, melhorá-los com os seus textos ou integrá-los no seu próprio software (como o FileMaker) - então o MLX é a escolha certa para si. Mas o primeiro passo está dado: tem o controlo de volta - e uma IA poderosa diretamente no seu computador.

Do modelo local à memória real da IA

O artigo sobre o MLX mostra claramente como a IA local se tornou poderosa diretamente no hardware Apple - em particular graças à estreita integração com a arquitetura do Apple Silicon e a estruturas optimizadas. O Ollama concentra-se mais na integração simples, APIs e fluxos de trabalho flexíveis, enquanto o MLX está profundamente incorporado no ecossistema do Apple e oferece um enorme potencial a longo prazo. É precisamente aqui que entra a nova série de artigos: Vai um passo mais além e mostra como estes modelos locais de IA podem ser expandidos para incluir uma verdadeira „memória“. Em vez de se limitarem a executar modelos, é criada uma base de conhecimentos que a exportação de dados dos seus próprios históricos de conversação do ChatGPT e torna-a semanticamente pesquisável. Isto faz com que a IA local não seja apenas uma ferramenta, mas um sistema pessoal que cresce com o seu próprio conhecimento.

O artigo sobre o MLX mostra claramente como a IA local se tornou poderosa diretamente no hardware Apple - em particular graças à estreita integração com a arquitetura do Apple Silicon e a estruturas optimizadas. O Ollama concentra-se mais na integração simples, APIs e fluxos de trabalho flexíveis, enquanto o MLX está profundamente incorporado no ecossistema do Apple e oferece um enorme potencial a longo prazo. É precisamente aqui que entra a nova série de artigos: Vai um passo mais além e mostra como estes modelos locais de IA podem ser expandidos para incluir uma verdadeira „memória“. Em vez de se limitarem a executar modelos, é criada uma base de conhecimentos que a exportação de dados dos seus próprios históricos de conversação do ChatGPT e torna-a semanticamente pesquisável. Isto faz com que a IA local não seja apenas uma ferramenta, mas um sistema pessoal que cresce com o seu próprio conhecimento.

Perguntas mais frequentes

- O que é exatamente o MLX - e em que é que difere do PyTorch ou do TensorFlow?

O MLX é um quadro de aprendizagem automática desenvolvido pelo Apple que foi especialmente optimizado para o Apple Silicon (M1-M4). Ao contrário do PyTorch ou do TensorFlow, que se destinam a muitas plataformas, o MLX utiliza especificamente a arquitetura dos chips Apple - por exemplo, a estrutura de memória comum (memória unificada) e a aceleração GPU metálica. Como resultado, funciona de forma mais eficiente em termos de memória e mais rápida em Macs - mas apenas em hardware Apple. - Por que razão deve escolher o MLX em vez de uma ferramenta como o Ollama ou o Llama.cpp?

O MLX tem uma vantagem se estiver a trabalhar especificamente no Apple Silicon e quiser obter o máximo desempenho do dispositivo. O Ollama e o Llama.cpp são muito flexíveis, mas muitas vezes funcionam de forma menos eficiente no Mac. O MLX também pode ser integrado diretamente em projectos Swift - ideal para programadores que criam aplicações próximas do Apple. Não é um concorrente do Ollama - mas uma ferramenta especializada para profissionais. - Que modelos são compatíveis com o MLX?

Muitos modelos de linguagem aberta são compatíveis - como Mistral, LLaMA 2 e 3, Phi-2 ou TinyLLaMA - que já estão convertidos ou podem ser convertidos utilizando a ferramenta mlx-lm.convert. É importante que estejam disponíveis no formato NumPy-ZIP (.npz) e que estejam preparados para o MLX. Existe agora uma secção separada em Hugging Face para modelos compatíveis com o MLX. - É fácil começar? Tenho de ser um programador?

Um pouco de conhecimento técnico é útil - por exemplo, para o terminal, ambientes Python ou nomes de modelos. Mas começar é relativamente fácil graças ao mlx-lm: um comando de instalação, um comando para iniciar, pronto. Se preferir trabalhar com uma interface de utilizador, pode utilizar o LM Studio - agora também suporta MLX no Mac. - Posso também treinar o MLX para os meus próprios projectos - por exemplo, com os meus próprios textos?

Sim, pode - mas a formação destina-se atualmente mais a utilizadores avançados. A maioria dos utilizadores utiliza modelos MLX para inferência (ou seja, para respostas, geração de texto, etc.). Para formação ou afinação, é necessário estar familiarizado com o LoRA, os formatos de dados (JSONL) e os requisitos de memória - ou utilizar ferramentas como o FileMaker 2025, que simplificam este processo. - O que acontece com a segurança e a proteção de dados na MLX?

Muito bem - porque o MLX funciona completamente a nível local. Todos os dados, entradas e respostas do modelo permanecem no seu próprio computador. Não há transferência para a nuvem, nem API externa - ideal para projectos sensíveis aos dados, documentos internos, dados de clientes protegidos ou notas confidenciais. - Que papel desempenha o Apple neste contexto? O MLX continuará a ser desenvolvido?

O Apple publicou o MLX sob uma licença aberta e está a desenvolvê-lo ativamente - especialmente em ligação com o Apple Intelligence, o sistema de IA para macOS, iOS e iPadOS. Na WWDC 2025, o MLX foi apresentado como o quadro oficial para a integração de modelos linguísticos personalizados no software Apple. Pode presumir-se que o MLX continuará a ganhar importância no mundo do Apple. - Posso também combinar o MLX com outras ferramentas, por exemplo, Neo4j, n8n ou FileMaker?

Sim - o MLX é uma estrutura de ML pura, mas pode ser ligado a outras ferramentas através de APIs REST, serviços Python personalizados ou wrappers locais. Por exemplo, pode integrá-lo na sua própria automatização (n8n), numa base de dados semântica (Neo4j) ou em soluções FileMaker - esta última está agora disponível de forma nativa com o FileMaker 2025

Imagem (c) Monoar_CGI_Artist @ pixabay