In einer Zeit, in der zentrale KI-Dienste wie ChatGPT, Claude oder Gemini die Schlagzeilen beherrschen, wächst bei vielen professionellen Anwendern das Bedürfnis nach einem Gegenpol – einer lokalen, selbst kontrollierbaren KI-Infrastruktur. Gerade für kreative Prozesse, sensible Daten oder wiederkehrende Arbeitsabläufe ist eine lokale Lösung oft die nachhaltigere und sicherere Option.

Wer mit einem Mac arbeitet – insbesondere mit Apple Silicon (M1, M2, M3 oder M4) – findet mittlerweile erstaunlich leistungsfähige Tools, um eigene Sprachmodelle direkt auf dem Gerät zu betreiben. Im Zentrum steht dabei eine neue, weitgehend unbekannte Komponente: MLX, ein von Apple entwickeltes Machine-Learning-Framework, das in den kommenden Jahren eine zunehmend zentrale Rolle im KI-Ökosystem des Unternehmens spielen dürfte.

Aktuelle Meldungen zu MLX und Ollama

02.05.2026: Ein aktuelles Video vertieft das Thema und ordnet die wichtigsten Inferenz-Engines im Detail ein. Dabei wird deutlich, dass nicht nur das Modell selbst entscheidend ist, sondern vor allem der „Motor“ dahinter – also die Engine, die Berechnung, Speicherzugriffe und Kommunikation steuert. Der Vergleich zwischen Ollama, MLX, llama.cpp und vLLM zeigt, wie stark sich Performance und Einsatzbereiche unterscheiden können, je nach Hardware und Zielsetzung. Besonders spannend ist die Rolle von MLX auf Apple-Silicon-Geräten, da hier durch die Architektur neue Effizienzgewinne möglich sind. Gleichzeitig wird klar, dass es keine universelle Lösung gibt: Je nach Szenario – lokal, serverbasiert oder skalierend – sind unterschiedliche Engines sinnvoll. Damit ergänzt das Video die aktuelle MLX-Entwicklung um eine wichtige strategische Perspektive.

Ollama, MLX, llama.cpp oder vLLM? So wählst du den Motor für DEINE KI! | Giorgi Lomidze

30.03.2026: Mit der aktuellen Vorschau-Version integriert Ollama erstmals Apples MLX-Framework als Backend für Apple-Silicon-Macs. Ziel ist es, lokale KI deutlich zu beschleunigen und die Hardware besser auszunutzen. MLX nutzt die Unified-Memory-Architektur moderner Macs, wodurch Daten effizient zwischen CPU und GPU geteilt werden können, ohne ständige Kopiervorgänge. Das Ergebnis sind spürbare Verbesserungen bei der „Time to First Token“ und der Generierungsgeschwindigkeit.

Erste Benchmarks und Berichte sprechen von deutlichen Performancegewinnen bis hin zu stark erhöhten Token-Raten und effizienterer Speichernutzung. Das im Artikel verlinkte Video zeigt anschaulich, warum dieser Wechsel so bedeutend ist: Der bisherige llama.cpp-Stack wird durch MLX ersetzt, wodurch lokale KI auf dem Mac erstmals wirklich flüssig und alltagstauglich wird. Gleichzeitig bleibt die Funktion noch eine Vorschau, sodass Einschränkungen und weitere Optimierungen zu erwarten sind. Insgesamt markiert der Schritt einen wichtigen Übergang hin zu schneller, lokal laufender KI auf Consumer-Hardware.

Was ist MLX – und wofür steht das neue Format?

MLX ist ein Open-Source-Framework von Apple für maschinelles Lernen, das speziell auf die Hardware-Architektur von Apple Silicon zugeschnitten ist. Im Gegensatz zu anderen KI-Backends wie PyTorch oder TensorFlow nutzt MLX direkt die Vorteile des sogenannten „Unified Memory“ von Apple – also den gemeinsamen Zugriff von CPU und GPU auf denselben RAM-Bereich. Das sorgt für eine deutlich effizientere Verarbeitung von Daten und Modellen – gerade bei großen Sprachmodellen, die mehrere Gigabyte umfassen können.

Das dazugehörige MLX-Format beschreibt typischerweise Modelle, deren Gewichtungen in einem komprimierten .npz-Dateiformat (NumPy Zip) abgelegt sind. Modelle wie Mistral, Phi-2 oder LLaMA 3 können mit entsprechenden Tools in dieses Format konvertiert und direkt auf einem Mac ausgeführt werden – ohne Cloud, ohne API, ohne Einschränkungen.

In einem weiteren Artikel stelle ich einen Vergleich zwischen Apple Silicon und NVIDIA an und erläutere, welche Hardware geeignet ist, um lokale Sprachmodelle auf einem Mac auszuführen.

Die aktuelle Lage: Was Apple jetzt schon bietet

Mit der Ankündigung von Apple Intelligence im Jahr 2024 hat Apple begonnen, systemweite KI-Funktionen direkt ins Betriebssystem zu integrieren. Schreibassistenten, Bildbearbeitung, semantische Suche, intelligente Mailfunktionen – vieles davon läuft vollständig lokal, insbesondere auf Geräten mit M1- oder neuerem Chip. Auf älteren Intel-Macs ist hingegen keine der neuen Funktionen verfügbar.

Parallel dazu hat Apple das MLX-Framework weiterentwickelt und unter einer offenen Lizenz veröffentlicht. In Kombination mit Tools wie mlx-lm oder der neuen MLX Swift API lassen sich heute bereits Textmodelle lokal betreiben, eigene Workflows aufbauen oder Modelle trainieren – direkt auf dem eigenen Mac, ohne dass Daten das Gerät verlassen.

Gerade professionelle Nutzer – etwa aus dem Bereich Softwareentwicklung, Publishing, Marketing oder Forschung – können davon stark profitieren, da sie auf Basis von MLX völlig neue Möglichkeiten erhalten, KI-Modelle in ihre Workflows zu integrieren, ohne auf externe Anbieter angewiesen zu sein.

So funktioniert MLX in der Praxis

Wer MLX heute nutzen möchte, braucht nur ein Terminal, Python (idealerweise in einer eigenen virtuellen Umgebung) und das Paket mlx-lm, das alle nötigen Funktionen bündelt: Modell-Download, Quantisierung, Inferenz und Chat. Nach der Installation lassen sich bereits vorgefertigte Modelle aus der Hugging-Face-Community starten – zum Beispiel:

mlx_lm.chat --model mlx-community/Mistral-7B-Instruct-v0.3-4bit

Alternativ kann man auch per Python-Skript auf die API zugreifen. Die Modelle werden dabei automatisch geladen, gecacht und lokal ausgeführt – ohne Internetverbindung nach dem ersten Download.

Auch die Konvertierung eigener Modelle ist einfach möglich. Mit einem einzigen Befehl kann man Modelle aus dem Hugging Face Hub herunterladen, quantisieren und für MLX bereitstellen:

python -m mlx_lm.convert --hf-path meta-llama/Llama-3-8B-Instruct -q

Die resultierenden .npz-Dateien können dann dauerhaft lokal gespeichert und wiederverwendet werden.

Der Vergleich: MLX vs. Ollama, Llama.cpp und LM Studio

Neben MLX gibt es auf dem Mac mehrere etablierte Alternativen zur lokalen KI-Nutzung – allen voran Ollama, Llama.cpp und LM Studio. Jedes dieser Tools hat seine Stärken, aber auch spezifische Grenzen.

Ollama

Ollama ist besonders bei Entwicklern beliebt, weil es eine einfache Kommandozeilen- und REST-API bietet. Die Modelle liegen hier im sogenannten GGUF-Format vor, einem optimierten Dateiformat für die schnelle Ausführung auf lokalen Maschinen. Ollama ist schnell eingerichtet, flexibel und unterstützt eine Vielzahl von Modellen. Aktuell läuft Ollama auf dem Mac allerdings noch nicht mit der MLX-Engine, sondern verwendet primär Metal-basiertes Backend über llama.cpp.

Für Workflows, bei denen es auf Automatisierung oder Headless-Betrieb (z. B. im Hintergrund laufende Prozesse) ankommt, ist Ollama aktuell die erste Wahl. Wer jedoch Apple-eigene Optimierungen nutzen will, muss auf zukünftige MLX-Integrationen warten.

Llama.cpp

Dieses Projekt bildet die Grundlage für viele andere Tools (darunter Ollama) und bietet eine sehr performante Inferenz-Engine für GGUF-Modelle. Es ist extrem flexibel, aber nicht immer ganz einfach zu installieren oder zu bedienen – besonders für Einsteiger. Der große Vorteil: Es gibt eine riesige Community, viele Erweiterungen und eine stabile Entwicklung.

LM Studio

Wer eine grafische Benutzeroberfläche sucht, landet meist bei LM Studio. Das Tool vereint Download, Verwaltung und Ausführung von Sprachmodellen in einer schlanken, Mac-nativen App – inklusive Chat-Interface, Konfiguration und Model-Management. Der Clou: LM Studio unterstützt seit einigen Monaten auch die MLX-Engine, wodurch man auf einem M1- oder M2-Mac die Vorteile von Apples Optimierungen voll ausspielen kann – und das bei deutlich geringerem RAM-Verbrauch als vergleichbare Tools.

Gerade für Nutzer, die sich nicht mit Terminal-Befehlen aufhalten möchten, ist LM Studio der ideale Einstiegspunkt in die Welt lokaler KI – und in Kombination mit MLX ein echter Leistungsträger.

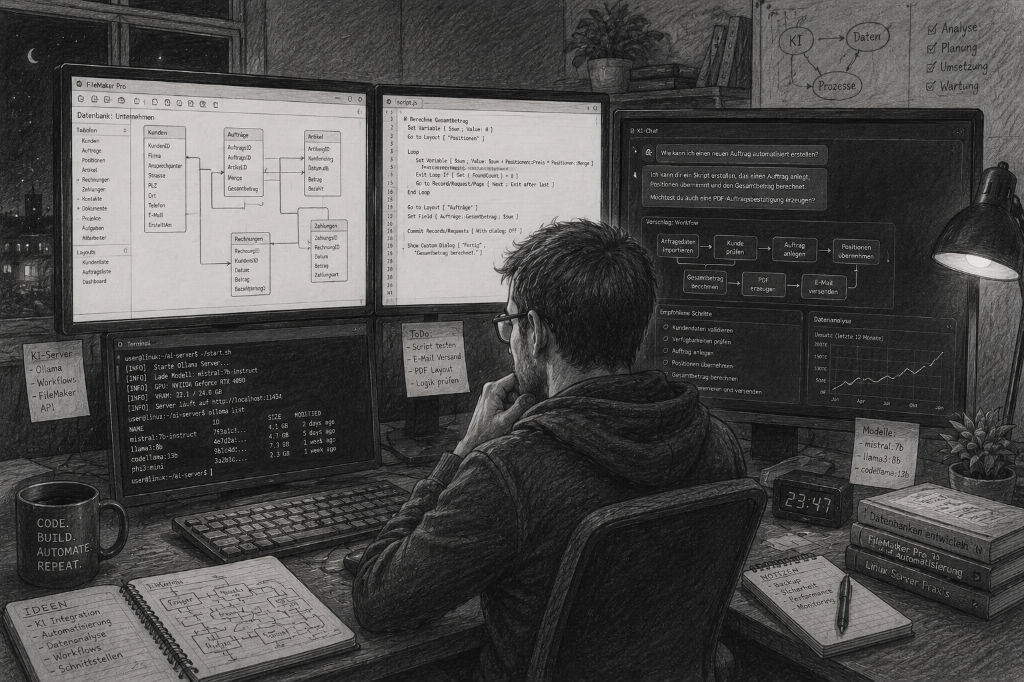

Feintuning einfach: Wie FileMaker 2025 LoRA-Training in den Alltag bringt

Während MLX und Ollama zeigen, wie sich Sprachmodelle lokal betreiben und in bestehende Abläufe integrieren lassen, geht der nächste Schritt deutlich weiter: die gezielte Anpassung dieser Modelle an eigene Daten. Genau hier setzt der Ansatz mit FileMaker 2025 der Apple-Tochter Claris an. Statt isolierter Trainingsumgebungen entsteht eine strukturierte Oberfläche, in der Datensätze, Trainingsparameter und Modellversionen zentral verwaltet werden können. Über klar definierte Prozesse lassen sich LoRA-Trainings vorbereiten, starten und nachvollziehen – ohne dass jeder Schritt manuell über Skripte oder Kommandozeilen gesteuert werden muss. Damit wird aus experimentellem Feintuning ein reproduzierbarer Workflow, der sich in bestehende Geschäftsprozesse einfügt. Gerade für Unternehmen, die mit eigenen Daten arbeiten, entsteht so ein entscheidender Vorteil: Die KI bleibt nicht allgemein, sondern wird gezielt auf den eigenen Kontext trainiert.

Während MLX und Ollama zeigen, wie sich Sprachmodelle lokal betreiben und in bestehende Abläufe integrieren lassen, geht der nächste Schritt deutlich weiter: die gezielte Anpassung dieser Modelle an eigene Daten. Genau hier setzt der Ansatz mit FileMaker 2025 der Apple-Tochter Claris an. Statt isolierter Trainingsumgebungen entsteht eine strukturierte Oberfläche, in der Datensätze, Trainingsparameter und Modellversionen zentral verwaltet werden können. Über klar definierte Prozesse lassen sich LoRA-Trainings vorbereiten, starten und nachvollziehen – ohne dass jeder Schritt manuell über Skripte oder Kommandozeilen gesteuert werden muss. Damit wird aus experimentellem Feintuning ein reproduzierbarer Workflow, der sich in bestehende Geschäftsprozesse einfügt. Gerade für Unternehmen, die mit eigenen Daten arbeiten, entsteht so ein entscheidender Vorteil: Die KI bleibt nicht allgemein, sondern wird gezielt auf den eigenen Kontext trainiert.

Wann MLX auf Silicon die bessere Wahl ist

Während GGUF-basierte Lösungen (Ollama, Llama.cpp) sehr flexibel sind und auf vielen Plattformen laufen, punktet MLX durch seine tiefgreifende Integration in die Apple-Welt. Besonders hervorzuheben sind:

- Effiziente Speichernutzung durch Unified Memory

- Optimierung für Metal/GPU ohne aufwändige Konfiguration

- Nahtlose Integration in Swift-Projekte und Apple-Frameworks

- Zukunftssicherheit, da Apple das Framework aktiv weiterentwickelt

- Erweiterbarkeit, z. B. durch eigene Modelle, Feintuning und Systemintegration

Für Mac-Nutzer, die langfristig planen und die volle Kontrolle über ihre Daten behalten möchten, ist MLX heute schon ein vielversprechender Einstieg in die Welt der lokalen KI – mit dem Potenzial, in Zukunft zum Standard zu werden.

Von lokaler KI zu echten Geschäftsprozessen: Wo ERP-Systeme ins Spiel kommen

Was in diesem Zusammenhang oft unterschätzt wird: Die eigentliche Stärke lokaler KI-Systeme wie MLX oder Ollama liegt nicht nur im Modell selbst, sondern in ihrer Integration in bestehende Arbeitsabläufe. Gerade über Schnittstellen und APIs entsteht die Möglichkeit, KI nicht isoliert zu nutzen, sondern direkt in operative Prozesse einzubinden – etwa bei der Analyse von Daten, der Automatisierung von Texten oder der Unterstützung von Entscheidungen.

Was in diesem Zusammenhang oft unterschätzt wird: Die eigentliche Stärke lokaler KI-Systeme wie MLX oder Ollama liegt nicht nur im Modell selbst, sondern in ihrer Integration in bestehende Arbeitsabläufe. Gerade über Schnittstellen und APIs entsteht die Möglichkeit, KI nicht isoliert zu nutzen, sondern direkt in operative Prozesse einzubinden – etwa bei der Analyse von Daten, der Automatisierung von Texten oder der Unterstützung von Entscheidungen.

Genau an dieser Stelle wird ein leistungsfähiges ERP-System zum zentralen Bindeglied: Es stellt die Daten bereit, strukturiert Abläufe und sorgt dafür, dass KI-Ergebnisse nicht nur erzeugt, sondern auch sinnvoll weiterverarbeitet werden. Wer lokale KI ernsthaft produktiv einsetzen möchte, kommt daher langfristig nicht an einer durchdachten Systemlandschaft vorbei. Weitere Informationen dazu auf der Seite ERP-Software, auf der ein FileMaker-basiertes ERP-System vorgestellt wird. FileMaker Server unterstützt ab Version 2025 das Hosting von MLX-Sprachmodellen direkt auf dem Datenbankserver und stellt entsprechende Scriptbefehle zur Verfügung. Die Software der Apple-Tochter Claris ist auf Apple Mac, Windows und mobil auf iOS-Geräten lauffähig.

Ein Ausblick: Wo Apple mit MLX und Apple Intelligence hin will

Apple hat mit der WWDC 2025 klar signalisiert, dass MLX keine Spielerei ist, sondern eine strategische Komponente im wachsenden Apple-Ökosystem rund um KI. Die Integration der neuen „Foundation Models“ direkt in macOS und iOS, die native Swift-Unterstützung und die Weiterentwicklung von MLX in Richtung Training, Quantisierung und Inferenz zeigen deutlich: Apple will mitmischen – aber auf eigene Weise. In einem weiteren Artikel zeige ich, wo Apple mit Siri und Gemini im Rahmen der Partnerschaft mit Google hin will.

Apple hat mit der WWDC 2025 klar signalisiert, dass MLX keine Spielerei ist, sondern eine strategische Komponente im wachsenden Apple-Ökosystem rund um KI. Die Integration der neuen „Foundation Models“ direkt in macOS und iOS, die native Swift-Unterstützung und die Weiterentwicklung von MLX in Richtung Training, Quantisierung und Inferenz zeigen deutlich: Apple will mitmischen – aber auf eigene Weise. In einem weiteren Artikel zeige ich, wo Apple mit Siri und Gemini im Rahmen der Partnerschaft mit Google hin will.

Dabei bleibt Apple seiner Linie treu: Keine spektakulären Versprechungen, sondern solide, lokal funktionierende Technik, die sich langfristig bewährt. Für professionelle Nutzer ist das nicht nur sympathisch, sondern strategisch hochinteressant.

MLX ist auf dem besten Weg, sich zur Standardlösung für lokale KI auf dem Mac zu entwickeln. Wer heute schon damit arbeitet, verschafft sich einen wertvollen Vorsprung – sei es für kreative, technische oder analytische Anwendungen. In Kombination mit Tools wie mlx-lm, LM Studio oder der neuen Swift-API lässt sich eine robuste, zuverlässige und zukunftssichere KI-Umgebung aufbauen – ganz im Sinne einer kontrollierten, datensouveränen Arbeitsweise, wie sie in Zukunft immer wichtiger wird.

Aktuelle Umfrage zu Künstlicher Intelligenz

MLX auf dem Mac nutzen – einfache Anleitung für Einsteiger

Apple hat mit MLX ein neues System geschaffen, mit dem man künstliche Intelligenz (KI) direkt auf dem eigenen Mac nutzen kann – ohne Internetverbindung, ohne Cloud, ohne Abhängigkeit von Google oder OpenAI. Das Schöne daran: Wenn Du einen Mac mit M1, M2, M3 oder M4 Prozessor besitzt (also Apple Silicon), kannst Du MLX mit wenigen Schritten ausprobieren. Alles läuft lokal – Deine Texte, Fragen und Daten verlassen Deinen Computer nie.

Hier erkläre ich Schritt für Schritt, wie Du ein sogenanntes Sprachmodell mit MLX herunterlädst und nutzt. Es klingt technisch – aber Du wirst sehen, es ist gut machbar.

Schritt 1: Voraussetzungen prüfen

Zuerst brauchst Du:

- Einen Apple Silicon Mac (M1 oder neuer). Du findest das in den Systemeinstellungen unter „Über diesen Mac“.

- macOS 13 (Ventura) oder neuer.

- Eine funktionierende Internetverbindung – nur zum Herunterladen des Modells, danach läuft alles offline.

- Etwas Speicherplatz, mindestens ca. 8-10 GB für ein kleines Modell.

Außerdem brauchst Du das Programm namens „Terminal“, das bereits auf jedem Mac vorinstalliert ist. Wir verwenden es, um ein paar Befehle einzugeben. Du findest es auf Deinem Mac unter „Programme/Dienstprogramme“ oder einfach <cmd – Leertaste> und dann „Terminal“ eintippen und mit „Enter“ bestätigen. Keine Sorge – Du brauchst nur zu kopieren und einzufügen.

Schritt 2: Python installieren (nur falls nötig)

MLX arbeitet mit der Programmiersprache Python. Viele Macs haben Python bereits installiert. Du kannst prüfen, ob es vorhanden ist, indem Du im Terminal folgendes eingibst:

python3 --version

Wenn Du eine Versionsnummer bekommst (z. B. Python 3.10.6), kannst Du direkt weitermachen.

Falls nicht, empfehle ich, Homebrew zu installieren (ein beliebtes Werkzeug für Programme auf dem Mac). Dafür gibst Du im Terminal ein:

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"

Danach installierst Du Python mit:

brew install python

Schritt 3: MLX-Tool installieren

Jetzt laden wir das MLX-Werkzeug herunter, mit dem Du später das Sprachmodell verwenden kannst. Dazu installierst Du ein kleines Programm namens mlx-lm. Gib im Terminal ein:

pip3 install mlx-lm

Das dauert ein paar Sekunden. Wenn es fertig ist, bist Du bereit, ein Modell zu laden.

Schritt 4: Ein Modell herunterladen und starten

Jetzt kommt der spannende Teil: Du holst Dir ein echtes Sprachmodell auf Deinen Mac – zum Beispiel eine Version von Mistral, einem sehr leistungsfähigen, frei verfügbaren KI-Modell. Einfach ins Terminal eingeben:

mlx_lm.chat --model mlx-community/Mistral-7B-Instruct-v0.3-4bit

Dieser Befehl bewirkt drei Dinge:

- Das Modell wird automatisch heruntergeladen (einmalig).

- Es wird vorbereitet und gestartet.

- Du landest in einem Chatfenster im Terminal, in dem Du Fragen stellen kannst – so ähnlich wie bei ChatGPT.

Wenn der Download abgeschlossen ist (kann je nach Internetgeschwindigkeit ein paar Minuten dauern), siehst Du einen blinkenden Cursor. Du kannst jetzt z. B. schreiben:

Erzähle mir etwas über die Geschichte von Venedig.

…und das Modell antwortet direkt – komplett offline.

Schritt 5: Mit dem Modell weiterarbeiten

Wenn Du fertig bist, kannst Du den Chat beenden, indem Du exit eintippst oder das Fenster schließt. Später kannst Du das gleiche Modell ohne erneuten Download wiederverwenden, indem Du einfach wieder denselben Befehl eingibst. Das Modell liegt nun lokal auf Deinem Mac und bleibt dort.

Wenn Du verschiedene Modelle ausprobieren möchtest, kannst Du sie über Hugging Face suchen oder direkt in der Terminalzeile den Modellnamen ändern – z. B.:

mlx_lm.chat --model mlx-community/Phi-2-4bit

Jedes Modell hat einen anderen Stil – manche sind sachlich, andere kreativer oder dialogorientierter.

Noch einfacher? LM Studio als Oberfläche nutzen

Wenn Du lieber mit Maus und Fenster arbeitest, kannst Du auch das Programm LM Studio ausprobieren. Es hat eine schöne Oberfläche, unterstützt MLX (auf Apple Silicon) und erlaubt Dir, Modelle per Klick herunterzuladen und zu verwenden.

LM Studio bekommst Du hier:

Nach der Installation kannst Du in den Einstellungen „MLX“ als Engine auswählen – dann nutzt das Programm dieselbe Technik wie oben, aber in einem hübschen Fenster mit Chatfeld.

Du hast es geschafft – Du nutzt jetzt eine moderne KI vollständig lokal auf Deinem Mac, ganz ohne Cloud oder Abo. Apple MLX macht es möglich, Sprachmodelle effizient, sicher und datenschutzfreundlich zu betreiben.

Wenn Du später noch tiefer einsteigen möchtest – etwa eigene Modelle trainieren, sie mit Deinen Texten verbessern oder in eigene Software (wie FileMaker) einbauen – dann bist Du mit MLX auf dem richtigen Weg. Aber der erste Schritt ist geschafft: Du hast die Kontrolle zurück – und eine leistungsfähige KI direkt auf Deinem Rechner.

Vom lokalen Modell zum echten KI-Gedächtnis

Im Artikel zu MLX wird deutlich, wie leistungsfähig lokale KI direkt auf Apple-Hardware inzwischen geworden ist – insbesondere durch die enge Verzahnung mit der Architektur von Apple Silicon und optimierten Frameworks. Ollama setzt dabei stärker auf einfache Integration, APIs und flexible Workflows, während MLX tief in das Apple-Ökosystem eingebettet ist und langfristig enormes Potenzial bietet. Genau hier setzt die neue Artikelserie an: Sie geht einen Schritt weiter und zeigt, wie sich diese lokalen KI-Modelle um ein echtes „Gedächtnis“ erweitern lassen. Statt nur Modelle auszuführen, wird eine Wissensbasis aufgebaut, die den Datenexport eigener Chatverläufe aus ChatGPT nutzt und semantisch durchsuchbar macht. Damit wird aus lokaler KI nicht nur ein Werkzeug, sondern ein persönliches System, das mit dem eigenen Wissen wächst.

Im Artikel zu MLX wird deutlich, wie leistungsfähig lokale KI direkt auf Apple-Hardware inzwischen geworden ist – insbesondere durch die enge Verzahnung mit der Architektur von Apple Silicon und optimierten Frameworks. Ollama setzt dabei stärker auf einfache Integration, APIs und flexible Workflows, während MLX tief in das Apple-Ökosystem eingebettet ist und langfristig enormes Potenzial bietet. Genau hier setzt die neue Artikelserie an: Sie geht einen Schritt weiter und zeigt, wie sich diese lokalen KI-Modelle um ein echtes „Gedächtnis“ erweitern lassen. Statt nur Modelle auszuführen, wird eine Wissensbasis aufgebaut, die den Datenexport eigener Chatverläufe aus ChatGPT nutzt und semantisch durchsuchbar macht. Damit wird aus lokaler KI nicht nur ein Werkzeug, sondern ein persönliches System, das mit dem eigenen Wissen wächst.

Häufig gestellte Fragen

- Was genau ist MLX – und wie unterscheidet es sich von PyTorch oder TensorFlow?

MLX ist ein von Apple entwickeltes Machine-Learning-Framework, das speziell für Apple Silicon (M1-M4) optimiert wurde. Im Gegensatz zu PyTorch oder TensorFlow, die auf viele Plattformen zielen, nutzt MLX gezielt die Architektur von Apple-Chips – z. B. die gemeinsame Speicherstruktur (Unified Memory) und Metal-GPU-Beschleunigung. Dadurch arbeitet es speichereffizienter und schneller auf Macs – allerdings nur auf Apple-Hardware. - Warum sollte man MLX einem Tool wie Ollama oder Llama.cpp vorziehen?

MLX ist dann im Vorteil, wenn man gezielt auf Apple Silicon arbeitet und maximale Leistung aus dem Gerät herausholen will. Ollama und Llama.cpp sind sehr flexibel, laufen aber oft weniger effizient auf dem Mac. MLX kann außerdem direkt in Swift-Projekten integriert werden – ideal für Entwickler, die Apple-nahe Anwendungen bauen. Es ist keine Konkurrenz zu Ollama – sondern ein Spezialwerkzeug für Profis. - Welche Modelle sind überhaupt mit MLX kompatibel?

Kompatibel sind viele offene Sprachmodelle – etwa Mistral, LLaMA 2 und 3, Phi-2 oder TinyLLaMA -, die entweder bereits konvertiert vorliegen oder mit dem Tool mlx-lm.convert umgewandelt werden können. Wichtig ist, dass sie im NumPy-ZIP-Format (.npz) vorliegen und für MLX vorbereitet sind. Es gibt auf Hugging Face mittlerweile eine eigene Sektion für MLX-kompatible Modelle. - Wie einfach ist der Einstieg? Muss ich dafür Entwickler sein?

Ein wenig technisches Verständnis ist hilfreich – z. B. für den Terminal, Python-Umgebungen oder Modellnamen. Aber der Einstieg ist dank mlx-lm relativ einfach: ein Installationsbefehl, ein Kommando zum Starten, fertig. Wer lieber mit Oberfläche arbeitet, kann LM Studio verwenden – es unterstützt MLX auf dem Mac inzwischen ebenfalls. - Kann ich MLX auch für eigene Projekte trainieren – z. B. mit eigenen Texten?

Ja, das geht – aber das Training ist derzeit eher für fortgeschrittene Anwender gedacht. Die meisten Nutzer nutzen MLX-Modelle für Inferenz (also zum Antworten, Textgenerieren etc.). Für Training oder Feintuning muss man sich mit LoRA, Datenformaten (JSONL) und dem Speicherbedarf auskennen – oder auf Tools wie FileMaker 2025 zurückgreifen, die diesen Prozess vereinfachen. - Wie steht es um Sicherheit und Datenschutz bei MLX?

Sehr gut – denn MLX läuft vollständig lokal. Alle Daten, Eingaben und Modellantworten bleiben auf Deinem eigenen Rechner. Es gibt keine Cloud-Übertragung, keine fremde API – ideal für datensensible Projekte, interne Dokumente, geschützte Kundendaten oder vertrauliche Notizen. - Welche Rolle spielt Apple selbst dabei? Wird MLX weiterentwickelt?

Apple hat MLX unter einer offenen Lizenz veröffentlicht und entwickelt es aktiv weiter – vor allem im Zusammenhang mit Apple Intelligence, dem KI-System für macOS, iOS und iPadOS. Auf der WWDC 2025 wurde MLX als offizielles Framework für die Integration eigener Sprachmodelle in Apple-Software vorgestellt. Man kann davon ausgehen, dass MLX in der Apple-Welt weiter an Bedeutung gewinnt. - Kann ich MLX auch mit anderen Tools kombinieren, z. B. Neo4j, n8n oder FileMaker?

Ja – MLX ist zwar ein reines ML-Framework, aber es lässt sich über REST-APIs, eigene Python-Services oder lokale Wrapper mit anderen Tools verbinden. So kann man es z. B. in eine eigene Automatisierung (n8n), eine semantische Datenbank (Neo4j) oder in FileMaker-Lösungen einbinden – Letzteres sogar inzwischen nativ mit FileMaker 2025

Bild (c) Monoar_CGI_Artist @ pixabay