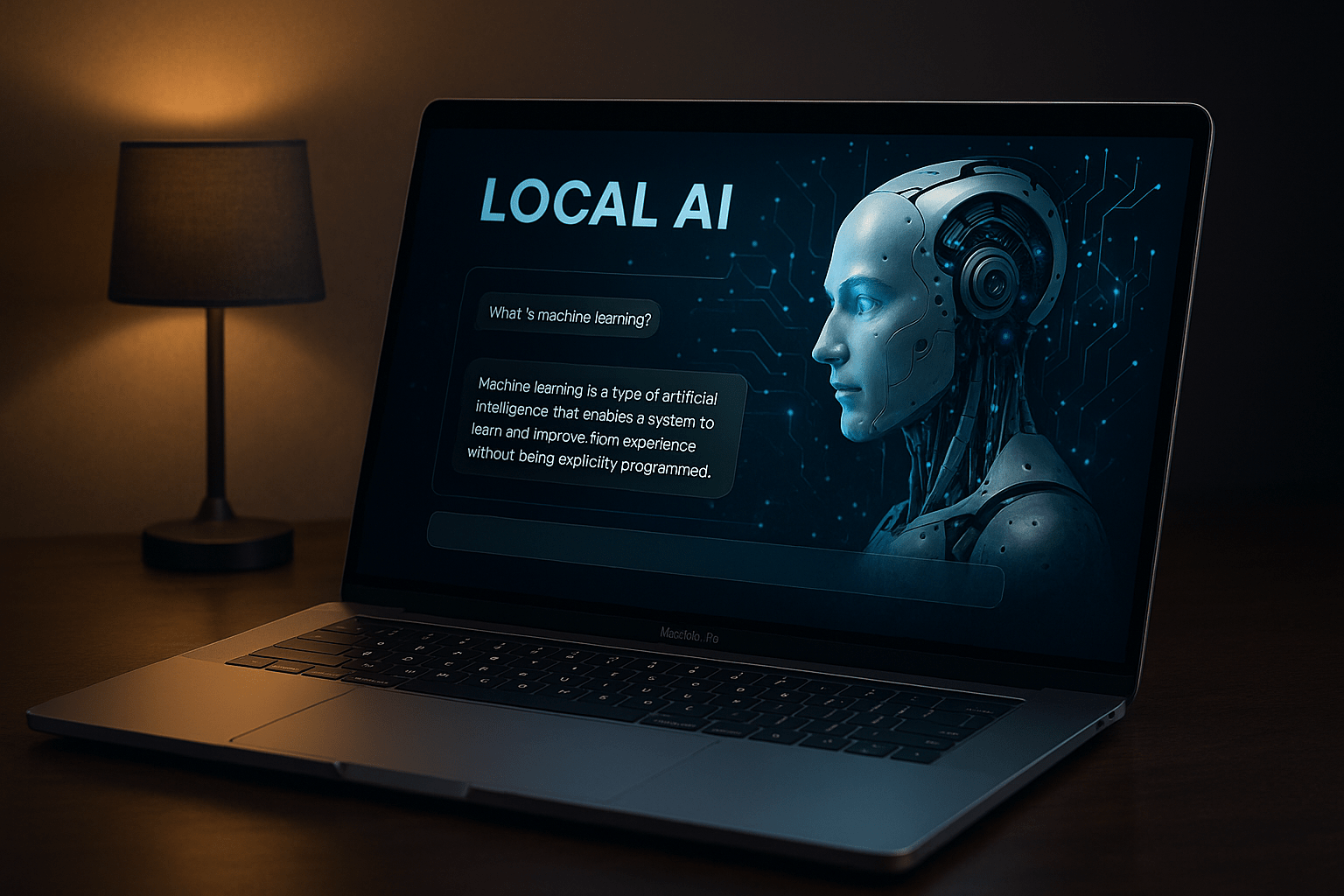

Místní umělá inteligence na Macu je již dlouho praktická - zejména na počítačích Apple-Silicon (řada M). S Ollama získáte štíhlé běhové prostředí pro mnoho otevřených jazykových modelů (např. Llama 3.1/3.2, Mistral, Gemma, Qwen). Současná verze Ollama nyní obsahuje také uživatelsky přívětivou aplikaci, která umožňuje nastavit lokální jazykový model na počítači Mac pouhým kliknutím myši. V tomto článku najdete pragmatického průvodce od instalace až po první výzvu - s praktickými radami, kde se tradičně stávají chyby.

Výhody místní umělé inteligence oproti cloudovým systémům

Model v místním jazyce, jako je Ollama na Macu, nabízí rozhodující výhody, které lze jen těžko překonat, zejména pro firmy, vývojáře a uživatele dbající na ochranu dat.

Suverenita a ochrana údajů

Všechny dotazy a odpovědi zůstávají zcela ve vašem počítači. Citlivé informace - údaje o zákaznících, interní strategické dokumenty nebo lékařské údaje - nikdy neopustí místní systém. Neexistují žádné soubory protokolů nebo mechanismy analýzy od poskytovatele cloudu, které by mohly být neúmyslně nebo úmyslně analyzovány.

Žádná závislost na službách třetích stran

Cloudové systémy mohou měnit cenové modely, zavádět omezení přístupu nebo vypínat jednotlivé funkce. Při lokální instalaci máte plnou kontrolu nad prostředím pro běh, verzemi a variantami modelů. Aktualizace provádíte, kdy chcete - ne když vám to nařídí poskytovatel.

Vyčíslitelné náklady

Namísto průběžných poplatků za každý požadavek nebo měsíc provedete jednorázovou investici do hardwaru (např. Mac s dostatečnou pamětí RAM) a pak s modelem pracujete neomezeně dlouho. Pro výpočetně náročné úlohy můžete hardware cíleně rozšiřovat, aniž byste se museli obávat rostoucích účtů za API.

Možnost připojení offline

Místní model funguje i v případech, kdy není k dispozici připojení k internetu - například na cestách, na stavbách nebo ve vysoce zabezpečených sítích bez vnějšího přístupu.

Vysoká flexibilita a integrace do stávajících systémů

Další výhodou místních systémů AI je jejich schopnost integrace. Protože Ollama poskytuje lokální server API, lze připojit téměř jakoukoli aplikaci - od jednoduchých skriptů až po složité systémy ERP.

Připojení FileMaker

Pomocí rozhraní API Ollama může FileMaker odesílat výzvy přímo do modelu a ukládat odpovědi do polí pomocí několika řádků kódu skriptu nebo pomocí volání zásuvného modulu MBS. Díky tomu lze automatizované textové analýzy, klasifikace, překlady nebo shrnutí obsahu realizovat výhradně v rámci FileMaker - bez latence cloudu a bez rizika ochrany dat.

Automatizované pracovní postupy

Místní koncový bod API také umožňuje integrovat nástroje, jako je Zapier, n8n nebo přizpůsobené skripty Python/bash. To umožňuje automatizovat složité procesy, jako je extrakce informací z e-mailů, generování sestav nebo vytváření textových modulů pro dokumenty.

Plná kontrola nad variantami modelů

Můžete spustit několik modelů paralelně, přepínat mezi nimi nebo načíst speciální modely oddělení, které jsou optimalizovány pro váš projekt. Přizpůsobení, jako je jemné doladění nebo modely LoRA, lze provádět i lokálně.

Praktická výhoda: rychlost reakce a latence

Jedním z často podceňovaných faktorů je rychlost reakce. Zatímco cloudové LLM jsou často zpožděny síťovými cestami, limity API nebo zatížením serveru, místní modely - v závislosti na hardwaru - reagují téměř v reálném čase. Zejména u opakujících se úloh nebo interaktivních procesů (např. při prezentaci nebo živé analýze dat v FileMaker) to může znamenat rozdíl mezi "hladkou prací" a "frustrovaným čekáním".

Který hardware je vhodný pro provozování místních jazykových modelů, které modely mají jaké výhody a Srovnání mezi Apple Silicon a NVIDIA jsme se věnovali v samostatném článku.

Aktuální průzkum používání místních systémů umělé inteligence

1) Předpoklady a obecné podmínky

macOS 12 "Monterey" nebo novější (doporučeno: nejnovější Sonoma/Sequoia). Oficiální stažení systému macOS vyžaduje Monterey+. ollama.com

Apple Silicon (M1-M4) přednostně. Běží také na počítačích Mac s procesory Intel, ale Apple-Silicon je mnohem efektivnější; velké modely potřebují hodně paměti RAM/jednotné paměti. (Velikost knihovny/modelu viz knihovna Ollama.) ollama.com

Port 11434 se pro rozhraní API používá lokálně. Tento port si poznamenejte - je důležitý pro pozdější testy a integrace. GitHubollama.readthedocs.io

Skeptická rada podle staré dobré tradice: "Nainstalovat a spustit" obvykle funguje - úzkým hrdlem je místo v RAM/disku (velké soubory GGUF), špatná varianta modelu nebo paralelní procesy blokující port.

2) Ollama installieren (Mac)

K dispozici máte dva čisté způsoby - instalační program GUI nebo Homebrew. Oba jsou správné; vyberte si styl, který vyhovuje vašemu každodennímu životu.

MOŽNOST A: OFICIÁLNÍ INSTALAČNÍ PROGRAM SYSTÉMU MACOS (DMG)

Stáhnout Ollama pro macOS z oficiálních stránek.

Otevřete DMG, přetáhněte aplikaci do "Programů", spusťte.

(Vyžaduje macOS 12+.) ollama.com

Pokud používáte tuto variantu 1TP12, můžete ke stažení modelu použít přímo software macOS. Všechny následující terminálové příkazy se týkají pouze možnosti automatizovat jazykový model pomocí skriptu.

VARIANTA B: HOMEBREW (CLI, ČISTÝ SKRIPTOVATELNÝ)

Otevřete terminál a (v případě potřeby) aktualizujte Homebrew:

brew update

Sud (Varianta aplikace) 1TP12Zvířata:

brew install --cask ollama-app

(Obvykle zobrazuje aktuální desktopovou aplikaci; ode dneška 0.11.x.) Homebrew Vzorce

Nebo vzorec (balíček CLI) installieren:

brew install ollama

(Binární soubory jsou k dispozici pro Apple-Silicon/Intel.) Homebrew Vzorce

Zkontrolujte verzi:

ollama --version

(Základní příkazy a varianty jsou zdokumentovány v oficiální dokumentaci a v repozitáři GitHub). GitHub

3) Spuštění a testování služby/serveru

Ollama se dodává s místním serverem. V případě potřeby jej explicitně spusťte:

ollama serve

Pokud je služba již spuštěna (např. prostřednictvím aplikace), může shell hlásit, že je používán port 11434 - pak je vše v pořádku.

Server ve výchozím nastavení naslouchá adrese http://localhost:11434.

Test funkce v prohlížeči:

Volejte http://localhost:11434/ - instance by měla reagovat (některé pokyny tuto kontrolu používají, protože port je ve výchozím nastavení aktivní). Střední

Tradiční upozornění: Pokud nic nereaguje, často se jedná o blokování starého procesu nebo bezpečnostní sady. Zkontrolujte, zda je stále spuštěn druhý terminál s ollama serve - nebo aplikaci ukončete/restartujte.

4) Načtení a použití prvního jazykového modelu

4.1 VYTÁHNĚTE MODEL NEBO JEJ SPUSŤTE PŘÍMO (RUN)

Použijte přímo (pull + run v jednom):

ollama run llama3.1

Pouze ke stažení:

ollama pull llama3.1

V oficiálním repozitáři jsou uvedeny běžné příkazy (run, pull, list, show, ps, stop, rm) a příklady s Llama 3.2, mimo jiné; stejné jsou i pro Llama 3.1, Mistral, Gemma atd. GitHubnotes.kodekloud.comglukhov.org

Další modelové stránky / knihovna:

Lama 3 / 3.1 / 3.2 v různých velikostech (1B-405B; velké verze jsou samozřejmě k dispozici ve velkém množství). Stačí zavolat Webová stránka Ollama vyhledat další modely a installiere je v Macu.

4.2 INTERAKTIVNÍ CHAT (TERMINÁL)

Spusťte například Lamu 3.1 v režimu chatu:

ollama run llama3.1

Pak zadejte přímo:

Jste užitečný asistent. Vysvětlete mi dvěma větami, co je to index v databázi.

Ukončete ji pomocí klávesové zkratky Ctrl+D.

Po spuštění aplikace Ollama na počítači Mac můžete také přímo vybrat model a zadat výzvu. Pokud model ještě není v počítači Mac k dispozici, stáhne se automaticky.

4.3 SPRÁVA MODELŮ

# Které modely jsou k dispozici na místě?

ollama list

# Zobrazit podrobnosti/kvantifikaci/značky:

ollama show llama3.1

# Zkontrolujte běžící procesy modelu:

ollama ps

# Zastavte běžící model:

ollama stop llama3.1

# Volné místo (vymazat model):

ollama rm llama3.1

(Příkazy jsou v několika aktuálních přehledech totožné. zdokumentované.) notes.kodekloud.comGeshanův blogglukhov.org

5) Používejte HTTP API lokálně (např. pro skripty, nástroje, integrace).

Ollama nabízí rozhraní REST API (ve výchozím nastavení http://localhost:11434). Příklady volání:

Generovat (jednoduchá výzva):

curl http://localhost:11434/api/generate -d '{

"model": "llama3.1",

"prompt": "Erkläre kurz den Unterschied zwischen RAM und SSD.",

"stream": false

}'

Chat (na základě rolí):

curl http://localhost:11434/api/chat -d '{

"model": "llama3.1",

"messages": [

{ "role": "system", "content": "Du antwortest knapp und sachlich." },

{ "role": "user", "content": "Was ist eine Normalisierung in Datenbanken?" }

],

"stream": false

}'

(Koncové body, chování datových toků a pole jsou popsány v oficiálním dokumentu Dokumentace API/GitHub popsáno).

Nápověda k dosažitelnosti:

Lokálně je vše přístupné přes localhost.

Pokud má být Mac přístupný v síti LAN, záměrně přiřaďte Ollama síťovou adresu, např:

export OLLAMA_HOST=0.0.0.0 ollama serve

(K serveru lze pak přistupovat prostřednictvím IP v síti. Zkontrolujte bezpečnostní aspekt!) Reddit

Mixed-Content/HTTPS (pouze pokud integrace prohlížeče nefunguje):

Některé doplňky/prohlížeče (zejména Safari) blokují volání HTTP z kontextů HTTPS. V takových případech pomáhá místní reverzní proxy server s protokolem HTTPS.

6) Praktické tipy pro Mac (zkušenosti a konzervativní péče)

- Začněte konzervativně s výběrem modeluZačněte s menšími kvantifikacemi (např. 4bitové varianty), zkontrolujte kvalitu a pak pomalu zvyšujte klíčování.

- Hlídejte paměť a disk: Velké modely zabírají několik GB - ollama show pomáhá s kategorizací. notes.kodekloud.com

- Apple-Silicon a kovyOllama používá v Macu akceleraci Apple (Metal). U nejnovějších sestavení modelu se mohou vyskytnout chyby ovladačů/Metal - udržujte Ollama aktuální a sledujte známé problémy. GitHub

- Konflikty v přístavechPokud si ollama serve stěžuje, aplikace nebo jiný proces již naslouchá na čísle 11434 - buď aplikaci zavřete, nebo zastavte server CLI. postman.com

7) Časté minimální pracovní postupy (kopírování a vkládání)

A) Newinstallation & první chat (Llama 3.1)

# Installation (eine Variante wählen) brew install --cask ollama-app # oder brew install ollama# Server starten (falls App nicht läuft) ollama serve # Erstes Modell testen ollama run llama3.1

("run" načte model, pokud ještě neexistuje.) Homebrew Formulae+1GitHub

B) Připravte model offline (nejprve vytáhněte, použijte později)

ollama pull mistral ollama show mistral ollama run mistral

("mistral" je běžný, kompaktní model - vhodný pro počáteční testy).

C) Integrace rozhraní API do skriptu/nástroje

curl http://localhost:11434/api/generate -d '{

"model": "llama3.1",

"výzva": "Uveďte mi tři konzervativní důvody pro upřednostnění dokumentace před automatizací."

}‘

(Příklady API jsou 1:1 oficiální odkaz převzato z)

8) Kde najdu modely?

Knihovna Ollama obsahuje kurátorské modely s tagy/velikostmi (Llama 3.1/3.2, Gemma, Qwen atd.). Vybírejte záměrně podle účelu (chat, nástroje, embeddings) a velikosti. Nové modely můžete vytvářet přímo v aplikaci Ollama na Macu nebo na Webová stránka Ollama najít.

9) Co dělat, když se něco nepovede?

- seznam ollama / ollama ps zkontrolovat: Je požadovaný model k dispozici/aktivní?

- ollama show Pohled: Jaká kvantifikace/velikost byla načtena? Odpovídá to operační paměti Macu? notes.kodekloud.com

Aktualizace:

brew upgrade ollama ollama-app

Zobrazit problémy: Občas se vyskytují chyby v kovu, zejména u zcela nových modelů/funkcí; často pomůže aktualizace nebo změna varianty modelu.

10) Alternativy s komfortem Mac (GUI)

Pokud dáváte přednost grafickému rozhraní s více možnostmi nebo chcete procházet/měnit modely:

LM Studio - oblíbený frontend pro Mac s integrovaným downloaderem, uživatelským rozhraním chatu a místním serverem API. Odkaz na stránku ke stažení a poznámky k vydání. LM Studio+1Uptodown

(Existují také uživatelská rozhraní třetích stran, například Open WebUI, která lze připojit k Ollama - ale pro většinu nastavení Macu stačí Ollama + Terminál nebo LM Studio).

Pomocí Ollama můžete na Macu nastavit místní prostředí LLM během několika minut - klasickým, srozumitelným způsobem a bez závislosti na cloudu. Postupujte podle osvědčených kroků (Installer/Brew → ollama serve → ollama run), zkontrolujte zdroje a postupujte od malého k velkému. Pokud dáváte přednost klikání před psaním, je LM Studio solidní alternativou na Macu. ollama.comGitHubLM Studio

Hodně štěstí - a zůstaňte kritičtí k systému: nejprve řádně dokumentujte, pak automatizujte.

Nová série článků: Použití exportu dat ChatGPT jako osobní paměti umělé inteligence

Pokud již máte místní UI s Ollama na Macu installiert, můžete udělat další krok: vytvořit si vlastní znalostní systém. V nové sérii článků vám ukážu, jak se Použití exportu dat ChatGPT vytvořit osobní databázi znalostí. Místo toho, aby konverzace mizely v historii chatu, lze je exportovat, strukturovaně zpracovat a integrovat do vektorové databáze. Vzniká tak umělá inteligence, která má přístup k vašim vlastním myšlenkám, nápadům a analýzám. Seriál vás krok za krokem provede celým procesem - od exportu dat až po vložení a integraci do systému RAG. Jednoduché historie chatů se tak postupně stanou digitální pamětí pro vaši vlastní UI.

Pokud již máte místní UI s Ollama na Macu installiert, můžete udělat další krok: vytvořit si vlastní znalostní systém. V nové sérii článků vám ukážu, jak se Použití exportu dat ChatGPT vytvořit osobní databázi znalostí. Místo toho, aby konverzace mizely v historii chatu, lze je exportovat, strukturovaně zpracovat a integrovat do vektorové databáze. Vzniká tak umělá inteligence, která má přístup k vašim vlastním myšlenkám, nápadům a analýzám. Seriál vás krok za krokem provede celým procesem - od exportu dat až po vložení a integraci do systému RAG. Jednoduché historie chatů se tak postupně stanou digitální pamětí pro vaši vlastní UI.

Často kladené otázky

- Co vlastně znamená „lokální umělá inteligence“ a proč bych měl na svém Macu spouštět jazykový model?

Místní umělá inteligence znamená, že jazykový model běží výhradně na vašem počítači, nikoli na externích serverech prostřednictvím internetového připojení. Model je provozován lokálně 1TP12 a zpracovává vaše vstupy přímo ve vašem zařízení. Hlavními výhodami jsou ochrana dat, kontrola a nezávislost: vaše data neopouštějí váš počítač, nevznikají žádné náklady na API a nejste závislí na poskytovatelích cloudových služeb. Zároveň si můžete systém přizpůsobit vlastním potřebám, integrovat vlastní data nebo dokonce vyvíjet vlastní pracovní postupy. Pro mnoho uživatelů - například vývojáře, autory nebo firmy s citlivými daty - je proto lokální UI mimořádně zajímavou alternativou ke cloudovým službám. - Jaké výhody nabízí Ollama ve srovnání s jinými nástroji pro lokální jazykové modely?

Ollama se rychle stal jedním z nejoblíbenějších nástrojů pro místní umělou inteligenci, protože výrazně zjednodušuje mnoho složitých kroků. Místo ručního stahování, konfigurace a spouštění modelů přebírá Ollama tyto úkoly z velké části automaticky. Jazykový model lze obvykle vytvořit a spustit jediným příkazem install. Ollama také nabízí rozhraní REST API, takže modely lze snadno integrovat do vlastních programů - například skriptů, databází nebo aplikací. Díky tomu je Ollama vhodný jak pro začátečníky, kteří si chtějí model rychle vyzkoušet, tak pro vývojáře, kteří chtějí integrovat místní umělou inteligenci do svých vlastních softwarových projektů. - Jaké požadavky musí můj Mac splňovat, aby bylo možné lokálně spustit jazykový model?

Pro dosažení dobrých výsledků doporučujeme Mac s procesorem Apple-Silicon (M1, M2, M3 nebo novějším). Tyto čipy mají architekturu, která je obzvláště vhodná pro výpočty umělé inteligence, například díky sdíleným paměťovým strukturám a akceleraci GPU. Důležitá je také dostatečná paměť a dostatek volného místa v úložišti, protože jazykové modely mohou mít velikost několika gigabajtů. Menší modely již fungují na zařízeních se střední pamětí, zatímco větší modely vyžadují podstatně více paměti RAM. Užitečná je také aktuální verze systému macOS, protože mnoho nástrojů umělé inteligence je optimalizováno pro moderní systémové knihovny. - Které jazykové modely mohu používat s Ollama v počítači Mac?

Ollama podporuje řadu moderních otevřených jazykových modelů. Patří mezi ně například varianty Llama, Mistral, Gemma nebo Qwen. Tyto modely se liší velikostí, výkonem a stylem. Některé jsou poměrně kompaktní a rychle běží na menších počítačích, jiné jsou větší a poskytují složitější odpovědi. Velkou výhodou je, že si můžete různé modely poměrně snadno vyzkoušet a porovnat, aniž byste museli přestavovat infrastrukturu. Vzniká tak flexibilní prostředí, ve kterém si můžete vybrat model, který nejlépe vyhovuje vašim úkolům. - Jak složitá je instalace modelu v místním jazyce s Ollama?

Instalace je nyní mnohem jednodušší než před několika lety. V mnoha případech se proces skládá pouze z několika kroků: Nejprve installier Ollama na počítači Mac, poté stáhněte jazykový model a spusťte jej prostřednictvím terminálu nebo grafického uživatelského rozhraní. Model se připraví automaticky a pak jej lze přímo používat. Mnoho uživatelů je překvapeno, jak rychle tento proces funguje. I bez hlubších technických znalostí je možné během několika minut nastavit funkční lokální systém UI. - Proč místní umělá inteligence funguje na počítačích Mac Apple-Silicon obzvlášť dobře?

Procesory Apple-Silicon byly vyvinuty s ohledem na moderní výpočetní úlohy, včetně strojového učení. Využívají takzvanou sjednocenou paměťovou architekturu, v níž CPU, GPU a další výpočetní jednotky používají stejnou paměť. To umožňuje efektivnější zpracování velkého množství dat. To je pro modely umělé inteligence velkou výhodou, protože jazykové modely musí při odvozování neustále přistupovat k velkým datovým strukturám. Nástroje jako Ollama nebo MLX tuto architekturu cíleně využívají a díky tomu dosahují překvapivě dobrého výkonu - a to i bez specializované grafické karty. - Jak rychle funguje místní jazykový model na Macu?

Rychlost závisí především na třech faktorech: na použitém modelu, paměti RAM počítače Mac a výkonu procesoru. Menší modely často reagují téměř v reálném čase, zatímco větší modely mohou pracovat pomaleji. Macy Apple-Silicon jsou však překvapivě výkonné a bez problémů na nich lze provozovat mnoho populárních modelů. Pro experimentální projekty nebo osobní pracovní procesy je výkon obvykle více než dostatečný. Pokud potřebujete obzvlášť rychlé reakce, můžete použít menší nebo komprimovanější modely. - Mohu s místní umělou inteligencí pracovat i offline?

Ano, to je jedna z největších výhod. Po stažení modelu již nevyžaduje připojení k internetu. Všechny výpočty probíhají přímo v počítači Mac. To znamená, že UI můžete používat i na cestách, bez připojení k síti nebo v izolovaném prostředí. Pro mnoho profesionálních aplikací - jako jsou citlivé dokumenty nebo interní analýzy - je tato možnost práce offline rozhodující výhodou. - Jak bezpečná jsou moje data, pokud používám jazykový model lokálně?

Pokud model běží zcela lokálně, data zůstávají vždy v počítači. Nedochází k automatickému přenosu na externí servery. To znamená, že můžete pracovat s důvěrnými texty, aniž byste se museli obávat cloudového úložiště nebo neoprávněného přístupu. Zabezpečení samozřejmě stále závisí na tom, jak je váš systém nakonfigurován - například zda mají k vašim datům přístup jiné programy. V zásadě však lokální UI nabízí výrazně větší kontrolu nad vlastními informacemi. - Mohu místní jazykový model trénovat nebo rozšířit pomocí vlastních dat?

Ano, je to možné, ale obvykle ne přímo prostřednictvím základního systému. Mnoho uživatelů kombinuje místní jazykové modely s takzvanými systémy RAG nebo databázemi, aby mohli integrovat vlastní obsah. To zahrnuje analýzu dokumentů nebo textů a jejich uložení do vektorové databáze. Jazykový model může později k tomuto obsahu přistupovat a začleňovat jej do svých odpovědí. Tímto způsobem se může umělá inteligence specializovat na své vlastní znalosti, aniž by musela model sama zcela přeškolit. - Jaký je rozdíl mezi jazykovým modelem a aplikací AI, jako je ChatGPT?

Jazykový model je v podstatě jen „motor“ umělé inteligence - neuronová síť, která analyzuje a generuje texty. Služby, jako je ChatGPT, jsou naproti tomu kompletní platformy, které kombinují model s uživatelským rozhraním, cloudovou infrastrukturou a dalšími funkcemi. Pokud používáte jazykový model lokálně installier, pracujete přímo s tímto základním systémem. To vám dává větší kontrolu, ale také se musíte sami rozhodnout, které další nástroje nebo rozhraní chcete používat. - Kolik místa v úložišti vyžaduje místní jazykový model v Macu?

Velikost jazykového modelu se může značně lišit. Malé modely vyžadují jen několik gigabajtů paměti, zatímco větší varianty mohou zabírat podstatně více místa. Paměť RAM je také zapotřebí k načtení modelu během provádění. Pro mnoho praktických aplikací však postačí kompaktní modely, které využívají relativně málo paměti a přesto jsou překvapivě výkonné. - Mohu na Macu 1TP12 spustit několik modelů současně?

Ano, to je vlastně velká výhoda místních prostředí s umělou inteligencí. Můžete si stáhnout několik modelů a spouštět je podle potřeby. Některé jsou vhodnější pro kreativní texty, jiné pro technické analýzy nebo programový kód. Tato flexibilita vám umožňuje používat prostředí AI jako sadu nástrojů a vybrat si model, který nejlépe vyhovuje danému úkolu. - Lze Ollama integrovat i do vašich vlastních programů?

Ano, Ollama nabízí rozhraní pro programování aplikací (API), které mohou jiné aplikace používat pro přístup k jazykovému modelu. To umožňuje integrovat místní umělou inteligenci do vlastních projektů - například do skriptů, automatizací nebo databázových systémů. Vývojáři tuto možnost často využívají k vytváření vlastních asistentů AI nebo k přidávání inteligentních funkcí do stávajícího softwaru. - Je místní jazykový model stejně výkonný jako velké cloudové modely?

V mnoha případech ne tak docela - přinejmenším při porovnávání velmi rozsáhlých modelů s miliardami parametrů. Poskytovatelé cloudových služeb provozují extrémně výkonný hardware, a proto mohou provozovat velmi rozsáhlé modely. Místní modely jsou často kompaktnější, takže je lze spustit na běžném počítači. Přesto jsou pro mnoho praktických úloh úžasně výkonné a mohou psát, analyzovat nebo strukturovat texty. Tento výkon je pro mnoho pracovních procesů zcela dostačující. - Proč se stále více lidí zajímá o místní UI namísto cloudových služeb?

Jedním z důležitých důvodů je kontrola dat a infrastruktury. Mnoho uživatelů nechce trvale přenášet svůj obsah do externích služeb. Místní systémy mohou být také dlouhodobě levnější, protože odpadají průběžné náklady na API. Pro vývojáře a technicky zdatné uživatele existuje další výhoda: mohou si sami navrhovat a experimentovat se svým prostředím UI. Vzniká tak nová forma technické suverenity. - Mohu později kombinovat místní UI s jinými systémy?

Ve skutečnosti je to jedna z nejzajímavějších možností. Místní jazykové modely lze propojit s databázemi, automatizačními platformami nebo vlastními programy. Výsledkem mohou být komplexní pracovní postupy - například systémy, které analyzují dokumenty, shrnují obsah nebo získávají znalosti z vlastních databází. Takové kombinace často tvoří základ pro asistenty umělé inteligence na míru nebo automatizované analytické nástroje. - Pro koho je místní UI v Macu obzvlášť užitečná?

Zajímavá je zejména pro vývojáře, autory, analytiky a firmy, které pravidelně pracují s texty nebo daty. Místní AI je také zajímavou možností pro technicky zdatné uživatele, kteří chtějí sami ovládat svou digitální infrastrukturu. Umožňuje využívat moderní technologie AI, aniž by byli závislí na velkých platformách. Zejména na výkonných počítačích Mac tak vzniká prostředí, které může být překvapivě všestranné a produktivní.