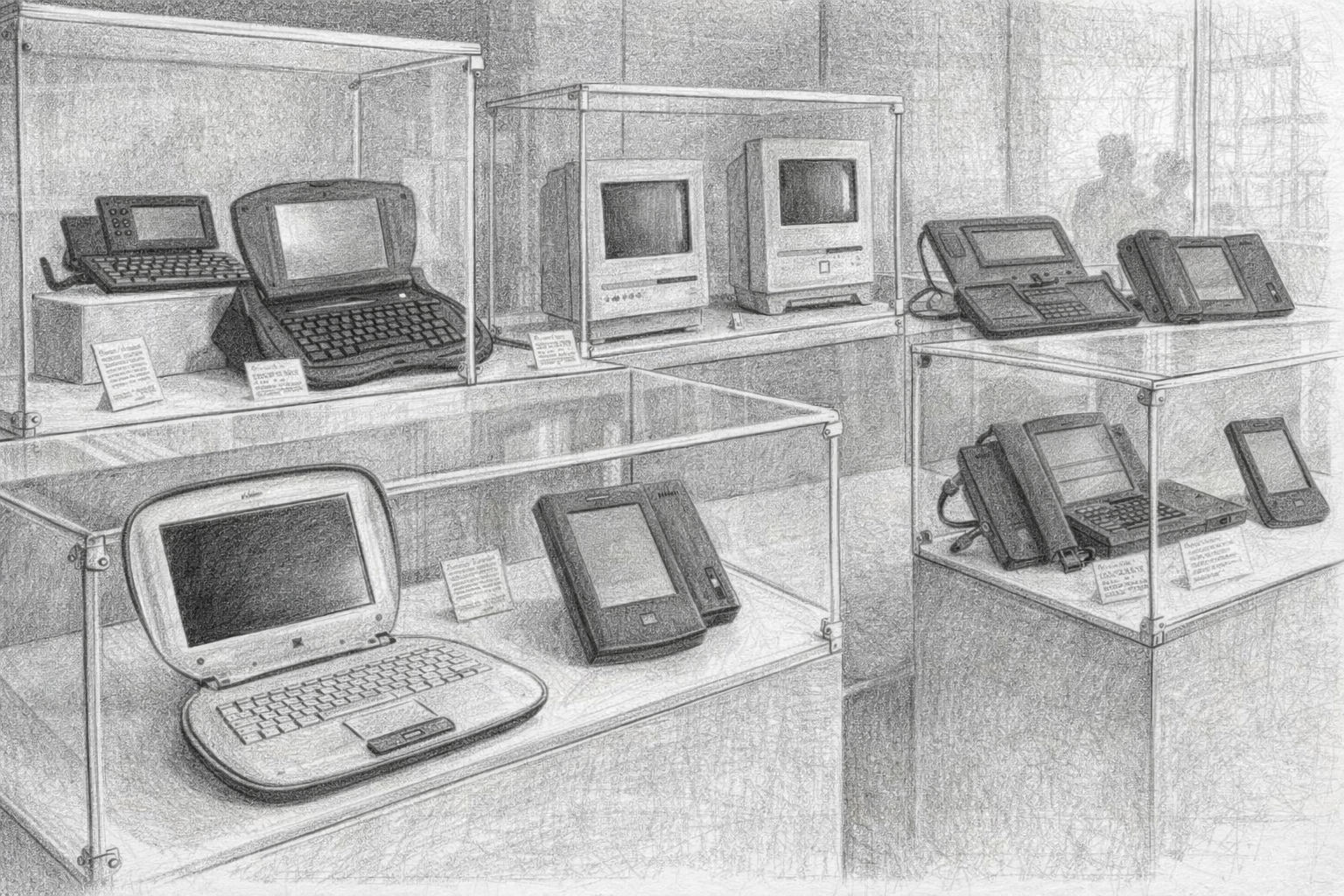

Jeśli interesujesz się historią komputerów, wizyta w Muzeum Komputerów w Oldenburgu jest szczególnie warta uwagi. Muzeum jest jednym z tych miejsc, które nie muszą być głośne, aby zrobić wrażenie, a od kwietnia będzie gościć specjalną wystawę pod hasłem „50 lat komputera Apple“. Od wielu lat technologia jest tam nie tylko wystawiana, ale także utrzymywana przy życiu. Urządzenia nie znajdują się za szkłem, ale często są gotowe do użycia na stołach - tak jak były używane w przeszłości.

To właśnie robi różnicę. Na wystawie można nie tylko zobaczyć stare komputery, ale także poczuć, jak to było pracować, bawić się i myśleć za pomocą tych maszyn. Od wczesnych komputerów domowych po klasyczne komputery biurowe i specjalne jednorazowe, wszystko jest reprezentowane - starannie zebrane, utrzymane, a przede wszystkim jasno skategoryzowane.