Wer sich heute mit dem Thema künstliche Intelligenz beschäftigt, stößt fast zwangsläufig auf ein merkwürdiges Gefühl: ständige Unruhe. Kaum hat man sich an ein Werkzeug gewöhnt, tauchen schon die nächsten zehn auf. Auf YouTube jagt ein Video das nächste: „Dieses KI-Tool verändert alles“, „Das musst du jetzt unbedingt nutzen“, „Wer das verpasst, bleibt zurück“. Und jedes Mal schwingt unterschwellig dieselbe Botschaft mit: Du bist zu spät. Die anderen sind weiter. Du musst aufholen.

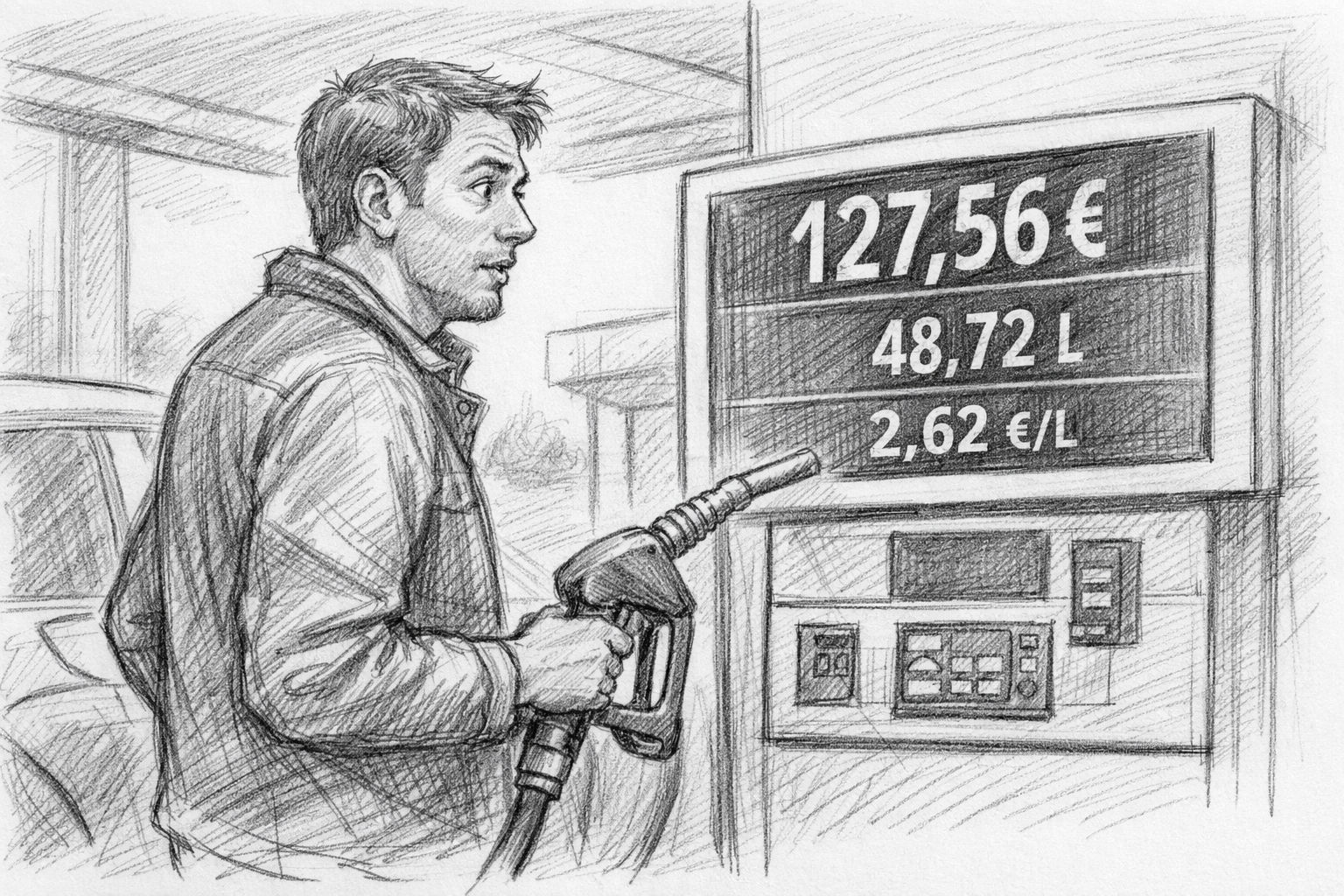

Das betrifft längst nicht nur IT-Leute. Auch Selbstständige, Kreative, Unternehmer oder ganz normale Angestellte spüren diesen Druck. Viele wissen gar nicht genau, was diese Tools eigentlich machen – aber sie haben das Gefühl, dass sie etwas verpassen könnten. Und genau das erzeugt Stress.