Chiunque lavori con l'IA oggi è quasi automaticamente spinto nel cloud: OpenAI, Microsoft, Google, qualsiasi interfaccia web, token, limiti, termini e condizioni. Questo sembra moderno, ma è essenzialmente un ritorno alla dipendenza: altri determinano quali modelli si possono usare, con quale frequenza, con quali filtri e a quale costo. Io sto deliberatamente andando nella direzione opposta: attualmente sto costruendo il mio piccolo studio di IA a casa. Con il mio hardware, i miei modelli e i miei flussi di lavoro.

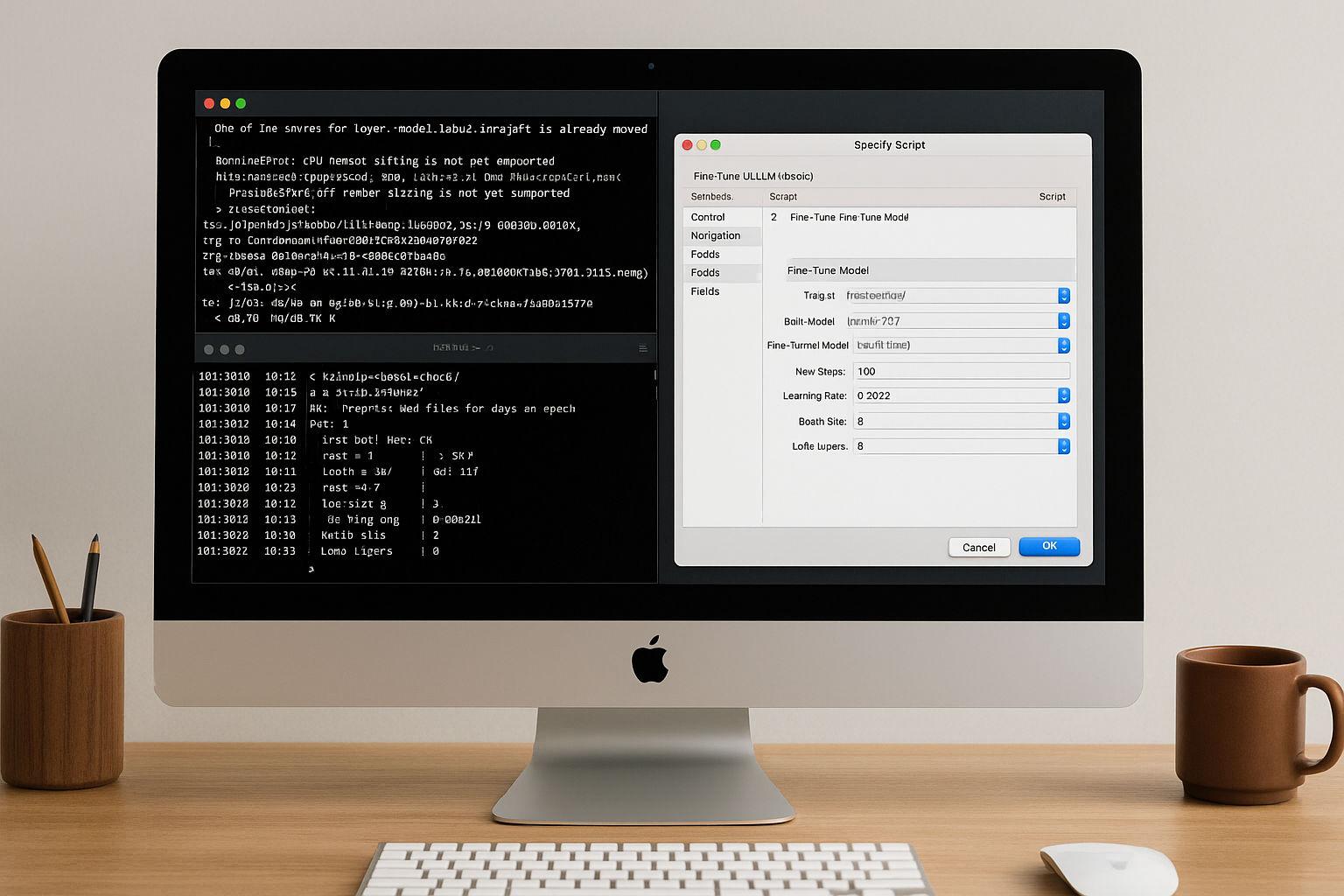

Il mio obiettivo è chiaro: IA locale per i testi, IA locale per le immagini, apprendimento dei miei modelli (LoRA, fine-tuning) e tutto questo in modo tale che io, come libero professionista e in seguito anche cliente di una PMI, non dipenda dai capricci quotidiani di qualche fornitore di cloud. Si potrebbe dire che è un ritorno a un vecchio atteggiamento che una volta era abbastanza normale: „Le cose importanti le fai da solo“. Solo che questa volta non si tratta del proprio banco di lavoro, ma della potenza di calcolo e della sovranità dei dati.