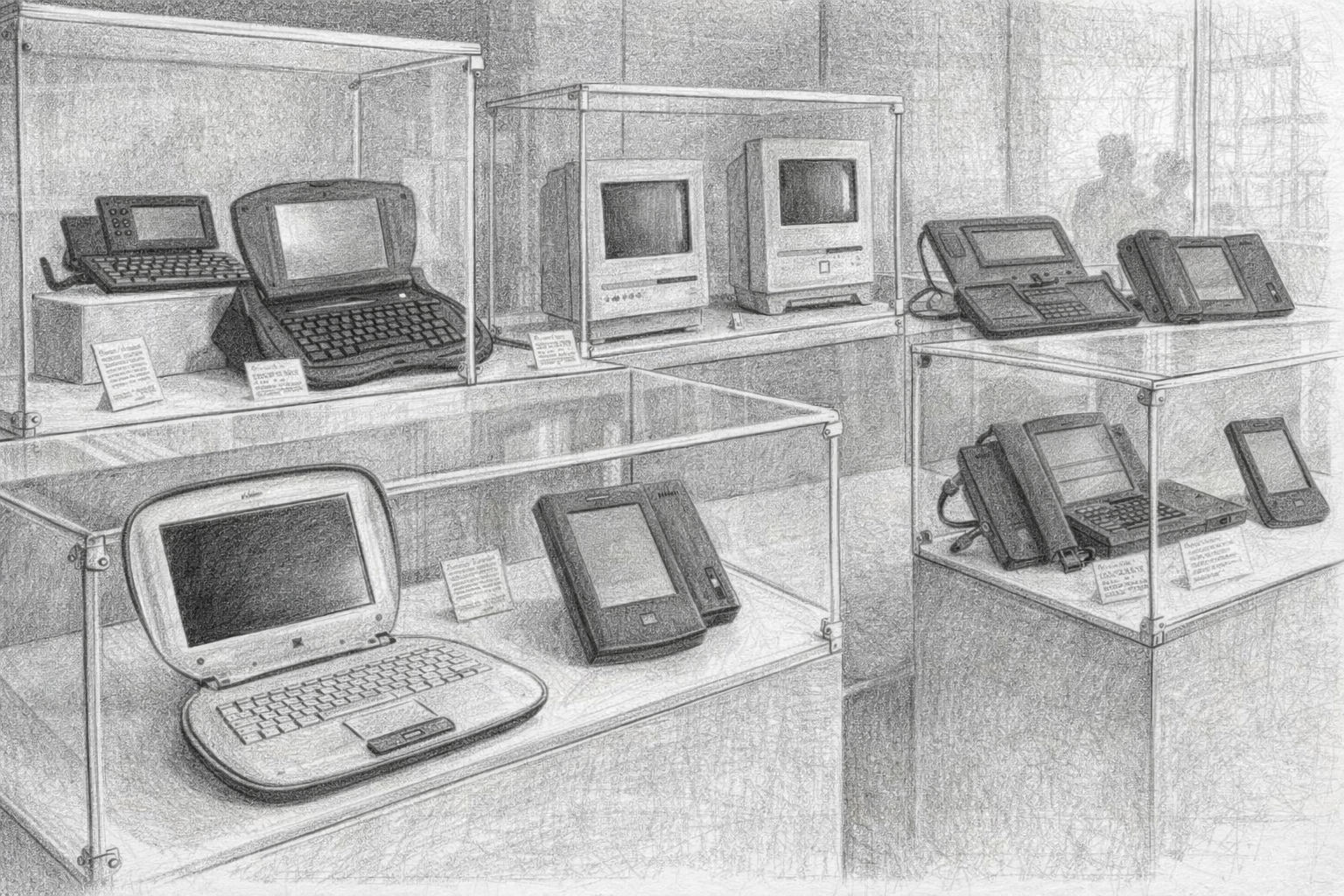

Wenn Du Dich für Computergeschichte interessierst, lohnt sich ein Blick ins Oldenburger Computer-Museum ganz besonders. Das Museum gehört zu den Orten, die nicht laut auftreten müssen, um Eindruck zu hinterlassen und bietet ab April eine Sonderausstellung unter dem Motto „50 Jahre Apple Computer“. Seit vielen Jahren wird dort Technik nicht nur ausgestellt, sondern lebendig gehalten. Geräte stehen nicht hinter Glas, sondern oft betriebsbereit auf Tischen – so, wie sie früher tatsächlich genutzt wurden.

Gerade das macht den Unterschied. Du siehst dort nicht einfach alte Computer, sondern Du bekommst ein Gefühl dafür, wie sich Arbeiten, Spielen und Denken mit diesen Maschinen angefühlt hat. Von frühen Heimcomputern über klassische Bürorechner bis hin zu besonderen Einzelstücken ist alles vertreten – sorgfältig gesammelt, gepflegt und vor allem verständlich eingeordnet.