Mentre MLX è stato originariamente lanciato come framework sperimentale da Apple Research, negli ultimi mesi si è verificato uno sviluppo silenzioso ma significativo: Con il rilascio di FileMaker 2025, Claris ha integrato stabilmente MLX nel server come infrastruttura AI nativa per Apple Silicon. Ciò significa che chiunque lavori con un Mac e utilizzi Apple Silicon può non solo eseguire i modelli MLX localmente, ma anche utilizzarli direttamente in FileMaker - con funzioni native, senza alcun livello intermedio.

Die Grenzen zwischen lokalem MLX-Experiment und professioneller FileMaker-Anwendung beginnen zu verschwimmen – zugunsten eines vollständig integrierten, nachvollziehbaren und kontrollierbaren KI-Workflows.

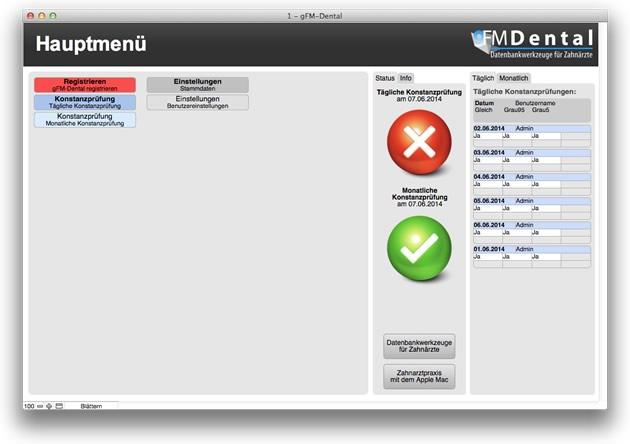

La nuova area AI nel server FileMaker: "Servizi AI".

Il fulcro di questa nuova architettura è l'area "Servizi AI" nella console di amministrazione di FileMaker Server 2025, dove gli sviluppatori e gli amministratori possono:

- attivare l'AI Model Server,

- Gestire i modelli (scaricare, fornire, mettere a punto),

- Assegnare chiavi API per i clienti autorizzati,

- e monitorare le operazioni di IA in corso in modo mirato.

Läuft der FileMaker Server auf einem Mac mit Apple Silicon, so verwendet der integrierte AI Model Server automatisch MLX als Inferenz-Backend. Das bringt alle Vorteile mit sich, die MLX auf Apple-Geräten bietet: hohe Speichereffizienz, native GPU-Nutzung über Metal, und eine klare Trennung von Modell und Infrastruktur – ganz im Stil der Apple-Welt.

Fornitura dei modelli MLX direttamente tramite la console del server

La distribuzione di un modello MLX è più semplice del previsto: Nella console di amministrazione dell'AI, i modelli supportati possono essere selezionati direttamente da un elenco crescente di modelli linguistici compatibili con Claris e distribuiti sul server installier. Si tratta di modelli open source (ad esempio varianti di Mistral, LLaMA o Phi) disponibili in formato .npz e appositamente convertiti per MLX. Al momento (da settembre 2025), tuttavia, il numero di modelli disponibili è ancora piuttosto limitato.

Alternativ lassen sich eigene Modelle vorbereiten – zum Beispiel durch Konvertierung von Hugging-Face-Modellen mit dem Tool mlx-lm. Mit einem einzigen Befehl kann man ein Modell herunterladen, quantisieren und in das passende Format bringen. Dieses kann dann im Serververzeichnis bereitgestellt werden – nach dem gleichen Schema, das auch Claris intern verwendet. Einmal installiert, stehen diese Modelle sofort für alle unterstützten KI-Funktionen innerhalb von FileMaker bereit.

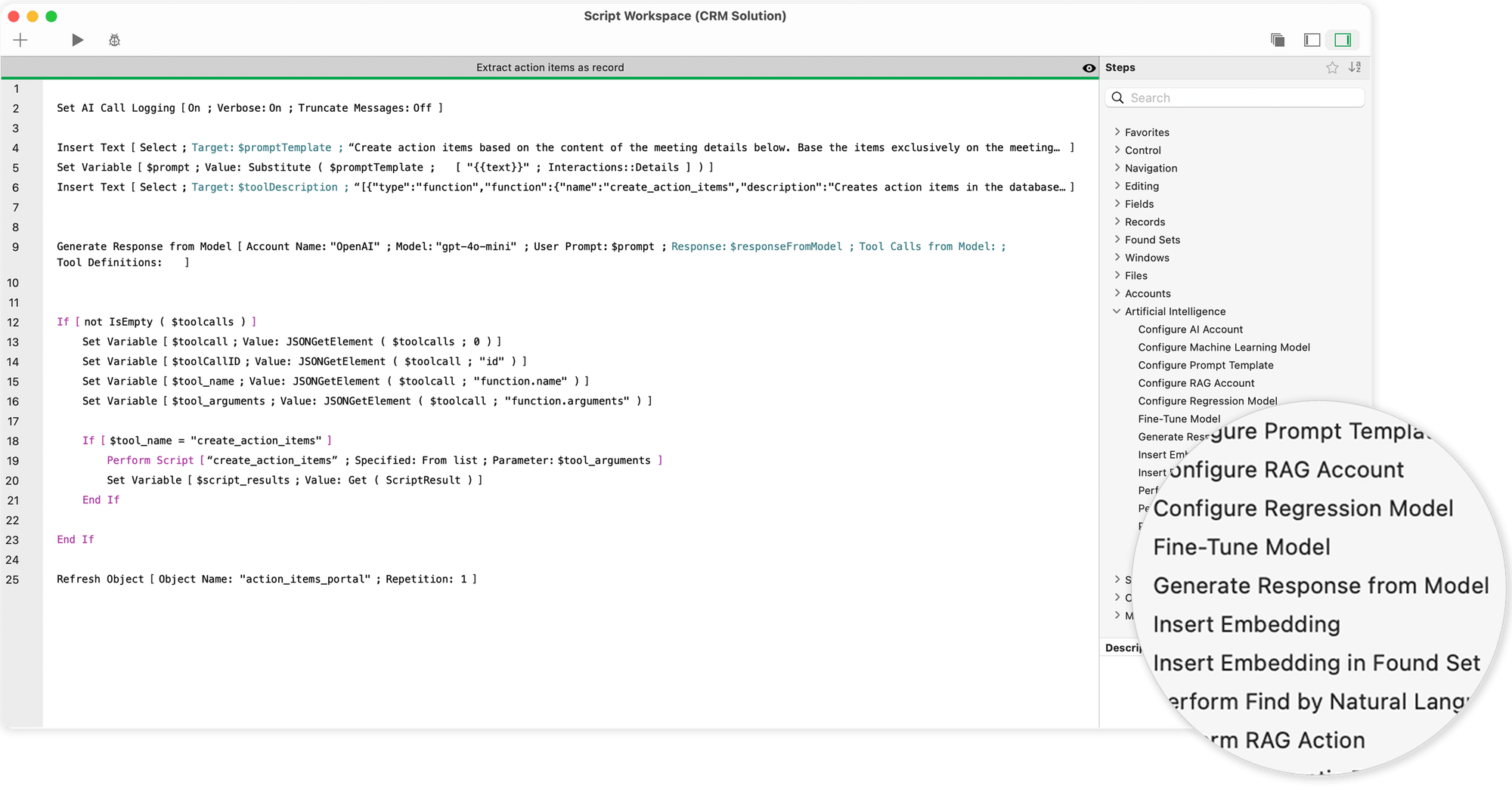

Funzioni AI native in FileMaker Pro: scripting al posto delle deviazioni

Was früher über externe APIs, REST-Aufrufe und manuell gebaute JSON-Routinen lief, ist heute in FileMaker 2025 in Form von dedizierten Scriptbefehlen verfügbar. Sobald ein AI Account eingerichtet ist – mit dem Namen des Modells und der Verbindung zum Server – lassen sich KI-Aufgaben nahtlos in die Benutzeroberfläche und Geschäftslogik integrieren.

I comandi più importanti sono

- "Generare una risposta dal modello", mit dem sich Textantworten erzeugen lassen – etwa für automatische Textvorschläge, Chatfunktionen oder E-Mail-Entwürfe.

- "Eseguire ricerche in linguaggio naturale"che traduce una semplice formulazione ("Mostrami tutti i clienti di Berlino con fatture in sospeso") in una precisa interrogazione del database.

- "Eseguire una query SQL in linguaggio naturale", mit dem auch komplexe SQL-Strukturen generiert und verarbeitet werden können – inklusive Joins und Subqueries.

- "Incorporare" und verwandte Funktionen, die semantische Vektoranalysen ermöglichen – etwa zur Suche nach inhaltlich ähnlichen Texten oder Kundenanfragen.

All diese Befehle greifen im Hintergrund auf das aktuell ausgewählte MLX-Modell zurück, das auf dem AI Model Server läuft. Die Antworten sind sofort verfügbar und lassen sich direkt weiterverarbeiten – als Text, JSON oder eingebetteter Vektor.

Fasi di script e possibilità per l'IA in FileMaker

Scriptschritte für künstliche Intelligenz ermöglichen die direkte Integration leistungsfähiger KI-Modelle – wie etwa Large Language Models (LLMs) oder Core ML – in FileMaker-Workflows. Sie schaffen die technische Grundlage, um natürliche Sprache, Datenbankwissen und maschinelles Lernen miteinander zu verbinden. Die folgenden Funktionen stehen zur Verfügung:

- Configurazione di un account AI denominato

È possibile impostare e denominare un account AI specifico, che verrà poi utilizzato in tutte le fasi e le funzioni di script successive. Ciò consente di mantenere il controllo sull'autenticazione e sull'accesso a modelli o servizi esterni. - Recupero di una risposta testuale basata su un prompt

Un modello di intelligenza artificiale può reagire a una richiesta inserita dall'utente e generare una risposta testuale corrispondente. Ciò consente la generazione automatica di testi, suggerimenti o funzioni di dialogo. - Interrogazione del database basata su una richiesta e sullo schema del database

Passando una richiesta in linguaggio naturale insieme allo schema strutturale del database, il modello può identificare i contenuti rilevanti e restituire un risultato mirato. - Generare query SQL

Il modello può anche generare query SQL basate su un prompt e sullo schema del database sottostante. Ciò consente di generare automaticamente query complesse, che possono essere utilizzate per le operazioni sul database. - FileMaker query di ricerca basate sui campi di layout

Passando al modello i campi del layout corrente insieme a una richiesta in linguaggio naturale, è possibile formulare automaticamente le query di ricerca e recuperare i set di risultati adeguati. - Inserire i vettori di incorporamento nei record di dati

Sie haben die Möglichkeit, semantische Einbettungen (Embeddings) – also numerische Vektoren, die Bedeutungen repräsentieren – in Felder einzelner Datensätze oder ganzer Ergebnismengen einzufügen. Dies bildet die Grundlage für spätere semantische Vergleiche oder KI-Analysen. - Eseguire una ricerca semantica

Basierend auf der Bedeutung einer Suchanfrage kann das System Datensätze identifizieren, deren Felddaten ähnliche Bedeutungen aufweisen – selbst wenn die Wörter nicht exakt übereinstimmen. Dies eröffnet neue Wege der intelligenten Datensuche. - Impostare i modelli di prompt

È possibile definire modelli di prompt riutilizzabili che possono essere utilizzati in altre fasi o funzioni di script. In questo modo si garantisce la coerenza e si risparmia tempo nella creazione di prompt strutturati. - Configurare il modello di regressione

Per compiti quali previsioni, stime o analisi delle tendenze, è possibile impostare un modello di regressione che opera su serie di dati numerici. È adatto, ad esempio, per analizzare l'andamento delle vendite o la valutazione dei rischi. - Configurare e gestire l'account RAG

È possibile impostare un account RAG (Retrieval Augmented Generation) con nome. Ciò consente di aggiungere o rimuovere dati e di inviare richieste specifiche a uno spazio RAG. I sistemi RAG combinano ricerche classiche con risposte generate dall'intelligenza artificiale. - Messa a punto di un modello con i dati di addestramento

È possibile riqualificare un modello esistente con il proprio set di dati per personalizzarlo meglio in base a requisiti specifici, stili linguistici o aree di attività. La messa a punto aumenta la pertinenza e la qualità del risultato. - Registro delle chiamate AI

È possibile attivare la registrazione di tutte le chiamate AI per il monitoraggio e l'analisi. Ciò è utile per ottimizzare le richieste, la risoluzione dei problemi o la documentazione. - Configurare i modelli Core ML

Oltre agli LLM basati su cloud, è possibile configurare anche modelli Core ML eseguiti localmente. Ciò è particolarmente utile per le applicazioni offline o per l'uso su dispositivi Apple con supporto ML integrato.

Sondaggio in corso sul futuro di Claris FileMaker e AI

Messa a punto direttamente dall'FileMaker: LoRA come nuovo standard

Eine der spannendsten Neuerungen ist die Möglichkeit, eigene Modelle direkt in FileMaker zu feintunen – und zwar vollständig innerhalb der gewohnten Oberfläche. Dazu genügt ein Scriptbefehl: „Fine-Tune Model“.

Hier können Datensätze aus FileMaker-Tabellen (z. B. Supportverläufe, Kundendialoge, Textmuster) als Trainingsdaten genutzt werden. Die Feintuning-Methode basiert auf LoRA (Low-Rank Adaptation), einem ressourcenschonenden Verfahren, das nur einen kleinen Teil der Modellparameter verändert und so schnelle Anpassungen ermöglicht – selbst auf Geräten mit begrenztem Arbeitsspeicher.

Die Trainingsdaten werden entweder aus einem aktuellen Found Set übernommen oder über eine JSONL-Datei eingespielt. Nach dem Training wird ein neuer Modellname vergeben – z. B. „fm-mlx-support-v1“ – und das Ergebnis steht direkt für weitere KI-Funktionen zur Verfügung. Damit lassen sich maßgeschneiderte Sprachmodelle erzeugen, die im Ton, im Vokabular und im Verhalten genau auf die jeweilige Anwendung abgestimmt sind.

Datenschutz und Leistung – zwei Seiten derselben Medaille

Il fatto che FileMaker 2025 si affidi a modelli locali con MLX non è un caso. In un momento in cui la sovranità dei dati, la conformità al GDPR e le linee guida sulla sicurezza interna stanno diventando sempre più importanti, questo approccio offre diversi vantaggi:

- Nessun cloud, nessun server esterno, nessun costo APITutte le richieste rimangono nella propria rete.

- Tempi di risposta più rapidi grazie all'elaborazione locale – insbesondere bei wiederkehrenden Abläufen.

- Elevata trasparenza e controllabilitàOgni risposta può essere controllata, ogni modifica tracciata, ogni fase di formazione documentata.

- Messa a punto in base ai propri datiLe conoscenze specifiche dell'azienda non vengono più convogliate attraverso fornitori esterni, ma rimangono interamente all'interno del sistema aziendale.

Gleichzeitig ist es wichtig, die Ressourcen realistisch einzuschätzen: Große Modelle benötigen auch lokal eine solide Infrastruktur – etwa ein Apple Silicon Mac mit 32 oder 64 GB RAM, ggf. mit SSD-Caching und dediziertem Server-Profil. Doch wer diesen Weg geht, profitiert langfristig von maximaler Kontrolle bei voller Flexibilität.

MLX und FileMaker – eine neue Allianz für Profis

Was zunächst wie ein paralleler Pfad aussah – auf der einen Seite MLX als Forschungsframework von Apple, auf der anderen Seite FileMaker als klassische Datenbankplattform – ist jetzt zu einem geschlossenen System zusammengewachsen.

Claris hat erkannt, dass moderne Geschäftsanwendungen mehr brauchen als Formulare, Tabellen und Reports. Sie brauchen adaptive, verständnisfähige KI – und zwar integriert, nicht angeflanscht. Mit der nativen Unterstützung von MLX, den neuen KI-Befehlen und der Möglichkeit zum lokalen Feintuning bietet FileMaker 2025 erstmals eine vollständige Plattform, um eigene KI-Prozesse aufzubauen, zu steuern und produktiv zu nutzen – ohne dabei auf externe Anbieter oder fremde Clouds angewiesen zu sein.

Für Entwickler, die wie Du eine klare, konservativ durchdachte und datensichere Architektur schätzen, ist das mehr als ein Fortschritt – es ist der Beginn einer neuen Arbeitsweise.

In un altro articolo presento un Confronto tra Apple Silicon e NVIDIA e spiegare quale hardware è adatto all'esecuzione di modelli linguistici locali su un Mac.

Domande frequenti

- Cosa significa esattamente che FileMaker 2025 "supporta MLX"?

FileMaker Server 2025 enthält erstmals einen integrierten AI Model Server, der – sofern auf einem Apple Silicon Mac installiert – nativ MLX-Modelle verwendet. Das bedeutet: Du kannst ein MLX-kompatibles Modell (z. B. Mistral oder Phi-2) direkt über die Admin-Konsole bereitstellen und in Deiner FileMaker-Lösung verwenden – ohne Umwege über externe Dienste oder REST-Aufrufe. - Di quale hardware e software specifico ho bisogno per questo?

– Einen Mac mit Apple Silicon (M1, M2, M3, M4), idealerweise mit 32-64 GB RAM,

- FileMaker Server 2025, su questo Mac installiert,

- FileMaker Pro 2025 per la soluzione attuale,

– und ein oder mehrere MLX-kompatible Modelle – entweder von Claris bereitgestellt oder selbst konvertiert (z. B. via mlx-lm). - Come posso integrare questo modello nella mia soluzione FileMaker?

Über die neue Funktion „Configure AI Account“ in FileMaker Scripts legst Du fest, mit welchem Modell gearbeitet wird. Der Servername, der Modellname und der Auth-Key werden dabei definiert. Danach kannst Du sofort die anderen KI-Funktionen verwenden – z. B. zur Texterzeugung, Embedding oder semantischen Suche. Alles läuft über native Script-Schritte, keine Webviewer oder „Insert from URL“-Bastelarbeit mehr nötig. - Quali funzioni AI posso utilizzare nell'FileMaker?

Sono disponibili le seguenti funzioni (a seconda del tipo di modello):

- Generazione di testo ("Genera risposta dal modello")

- Ricerca naturale ("Esegui ricerca in linguaggio naturale")

- SQL nel linguaggio quotidiano ("Eseguire una query SQL in linguaggio naturale")

- Vettori semantici ("Incorpora", "Similitudine del coseno")

- Gestione dei modelli di prompt ("Configura modello di prompt")

- Messa a punto LoRA tramite i propri dati ("Fine-Tune Model")

Tutte le funzioni sono basate su script e possono essere integrate senza problemi nelle soluzioni esistenti. - Come funziona la regolazione fine direttamente nell'FileMaker?

Du kannst in FileMaker 2025 ein vorhandenes MLX-Modell per LoRA direkt feintunen – also mit Deinen eigenen Daten anpassen. Dafür nutzt Du entweder Datensätze in einer Tabelle (z. B. Fragen + Antworten) oder eine JSONL-Datei. Ein einziger Scriptbefehl („Fine-Tune Model“) reicht aus, um ein neues, angepasstes Modell zu erzeugen – das dann sofort in der Lösung verfügbar ist. - Devo ancora avere familiarità con Python, JSON, API o formati di modelli?

Nein, nicht unbedingt. Claris hat bewusst darauf geachtet, dass viele dieser technischen Details in den Hintergrund treten. Du kannst mit nativen Scriptbefehlen arbeiten, die Daten in FileMaker selbst verwalten, und die Rückgaben als Text oder Vektor einfach verarbeiten. Wer will, kann tiefer einsteigen – aber es geht jetzt auch ohne Programmierkenntnisse. - Was sind die Vorteile, wenn ich MLX über FileMaker nutze – gegenüber externen APIs?

I vantaggi risiedono nella sicurezza dei dati, nel controllo dei costi e nelle prestazioni:

- Non è necessaria alcuna connessione al cloud, tutti i dati rimangono nella vostra rete.

– Keine API-Kosten oder Token-Limits – einmal installiert, ist die Nutzung frei.

- Tempi di risposta molto brevi, poiché non c'è latenza di rete.

- Pieno controllo sui dati di formazione, sulla messa a punto e sulla versione del modello.

Si tratta di una vera e propria svolta, soprattutto per le applicazioni interne, le soluzioni industriali o i processi sensibili. - Ci sono restrizioni o cose a cui fare attenzione?

Ja – MLX funktioniert nur auf Apple Silicon, d. h. ein Intel-Server ist ausgeschlossen. Außerdem brauchst Du genügend RAM, damit auch größere Modelle zuverlässig laufen. Nicht alle Modelle sind sofort kompatibel – manche müssen konvertiert werden. Und schließlich: Obwohl vieles „automatisch“ funktioniert, sollte man bei produktivem Einsatz immer einen dedizierten Testlauf machen – z. B. mit kleinen Datenmengen, klaren Zieldefinitionen und guter Logging-Strategie.

Materiale dell'immagine (c) Claris Inc. e Kohji Asakawa su Pixabay