Lokalna sztuczna inteligencja z pamięcią - bez chmury, bez subskrypcji, bez przekierowań

W poprzednie artykuły Wyjaśniłem, jak skonfigurować Ollama na Macu install. Jeśli wykonałeś już ten krok, masz teraz potężny lokalny model językowy - taki jak Mistral, LLaMA3 lub inny kompatybilny model, do którego można się odwołać za pośrednictwem interfejsu API REST.

Model „wie“ jednak tylko to, co znajduje się w bieżącej podpowiedzi. Nie pamięta poprzednich rozmów. Brakuje tylko pamięci.

Właśnie dlatego korzystamy z Qdrant, nowoczesnej semantycznej wektorowej bazy danych.

W tym artykule pokażę to krok po kroku:

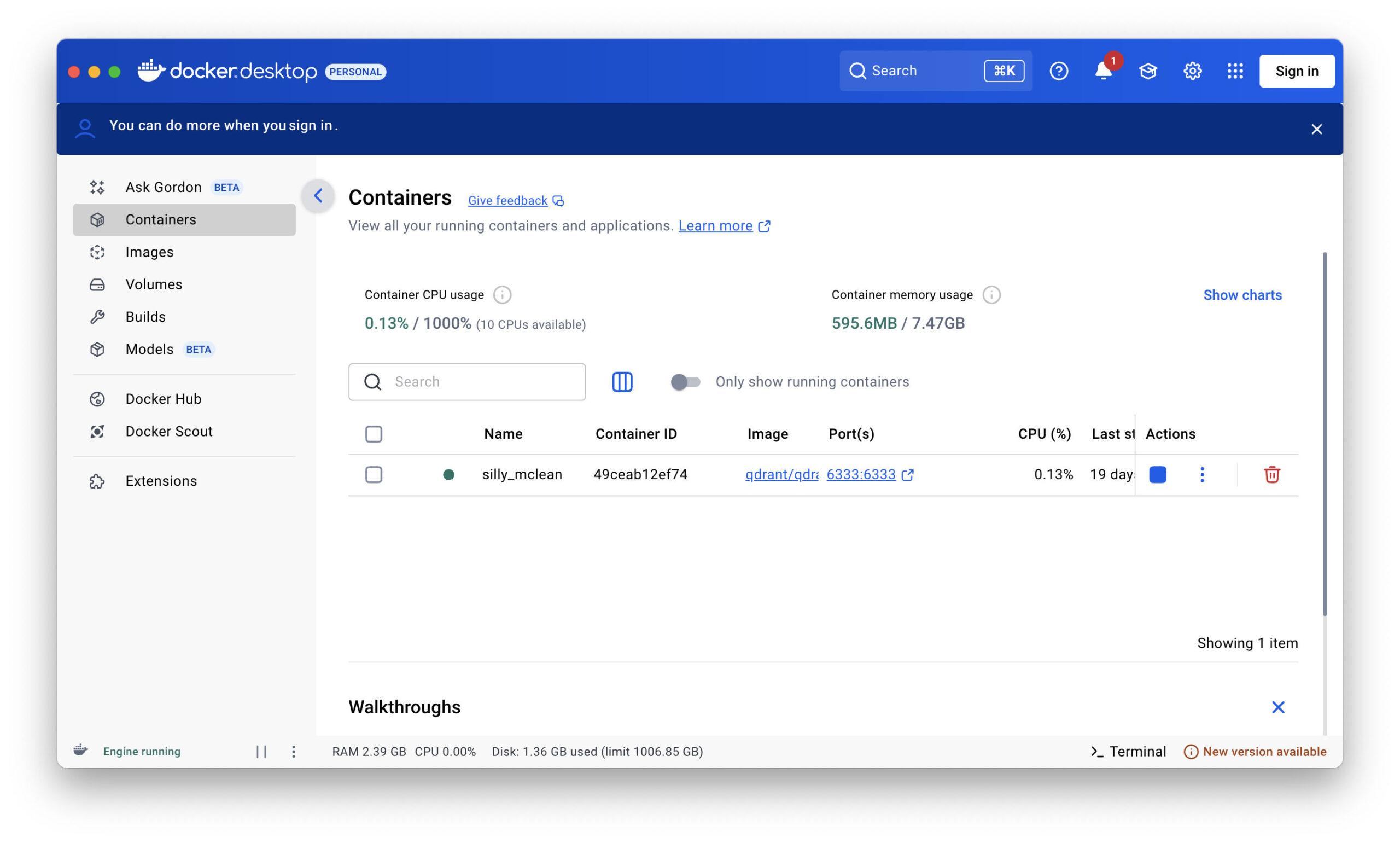

- Jak installier Qdrant na Macu (przez Docker)

- Jak tworzyć osadzenia za pomocą Pythona

- jak zapisywać, wyszukiwać i integrować zawartość z przepływem pracy Ollama

- i jak wygląda kompletna sekwencja monit→pamięć→odpowiedź

Dlaczego Qdrant?

Qdrant nie przechowuje tradycyjnych tekstów, ale wektory, które reprezentują znaczenie tekstu jako kod numeryczny. Oznacza to, że treść może być nie tylko dokładnie znaleziona, ale także semantycznie podobna - nawet jeśli słowa się różnią.

Ollama + Qdrant daje zatem wyniki:

Lokalny model językowy z pamięcią długoterminową - bezpieczny, kontrolowany i rozszerzalny.

Wymagania wstępne

- Ollama to installiert i działa (→ np. ollama run mistral)

- Docker to installiert: https://www.docker.com/products/docker-desktop

- Python 3.9+

Pakietinstallation od Qdrant:

pip install qdrant-client sentence-transformers

Uruchom Qdrant (Docker)

docker run -p 6333:6333 -p 6334:6334 qdrant/qdrant

Następnie uruchamia się Qdrant:

http://localhost:6333 (REST API)

http://localhost:6334 (gRPC, niewymagane w tym artykule)

Przykład w języku Python dla Ollama + Qdrant

Napiszemy teraz prosty podstawowy skrypt, który:

- akceptuje monit użytkownika

- generuje wektor osadzania z tego wektora

- wyszukuje semantycznie podobne wspomnienia w Qdrant

- odpowiedź jest generowana z kontekstem przez Ollama

- zapisuje nową rozmowę jako przypomnienie

Python-Script: ollama_memory.py

import requests

from sentence_transformers import SentenceTransformer

from qdrant_client import QdrantClient

from qdrant_client.models import Distance, VectorParams, PointStruct

# Einstellungen

OLLAMA_URL = "http://localhost:11434/api/generate"

COLLECTION_NAME = "memory"

VECTOR_SIZE = 384 # für 'all-MiniLM-L6-v2'

# Lade Embedding-Modell

embedder = SentenceTransformer("all-MiniLM-L6-v2")

# Verbinde mit Qdrant

qdrant = QdrantClient(host="localhost", port=6333)

# Erstelle Collection (einmalig)

def create_collection():

if COLLECTION_NAME not in qdrant.get_collections().collections:

qdrant.recreate_collection(

collection_name=COLLECTION_NAME,

vectors_config=VectorParams(size=VECTOR_SIZE, distance=Distance.COSINE)

)

# Füge Eintrag ins Gedächtnis hinzu

def add_to_memory(text: str):

vector = embedder.encode(text).tolist()

point = PointStruct(id=hash(text), vector=vector, payload={"text": text})

qdrant.upsert(collection_name=COLLECTION_NAME, points=[point])

# Suche im Gedächtnis

def search_memory(query: str, top_k=3):

vector = embedder.encode(query).tolist()

hits = qdrant.search(

collection_name=COLLECTION_NAME,

query_vector=vector,

limit=top_k

)

return [hit.payload["text"] for hit in hits]

# Sende Anfrage an Ollama

def query_ollama(context: list[str], user_prompt: str):

prompt = "\n\n".join(context + [user_prompt])

response = requests.post(OLLAMA_URL, json={

"model": "mistral",

"prompt": prompt,

"stream": False

})

return response.json()["response"]

# Ablauf

def main():

create_collection()

print("Frage an die KI:")

user_prompt = input("> ")

context = search_memory(user_prompt)

answer = query_ollama(context, user_prompt)

print("\nAntwort von Ollama:")

print(answer.strip())

# Speichern der Konversation

full_entry = f"Frage: {user_prompt}\nAntwort: {answer.strip()}"

add_to_memory(full_entry)

if __name__ == "__main__":

main()Uwagi dotyczące praktyki

Można również użyć własnych modeli osadzania, np. za pośrednictwem Ollama (np. nomic-embed-text) lub modeli Hugging Face.

Qdrant obsługuje filtry ładunku, okresy czasu i pola (bardzo przydatne do późniejszej rozbudowy!).

Identyfikator hash(text)-ID jest wystarczający do prostych testów, do profesjonalnych zastosowań należy używać identyfikatorów UUID

Lokalna sztuczna inteligencja z pamięcią - i co można z nią zrobić

W poprzednich rozdziałach pokazałem, jak zbudować prawdziwą, lokalną pamięć AI na komputerze Mac z Ollama i Qdrant. Konfiguracja, która działa bez chmury, bez subskrypcji i bez zewnętrznych serwerów - szybko, bezpiecznie, prywatnie.

Ale co teraz?

Do czego właściwie można wykorzystać tę technologię? Co jest dzięki niej możliwe - dziś, jutro, pojutrze?

Odpowiedź: całkiem sporo.

Ponieważ to, co tutaj masz, to coś więcej niż tylko chatbot. To niezależna od platformy myśląca maszyna z pamięcią długoterminową. A to otwiera drzwi.

1. baza danych wiedzy osobistej

Możesz użyć Ollama + Qdrant jako osobistej pamięci długoterminowej.

Dokumenty, notatki z rozmów, pomysły - wszystko, co mu powiesz, może być semantycznie przechowywane i wyszukiwane.

Przykład:

„Jaki był mój pomysł na biznes z zeszłego czwartku?“.“

„Którzy klienci chcieli aktualizacji w marcu?“

Zamiast przeszukiwać foldery, wystarczy zapytać system. Szczególnie ekscytujące jest to, że działa również z nieprecyzyjnymi pytaniami, ponieważ Qdrant wyszukuje semantycznie, a nie tylko słowa kluczowe.

2. automatyczne rejestrowanie i podsumowywanie

W połączeniu z wprowadzaniem danych dźwiękowych lub tekstowych, system może prowadzić bieżący dziennik:

- Notatki na spotkaniach

- Rozmowy z klientami

- Dzienniki lub historie projektów

Dane te są automatycznie wprowadzane do pamięci Qdrant, dzięki czemu można je później przeszukiwać jak asystenta:

„Co pan Meier powiedział o dostawie?“

„Jak wyglądał proces w projekcie XY?“

3. osobisty trener lub asystent dziennika

Regularne zapisywanie myśli, nastrojów lub decyzji pozwala stworzyć refleksyjnego towarzysza:

„Jaki był mój największy postęp w tym miesiącu?“.“

„Jak wtedy reagowałem na niepowodzenia?“.“

System z czasem poznaje użytkownika i staje się prawdziwym lustrem, a nie tylko chatbotem.

4. aplikacje biznesowe z FileMaker

Jeśli - tak jak ja - używasz FileMaker, możesz podłączyć tę konfigurację bezpośrednio:

- Wysyłanie monitów z FileMaker

- Automatyczne pobieranie i zapisywanie odpowiedzi

- Kontroluj dostęp do pamięci bezpośrednio przez REST API lub skrypt powłoki

Tworzy to niezwykle potężną kombinację:

- FileMaker = Front-end, interfejs użytkownika, centrum sterowania

- Ollama = inteligencja językowa

- Qdrant = semantyczna pamięć długotrwała

Rezultat: prawdziwy komponent AI dla rozwiązań FileMaker - lokalny, bezpieczny i spersonalizowany.

🛠️ 5. Wsparcie w życiu codziennym: przypomnienia, pomysły, zalecenia

„Przypomnij mi o tym pomyśle w przyszłym tygodniu“.“

„Które książki już ci poleciłem?“

„Co mógłbym zaoferować panu Müllerowi w następnej kolejności?“

Dzięki ukierunkowanej logice pamięci (znaczniki czasu, kategorie, użytkownicy) można uporządkować pamięć w ukierunkowany sposób i wykorzystać ją w wielu obszarach życia i biznesu.

6. podstawa dla systemu agentowego

Jeśli myślisz przyszłościowo, możesz również budować systemy podobne do agentów za pomocą tej konfiguracji:

- Sztuczna inteligencja przejmuje proste zadania

- Sztuczna inteligencja rozpoznaje wzorce w czasie

- Sztuczna inteligencja udziela proaktywnych wskazówek

Przykład:

„Zadałeś to samo pytanie cztery razy w tym tygodniu - czy chcesz zapisać notatkę?“.“

„Uderzająca liczba klientów wspomniała o tym produkcie - czy mam to podsumować?“.“

7. integracja z innymi narzędziami

System można łatwo połączyć z innymi narzędziami:

- Neo4j, do graficznego przedstawiania relacji semantycznych

- Pliki i pliki PDF, do automatycznego indeksowania treści

- Parser poczty, analizowanie i zapamiętywanie wiadomości e-mail

- Asystenci głosowi, do interakcji głosowej

8. wszystko pozostaje lokalne - i pod kontrolą

Największa zaleta: Ty decydujesz, co zostanie zapisane. Ty decydujesz, jak długo będą zapisywane. I: nigdy nie opuszcza twojego komputera, jeśli tego nie chcesz. W świecie, w którym wiele osób ślepo polega na sztucznej inteligencji w chmurze, jest to potężna przeciwwaga - szczególnie dla freelancerów, programistów, autorów i przedsiębiorców.

Aktualne badanie dotyczące korzystania z lokalnych systemów AI

Tame Ollama + Qdrant: Jak nadać lokalnej sztucznej inteligencji strukturę, zasady i dopracowanie?

Jeśli zadałeś sobie trud zainstalowania Ollama i Qdrant lokalnie na komputerze Mac, osiągnąłeś już wielkie rzeczy. Masz teraz:

- Lokalny język AI

- Pamięć semantyczna

- I działający potok, który mapuje Prompt → Memory → Ollama → Response

Ale każdy, kto z nim pracuje, szybko zdaje sobie sprawę, że potrzebuje zasad. Struktury. Porządku.

Bez kontroli asystent szybko zamieni się w gadułę, który za dużo pamięta, ciągle się powtarza lub przywołuje nieistotne wspomnienia.

Czego jeszcze brakuje?

Orkiestra ma również dyrygenta. I to właśnie jest teraz twoje zadanie: kontrolować, a nie tylko wykorzystywać.

Moduł 1: „Router“ dla logiki pamięci

Zamiast tępo zapisywać wszystko lub tępo szukać wszystkiego, powinieneś z góry zdecydować, czy cokolwiek powinno zostać zapisane lub załadowane. Można to zrobić na przykład za pomocą prostego routera relewancji, który umieszcza się między monitem a pamięcią:

PrzykładSprawdź trafność za pomocą monitu do samego Ollama

def is_relevant_for_memory(prompt, response):

prüf_prompt = f"""

Nutzer hat gefragt: "{prompt}"

Die KI hat geantwortet: "{response}"

Sollte man sich diesen Dialog langfristig merken? Antworte nur mit 'Ja' oder 'Nein'.

"""

result = query_ollama([], prüf_prompt).strip().lower()

return result.startswith("ja")Dajesz więc Ollama zadanie oceny jego odpowiedzi - i tylko jeśli zostanie ona sklasyfikowana jako istotna, zapisujesz ją w Qdrant.

Moduł 2: Wykluczanie starszych wiadomości (ograniczenie kontekstu)

Szczególnie w przypadku dłuższych sesji staje się to problematyczne, gdy stare wiadomości pojawiają się ponownie w kontekście. Model nie zapomina - grzęźnie.

RozwiązanieOgranicz okno kontekstowe.

Można to zrobić na dwa sposoby:

Metoda 1Ogranicz liczbę trafień

context = search_memory(user_prompt, top_k=3)

Wczytywane jest tylko to, co ma znaczenie semantyczne - nie wszystko.

Metoda 2Ograniczenie czasu

# Nur Nachrichten der letzten 7 Tage now = datetime.utcnow() filter = Filter( must=[ FieldCondition(key="timestamp", range=Range(gte=now - timedelta(days=7))) ] )

Można zatem „odciąć“ czas, jeśli system sięga zbyt daleko w przeszłość.

Moduł 3: Wprowadzenie wag kontekstowych i etykiet

Nie każdy wpis w pamięci ma taką samą wartość. Możesz nadać im wagę lub kategorie:

- Naprawiono (np. „Użytkownik nazywa się Markus“)

- Tymczasowy (np. „Dzisiaj jest wtorek“)

- Sytuacyjny (np. „Czat od dziś od 10:30“)

Qdrant obsługuje tzw. payloads - tj. dodatkowe informacje na wpis. Pozwala to na późniejsze filtrowanie lub ustalanie priorytetów.

Moduł 4: Dostrajanie za pomocą monitu

Sam monit jest potężną jednostką sterującą.

Oto kilka sztuczek, których możesz użyć, aby uczynić Ollama bardziej inteligentnym:

Przykładowy monit z instrukcjami:

Jesteś lokalnym asystentem z pamięcią semantyczną. Jeśli znajdziesz kilka wspomnień, użyj tylko trzech najbardziej istotnych. Nie odwołuj się do informacji starszych niż 10 dni, chyba że są one wyraźnie zaznaczone. Ignoruj trywialne przypomnienia, takie jak „Dzień dobry“ lub „Dziękuję“. Odpowiadaj precyzyjnie i w stylu doświadczonego doradcy.

Pozwala to na przeprowadzanie dostrajania bezpośrednio w samej podpowiedzi - bez nowych modeli, bez szkolenia.

I: Podpowiedź można generować dynamicznie - w zależności od sytuacji.

Moduł 5: Higiena przechowywania

Gdy pamięć rośnie, staje się to mylące.

Prosty skrypt konserwacyjny, który usuwa nieistotne lub zduplikowane treści, jest na wagę złota.

Przykład:

„Zapomnij o wszystkim, co ma związek z ‚pogodą‘“.“

„Usuń wpisy, które są starsze niż 3 miesiące i nigdy nie były pobierane“.“

Qdrant obsługuje to za pośrednictwem interfejsu API - i można to zautomatyzować na przykład raz w tygodniu.

Moduł 6: FileMaker jako panel kontrolny

Jeśli - tak jak ja - pracujesz z FileMaker, możesz kontrolować to wszystko zdalnie za pośrednictwem REST-API:

- Wyślij niezwłocznie

- Pobieranie kontekstu

- Otrzymana odpowiedź

- Przeprowadzenie wyceny

- Zapisz lub zapomnij

Wszystko, czego potrzebujesz, to mały moduł REST w FileMaker (wstawianie z adresu URL za pomocą JSON) i kilka skryptów.

Rezultat: interfejs, który pozwala kontrolować sztuczną inteligencję jak żywy notebook - ale z inteligencją.

Wniosek: sztuczna inteligencja jest tak dobra, jak jej przywództwo

Ollama jest potężny. Qdrant jest elastyczny. Ale bez jasnych zasad oba stają się nieuporządkowanym stosem danych. Sztuczka nie polega na przechowywaniu wszystkiego - ale na przechowywaniu tylko tego, co jest istotne i myśleniu celowym, a nie tylko zapamiętywaniu.

Nowa seria artykułów: Historie ChatGPT jako baza wiedzy dla sztucznej inteligencji

Jeśli zbudowałeś już własną pamięć AI z Ollama i Qdrant, warto przyjrzeć się nowej serii artykułów, która zaczyna się właśnie tutaj. Opowiada ona o tym, jak Zintegruj eksport danych ChatGPT z tym systemem lets. Wielu użytkowników nawet nie zdaje sobie sprawy, że mogą wyeksportować całą historię czatów - i że te dane są cennym źródłem wiedzy. W tej serii pokażę, jak analizować te rozmowy, konwertować je na embeddings, a następnie importować do wektorowej bazy danych. Dzięki temu lokalna sztuczna inteligencja może później uzyskać dostęp do poprzednich rozmów i wykorzystać je jako kontekst dla odpowiedzi. W ten sposób osobiste archiwum wiedzy rośnie krok po kroku z poszczególnych dialogów.

Jeśli zbudowałeś już własną pamięć AI z Ollama i Qdrant, warto przyjrzeć się nowej serii artykułów, która zaczyna się właśnie tutaj. Opowiada ona o tym, jak Zintegruj eksport danych ChatGPT z tym systemem lets. Wielu użytkowników nawet nie zdaje sobie sprawy, że mogą wyeksportować całą historię czatów - i że te dane są cennym źródłem wiedzy. W tej serii pokażę, jak analizować te rozmowy, konwertować je na embeddings, a następnie importować do wektorowej bazy danych. Dzięki temu lokalna sztuczna inteligencja może później uzyskać dostęp do poprzednich rozmów i wykorzystać je jako kontekst dla odpowiedzi. W ten sposób osobiste archiwum wiedzy rośnie krok po kroku z poszczególnych dialogów.

Często zadawane pytania

- Dlaczego lokalna sztuczna inteligencja w ogóle potrzebuje „pamięci“? Czy model językowy nie wystarczy?

Model językowy działa tylko z bieżącą podpowiedzią i kontekstem, który aktualnie mu nadajesz. Nie zapamiętuje zatem na stałe poprzednich rozmów, dokumentów czy informacji. Właśnie w tym miejscu pojawia się pamięć lokalna. Dodatkowa baza danych pozwala sztucznej inteligencji zapisywać poprzednie treści i pobierać je w razie potrzeby. Model otrzymuje wtedy nie tylko bieżące pytanie podczas udzielania odpowiedzi, ale także odpowiednie informacje z tej pamięci. Skutkuje to znacznie bardziej spójnymi i świadomymi odpowiedziami. Bez takiego systemu model językowy pozostaje w zasadzie czystym generatorem tekstu bez żadnej długoterminowej wiedzy na temat własnych danych lub projektów. - Czym dokładnie jest Qdrant i dlaczego jest używany w tym systemie?

Qdrant to nowoczesna wektorowa baza danych, która została opracowana specjalnie do wyszukiwania semantycznego. W przeciwieństwie do tradycyjnych baz danych, przechowuje informacje nie tylko jako tekst, ale jako tak zwane wektory - matematyczne reprezentacje znaczenia. Pozwala to na przeszukiwanie treści nie tylko pod kątem identycznych słów, ale także pod kątem bliskości treści. Jeśli więc zadasz pytanie, Qdrant może znaleźć odpowiednie fragmenty tekstu z Twojej bazy wiedzy, nawet jeśli nie zawierają one dokładnie tych samych terminów. W połączeniu z modelem językowym tworzy to rodzaj inteligentnej pamięci dla sztucznej inteligencji. - Co oznacza termin „RAG“, który jest często używany w tym kontekście?

RAG to skrót od „Retrieval Augmented Generation“. Jest to technika, w której model językowy pobiera dodatkowe informacje z bazy danych przed udzieleniem odpowiedzi. W ten sposób model nie tylko generuje swoją odpowiedź na podstawie szkolenia, ale także uzupełnia ją odpowiednimi informacjami ze źródła wiedzy. Metoda ta rozwiązuje typowy problem modeli językowych: Znają one tylko to, czego nauczyły się podczas treningu. RAG umożliwia im dostęp do aktualnych lub osobistych danych - takich jak dokumentacja, strony internetowe lub własne notatki. - W jaki sposób Ollama i Qdrant faktycznie ze sobą współpracują?

W tej konfiguracji Ollama pełni rolę modelu językowego, podczas gdy Qdrant działa jako pamięć semantyczna. Gdy zadajesz pytanie, Qdrant najpierw wyszukuje odpowiednie fragmenty tekstu. Wyniki te są następnie przekazywane do modelu językowego wraz z pytaniem. Model wykorzystuje te dodatkowe informacje do sformułowania dobrze uzasadnionej odpowiedzi. Typowa sekwencja jest zatem następująca: zapytanie → wyszukiwanie w pamięci → rozszerzanie kontekstu → generowanie odpowiedzi. - Jakie rodzaje danych mogę umieścić w tej pamięci AI?

Zasadniczo prawie wszystko, co można przekonwertować na tekst. Obejmuje to dokumentację, strony internetowe, pliki Markdown, pliki PDF, wpisy do baz danych, a nawet osobiste notatki. Jedyną ważną rzeczą jest to, że treść może zostać podzielona na mniejsze sekcje tekstowe, zanim zostanie zapisana w bazie danych. Te tak zwane „fragmenty“ stanowią później podstawę wyszukiwania semantycznego. Pozwala to sztucznej inteligencji na uzyskanie dostępu do poszczególnych istotnych sekcji zamiast konieczności przeszukiwania całych dokumentów. - Dlaczego używana jest wektorowa baza danych zamiast zwykłego wyszukiwania tekstowego?

Klasyczne wyszukiwarki zazwyczaj działają w oparciu o słowa kluczowe. Oznacza to, że znajdują tylko wyniki zawierające dokładnie te same terminy. Z drugiej strony wektorowa baza danych wyszukuje znaczenie. Może więc również znaleźć teksty o podobnej treści, nawet jeśli użyto różnych słów. Ma to kluczowe znaczenie dla systemów sztucznej inteligencji, ponieważ pytania są często formułowane inaczej niż oryginalne dokumenty. Wyszukiwanie semantyczne sprawia, że powiązanie między pytaniem a odpowiedzią jest znacznie bardziej niezawodne. - W jaki sposób teksty są konwertowane na wektory?

W tym celu wykorzystywane są tak zwane modele osadzania. Modele te analizują teksty i przekształcają je w wektory liczbowe, które reprezentują ich znaczenie. Każda sekcja tekstu otrzymuje zatem matematyczną reprezentację w tak zwanej przestrzeni wektorowej. Podobne treści znajdują się bliżej siebie niż zupełnie różne tematy. Jeśli pytanie zostanie zadane później, jest ono również konwertowane na wektor. Qdrant może wtedy bardzo szybko znaleźć najbardziej podobne wpisy w pamięci. - Dlaczego Qdrant jest często używany przez Docker installiert?

Docker znacznie upraszcza instalację złożonego oprogramowania. Zamiast ręcznie konfigurować wiele indywidualnych zależności, Qdrant po prostu działa w kontenerze. Oznacza to, że instalacja działa niezawodnie na różnych systemach i można ją łatwo uruchomić lub zatrzymać. Ta metoda jest szczególnie praktyczna na komputerach Mac, ponieważ utrzymuje system w czystości i jednocześnie zapewnia stabilne środowisko dla bazy danych. - Czy mogę obsługiwać ten system całkowicie offline?

Tak, to jedna z największych zalet tej architektury. Zarówno model językowy, jak i wektorowa baza danych działają lokalnie na komputerze użytkownika. Oznacza to, że żadne dane nie są wysyłane na zewnętrzne serwery. Tworzy to całkowicie prywatne środowisko AI. Jest to zdecydowana przewaga nad systemami chmurowymi, zwłaszcza w przypadku wrażliwych danych lub wewnętrznych dokumentów firmowych. - Jak duża może stać się taka lokalna pamięć AI?

Zależy to przede wszystkim od przestrzeni dyskowej i wydajności systemu. Nowoczesne wektorowe bazy danych mogą z łatwością zarządzać milionami fragmentów tekstu. Jednak w przypadku wielu osobistych projektów wystarczy zaledwie kilka tysięcy dokumentów, aby stworzyć bardzo wydajny system wiedzy. Jakość struktury danych jest ważniejsza niż sama ilość informacji. - Czy AI naprawdę może „uczyć się“ za pomocą tego systemu?

Nie w klasycznym sensie. Sam model językowy nie jest ponownie trenowany. Zamiast tego wiedza jest przechowywana poza modelem i pobierana w razie potrzeby. Chociaż sprawia to, że sztuczna inteligencja wydaje się zdolna do uczenia się, w rzeczywistości uzyskuje jedynie dostęp do stale rosnącego zasobu wiedzy. Podejście to ma jedną ważną zaletę: nowe informacje mogą być dodawane w dowolnym momencie bez konieczności ponownego trenowania modelu. - Jakie praktyczne zastosowania wynikają z takiej lokalnej pamięci AI?

Możliwości są niezwykle zróżnicowane. Można na przykład utworzyć osobistą bazę wiedzy, umożliwić przeszukiwanie dokumentacji technicznej lub analizę wewnętrznych dokumentów firmy. Autorzy, programiści lub badacze również czerpią z tego korzyści, ponieważ mogą udostępniać duże ilości informacji w ustrukturyzowany sposób. Zasadniczo tworzony jest rodzaj osobistego asystenta badawczego, który rozumie własne dane. - Czy mogę zintegrować kilka źródeł danych jednocześnie?

Tak, Qdrant umożliwia nadanie każdemu fragmentowi tekstu dodatkowych metadanych, takich jak źródło, kategoria lub język. Pozwala to na wspólne zarządzanie różnymi bazami danych. Metadane te mogą być nawet specjalnie filtrowane podczas wyszukiwania. Na przykład sztuczna inteligencja może brać pod uwagę tylko treści z określonej dokumentacji lub określonego projektu. - Czym ten system różni się od klasycznych chatbotów?

Większość chatbotów działa wyłącznie w oparciu o wiedzę z ich zestawu danych szkoleniowych. Nie mogą zatem dostarczyć żadnych konkretnych informacji na temat treści użytkownika. Z drugiej strony, system RAG łączy model językowy z indywidualną bazą wiedzy. Pozwala to sztucznej inteligencji udzielać odpowiedzi, które są bezpośrednio dostosowane do własnych danych. Dzięki temu jest znacznie bardziej przydatna do produktywnej pracy. - Jaką rolę odgrywa Python w tej konfiguracji?

Python jest często używany do kontrolowania połączenia między modelem językowym a bazą danych. Za pomocą zaledwie kilku skryptów można wczytać teksty, przekształcić je w wektory i zapisać w Qdrant. Python może również przeprowadzić wyszukiwanie i przenieść znalezione wyniki do modelu językowego. Tworzy to elastyczny potok, który można dostosować do własnych wymagań. - Czy stworzenie takiego systemu jest tylko dla deweloperów?

Niekoniecznie. Chociaż konfiguracja systemu wymaga pewnej wiedzy technicznej, wiele z wymaganych narzędzi stało się obecnie znacznie prostszych. Przy odrobinie cierpliwości działający system można skonfigurować nawet bez dogłębnej wiedzy programistycznej. Każdy, kto choć raz miał z tym do czynienia, szybko dostrzeże ogromny potencjał takiej lokalnej infrastruktury AI. - Jakie są ograniczenia lokalnej pamięci AI?

Najważniejszym ograniczeniem jest moc obliczeniowa własnego komputera. Duże modele lub ogromne bazy wiedzy mogą wymagać więcej pamięci i mocy procesora. Jakość odpowiedzi zależy również w dużej mierze od struktury danych. Jeśli dokumenty są źle przygotowane, sztuczna inteligencja może zapewnić dobre wyniki tylko w ograniczonym zakresie. - Dlaczego połączenie Ollama i Qdrant jest uważane za szczególnie interesującą architekturę dla lokalnej sztucznej inteligencji?

Ponieważ łączy w sobie dwa kluczowe komponenty: potężny model językowy i szybką semantyczną bazę danych. Razem tworzą one kompletne środowisko pracy AI, które może być obsługiwane całkowicie lokalnie. Pozwala to na tworzenie osobistych systemów wiedzy, inteligentnych wyszukiwarek lub wyspecjalizowanych asystentów - bez zależności od chmury i z pełną kontrolą nad własnymi danymi.