Há mais de dez anos que me dedico intensamente ao tema das hemorróidas - infelizmente não por interesse teórico, mas por experiência própria. Durante este tempo, já fui submetido a duas operações: um método THD (desarterialização transanal de hemorróidas) e um tratamento a laser. Ambas as operações ajudaram temporariamente, mas os sintomas voltaram sempre com o tempo.

Contribuições actuais

Escrever livros 2.0 - guia prático para autores na era da IA

Este livro não fornece visões especulativas do futuro, mas uma resposta prática e bem fundamentada da vida quotidiana de um autor que escreve ele próprio com IA - e que se concentra deliberadamente não na automação, mas na autonomia. "Escrever livros 2.0" destina-se a qualquer pessoa que esteja a pensar em escrever o seu próprio livro - ou que já esteja a fazê-lo - e que se interrogue sobre a forma como ferramentas modernas como o ChatGPT, geradores de imagens de IA ou auxiliares de tradução podem ser bem utilizadas. A tónica não é colocada em "produtos acabados de IA", mas numa abordagem holística: a IA como ferramenta, os seres humanos como autores.

Vemo-nos na conferência FileMaker FMK 2025 em Hamburgo?

De 15 a 17 de setembro de 2025, a comunidade FileMaker de língua alemã reunir-se-á no JUFA Hotel Hamburg HafenCity para discutir os últimos desenvolvimentos, tendências e melhores práticas na Conferência FileMaker (FMK 2025). Há mais de dez anos que esta conferência é considerada o evento mais importante para programadores, utilizadores e decisores no sector do FileMaker da Claris - e é com grande prazer que volto a estar presente este ano.

O livro das hemorróidas um pouco diferente - aberto, honesto e holístico

As hemorróidas são um assunto tabu. Embora milhões de pessoas sejam afectadas, raramente se fala abertamente sobre elas. Muitas sofrem em silêncio, adiando as visitas ao médico e tentando sobreviver com cremes e remédios caseiros. Mas é precisamente este silêncio que pode, inadvertidamente, prolongar o sofrimento.

Com "O livro das hemorróidas um pouco diferente - O meu caminho através do inferno das hemorróidas - e volta" O Markus Schall envia um sinal claro contra esta falta de palavras - e mostra novas formas de compreender melhor, categorizar e aliviar as queixas de forma holística.

Terapia com talas para a DMC - O meu percurso pessoal até à fase final

Há três anos e meio, começou para mim uma viagem que eu nunca teria esperado a este ponto - uma viagem através do meu próprio corpo, guiada por uma única tala ajustada regularmente. No início de 2022, de certeza que não teria pensado que os efeitos seriam tão grandes.

Ollama encontra Qdrant: Uma memória local para a sua IA no Mac

IA local com memória - sem nuvem, sem subscrição, sem desvios

Num artigos anteriores Expliquei como configurar o Ollama no Mac install. Se já tiver concluído este passo, tem agora um modelo de língua local poderoso - como o Mistral, LLaMA3 ou outro modelo compatível que pode ser abordado através da API REST.

No entanto, o modelo apenas "sabe" o que está no prompt atual. Não se lembra de conversas anteriores. O que falta é uma memória.

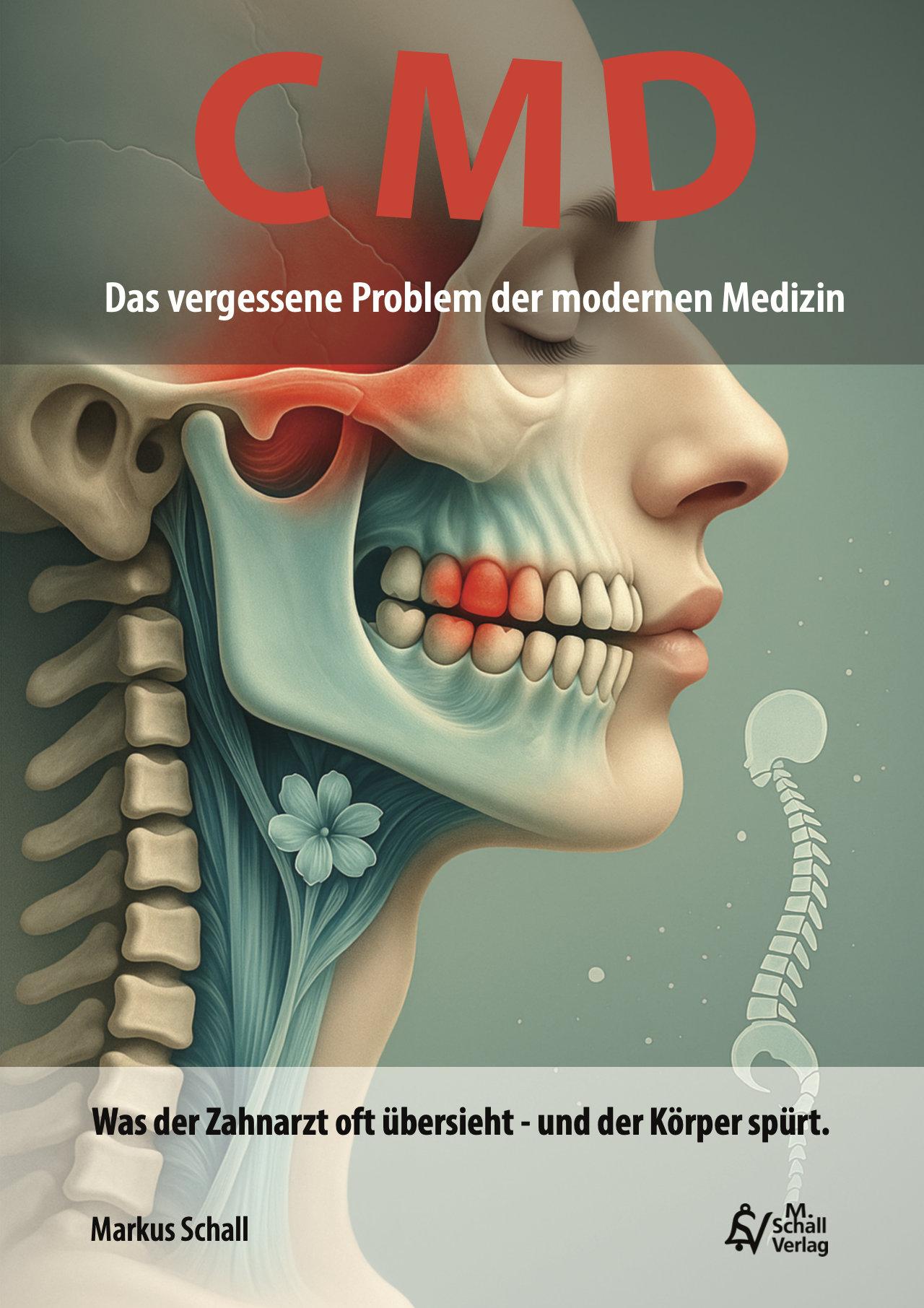

CMD - O problema esquecido da medicina moderna

Milhões de pessoas na Alemanha sofrem de queixas como zumbidos, tonturas, dores de costas ou tensão - e, no entanto, não conseguem encontrar um diagnóstico claro. O que muitas pessoas não sabem: Pode haver uma única causa, muitas vezes ignorada, por detrás de todos estes sintomas - a disfunção craniomandibular, ou DMC.

Com o meu livro "CMD - O problema esquecido da medicina moderna" Gostaria de começar por aqui: Explico o que é a DMC, como se manifesta, porque é tão difícil de reconhecer - e como as pessoas afectadas podem finalmente alcançar uma maior clareza e qualidade de vida.

O livro "A base de dados um pouco diferente" introduz a forma de pensar do processo.

O que têm em comum os contactos do telemóvel, as listas de tarefas, os calendários e até o seu próprio guarda-roupa? É isso mesmo: podem ser apresentados como tabelas - e não é por acaso. Há muito que os dados se tornaram um elemento básico da nossa vida quotidiana. Se os compreendermos, compreendemos o mundo um pouco melhor. É exatamente aqui que entra o "The database book with a difference".

Afinal, qualquer pessoa que consiga compreender os processos e os antecedentes na vida quotidiana é automaticamente capaz de concetualizar processos de software de forma rápida e intuitiva e de os implementar na prática.