In een steeds meer gedigitaliseerde wereld brengen we veel tijd online door: We chatten, winkelen, werken en informeren onszelf. Tegelijkertijd veranderen de regels over hoe inhoud wordt gedeeld, gemodereerd of gecontroleerd. De Digital Services Act (DSA), de European Media Freedom Act (EMFA), de geplande verordening ter voorkoming en bestrijding van seksueel misbruik van kinderen (CSAR, vaak „chatcontrole“ genoemd) en de AI-wet zijn belangrijke wetgevingsvoorstellen van de Europese Unie (EU) om de digitale omgeving te reguleren.

Deze regels lijken op het eerste gezicht ver weg - maar ze hebben invloed op zowel jou als particulier als op kleine en middelgrote bedrijven. Dit artikel zal je stap voor stap begeleiden: van de vraag „Wat is hier gepland?“ naar de achtergrond en tijdlijnen naar de verandering van perspectief: Wat betekent dit voor jou in het dagelijks leven?

In het eerste deel kijken we naar wat er eigenlijk gepland is, welke grote wetgevingsprojecten momenteel worden besproken of al zijn aangenomen en de redenen voor hun oprichting.

Laatste nieuws over geplande EU-censuurwetten

27.11.2025 - De EU-lidstaten hebben volgens Tagesschau na lange discussies overeengekomen om geen verplichte chatcontroles in te voeren. Voorlopig hoeven diensten als WhatsApp of Signal hun berichten niet automatisch te scannen op afbeeldingen van geseksualiseerd geweld tegen kinderen. Het oorspronkelijke plan mislukte door aanzienlijke tegenstand van onder andere Duitsland. In plaats daarvan vertrouwt de EU nu op vrijwillige maatregelen van providers. Een eerder tijdelijke uitzondering, die vrijwillige scans ondanks de regels voor gegevensbescherming toestaat, wordt permanent gemaakt. Na drie jaar wil de EU-Commissie opnieuw bekijken of een verplichting toch nodig is. Volgens het ontwerp moeten de platforms niettemin actief de risico's voor kinderen beperken, bijvoorbeeld door een betrouwbare leeftijdscontrole. Er is ook een nieuw EU-centrum tegen kindermisbruik gepland, dat de nationale autoriteiten zal bijstaan. Voordat de regelgeving van kracht wordt, moeten de Raad van Ministers van de EU en het Europees Parlement het nog eens worden over een gezamenlijke versie van de wet.

Korte tijd later publiceerde de Berliner Zeitung echter een kritisch verslag waarin vraagtekens worden gezet bij de formulering van de Tagesschau en de „vrijwillige“ aard van de chatcontrole. Patrick Breyer, een activist voor digitale vrijheid, bekritiseert de vrijwillige aanpak in het rapport en waarschuwt het publiek zich niet te laten misleiden door de term „vrijwillig“.

24.11.2025 - A Artikel in de Berliner Zeitung meldt dat de verordening ter voorkoming en bestrijding van seksueel misbruik van kinderen (CSAR) - vaak aangeduid als „chatcontrole“ - er volgens insiders zonder publiek debat doorheen wordt geloodst in de Europese Unie. Hoewel de expliciete verplichting om chats te scannen officieel is geschrapt, bevat het nieuwe ontwerp een maas in de wet: providers moeten doorgaan met het implementeren van „passende risicobeperkende maatregelen“, wat in feite automatisch scannen zou kunnen betekenen. Critici waarschuwen dat dit end-to-end encryptie zal ondermijnen en privécommunicatie in de toekomst automatisch doorzoekbaar zal maken.

Wat de EU momenteel van plan is: een eenvoudig overzicht

De EU heeft dit de afgelopen jaren erkend: Het internet verandert snel. Platforms met miljoenen of miljarden gebruikers, kunstmatige intelligentie, nieuwe vormen van communicatie - veel wettelijke kaders dateren nog van de afgelopen decennia. De EU wil de digitale ruimte veiliger maken, de grondrechten beschermen en eerlijke voorwaarden scheppen - zowel voor gebruikers als voor bedrijven. In de DSA staat bijvoorbeeld:

„Het doel is om een veiligere digitale ruimte te creëren waarin de grondrechten van alle gebruikers van digitale diensten worden beschermd.“

Omdat er verschillende wetgevingsprojecten tegelijk zijn gelanceerd, wordt de indruk gewekt dat „er nu veel dingen tegelijk worden geregeld“ - en dit zorgt voor onzekerheid, vooral bij mensen die niet dagelijks met digitaal recht te maken hebben.

De belangrijkste doelen volgens de EU

De belangrijkste doelstellingen van deze wetgevingspakketten kunnen als volgt worden samengevat:

- Bescherming tegen misbruikDe EU wil bijvoorbeeld de CSAR-ontwerp ervoor zorgen dat afbeeldingen van seksueel misbruik van kinderen online sneller worden herkend en verwijderd.

- Bescherming tegen desinformatie, verkiezingsinterferentie en sociale risico'sBij de DSA stelt expliciet dat het onder andere bedoeld is om de verspreiding van illegale inhoud en andere risico's te beperken.

- Pluralisme in de media, transparantie en eerlijke concurrentieMet de EMFA probeert de EU het medialandschap strenger te reguleren om invloed en concentratie te beperken.

- Regels voor kunstmatige intelligentie en etiketteringsvereistenDe AI-wet moet ervoor zorgen dat AI-systemen en de inhoud ervan in de toekomst transparant zijn - bijvoorbeeld in het geval van deepfakes of geautomatiseerde beslissingen.

- Eerlijke voorwaarden voor bedrijvenDe EU wil niet alleen de gebruikers beschermen, maar ook duidelijkheid en gelijke rechten voor iedereen. Spelregels voor providers (bijv. platforms). Een van de doelstellingen van de DSA is het creëren van een „gestandaardiseerde reeks regels en concurrentievoorwaarden voor bedrijven“.

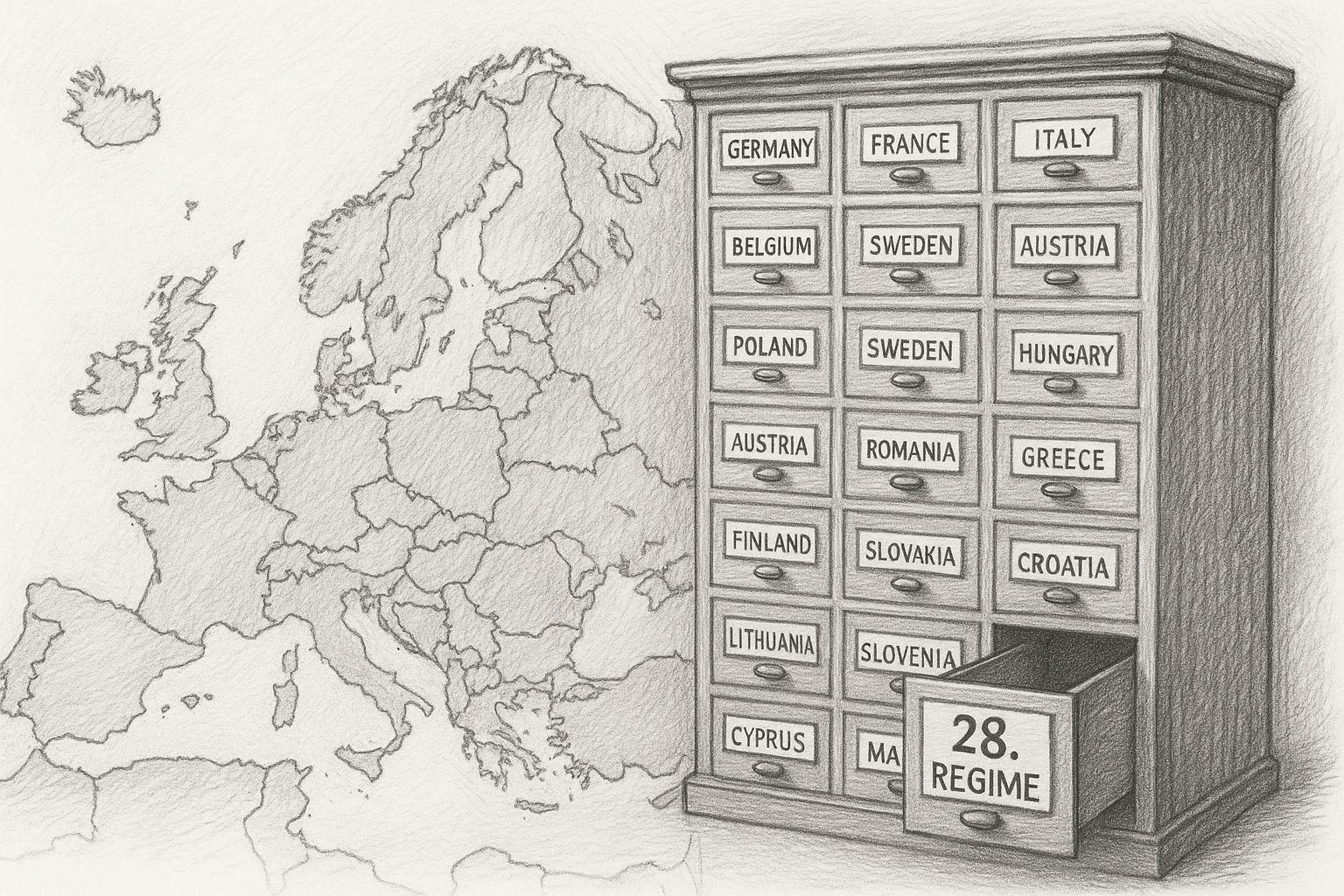

Waar staan we vandaag?

De huidige situatie kan als volgt worden samengevat:

- Met de DSADe voorschriften zijn al aangenomen, Aanbieders met een zeer groot aantal gebruikers („zeer grote online platforms“) zijn sinds 2023/24 onderworpen aan bijzonder strenge regels.

- Met CSAR („Chatcontrol“)Het voorstel werd in 2022 door de EU-Commissie gepresenteerd. Veel lidstaten en organisaties op het gebied van gegevensbescherming en burgerlijke vrijheden zijn echter scherpe kritiek. Het is dus nog niet afgerond.

- Met de EMFA en AI ActDe EMFA is formeel goedgekeurd en is vanaf bepaalde data van toepassing. De AI-wet is van kracht, maar veel verplichtingen zijn gespreid.

Belangrijk: Zelfs als er wetten zijn aangenomen, betekent dit niet dat alle vereisten onmiddellijk van toepassing zijn - er zijn vaak overgangsperioden, uitzonderingen of technische implementaties die nog openstaan. In dit eerste deel hebben we daarom uitgewerkt welke verordeningen van kracht zijn, wat de EU ermee wil bereiken en waar we op dit moment staan. In het volgende hoofdstuk gaan we specifiek in op de afzonderlijke belangrijke wetten - in eenvoudige bewoordingen, zodat het duidelijk wordt: „Wat is dit precies?“.“

Huidig onderzoek naar de geplande digitale EU-ID

Chatcontrole / CSAR - Bewaking van privécommunicatie

In 2022 presenteerde de verordening van de EU-Commissie ter voorkoming en bestrijding van seksueel misbruik van kinderen (CSAR) het voorstel, dat door velen als „Chatbesturing“ wordt genoemd. De kern: aanbieders van messenger-diensten, chatplatforms of andere digitale communicatiediensten worden verplicht om inhoud van seksueel misbruik van kinderen op te sporen, te melden en te verwijderen.

Het idee hierachter is begrijpelijk: Misbruik van online materiaal is een ernstig probleem en nationale wetten alleen zijn niet altijd effectief - de EU ziet dit als een gestandaardiseerde standaardeisen.

Maar hier begint de controverse: Sommige versies van het voorstel voorzien namelijk in het doorzoeken van communicatie, zelfs als deze end-to-end versleuteld is. In alledaagse termen betekent dit dat je privé chats, afbeeldingen of video's technisch geanalyseerd kunnen worden - voordat de berichtendienst ze versleutelt of doorstuurt. Critici spreken van massasurveillance.

De technologie is geavanceerd en riskant: hoe kun je misbruik echt herkennen zonder het risico te lopen op een verkeerde diagnose? Hoe kunnen gegevensbescherming en encryptie worden gegarandeerd? A Studie laat zien dat fout-positieven hoog kunnen zijn, vooral bij scannen vanaf de client.

Kortom, het voorstel combineert een legitiem beschermingsmandaat met aanzienlijke risico's voor de grondrechten. Voor burgers betekent dit dat privécommunicatie in de toekomst aan strengere controles kan worden onderworpen - zelfs als ze niets met misbruik te maken hebben. Voor kleine bedrijven betekent dit dat als u messenger-kanalen of communicatie met klanten beheert, u voorbereid moet zijn op de mogelijkheid van nieuwe wettelijke verplichtingen of technische audits.

| Aspect | Beschrijving van de |

|---|---|

| Naam | Verordening ter voorkoming en bestrijding van seksueel misbruik van kinderen (CSAR), beter bekend als „chatcontrole“.“ |

| Belangrijkste doelstelling volgens de EU | De onlineverspreiding van materiaal over seksueel misbruik van kinderen voorkomen, melden en verwijderen; een EU-meldpunt oprichten. |

| Wie wordt er het meest getroffen? | Aanbieders van communicatiediensten (messengers, chats, hostingplatforms, clouddiensten), in sommige gevallen ook aanbieders van versleutelde communicatie. |

| Centrale instrumenten | - (Gedeeltelijk) scannen van inhoud op bekende misbruikpatronen - Rapportageverplichtingen aan autoriteiten/EU-centrum - Verplichte of „vrijwillige“ controlemaatregelen afhankelijk van de risicoclassificatie |

| Huidige status | - Voorgestelde verordening in onderhandeling sinds 2022 - Sterke tegenstand van verschillende lidstaten en burgerrechtenorganisaties - Compromisteksten met „vrijwillige“ scanning worden besproken |

| Argumenten vóór | - Zonder geharmoniseerde EU-regels kan CSAM niet effectief worden bestreden - Aanbieders moeten verantwoordelijkheid nemen - Technische middelen zijn nodig om overtreders op te sporen |

| Argumenten van critici | - Gevaar van algemene bewaking van alle burgers - Verzwakking van end-to-end versleuteling („client-side scanning“) - Hoog aantal mogelijke valse alarmen en valse verdenkingen - Creëren van een permanente monitoringinfrastructuur die politiek uitbreidbaar is |

| Gevolgen voor burgers | - Privécommunicatie kan (gedeeltelijk) automatisch worden gecontroleerd - Onzekerheid met gevoelige inhoud (foto's, documenten, chats) - Risico op valse verdenkingen en gegevensopslag |

| Gevolgen voor het mkb | - Klantcommunicatie via gescande services is niet langer volledig privé - Mogelijke conflicten met gegevensbescherming en bedrijfsgeheimen - Behoefte aan maatwerk bij de selectie en het gebruik van communicatiekanalen |

Digital Services Act (DSA) - regels voor platforms en hun annuleringsverplichtingen

Met de Wet digitale diensten (DSA) heeft de EU een uitgebreide reeks regels opgesteld die in 2022 is aangenomen. Deze is vooral gericht op digitale diensten - hostingproviders, platforms, zoekmachines - met als doel het internet veiliger, transparanter en eerlijker te maken. De belangrijkste verplichtingen zijn

- Aanbieders moeten Systemen voor rapportage en herstel om gebruikers in staat te stellen illegale inhoud te melden (bijv. haatzaaien, terroristische propaganda, fraude).

- Platformen moeten hierop reageren, d.w.z. Inhoud verwijderen of toegang blokkeren, als ze illegale inhoud ontdekken.

- Voor „zeer grote“ platforms (bijv. meer dan 45 miljoen gebruikers in de EU) gelden strengere eisen: Risicoanalyses, auditing van aanbevelingsalgoritmen, openbaarmaking van moderatiepraktijken.

- TransparantieverplichtingenGebruikers moeten beter begrijpen waarom inhoud is verwijderd of geblokkeerd; platforms moeten hierover rapporteren.

Voor het dagelijks leven van een persoon betekent dit dat als je artikelen op platforms plaatst - bijvoorbeeld op sociale netwerken of fora - platforms in de toekomst strengere beslissingen zullen moeten nemen. In geval van twijfel kan inhoud sneller worden verwijderd.

Voor een klein bedrijf betekent dit dat als je website, forum of platform interactieve gebruikersbijdragen heeft, je zorgvuldig de gebruiksvoorwaarden, meldingsprocedures en verwijderingsprocessen moet controleren. Zelfs als je niet een van de echt grote platforms bent, kan er indirecte druk ontstaan, vooral door richtlijnen over hoe gebruikers beschermd moeten worden tegen schadelijke inhoud.

| Aspect | Beschrijving van de |

|---|---|

| Naam | Wet op de digitale diensten (DSA) - Verordening (EU) 2022/2065 |

| Belangrijkste doelstelling volgens de EU | - Veilige digitale ruimte voor gebruikers - Bescherming van grondrechten online - Gestandaardiseerde regels voor digitale diensten in de EU |

| Wie wordt er het meest getroffen? | - Overstapservices (toegang, caching, hosting) - Online platforms en marktplaatsen - Very Large Online Platforms„ (VLOP's) en zoekmachines met 45 miljoen gebruikers of meer in de EU |

| Centrale taken | - Meldkanalen voor illegale inhoud - Verplichting om snel te verwijderen na kennis - Transparantierapporten over moderatie - Risicoanalyses en audits voor zeer grote platforms - Samenwerking met „vertrouwde vlaggers“ |

| Huidige status | - Van kracht, al volledig effectief voor grote platforms - Commissie voert procedures tegen individuele aanbieders (bijv. wegens ontoereikende moderatie) |

| Argumenten vóór | - Platforms nemen verantwoordelijkheid voor de risico's van hun diensten - Meer transparantie over annulerings- en aanbevelingspraktijken - Betere bescherming tegen haat, fraude, desinformatie en illegale aanbiedingen |

| Argumenten van critici | - Gevaar van „overblocking“ (er wordt te veel verwijderd om straffen te voorkomen) - De facto privatisering van censuur: platforms bepalen wat zichtbaar blijft - Flexibele termen zoals „systeemrisico's“; politiek gevoelige inhoud kan worden uitgedund |

| Gevolgen voor burgers | - Berichten kunnen sneller worden geblokkeerd of onzichtbaar worden gemaakt - Formelere manieren om beslissingen aan te vechten - maar dat kost meer moeite - Filterbubbels worden niet noodzakelijkerwijs kleiner, de interventie is eerder „van bovenaf“.“ |

| Gevolgen voor het mkb | - Marketing en zichtbaarheid zijn nog meer afhankelijk van het algoritme van het platform - Inhoud over gevoelige onderwerpen (gezondheid, politiek, maatschappij) wordt eerder verwijderd - Aparte commentaargebieden vereisen meer moderatie en duidelijke regels |

Wet op de vrijheid van de Europese media (EMFA) - de nieuwe mediawet

De Wet op de vrijheid van de Europese media (EMFA) trad formeel in werking op 7 mei 2024 en zal volledig van toepassing zijn vanaf 8 augustus 2025: De EU wil de onafhankelijkheid en diversiteit van de media - d.w.z. uitgeverijen, omroepen, online media - waarborgen en tegelijkertijd nieuwe regels creëren voor samenwerking tussen media en platforms. Belangrijke inhoud:

- Bescherming van redactionele onafhankelijkheid en journalistieke bronnen.

- Transparantie over eigendomsstructuren van media, zodat het duidelijk is wie er achter een medium zit.

- Regulering van overheidsreclame en hoe overheden de media kunnen beïnvloeden via advertenties.

Een bijzonderheid: aanbieders van mediadiensten moeten worden beschermd tegen platforms, bijvoorbeeld zodat hun inhoud niet naar believen wordt onderdrukt door grote platforms.

Voor de gebruiker betekent dit dat er theoretisch een grotere diversiteit aan meningen en mediabronnen zou kunnen ontstaan, met duidelijke labeling en betere voorwaarden voor kwaliteitsmedia. Er zal echter ook een nieuw niveau van toezicht komen - platforms zullen in de toekomst extra voorzichtig moeten zijn met «erkende media».

Voor een klein bedrijf dat inhoud publiceert (bijv. blog, nieuwsbrief of online magazine), betekent dit dat je je in een andere orde bevindt waarin je inhoud verschillend kan worden beoordeeld - afhankelijk van of je als „medium“ wordt beschouwd of niet, en hoe platforms met dergelijke inhoud omgaan.

| Aspect | Beschrijving van de |

|---|---|

| Naam | Europese Mediavrijheidswet (EMFA) - Europese mediavrijheidswet |

| Belangrijkste doelstelling volgens de EU | - Bescherming van pluralisme in de media en redactionele onafhankelijkheid - Politieke invloed op de media beperken - Transparantie over eigendomsstructuren en staatsreclamefondsen |

| Wie wordt er het meest getroffen? | - Mediabedrijven (drukwerk, omroep, online) - Publiekrechtelijke instellingen - Platforms in de omgang met media-inhoud |

| Centrale instrumenten | - Europees orgaan voor mediadiensten (samenwerking van nationale regelgevende instanties) - Regels voor overheidsreclame en -promotie - Speciale behandeling van „erkende media“ door platforms (bijv. voorkeursbehandeling tijdens moderatie) |

| Huidige status | - Aangenomen, inwerkingtreding 2024 - Geldigheid van de belangrijkste bepalingen vanaf 2025 |

| Argumenten vóór | - Betere bescherming van gerenommeerde media tegen politieke druk - Transparantie tegen heimelijke beïnvloeding en mediaconcentratie - Bescherming van redactionele beslissingen tegen inmenging door eigenaars of staten |

| Argumenten van critici | - Gevaar van een „mediaprivilege“ voor staatsgetrouwe of gevestigde providers - Platforms komen in conflict tussen DSA-verplichtingen voor verwijdering en EMFA-privileges - Kleinere of alternatieve media zonder formele status kunnen worden bestraft |

| Gevolgen voor burgers | - Zichtbare inhoud kan sterker worden gekenmerkt door „erkende media“. - De scheidslijn tussen gevestigde media en onafhankelijk aanbod wordt scherper - Kritischere of nieuwe stemmen kunnen het moeilijker hebben om een bereik op te bouwen |

| Gevolgen voor het mkb | - Eigen content (blogs, tijdschriften, nieuwsbrieven) concurreert met bevoorrechte media-omgevingen - Samenwerking met media (reclame, gesponsorde inhoud) is strenger gereguleerd - Bedrijven die zelf als medium willen optreden, moeten aan aanvullende eisen voldoen |

AI-wet - regels voor kunstmatige intelligentie, deepfakes & co.

Met de Wet Kunstmatige Intelligentie (AI-wet) heeft de EU een van 's werelds eerste uitgebreide stukken wetgeving over AI-regulering opgesteld. Het is technologieneutraal ontworpen, d.w.z. niet alleen voor de huidige bekende AI-systemen, maar ook voor toekomstige ontwikkelingen. Het belangrijkste kenmerk is een risicogebaseerde aanpak: hoe groter het risico voor de grondrechten of de veiligheid, hoe strenger de verplichtingen. Voorbeelden:

- AI-systemen met onaanvaardbaar risico (bijv. sociale beoordelingssystemen) kunnen worden verboden.

- AI met hoog risico (bijv. applicatie- of biometrische systemen) zijn onderworpen aan strenge eisen.

- Andere AI-systemen moeten gelabeld bijvoorbeeld als inhoud automatisch is gegenereerd (bijv. deepfakes).

Voor burgers betekent dit dat als je in de toekomst inhoud tegenkomt, zoals een video of tekst die automatisch is gemaakt, deze inhoud kan worden gelabeld als „AI-gegenereerd“ - zodat je kunt herkennen wie of wat erachter zit. Voor bedrijven betekent dit dat als je AI-tools gebruikt - bijvoorbeeld in marketing, voor documentproductie, klantenservice - je moet controleren of je toepassing onder een risicocategorie valt, of er etiketteringsverplichtingen gelden en of er aan eisen moet worden voldaan.

| Aspect | Beschrijving van de |

|---|---|

| Naam | Wet op de kunstmatige intelligentie (AI-wet) - EU-verordening inzake de regulering van AI |

| Belangrijkste doelstelling volgens de EU | - Zorgen dat AI-systemen veilig en betrouwbaar zijn - Bescherming van grondrechten en consumenten - Innovatie bevorderen volgens duidelijke regels |

| Wie wordt er het meest getroffen? | - Aanbieders en beheerders van AI-systemen (van start-ups tot grote bedrijven) - Gebruikers die AI integreren in producten of diensten - Specifiek: fabrikanten van „AI met hoog risico“.“ |

| Risicocategorieën | - Verboden AI (bijv. bepaalde vormen van sociale beoordeling) - AI met hoog risico (bijv. biometrische systemen, bepaalde beslissingsondersteuning) - AI met transparantieverplichtingen (bijv. chatbots, deepfakes) - AI met minimaal risico (bijv. eenvoudige tools zonder diepgaande interventie in rechten) |

| Centrale taken | - Risicobeoordeling en documentatie - AI-gegenereerde inhoud in bepaalde gevallen labelen - Kwaliteits- en gegevensvereisten voor AI met hoog risico - Transparantie naar gebruikers (bijv. „U spreekt met een AI“) |

| Huidige status | - Aangenomen, wordt gefaseerd van kracht - Individuele verplichtingen zijn al van toepassing, andere zullen volgen in overgangsperioden |

| Argumenten vóór | - Bescherming tegen ondoorzichtige, oneerlijke of gevaarlijke AI-systemen - Vertrouwen opbouwen: Gebruikers weten wanneer AI in het spel is - Minimumnormen voor kwaliteit en gegevensbeveiliging |

| Argumenten van critici | - Complexiteit en bureaucratie, vooral voor kleine aanbieders - Onzekerheid over de vraag of een aanvraag „hoog risico“ is of niet - Risico dat innovatie en AI-ontwikkeling verschuiven naar minder gereguleerde regio's - Remmingsdrempel voor KMO's om AI überhaupt te gebruiken |

| Gevolgen voor burgers | - Meer labeling van AI-inhoud (teksten, afbeeldingen, video's) - Betere bescherming voor geautomatiseerde besluiten, maar ook meer formaliteit - Bewuster omgaan met „machinaal gegenereerde“ informatie |

| Gevolgen voor het mkb | - Noodzaak om het gebruik van AI te documenteren (intern en extern) - Mogelijke etiketteringsverplichtingen in marketing- of klantencontact - Er kan advies nodig zijn om risico's en verplichtingen correct te categoriseren - Wie goed voorbereid is, kan AI nog steeds gebruiken als concurrentievoordeel |

Een tijdlijn van de belangrijkste stappen

2022-2023: De fase van grote voorstellen

Tijdens deze fase werden verschillende belangrijke voorstellen officieel geïntroduceerd: de Digital Services Act (DSA), de Verordening ter voorkoming en bestrijding van seksueel misbruik van kinderen (CSAR, ook bekend als „Chat Control“) en de Europese Media Freedom Act (EMFA).

- In de Mei 2022 presenteerde de EU-Commissie het CSAR-voorstel om online afbeeldingen van seksueel misbruik van kinderen te bestrijden.

- Op 23 april 2022 er werd een politiek akkoord bereikt tussen het Parlement en de Raad over het DSA-initiatief.

- In de Juni/december 2023 onderhandelingen en er werd overeenstemming bereikt over het EMFA-ontwerp.

Europese Raad

Het speelveld werd daarom in dit stadium afgebakend: de EU besloot dat er uitgebreidere digitale regels nodig waren.

2024: De eerste wetten worden van kracht

De implementatiefase begon in 2024: sommige verordeningen zijn aangenomen, andere worden voorbereid voor toepassing.

- De DSA formeel van kracht werd (Verordening (EU) 2022/2065) en veel diensten zich moesten voorbereiden op naleving.

- De EMFA formeel is aangenomen (bijv. 26 maart 2024 door de Raad) en de streefdoelen voor de tenuitvoerlegging zijn vastgesteld.

- Op de CSAR De situatie blijft echter onzeker: de tijd tot een definitief besluit is al verschillende keren verlengd. Zo werd de overgangsmaatregel verlengd tot 3 april 2026.

Deze fase werd gekenmerkt door overgangsperiodes, voorbereidingen en politieke geschillen - de klok tikt, maar nog niet alles is actief.

2025: De beslissende fase

In 2025 zullen er belangrijke beslissingen moeten worden genomen.

- De DSA plichten voor zeer grote platforms („VLOP's“) worden steeds meer van kracht; de termijnen verstrijken.

- De EMFA is volledig van toepassing - veel bepalingen zijn van toepassing vanaf een bepaalde datum.

- Op de CSAR Een beslissing ligt in het verschiet: Sommige lidstaten hebben verzet aangekondigd, stemmingen zijn uitgesteld of geblokkeerd.

Voor burgers en bedrijven wordt het tastbaarder: niet langer slechts „wetsvoorstellen“, maar „regelgeving waaraan men zich moet aanpassen“.

2026 en later: wat is te verwachten

De volgende stappen zijn ook relevant na 2025. Aanvullende technische normen kunnen nog steeds van toepassing zijn op de DSA: de EU-Commissie houdt toezicht op de uitvoering en de gevolgen. Er kan een definitieve verordening volgen voor de CSAR - of het voorstel kan aanzienlijk worden gewijzigd of uitgesteld. Verdere bijzondere bepalingen zullen van toepassing zijn op de EMFA, bijvoorbeeld inzake samenwerking tussen mediaplatforms, interfaces of reclame.

Over het algemeen wordt verwacht dat hoe complexer de digitale infrastructuur wordt (AI, platforms, communicatie), hoe meer regelgeving nodig zal zijn. Voor de lezer betekent dit dat het onderwerp niet afgesloten is - het zal deel gaan uitmaken van ons dagelijks digitale leven. Voorbereiding en aandacht zijn daarom aan te raden.

Vrijheid van meningsuiting in gevaar: EU-wet digitale diensten | WELT nieuwskanaal

Wat betekent dit voor kleine en middelgrote ondernemingen?

Bedrijven zoals Meta, Google en Microsoft hebben hun eigen juridische afdelingen, dataprotectieteams en compliance officers. Kleine en middelgrote ondernemingen (KMO's) over het algemeen niet. Toch heeft de nieuwe EU-regelgeving ook gevolgen voor hen - soms direct, vaak indirect via de gebruikte platforms, tools en communicatiekanalen.

In het volgende hoofdstuk wordt bekeken wat deze ontwikkelingen concreet kunnen betekenen voor kleinere bedrijven: van eenmanszaken tot KMO's met 50 of 200 werknemers.

Meer regels op de achtergrond - zelfs als je ze niet meteen ziet

Veel van de nieuwe regels - bijvoorbeeld in de Digital Services Act (DSA) of de AI-wet - zijn officieel vooral gericht op „zeer grote“ platforms of bepaalde AI-aanbieders. Toch hebben de gevolgen ook gevolgen voor kleinere bedrijven:

- over de platforms waarop ze adverteren of inhoud publiceren,

- over de tools die ze gebruiken (bijv. AI-systemen, nieuwsbriefsoftware, chatsystemen),

- en over communicatieverplichtingen die geleidelijk ook voor kleinere aanbieders ontstaan.

Voorbeeld: De DSA verplicht online platforms om illegale inhoud efficiënt te verwijderen en transparantie te creëren. Voor kleine bedrijven die klanten bereiken via Facebook, Instagram, YouTube of marktplaatsen op platforms betekent dit dat inhoud sneller dan voorheen kan worden verwijderd of beperkt - zelfs als ze zelf aan de wet voldoen.

Concrete effecten in het dagelijks leven van een KMO

1. commentaarkolommen, forums en klantbeoordelingen

Veel bedrijven gebruiken tegenwoordig:

- Blogartikel met commentaarsectie

- Fora of ondersteuningsgemeenschappen

- Beoordelingsfuncties of gastenboeken

- Sociale mediakanalen met reacties

De nieuwe regels verhogen de druk om de inhoud van gebruikers in de gaten te houden:

- Klachten moeten serieus worden genomen en nauwkeurig worden onderzocht.

- Uiteraard illegale inhoud moeten snel worden verwijderd om aansprakelijkheidsproblemen te voorkomen.

- Platformen zelf gevoeliger reageren: een shitstorm met borderline-inhoud kan sneller leiden tot bans, verlies van bereik of blokkades.

- Voorstanders zeggenDit is logisch omdat het duidelijke verantwoordelijkheden schept. Iedereen die een openbaar platform aanbiedt (zelfs een klein forum) moet misbruik voorkomen. Voor gerenommeerde aanbieders is dit geen nadeel, maar een teken van kwaliteit.

- Critici spreken dit tegenKleine bedrijven hebben noch de tijd noch het personeel om commentaren wettelijk te beoordelen of voor te bereiden op moderatie. Ze zijn bang om commentaarfuncties volledig uit te schakelen uit angst voor problemen - wat de open dialoog op het internet verder verarmt.

2. communicatiekanalen: E-mail, Messenger en „Chatcontrol“.“

De geplande verordening ter bestrijding van kindermisbruik (CSAR, „Chatcontrol“) is formeel gericht op aanbieders van communicatiediensten die misbruikmateriaal moeten opsporen en melden. Voor traditionele KMO's betekent dit niet dat ze meteen hun eigen scanners moeten opzetten. Maar:

- Velen gebruiken messengerdiensten (WhatsApp, Signal, Teams, Slack, enz.) zowel intern als in de communicatie met klanten.

- Als deze diensten Inhoud scannen (of moeten scannen), is bedrijfscommunicatie mogelijk niet meer zo vertrouwelijk als vroeger.

- Bijzonder delicaatDossiers, projectdocumenten, concepten, vertrouwelijke informatie die via dergelijke kanalen wordt doorgegeven.

- Voorstanders bewerenZonder dergelijke maatregelen zou het bestrijden van kindermisbruik online nauwelijks mogelijk zijn. Bedrijven die netjes werken hebben niets te vrezen - integendeel, ze profiteren van een veiligere digitale omgeving.

- Critici tegenDe technische implementatie (bijv. „client-side scanning“) kan encryptie praktisch opheffen en een infrastructuur creëren die gebruikt kan worden om elk type inhoud te controleren - misbruik vandaag, mogelijk politieke of economische kwesties morgen. Bedrijfsgeheimen en klantgegevens lopen gevaar omdat er extra interfaces worden gecreëerd waardoor gegevens kunnen uitlekken of misbruikt kunnen worden. Valse alarmen (valse verdenkingen) kunnen schadelijk zijn voor de reputatie van bedrijven en werknemers, zelfs als er in werkelijkheid niets verkeerd is gedaan.

3 AI in het bedrijf: Etikettering, documentatie en aansprakelijkheid

Met de AI-wet introduceert de EU een risicogebaseerd kader: Afhankelijk van het toepassingsgebied gelden verschillende verplichtingen. Drie gebieden zijn met name relevant voor KMO's:

- Marketing en communicatieAls teksten, afbeeldingen of video's worden gemaakt met AI - zoals blogartikelen, berichten op sociale media of productafbeeldingen - kunnen etiketteringsverplichtingen van toepassing zijn (bijv. „Deze inhoud is gemaakt met ondersteuning van AI“), vooral als het gaat om politiek gevoelige gebieden of deepfakes.

- Klantenservice en besluitvormingsprocessenChatbots of geautomatiseerde besluitvormingssystemen (scoring, selectie van sollicitanten, risicobeoordeling) kunnen in de categorie „AI met hoog risico“ vallen, afhankelijk van hun kenmerken, met strikte documentatie- en transparantieverplichtingen.

- Interne hulpmiddelen en analysesZelfs als externe leveranciers AI-functies integreren (bijv. CRM-systemen, boekhouding, ERP), kan het bedrijf verantwoordelijk worden gehouden als het beslissingen neemt op basis van AI-aanbevelingen.

- Voorstanders zeggenDe AI-wet beschermt klanten en burgers tegen ondoorzichtige of oneerlijke beslissingen. Het dwingt aanbieders zorgvuldigheid, kwaliteit en transparantie te betrachten - wat uiteindelijk ook ten goede komt aan gerenommeerde kleine en middelgrote bedrijven die AI op verantwoorde wijze gebruiken.

- Critici wijzen opVoor kleinere bedrijven wordt de regelgeving al snel verwarrend. Ze weten vaak niet of hun gebruik van AI al binnen het gereguleerde gebied valt of niet. Het risico bestaat dat het mkb zich vanwege de onzekerheid liever helemaal niet aan AI waagt - en dus een innovatienadeel accepteert ten opzichte van grotere bedrijven. In de praktijk kunnen documentatie- en etiketteringsverplichtingen een bureaucratisch monster worden dat zonder gespecialiseerd advies bijna niet bij te houden is.

4. reputatierisico's: zichtbaarheid, blokkering en „algoritmedruk“.“

De DSA zet platforms onder grotere druk: ze moeten laten zien dat ze risico's zoals desinformatie, haatzaaien of juridisch problematische inhoud serieus bestrijden. Voor bedrijven betekent dit

- Inhoud die controversiële onderwerpen aansnijdt (gezondheid, politiek, veiligheid, crises, samenleving) kunnen sneller naar beneden worden bijgesteld - d.w.z. minder zichtbaar zijn.

- Accounts kunnen tijdelijk vergrendeld, bijdragen verwijderd of reclamecampagnes geblokkeerd wanneer platforms „risico's“ zien - zelfs als de inhoud niet duidelijk illegaal is.

- De grens tussen legitieme kritiek en „problematische inhoud“ wordt dus vager - en is in de praktijk in handen van de respectievelijke platform moderatie.

- Voorstanders bewerenPlatformen moeten hun verantwoordelijkheid nemen. Zonder effectieve mechanismen zouden desinformatie en haatzaaiende taal ongecontroleerd blijven. Bedrijven die fatsoenlijke inhoud bieden, hebben op de lange termijn meer te winnen: een schonere omgeving en meer vertrouwen.

- Critici zien echtern: Een sterke neiging tot overblocking: uit angst voor boetes verwijderen platforms liever te veel dan te weinig.

Dit kan vooral gevolgen hebben voor kleinere bedrijven, die afhankelijk zijn van zichtbaarheid maar geen lobby hebben om beslissingen aan te vechten.

De „algoritmedruk“ leidt ertoe dat inhoud wordt aangepast aan vermeende richtlijnen om geen negatieve aandacht te trekken - wat neerkomt op sluipende zelfcensuur.

Huidig onderzoek naar de geplande digitale euro

Wie bepaalt wat „informatie“ is en wat „desinformatie“?

Als je naar de nieuwe EU-regels kijkt, valt één woord altijd op: Desinformatie. Het moet worden bestreden - door middel van platformverplichtingen, risicobeoordelingen of algoritmische interventies. Maar het cruciale punt wordt zelden gemaakt: Wie definieert wat desinformatie is?

Deze vraag staat centraal, omdat het bepaalt of beschermende maatregelen echt bescherming bieden - of dat ze onbedoeld leiden tot de controle van publieke debatten. In theorie lijkt het eenvoudig:

- Valse beweringen = Desinformatie,

- juiste beweringen = Informatie.

In de praktijk is de wereld echter zelden zo duidelijk. Veel onderwerpen zijn complex, onduidelijk, controversieel of voortdurend in ontwikkeling. Studies veranderen, experts discussiëren, nieuwe feiten duiken op. Wat de ene dag als verkeerd wordt beschouwd, kan de volgende dag plots opnieuw geëvalueerd worden - denk maar aan politieke voorspellingen, gezondheidsdebatten of nieuwe technologische risico's.

Daarom waarschuwen veel critici tegen het behandelen van „desinformatie“ als een vaste term. Ze benadrukken dat het vaak minder gaat om duidelijke feiten dan om een interpretatie die wordt gevormd door de respectievelijke politieke of sociale situatie.

Platforms nemen praktische beslissingen - maar onder druk

Formeel zijn het platformen die moeten beslissen of iets mogelijk desinformatie is, omdat ze verantwoordelijk worden gehouden voor risico's onder de Wet Digitale Diensten. Maar platforms handelen niet in een vacuüm. Ze staan onder verschillende soorten druk:

- Juridische drukHoge boetes als „risico's“ niet voldoende worden beperkt.

- Politieke drukVerwachting om meer of minder gewicht te geven aan bepaalde verhalen.

- Publieke drukCampagnes, verontwaardiging, mediaberichten die beslissingen over moderatie beïnvloeden.

- Financiële drukOnafhankelijke moderatie kost tijd, geld en personeel - geautomatiseerde oplossingen zijn goedkoper, maar vaak foutgevoeliger.

Onder deze omstandigheden hebben platforms de neiging om bij twijfel eerder te veel dan te weinig te verwijderen of te beperken. Dit betekent dat zij de facto bepalen wat zichtbaar blijft - zelfs als zij niet de feitelijke wetgever zijn.

De rol van overheden en autoriteiten

Een ander punt is dat overheden of staatsagentschappen steeds meer betrokken raken bij deze processen - bijvoorbeeld in de vorm van:

- „Vertrouwde vlaggers“

- Rapportagecentra

- Adviescentra voor platforms

- Beoordeling van „systeemrisico's“

Dit creëert een systeem waarin staatsinstellingen indirect kunnen beïnvloeden welke inhoud als problematisch wordt gecategoriseerd. Dit hoeft niet per se misbruik op te leveren - maar het creëert een structuur die vatbaar is voor misbruik als later andere politieke meerderheden de overhand krijgen.

Het gevaar van een „verschuiving in wat gezegd kan worden“

Wanneer platforms inhoud sorteren op basis van vage termen zoals „manipulatie“, „sociale risico's“ of „desinformatie“, vindt er op de lange termijn een culturele verschuiving plaats:

- Mensen uiten zich voorzichtiger, bedrijven vermijden bepaalde onderwerpen, kritische stemmen verliezen aan zichtbaarheid.

- Het resultaat is geen openlijk verbod, maar een sluipende onzichtbaarheid. Inhoud verdwijnt niet, maar bereikt bijna niemand.

Veel critici zien dit niet als gerichte censuur, maar eerder als een neveneffect dat net zo effectief is: wat gezegd kan worden verschuift, simpelweg omdat elke acteur moet leren wat „wenselijk“ of „belastend“ is van de platforms.

Wie het over desinformatie heeft, moet het ook over macht hebben.

Vandaag de dag ligt de beslissing over wat waar, onwaar, toelaatbaar of gevaarlijk is niet langer alleen bij de wetenschap, de journalistiek of het democratisch debat, maar steeds meer bij een mengeling van die twee:

- Platformen

- Algoritmen

- Overheidsinstellingen

- Moderatieteams

- externe auditors

- en sociale druk

Juist daarom is het belangrijk om deze ontwikkeling niet alleen in technische of juridische termen te bekijken, maar ook cultureel. Uiteindelijk gaat het immers om iets heel fundamenteels: hoe vrij kan een samenleving spreken als niemand duidelijk kan zeggen wie bepaalt wat waar en onwaar is - en volgens welke normen?

EU-wetgeving censureert het internet (DSA - Digital Services Act) | Prof. dr. Christian Rieck

Voorstanders vs. critici - de confrontatie

Om de spanningen duidelijk te maken, is het de moeite waard om een directe vergelijking te maken. Wat supporters benadrukken:

- Veiligheid en beschermingKinderen, consumenten, democratische processen - ze hebben allemaal een modern juridisch schild nodig.

- Juridische duidelijkheid: Gestandaardiseerde regels in de EU besparen bedrijven de lappendeken van speciale nationale benaderingen. Wie zich aan duidelijke richtlijnen houdt, heeft minder rechtsonzekerheid.

- EerlijkheidGrote platforms en AI-aanbieders mogen geen „free riders“ zijn die winst binnenharken en risico's afwentelen op de maatschappij. Regelgeving zoals de DSA en de AI-wet zouden hier orde scheppen.

- VertrouwenOp langere termijn zou het vertrouwen in digitale diensten moeten toenemen als gebruikers weten dat er regels gelden en worden gecontroleerd.

Wat critici benadrukken:

- Risico's in verband met grondrechtenChatcontrole en soortgelijke maatregelen creëren een technische infrastructuur die in de toekomst gebruikt zou kunnen worden om alle digitale communicatie te controleren - zelfs verder dan het oorspronkelijke doel.

- Bureaucratische overbelastingKleine bedrijven hebben noch de middelen, noch de knowhow om de groeiende catalogus van verplichtingen (etikettering, documentatie, moderatie, rapporteringskanalen) naar behoren en permanent na te leven.

- Geprivatiseerde censuurHoge boetes veranderen platforms in „hulpsheriffs“ die in geval van twijfel meer verwijderen dan nodig is - ten koste van de vrijheid van meningsuiting en de diversiteit van het debat. KMO's die gedijen op bereik kunnen zonder waarschuwing het onderspit delven.

- Belemmering voor innovatieIn plaats van te durven experimenteren, vertragen veel kleine bedrijven zichzelf omdat ze bang zijn iets verkeerd te doen. Als je geen risico's neemt, ga je niet de fout in - maar blijf je ter plaatse.

- MachtsverschuivingUiteindelijk zullen degenen die het beste met de regels en voorschriften kunnen omgaan, zegevieren - grote bedrijven met juridische afdelingen en compliance teams. Kleine bedrijven moeten zich aan hun regels houden omdat ze afhankelijk zijn van hun infrastructuur.

Conclusie vanuit het perspectief van een klein of middelgroot bedrijf

Het belangrijkste voor een normale KMO:

- Ken de basis zonder in elk detail te verdwalen.

- Controleer je eigen communicatiekanalen (commentaren, sociale media, nieuwsbrieven, messenger) en bepaal bewust wat je echt nodig hebt - en waar je bewust vermindert.

- Documenteer het gebruik van AI en communiceer bij twijfel openlijk in plaats van het later te moeten uitleggen.

- Blijf kalm, maar let op: het heeft geen zin om niets te doen vanwege alle wetten. Het is belangrijk om stap voor stap na te denken: „Waar heeft dit echt invloed op mij?“ - en daar solide oplossingen te vinden.

De belangrijkste zorg van de critici kan in één zin worden samengevat: Het is niet de individuele wet die het probleem is, maar de interactie van vele regels die geleidelijk een digitale omgeving creëert waarin controle en conformiteit worden beloond - en onafhankelijke, kritische stemmen het moeilijker hebben.

Wat blijft er over voor gewone burgers en kleine bedrijven?

Als je naar al deze ontwikkelingen kijkt, wordt het duidelijk dat de EU orde probeert te scheppen in een digitale wereld die gedurende vele jaren grotendeels ongereguleerd is gebleven. Op papier klinken de doelstellingen begrijpelijk - bescherming, veiligheid, transparantie. Maar tegelijkertijd wordt ons dagelijkse digitale leven langzaam maar zeker omgeven door een dicht netwerk van regels, testmechanismen en technische vereisten.

Voor grote bedrijven is dit een kwestie van middelen. Ze huren advocaten in, passen hun processen aan en investeren in nieuwe hulpmiddelen. Voor gewone burgers en kleine of middelgrote bedrijven voelt deze ontwikkeling daarentegen vaak verwarrend, soms zelfs bedreigend - niet omdat ze iets te verbergen hebben, maar omdat ze voelen dat de aard van digitale communicatie verandert.

Wat gewone burgers moeten overwegen

- Blijf alert zonder jezelf gek te maken. We hoeven niet in paniek te raken, maar we moeten ons er wel van bewust zijn dat communicatie in de digitale ruimte in toenemende mate wordt gecontroleerd en gefilterd - niet noodzakelijkerwijs door mensen, maar door systemen, algoritmen en geautomatiseerde controles.

- Je eigen informatiekanalen onderhouden. Hoe meer inhoud wordt gefilterd en gesorteerd, hoe belangrijker het wordt om bewust gebruik te maken van verschillende informatiebronnen. Niet alleen sociale netwerken, maar ook traditionele media, gespecialiseerde portals en onafhankelijke nieuwsbrieven.

- Bewust communiceren. Je hoeft niet elke gedachte openbaar te maken. Maar het helpt om te beseffen dat platforms bij twijfel eerder geneigd zijn om te verwijderen dan om weg te gaan. Dat betekent niet dat je jezelf kleineert - maar je moet wel begrijpen hoe de mechanismen werken.

- Vertrouw niet elke AI - Maar wees er ook niet bang voor. Als content in de toekomst wordt gelabeld als AI-gegenereerd, kan dit mensen helpen om niet alles klakkeloos aan te nemen. Tegelijkertijd moeten we ons er niet van laten weerhouden om AI-tools verstandig te gebruiken - met gevoel voor verhoudingen.

Wat kleine en middelgrote ondernemingen moeten overwegen

- Bewust structuur aanbrengen in communicatie en aanwezigheid op het platform. Commentaarsecties, ondersteuningsforums, sociale mediakanalen - deze kunnen allemaal nuttig zijn, maar moeten goed worden onderhouden. De nieuwe regelgeving dwingt bedrijven om verantwoordelijkheid te nemen, maar dit kan professioneel worden aangepakt.

- AI-gebruik documenteren. Niet elk hulpmiddel is problematisch, maar bedrijven moeten weten waar AI wordt gebruikt - en dit bij twijfel openlijk communiceren. Dit schept vertrouwen en voorkomt misverstanden.

- Duidelijke interne regels opstellen. Welke inhoud wordt gepubliceerd? Wie controleert klachten? Welke platforms gebruik je echt actief? Een duidelijke structuur neemt veel onzekerheid weg.

- Verlies je eigen weg niet. Vooral kleine bedrijven gedijen op hun persoonlijkheid, hun kenmerkende stijl en hun directe klantenrelaties. Geen enkele wet dwingt hen dit te verliezen. Integendeel - in een wereld vol geautomatiseerde processen lijkt oprechte menselijkheid tegenwoordig bijna een concurrentievoordeel.

Onduidelijk effect in een noodgeval: Wat gebeurt er in geval van spanning?

Tot nu toe is het volstrekt onduidelijk hoe het hele pakket EU-wetten op het gebied van censuur - van de Digital Services Act tot uitgebreide controlebevoegdheden - zou uitpakken in een daadwerkelijk spanningsgeval. Tot nu toe is er geen betrouwbare ervaring over hoe de vele bepalingen in de praktijk op elkaar zullen inwerken als nationale regeringen plotseling verregaande ingrepen in communicatie- en informatievrijheden rechtvaardigen met een verwijzing naar externe dreigingen of hybride aanvallen.

Het is op dit moment noch voor burgers noch voor bedrijven duidelijk welke beperkingen in een noodsituatie van kracht zouden kunnen worden, welke mechanismen er bestaan om zich te verdedigen - of dat individuele maatregelen zelfs automatisch van kracht zouden worden in een noodsituatie.

Een diepgaande blik op mogelijke scenario's in een binnenlandse noodtoestand is te vinden in het artikel over de Spanningsverlies in Duitsland - een perspectief dat tot nu toe onvoldoende is belicht in het huidige politieke debat.

Een laatste gedachte

De digitale toekomst wordt gekenmerkt door regels. Dat is onvermijdelijk - en op veel gebieden noodzakelijk. Maar de doorslaggevende factor is hoe we er als burgers en ondernemers mee omgaan. Wie geïnformeerd blijft, bewust communiceert en zich niet laat intimideren door ingewikkelde termen, behoudt zijn vrijheid - zelfs in een zwaarder gereguleerde omgeving.

Misschien is dat wel de echte boodschap: vertrouw niet blindelings, verwerp niet blindelings. Begrijp in plaats daarvan de dingen, categoriseer ze - en beslis dan voor jezelf welk pad je wilt nemen.

Veelgestelde vragen

- Wat wil de EU precies bereiken met deze nieuwe digitale wetten?

De EU wil het internet veiliger maken, misbruik tegengaan, de verspreiding van illegale inhoud tegengaan en de transparantie over media en digitale diensten vergroten. Het idee hierachter is dat het huidige wettelijke kader niet langer toereikend is omdat digitale diensten nu een enorme impact hebben op de samenleving en de democratie. De doelstellingen lijken begrijpelijk, maar de geplande middelen om ze te bereiken zijn verstrekkend en soms controversieel. - Waarom hebben sommige mensen het over „censuurwetten“, hoewel de EU dit ontkent?

De term komt voort uit de zorg dat hoge boetes en onduidelijke definities („systeemrisico's“, „desinformatie“) ertoe zullen leiden dat platforms uit voorzorg inhoud zullen verwijderen. Dit creëert in feite een geprivatiseerde vorm van censuur, ook al wordt het officieel niet zo genoemd. Critici zien het probleem niet zozeer in de wettekst zelf, maar in de manier waarop platforms erop reageren. - Wat maakt Chatcontrol of CSAR zo controversieel?

Omdat deze wet het mogelijk maakt om privécommunicatie automatisch te scannen. In technische termen betekent dit vaak „client-side scanning“, waarbij de inhoud wordt gecontroleerd voordat deze wordt versleuteld. Critici zeggen dat dit een infrastructuur creëert die in principe elke communicatie kan controleren - ongeacht of je iets illegaals doet of niet. - Is er al besloten over Chatcontrol?

Nee. Er is massale weerstand, vooral vanuit Duitsland en andere EU-landen. Het ontwerp zit politiek in een impasse en delen ervan zijn verschillende keren herzien. Maar het is ook niet van tafel - het blijft boven de onderhandelingen hangen. - Wat betekent de Digital Services Act (DSA) voor gewone mensen?

Bijdragen, opmerkingen of berichten op grote platforms kunnen sneller worden verwijderd als platforms iets categoriseren als mogelijk illegaal of riskant. Gebruikers moeten erop voorbereid zijn dat het algoritmische „filter“ strenger wordt. Tegelijkertijd zijn er meer transparantierechten - het is makkelijker om uit te zoeken waarom een bericht is geblokkeerd. - Welke gevolgen heeft de DSA voor kleine en middelgrote ondernemingen?

Bedrijven die sociale media gebruiken, blogcommentaren toestaan of online winkelplatforms gebruiken, worden indirect beïnvloed. Hun inhoud kan gemakkelijker onderworpen worden aan beperkingen - en ze moeten meer aandacht besteden aan hun eigen moderatie. Fouten in commentaren of forums kunnen leiden tot juridische problemen. - Wat regelt de nieuwe Media Freedom Act (EMFA)?

Het is bedoeld om de onafhankelijkheid en diversiteit van de media te beschermen. Dit betekent ook dat platforms erkende media niet zonder goede reden mogen degraderen of blokkeren. Critici vrezen echter dat dit een soort mediahiërarchie zal creëren waarin gevestigde media worden bevoordeeld en alternatieve stemmen worden benadeeld. - Kan een bedrijf „bevoorrechte“ zichtbaarheid verliezen via de EMFA?

Ja - niet direct, maar indirect. Inhoud van kleine blogs of bedrijfswebsites concurreert met „erkende media“ waarvan de zichtbaarheid algoritmisch wordt beschermd. Dit kan betekenen dat bedrijfscontent minder prominent op platforms verschijnt omdat platforms voorzichtiger moderatiestrategieën voor media moeten toepassen. - Wat verandert de AI-wet voor burgers?

In de toekomst zal veel AI-inhoud - afbeeldingen, teksten, video's - moeten worden gelabeld als AI-gegenereerd. Dit is bedoeld om transparantie te creëren zodat mensen kunnen herkennen of een mens of een algoritme de auteur is. Dit is vooral belangrijk voor politieke onderwerpen of onderwerpen die gevoelig zijn voor manipulatie. - En wat betekent de AI-wet voor bedrijven?

Bedrijven moeten nagaan of en hoe ze AI gebruiken: in marketing, klantenservice of intern. Afhankelijk van het risiconiveau moeten ze documenteren, labelen of uitleggen hoe AI wordt gebruikt. Dit kan extra werk betekenen, maar beschermt ook tegen juridische problemen op de lange termijn. - Waarom is de combinatie van al deze wetten zo belangrijk?

Want elke wet heeft zijn eigen functie, maar alleen als ze samenwerken hebben ze een grotere impact: toezicht op privécommunicatie (CSAR), meer platformcontrole (DSA), mediahiërarchieën (EMFA) en AI-etiketteringsvereisten (AI-wet). Critici zeggen dat dit een omgeving creëert waarin controle, conformiteit en voorzichtigheid domineren - met gevolgen voor debat, creativiteit en vrijheid. - Wat adviseren experts gewone burgers om te doen als ze met deze veranderingen te maken krijgen?

Blijf kalm, maar oplettend. Onderhoud je eigen informatiekanalen, laat niet alles over aan één platform en ga bewust om met privé of gevoelige inhoud. Het is belangrijk om te begrijpen dat digitale communicatie niet langer „neutraal“ wordt gemodereerd, maar steeds meer door regels wordt gecontroleerd. - Hoe kunnen burgers zich verdedigen tegen verkeerde beslissingen van platforms?

De DSA geeft je nieuwe rechten: je kunt moderatiebeslissingen aanvechten, klachten indienen en een motivering eisen. Dit is een vooruitgang, maar vergt tijd, doorzettingsvermogen en soms juridische ondersteuning. - Welke specifieke voorbereidingen moeten kleine bedrijven de komende jaren treffen?

Ze moeten duidelijke interne communicatieregels opstellen, commentaargebieden beter controleren, AI-gebruik documenteren en nagaan welke platforms ze echt nodig hebben. Het is de moeite waard om niet alles wat intern geregeld kan worden openbaar te maken. - Wie zijn de serieuze critici van deze wetten?

Patrick Breyer (Europees Parlement), European Digital Rights (EDRi), de messenger app Signal, IT-beveiligingsonderzoekers en talrijke mediarechtexperts. Hun kritiek is minder gebaseerd op ideologie dan op technische en constitutionele bezwaren. - Gaan al deze wetten uiteindelijk over censuur?

Dat hangt af van wie je het vraagt. Voorstanders zeggen dat het gaat om veiligheid en orde. Critici zeggen: zelfs als „censuur“ niet in de wet staat, zorgen verplichtingen, straffen en risicomijding voor een feitelijke beperking van de zichtbaarheid en vrijheid. De waarheid ligt er waarschijnlijk ergens tussenin - maar de trend is duidelijk: communicatieruimtes worden steeds meer gereguleerd. - Zijn deze nieuwe regels gevaarlijk voor de democratie?

Niet per se - maar ze kunnen dat wel worden als ze later verkeerd worden geïmplementeerd of politiek worden uitgebreid. Democratie gedijt bij open debat, kritiek en diversiteit. Als platforms uit angst te veel verwijderen of als communicatiekanalen worden gecontroleerd, kan dit de democratische cultuur verzwakken. - Hoe moet een bedrijf of burger op de lange termijn reageren?

De beste manier is een combinatie van weloverwogen kalmte en praktische voorbereiding. Je moet je niet laten intimideren, maar je moet ook niet naïef zijn. Als je je communicatiekanalen verstandig kiest, transparantie creëert en je eigen gegevens beschermt, blijf je in staat om te handelen - zelfs in een omgeving die steeds meer gereguleerd wordt.