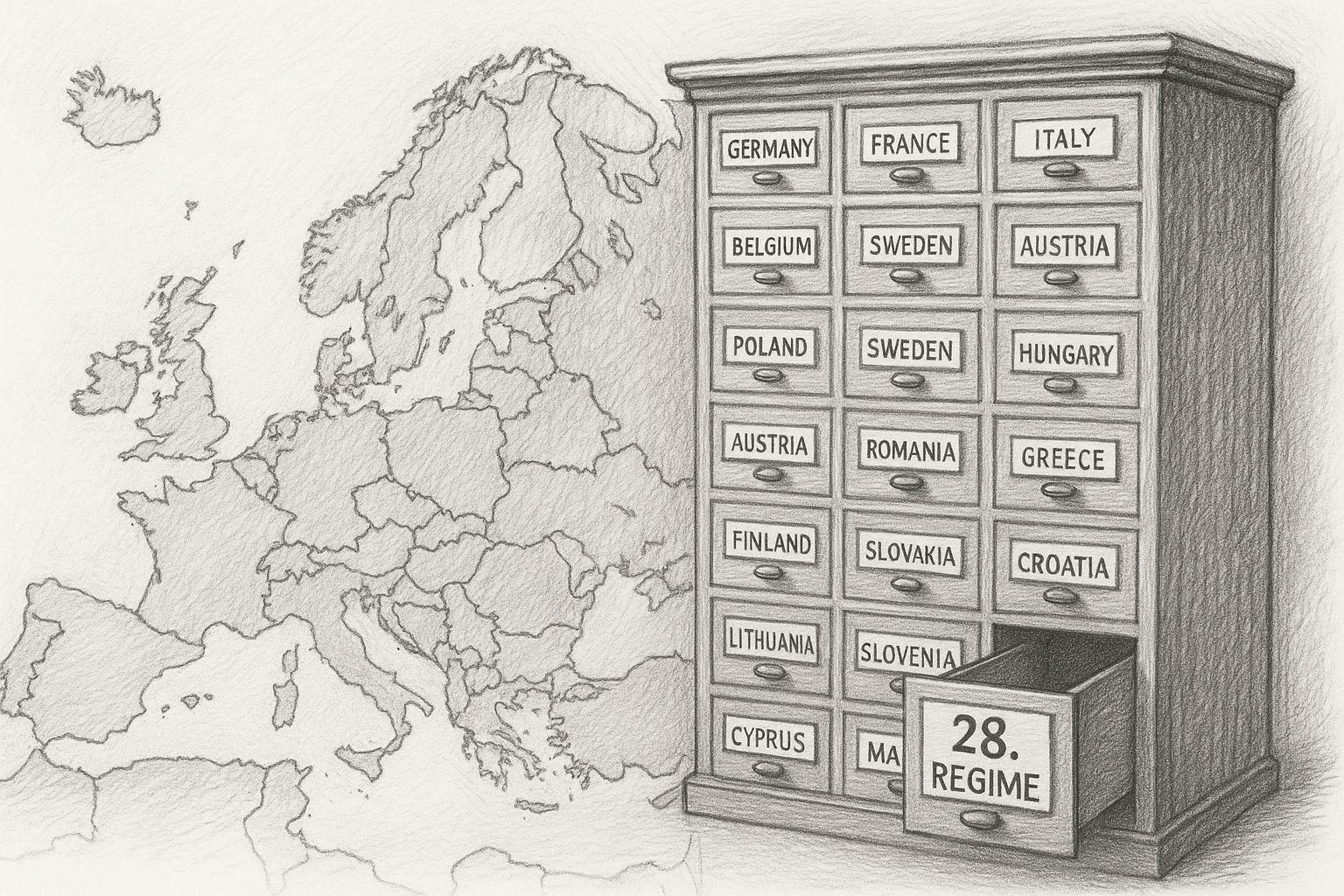

En un mundo cada vez más digitalizado, pasamos mucho tiempo en línea: Chateando, comprando, trabajando, informándonos. Al mismo tiempo, las normas sobre cómo se comparten, moderan o controlan los contenidos están cambiando. La Ley de Servicios Digitales (DSA), la Ley Europea de Libertad de los Medios de Comunicación (EMFA), el Reglamento previsto para prevenir y combatir el abuso sexual infantil (CSAR, a menudo denominado „control del chat“) y la Ley de IA son piezas clave de la legislación propuesta por la Unión Europea (UE) para regular el entorno digital.

Esta normativa puede parecer lejana a primera vista, pero tiene repercusiones tanto para usted como particular como para las pequeñas y medianas empresas. Este artículo le guiará paso a paso: desde la pregunta „¿Qué está previsto aquí?“ al trasfondo y las líneas de tiempo al cambio de perspectiva: ¿Qué significa esto para ti en la vida cotidiana?

En la primera parte, echamos un vistazo a lo que está realmente previsto, qué grandes proyectos legislativos se están debatiendo actualmente o se han aprobado ya y las razones de su creación.

Últimas noticias sobre las leyes de censura previstas en la UE

21.04.2026El Berliner Zeitung aborda la cuestión en un contribución actual el libro „El complejo de la verdad“ de Norbert Häring y describe una densa red de ONG, verificadores de hechos, centros de información, plataformas y estructuras financiadas por el Estado que, según el artículo, se ha ido consolidando cada vez más desde 2014 aproximadamente. El artículo cita como hitos importantes la primera cumbre de fact-checking celebrada en Londres, la puesta en marcha del Centro StratCom de la OTAN en Riga, la fundación de Correctiv y el programa federal „¡Democracia viva!“. El artículo describe cómo términos como „desinformación“, „discurso del odio“ o „noticias falsas“ podrían ejercer presión no sólo sobre los contenidos delictivos, sino también cada vez más sobre posiciones políticas indeseables. Se presta especial atención a la Ley de Servicios Digitales de la UE, que según los críticos proporciona el marco regulador para intervenciones de mayor alcance en el espacio digital. El artículo dibuja así el panorama de un sistema en el que el control sobre la soberanía de la interpretación, el alcance y la percepción pública está cada vez más organizado institucionalmente.

14.04.2026: A artículo actual en it-daily muestra que la Ley de IA de la UE está obligando cada vez más a las empresas a estructurar sistemáticamente sus actividades de IA, antes desorganizadas. El reglamento entró en vigor en 2024 y se está aplicando gradualmente. Las primeras obligaciones concretas están en vigor desde febrero de 2025, como la prohibición de determinadas aplicaciones de IA y la obligación de formar a los empleados en el uso de la IA. En los próximos años -en particular para agosto de 2026- seguirán requisitos más estrictos para los llamados sistemas de alto riesgo, lo que implicará responsabilidades claras para proveedores y usuarios. En general, está claro que la IA ya no puede utilizarse de forma aislada o experimental, sino que debe integrarse, documentarse y supervisarse en la organización. Por lo tanto, las empresas se enfrentan a la tarea de redefinir los procesos, las responsabilidades y las competencias relacionadas con la IA, tanto para cumplir los requisitos normativos como para operar sus sistemas de forma segura y trazable.

La Ley de Inteligencia Artificial de la UE y sus consecuencias para las empresas | Rainer Hoffmann, de EnBW StackFuel

27.03.2026El debate sobre el control del chat en la UE sigue siendo muy controvertido y se está convirtiendo cada vez más en una patata caliente política. Según los informes actuales, el proyecto sigue debatiéndose entre la protección de la infancia y los derechos fundamentales. Mientras los partidarios subrayan que el escaneo de las comunicaciones privadas es necesario para combatir eficazmente los abusos en línea, los críticos advierten contra la introducción de una vigilancia masiva sin motivo.

El hecho de que tales medidas puedan invadir profundamente la intimidad e incluso afectar a las comunicaciones cifradas se considera de forma especialmente crítica. Al mismo tiempo, los procesos políticos en la UE muestran que, a pesar de los repetidos reveses, la cuestión no está fuera de la mesa y se sigue impulsando, a veces a puerta cerrada. El debate ilustra lo difícil que se ha vuelto el compromiso entre seguridad y libertad. La disputa sobre el control del chat es, por tanto, ejemplar de una cuestión fundamental a la que se enfrentan las sociedades modernas: ¿Hasta dónde debe llegar el acceso estatal a la comunicación digital?

27.11.2025 - Los Estados miembros de la UE han según Tagesschau acordaron, tras largas disputas, no introducir controles obligatorios en los chats. Por el momento, servicios como WhatsApp o Signal no tienen que escanear automáticamente sus mensajes en busca de representaciones de violencia sexualizada contra menores. El plan original fracasó debido a la importante oposición de Alemania, entre otros países. En su lugar, la UE confía ahora en las medidas voluntarias de los proveedores. Una excepción hasta ahora temporal, que permite los escaneos voluntarios a pesar de las normas de protección de datos, se hará permanente. Transcurridos tres años, la Comisión Europea quiere revisar si, después de todo, sería necesaria una obligación. No obstante, según el proyecto, las plataformas deben reducir activamente los riesgos para los niños, por ejemplo mediante una verificación fiable de la edad. También está previsto crear un nuevo centro de la UE contra el abuso infantil, que ayudará a las autoridades nacionales. Antes de que la normativa entre en vigor, el Consejo de Ministros de la UE y el Parlamento Europeo aún tienen que acordar una versión conjunta de la ley.

Poco después, sin embargo, el Berliner Zeitung publicó un informe crítico que cuestiona la redacción del Tagesschau y el carácter „voluntario“ del control del chat. Patrick Breyer, activista de la libertad digital, critica el enfoque voluntario del informe y advierte al público de que no se deje engañar por el término „voluntario“.

Peritos y expertos en protección de datos también advierten, que este carácter voluntario no es más que una puerta trasera y que podrían seguir poniéndose en peligro los derechos fundamentales, por ejemplo mediante el escaneo de clientes o la creación de un centro de la UE para la lucha contra el maltrato infantil. Los críticos subrayan que éste no es ni mucho menos el final del debate y que seguirán nuevas disputas políticas.

24.11.2025 - A Artículo en el Berliner Zeitung informa de que la iniciativa de Reglamento para Prevenir y Combatir el Abuso Sexual Infantil (CSAR) -a menudo denominada „control de chats“- va a ser aprobada en la Unión Europea sin debate público, según fuentes internas. Aunque oficialmente se ha eliminado la obligación explícita de escanear los chats, el nuevo borrador contiene una laguna: los proveedores deben seguir aplicando „medidas apropiadas de mitigación de riesgos“, lo que en la práctica podría significar un escaneo automatizado. Los críticos advierten de que esto socavará el cifrado de extremo a extremo y hará que las comunicaciones privadas se puedan buscar automáticamente en el futuro.

Lo que la UE planea en la actualidad: un sencillo resumen

La UE lo ha reconocido en los últimos años: Internet está cambiando rápidamente. Plataformas con millones o miles de millones de usuarios, inteligencia artificial, nuevas formas de comunicación: muchos marcos jurídicos datan de décadas anteriores. La UE tiene que ponerse al día: quiere hacer más seguro el espacio digital, proteger los derechos fundamentales y crear condiciones justas, tanto para los usuarios como para las empresas. Así, por ejemplo, la DSA

„El objetivo es crear un espacio digital más seguro en el que se protejan los derechos fundamentales de todos los usuarios de servicios digitales“.“

Como se han puesto en marcha varios proyectos legislativos en paralelo, se crea la impresión de que „ahora se regulan muchas cosas al mismo tiempo“, lo que genera incertidumbre, sobre todo para las personas que no se ocupan a diario del Derecho digital.

Los principales objetivos según la UE

Los objetivos más importantes de estos paquetes legislativos pueden resumirse como sigue:

- Protección contra el uso indebidoPor ejemplo, la UE quiere utilizar el Diseño CSAR Garantizar que las representaciones de abusos sexuales a menores se reconozcan y supriman más rápidamente en Internet.

- Protección contra la desinformación, la injerencia electoral y los riesgos sociales: En el DSA declara explícitamente que su objetivo es limitar la difusión de contenidos ilegales y otros riesgos, entre otras cosas.

- Pluralismo, transparencia y competencia leal en los medios de comunicaciónCon el EMFA, la UE se esfuerza por regular más estrechamente el panorama de los medios de comunicación para limitar la influencia y la concentración.

- Normas para la inteligencia artificial y requisitos de etiquetadoLa Ley de IA pretende garantizar que los sistemas de IA y su contenido sean transparentes en el futuro, por ejemplo en el caso de deepfakes o decisiones automatizadas.

- Condiciones justas para las empresas: Además de proteger a los usuarios, la UE también quiere claridad e igualdad. Reglas del juego para los proveedores (por ejemplo, plataformas). Uno de los objetivos de la DSA es crear un „conjunto normalizado de normas y condiciones competitivas para las empresas“.

¿Cuál es nuestra situación actual?

La situación actual puede resumirse del siguiente modo:

- Con la DSA: La normativa ya ha sido adoptado, Los proveedores con un número muy elevado de usuarios („plataformas en línea muy grandes“) están sujetos a normas especialmente estrictas desde 2023/24.

- Con CSAR („Chatcontrol“)La propuesta fue presentada por la Comisión Europea en 2022. Sin embargo, muchos Estados miembros y organizaciones de protección de datos y libertades civiles están fuertes críticas. Por lo tanto, aún no ha finalizado.

- Con la Ley EMFA y AIEl EMFA ha sido adoptado formalmente y se aplicará a partir de determinadas fechas. La Ley de AI está en vigor, pero muchas obligaciones están escalonadas.

Importante: Aunque se hayan aprobado leyes, esto no significa que todos los requisitos se apliquen inmediatamente: a menudo hay periodos transitorios, excepciones o implementaciones técnicas que aún están abiertas. En esta primera parte hemos analizado qué normas están en juego, qué pretende conseguir la UE con ellas y cuál es la situación actual. En el próximo capítulo nos ocuparemos específicamente de cada una de las principales leyes, en términos sencillos, para que quede claro: „¿Qué es esto exactamente?“.“

Encuesta actual sobre el proyecto de identificación digital de la UE

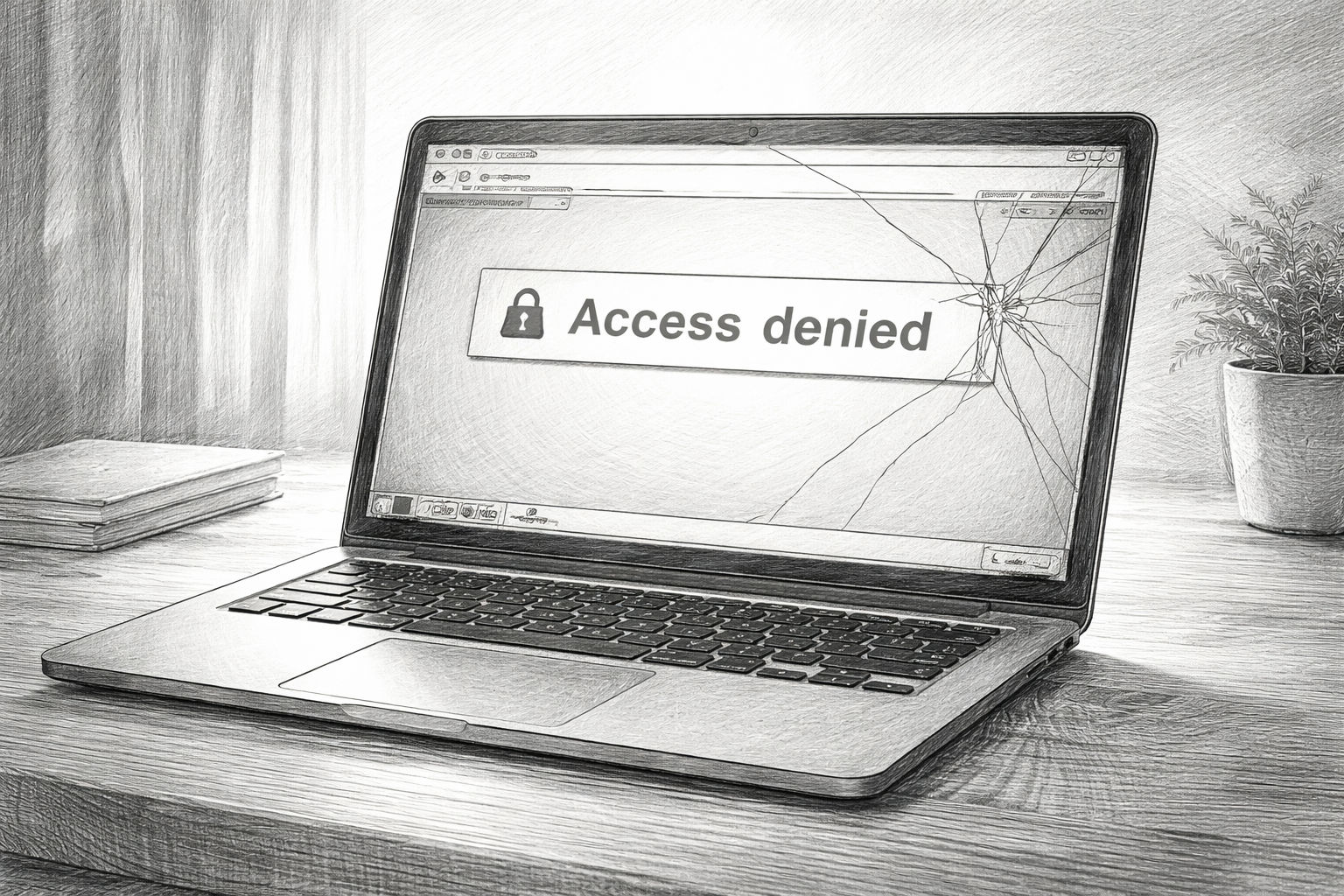

Chat Control / CSAR - Supervisión de las comunicaciones privadas

En 2022, el Reglamento de la Comisión de la UE para prevenir y combatir el abuso sexual infantil (CSAR) presentó la propuesta que muchos consideran „Control del chat“se llama. El núcleo: los proveedores de servicios de mensajería, plataformas de chat u otros servicios de comunicación digital estarán obligados a buscar, denunciar y eliminar contenidos de abuso sexual infantil (CSAM).

La idea que subyace es comprensible: El material abusivo en línea es un problema grave, y las leyes nacionales por sí solas no siempre son eficaces. requisitos normalizados.

Pero aquí es donde empieza la polémica: Y es que algunas versiones de la propuesta prevén la posibilidad de buscar las comunicaciones, aunque estén cifradas de extremo a extremo. En términos cotidianos, esto significa que tus chats, imágenes o vídeos privados podrían ser analizados técnicamente, antes de que el servicio de mensajería los cifre o reenvíe. Los críticos hablan de vigilancia masiva.

La tecnología es sofisticada y arriesgada: ¿cómo reconocer realmente el material mal utilizado sin arriesgarse a un diagnóstico erróneo? ¿Cómo garantizar la protección y el cifrado de los datos? A Estudiar muestra que los falsos positivos pueden ser elevados, especialmente con la exploración del lado del cliente.

En resumen, la propuesta combina un mandato legítimo de protección con riesgos considerables para los derechos fundamentales. Para los ciudadanos, esto significa que las comunicaciones privadas podrían estar sujetas a controles más estrictos en el futuro, aunque no tengan nada que ver con un uso indebido. Para las pequeñas empresas, esto significa que si gestionan canales de mensajería o comunicaciones con clientes, tendrían que estar preparadas para la posibilidad de nuevas obligaciones legales o auditorías técnicas.

| Aspecto | Descripción de la |

|---|---|

| Nombre | Reglamento para prevenir y combatir el abuso sexual infantil (CSAR), coloquialmente conocido como „control del chat“ |

| Objetivo principal según la UE | Prevenir, denunciar y eliminar la difusión en línea de material de abuso sexual infantil (CSAM); crear un centro de denuncia de la UE. |

| ¿A quién afecta principalmente? | Proveedores de servicios de comunicación (mensajeros, chats, plataformas de alojamiento, servicios en la nube), en algunos casos también proveedores de comunicación cifrada. |

| Instrumentos centrales | - Escaneo (parcial) de contenidos en busca de patrones de abuso conocidos. - Obligaciones de información a las autoridades/centro de la UE - Medidas de control obligatorias o „voluntarias“ en función de la clasificación del riesgo |

| Situación actual | - Propuesta de reglamento en negociación desde 2022 - Fuerte oposición de varios Estados miembros y organizaciones de derechos civiles - Se debaten textos de compromiso con la digitalización „voluntaria |

| Argumentos a favor | - Sin normas armonizadas en la UE, no se puede combatir eficazmente la CSAM - Los proveedores deben asumir su responsabilidad - Se necesitan medios técnicos para localizar a los infractores |

| Argumentos de los críticos | - Peligro de vigilancia generalizada de todos los ciudadanos - Debilitamiento del cifrado de extremo a extremo („exploración del lado del cliente“) - Alto número de posibles falsas alarmas y falsas sospechas - Creación de una infraestructura de vigilancia permanente que pueda ampliarse políticamente |

| Consecuencias para los ciudadanos | - Las comunicaciones privadas podrían controlarse (parcialmente) de forma automática - Incertidumbre con contenidos sensibles (fotos, documentos, chats) - Riesgo de falsas sospechas y almacenamiento de datos |

| Consecuencias para las PYME | - La comunicación con el cliente a través de servicios escaneados ya no es completamente privada - Posibles conflictos con la protección de datos y los secretos comerciales - Necesidad de personalizar la selección y el uso de los canales de comunicación |

Ley de Servicios Digitales (DSA): normas para las plataformas y sus obligaciones de cancelación

Con el Ley de Servicios Digitales la UE ha creado un amplio conjunto de normas que se adoptó en 2022. Se dirige principalmente a los servicios digitales -proveedores de alojamiento, plataformas, motores de búsqueda- con el objetivo de hacer internet más seguro, transparente y justo. Entre las obligaciones más importantes figuran

- Los proveedores deben Sistemas de notificación y corrección permitir a los usuarios denunciar contenidos ilegales (por ejemplo, incitación al odio, propaganda terrorista, fraude).

- Las plataformas deben responder a ello, es decir Borrar contenidos o bloquear el acceso, si tienen conocimiento de contenidos ilegales.

- Para plataformas „muy grandes (por ejemplo, más de 45 millones de usuarios en la UE), se aplican requisitos más estrictos: Análisis de riesgos, auditoría de los algoritmos de recomendación, divulgación de las prácticas de moderación.

- Obligaciones de transparenciaLos usuarios deben comprender mejor por qué se han eliminado o bloqueado contenidos; las plataformas deben informar al respecto.

Para la vida cotidiana de una persona, esto significa que si publica artículos en plataformas -por ejemplo, en redes sociales o foros-, las plataformas tendrán que tomar decisiones más estrictas en el futuro. En caso de duda, los contenidos podrían eliminarse más rápidamente.

Para una pequeña empresa, esto significa que si su sitio web, foro o plataforma tiene contribuciones interactivas de los usuarios, debe comprobar cuidadosamente las condiciones de uso, los procedimientos de denuncia y los procesos de eliminación. Incluso si no es una de las plataformas realmente grandes, puede surgir una presión indirecta, especialmente a través de directrices sobre cómo se debe proteger a los usuarios de contenidos perjudiciales.

| Aspecto | Descripción de la |

|---|---|

| Nombre | Ley de Servicios Digitales (DSA) - Reglamento (UE) 2022/2065 |

| Objetivo principal según la UE | - Espacio digital seguro para los usuarios - Protección de los derechos fundamentales en línea - Conjunto normalizado de normas para los servicios digitales en la UE |

| ¿A quién afecta principalmente? | - Cambio de servicios (acceso, caché, alojamiento) - Plataformas y mercados en línea - „Very Large Online Platforms“ (VLOPs) y motores de búsqueda con 45 millones de usuarios de la UE o más |

| Funciones centrales | - Canales de denuncia de contenidos ilícitos - Obligación de eliminar rápidamente tras el conocimiento - Informes de transparencia sobre moderación - Análisis de riesgos y auditorías para plataformas muy grandes - Cooperación con „abanderados de confianza“ |

| Situación actual | - En vigor, ya plenamente eficaz para las grandes plataformas - La Comisión incoa procedimientos contra proveedores individuales (por ejemplo, debido a una moderación inadecuada). |

| Argumentos a favor | - Las plataformas asumen los riesgos de sus servicios - Más transparencia sobre las prácticas de cancelación y recomendación - Mejor protección contra el odio, el fraude, la desinformación y las ofertas ilegales |

| Argumentos de los críticos | - Peligro de „sobrebloqueo“ (se elimina demasiado para evitar sanciones) - Privatización de facto de la censura: las plataformas deciden qué permanece visible - Términos flexibles como „riesgos sistémicos“; el contenido políticamente sensible puede diluirse |

| Consecuencias para los ciudadanos | - Los mensajes pueden bloquearse o hacerse invisibles más rápidamente - Más medios formales para impugnar decisiones, pero más esfuerzo - Las burbujas de los filtros no son necesariamente cada vez más pequeñas, la intervención es más bien „desde arriba“ |

| Consecuencias para las PYME | - El marketing y la visibilidad dependen aún más del algoritmo de la plataforma - Los contenidos sobre temas delicados (salud, política, sociedad) tienen más probabilidades de ser eliminados. - Las áreas de comentarios separadas requieren más esfuerzo de moderación y normas claras |

European Media Freedom Act (EMFA) - la nueva ley de medios de comunicación

En Ley Europea de Libertad de los Medios de Comunicación (EMFA) entró formalmente en vigor el 7 de mayo de 2024 y se aplicará íntegramente a partir del 8 de agosto de 2025: La UE quiere salvaguardar la independencia y diversidad de los medios de comunicación -es decir, editoriales, radiodifusores y medios en línea- y, al mismo tiempo, crear nuevas normas de cooperación entre medios y plataformas. Contenido importante:

- Protección de la independencia editorial y de las fuentes periodísticas.

- Transparencia sobre las estructuras de propiedad de los medios de comunicación para que quede claro quién está detrás de un medio.

- Regulación de la publicidad gubernamental y cómo los gobiernos pueden influir en los medios de comunicación a través de los anuncios.

Una particularidad: los proveedores de servicios de medios deben estar protegidos frente a las plataformas, por ejemplo para que sus contenidos no sean suprimidos a voluntad por las grandes plataformas.

Para el usuario, esto significa que teóricamente podría surgir una mayor diversidad de opiniones y fuentes mediáticas, con un etiquetado claro y mejores condiciones para los medios de calidad. Sin embargo, también habrá un nuevo nivel de escrutinio: las plataformas tendrán que tener especial cuidado con los «medios reconocidos» en el futuro.

Para una pequeña empresa que publica contenidos (por ejemplo, un blog, un boletín o una revista en línea), esto significa que se encontrará en un orden diferente en el que sus contenidos pueden ser evaluados de forma distinta, dependiendo de si se le considera un „medio“ o no, y de cómo traten las plataformas dichos contenidos.

| Aspecto | Descripción de la |

|---|---|

| Nombre | European Media Freedom Act (EMFA) - Ley europea de libertad de los medios de comunicación |

| Objetivo principal según la UE | - Protección del pluralismo de los medios de comunicación y de la independencia editorial - Limitar la influencia política en los medios de comunicación - Transparencia sobre las estructuras de propiedad y los fondos estatales para publicidad |

| ¿A quién afecta principalmente? | - Empresas de medios de comunicación (prensa, radiodifusión, en línea) - Instituciones de derecho público - Plataformas de tratamiento de contenidos multimedia |

| Instrumentos centrales | - Organismo europeo de servicios de medios de comunicación (cooperación de reguladores nacionales) - Normas de publicidad y promoción del Estado - Trato especial a los „medios reconocidos“ por parte de las plataformas (por ejemplo, trato privilegiado durante la moderación). |

| Situación actual | - Adoptada, entrada en vigor en 2024 - Vigencia de las principales disposiciones a partir de 2025 |

| Argumentos a favor | - Mayor protección de los medios de comunicación acreditados frente a las presiones políticas - Transparencia contra la influencia encubierta y la concentración de medios - Protección de las decisiones editoriales frente a injerencias de propietarios o Estados |

| Argumentos de los críticos | - Peligro de „privilegio mediático“ para los proveedores estatales o establecidos - Las plataformas entran en conflicto entre las obligaciones de supresión de la DSA y los privilegios de la EMFA - Los medios pequeños o alternativos sin estatuto oficial podrían ser penalizados |

| Consecuencias para los ciudadanos | - Los contenidos visibles podrían caracterizarse en mayor medida por „medios reconocidos“. - La demarcación entre los medios establecidos y la oferta independiente es cada vez más nítida - Las voces más críticas o nuevas pueden tener más dificultades para llegar a los ciudadanos. |

| Consecuencias para las PYME | - Los contenidos propios (blogs, revistas, boletines) compiten con entornos mediáticos privilegiados - Las cooperaciones con los medios de comunicación (publicidad, contenidos patrocinados) se regulan de forma más estricta - Las empresas que deseen actuar ellas mismas como medio de comunicación deben cumplir requisitos adicionales |

AI Act - normas para la inteligencia artificial, deepfakes & co.

Con el Ley sobre Inteligencia Artificial la UE ha creado uno de los primeros textos legislativos completos del mundo sobre regulación de la IA. Está diseñada para ser tecnológicamente neutra, es decir, no sólo para los sistemas de IA conocidos actualmente, sino también para futuros desarrollos. La característica principal es un planteamiento basado en el riesgo: cuanto mayor sea el riesgo para los derechos fundamentales o la seguridad, más estrictas serán las obligaciones. Ejemplos:

- Sistemas de IA con un riesgo inaceptable (por ejemplo, sistemas de calificación social) pueden estar prohibidos.

- IA de alto riesgo (por ejemplo, sistemas de aplicación o biométricos) están sujetos a requisitos estrictos.

- Otros sistemas de IA deben etiquetado por ejemplo, si el contenido se ha generado automáticamente (por ejemplo, deepfakes).

Para los ciudadanos, esto significa que si en el futuro se encuentran con un contenido, como un vídeo o un texto que se haya creado automáticamente, este contenido podrá etiquetarse como „generado por IA“, para que puedan reconocer quién o qué está detrás de él. Para las empresas, esto significa que si utilizan herramientas de IA -por ejemplo, en marketing, para la producción de documentos, atención al cliente- deben comprobar si su aplicación entra dentro de una categoría de riesgo, si se aplican obligaciones de etiquetado o si es necesario cumplir requisitos.

| Aspecto | Descripción de la |

|---|---|

| Nombre | Ley de Inteligencia Artificial (AI Act) - Reglamento de la UE sobre la regulación de la IA |

| Objetivo principal según la UE | - Garantizar que los sistemas de IA son seguros y fiables - Protección de los derechos fundamentales y de los consumidores - Fomentar la innovación con normas claras |

| ¿A quién afecta principalmente? | - Proveedores y operadores de sistemas de IA (desde nuevas empresas hasta grandes corporaciones) - Usuarios que integran la IA en productos o servicios - Concretamente: fabricantes de „IA de alto riesgo“.“ |

| Categorías de riesgo | - IA prohibida (por ejemplo, ciertas formas de juicio social) - IA de alto riesgo (por ejemplo, sistemas biométricos, determinados apoyos a la toma de decisiones) - IA con obligaciones de transparencia (por ejemplo, chatbots, deepfakes) - IA de riesgo mínimo (por ejemplo, herramientas sencillas sin intervención profunda en los derechos) |

| Funciones centrales | - Evaluación de riesgos y documentación - Etiquetado de contenidos generados por IA en determinados casos - Requisitos de calidad y datos para la IA de alto riesgo - Transparencia hacia los usuarios (por ejemplo, „Está hablando con una IA“). |

| Situación actual | - Adoptada, entra en vigor por etapas - Ya se aplican obligaciones individuales, otras seguirán en periodos transitorios |

| Argumentos a favor | - Protección contra sistemas de IA no transparentes, injustos o peligrosos - Generar confianza: Los usuarios saben cuándo está en juego la IA - Normas mínimas de calidad y seguridad de los datos |

| Argumentos de los críticos | - Complejidad y burocracia, especialmente para los pequeños proveedores. - Incertidumbre sobre si una solicitud es de „alto riesgo“ o no - Riesgo de que la innovación y el desarrollo de la IA se desplacen a regiones menos reguladas - Umbral de inhibición para que las PYME utilicen la IA en absoluto |

| Consecuencias para los ciudadanos | - Más etiquetado de los contenidos de IA (textos, imágenes, vídeos) - Mayor protección de las decisiones automatizadas, pero también más formalidad - Tratamiento más consciente de la información „generada por máquinas“. |

| Consecuencias para las PYME | - Necesidad de documentar el uso de la IA (interna y externamente) - Posibles obligaciones de etiquetado en la comercialización o el contacto con el cliente - Puede ser necesario asesoramiento para clasificar correctamente los riesgos y las obligaciones - Los que están bien preparados aún pueden utilizar la IA como ventaja competitiva |

Calendario de los pasos más importantes

2022-2023: La fase de las grandes propuestas

Durante esta fase se presentaron oficialmente varias propuestas clave: la Ley de Servicios Digitales (DSA), el Reglamento para Prevenir y Combatir el Abuso Sexual Infantil (CSAR, también conocido como „Chat Control“) y la Ley Europea de Libertad de los Medios de Comunicación (EMFA).

- En el Mayo de 2022 la Comisión Europea presentó la propuesta CSAR para combatir las representaciones en línea de abusos sexuales a menores.

- En 23 de abril de 2022 se alcanzó un acuerdo político entre el Parlamento y el Consejo sobre la iniciativa DSA.

- En el Junio/diciembre de 2023 negociaciones y se alcanzaron acuerdos sobre el borrador del EMFA.

Consejo Europeo

Así pues, el terreno de juego quedó delimitado en esta fase: la UE decidió que se necesitaban normas digitales más completas.

2024: entran en vigor las primeras leyes

La fase de aplicación comenzó en 2024: se han adoptado algunos reglamentos, otros se están preparando para su aplicación.

- En DSA entró formalmente en vigor (Reglamento (UE) 2022/2065), y muchos servicios tuvieron que prepararse para su cumplimiento.

- En EMFA se ha adoptado formalmente (por ejemplo, el 26 de marzo de 2024 por el Consejo) y se han fijado los objetivos de aplicación.

- En el CSAR Sin embargo, la situación sigue siendo incierta: el plazo hasta que se tome una decisión definitiva se ha ampliado varias veces. Por ejemplo, la medida cautelar se prorrogó hasta el 3 de abril de 2026.

Esta fase se caracterizó por periodos de transición, preparativos y disputas políticas: el reloj corre, pero aún no está todo activo.

2025: La fase decisiva

En 2025 habrá que tomar decisiones importantes.

- En Funciones de la AVD para plataformas muy grandes („VLOP“) están entrando cada vez más en vigor; los plazos están expirando.

- En EMFA es plenamente aplicable: muchas disposiciones se aplicarán a partir de una fecha límite.

- En el CSAR se vislumbra una decisión en el horizonte: Algunos Estados miembros han anunciado resistencia, se han aplazado o bloqueado votaciones.

Para los ciudadanos y las empresas, cada vez es más tangible: ya no se trata sólo de „proyectos legislativos“, sino de „normativa a la que hay que adaptarse“.

2026 y después: lo que está por venir

Los siguientes pasos también son pertinentes más allá de 2025. Es posible que se sigan aplicando normas técnicas adicionales a la DSA: la Comisión Europea está supervisando su aplicación e impacto. Es posible que a continuación se adopte un reglamento definitivo para la RCA, o que la propuesta se modifique o aplace considerablemente. Se aplicarán otras disposiciones especiales al EMFA, por ejemplo sobre cooperación entre plataformas de medios, interfaces o publicidad.

En términos generales, cuanto más compleja se vuelve la infraestructura digital (IA, plataformas, comunicación), más regulación se espera que sea necesaria. Para el lector, esto significa que el tema no está cerrado: formará parte de nuestra vida digital cotidiana. Por lo tanto, es aconsejable prepararse y prestar atención.

LA LIBERTAD DE OPINIÓN EN PELIGRO: La Ley de Servicios Digitales de la UE | Canal de noticias WELT

¿Qué significa esto para las pequeñas y medianas empresas?

Empresas como Meta, Google y Microsoft tienen sus propios departamentos jurídicos, equipos de protección de datos y responsables de cumplimiento. Las pequeñas y medianas empresas (PYME) no suelen tenerlos. Sin embargo, la nueva normativa de la UE también les afecta, a veces directamente, a menudo indirectamente a través de las plataformas, herramientas y canales de comunicación utilizados.

La siguiente sección examina lo que esta evolución puede significar en términos concretos para las empresas más pequeñas: desde empresas unipersonales hasta PYME con 50 o 200 empleados.

Más normas en segundo plano, aunque no las vea inmediatamente

Muchas de las nuevas normas -por ejemplo, en la Ley de Servicios Digitales (DSA) o la Ley de IA- están oficialmente dirigidas sobre todo a las plataformas „muy grandes“ o a determinados proveedores de IA. No obstante, sus consecuencias están repercutiendo en las empresas más pequeñas:

- sobre las plataformas en las que se anuncian o publican contenidos,

- las herramientas que utilizan (por ejemplo, sistemas de inteligencia artificial, software de boletines informativos, sistemas de chat),

- y sobre las obligaciones de comunicación que están surgiendo gradualmente también para los proveedores más pequeños.

Ejemplo: La DSA obliga a las plataformas en línea a eliminar eficazmente los contenidos ilegales y a crear transparencia. Para las pequeñas empresas que llegan a sus clientes a través de Facebook, Instagram, YouTube o mercados de plataformas, esto significa que los contenidos pueden eliminarse o restringirse más rápidamente que antes, incluso si ellas mismas cumplen la ley.

Efectos concretos en la vida cotidiana de una PYME

1. columnas de comentarios, foros y valoraciones de clientes

Muchas empresas lo utilizan hoy en día:

- Artículo de blog con sección de comentarios

- Foros o comunidades de apoyo

- Funciones de calificación o libros de visitas

- Canales de medios sociales con comentarios

Las nuevas normas aumentan la presión para vigilar los contenidos de los usuarios:

- Quejas deben tomarse en serio y ser objeto de escrutinio.

- Obviamente contenidos ilegales deben retirarse rápidamente para evitar problemas de responsabilidad.

- Plataformas ellos mismos reaccionan con más sensibilidad: una tormenta de mierda con contenido límite puede dar lugar más rápidamente a baneos, pérdida de alcance o bloqueos.

- Los partidarios dicenEsto tiene sentido porque crea responsabilidades claras. Cualquiera que ofrezca una plataforma pública (aunque sea un pequeño foro) debe evitar los abusos. Para los proveedores reputados, esto no es una desventaja, sino un signo de calidad.

- Los críticos argumentan en contraLas pequeñas empresas no tienen ni tiempo ni personal para evaluar legalmente los comentarios o prepararlos para la moderación. Temen desactivar por completo las funciones de comentario por miedo a los problemas, lo que empobrece aún más el diálogo abierto en Internet.

2. canales de comunicación: Correo electrónico, Messenger y „Chatcontrol“

El reglamento previsto para combatir los abusos a menores (CSAR, „Chatcontrol“) se dirige formalmente a los proveedores de servicios de comunicación, que deben buscar y denunciar el material abusivo. Para las PYME tradicionales, esto no significa que tengan que instalar sus propios escáneres inmediatamente. Pero

- Muchos utilizan servicios de mensajería (WhatsApp, Signal, Teams, Slack, etc.) tanto internamente como en la comunicación con los clientes.

- Si estos servicios Escanear contenidos (o tienen que escanear), las comunicaciones corporativas ya no son potencialmente tan confidenciales como antes.

- Especialmente delicadoExpedientes, documentos de proyectos, borradores, información confidencial que pasa por esos canales.

- Los defensores argumentanSin este tipo de medidas, la lucha contra el abuso infantil en Internet difícilmente sería posible. Las empresas que trabajan con limpieza no tienen nada que temer; al contrario, se benefician de un entorno digital más seguro.

- Críticas en contraLa implementación técnica (por ejemplo, el „escaneado del lado del cliente“) puede prácticamente anular el cifrado y crear una infraestructura que podría utilizarse para comprobar cualquier tipo de contenido: abuso hoy, posiblemente cuestiones políticas o económicas mañana. Los secretos comerciales y los datos de los clientes corren peligro porque se crean interfaces adicionales a través de las cuales los datos pueden filtrarse o utilizarse indebidamente. Las falsas alarmas (falsas sospechas) pueden dañar la reputación de empresas y empleados, aunque en realidad no se haya hecho nada malo.

3 IA en la empresa: Etiquetado, documentación y responsabilidad

Con la Ley de IA, la UE introduce un marco basado en el riesgo: Según el ámbito de aplicación, se aplicarán distintas obligaciones. Tres ámbitos son especialmente relevantes para las PYME:

- Marketing y comunicaciónSi se crean textos, imágenes o vídeos con IA -como artículos de blog, publicaciones en redes sociales o imágenes de productos-, pueden aplicarse obligaciones de etiquetado (por ejemplo, „Este contenido se ha creado con ayuda de IA“), especialmente cuando se trata de áreas políticamente sensibles o deepfakes.

- Atención al cliente y procesos de toma de decisionesLos chatbots o sistemas automatizados de toma de decisiones (puntuación, selección de candidatos, evaluación de riesgos) pueden entrar en la categoría de „IA de alto riesgo“, en función de sus características, con estrictas obligaciones de documentación y transparencia.

- Herramientas y análisis internosIncluso si proveedores externos integran funciones de IA (por ejemplo, sistemas CRM, contabilidad, ERP), la empresa puede ser considerada responsable si toma decisiones basadas en recomendaciones de IA.

- Los partidarios dicenLa Ley de IA protege a clientes y ciudadanos de decisiones opacas o injustas. Obliga a los proveedores a actuar con cautela, calidad y transparencia, lo que en última instancia también beneficia a las PYME de buena reputación que utilizan la IA de forma responsable.

- Los críticos señalanPara las empresas más pequeñas, la normativa se vuelve rápidamente confusa. A menudo no saben si el uso que hacen de la IA entra ya en el ámbito regulado o no. Existe el riesgo de que las PYME prefieran no aventurarse en absoluto en la IA debido a la incertidumbre, y acepten así una desventaja en materia de innovación en comparación con las empresas más grandes. En la práctica, las obligaciones de documentación y etiquetado podrían convertirse en un monstruo burocrático casi imposible de seguir sin asesoramiento especializado.

4. riesgos para la reputación: visibilidad, bloqueo y „presión del algoritmo“.“

La DSA somete a las plataformas a una mayor presión: tienen que demostrar que combaten seriamente riesgos como la desinformación, la incitación al odio o los contenidos legalmente problemáticos. Para las empresas, esto significa

- Contenidos que abordan temas controvertidos (salud, política, seguridad, crisis, sociedad) pueden degradarse más rápidamente, es decir, recibir menos visibilidad.

- Las cuentas pueden estar temporalmente bloqueado, contribuciones eliminado o campañas publicitarias bloqueado cuando las plataformas ven „riesgos“, aunque el contenido no sea claramente ilegal.

- La frontera entre crítica legítima y „contenido problemático“ se vuelve así más difusa - y en la práctica está en manos de la moderación de la plataforma respectiva.

- Los defensores argumentanLas plataformas deben asumir su responsabilidad. Sin mecanismos eficaces, la desinformación y la incitación al odio quedarían sin control. Las empresas que ofrecen contenidos fiables tienen más que ganar a largo plazo: un entorno más limpio y más confianza.

- Los críticos, sin embargo, venn: Fuerte tendencia al bloqueo excesivo: por miedo a las multas, las plataformas prefieren borrar demasiado a borrar poco.

Esto puede afectar sobre todo a las empresas más pequeñas, que dependen de la visibilidad pero carecen de grupos de presión para impugnar las decisiones.

La „presión del algoritmo“ hace que los contenidos se adapten a unas supuestas directrices para no llamar la atención negativamente, lo que equivale a una autocensura rastrera.

Encuesta actual sobre el euro digital previsto

¿Quién decide qué es „información“ y qué es „desinformación“?

Cuando se examina la nueva normativa de la UE, siempre destaca una palabra: Desinformación. Hay que combatirla, ya sea mediante obligaciones de las plataformas, evaluaciones de riesgo o intervenciones algorítmicas. Pero rara vez se aborda el punto crucial: ¿Quién define qué es la desinformación?

Esta cuestión es central, porque determina si las medidas de protección protegen realmente, o si conducen involuntariamente al control de los debates públicos. En teoría, parece sencillo:

- Afirmaciones falsas = Desinformación,

- declaraciones correctas = Información.

En la práctica, sin embargo, el mundo rara vez es tan claro. Muchos temas son complejos, poco claros, controvertidos o están en constante evolución. Los estudios cambian, los expertos discuten, surgen nuevos hechos. Lo que un día se considera erróneo puede reevaluarse de repente al día siguiente: basta pensar en las previsiones políticas, los debates sanitarios o los nuevos riesgos tecnológicos.

Por eso muchos críticos advierten del peligro de tratar la „desinformación“ como un término fijo. Subrayan que a menudo no se trata tanto de hechos claros como de una interpretación moldeada por la respectiva situación política o social.

Las plataformas toman decisiones prácticas, pero bajo presión

Formalmente, son las plataformas las que tienen que decidir si algo es potencialmente desinformativo, porque la Ley de Servicios Digitales las hace responsables de los riesgos. Pero las plataformas no actúan en el vacío. Están sometidas a varios tipos de presiones:

- Presión jurídicaMultas elevadas si no se reducen suficientemente los „riesgos“.

- Presión políticaExpectativa de dar más o menos peso a determinadas narrativas.

- Presión públicaCampañas, indignación, informes de los medios de comunicación que influyen en las decisiones de moderación.

- Presión financieraLa moderación independiente cuesta tiempo, dinero y personal: las soluciones automatizadas son más baratas, pero a menudo más propensas a errores.

En estas condiciones, las plataformas tienden a eliminar o restringir demasiado en lugar de demasiado poco cuando tienen dudas. Esto significa que deciden de facto lo que permanece visible, aunque no sean el legislador real.

El papel de los gobiernos y las autoridades

Otra cuestión es que los gobiernos u organismos estatales participan cada vez más en estos procesos, por ejemplo en forma de:

- „Abanderados de confianza“

- Centros de notificación

- Centros de asesoramiento para plataformas

- Evaluación de los „riesgos sistémicos“

Esto crea un sistema en el que las instituciones estatales pueden influir indirectamente en los contenidos que se consideran problemáticos. Esto no tiene por qué ser necesariamente abusivo, pero crea una estructura susceptible de abuso si más adelante se imponen otras mayorías políticas.

El peligro de un „cambio en lo que se puede decir“

Cuando las plataformas clasifican los contenidos en función de términos vagos como „manipulación“, „riesgos sociales“ o „desinformación“, se produce un cambio cultural a largo plazo:

- La gente se expresa con más cautela, las empresas evitan ciertos temas, las voces críticas pierden visibilidad.

- El resultado no es una prohibición abierta, sino una invisibilidad progresiva. Los contenidos no desaparecen, pero apenas llegan a nadie.

Muchos críticos no consideran que se trate de una censura selectiva, sino de un efecto secundario igual de eficaz: lo que se puede decir cambia, simplemente porque cada actor tiene que aprender lo que es „deseable“ o „incriminatorio“ de las plataformas.

Quien habla de desinformación debe hablar también de poder.

Hoy en día, la decisión sobre lo que es verdadero, falso, permisible o peligroso ya no recae únicamente en la ciencia, el periodismo o el debate democrático, sino cada vez más en una mezcla de ambos:

- Plataformas

- Algoritmos

- Organismos públicos

- Equipos de moderación

- auditores externos

- y la presión social

Precisamente por eso es importante analizar esta evolución no sólo en términos técnicos o jurídicos, sino también culturales. Al fin y al cabo, se trata en última instancia de algo muy fundamental: ¿con qué libertad puede hablar una sociedad si nadie puede decir claramente quién decide lo que es verdadero y falso, y con arreglo a qué criterios?

La legislación de la UE censura Internet (DSA - Digital Services Act) | La UE censura Internet Prof. Dr. Christian Rieck

A favor y en contra: la confrontación

Para aclarar las tensiones, vale la pena hacer una comparación directa. Lo que destacan los partidarios:

- Seguridad y protecciónLos niños, los consumidores, los procesos democráticos: todos ellos necesitan un escudo protector jurídico moderno.

- Claridad jurídica: las normas normalizadas de la UE evitan a las empresas el mosaico de enfoques nacionales especiales. Quienes se adhieren a directrices claras tienen menos inseguridad jurídica.

- EquidadLas grandes plataformas y los proveedores de inteligencia artificial no deben ser „aprovechados“ que obtienen beneficios y descargan los riesgos sobre la sociedad. Normativas como la DSA y la Ley de IA pondrían orden en este ámbito.

- Confíe enEl objetivo: a largo plazo, la confianza en los servicios digitales debería aumentar si los usuarios saben que las normas se aplican y se controlan.

Lo que destacan los críticos:

- Riesgos relacionados con los derechos fundamentalesEl control de chats y medidas similares crean una infraestructura técnica que podría utilizarse para vigilar toda la comunicación digital en el futuro, incluso más allá de su propósito original.

- Sobrecarga burocráticaLas pequeñas empresas no tienen ni los recursos ni los conocimientos necesarios para cumplir de forma adecuada y permanente el creciente catálogo de obligaciones (etiquetado, documentación, moderación, canales de notificación).

- Censura privatizadaLas multas elevadas convierten a las plataformas en „ayudantes del sheriff“ que, en caso de duda, borran más de lo necesario, en detrimento de la libertad de expresión y la diversidad del debate. Las pymes que prosperan gracias al alcance pueden perderlo todo sin previo aviso.

- Obstáculo a la innovaciónEn lugar de atreverse a experimentar, muchas pequeñas empresas se frenan porque temen hacer algo mal. Si no te arriesgas, no te equivocas, pero te quedas en el sitio.

- Cambio de poderAl final, prevalecerán los que mejor sepan manejar las normas y reglamentos: las grandes empresas con departamentos jurídicos y equipos de cumplimiento. Las pequeñas empresas tienen que seguir sus reglas porque dependen de su infraestructura.

Conclusión desde la perspectiva de una pequeña o mediana empresa

Lo más importante para una PYME normal:

- Conozca lo básico sin perderse en cada detalle.

- Compruebe sus propios canales de comunicación (comentarios, redes sociales, boletines, mensajería) y decida conscientemente qué necesita realmente, y dónde reduce conscientemente.

- Documente el uso de la IA y, en caso de duda, comuníquelo abiertamente en lugar de tener que dar explicaciones más tarde.

- Mantenga la calma, pero preste atención: no tiene sentido no hacer nada por culpa de todas las leyes. Es importante pensar paso a paso: „¿Dónde me afecta esto realmente?“, y encontrar allí soluciones sólidas.

La principal preocupación de los críticos puede resumirse en una frase: El problema no son las leyes individuales, sino la interacción de muchas normas que está creando gradualmente un entorno digital en el que se premia el control y la conformidad, y las voces independientes y críticas lo tienen más difícil.

La soberanía de los datos como base de la seguridad reglamentaria

Los crecientes requisitos de normativas de la UE como la Ley de IA o la Ley de Servicios Digitales plantean a los gestores de productos una tarea clara: los sistemas no sólo deben funcionar, sino también ser trazables y controlables en todo momento. Aquí es precisamente donde entra en juego la ventaja de una estructura de software dedicada y controlada de forma centralizada. Si tiene sus datos, procesos e interfaces bajo control, no sólo podrá cumplir los nuevos requisitos, sino darles forma activamente. Un solución ERP de gestión local como gFM Business permite precisamente este control: los datos se almacenan en su propio sistema, los procesos se documentan de forma transparente y los ajustes pueden aplicarse de forma selectiva, sin depender de plataformas externas. De este modo se crea una base estable para trazar claramente los requisitos normativos, ya sea para las obligaciones de documentación, los controles de acceso o la trazabilidad de las decisiones. Para los jefes de producto, esto significa sobre todo una cosa: menos incertidumbre, procesos más claros y la certeza de que su propio sistema seguirá siendo fiable incluso bajo requisitos cada vez mayores.

Los crecientes requisitos de normativas de la UE como la Ley de IA o la Ley de Servicios Digitales plantean a los gestores de productos una tarea clara: los sistemas no sólo deben funcionar, sino también ser trazables y controlables en todo momento. Aquí es precisamente donde entra en juego la ventaja de una estructura de software dedicada y controlada de forma centralizada. Si tiene sus datos, procesos e interfaces bajo control, no sólo podrá cumplir los nuevos requisitos, sino darles forma activamente. Un solución ERP de gestión local como gFM Business permite precisamente este control: los datos se almacenan en su propio sistema, los procesos se documentan de forma transparente y los ajustes pueden aplicarse de forma selectiva, sin depender de plataformas externas. De este modo se crea una base estable para trazar claramente los requisitos normativos, ya sea para las obligaciones de documentación, los controles de acceso o la trazabilidad de las decisiones. Para los jefes de producto, esto significa sobre todo una cosa: menos incertidumbre, procesos más claros y la certeza de que su propio sistema seguirá siendo fiable incluso bajo requisitos cada vez mayores.

¿Qué les queda a los ciudadanos de a pie y a las pequeñas empresas?

Si se observan todas estas novedades, queda claro que la UE intenta poner orden en un mundo digital que ha crecido en gran medida sin regulación durante muchos años. Los objetivos parecen comprensibles sobre el papel: protección, seguridad, transparencia. Pero al mismo tiempo, una densa red de normativas, mecanismos de comprobación y requisitos técnicos envuelve lenta pero perceptiblemente nuestra vida digital cotidiana.

Para las grandes empresas, se trata de una cuestión de recursos. Contratan abogados, adaptan sus procesos e invierten en nuevas herramientas. Para los ciudadanos normales y las pequeñas y medianas empresas, en cambio, esta evolución suele resultar confusa, a veces incluso amenazadora, no porque tengan algo que ocultar, sino porque intuyen que la naturaleza de la comunicación digital está cambiando.

Lo que los ciudadanos de a pie deben tener en cuenta

- Mantente alerta sin volverte loco. No es necesario que cunda el pánico, pero sí que seamos conscientes de que la comunicación en el espacio digital está cada vez más vigilada y filtrada, no necesariamente por personas, sino por sistemas, algoritmos y controles automatizados.

- Mantenga sus propios canales de información. Cuanto más se filtran y clasifican los contenidos, más importante resulta utilizar conscientemente distintas fuentes de información. No sólo las redes sociales, sino también los medios de comunicación tradicionales, los portales especializados y los boletines independientes.

- Comunicar conscientemente. No es necesario escribir públicamente cada pensamiento. Pero ayuda darse cuenta de que, en caso de duda, es más probable que las plataformas borren que dejen. Eso no significa menospreciarse, pero hay que entender cómo funcionan los mecanismos.

- No confíes en todas las IA - Pero tampoco hay que tenerle miedo. Si en el futuro los contenidos se etiquetan como generados por IA, esto puede ayudar a la gente a no tomárselo todo al pie de la letra. Al mismo tiempo, no debemos dejar de utilizar las herramientas de IA con sensatez y sentido de la proporción.

Qué deben tener en cuenta las pequeñas y medianas empresas

- Estructurar conscientemente la comunicación y la presencia en la plataforma. Secciones de comentarios, foros de apoyo, canales en las redes sociales... todos ellos pueden ser útiles, pero deben mantenerse bien. La nueva normativa obliga a las empresas a asumir su responsabilidad, pero esto puede gestionarse con profesionalidad.

- Documentar el uso de la IA. No todas las herramientas son problemáticas, pero las empresas deben saber dónde se utiliza la IA y comunicarlo abiertamente en caso de duda. Esto genera confianza y evita malentendidos.

- Crear normas internas claras. ¿Qué contenidos se publican? ¿Quién comprueba las quejas? ¿Qué plataformas utiliza realmente de forma activa? Una estructura clara elimina muchas incertidumbres.

- No pierdas tu propio camino. Las pequeñas empresas, en particular, prosperan gracias a su personalidad, su estilo propio y sus relaciones directas con los clientes. Ninguna ley les obliga a perder esto. Al contrario, en un mundo lleno de procesos automatizados, la auténtica humanidad parece hoy casi una ventaja competitiva.

Contenidos propios en lugar de intervenciones externas: Por qué tener una revista propia es estratégicamente crucial

Los acontecimientos actuales en torno al control del chat, la Ley de Servicios Digitales y la Ley de IA muestran claramente hacia dónde se dirige el viaje: las plataformas y los servicios digitales están cada vez más regulados, supervisados y obligados a rendir cuentas. Los grandes proveedores tienen que revisar los contenidos, evaluar los riesgos y, en algunos casos, incluso aplicar medidas de control de contenidos. Al mismo tiempo, hay propuestas para analizar más de cerca la comunicación o capturar contenidos automáticamente, lo que intensifica aún más el debate sobre la privacidad y el control. En este entorno, a menudo se subestima un punto: Cualquiera que publique sus contenidos exclusivamente a través de plataformas de terceros está inevitablemente sujeto a estas normas y a su interpretación. Nuestra propia revista En cambio, el nuevo sitio web sigue un principio probado: el contenido, la estructura y la publicación siguen en nuestras manos. Esto no sólo crea independencia, sino también estabilidad a largo plazo. Especialmente en tiempos de creciente regulación, no se trata de un lujo, sino de una decisión estratégica: hacia un mayor control, responsabilidades claras y una plataforma que no esté controlada desde fuera.

Los acontecimientos actuales en torno al control del chat, la Ley de Servicios Digitales y la Ley de IA muestran claramente hacia dónde se dirige el viaje: las plataformas y los servicios digitales están cada vez más regulados, supervisados y obligados a rendir cuentas. Los grandes proveedores tienen que revisar los contenidos, evaluar los riesgos y, en algunos casos, incluso aplicar medidas de control de contenidos. Al mismo tiempo, hay propuestas para analizar más de cerca la comunicación o capturar contenidos automáticamente, lo que intensifica aún más el debate sobre la privacidad y el control. En este entorno, a menudo se subestima un punto: Cualquiera que publique sus contenidos exclusivamente a través de plataformas de terceros está inevitablemente sujeto a estas normas y a su interpretación. Nuestra propia revista En cambio, el nuevo sitio web sigue un principio probado: el contenido, la estructura y la publicación siguen en nuestras manos. Esto no sólo crea independencia, sino también estabilidad a largo plazo. Especialmente en tiempos de creciente regulación, no se trata de un lujo, sino de una decisión estratégica: hacia un mayor control, responsabilidades claras y una plataforma que no esté controlada desde fuera.

Efecto poco claro en caso de emergencia: ¿Qué ocurre en caso de tensión?

Hasta ahora, sigue sin estar del todo claro cómo se desenvolvería todo el paquete de leyes de censura de la UE -desde la Ley de Servicios Digitales hasta los poderes de control ampliados- en un caso real de tensión. Hasta ahora, no hay experiencia fiable de cómo interactuarán en la práctica la multitud de disposiciones si los gobiernos nacionales justifican repentinamente intervenciones de gran alcance en las libertades de comunicación e información con referencia a amenazas externas o ataques híbridos.

Actualmente no está claro ni para los ciudadanos ni para las empresas qué restricciones podrían entrar en vigor en caso de emergencia, qué mecanismos existen para defenderse - o si las medidas individuales incluso entrarán en vigor automáticamente en un estado de emergencia.

En el artículo sobre el estado de excepción nacional se analizan en profundidad los posibles escenarios. Caída de tensión en Alemania, una perspectiva que hasta ahora no se ha destacado lo suficiente en el discurso político actual.

Una última reflexión

El futuro digital se caracterizará por las normas. Es inevitable y necesario en muchos ámbitos. Pero el factor decisivo es cómo nos enfrentamos a ellas como ciudadanos y empresarios. Quienes se mantengan informados, se comuniquen conscientemente y no se dejen intimidar por términos complicados conservarán su libertad, incluso en un entorno más regulado.

Quizá ese sea el verdadero mensaje: no confíes ciegamente, no rechaces ciegamente. En lugar de eso, entiende las cosas, clasifícalas y luego decide por ti mismo qué camino quieres tomar.

Preguntas más frecuentes

- ¿Qué quiere conseguir exactamente la UE con estas nuevas leyes digitales?

La UE quiere hacer más seguro Internet, combatir los abusos, frenar la difusión de contenidos ilegales y aumentar la transparencia sobre los medios de comunicación y los servicios digitales. La idea subyacente es que el marco jurídico actual ya no es suficiente porque los servicios digitales tienen ahora un enorme impacto en la sociedad y la democracia. Los objetivos parecen comprensibles, pero los medios previstos para alcanzarlos son de largo alcance y a veces controvertidos. - ¿Por qué algunos hablan de „leyes de censura“, aunque la UE lo niegue?

El término surge de la preocupación de que las elevadas multas y las definiciones poco claras („riesgos sistémicos“, „desinformación“) lleven a las plataformas a eliminar contenidos como medida de precaución. Esto crea de hecho una forma privatizada de censura, aunque no se denomine oficialmente como tal. Los críticos ven el problema no tanto en el texto legal en sí, sino en la forma en que las plataformas reaccionan ante él. - ¿Qué hace que Chatcontrol o CSAR sean tan controvertidos?

Porque esta ley permite potencialmente que las comunicaciones privadas sean escaneadas automáticamente. En términos técnicos, esto suele significar „escaneado del lado del cliente“, en el que el contenido se comprueba antes de ser encriptado. Los críticos dicen que esto crea una infraestructura que básicamente podría vigilar cualquier comunicación, independientemente de si estás haciendo algo ilegal o no. - ¿Ya se ha decidido Chatcontrol?

No. Hay una resistencia masiva, sobre todo de Alemania y otros países de la UE. El proyecto está políticamente estancado y algunas de sus partes se han revisado varias veces. Pero tampoco está fuera de la mesa: sigue planeando sobre las negociaciones. - ¿Qué significa la Ley de Servicios Digitales (DSA) para los ciudadanos de a pie?

Las contribuciones, comentarios o publicaciones en grandes plataformas pueden eliminarse más rápidamente si las plataformas categorizan algo como potencialmente ilegal o arriesgado. Los usuarios deben estar preparados para que el „filtro“ algorítmico sea más estricto. Al mismo tiempo, hay más derechos de transparencia: es más fácil averiguar por qué se ha bloqueado una publicación. - ¿Cómo afecta el ASD a las pequeñas y medianas empresas?

Las empresas que utilizan las redes sociales, permiten comentarios en blogs o utilizan plataformas de tiendas online se ven afectadas indirectamente. Su contenido puede ser más fácilmente objeto de restricciones, y tienen que prestar más atención a su propia moderación. Los errores en columnas de comentarios o foros pueden acarrear problemas legales. - ¿Qué regula la nueva Ley de Libertad de los Medios de Comunicación (EMFA)?

Su objetivo es proteger la independencia y diversidad de los medios de comunicación. Esto significa también que las plataformas no pueden bajar de categoría o bloquear medios reconocidos sin una buena razón. Sin embargo, los críticos temen que esto cree una especie de jerarquía mediática en la que se favorezca a los medios establecidos y se perjudique a las voces alternativas. - ¿Puede una empresa perder visibilidad „privilegiada“ a través del EMFA?

Sí, no directamente, pero sí indirectamente. El contenido de pequeños blogs o sitios web de empresas compite con „medios reconocidos“ cuya visibilidad está protegida por algoritmos. Esto puede significar que el contenido de la empresa aparezca de forma menos prominente en las plataformas porque estas tienen que aplicar estrategias de moderación más cuidadosas para los medios. - ¿Qué cambia para los ciudadanos con la Ley de IA?

En el futuro, muchos contenidos generados por IA -imágenes, textos, vídeos- tendrán que etiquetarse como generados por IA. Con ello se pretende crear transparencia para que la gente pueda reconocer si el autor es un humano o un algoritmo. Esto es especialmente importante en temas políticos o susceptibles de manipulación. - ¿Y qué significa la Ley de IA para las empresas?

Las empresas deben comprobar si utilizan la IA y cómo lo hacen: en marketing, atención al cliente o internamente. En función del nivel de riesgo, deben documentar, etiquetar o explicar cómo se utiliza la IA. Esto puede suponer trabajo adicional, pero también protege contra problemas legales a largo plazo. - ¿Por qué es tan importante la combinación de todas estas leyes?

Porque cada ley tiene su propia función, pero sólo cuando funcionan juntas tienen un mayor impacto: vigilancia de las comunicaciones privadas (CSAR), mayor control de las plataformas (DSA), jerarquización de los medios de comunicación (EMFA) y requisitos de etiquetado de la IA (Ley de IA). Los críticos dicen que esto crea un entorno en el que dominan el control, la conformidad y la cautela, con consecuencias para el debate, la creatividad y la libertad. - ¿Qué aconsejan los expertos a los ciudadanos de a pie para afrontar estos cambios?

Mantén la calma, pero atento. Mantenga sus propios canales de información, no lo deje todo en manos de una única plataforma y maneje conscientemente los contenidos privados o sensibles. Es importante comprender que la comunicación digital ya no se modera de forma „neutral“, sino que cada vez está más controlada por normas. - ¿Cómo pueden defenderse los ciudadanos de las decisiones erróneas tomadas por las plataformas?

La DSA te otorga nuevos derechos: puedes impugnar las decisiones de moderación, presentar quejas y exigir una exposición de motivos. Es un avance, pero requiere tiempo, perseverancia y, a veces, apoyo jurídico. - ¿Qué preparativos concretos deben hacer las pequeñas empresas en los próximos años?

Deberían crear normas internas claras de comunicación, controlar mejor las áreas de comentarios, documentar el uso de la IA y comprobar qué plataformas necesitan realmente. Merece la pena no dar publicidad a todo lo que pueda regularse internamente. - ¿Quiénes son los críticos serios de estas leyes?

Patrick Breyer (Parlamento Europeo), European Digital Rights (EDRi), la aplicación de mensajería Signal, investigadores de seguridad informática y numerosos expertos en derecho de los medios de comunicación. Sus críticas se basan menos en la ideología que en preocupaciones técnicas y constitucionales. - ¿Todas estas leyes son, en última instancia, censura?

Depende de a quién se pregunte. Los partidarios dicen que se trata de seguridad y orden. Los críticos dicen: aunque la „censura“ no esté en la ley, las obligaciones, las sanciones y la aversión al riesgo crean una restricción de facto de la visibilidad y la libertad. La verdad está probablemente en algún punto intermedio, pero la tendencia es clara: los espacios de comunicación están cada vez más regulados. - ¿Son estas nuevas normas peligrosas para la democracia?

No necesariamente per se - pero pueden llegar a serlo si se aplican incorrectamente o se amplían políticamente más tarde. La democracia se nutre del debate abierto, la crítica y la diversidad. Si las plataformas borran demasiado por miedo o si se vigilan los canales de comunicación, se puede debilitar la cultura democrática. - ¿Cómo debe reaccionar una empresa o un ciudadano a largo plazo?

La mejor manera es con una mezcla de serenidad informada y preparación práctica. No debe sentirse intimidado, pero tampoco ingenuo. Si eliges sabiamente tus canales de comunicación, creas transparencia y proteges tus propios datos, seguirás siendo capaz de actuar, incluso en un entorno cada vez más regulado.