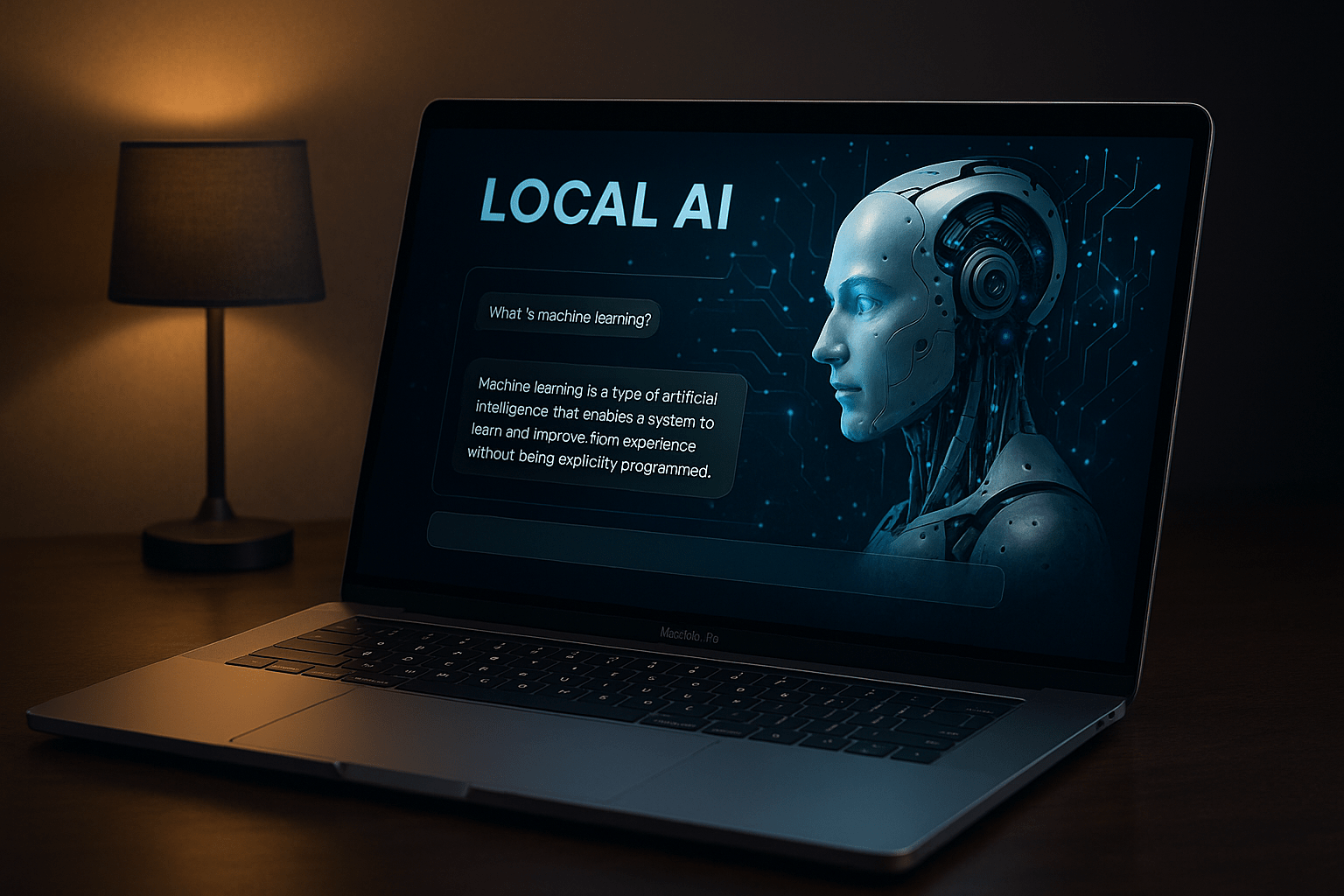

Lokale AI op de Mac is al lang praktisch - vooral op Apple-Silicon computers (M-serie). Met Ollama krijg je een slanke runtime-omgeving voor veel open source taalmodellen (bijv. Llama 3.1/3.2, Mistral, Gemma, Qwen). De huidige Ollama versie komt nu ook met een gebruiksvriendelijke app waarmee je met een muisklik een lokaal taalmodel op je Mac kunt instellen. In dit artikel vind je een pragmatische gids van installatie tot de eerste prompt - met praktische tips over waar het traditioneel vaak misgaat.

Voordelen van lokale AI ten opzichte van cloudsystemen

Een lokaal taalmodel zoals Ollama op de Mac biedt doorslaggevende voordelen die moeilijk te overtreffen zijn, vooral voor bedrijven, ontwikkelaars en gegevensbeschermingsbewuste gebruikers.

Gegevenssoevereiniteit & gegevensbescherming

Alle vragen en antwoorden blijven volledig op je eigen computer. Gevoelige informatie - klantgegevens, interne strategiedocumenten of medische gegevens - verlaat nooit het lokale systeem. Er zijn geen logbestanden of analysemechanismen van een cloudprovider die onbedoeld of opzettelijk geanalyseerd kunnen worden.

Geen afhankelijkheid van services van derden

Cloudsystemen kunnen prijsmodellen wijzigen, toegangsbeperkingen invoeren of individuele functies uitschakelen. Met een lokale installatie heb je volledige controle over de runtime-omgeving, versies en modelvarianten. Je voert updates uit wanneer jij dat wilt - niet wanneer een provider dat dicteert.

Berekenbare kosten

In plaats van doorlopende kosten per aanvraag of maand, doe je een eenmalige investering in hardware (bijvoorbeeld een Mac met voldoende RAM) en werk je vervolgens onbeperkt met het model. Voor rekenintensieve taken kun je de hardware gericht uitbreiden zonder je zorgen te maken over stijgende API-rekeningen.

Offline mogelijkheid

Een lokaal model werkt ook als er geen internetverbinding beschikbaar is - bijvoorbeeld op reis, op bouwplaatsen of in sterk beveiligde netwerken zonder externe toegang.

Hoge flexibiliteit en integratie in bestaande systemen

Een ander voordeel van lokale AI-systemen is hun integratievermogen. Omdat Ollama een lokale API-server biedt, kan bijna elke toepassing worden aangesloten - van eenvoudige scripts tot complexe ERP-systemen.

FileMaker aansluiting

Met behulp van de Ollama API, kan FileMaker sturen prompts rechtstreeks naar het model en op te slaan antwoorden in velden met slechts een paar regels script code of via MBS plugin oproepen. Hierdoor kunnen geautomatiseerde tekstanalyses, classificaties, vertalingen of samenvattingen van de inhoud volledig worden geïmplementeerd binnen FileMaker - zonder cloud-latentie en zonder risico's op gegevensbescherming.

Geautomatiseerde workflows

Met het lokale API-eindpunt kunnen ook tools zoals Zapier, n8n of aangepaste Python/bash-scripts worden geïntegreerd. Hierdoor kunnen complexe processen worden geautomatiseerd, zoals het extraheren van informatie uit e-mails, het genereren van rapporten of het maken van tekstmodules voor documenten.

Volledige controle over modelvarianten

Je kunt verschillende modellen parallel laten draaien, ertussen schakelen of speciale compartimentmodellen laden die geoptimaliseerd zijn voor je project. Aanpassingen zoals fijnafstelling of LoRA-modellen kunnen ook lokaal worden uitgevoerd.

Praktisch voordeel: reactiesnelheid en latentie

Een factor die vaak wordt onderschat is de reactiesnelheid. Terwijl cloud LLM's vaak vertraging oplopen door netwerkpaden, API-limieten of serverbelasting, reageren lokale modellen - afhankelijk van de hardware - bijna in realtime. Vooral bij repetitieve taken of interactieve processen (bijvoorbeeld tijdens een presentatie of live gegevensanalyse in FileMaker) kan dit het verschil maken tussen "soepel werken" en "wachtende frustratie".

Welke hardware is geschikt voor het draaien van lokale taalmodellen, welke modellen hebben welke voordelen en een Vergelijking tussen Apple Silicon en NVIDIA zijn in een apart artikel behandeld.

Huidig onderzoek naar het gebruik van lokale AI-systemen

1) Vereisten & algemene voorwaarden

macOS 12 "Monterey" of nieuwer (aanbevolen: nieuwste Sonoma/Sequoia). Voor de officiële macOS-download is Monterey+ vereist. ollama.com

Apple Silicon (M1-M4) heeft de voorkeur. Draait ook op Intel Macs, maar Apple-Silicon is veel efficiënter; grote modellen hebben veel RAM/geheugen nodig. (Voor bibliotheek/modelgroottes zie de Ollama bibliotheek.) ollama.com

Poort 11434 wordt lokaal gebruikt voor de API. Noteer de poort - het is belangrijk voor tests en integraties later. GitHubollama.readthedocs.io

Sceptisch advies in de goede oude traditie: "Install and go" werkt meestal - knelpunten zijn RAM-/diskruimte (grote GGUF-bestanden), verkeerde modelvariant of parallelle processen die de poort blokkeren.

2) Ollama installieren (Mac)

Je hebt twee schone manieren - GUI-installatie of Homebrew. Beide zijn correct; kies de stijl die bij je dagelijkse leven past.

OPTIE A: OFFICIEEL MACOS INSTALLATIEPROGRAMMA (DMG)

Ollama downloaden voor macOS van de officiële site.

Open DMG, sleep app naar "Programma's", start.

(MacOS 12+ vereist.) ollama.com

Als je deze variant 1TP12 gebruikt, kun je de macOS software direct gebruiken om het model te downloaden. Alle volgende terminalcommando's hebben alleen betrekking op het kunnen automatiseren van het taalmodel via een script.

VARIANT B: HOMEBREW (CLI, CLEAN SCRIPTABLE)

Open de terminal en update (indien nodig) Homebrew:

brew update

Fust (App-variant) 1TP12Dieren:

brew install --cask ollama-app

(Toont meestal de huidige desktop-app; vanaf vandaag 0.11.x.) Homebrew Formules

Of de formule (CLI-pakket) installieren:

brew install ollama

(Binairen beschikbaar voor Apple-Silicon/Intel.) Homebrew Formules

Versie controleren:

ollama --version

(Basiscommando's en varianten zijn gedocumenteerd in de officiële documentatie & in de GitHub repo). GitHub

3) Service/server starten en testen

Ollama wordt geleverd met een lokale server. Start deze expliciet indien nodig:

ollama serve

Als de service al draait (bijvoorbeeld via de app), kan de shell melden dat poort 11434 in gebruik is - dan is alles in orde.

De server luistert standaard naar http://localhost:11434.

Functietest in de browser:

Bel http://localhost:11434/ - de instantie moet reageren (sommige instructies gebruiken deze controle omdat de poort standaard actief is). Medium

Traditionele voorzichtigheid: als er niets reageert, blokkeert vaak een oud proces of een beveiligingssuite. Controleer of er nog een tweede terminal draait met ollama serve - of sluit de app af of start hem opnieuw op.

4) Het eerste taalmodel laden en gebruiken

4.1 MODEL TREKKEN OF DIRECT STARTEN (RUN)

Direct gebruiken (trekken + rennen in één):

ollama run llama3.1

Alleen downloaden:

ollama pull llama3.1

De officiële repo toont de veelgebruikte commando's (run, pull, list, show, ps, stop, rm) en voorbeelden met onder andere Llama 3.2; identiek voor Llama 3.1, Mistral, Gemma etc. GitHubnotes.kodekloud.comglukhov.org

Meer modelpagina's/bibliotheek:

Llama 3 / 3.1 / 3.2 in verschillende maten (1B-405B; de grote versies zijn natuurlijk ook in hoge aantallen verkrijgbaar). Bel gewoon de Website van Ollama om andere modellen te vinden en installiere ze op je Mac.

4.2 INTERACTIEVE CHAT (TERMINAL)

Start bijvoorbeeld Llama 3.1 in chatmodus:

ollama run llama3.1

Typ dan direct:

Je bent een behulpzame assistent. Leg me in twee zinnen uit wat een index in een database is.

Sluit af met Ctrl+D.

Als je het programma Ollama op je Mac start, kun je ook direct een model selecteren en een prompt invoeren. Als het model nog niet beschikbaar is op uw Mac, wordt het automatisch gedownload.

4.3 MODELLEN BEHEREN

# Welke modellen zijn lokaal verkrijgbaar?

ollama list

# Details/kwantificering/tags weergeven:

ollama show llama3.1

# Lopende modelprocessen controleren:

ollama ps

# Stop met het uitvoeren van het model:

ollama stop llama3.1

# Ruimte vrijmaken (model verwijderen):

ollama rm llama3.1

(De commando's zijn identiek in verschillende huidige overzichten gedocumenteerd.) notes.kodekloud.comGeshan's Blogglukhov.org

5) HTTP API lokaal gebruiken (bijv. voor scripts, tools, integraties)

Ollama biedt een REST API (standaard http://localhost:11434). Voorbeeldoproepen:

Genereren (eenvoudige prompt):

curl http://localhost:11434/api/generate -d '{

"model": "llama3.1",

"prompt": "Erkläre kurz den Unterschied zwischen RAM und SSD.",

"stream": false

}'

Chat (rolgebaseerd):

curl http://localhost:11434/api/chat -d '{

"model": "llama3.1",

"messages": [

{ "role": "system", "content": "Du antwortest knapp und sachlich." },

{ "role": "user", "content": "Was ist eine Normalisierung in Datenbanken?" }

],

"stream": false

}'

(Eindpunten, streaminggedrag en velden worden beschreven in de officiële API-documentatie/GitHub beschreven).

Bereikbaarheidstip:

Lokaal is alles toegankelijk via localhost.

Als de Mac toegankelijk moet zijn in het LAN, bind Ollama dan met opzet aan een netwerkadres, bijv:

export OLLAMA_HOST=0.0.0.0 ollama serve

(De server is dan toegankelijk via het IP-adres in het netwerk. Controleer het beveiligingsaspect!) Reddit

Mixed-Content/HTTPS (alleen als browserintegraties niet werken):

Sommige invoegtoepassingen/browsers (vooral Safari) blokkeren HTTP-oproepen vanuit HTTPS-contexten. In zulke gevallen helpt een lokale reverse proxy met HTTPS.

6) Praktische tips voor de Mac (ervaring & conservatieve zorg)

- Begin conservatief met modelselectieBegin met kleinere kwantisaties (bijv. 4-bits varianten), controleer de kwaliteit en voer de verdeelsleutel dan langzaam op.

- Geheugen & schijf in de gaten houden: Grote modellen nemen meerdere GB in beslag - ollama show helpt met categoriseren. notes.kodekloud.com

- Apple-Silicon & MetaalOllama gebruikt Apple versnelling (Metal) op de Mac. Driver/Metal fouten kunnen optreden bij zeer recente model builds - houd Ollama up-to-date en houd bekende problemen in de gaten. GitHub

- HavenconflictenAls ollama serve klaagt, luistert de app of een ander proces al naar 11434 - sluit de app of stop de CLI-server. postman.com

7) Frequente minimale workflows (kopiëren & plakken)

A) Nieuweinstallatie & eerste chat (Llama 3.1)

# Installation (eine Variante wählen) brew install --cask ollama-app # oder brew install ollama# Server starten (falls App nicht läuft) ollama serve # Erstes Modell testen ollama run llama3.1

("Run" laadt het model als het nog niet bestaat.) Homebrew Formulae+1GitHub

B) Model offline voorbereiden (eerst trekken, later gebruiken)

ollama pull mistral ollama show mistral ollama run mistral

("mistral" is een algemeen, compact model - goed voor eerste tests).

C) API-integratie in een script/tool

curl http://localhost:11434/api/generate -d '{

"model": "llama3.1",

"prompt": "Geef me drie conservatieve redenen om documentatie boven automatisering te verkiezen."

}‘

(API-voorbeelden zijn 1:1 van de officiële referentie overgenomen uit)

8) Waar kan ik modellen vinden?

De Ollama bibliotheek bevat gecureerde modellen met tags/afmetingen (Llama 3.1/3.2, Gemma, Qwen, enz.). Kies bewust op basis van doel (chat, tools, embeddings) en grootte. Je kunt nieuwe modellen direct maken in de Ollama app op de Mac of op de Website van Ollama vinden.

9) Wat te doen als het misgaat?

- lijst met ollama's / ollama ps controleren: Is het gewenste model beschikbaar/actief?

- ollama toon Bekijken: Welke kwantisatie/grootte werd geladen? Komt dit overeen met het RAM-geheugen van de Mac? notes.kodekloud.com

Update:

brew upgrade ollama ollama-app

Bekijk problemenMetaalfouten komen soms voor, vooral bij zeer nieuwe modellen/functies; een update of verandering van modelvariant helpt vaak.

10) Alternatieven met Mac-comfort (GUI)

Als je liever een grafische interface met meer opties gebruikt of graag door modellen bladert/verandert:

LM Studio - een populair Mac-frontend met geïntegreerde downloader, chat UI en lokale API-server. Downloadpagina en release notes gelinkt. LM Studio+1Uptodown

(Er zijn ook UI's van derden zoals Open WebUI die verbonden kunnen worden met Ollama - maar voor de meeste Mac opstellingen is Ollama + Terminal of LM Studio voldoende).

Met Ollama zet je in een paar minuten een lokale LLM-omgeving op de Mac op - op een klassieke, begrijpelijke manier en zonder afhankelijkheid van de cloud. Volg de beproefde stappen (Installer/Brew → ollama serve → ollama run), controleer de bronnen en werk van klein naar groot. Als je liever klikt dan typt, is LM Studio een goed alternatief op de Mac. ollama.comGitHubLM Studio

Veel succes - en blijf kritisch met een systeem: eerst goed documenteren, dan automatiseren.

Nieuwe artikelreeks: ChatGPT-gegevensexport gebruiken als persoonlijk AI-geheugen

Als je al een lokale AI hebt met Ollama op de Mac installiert, kun je de volgende stap nemen: het bouwen van je eigen kennissysteem. In een nieuwe serie artikelen laat ik je zien hoe de ChatGPT-gegevensexport gebruiken om een persoonlijke kennisdatabase te maken. In plaats van dat gesprekken verdwijnen in de chatgeschiedenis, kunnen ze worden geëxporteerd, op een gestructureerde manier worden verwerkt en worden geïntegreerd in een vectordatabase. Zo ontstaat een AI die toegang heeft tot je eigen gedachten, ideeën en analyses. De serie neemt je stap voor stap mee door het hele proces - van data-export tot insluiting en integratie in een RAG-systeem. Op deze manier worden eenvoudige chatgeschiedenissen geleidelijk een digitaal geheugen voor je eigen AI.

Als je al een lokale AI hebt met Ollama op de Mac installiert, kun je de volgende stap nemen: het bouwen van je eigen kennissysteem. In een nieuwe serie artikelen laat ik je zien hoe de ChatGPT-gegevensexport gebruiken om een persoonlijke kennisdatabase te maken. In plaats van dat gesprekken verdwijnen in de chatgeschiedenis, kunnen ze worden geëxporteerd, op een gestructureerde manier worden verwerkt en worden geïntegreerd in een vectordatabase. Zo ontstaat een AI die toegang heeft tot je eigen gedachten, ideeën en analyses. De serie neemt je stap voor stap mee door het hele proces - van data-export tot insluiting en integratie in een RAG-systeem. Op deze manier worden eenvoudige chatgeschiedenissen geleidelijk een digitaal geheugen voor je eigen AI.

Veelgestelde vragen

- Wat betekent „lokale AI“ eigenlijk en waarom zou ik een taalmodel op mijn eigen Mac laten draaien?

Lokale AI betekent dat een taalmodel volledig op je eigen computer draait in plaats van externe servers te benaderen via een internetverbinding. Het model draait lokaal 1TP12 en verwerkt je input direct op je apparaat. De belangrijkste voordelen zijn gegevensbescherming, controle en onafhankelijkheid: je gegevens verlaten je computer niet, er zijn geen API-kosten en je bent niet afhankelijk van cloudproviders. Tegelijkertijd kun je het systeem aanpassen aan je eigen behoeften, je eigen gegevens integreren of zelfs je eigen workflows ontwikkelen. Voor veel gebruikers - zoals ontwikkelaars, auteurs of bedrijven met gevoelige gegevens - is lokale AI daarom een bijzonder interessant alternatief voor cloudservices. - Welke voordelen biedt Ollama vergeleken met andere tools voor lokale taalmodellen?

Ollama is snel uitgegroeid tot een van de populairste tools voor lokale AI, omdat het veel complexe stappen sterk vereenvoudigt. In plaats van het handmatig downloaden, configureren en starten van modellen, neemt Ollama deze taken grotendeels automatisch over. Een taalmodel kan meestal worden gemaakt en gestart met een enkel install commando. Ollama biedt ook een REST API zodat modellen eenvoudig geïntegreerd kunnen worden in eigen programma's - zoals scripts, databases of applicaties. Dit maakt Ollama zowel geschikt voor beginners die snel een model willen uitproberen als voor ontwikkelaars die lokale AI willen integreren in hun eigen softwareprojecten. - Aan welke eisen moet mijn Mac voldoen om een taalmodel lokaal te kunnen uitvoeren?

Voor goede resultaten raden we een Mac aan met een Apple-Silicon processor (M1, M2, M3 of nieuwer). Deze chips hebben een architectuur die bijzonder geschikt is voor AI-berekeningen, bijvoorbeeld door gedeelde geheugenstructuren en GPU-versnelling. Het is ook belangrijk om voldoende geheugen en voldoende vrije opslagruimte te hebben, aangezien taalmodellen meerdere gigabytes groot kunnen zijn. Kleinere modellen werken al op apparaten met een matig geheugen, terwijl grotere modellen aanzienlijk meer RAM-geheugen nodig hebben. Een actuele macOS-versie is ook handig, omdat veel AI-tools geoptimaliseerd zijn voor moderne systeembibliotheken. - Welke taalmodellen kan ik gebruiken met Ollama op mijn Mac?

Ollama ondersteunt een reeks moderne open source taalmodellen. Dit zijn bijvoorbeeld varianten van Llama, Mistral, Gemma of Qwen. Deze modellen verschillen in grootte, prestaties en stijl. Sommige zijn vrij compact en draaien snel op kleinere computers, andere zijn groter en geven complexere antwoorden. Het grote voordeel: je kunt verschillende modellen relatief eenvoudig uitproberen en vergelijken zonder dat je je infrastructuur opnieuw hoeft op te bouwen. Dit creëert een flexibele omgeving waarin u het model kunt kiezen dat het beste bij uw taken past. - Hoe ingewikkeld is de installatie van een lokaal taalmodel met Ollama eigenlijk?

Installatie is veel eenvoudiger geworden dan een paar jaar geleden. In veel gevallen bestaat het proces uit slechts een paar stappen: Eerst installier Ollama op je Mac, dan een taalmodel downloaden en starten via de terminal of een grafische gebruikersinterface. Het model wordt automatisch voorbereid en kan dan direct worden gebruikt. Veel gebruikers zijn verbaasd over hoe snel dit proces werkt. Zelfs zonder diepgaande technische kennis is het mogelijk om binnen een paar minuten een werkend lokaal AI-systeem op te zetten. - Waarom werkt lokale AI bijzonder goed op Apple-Silicon Macs?

Apple-Silicon processoren zijn ontwikkeld met het oog op moderne rekentaken, waaronder machine learning. Ze maken gebruik van een zogenaamde unified memory architectuur, waarbij de CPU, GPU en andere rekeneenheden hetzelfde geheugen gebruiken. Hierdoor kunnen grote hoeveelheden gegevens efficiënter worden verwerkt. Dit is een groot voordeel voor AI-modellen omdat taalmodellen tijdens de inferentie constant toegang moeten hebben tot grote gegevensstructuren. Tools zoals Ollama of MLX maken gericht gebruik van deze architectuur en behalen daardoor verrassend goede prestaties - zelfs zonder een speciale grafische kaart. - Hoe snel werkt een lokaal taalmodel op een Mac?

De snelheid hangt voornamelijk af van drie factoren: het gebruikte model, het RAM-geheugen van de Mac en de prestaties van de processor. Kleinere modellen reageren vaak bijna in realtime, terwijl grotere modellen langzamer kunnen werken. Macs van Apple-Silicon zijn echter verrassend krachtig en kunnen veel populaire modellen met gemak uitvoeren. Voor experimentele projecten of persoonlijke werkprocessen zijn de prestaties meestal meer dan voldoende. Als u bijzonder snelle reacties nodig hebt, kunt u kleinere of meer gecomprimeerde modellen gebruiken. - Kan ik ook offline werken met een lokale AI?

Ja, dat is een van de grootste voordelen. Zodra het model is gedownload, is er geen internetverbinding meer nodig. Alle berekeningen vinden direct op je Mac plaats. Dit betekent dat je de AI ook onderweg kunt gebruiken, zonder netwerk of in geïsoleerde omgevingen. Voor veel professionele toepassingen - zoals gevoelige documenten of interne analyses - is deze offline mogelijkheid een doorslaggevend voordeel. - Hoe veilig zijn mijn gegevens als ik lokaal een taalmodel gebruik?

Als het model volledig lokaal draait, blijven je gegevens altijd op je computer staan. Er is geen automatische overdracht naar externe servers. Dit betekent dat je met vertrouwelijke teksten kunt werken zonder dat je je zorgen hoeft te maken over cloudopslag of ongeautoriseerde toegang. Natuurlijk hangt de beveiliging nog steeds af van hoe je systeem is geconfigureerd - bijvoorbeeld of andere programma's toegang hebben tot je gegevens. Maar in principe biedt een lokale AI aanzienlijk meer controle over je eigen informatie. - Kan ik een lokaal taalmodel trainen of uitbreiden met mijn eigen gegevens?

Ja, dit is mogelijk, maar meestal niet rechtstreeks via het basissysteem. Veel gebruikers combineren lokale taalmodellen met zogenaamde RAG-systemen of databases om hun eigen inhoud te integreren. Hierbij worden documenten of teksten geanalyseerd en opgeslagen in een vectordatabase. Het taalmodel kan later toegang krijgen tot deze inhoud en deze verwerken in zijn antwoorden. Op deze manier kan een AI zich specialiseren in zijn eigen kennis zonder dat het model zelf volledig opnieuw hoeft te worden getraind. - Wat is het verschil tussen een taalmodel en een AI-app zoals ChatGPT?

Een taalmodel is eigenlijk gewoon de „motor“ van de AI - het neurale netwerk dat teksten analyseert en genereert. Diensten zoals ChatGPT zijn daarentegen complete platforms die een model combineren met een gebruikersinterface, cloud-infrastructuur en aanvullende functies. Als je een taalmodel lokaal installier gebruikt, werk je direct met dit kernsysteem. Dit geeft je meer controle, maar je moet ook zelf beslissen welke aanvullende tools of interfaces je wilt gebruiken. - Hoeveel opslagruimte heeft een lokaal taalmodel nodig op de Mac?

De grootte van een taalmodel kan sterk variëren. Kleine modellen hebben slechts enkele gigabytes geheugen nodig, terwijl grotere varianten aanzienlijk meer ruimte in beslag kunnen nemen. Er is ook RAM nodig om het model te laden tijdens de uitvoering. Voor veel praktische toepassingen volstaan echter compacte modellen die relatief weinig geheugen gebruiken en toch verrassend krachtig zijn. - Kan ik meerdere modellen tegelijk laten werken op mijn Mac 1TP12?

Ja, dit is eigenlijk een groot voordeel van lokale AI-omgevingen. Je kunt verschillende modellen downloaden en naar behoefte starten. Sommige zijn beter geschikt voor creatieve teksten, andere voor technische analyses of programmacode. Dankzij deze flexibiliteit kun je je AI-omgeving als een gereedschapskist gebruiken en het model kiezen dat het beste bij de taak past. - Kan Ollama ook worden geïntegreerd in jullie eigen programma's?

Ja, Ollama biedt een application programming interface (API) die andere toepassingen kunnen gebruiken om toegang te krijgen tot het taalmodel. Hierdoor kun je lokale AI integreren in je eigen projecten, bijvoorbeeld in scripts, automatiseringen of databasesystemen. Ontwikkelaars gebruiken deze optie vaak om AI-assistenten op maat te maken of om intelligente functies toe te voegen aan bestaande software. - Is een lokaal taalmodel net zo krachtig als grote cloudmodellen?

In veel gevallen niet helemaal, tenminste niet als je zeer grote modellen met miljarden parameters vergelijkt. Cloudproviders werken met extreem krachtige hardware en kunnen daarom zeer grote modellen draaien. Lokale modellen zijn vaak compacter zodat ze op een normale computer kunnen draaien. Toch zijn ze verbazingwekkend krachtig voor veel praktische taken en kunnen ze teksten schrijven, analyseren of structureren. Deze prestaties zijn voor veel werkprocessen volledig toereikend. - Waarom zijn steeds meer mensen geïnteresseerd in lokale AI in plaats van cloudservices?

Een belangrijke reden is de controle over gegevens en infrastructuur. Veel gebruikers willen hun inhoud niet permanent overbrengen naar externe diensten. Lokale systemen kunnen op lange termijn ook goedkoper zijn omdat er geen lopende API-kosten zijn. Voor ontwikkelaars en technisch onderlegde gebruikers is er nog een voordeel: ze kunnen hun AI-omgeving zelf ontwerpen en ermee experimenteren. Dit creëert een nieuwe vorm van technische soevereiniteit. - Kan ik een lokale AI later combineren met andere systemen?

In feite is dit een van de meest opwindende mogelijkheden. Lokale taalmodellen kunnen worden gekoppeld aan databases, automatiseringsplatforms of eigen programma's. Dit kan resulteren in complexe workflows. Dit kan resulteren in complexe workflows - zoals systemen die documenten analyseren, inhoud samenvatten of kennis ophalen uit hun eigen databases. Dergelijke combinaties vormen vaak de basis voor op maat gemaakte AI-assistenten of geautomatiseerde analysetools. - Voor wie is een lokale AI op de Mac bijzonder de moeite waard?

Het is vooral interessant voor ontwikkelaars, auteurs, analisten en bedrijven die regelmatig met teksten of gegevens werken. Lokale AI is ook een interessante optie voor tech-savvy gebruikers die hun digitale infrastructuur zelf willen beheren. Het maakt het mogelijk om moderne AI-technologie te gebruiken zonder afhankelijk te zijn van grote platforms. Vooral op krachtige Macs creëert dit een omgeving die verrassend veelzijdig en productief kan zijn.