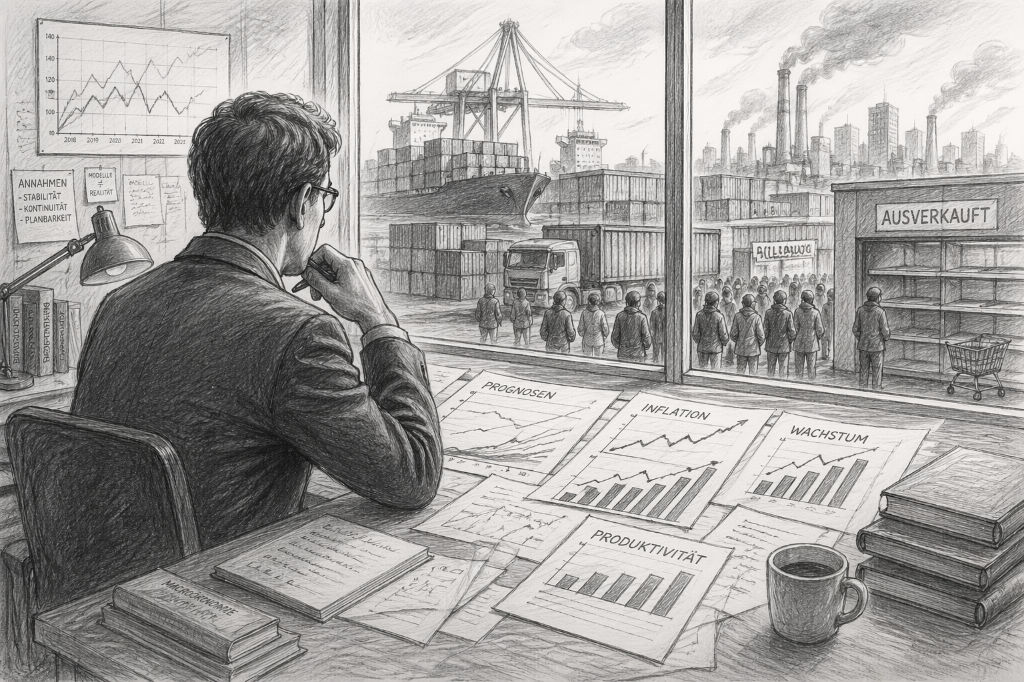

Incluso durante la pandemia de coronavirus, muchos economistas se mostraron sorprendentemente unánimes: el gran peligro era una fase de baja inflación, quizá incluso de deflación. Pocos años después, el panorama era distinto. La inflación alcanzó máximos históricos en muchos países, las cadenas de suministro se colapsaron y la evolución económica resultó distinta de la esperada.

La pandemia no fue sólo una crisis sanitaria, sino también una prueba de resistencia para las previsiones económicas. Este artículo muestra dónde se equivocaron los expertos, por qué fue así y qué lecciones pueden extraerse para futuras evaluaciones.